Der Begriff Deepfake tauchte erstmals 2017 auf Reddit auf.als ein Nutzer mit demselben Benutzernamen anfing, veränderte Videos zu teilen, bei denen die KI Gesichter austauschte, zunächst bei Inhalten für Erwachsene.

Während Reddit das ursprüngliche Subreddit verbot, hatte sich die Idee bereits durchgesetzt.

Aber die Wurzeln dieser Technologie reichen noch weiter zurück.

Bereits 1997 hatten Forscher begonnen, mit der Videobearbeitung durch maschinelles Lernen zu experimentieren.

Ihr frühes Tool für die Lippensynchronisation, genannt Video umschreiben könnte den Anschein erwecken, dass jemand etwas gesagt hat, was er nicht gesagt hat.

Nach heutigen Maßstäben war es zwar kein Deepfake, aber es legte den Grundstein für das, was danach kommen sollte.

Im heutigen Blog geht es darum, wie diese sich entwickelnde Technologie funktioniert, wo sie im Alltag auftaucht und welche Risiken und Vorteile sie mit sich bringt.

Beginnen wir damit, zu verstehen, was ein Deepfake eigentlich ist.

Wichtigste Erkenntnisse:

- Deepfakes sind KI-generierte Medien, die den Anschein erwecken, dass Menschen Dinge sagen oder tun, die sie in Wirklichkeit nie getan haben.

- Mit kostenlosen Tools und grundlegenden Kenntnissen kann nun fast jeder überzeugende Deepfake-Videos, -Bilder oder -Audioclips erstellen.

- Deepfakes können zwar kreativ oder unterhaltsam sein, aber sie bergen auch ernste Risiken wie Betrug, Verleumdung und Fehlinformationen.

- Sie können die meisten Deepfakes erkennen, indem Sie Tools zur Erkennung verwenden oder genau auf visuelle und verhaltensbezogene Ungereimtheiten achten.

Was ist ein Deepfake?

Ein Deepfake ist ein gefälschtes Medium, in der Regel ein Video, ein Audioclip oder ein Bild, das mit Hilfe künstlicher Intelligenz so verändert wurde, dass eine Person so aussieht oder klingt, als würde sie etwas tun oder sagen, was sie in Wirklichkeit nicht getan hat.

Verwechseln Sie das nicht mit einer schlechten Photoshop-Arbeit oder einem unvollständigen Kommentar.

Es geht um Manipulationen auf hohem Niveau mit einer Technologie namens Deep Learning, die eine Untergruppe der KI ist.

Machen Sie sich nie wieder Sorgen, dass KI Ihre Texte erkennt. Undetectable AI Kann Ihnen helfen:

- Lassen Sie Ihr AI-unterstütztes Schreiben erscheinen menschenähnlich.

- Bypass alle wichtigen KI-Erkennungstools mit nur einem Klick.

- Verwenden Sie AI sicher und zuversichtlich in Schule und Beruf.

Das ist es, was der Begriff "Deepfake" impliziert: Deep Learning und gefälschte Inhalte.

Das Ziel eines Deepfakes ist es in der Regel, etwas zu schaffen, das echt genug aussieht, um Menschen zu täuschen.

Vielleicht kennen Sie diese viralen Videos von Prominenten, die bizarre Dinge tun, oder von Politikern, die unverschämte Aussagen machen, die sie nie wirklich sagen würden.

Das sind klassische Anwendungsfälle für Deepfake. Was Sie sehen, ist nicht echt, aber die Technik dahinter ist so gut geworden, dass Ihr Gehirn die Fälschung nicht sofort erkennt, es sei denn, Sie schauen genau hin.

Das ist der Grund, warum Tools wie TruthScan eintreten.

TruthScan wurde für Organisationen entwickelt, die Medien in großem Umfang überprüfen müssen - Unternehmen, Nachrichtenredaktionen, Universitäten und öffentliche Einrichtungen. Es hilft Teams, Manipulationen zu erkennen, bevor falsche Inhalte das Vertrauen oder den Ruf schädigen.

Laut dem Forschungsteam von Undetectable AI ist es sogar so, dass 85 % der Amerikaner sagen, dass Deepfakes ihr Vertrauen in Online-Informationen untergraben haben.

Sie haben soeben erfahren, was ein Deepfake-Video oder -Medium eigentlich ist, und nun erfahren Sie, wie die Leute es herstellen.

Wie Deepfakes gemacht werden

Die Technologie, die hinter den meisten Deepfakes steckt, ist eine Kategorie von Algorithmen für maschinelles Lernen, die als generative adversarische Netzwerke (GANs) bezeichnet werden.

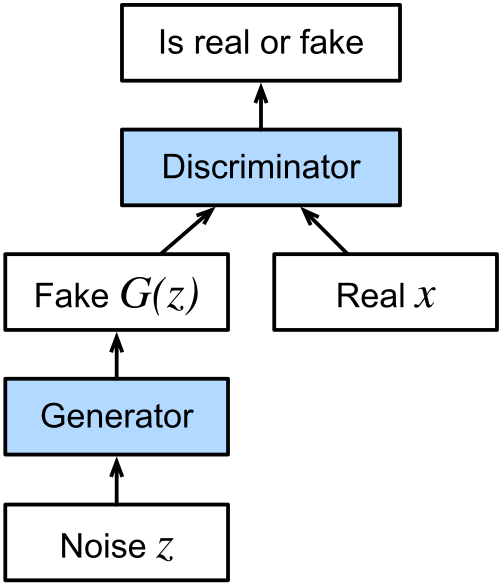

GANs setzen sich aus zwei Teilen zusammen: einem Generator und einem Diskriminator.

Der Generator erstellt gefälschte Medien auf der Grundlage dessen, was er zu replizieren trainiert wurde, und die Aufgabe des Diskriminators ist es, zu erkennen, was gefälscht aussieht.

Sie gehen so lange hin und her, bis der Generator besser darin wird, gefälschte Inhalte zu erstellen, die den Test des Diskriminators bestehen können.

Mit der Zeit führt dieses Hin und Her zu Medien, die schockierend realistisch aussehen.

Was ist ein Deepfake-Video-Generierungsprozess?

Bei der Erstellung eines Deepfake-Videos analysiert das System Videos aus mehreren Blickwinkeln, untersucht, wie die Person spricht, wie sich ihr Gesicht bewegt und wie sich ihr Körper bewegt.

All diese Informationen werden in den Generator eingespeist, so dass er Inhalte erstellen kann, die diese Verhaltensweisen nachahmen.

Dann hilft der Diskriminator bei der Feinabstimmung, indem er auf Fehler hinweist, bis das Endergebnis genau richtig aussieht.

Deshalb hält sich die Illusion auch so gut in Bewegung.

Je nach Zweck des Deepfake-Videos werden verschiedene Techniken eingesetzt.

Wenn es darum geht, jemanden so aussehen zu lassen, als würde er in einem Video etwas sagen oder tun, was er in Wirklichkeit nicht gesagt oder getan hat, dann handelt es sich um einen so genannten Deepfake eines Quellenvideos.

Ein Deepfake-Autoencoder, der aus einem Encoder und einem Decoder besteht, untersucht das ursprüngliche Filmmaterial und überträgt die Mimik, Gestik und die subtilen Kopfbewegungen der Zielperson darauf.

Audio Deepfakes

Bei einem Audio-Deefake wird die Stimme einer Person geklont, wiederum mit Hilfe von GANs, die auf Aufnahmen der natürlichen Sprechweise basieren.

Sobald das Modell trainiert ist, kann es neue Sprache in dieser Stimme erzeugen, auch wenn die Person diese Worte nie gesagt hat.

Eine weitere Ebene, die oft hinzugefügt wird, ist die Lippensynchronisation.

Hier ordnet das System generierte oder vorab aufgezeichnete Audiodaten einem Video zu.

Ziel ist es, dass die Lippen im Video mit den Wörtern im Audio übereinstimmen.

Beispiele für Deepfakes aus der realen Welt

Deepfakes tauchen in diesen Tagen überall auf.

Im Folgenden stellen wir Ihnen einige beliebte Deepfakes vor, die zeigen, wie weit sich die Technologie entwickelt hat.

Das Deepfake von Präsident Zelenskyy, der die ukrainischen Truppen zur Kapitulation auffordert

Im März 2022, in der Anfangsphase des Krieges zwischen Russland und der Ukraine, tauchte ein Video im Internet auf mit dem ukrainischen Präsidenten Wolodymyr Zelenskyy und forderte seine Soldaten auf, sich zu ergeben.

Es sah aus wie eine nationale Ansprache, komplett mit Zelenskyys Stimme und Manierismen.

Das Video verbreitete sich über soziale Medien und wurde sogar auf einer kompromittierten ukrainischen Nachrichtenwebsite veröffentlicht.

Der Präsident handelte schnell und gab über seine verifizierten Kanäle eine offizielle Erklärung ab, um das Filmmaterial zu entkräften.

Das virale Deepfake-Bild von Papst Franziskus in einer Designer-Pufferjacke

Manchmal muss ein gefälschtes Bild nicht bösartig sein, um Verwirrung zu stiften.

Im Jahr 2023 wird ein virales Foto von Papst Franziskus läuft in einer schicken weißen Balenciaga-Pufferjacke herum hat das Internet im Sturm erobert.

Er wurde mehrere zehn Millionen Mal aufgerufen und auf vielen Plattformen geteilt.

Das Bild wurde von einem anonymen Nutzer in Chicago mit einem KI-Tool namens Midjourney erstellt.

Elon Musk Deepfakes in Online-Betrügereien verwendet

Im Jahr 2024, deepfakes mit Elon Musk wurde ein zentraler Bestandteil mehrerer groß angelegter Online-Betrügereien.

KI-generierte Videos von Musk tauchten auf Facebook, TikTok und anderen Plattformen auf und bewarben gefälschte Kryptowährungsgeschenke und Investitionspläne.

Diese Clips sahen bemerkenswert echt aus und hörten sich auch so an.

Der Schaden war nicht nur theoretisch. Ein älterer Rentner hat Berichten zufolge fast $700.000 verloren, nachdem er durch eines dieser Videos überzeugt wurde.

Der Joe Biden Deepfake Robocall, der auf US-Wähler abzielte

Anfang 2024, kurz vor den Vorwahlen in New Hampshire, Wähler erhielten Werbeanrufe der genau wie US-Präsident Joe Biden klang.

In dem Anruf forderte Joe Biden die Wähler auf, zu Hause zu bleiben und ihre Stimme für die allgemeinen Wahlen im November aufzuheben. Die Absicht war, die Wähler zu verwirren und in die Irre zu führen, damit sie die Vorwahlen auslassen.

Der Vorfall löste Forderungen nach einer Regulierung aus. Interessengruppen drängten die US-Bundeswahlkommission (Federal Election Commission), sich einzuschalten, doch die FEC lehnte dies schließlich mit Verweis auf ihre begrenzten Befugnisse ab.

In der Zwischenzeit hat das für die Verbreitung des Robocalls verantwortliche Telekommunikationsunternehmen stimmte der Zahlung einer Geldstrafe von $1 Million zu.

Politischer Deepfake-Einsatz bei den indischen Wahlen 2020

Nicht alle Verwendungen der Deepfake-Technologie sind schädlich oder in betrügerischer Absicht (mehr dazu später im Blog).

Bei den Wahlen zur gesetzgebenden Versammlung in Delhi 2020 wird die Bharatiya Janata Party nutzt KI, um einen Werbespot zu gestalten für verschiedene Sprachgruppen.

Die Partei nahm ein Video auf, in dem ihr Vorsitzender Manoj Tiwari auf Englisch spricht, und machte eine Version in Haryanvi, einem regionalen Dialekt, durch Lippensynchronisation nach.

Während die Stimme von einem Schauspieler stammt, wurde das Bildmaterial mit Hilfe einer KI, die auf echtem Filmmaterial von Tiwari trainiert wurde, an den neuen Ton angepasst.

Die Parteimitglieder sahen darin eine positive Anwendung der Technologie, die es ihnen ermöglichte, mit den Wählern in einer Sprache in Kontakt zu treten, die sie verstanden, auch wenn der Kandidat sie nicht fließend sprach.

Wie man Deepfakes in der realen Welt verifiziert

Da Deepfakes in Politik, Unterhaltung und alltäglicher Kommunikation immer weiter verbreitet sind, ist es wichtiger denn je, zu wissen, wie man echte Inhalte von gefälschten unterscheiden kann.

Trotz der Zunahme ausgeklügelter Beispiele gibt es zuverlässige Tools, um der Bedrohung durch Deepfake-Technologie entgegenzuwirken.

Nicht nachweisbare AI's KI-Videodetektor ist ein solches Tool, das zeigt, dass es zuverlässige Tools gibt, um den ausgeklügelten Beispielen der Deepfake-Technologie entgegenzuwirken.

Das ist der Punkt, an dem Undetectable AI Deepfake-Erkennung kommt herein.

Damit soll überprüft werden, ob Audio- oder Videoinhalte künstlich erzeugt wurdenDabei werden fortschrittliche forensische Modelle verwendet, die die Bewegung von Bild zu Bild, die Konsistenz auf Pixelebene und den Fingerabdruck der Stimme analysieren.

In Sekundenschnelle können Nutzer erkennen, ob ein Video digital verändert wurde - oder ob eine Stimme von der KI geklont wurde.

Laden Sie einfach die Datei hoch, und das Tool erstellt einen detaillierten Authentizitätsbericht mit einer visuellen Aufschlüsselung und einer Vertrauensbewertung.

Ob es sich um einen viralen Clip, ein verdächtiges Interview oder eine gemeinsam genutzte Aufnahme handelt, Deepfake Detection hilft Journalisten, Pädagogen und alltäglichen Nutzern, die Wahrheit hinter dem, was sie sehen und hören, aufzudecken.

Sind Deepfakes gefährlich? Risiken und Besorgnisse

Bisher haben wir uns angesehen, was ein Deepfake ist, wie er gemacht wird und wo er bereits in der realen Welt aufgetaucht ist.

Die Technologie ist unbestreitbar beeindruckend, aber die damit verbundenen Risiken sind gravierend und wachsen schnell.

Deepfakes können auf vielfältige Weise als Waffe eingesetzt werden. Hier sind einige der Hauptbedenken.

Verleumdung

Wenn das Konterfei oder die Stimme einer Person verwendet wird, um gefälschte Bemerkungen, Aussagen oder Videos zu erstellen, insbesondere solche, die beleidigend oder umstritten sind, kann dies den Ruf fast augenblicklich ruinieren.

Und im Gegensatz zu älteren Hoaxes oder gefälschten Zitaten lässt ein überzeugendes Deepfake wenig Raum für Zweifel beim Betrachter.

In dieser Hinsicht können Deepfakes Empörung hervorrufen, Beziehungen zerstören oder einfach ein schädliches Narrativ verbreiten.

Besonders bedenklich ist, dass das Deepfake nicht einmal perfekt sein muss.

Solange die Person erkennbar und der Inhalt glaubwürdig genug ist, kann sie die öffentliche Meinung nachhaltig beeinflussen.

Glaubwürdigkeit der Informationen

Eine weitere große Sorge ist, dass Deepfakes die Idee der Wahrheit selbst untergraben.

Mit der zunehmenden Verbreitung von Fälschungen wird es immer schwieriger zu erkennen, ob das, was wir sehen oder hören, echt ist. Mit der Zeit könnte dies zu einer allgemeinen Erosion des Vertrauens in jede Form der digitalen Kommunikation führen.

Diese Krise der Glaubwürdigkeit geht über einzelne Vorfälle hinaus.

In demokratischen Gesellschaften stützen sich die Menschen auf gemeinsame Fakten, um Entscheidungen zu treffen, Fragen zu diskutieren und kollektive Probleme zu lösen.

Wenn aber Wähler, Zuschauer oder Bürger beginnen, alles in Frage zu stellen, wird es viel einfacher, die öffentliche Meinung zu manipulieren oder unbequeme Wahrheiten als "nur eine weitere Fälschung" abzutun.

Erpressung

KI-generierte Medien können dazu verwendet werden, Personen fälschlicherweise zu belasten, indem sie den Anschein erwecken, sie hätten etwas Illegales, Unmoralisches oder Peinliches getan.

Diese Art von fabrizierten Beweisen kann dann verwendet werden, um sie zu bedrohen oder zu kontrollieren.

Und das gilt für beide Seiten. Da Deepfakes inzwischen so realistisch sind, könnte jemand, der mit einer echten Erpressung konfrontiert ist, behaupten, die Beweise seien gefälscht, auch wenn sie es nicht sind.

Dies wird manchmal als Erpressungsinflation bezeichnet, bei der die schiere Menge an glaubwürdigen Fälschungen den Wert des tatsächlich belastenden Materials verringert.

Die Glaubwürdigkeit echter Beweise geht im Nebel verloren, und das macht die Aufdeckung von Fehlverhalten nur noch komplizierter.

Betrug und Betrugsversuche

Mit Hilfe von KI-generierten Videos oder Stimmen von vertrauenswürdigen Personen des öffentlichen Lebens schaffen Betrüger unglaublich überzeugende Tricks.

In einigen Fällen werden Deepfakes von Prominenten wie Elon Musk, Tom Hanks oder Oprah Winfrey verwendet, um für Produkte oder Dienstleistungen zu werben, von denen sie noch nie gehört haben.

Diese Videos werden dann über soziale Plattformen verbreitet, wo sie Millionen von Menschen erreichen.

Auch Privatpersonen sind gefährdet, insbesondere bei Spearphishing-Kampagnen, die sich mit personalisierten Inhalten an bestimmte Personen wenden, um sie zu manipulieren oder zu täuschen.

Laut einer 2024 Bericht von ForbesDer durch Deepfakes verursachte Betrug hat weltweit bereits einen geschätzten Schaden von $12 Milliarden verursacht, und diese Zahl wird sich in den nächsten Jahren voraussichtlich mehr als verdreifachen.

Aus diesem Grund ist die Erkennung nicht nur für Privatpersonen wichtig. Sie ist wichtig für Unternehmen, die mit sensiblen Daten, Kommunikation oder öffentlichen Inhalten arbeiten. TruthScan hilft diesen Organisationen, veränderte Videos zu erkennen, bevor sich Fehlinformationen verbreiten.

Positive und kreative Nutzung von Deepfakes

Es ist erwähnenswert, dass nicht jede Anwendung der Technologie negativ ist.

Während sich viele Blogs, die erklären, was ein Deepfake ist, auf den Missbrauch konzentrieren, gibt es eine wachsende Liste von kreativen und produktiven Möglichkeiten, Deepfakes zu nutzen.

Für Unternehmen gilt jedoch, dass selbst die künstlerische oder marketingorientierte Verwendung von Deepfakes vor der Veröffentlichung auf ihre Echtheit überprüft werden sollte.

Werkzeuge wie TruthScan können bestätigen, dass in der endgültigen Fassung keine unbeabsichtigten Manipulationen enthalten sind.

Nachfolgend sind einige bemerkenswerte Beispiele aufgeführt.

Film und schauspielerische Darbietungen

Die Studios beginnen, sich auf die Deepfake-Technologie zu verlassen, z. B. für Dinge wie:

- Verbesserung der visuellen Effekte

- Senkung der Produktionskosten

- Wiedereinführung von Figuren, die nicht mehr da sind

Disneyhat beispielsweise hochauflösende Deepfake-Modelle verfeinert, die das Austauschen von Gesichtern und die Alterung von Schauspielern mit beeindruckendem Realismus ermöglichen.

Die Technologie arbeitet mit einer Auflösung von 1024 x 1024 Pixeln und ist in der Lage, Gesichtsausdrücke genau zu erfassen, um Figuren jünger oder ausdrucksstärker aussehen zu lassen.

Außerhalb Hollywoods haben Deepfakes globale Kampagnen ermöglicht, wie zum Beispiel bei David Beckham wurde digital geklont um eine Gesundheitsbotschaft in mehreren Sprachen zu übermitteln.

Art

Im Jahr 2018 nutzte der Multimedia-Künstler Joseph Ayerle die Deepfake-Technologie, um einen KI-Schauspieler zu erschaffen, der das Gesicht des italienischen Filmstars Ornella Muti mit dem Körper von Kendall Jenner verschmolz.

Das Ergebnis war eine surreale Erkundung der Identität der Generationen und eine künstlerische Provokation, die Teil eines Videokunstwerks mit dem Titel Un'emozione per sempre 2.0 ist.

Deepfakes sind auch in Satire und Parodie aufgetaucht.

Die 2020 erscheinende Webserie Sassy Justice, die von den South Park-Schöpfern Trey Parker und Matt Stone ins Leben gerufen wurde, ist ein Paradebeispiel dafür.

Sie nutzte gefälschte öffentliche Personen, um sich über aktuelle Ereignisse lustig zu machen und gleichzeitig das Bewusstsein für die Technologie selbst zu schärfen.

Kundenbetreuung

Auch außerhalb der Kreativbranche finden Unternehmen Nutzen in Deepfakes für kundenorientierte Dienstleistungen.

Einige Callcenter verwenden jetzt synthetische Stimmen, die durch Deepfake-Technologie angetrieben werden, um grundlegende Anfragen zu automatisieren, wie z. B. Kontoabfragen oder die Erfassung von Beschwerden.

In diesen Fällen geht es nicht um böswillige Absicht, sondern einfach um Rationalisierung.

Anrufbeantwortungssysteme können mit Hilfe von KI-generierten Stimmen personalisiert werden, damit automatisierte Dienste natürlicher und ansprechender klingen.

Da es sich in der Regel um risikoarme und sich wiederholende Aufgaben handelt, tragen Deepfakes in diesem Zusammenhang zur Kostenreduzierung bei und setzen menschliche Mitarbeiter für komplexere Aufgaben frei.

Bildung

Auch Bildungsplattformen haben begonnen, Deepfake-gestützte Tutoren einzubauen, um Lernende auf interaktivere Weise zu unterstützen.

Diese KI-gesteuerten Tutoren können Lektionen mit synthetischen Stimmen und personalisierter Anleitung erteilen.

Tools und Techniken zur Deepfake-Erkennung

Je fortschrittlicher und zugänglicher Deepfakes werden, desto wichtiger wird es, sie zu erkennen, bevor sie Schaden anrichten.

Menschen und Organisationen brauchen auch die richtigen Werkzeuge und Techniken, um einen Schritt voraus zu sein. Hier sind also ein paar Werkzeuge und Techniken.

Für die bildgestützte Überprüfung, TruthScans AI-Bild-Detektor analysiert Beleuchtung, Pixelmuster und zusammengesetzte Elemente, um KI-generiertes oder bearbeitetes Bildmaterial in Echtzeit zu kennzeichnen.

Es hilft Teams, die Authentizität von Bildern und Videos schnell zu bestätigen, bevor Inhalte veröffentlicht oder weitergegeben werden.

TruthScan: Deepfake-Erkennung auf Unternehmensebene

TruthScan wurde für Unternehmen, Universitäten und Medienorganisationen entwickelt, die Bild- und Audioinhalte in großem Umfang überprüfen müssen.

Es analysiert die Authentizität von Videos über mehrere Dimensionen hinweg:

- Face Swap Detection: Identifiziert manipulierte Gesichtszüge Bild für Bild.

- Behavioral Fingerprinting: Erkennt subtile Ausdrucksmuster und Mikrobewegungen, die nicht mit dem natürlichen menschlichen Verhalten übereinstimmen.

- Video-Forensik: Untersucht Bildkomprimierung, Pixelrauschen und Sprachmanipulationen.

- Echtzeit-Detektion: Ermöglicht die Live-Überprüfung bei Videoanrufen, Pressemitteilungen oder Broadcast-Streams.

Mit TruthScan können Teams Videos vor der Veröffentlichung oder öffentlichen Verbreitung authentifizieren und so Reputations- und finanzielle Schäden verhindern.

Für alltägliche Nutzer bieten die Tools von Undetectable AI einen ähnlichen Schutz auf individueller Ebene.

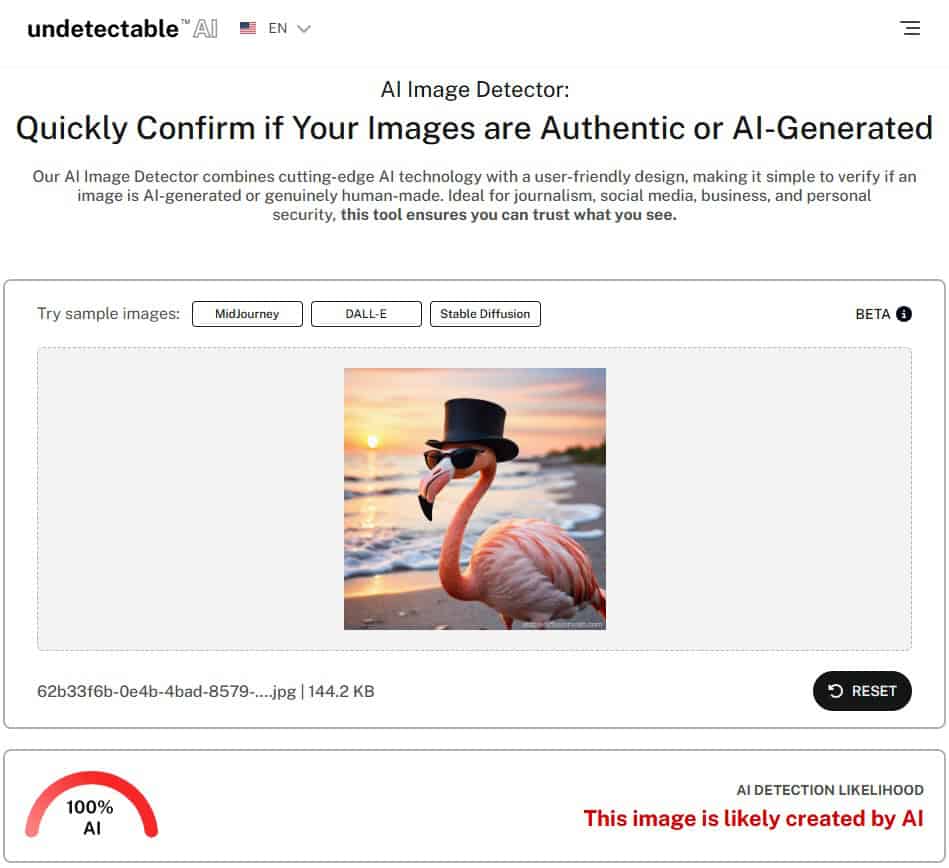

AI Image Detector von Undetectable AI

Der AI Image Detector von Undetectable AI macht die Erkennung von Deepfakes einfacher, auch für Personen ohne technischen Hintergrund.

Der Detektor analysiert verschiedene Elemente in einem hochgeladenen Bild, z. B. Farbmuster, Texturen, Gesichtszüge und strukturelle Unstimmigkeiten.

Es unterstützt die Erkennung von Medien, die mit den bekanntesten KI-Bildgeneratoren wie

- MidJourney

- DALL-E

- Stabile Diffusion

- Ideogramm

- GAN-basierte Modelle

Laden Sie einfach ein Bild hoch, lassen Sie es von dem Tool analysieren und Sie erhalten ein klares Urteil mit einer Vertrauensbewertung.

Wenn Sie sich nicht sicher sind, ob ein Bild, das Sie gefunden haben, echt ist, probieren Sie unser AI-Bild-Detektor um nach Anzeichen von KI-Manipulationen zu suchen.

Nun, lassen Sie uns Der AI-Detektor von Undetectable zu testen, um zu sehen, ob es genau erkennen kann, ob das Bild KI-generiert ist.

Wie Sie sehen können, hat der Bild-KI-Detektor von Undetectable AI dieses Bild als 100% AI-generiert gekennzeichnet.

Visuelle und verhaltensbasierte Techniken zur manuellen Erkennung

Es gibt auch praktische Techniken, mit denen Einzelpersonen Deepfakes manuell erkennen können, insbesondere in Situationen, in denen eine sofortige Analyse erforderlich ist.

Einige visuelle Warnsignale sind:

- Ungünstige Gesichtsausdrücke oder merkwürdige Mimik.

- Inkonsistente Beleuchtung oder Farbgebung in verschiedenen Teilen des Bildes oder Videos.

- Flackern im Gesicht oder am Haaransatz, insbesondere bei Bewegung.

- Fehlen eines natürlichen Blinzelns oder unregelmäßige Augenbewegungen.

- Unstimmigkeiten bei der Lippensynchronisation, wenn der Ton nicht mit der Sprache übereinstimmt.

Was das Verhalten betrifft, so fällt es Deepfakes oft schwer, subtile menschliche Züge zu imitieren. Achten Sie auf Körpersprache, emotionale Ausdrücke und gewohnte Gesten.

Und bitten Sie bei Echtzeitgesprächen, insbesondere bei Live-Videos, um eine Seitenprofilansicht.

Viele Deepfake-Modelle haben immer noch Schwierigkeiten, einen 90-Grad-Winkel im Gesicht oder komplexe Bewegungen wie das Drehen des Kopfes unter Beibehaltung einer natürlichen Mimik genau wiederzugeben.

Erkennen von Deepfakes in Text und Kontext

Deepfakes sind nicht auf Bilder beschränkt. Einige Versionen beinhalten synthetischen Text, Stimme oder Verhalten, die den Kommunikationsstil einer Person imitieren.

Achten Sie bei der Analyse von Textinhalten oder Dialogen auf die folgenden Punkte:

- Rechtschreibfehler und seltsame Grammatik.

- Sätze, die sich gezwungen anfühlen oder nicht natürlich fließen.

- Ungewöhnliche E-Mail-Adressen oder widersprüchliche Formulierungen.

- Botschaften, die aus dem Zusammenhang gerissen sind oder keinen Bezug zur Situation haben.

Auch der Kontext ist wichtig. Wenn ein Video oder eine Nachricht in einer Umgebung erscheint, die keinen Sinn ergibt, wie z. B. ein Politiker, der beiläufig eine wichtige Entscheidung in einem minderwertigen Clip ankündigt, lohnt es sich, seine Authentizität in Frage zu stellen.

Neugierig auf unseren AI-Detektor und Humanizer? Probieren Sie sie mit dem Widget unten aus!

FAQs über Deepfakes

Sind Deepfakes illegal?

Deepfakes sind nicht von vornherein illegal, aber sie können es sein, wenn sie gegen bestehende Gesetze verstoßen, z. B. gegen die Gesetze über Verleumdung, Kinderpornografie oder nicht einvernehmliche explizite Inhalte.

Einige US-Bundesstaaten haben Gesetze gegen Deepfakes erlassen, die Wahlen beeinflussen oder Rachepornos beinhalten.

Bundesgesetze wie das DEFIANCE-Gesetz und NO FAKES Gesetz sind ebenfalls in Arbeit, um die böswillige Nutzung der Deepfake-Technologie zu regeln.

Kann jemand ein Deepfake machen?

Ja, fast jeder kann mit kostenloser oder preiswerter Software und KI-Tools ein Deepfake erstellen.

Viele Plattformen bieten inzwischen benutzerfreundliche Schnittstellen, so dass für den Einstieg keine fortgeschrittenen technischen Kenntnisse erforderlich sind.

Wie kann ich mich vor Deepfakes schützen?

Vermeiden Sie es, hochauflösende Bilder oder Videos online zu stellen. Verwenden Sie Datenschutzeinstellungen und Erkennungstools wie Nicht nachweisbare AI oder TruthScan um alles Verdächtige zu überprüfen.

Gibt es Apps zur Erkennung von Fälschungen?

Ja, TruthScan ist für Unternehmen gedacht, die Videoinhalte in großem Umfang analysieren müssen, während die Detektoren von Undetectable AI für Privatpersonen und Urheber gedacht sind, die kleinere Mengen an Inhalten überprüfen wollen.

Schlussgedanken

Deepfakes verändern die Art und Weise, wie wir die Wahrheit im Internet sehen. Egal, ob Sie Ihre Marke schützen, die öffentliche Kommunikation verwalten oder einfach nur sicher surfen wollen - die richtigen Erkennungswerkzeuge machen den Unterschied.

Für Unternehmen und Institutionen, TruthScan bietet Schutz vor KI-gesteuerten Fehlinformationen auf Unternehmensebene.

Für Einzelpersonen, nicht nachweisbare AI's AI-Bild-Detektor bietet eine einfache und schnelle Möglichkeit, Bilder zu prüfen und sich zu informieren.

Gemeinsam sorgen sie dafür, dass das, was Sie sehen und teilen, real bleibt.