Istilah deepfake pertama kali muncul di Reddit pada tahun 2017ketika pengguna dengan nama layar yang sama mulai membagikan video yang telah diubah yang menggunakan AI untuk menukar wajah, awalnya dalam konten dewasa.

Meskipun Reddit melarang subreddit asli, idenya sudah terlanjur menyebar.

Tetapi akar dari teknologi ini bahkan lebih jauh lagi.

Pada tahun 1997, para peneliti sudah mulai bereksperimen dengan pengeditan video melalui pembelajaran mesin.

Alat sinkronisasi bibir awal mereka, yang disebut Menulis Ulang Video dapat membuat seseorang tampak mengatakan sesuatu yang tidak mereka katakan.

Secara teknis, ini bukanlah pemalsuan yang mendalam menurut standar saat ini, tetapi ini meletakkan dasar untuk apa yang akan terjadi selanjutnya.

Blog hari ini membahas tentang bagaimana teknologi yang terus berkembang ini bekerja, bagaimana teknologi ini muncul dalam kehidupan sehari-hari, dan apa saja risiko dan manfaat yang dibawanya.

Mari kita mulai dengan memahami apa itu deepfake.

Hal-hal penting yang dapat diambil:

- Deepfakes adalah media yang dibuat oleh AI yang membuat orang tampak mengatakan atau melakukan hal-hal yang sebenarnya tidak pernah mereka lakukan.

- Dengan alat bantu gratis dan keterampilan dasar, hampir semua orang sekarang dapat membuat video, gambar, atau klip audio yang meyakinkan.

- Meskipun deepfake bisa menjadi sesuatu yang kreatif atau menghibur, namun juga memiliki risiko serius seperti penipuan, pencemaran nama baik, dan informasi yang salah.

- Anda dapat mengenali sebagian besar deepfake dengan menggunakan alat deteksi atau mengamati dengan cermat ketidakkonsistenan visual dan perilaku.

Apa yang dimaksud dengan Deepfake?

Deepfake adalah media palsu, biasanya berupa video, klip audio, atau gambar, yang telah diubah menggunakan kecerdasan buatan untuk membuat seseorang terlihat atau terdengar seperti melakukan atau mengatakan sesuatu yang sebenarnya tidak pernah mereka lakukan.

Sekarang, jangan salah mengira bahwa ini hanya pekerjaan Photoshop yang buruk atau sulih suara yang tidak jelas.

Kita berbicara tentang manipulasi tingkat tinggi menggunakan teknologi yang disebut deep learning, yang merupakan bagian dari AI.

Jangan Pernah Khawatir AI Mendeteksi Teks Anda Lagi. Undetectable AI Dapat Membantu Anda:

- Membuat tulisan dengan bantuan AI Anda muncul seperti manusia.

- Bypass semua alat pendeteksi AI utama hanya dengan satu klik.

- Gunakan AI dengan aman dan dengan percaya diri di sekolah dan tempat kerja.

Itulah yang dimaksud dengan istilah "deepfake": pembelajaran mendalam dan konten palsu.

Tujuan dari deepfake biasanya untuk menciptakan sesuatu yang terlihat cukup nyata untuk menipu orang.

Mungkin Anda pernah melihat video viral tentang selebriti yang melakukan hal-hal aneh atau politisi yang membuat pernyataan keterlaluan yang tidak pernah mereka katakan.

Itu adalah kasus penggunaan deepfake yang klasik. Apa yang Anda lihat tidaklah nyata, tetapi teknologi di baliknya sudah cukup baik sehingga otak Anda tidak akan langsung mengetahui kepalsuannya, kecuali jika Anda benar-benar mencarinya.

Di situlah alat bantu seperti TruthScan masuklah.

TruthScan dibuat untuk organisasi yang perlu memverifikasi media dalam skala besar-perusahaan, ruang redaksi, universitas, dan lembaga publik. Ini membantu tim menemukan manipulasi sebelum konten palsu merusak kepercayaan atau reputasi.

Faktanya, menurut tim peneliti Undetectable AI, 85 % orang Amerika mengatakan bahwa deepfakes telah mengikis kepercayaan mereka terhadap informasi online.

Anda baru saja mempelajari apa itu video atau media deepfake, sekarang bagaimana orang membuatnya.

Bagaimana Deepfakes Dibuat

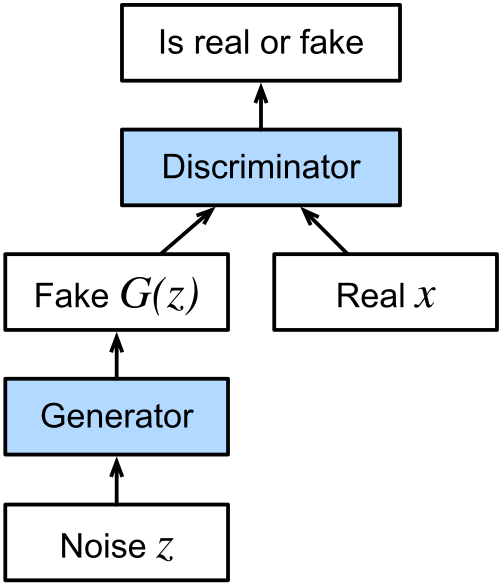

Teknologi di balik sebagian besar deepfake adalah kategori algoritme pembelajaran mesin yang disebut generative adversarial networks, atau GAN.

GAN terdiri dari dua bagian: generator dan diskriminator.

Generator membuat media palsu berdasarkan apa yang telah dilatih untuk ditiru, dan tugas diskriminator adalah memanggil apa yang terlihat palsu.

Mereka terus bolak-balik sampai generator menjadi lebih baik dalam membuat konten palsu yang dapat lulus uji diskriminator.

Seiring waktu, bolak-balik ini menghasilkan media yang terlihat sangat realistis.

Apa yang dimaksud dengan Proses Pembuatan Video Deepfake?

Saat membuat video deepfake, sistem menganalisis video dari berbagai sudut, mempelajari bagaimana orang tersebut berbicara, bagaimana wajahnya bergerak, bagaimana tubuhnya bergeser.

Semua informasi tersebut dimasukkan ke dalam generator sehingga generator dapat membuat konten yang meniru perilaku tersebut.

Kemudian, diskriminator membantu menyempurnakannya dengan menunjukkan apa yang tidak sesuai sampai hasil akhirnya terlihat tepat.

Begitulah cara ilusi bertahan dengan sangat baik dalam gerakan.

Ada beberapa teknik berbeda yang digunakan, tergantung pada tujuan video deepfake.

Jika idenya adalah membuat seseorang tampak mengatakan atau melakukan sesuatu dalam video yang sebenarnya tidak pernah mereka katakan atau lakukan, maka kita berurusan dengan apa yang disebut dengan deepfake video sumber.

Autoencoder deepfake, yang terdiri dari encoder dan decoder, mempelajari rekaman asli dan menerapkan ekspresi, gestur, dan gerakan kepala target yang halus ke dalamnya.

Audio Deepfakes

Audio deepfake bekerja dengan mengkloning suara seseorang, sekali lagi menggunakan GAN, berdasarkan rekaman bagaimana mereka berbicara secara alami.

Setelah dilatih, model ini dapat menghasilkan ucapan baru dengan suara tersebut, bahkan jika orang tersebut tidak pernah mengucapkan kata-kata tersebut.

Lapisan lain yang sering ditambahkan adalah sinkronisasi bibir.

Di sini, sistem memetakan audio yang dihasilkan atau yang sudah direkam sebelumnya ke dalam video.

Tujuannya adalah untuk membuat bibir dalam video sesuai dengan kata-kata dalam audio.

Contoh Dunia Nyata dari Deepfakes

Deepfakes muncul di mana-mana akhir-akhir ini.

Mari kita perkenalkan kepada Anda beberapa deepfake populer yang menunjukkan seberapa jauh teknologi ini telah berkembang.

Rekaman Dalaman Presiden Zelenskyy Meminta Pasukan Ukraina Menyerah

Pada Maret 2022, selama tahap awal perang Rusia-Ukraina, sebuah video muncul secara online menunjukkan Presiden Ukraina Volodymyr Zelenskyy mendesak tentaranya untuk menyerah.

Tampak seperti pidato kenegaraan, lengkap dengan suara dan tingkah laku Zelenskyy.

Video tersebut menyebar di berbagai platform media sosial dan bahkan diposting di situs berita Ukraina.

Presiden bertindak cepat dan merilis pernyataan resmi melalui salurannya yang terverifikasi untuk menyanggah rekaman tersebut.

Gambar Paus Fransiskus yang Viral dengan Jaket Puffer Desainer

Kadang-kadang, gambar deepfake tidak perlu berbahaya untuk menimbulkan kebingungan.

Pada tahun 2023, sebuah foto viral dari Paus Fransiskus berjalan-jalan dengan jaket puffer Balenciaga berwarna putih yang bergaya menghebohkan dunia internet.

Video ini telah ditonton oleh puluhan juta orang dan dibagikan secara luas di berbagai platform.

Gambar tersebut dibuat dengan menggunakan alat bantu AI yang disebut Midjourney oleh pengguna anonim di Chicago.

Elon Musk Deepfakes Digunakan dalam Penipuan Online

Pada tahun 2024, deepfakes yang menampilkan Elon Musk menjadi bagian utama dari beberapa penipuan online berskala besar.

Video-video Musk yang dibuat oleh AI mulai bermunculan di Facebook, TikTok, dan platform lainnya, mempromosikan hadiah mata uang kripto palsu dan skema investasi.

Klip-klip ini terlihat dan terdengar sangat nyata.

Kerugiannya tidak hanya bersifat teoritis. Seorang pensiunan lansia dilaporkan kehilangan hampir $700.000 setelah diyakinkan oleh salah satu video ini.

Robocall Palsu Joe Biden yang Menargetkan Pemilih AS

Pada awal 2024, tepat sebelum pemilihan pendahuluan di New Hampshire, para pemilih menerima telepon genggam yang terdengar persis seperti Presiden AS Joe Biden.

Dalam seruan tersebut, Joe Biden mendesak para pemilih untuk tetap tinggal di rumah dan menyimpan suara mereka untuk pemilihan umum pada bulan November. Tujuannya adalah untuk membingungkan dan menyesatkan para pemilih agar melewatkan pemilihan pendahuluan.

Insiden ini memicu seruan untuk membuat regulasi. Kelompok-kelompok advokasi mendesak Komisi Pemilihan Umum Federal AS untuk turun tangan, tetapi FEC akhirnya menolak, dengan alasan keterbatasan kewenangannya.

Sementara itu, perusahaan telekomunikasi yang bertanggung jawab untuk mendistribusikan robocall setuju untuk membayar denda sebesar $1 juta.

Penggunaan Deepfake Politik dalam Pemilu India 2020

Tidak semua penggunaan teknologi deepfake berbahaya atau bermaksud menipu (lebih lanjut tentang hal ini nanti di blog).

Selama pemilihan Dewan Legislatif Delhi tahun 2020, pemilihan Partai Bharatiya Janata menggunakan AI untuk menyesuaikan iklan kampanye untuk audiens dengan bahasa yang berbeda.

Partai ini mengambil video pemimpinnya, Manoj Tiwari, yang berbicara dalam bahasa Inggris dan menggunakan sinkronisasi bibir deepfake untuk menghasilkan versi dalam bahasa Haryanvi, sebuah dialek regional.

Sementara sulih suara berasal dari seorang aktor, visual dimodifikasi agar sesuai dengan audio baru menggunakan AI yang dilatih dengan rekaman Tiwari yang asli.

Anggota partai melihatnya sebagai aplikasi positif dari teknologi yang memungkinkan mereka terhubung dengan pemilih dalam bahasa yang mereka pahami, bahkan jika kandidat tidak berbicara dengan lancar.

Cara Memverifikasi Deepfakes di Dunia Nyata

Dengan penyebaran deepfakes di bidang politik, hiburan, dan komunikasi sehari-hari, mengetahui cara memverifikasi apa yang sebenarnya terjadi belum pernah sepenting ini.

Meskipun munculnya contoh-contoh yang semakin canggih, alat-alat yang andal tetap tersedia untuk melawan ancaman teknologi deepfake.

AI yang tidak terdeteksi Detektor Video AI adalah salah satu alat semacam itu, yang menunjukkan bahwa alat yang andal memang ada untuk melawan contoh-contoh canggih dari teknologi deepfake.

Itulah tempat di mana AI yang tidak terdeteksi Deteksi Deepfake datang.

Ini dirancang untuk memverifikasi apakah konten audio atau video dibuat secara artifisialmenggunakan model forensik canggih yang menganalisis gerakan frame-by-frame, konsistensi tingkat piksel, dan sidik jari vokal.

Dalam hitungan detik, pengguna dapat melihat apakah video telah diubah secara digital-atau apakah suara telah dikloning oleh AI.

Cukup unggah file, dan alat ini memberikan laporan keaslian yang terperinci dengan rincian visual dan skor kepercayaan.

Baik itu klip viral, wawancara yang mencurigakan, atau rekaman yang dibagikan, Deepfake Detection membantu jurnalis, pendidik, dan pengguna sehari-hari mengungkap kebenaran di balik apa yang mereka lihat dan dengar.

Apakah Deepfakes Berbahaya? Risiko dan Kekhawatiran

Sejauh ini, kita telah melihat apa itu deepfake, bagaimana cara membuatnya, dan di mana ia sudah muncul di dunia nyata.

Teknologi ini tidak dapat disangkal lagi sangat mengesankan, tetapi risiko yang terkait dengannya sangat serius dan berkembang pesat.

Deepfakes dapat digunakan dengan berbagai cara. Berikut adalah beberapa masalah utama.

Pencemaran nama baik

Ketika kemiripan atau suara seseorang digunakan untuk membuat komentar, pernyataan, atau video palsu, terutama yang menyinggung atau kontroversial, hal ini dapat merusak reputasi dengan cepat.

Dan tidak seperti tipuan lama atau kutipan palsu, deepfake yang meyakinkan hanya menyisakan sedikit ruang untuk keraguan di benak pemirsa.

Dalam hal ini, deepfake dapat memicu kemarahan, menghancurkan hubungan, atau sekadar mendorong narasi yang merusak.

Yang sangat memprihatinkan adalah bahwa deepfake bahkan tidak perlu sempurna.

Selama orang tersebut dapat dikenali, dan kontennya cukup dapat dipercaya, maka hal ini dapat meninggalkan dampak yang bertahan lama pada opini publik.

Kredibilitas Informasi

Kekhawatiran utama lainnya adalah bagaimana pemalsuan mendalam merusak gagasan tentang kebenaran.

Ketika deepfakes menjadi semakin umum, semakin sulit untuk mengetahui apakah yang kita lihat atau dengar itu nyata. Seiring berjalannya waktu, hal ini dapat menyebabkan erosi kepercayaan yang lebih luas pada segala bentuk komunikasi digital.

Krisis kredibilitas ini lebih dari sekadar insiden individual.

Dalam masyarakat demokratis, orang mengandalkan fakta bersama untuk membuat keputusan, memperdebatkan isu, dan memecahkan masalah bersama.

Tetapi jika pemilih, pemirsa, atau warga negara mulai mempertanyakan segala sesuatu, akan lebih mudah untuk memanipulasi opini publik atau mengabaikan kebenaran yang tidak nyaman sebagai "hanya sebuah deepfake."

Pemerasan

Media yang dihasilkan oleh AI dapat digunakan untuk secara keliru memberatkan seseorang dengan membuatnya tampak seperti telah melakukan sesuatu yang ilegal, tidak etis, atau memalukan.

Bukti yang dibuat ini kemudian dapat digunakan untuk mengancam atau mengendalikan mereka.

Dan ini berlaku dua arah. Karena deepfakes sekarang sangat realistis, seseorang yang menghadapi pemerasan sungguhan dapat mengklaim bahwa buktinya palsu, meskipun sebenarnya tidak.

Hal ini terkadang disebut sebagai penggelembungan pemerasan, di mana banyaknya jumlah pemalsuan yang dapat dipercaya pada akhirnya mengurangi nilai materi yang sebenarnya memberatkan.

Kredibilitas bukti nyata hilang dalam kabut, dan hal itu hanya menambah lapisan kerumitan ketika mencoba mengungkap kesalahan.

Penipuan dan Penipuan

Dengan menggunakan video yang dihasilkan oleh AI atau suara tokoh publik tepercaya, para penipu menciptakan skema yang sangat meyakinkan.

Dalam beberapa kasus, deepfake selebriti seperti Elon Musk, Tom Hanks, atau Oprah Winfrey digunakan untuk mendukung produk atau layanan yang belum pernah mereka dengar.

Video-video ini kemudian disebarkan ke berbagai platform sosial, di mana video-video ini dapat menjangkau jutaan orang.

Bahkan individu pribadi pun berisiko, terutama dalam kampanye spearphishing yang menargetkan orang-orang tertentu dengan konten yang dipersonalisasi yang dirancang untuk memanipulasi atau menipu.

Menurut sebuah Laporan tahun 2024 oleh Forbespenipuan yang digerakkan oleh deepfake telah menyebabkan kerugian global sebesar 1 triliun dolar AS, dan angka tersebut diperkirakan akan meningkat tiga kali lipat dalam beberapa tahun mendatang.

Itulah mengapa deteksi tidak hanya untuk individu. Sangat penting bagi perusahaan yang menangani data sensitif, komunikasi, atau konten publik. TruthScan membantu organisasi-organisasi ini mengidentifikasi video yang telah diubah sebelum informasi yang salah menyebar.

Penggunaan Deepfakes yang Positif dan Kreatif

Perlu dicatat bahwa tidak semua penerapan teknologi itu negatif.

Meskipun banyak blog yang menjelaskan apa itu deepfake berfokus pada penyalahgunaan, ada banyak cara kreatif dan produktif untuk menggunakan deepfake.

Namun, untuk bisnis, bahkan penggunaan artistik atau pemasaran deepfake harus diperiksa keasliannya sebelum dirilis.

Alat seperti TruthScan dapat memastikan bahwa tidak ada manipulasi yang tidak diinginkan yang tersisa dalam versi final.

Di bawah ini adalah beberapa contoh penting.

Pertunjukan Film dan Akting

Studio mulai mengandalkan teknologi deepfake untuk berbagai hal, seperti:

- Meningkatkan efek visual

- Mengurangi biaya produksi

- Menghadirkan kembali karakter yang sudah tidak ada lagi

Disneymisalnya, telah menyempurnakan model deepfake resolusi tinggi yang memungkinkan penukaran wajah dan penghilangan penuaan aktor dengan realisme yang mengesankan.

Teknologi mereka beroperasi pada resolusi 1024 x 1024 dan secara akurat dapat melacak ekspresi wajah untuk membuat karakter terlihat lebih muda atau lebih ekspresif.

Di luar Hollywood, deepfake telah memungkinkan pekerjaan kampanye global, seperti ketika David Beckham dikloning secara digital untuk menyampaikan pesan kesehatan dalam berbagai bahasa.

Seni

Pada tahun 2018, seniman multimedia Joseph Ayerle menggunakan teknologi deepfake untuk menciptakan aktor AI yang memadukan wajah bintang film Italia, Ornella Muti, dengan tubuh Kendall Jenner.

Hasilnya adalah eksplorasi surealis identitas generasi dan provokasi artistik, bagian dari karya seni video berjudul Un'emozione per sempre 2.0.

Deepfakes juga muncul dalam bentuk satir dan parodi.

Serial web Sassy Justice, yang dibuat oleh kreator South Park, Trey Parker dan Matt Stone, adalah contoh terbaik.

Mereka menggunakan tokoh-tokoh publik yang dipalsukan untuk mengolok-olok peristiwa terkini sambil meningkatkan kesadaran akan teknologi itu sendiri.

Layanan Pelanggan

Di luar industri kreatif, bisnis menemukan kegunaan deepfake untuk layanan yang berhadapan langsung dengan pelanggan.

Beberapa pusat panggilan sekarang menggunakan suara sintetis yang didukung oleh teknologi deepfake untuk mengotomatiskan permintaan dasar, seperti pertanyaan akun atau pencatatan keluhan.

Dalam hal ini, maksudnya tidak jahat tetapi hanya untuk merampingkan.

Sistem respons penelepon dapat dipersonalisasi menggunakan suara yang dihasilkan oleh AI agar layanan otomatis terdengar lebih alami dan menarik.

Karena tugas yang ditangani biasanya berisiko rendah dan berulang, deepfake dalam konteks ini membantu mengurangi biaya dan membebaskan agen manusia untuk masalah yang lebih kompleks.

Pendidikan

Platform pendidikan juga telah mulai menggabungkan tutor yang didukung deepfake untuk membantu pelajar dengan cara yang lebih interaktif.

Tutor yang digerakkan oleh AI ini dapat menyampaikan pelajaran menggunakan suara sintetis dan panduan yang dipersonalisasi.

Alat dan Teknik Pendeteksian Deepfake

Seiring dengan semakin canggih dan mudahnya deepfakes diakses, begitu pula dengan kebutuhan untuk mengidentifikasinya sebelum menyebabkan kerugian.

Orang-orang dan organisasi juga membutuhkan alat dan teknik yang tepat untuk tetap selangkah lebih maju. Jadi, inilah beberapa alat dan tekniknya.

Untuk verifikasi yang berfokus pada gambar, Detektor Gambar AI dari TruthScan menganalisis pencahayaan, pola piksel, dan elemen-elemen yang dikomposisikan untuk menandai visual yang dihasilkan atau diedit oleh AI dalam waktu nyata.

Ini membantu tim mengonfirmasi keaslian dengan cepat di seluruh gambar dan bingkai video sebelum konten dipublikasikan atau dibagikan.

TruthScan: Deteksi Pemalsuan Tingkat Perusahaan

TruthScan dirancang untuk bisnis, universitas, dan organisasi media yang membutuhkan verifikasi konten visual dan audio berskala besar.

Alat ini menganalisis keaslian video di berbagai dimensi:

- Deteksi Pertukaran Wajah: Mengidentifikasi fitur wajah yang dimanipulasi bingkai demi bingkai.

- Sidik Jari Perilaku: Mendeteksi pola ekspresi halus dan gerakan mikro yang tidak konsisten dengan perilaku alami manusia.

- Forensik Video: Memeriksa kompresi bingkai, noise piksel, dan gangguan suara.

- Deteksi Waktu Nyata: Memungkinkan verifikasi langsung selama panggilan video, siaran pers, atau streaming siaran.

Dengan TruthScan, tim dapat mengotentikasi video sebelum dipublikasikan atau didistribusikan ke publik, sehingga mencegah kerusakan reputasi dan finansial.

Untuk pengguna sehari-hari, alat Undetectable AI menawarkan perlindungan serupa di tingkat individu.

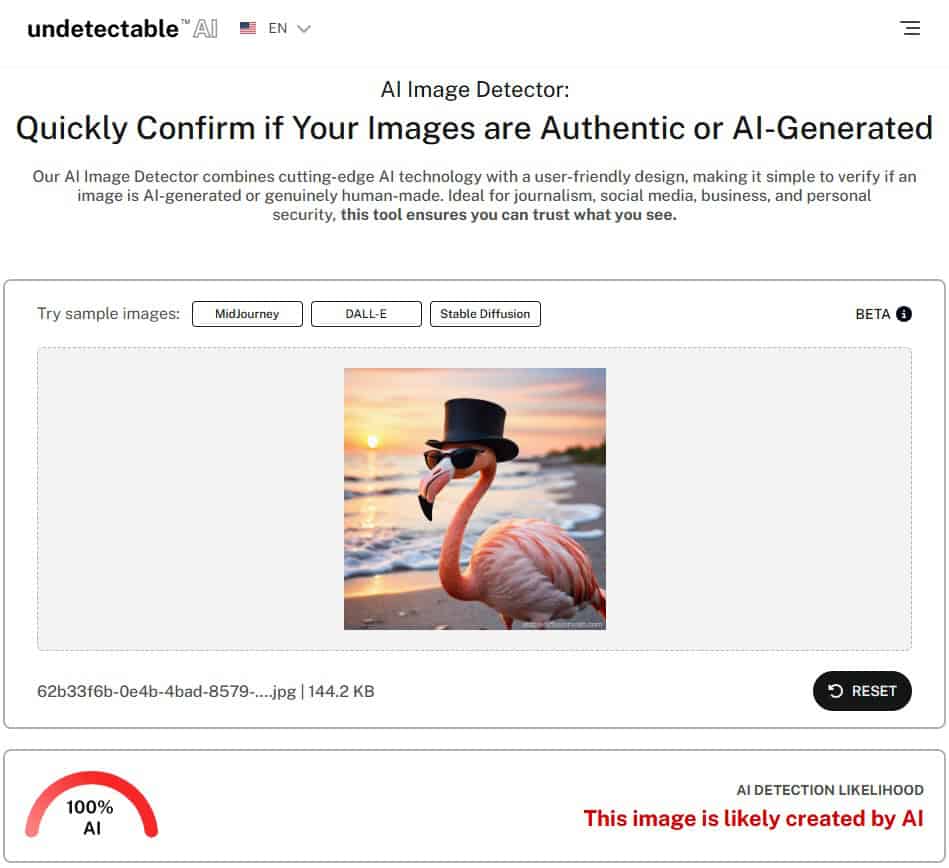

Detektor Gambar AI oleh AI yang Tidak Terdeteksi

Pendeteksi Gambar AI yang tidak terdeteksi membuat pendeteksian deepfake menjadi lebih mudah, bahkan bagi mereka yang tidak memiliki latar belakang teknis.

Detektor bekerja dengan menganalisis berbagai elemen dalam gambar yang diunggah, seperti pola warna, tekstur, fitur wajah, dan ketidakkonsistenan struktural.

Ini mendukung deteksi untuk media yang dibuat menggunakan generator gambar AI yang paling terkenal seperti

- MidJourney

- DALL-E

- Difusi Stabil

- Ideogram

- Model berbasis GAN

Untuk menggunakannya, cukup unggah gambar, biarkan alat ini menganalisisnya, dan dapatkan hasil yang jelas dengan skor keyakinan.

Jika Anda tidak yakin apakah gambar yang Anda temui adalah asli, cobalah fitur Detektor Gambar AI untuk memeriksa tanda-tanda gangguan AI.

Sekarang, mari kita letakkan Detektor AI yang tidak terdeteksi untuk menguji dan melihat apakah ia dapat secara akurat mengetahui bahwa gambar tersebut dihasilkan oleh AI.

Seperti yang bisa Anda lihat, detektor AI gambar oleh Undetectable AI telah menandai gambar ini sebagai gambar yang dihasilkan oleh AI 100%.

Teknik Visual dan Perilaku untuk Deteksi Manual

Ada juga teknik praktis yang dapat digunakan individu untuk mendeteksi deepfakes secara manual, terutama dalam situasi di mana analisis segera diperlukan.

Beberapa tanda bahaya visual meliputi:

- Posisi wajah yang canggung atau ekspresi yang aneh.

- Pencahayaan atau pewarnaan yang tidak konsisten di berbagai bagian gambar atau video.

- Berkedip-kedip di sekitar wajah atau garis rambut, khususnya saat bergerak.

- Kurangnya kedipan alami atau gerakan mata yang tidak teratur.

- Perbedaan dalam sinkronisasi bibir ketika audio tidak sesuai dengan ucapan.

Dari sudut perilaku, deepfake sering kali kesulitan untuk menirukan sifat-sifat manusia yang halus. Perhatikan bahasa tubuh, ekspresi emosional, dan gerakan kebiasaan.

Dan dalam percakapan waktu nyata, terutama video langsung, mintalah tampilan profil samping.

Banyak model deepfake yang masih kesulitan untuk secara akurat merender sudut wajah 90 derajat atau gerakan yang rumit, seperti menoleh sambil mempertahankan ekspresi yang wajar.

Menemukan Deepfakes dalam Teks dan Konteks

Deepfakes tidak terbatas pada visual. Beberapa versi melibatkan teks sintetis, suara, atau perilaku yang meniru gaya komunikasi seseorang.

Apabila menganalisis konten tekstual atau dialog, perhatikan hal-hal berikut ini:

- Salah eja dan tata bahasa yang aneh.

- Kalimat yang terasa dipaksakan atau tidak mengalir secara alami.

- Alamat email yang tidak biasa atau frasa yang tidak konsisten.

- Pesan yang terasa di luar konteks atau tidak terkait dengan situasi.

Konteks juga penting. Jika sebuah video atau pesan muncul dalam latar yang tidak masuk akal, seperti seorang politisi yang dengan santai mengumumkan keputusan besar dalam klip berkualitas rendah, maka perlu dipertanyakan keasliannya.

Penasaran dengan AI Detector dan Humanizer kami? Cobalah di widget di bawah ini!

Tanya Jawab Tentang Deepfakes

Apakah deepfakes ilegal?

Deepfake tidak ilegal secara default, tetapi bisa jadi ilegal jika melanggar hukum yang ada seperti yang mencakup pencemaran nama baik, pornografi anak, atau konten eksplisit yang tidak konsensual.

Beberapa negara bagian di AS telah mengesahkan undang-undang yang menargetkan deepfakes yang memengaruhi pemilihan umum atau melibatkan pornografi balas dendam.

Tagihan federal seperti Undang-Undang DEFIANCE dan TIDAK ADA UU PALSU juga sedang dalam proses untuk mengatur penggunaan teknologi deepfake yang berbahaya.

Adakah yang bisa membuat deepfake?

Ya, hampir semua orang dapat membuat deepfake menggunakan perangkat lunak gratis atau berbiaya rendah dan alat bantu AI.

Banyak platform sekarang menawarkan antarmuka yang ramah pengguna, jadi tidak diperlukan keahlian teknis tingkat lanjut untuk memulai.

Bagaimana cara melindungi diri saya dari deepfake?

Batasi eksposur Anda dengan menghindari memposting gambar atau video beresolusi tinggi secara online. Gunakan pengaturan privasi dan alat deteksi seperti AI yang tidak terdeteksi atau TruthScan untuk memeriksa ulang segala sesuatu yang mencurigakan.

Apakah ada aplikasi pendeteksi deepfake?

Ya, TruthScan dirancang untuk pengguna bisnis yang perlu menganalisis konten video dalam skala besar, sementara detektor Undetectable AI melayani individu dan kreator yang ingin memverifikasi konten dalam jumlah yang lebih kecil.

Pikiran Akhir

Deepfakes mengubah cara kita melihat kebenaran secara online. Baik Anda melindungi merek Anda, mengelola komunikasi publik, atau sekadar menjelajah dengan aman, menggunakan alat pendeteksi yang tepat akan membuat perbedaan besar.

Untuk bisnis dan institusi, TruthScan memberikan perlindungan tingkat perusahaan terhadap kesalahan informasi yang disebabkan oleh AI.

Untuk individu, AI yang tidak terdeteksi Detektor Gambar AI menawarkan cara yang sederhana dan cepat untuk memeriksa gambar dan tetap mendapatkan informasi.

Bersama-sama, mereka membantu memastikan apa yang Anda lihat dan bagikan tetap nyata.