ディープフェイクという言葉 2017年、Redditに初めて現れた同じスクリーンネームのユーザーが、AIを使って顔を入れ替えた動画を共有し始めたのだ。

Redditはオリジナルのsubredditを禁止したが、このアイデアはすでに広まっていた。

しかし、この技術のルーツはさらに遡る。

1997年、研究者たちはすでに機械学習によるビデオ編集の実験を始めていた。

という初期のリップ・シンク・ツールだ。 ビデオ・リライト 誰かが何か言っているように見せかけることができる。

今日の基準からすれば、厳密にはディープフェイクではなかったが、次に来るものの土台を作った。

今日のブログは、この進化するテクノロジーがどのように機能するのか、日常生活のどこに登場するのか、そしてどのようなリスクとベネフィットをもたらすのかについてである。

まず、ディープフェイクとは何かを理解することから始めよう。

重要なポイント

- ディープフェイクとは、AIによって生成されたメディアで、人々が実際にはやっていないことを言ったりやったりしているように見せかけるものだ。

- 無料のツールと基本的なスキルがあれば、ほとんど誰でも説得力のあるディープフェイク動画、画像、音声クリップを作成できるようになった。

- ディープフェイクはクリエイティブで面白いものだが、詐欺、中傷、誤報といった深刻なリスクももたらす。

- ディープフェイクのほとんどは、検出ツールを使ったり、ビジュアルや振る舞いの矛盾を注意深く観察することで見破ることができる。

ディープフェイクとは何か?

ディープフェイクとは偽のメディアのことで、通常はビデオやオーディオクリップ、画像などを人工知能を使って加工し、誰かが実際にはやっていないことをやっているように見せたり、言っているように聞こえるようにしたものだ。

これをただの下手なフォトショップや大雑把なナレーションと勘違いしないでほしい。

私たちが話しているのは、AIのサブセットであるディープラーニングと呼ばれる技術を使った高度な操作のことだ。

もうAIがあなたのテキストを検出する心配はありません。 Undetectable AI あなたを助けることができる:

- AIがアシストする文章を出現させる 人間らしい。

- バイパス ワンクリックですべての主要なAI検出ツール。

- 用途 AI 無事に そして 堂々 学校でも仕事でも。

ディープフェイク」という言葉が意味するのは、ディープラーニングとフェイクコンテンツだ。

ディープフェイクの目的は通常、人々を騙すのに十分なほど本物に見えるものを作ることだ。

有名人が奇妙なことをしたり、政治家が実際には決して言わないようなとんでもない発言をしているバイラルビデオを見たことがあるかもしれない。

これらは典型的なディープフェイクの使用例だ。あなたが見ているものは本物ではないが、その背後にある技術は十分に向上しているため、本当に見ていない限り、あなたの脳はすぐにフェイクに気づかない。

そこで トゥルースキャン に入る。

TruthScanは、企業、報道機関、大学、公共機関など、大規模なメディア検証を必要とする組織向けに構築されています。偽のコンテンツによって信頼や評判が損なわれる前に、操作に気づくことができます。

実際、Undetectable AIの研究チームによれば、次のようになる、 アメリカ人の85 %が、ディープフェイクによってオンライン情報への信頼が損なわれたと答えている。.

ディープフェイク・ビデオやメディアとは何なのか?

ディープフェイクはどのように作られるか

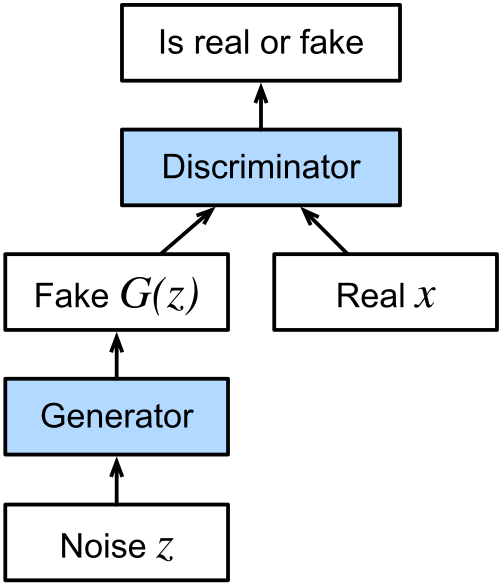

ほとんどのディープフェイクの背後にある技術は、Generative Adversarial Network(GAN)と呼ばれる機械学習アルゴリズムの一種である。

GANは生成器と識別器の2つの部分から構成されている。

ジェネレーターは、複製するように訓練されたものに基づいて偽のメディアを作成し、識別装置の仕事は、偽に見えるものを呼び出すことである。

ジェネレーターが識別テストをパスできる偽コンテンツを作るのがうまくなるまで、両者は行ったり来たりを繰り返す。

時間をかけて、この行き来が、衝撃的なほどリアルに見えるメディアにつながっていく。

ディープフェイク映像生成プロセスとは?

ディープフェイクビデオを構築する際、システムは複数のアングルからビデオを分析し、人物がどのように話し、顔がどのように動き、身体がどのように動くかを研究する。

これらの情報はすべてジェネレーターに送られ、ジェネレーターはこれらの行動を模倣したコンテンツを作成することができる。

そして、最終的な結果がちょうどよく見えるまで、どこがズレているかを指摘することで微調整を助ける。

だから、イリュージョンは動きの中でもうまく維持できるのだ。

ディープフェイクビデオの目的に応じて、いくつかの異なるテクニックが使われている。

もし、誰かが実際に言ったこともやったこともないことをビデオの中で言ったように見せたり、やったように見せたりするのであれば、私たちはいわゆるソースビデオのディープフェイクを扱っていることになる。

エンコーダーとデコーダーで構成されるディープフェイクオートエンコーダーは、オリジナルの映像を研究し、ターゲットの表情、ジェスチャー、微妙な頭の動きをそれに適用する。

オーディオ・ディープフェイク

オーディオ・ディープフェイクは、自然な話し方の録音をもとに、やはりGANを使って誰かの声をクローンすることで機能する。

一度訓練されれば、たとえその人が実際にその言葉を発しなかったとしても、モデルはその声で新しい音声を生成することができる。

もうひとつ、リップシンクもよく加えられるレイヤーだ。

ここでは、生成または録音された音声をビデオにマッピングする。

目標は、ビデオの唇と音声の言葉を一致させることだ。

ディープフェイクの実例

最近、ディープフェイクがあちこちに出没している。

技術の進歩を示す人気のディープフェイクを紹介しよう。

ウクライナ軍に降伏を求めるゼレンスキー大統領のディープフェイク

ロシアとウクライナの戦争が始まったばかりの2022年3月、ある動画がネット上に公開された。 ウクライナのヴォロディミル・ゼレンスキー大統領を示す 兵士たちに降伏を促した。

ゼレンスキーの声と物腰で、まるで全国演説のようだった。

この動画はソーシャルメディア上で拡散され、ウクライナの危険なニュースサイトにも掲載された。

大統領は素早く行動し、確認されたチャンネルを通じて公式声明を発表し、この映像を否定した。

ローマ法王フランシスコがデザイナーズ・パフジャケットを着ているディープフェイク画像が流出

ディープフェイクの画像は、悪意がなくても混乱を引き起こすことがある。

2023年、ある写真が流行した。 ローマ法王フランシスコ、スタイリッシュなバレンシアガの白いパフジャケットで歩く はインターネットを席巻した。

再生回数は数千万回を記録し、各プラットフォームで広く共有された。

この画像は、シカゴの匿名ユーザーによってMidjourneyというAIツールを使って作成された。

オンライン詐欺に使われるイーロン・マスクのディープフェイク

2024年だ、 イーロン・マスクをフィーチャーしたディープフェイク は、いくつかの大規模なオンライン詐欺の中心的存在となった。

AIが生成したマスクの動画がフェイスブックやTikTokなどに出回り始め、偽の暗号通貨プレゼントや投資スキームを宣伝している。

これらのクリップは驚くほどリアルに見えたし、聞こえた。

被害は理論的なものだけではなかった。ある定年退職した老人は、このようなビデオに騙され、$70万円近くを失ったと報告されている。

米国有権者を狙ったジョー・バイデンのディープフェイク・ロボコール

2024年初頭、ニューハンプシャー予備選の直前、 ロボコールを受けた有権者 ジョー・バイデン米大統領にそっくりだった。

この電話では、ジョー・バイデンは有権者に家に留まり、11月の総選挙のために票を温存するよう促していた。その意図は、有権者を混乱させ、予備選をスキップするように惑わすことだった。

この事件は規制を求める声を引き起こした。擁護団体は米連邦選挙委員会に介入するよう求めたが、FECはその権限に限界があるとして最終的に拒否した。

一方、このロボコールを配信した通信会社は、次のように述べている。 $1百万ドルの罰金支払いに合意.

2020年インド選挙における政治的ディープフェイク利用

ディープフェイク技術のすべての使用が有害であったり、意図的に欺くものであったりするわけではない(これについてはブログの後半で詳しく説明する)。

2020年デリー州議会選挙で バラティヤ・ヤナタ党がキャンペーン広告にAIを活用 さまざまな言語的聴衆のために。

同党は、党首のマノジ・ティワリが英語で話しているビデオを撮影し、リップシンクを使って地方の方言であるハリャンヴィー語のバージョンを作った。

ナレーションは俳優が担当し、映像はティワリの実際の映像で訓練されたAIを使って、新しい音声に合うように修正された。

党員たちは、たとえ候補者がその言語を流暢に話せなくても、有権者が理解できる言語で有権者とつながることを可能にする技術の前向きな応用だと考えた。

ディープフェイクを実世界で検証する方法

政治、エンターテインメント、日常のコミュニケーションにディープフェイクが蔓延する中、何が本物かを見極める方法を知ることは、これまで以上に重要となっている。.

洗練された事例が増加しているにもかかわらず、ディープフェイク技術の脅威に対抗する信頼性の高いツールは存在する。.

検出不可能なAI AI動画検出器 そのようなツールの一つであり、高度なディープフェイク技術に対抗する信頼性の高いツールが存在することを示している。.

そこでUndetectable AIの ディープフェイク検出 が入ってくる。

を検証するためのものだ。 音声または映像コンテンツが人工的に生成されたものである。フレームごとの動き、ピクセルレベルの一貫性、声のフィンガープリントを分析する高度なフォレンジック・モデルを使用。

ユーザーは数秒で、ビデオがデジタル加工されたかどうか、あるいはAIによって声がコピーされたかどうかを知ることができる。

ファイルをアップロードするだけで、ツールは視覚的な内訳と信頼度スコアを含む詳細な真正性レポートを提供する。

Deepfake Detectionは、バイラルクリップであれ、疑わしいインタビューであれ、共有された録音であれ、ジャーナリスト、教育者、一般ユーザーが見聞きしたことの背後にある真実を明らかにするのに役立ちます。

ディープフェイクは危険か?リスクと懸念

これまで、ディープフェイクとは何か、どのように作られるのか、そして現実の世界ですでに現れている場所について見てきた。

このテクノロジーは紛れもなく素晴らしいものだが、それに付随するリスクは深刻で、急速に拡大している。

ディープフェイクは様々な方法で武器になり得る。主な懸念事項をいくつか挙げてみよう。

名誉毀損

誰かの似顔絵や声が、偽の発言や声明、動画、特に攻撃的で物議を醸すようなものの作成に使われると、評判はたちまち台無しになる。

そして、古いデマや偽の引用とは異なり、説得力のあるディープフェイクは、見る者の心に疑いの余地をほとんど残さない。

この点で、ディープフェイクは怒りをかき立てたり、人間関係を破壊したり、単に有害な物語を押し付けることができる。

特に問題なのは、ディープフェイクが完璧である必要さえないことだ。

人物を認識でき、内容が十分に信じられるものであれば、世論に永続的なインパクトを残すことができる。

情報の信頼性

もうひとつの大きな懸念は、ディープフェイクがいかに真実という概念を損なうかということだ。

ディープフェイクが一般的になるにつれ、私たちが見聞きしているものが本物かどうかを知ることは難しくなっている。そのうちに、あらゆる形態のデジタル・コミュニケーションに対する信頼が、より広範に損なわれることになりかねない。

この信頼性の危機は、個々の事件にとどまらない。

民主的な社会では、人々は意思決定、議論、集団的な問題の解決において、共有された事実に依拠する。

しかし、有権者や視聴者、市民がすべてを疑い始めたら、世論を操作したり、不都合な真実を "単なる深層心理の捏造 "として片付けたりするのはずっと簡単になる。

恐喝

AIが生成したメディアは、個人が違法なこと、倫理に反すること、恥ずかしいことをしたように見せかけることで、偽の罪を着せるために使われる可能性がある。

このような捏造された証拠は、彼らを脅したりコントロールしたりするために使われる。

そしてそれはどちらにも当てはまる。ディープフェイクが現実的になっているため、本物の恐喝に直面している人は、たとえ証拠が偽物でなくても、偽物だと主張するかもしれない。

これは脅迫インフレと呼ばれることもあり、信じられる偽物が大量に出回ることで、実際の証拠資料の価値が下がってしまう。

本当の証拠の信憑性は霧の中で失われ、不正行為を暴こうとする際には、さらに複雑な層が増えるだけだ。

詐欺と詐欺

AIが生成したビデオや信頼できる公人の声を使い、詐欺師は信じられないほど説得力のある詐欺を仕掛けている。

イーロン・マスク、トム・ハンクス、オプラ・ウィンフリーといった有名人のディープフェイクが、聞いたこともないような商品やサービスの推薦に使われるケースもある。

これらの動画はソーシャル・プラットフォームにプッシュされ、何百万もの人々に届く。

特に、特定の人を標的に、操作したり騙したりするためにパーソナライズされたコンテンツを提供するスピアフィッシング・キャンペーンでは、個人でさえ危険にさらされている。

によると、次のようになる。 フォーブスによる2024年レポートディープフェイクに起因する詐欺は、すでに世界で推定$120億ドルの損失を計上しており、この数字は今後数年間で3倍以上になると予想されている。

そのため、検知は個人のためだけではありません。機密データ、通信、公開コンテンツを扱う企業にとって不可欠なのです。TruthScanは、このような企業が、誤った情報が広まる前に、改ざんされた動画を特定するのに役立ちます。

ディープフェイクの積極的かつ創造的な利用法

注目すべきは、この技術のすべての応用が否定的ではないということだ。

ディープフェイクとは何かを説明する多くのブログは誤用に焦点を当てているが、ディープフェイクの創造的で生産的な使われ方のリストは増えている。

それでも、企業にとっては、ディープフェイクの芸術的利用やマーケティング利用であっても、公開前に真偽を確認する必要がある。

TruthScanのようなツールは、最終版に意図しない操作が残されていないことを確認することができる。

以下に注目すべき例を挙げる。

映画・俳優出演

スタジオはディープフェイク技術に頼り始めている:

- 視覚効果の向上

- 生産コストの削減

- 今はもういないキャラクターを復活させる

ディズニー例えば、「Deepfake.com」は高解像度のディープフェイクモデルを改良しており、俳優の顔を入れ替えたり、老化を防いだりすることができる。

この技術は1024×1024の解像度で作動し、顔の表情を正確に追跡して、キャラクターを若く見せたり、表情豊かに見せたりすることができる。

ハリウッドの枠を超えて、ディープフェイクは世界的なキャンペーン活動を可能にした。 デビッド・ベッカム、デジタル・クローンにされる 健康メッセージを多言語で伝える。

アート

2018年、マルチメディア・アーティストのジョセフ・アイルは、ディープフェイク技術を使って、イタリアの映画スター、オルネッラ・ムーティの顔とケンダル・ジェンナーの体を融合させたAI俳優を作った。

その結果、世代間のアイデンティティの超現実的な探求と芸術的な挑発が生まれ、『Un'emozione per sempre 2.0』と題されたビデオ作品の一部となった。

ディープフェイクは風刺やパロディにも登場する。

サウスパーク』のクリエイター、トレイ・パーカーとマット・ストーンが手掛けた2020年のウェブシリーズ『Sassy Justice』は、その典型的な例だ。

ディープフェイクされた公人を使って時事問題をからかいつつ、技術自体の認知度を高めた。

カスタマーサービス

クリエイティブ産業以外でも、企業は顧客向けサービスのディープフェイクに有用性を見出している。

現在、一部のコールセンターでは、ディープフェイク技術による合成音声を使って、口座照会や苦情記録などの基本的なリクエストを自動化している。

このような場合、その意図は悪意ではなく、単に合理化することにある。

自動化されたサービスをより自然で魅力的なものにするために、AIが生成した音声を使用して、発信者応答システムをパーソナライズすることができる。

扱われるタスクは通常、リスクが低く反復的であるため、この文脈におけるディープフェイクはコストを削減し、人間のエージェントをより複雑な問題に解放するのに役立つ。

教育

教育プラットフォームもまた、よりインタラクティブな方法で学習者を支援するために、ディープフェイクを利用したチューターを取り入れ始めている。

こうしたAIを活用した家庭教師は、合成音声や個人に合わせたガイダンスを使って授業を行うことができる。

ディープフェイク検出ツールとテクニック

ディープフェイクがより進化し、アクセスしやすくなるにつれ、被害をもたらす前にそれを特定する必要性も高まっている。

人や組織もまた、一歩先を行くために適切なツールやテクニックを必要としている。そこで、いくつかのツールとテクニックを紹介しよう。

イメージ重視の検証のため、 TruthScanのAI画像検出器 ライティング、ピクセルパターン、合成要素を分析し、AIが生成または編集したビジュアルにリアルタイムでフラグを付けます。

コンテンツが公開されたり共有されたりする前に、画像やビデオフレームの真正性を迅速に確認することができます。

トゥルーススキャンエンタープライズグレードのディープフェイク検出

トゥルースキャン は、映像や音声コンテンツの大規模な検証を必要とする企業、大学、報道機関向けに設計されています。

ビデオの信憑性を多角的に分析する:

- 顔の入れ替わり検出: 操作された顔の特徴をフレームごとに識別する。

- 行動指紋: 人間の自然な行動とは一致しない微妙な表情パターンや微小な動きを検出する。

- ビデオ・フォレンジック フレーム圧縮、ピクセルノイズ、音声改ざんを調べる。

- リアルタイム検出: ビデオ通話、プレス・リリース、ブロードキャスト・ストリーム中のライブ検証を可能にします。

TruthScanを使用することで、チームは公開や一般配布の前にビデオを認証することができ、風評被害や金銭的損害を防ぐことができます。

日常的なユーザーに対しては、Undetectable AIのツールが個人レベルで同様の保護を提供する。

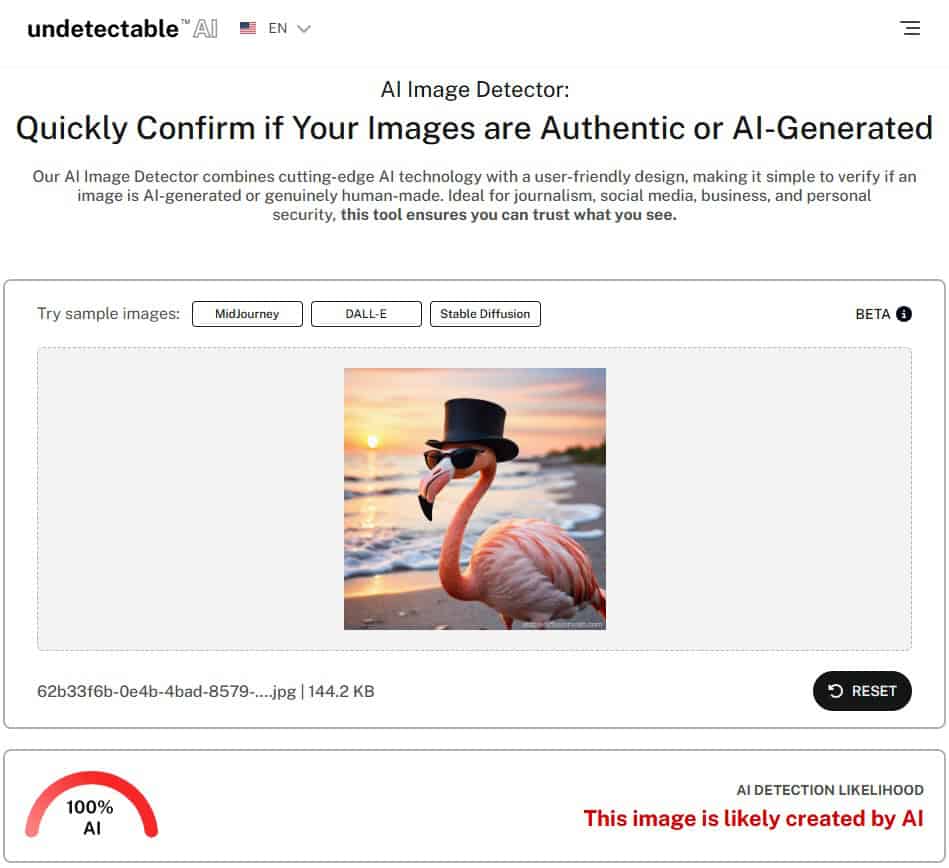

検出不可能なAIによるAI画像検出器

Undetectable AIのAI画像検出は、技術的なバックグラウンドを持たない人でも、ディープフェイク検出をより簡単にします。

この検出器は、アップロードされた画像の色パターン、テクスチャ、顔の特徴、構造の不一致など、さまざまな要素を分析することで機能する。

以下のような最も有名なAI画像ジェネレーターを使って作成されたメディアの検出をサポートしている。

- ミッドジャーニー

- ダール・イー

- 安定した拡散

- イデオグラム

- GANベースのモデル

使い方は簡単で、画像をアップロードしてツールに分析させれば、信頼度スコアとともに明確な判定が表示される。

もし、あなたが目にした画像が本物かどうかわからない場合は、私たちのサイトをお試しください。 AI画像検出器 AIが改ざんした形跡がないかチェックする。

さて、次は アンデテクタブルのAIディテクター をテストし、AIが生成した画像であることを正確に見分けることができるかどうかを確認する。

ご覧のように、Undetectable AIによる画像AI検出器は、この画像に100% AI生成のフラグを立てました。

手動検出のための視覚的および行動的テクニック

また、ディープフェイクを手動で検出するために、特に即時分析が必要な状況で個人が使える実用的なテクニックもある。

視覚的な危険信号には次のようなものがある:

- ぎこちない顔の位置や奇妙な表情。

- 画像や映像のさまざまな部分で、照明や色使いに一貫性がない。

- 顔や髪の生え際がチカチカする。

- 自然なまばたきの欠如、または不規則な目の動き。

- 音声と発話が一致しない場合のリップシンクの不一致。

行動面から見ると、ディープフェイクは人間の微妙な特徴を模倣するのに苦労することが多い。ボディランゲージ、感情表現、習慣的なジェスチャーに注意を払う。

そして、リアルタイムの会話、特にライブビデオでは、横顔を映してもらう。

多くのディープフェイク・モデルは、自然な表情を保ちながら、顔の角度を90度にしたり、首を回したりするような複雑な動きを正確に表現することにまだ苦労している。

テキストと文脈からディープフェイクを見抜く

ディープフェイクはビジュアルに限らない。誰かのコミュニケーション・スタイルを模倣した合成テキスト、音声、行動を含むバージョンもある。

テキストコンテンツやダイアログを分析する際には、以下の点に注意する:

- スペルミスや奇妙な文法。

- 押しつけがましく感じられたり、自然に流れない文章。

- 通常と異なるメールアドレスや一貫性のない表現。

- 脈絡のない、あるいは状況とは無関係に感じられるメッセージ。

文脈も重要だ。政治家が低品質のクリップでさりげなく重大な決定を発表するような、意味をなさない設定でビデオやメッセージが表示されたら、その信憑性を疑う価値がある。

AIディテクターとヒューマナイザーに興味がありますか?下のウィジェットでお試しください!

ディープフェイクに関するFAQ

ディープフェイクは違法か?

ディープフェイクは、デフォルトでは違法ではないが、名誉毀損、児童ポルノ、非合意の露骨なコンテンツなどを対象とする既存の法律に違反する場合は、違法となる可能性がある。

米国のいくつかの州では、選挙に影響を与えたり、リベンジポルノに関与したりするディープフェイクを対象とする法律が成立している。

デファイアンス法などの連邦法案や ノー・フェイク・アクト また、ディープフェイク技術の悪意ある利用を規制する動きもある。

誰かディープフェイクを作れないか?

そう、無料または低コストのソフトウェアやAIツールを使えば、ほとんど誰でもディープフェイクを作ることができる。

現在、多くのプラットフォームがユーザーフレンドリーなインターフェイスを提供しているため、始めるのに高度な技術的スキルは必要ない。

ディープフェイクから身を守るには?

ディープフェイク検出アプリはありますか?

一方、Undetectable AIのディテクターは、より少量のコンテンツを検証したい個人やクリエイター向けに設計されている。

最終的な感想

ディープフェイクは、私たちがオンラインで真実を見る方法を再構築しています。ブランドを保護するにしても、公的なコミュニケーションを管理するにしても、あるいはただ安全にブラウジングするにしても、適切な検知ツールを使うことで大きな違いが生まれます。

企業・団体向け トゥルースキャン は、AIによる誤報に対する企業レベルの保護を提供します。

個人の場合、検出不可能なAI AI画像検出器 は、画像をチェックし、情報を得るためのシンプルで迅速な方法を提供します。

この2つの協力によって、あなたが見たり共有したりするものがリアルなものに保たれるのです。