O termo deepfake apareceu pela primeira vez no Reddit em 2017quando um utilizador com o mesmo nome de ecrã começou a partilhar vídeos alterados que utilizavam a IA para trocar rostos, inicialmente em conteúdos para adultos.

Embora o Reddit tenha banido o subreddit original, a ideia já tinha arrancado.

Mas as raízes desta tecnologia são ainda mais antigas.

Em 1997, os investigadores já tinham começado a fazer experiências com a edição de vídeo através da aprendizagem automática.

A sua primeira ferramenta de sincronização labial, chamada Reescrita de vídeo pode fazer com que alguém pareça ter dito algo que não disse.

Não era tecnicamente um deepfake segundo os padrões actuais, mas lançou as bases para o que viria a seguir.

O blogue de hoje é sobre como funciona esta tecnologia em evolução, onde aparece na vida quotidiana e quais os riscos e benefícios que traz consigo.

Comecemos por perceber o que é de facto um deepfake.

Principais conclusões:

- Os deepfakes são meios de comunicação gerados por IA que fazem com que as pessoas pareçam dizer ou fazer coisas que na realidade nunca fizeram.

- Com ferramentas gratuitas e conhecimentos básicos, quase qualquer pessoa pode agora criar vídeos, imagens ou clips de áudio deepfake convincentes.

- Embora os deepfakes possam ser criativos ou divertidos, também representam riscos graves, como fraudes, difamação e desinformação.

- Pode detetar a maioria dos deepfakes utilizando ferramentas de deteção ou observando atentamente as inconsistências visuais e comportamentais.

O que é um Deepfake?

Um deepfake é um meio de comunicação falso, normalmente um vídeo, um clip de áudio ou uma imagem, que foi alterado utilizando inteligência artificial para fazer com que alguém pareça estar a fazer ou a dizer algo que nunca fez.

Não confundam isto com um mau trabalho de Photoshop ou com uma locução mal feita.

Estamos a falar de manipulação de alto nível utilizando uma tecnologia chamada aprendizagem profunda, que é um subconjunto da IA.

Nunca mais se preocupe com o facto de a IA detetar os seus textos. Undetectable AI Pode ajudar-vos:

- Faça aparecer a sua escrita assistida por IA de tipo humano.

- Bypass todas as principais ferramentas de deteção de IA com apenas um clique.

- Utilização IA com segurança e com confiança na escola e no trabalho.

É isso que o termo "deepfake" implica: aprendizagem profunda e conteúdos falsos.

O objetivo de um deepfake é normalmente criar algo que pareça suficientemente real para enganar as pessoas.

Talvez já tenha visto aqueles vídeos virais de celebridades a fazer coisas bizarras ou de políticos a fazer declarações ultrajantes que nunca chegariam a dizer.

Estes são casos clássicos de utilização de deepfake. O que se está a ver não é real, mas a tecnologia por detrás disso é suficientemente boa para que o cérebro não detecte imediatamente a falsificação, a não ser que se esteja mesmo à procura.

É aí que ferramentas como TruthScan entrar.

O TruthScan foi criado para organizações que precisam verificar a mídia em escala - empresas, redações, universidades e órgãos públicos. Ele ajuda as equipes a identificar manipulações antes que o conteúdo falso prejudique a confiança ou a reputação.

De facto, de acordo com a equipa de investigação da Undetectable AI, 85 % dos americanos afirmam que os deepfakes diminuíram a sua confiança na informação em linha.

Acabaste de aprender o que é um vídeo ou um meio de comunicação deepfake, agora vamos ver como é que as pessoas os fazem.

Como são feitas as deepfakes

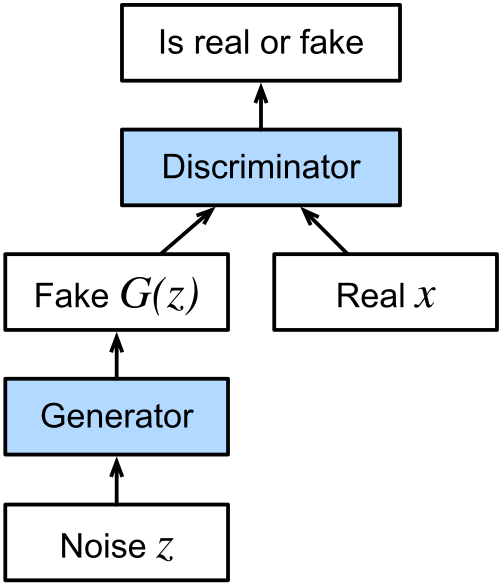

A tecnologia subjacente à maioria dos deepfakes é uma categoria de algoritmos de aprendizagem automática denominada redes adversárias generativas, ou GANs.

Os GANs são compostos por duas partes: um gerador e um discriminador.

O gerador cria meios de comunicação falsos com base no que foi treinado para replicar, e o trabalho do discriminador é chamar a atenção para o que parece falso.

Continuam a andar para trás e para a frente até que o gerador se torne melhor a criar conteúdos falsos que possam passar no teste do discriminador.

Com o passar do tempo, este vai-e-vem conduz a meios de comunicação que parecem chocantemente realistas.

O que é um processo de geração de vídeo Deepfake?

Ao construir um vídeo deepfake, o sistema analisa vídeos de vários ângulos, estuda a forma como a pessoa fala, como o seu rosto se move, como o seu corpo se desloca.

Todas essas informações são introduzidas no gerador para que este possa criar conteúdos que imitem esses comportamentos.

Depois, o discriminador ajuda a afiná-lo, apontando o que está errado, até que o resultado final seja o ideal.

É por isso que a ilusão se mantém tão bem em movimento.

São utilizadas algumas técnicas diferentes, dependendo do objetivo do vídeo deepfake.

Se a ideia é fazer com que alguém pareça dizer ou fazer algo num vídeo que na realidade nunca disse ou fez, então estamos perante o que se chama um deepfake de vídeo de origem.

Um codificador automático de deepfake, composto por um codificador e um descodificador, estuda a filmagem original e aplica-lhe as expressões, os gestos e os movimentos subtis da cabeça do alvo.

Deepfakes áudio

Um deepfake áudio funciona clonando a voz de alguém, mais uma vez utilizando GANs, com base em gravações da forma como a pessoa fala naturalmente.

Uma vez treinado, o modelo pode gerar um novo discurso com essa voz, mesmo que a pessoa nunca tenha efetivamente dito essas palavras.

Outra camada frequentemente adicionada é a sincronização labial.

Neste caso, o sistema mapeia o áudio gerado ou pré-gravado num vídeo.

O objetivo é fazer com que os lábios no vídeo correspondam às palavras no áudio.

Exemplos reais de Deepfakes

Os deepfakes estão a aparecer em todo o lado hoje em dia.

Vamos apresentar-lhe alguns deepfakes populares que mostram até que ponto a tecnologia avançou.

O Deepfake do Presidente Zelenskyy a pedir a rendição das tropas ucranianas

Em março de 2022, durante a fase inicial da guerra entre a Rússia e a Ucrânia, surgiu um vídeo na Internet que mostra o Presidente ucraniano Volodymyr Zelenskyy incitando os seus soldados a renderem-se.

Parecia um discurso nacional, com a voz e os trejeitos de Zelenskyy.

O vídeo espalhou-se pelas plataformas das redes sociais e foi mesmo publicado num sítio Web de notícias ucraniano comprometido.

O Presidente agiu rapidamente e divulgou uma declaração oficial através dos seus canais verificados para desmentir as imagens.

A imagem viral do Deepfake do Papa Francisco com um casaco de bombazina de marca

Por vezes, uma imagem deepfake não precisa de ser maliciosa para causar confusão.

Em 2023, uma foto viral de O Papa Francisco passeia com um elegante casaco branco da Balenciaga tomou de assalto a Internet.

A mensagem teve dezenas de milhões de visualizações e foi amplamente partilhada em todas as plataformas.

A imagem foi criada por um utilizador anónimo de Chicago, utilizando uma ferramenta de IA chamada Midjourney.

Deepfakes de Elon Musk usados em fraudes online

Em 2024, deepfakes com Elon Musk tornou-se um elemento central de várias burlas em linha de grande escala.

Vídeos de Musk gerados por IA começaram a aparecer no Facebook, no TikTok e noutras plataformas, promovendo falsas ofertas de criptomoedas e esquemas de investimento.

Estes clips pareciam e soavam extraordinariamente reais.

O prejuízo não foi apenas teórico. Um idoso reformado terá perdido cerca de $700.000 euros depois de ter sido convencido por um destes vídeos.

O Robocall Deepfake de Joe Biden que visou os eleitores dos EUA

No início de 2024, pouco antes das primárias de New Hampshire, eleitores receberam chamadas automáticas que soava exatamente como o Presidente dos EUA, Joe Biden.

No telefonema, Joe Biden exortava os eleitores a ficarem em casa e a guardarem o seu voto para as eleições gerais de novembro. A intenção era confundir e enganar os eleitores para que não participassem nas primárias.

O incidente desencadeou pedidos de regulamentação. Grupos de defesa instaram a Comissão Eleitoral Federal dos EUA a intervir, mas a FEC acabou por recusar, alegando limitações na sua autoridade.

Entretanto, a empresa de telecomunicações responsável pela distribuição da chamada automática concordou em pagar uma coima de $1 milhões.

Utilização de deepfake político nas eleições indianas de 2020

Nem todas as utilizações da tecnologia deepfake são prejudiciais ou enganadoras (veremos mais adiante no blogue).

Durante as eleições para a Assembleia Legislativa de Deli de 2020, o O Partido Bharatiya Janata utilizou a IA para adaptar um anúncio de campanha para diferentes públicos linguísticos.

O partido utilizou um vídeo do seu líder Manoj Tiwari a falar em inglês e recorreu a uma simulação labial para produzir uma versão em Haryanvi, um dialeto regional.

Enquanto a locução foi feita por um ator, os efeitos visuais foram modificados para corresponder ao novo áudio utilizando IA treinada em imagens reais de Tiwari.

Os membros do partido consideraram que se tratava de uma aplicação positiva da tecnologia, que lhes permitia estabelecer contacto com os eleitores numa língua que eles compreendiam, mesmo que o candidato não a falasse fluentemente.

Como verificar Deepfakes no mundo real

Com os deepfakes a espalharem-se pela política, entretenimento e comunicação quotidiana, saber como confirmar o que é real nunca foi tão importante.

Apesar do aumento de exemplos sofisticados, existem ferramentas confiáveis para combater a ameaça da tecnologia deepfake.

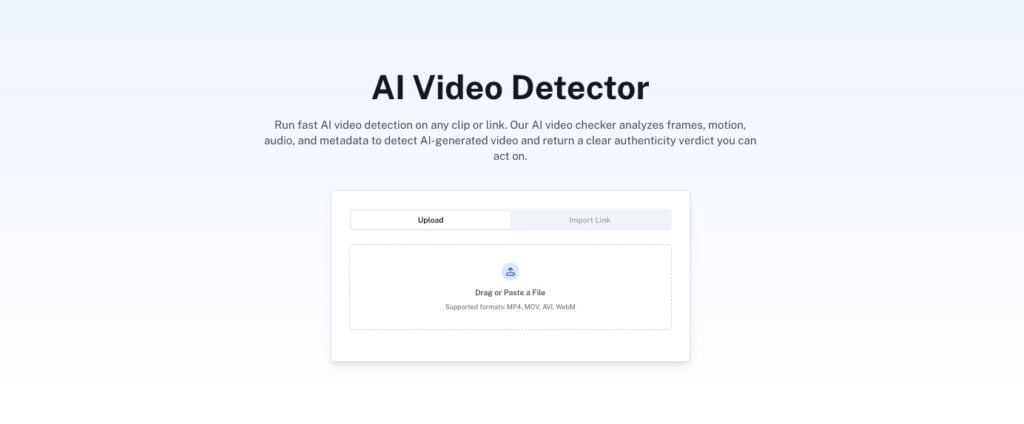

IA's indetectáveis Detector de vídeo com IA é uma dessas ferramentas, mostrando que existem ferramentas confiáveis para combater os exemplos sofisticados da tecnologia deepfake.

É aí que entra a IA indetetável da Deteção de Deepfake entra.

Foi concebido para verificar se o conteúdo áudio ou vídeo foi gerado artificialmenteutilizando modelos forenses avançados que analisam o movimento fotograma a fotograma, a consistência ao nível dos píxeis e a impressão digital vocal.

Em segundos, os utilizadores podem ver se um vídeo foi alterado digitalmente ou se uma voz foi clonada por IA.

Basta carregar o ficheiro e a ferramenta fornece um relatório de autenticidade detalhado com uma análise visual e uma pontuação de confiança.

Quer se trate de um clip viral, de uma entrevista suspeita ou de uma gravação partilhada, a Deepfake Detection ajuda jornalistas, educadores e utilizadores comuns a descobrir a verdade por detrás do que vêem e ouvem.

Os Deepfakes são perigosos? Riscos e preocupações

Até agora, analisámos o que é um deepfake, como é feito e onde já apareceu no mundo real.

A tecnologia é inegavelmente impressionante, mas os riscos que lhe estão associados são graves e estão a aumentar rapidamente.

As deepfakes podem ser utilizadas como armas de várias formas. Aqui estão algumas das principais preocupações.

Difamação

Quando a imagem ou a voz de alguém é utilizada para criar comentários, declarações ou vídeos falsos, especialmente os que são ofensivos ou controversos, pode arruinar reputações quase instantaneamente.

E, ao contrário dos embustes mais antigos ou das citações falsas, um deepfake convincente deixa pouca margem para dúvidas na mente do espetador.

Neste sentido, os deepfakes podem provocar indignação, destruir relações ou simplesmente promover uma narrativa prejudicial.

O que é especialmente preocupante é o facto de o deepfake nem sequer precisar de ser perfeito.

Desde que a pessoa seja reconhecível e o conteúdo seja suficientemente credível, pode ter um impacto duradouro na opinião pública.

Credibilidade da informação

Outra grande preocupação é a forma como os deepfakes minam a própria ideia de verdade.

À medida que os deepfakes se tornam mais comuns, é cada vez mais difícil saber se o que estamos a ver ou a ouvir é real. Com o tempo, isto pode levar a uma erosão mais alargada da confiança em qualquer forma de comunicação digital.

Esta crise de credibilidade ultrapassa os incidentes individuais.

Nas sociedades democráticas, as pessoas baseiam-se em factos partilhados para tomar decisões, debater questões e resolver problemas colectivos.

Mas se os eleitores, os telespectadores ou os cidadãos começarem a questionar tudo, torna-se muito mais fácil manipular a opinião pública ou descartar verdades inconvenientes como "apenas mais um deepfake".

Chantagem

Os meios de comunicação gerados pela IA podem ser utilizados para incriminar falsamente as pessoas, fazendo parecer que fizeram algo ilegal, pouco ético ou embaraçoso.

Este tipo de provas fabricadas pode depois ser utilizado para os ameaçar ou controlar.

E isto é válido para os dois lados. Como os deepfakes são agora tão realistas, alguém que esteja a enfrentar uma chantagem real pode alegar que as provas são falsas, mesmo que não o sejam.

Esta situação é por vezes designada por inflação da chantagem, em que o grande volume de falsificações credíveis acaba por reduzir o valor do material incriminatório real.

A credibilidade das provas reais perde-se no nevoeiro, o que apenas acrescenta mais uma camada de complexidade quando se tenta expor uma infração.

Fraudes e burlas

Utilizando vídeos gerados por IA ou vozes de figuras públicas de confiança, os burlões estão a criar esquemas incrivelmente convincentes.

Nalguns casos, os deepfakes de celebridades como Elon Musk, Tom Hanks ou Oprah Winfrey são utilizados para promover produtos ou serviços de que nunca ouviram falar.

Estes vídeos são depois difundidos nas plataformas sociais, onde chegam a milhões de pessoas.

Até os particulares estão em risco, especialmente em campanhas de spearphishing que visam pessoas específicas com conteúdos personalizados concebidos para manipular ou enganar.

De acordo com um Relatório 2024 da ForbesA fraude baseada em deepfake já registou perdas globais estimadas em $12 mil milhões, prevendo-se que esse valor mais do que triplique nos próximos anos.

É por isso que a deteção não é apenas para indivíduos. Ela é essencial para empresas que lidam com dados confidenciais, comunicações ou conteúdo público. O TruthScan ajuda essas organizações a identificar vídeos alterados antes que a desinformação se espalhe.

Utilizações positivas e criativas de Deepfakes

É de salientar que nem todas as aplicações da tecnologia são negativas.

Embora muitos blogues que explicam o que é um deepfake se concentrem na utilização indevida, há uma lista crescente de formas criativas e produtivas de utilização de deepfakes.

Ainda assim, para as empresas, mesmo as utilizações artísticas ou de marketing de deepfakes devem ser verificadas quanto à autenticidade antes da sua publicação.

Ferramentas como o TruthScan podem confirmar que nenhuma manipulação não intencional permanece na versão final.

Seguem-se alguns exemplos notáveis.

Filmes e actuações

Os estúdios estão a começar a confiar na tecnologia deepfake para coisas como:

- Melhorar os efeitos visuais

- Redução dos custos de produção

- Trazer de volta personagens que já não existem

Disneypor exemplo, tem vindo a aperfeiçoar modelos deepfake de alta resolução que permitem a troca de rostos e o envelhecimento de actores com um realismo impressionante.

A sua tecnologia funciona com uma resolução de 1024 x 1024 e pode seguir com precisão as expressões faciais para fazer com que as personagens pareçam mais jovens ou mais expressivas.

Para além de Hollywood, os deepfakes permitiram o trabalho de campanhas globais, como quando David Beckham foi clonado digitalmente para transmitir uma mensagem de saúde em várias línguas.

Arte

Em 2018, o artista multimédia Joseph Ayerle utilizou a tecnologia deepfake para criar um ator de IA que misturava o rosto da estrela de cinema italiana Ornella Muti com o corpo de Kendall Jenner.

O resultado foi uma exploração surrealista da identidade geracional e da provocação artística, parte de uma obra de arte em vídeo intitulada Un'emozione per sempre 2.0.

Os deepfakes também apareceram na sátira e na paródia.

A série web de 2020 Sassy Justice, criada pelos criadores de South Park, Trey Parker e Matt Stone, é um excelente exemplo.

Utilizava figuras públicas com deepfakes para gozar com a atualidade e sensibilizar para a própria tecnologia.

Serviço ao cliente

Fora das indústrias criativas, as empresas estão a encontrar utilidade nos deepfakes para serviços dirigidos aos clientes.

Alguns centros de atendimento telefónico utilizam agora vozes sintéticas alimentadas por tecnologia deepfake para automatizar pedidos básicos, como pedidos de informação sobre contas ou registo de reclamações.

Nestes casos, a intenção não é maliciosa, mas simplesmente racionalizar.

Os sistemas de resposta a chamadas podem ser personalizados utilizando vozes geradas por IA para tornar os serviços automatizados mais naturais e envolventes.

Uma vez que as tarefas tratadas são geralmente de baixo risco e repetitivas, os deepfakes neste contexto ajudam a reduzir os custos e a libertar agentes humanos para questões mais complexas.

Educação

As plataformas de ensino também começaram a incorporar tutores com tecnologia deepfake para ajudar os alunos de forma mais interactiva.

Estes tutores baseados em IA podem dar aulas utilizando vozes sintéticas e orientação personalizada.

Ferramentas e técnicas de deteção de Deepfake

À medida que os deepfakes se tornam mais avançados e acessíveis, também aumenta a necessidade de os identificar antes que causem danos.

As pessoas e as organizações também precisam das ferramentas e técnicas corretas para se manterem um passo à frente. Eis algumas ferramentas e técnicas.

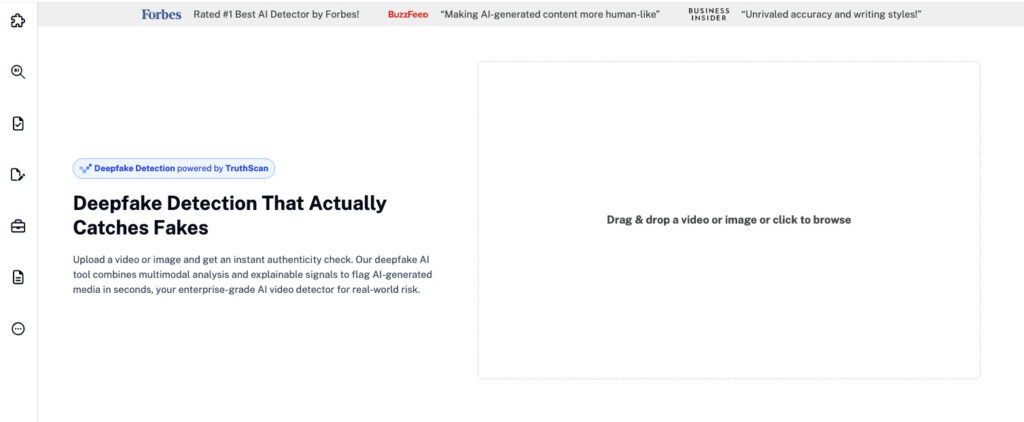

Para verificação com foco na imagem, Detetor de imagens com IA do TruthScan analisa a iluminação, os padrões de píxeis e os elementos compostos para assinalar visuais gerados por IA ou editados em tempo real.

Ajuda as equipas a confirmar rapidamente a autenticidade de imagens e quadros de vídeo antes de o conteúdo ser publicado ou partilhado.

TruthScan: Deteção de Deepfake de nível empresarial

TruthScan foi concebido para empresas, universidades e organizações de comunicação social que necessitam de uma verificação em grande escala de conteúdos visuais e áudio.

Analisa a autenticidade do vídeo em várias dimensões:

- Deteção de troca de rosto: Identifica as caraterísticas faciais manipuladas quadro a quadro.

- Impressão digital comportamental: Detecta padrões de expressão subtis e micro-movimentos inconsistentes com o comportamento humano natural.

- Vídeo Forense: Examina a compressão de fotogramas, o ruído de píxeis e a adulteração de voz.

- Deteção em tempo real: Permite a verificação em direto durante videochamadas, comunicados de imprensa ou transmissões em direto.

Com o TruthScan, as equipas podem autenticar vídeos antes da publicação ou distribuição pública, evitando danos financeiros e à reputação.

Para os utilizadores comuns, as ferramentas da Undetectable AI oferecem uma proteção semelhante a nível individual.

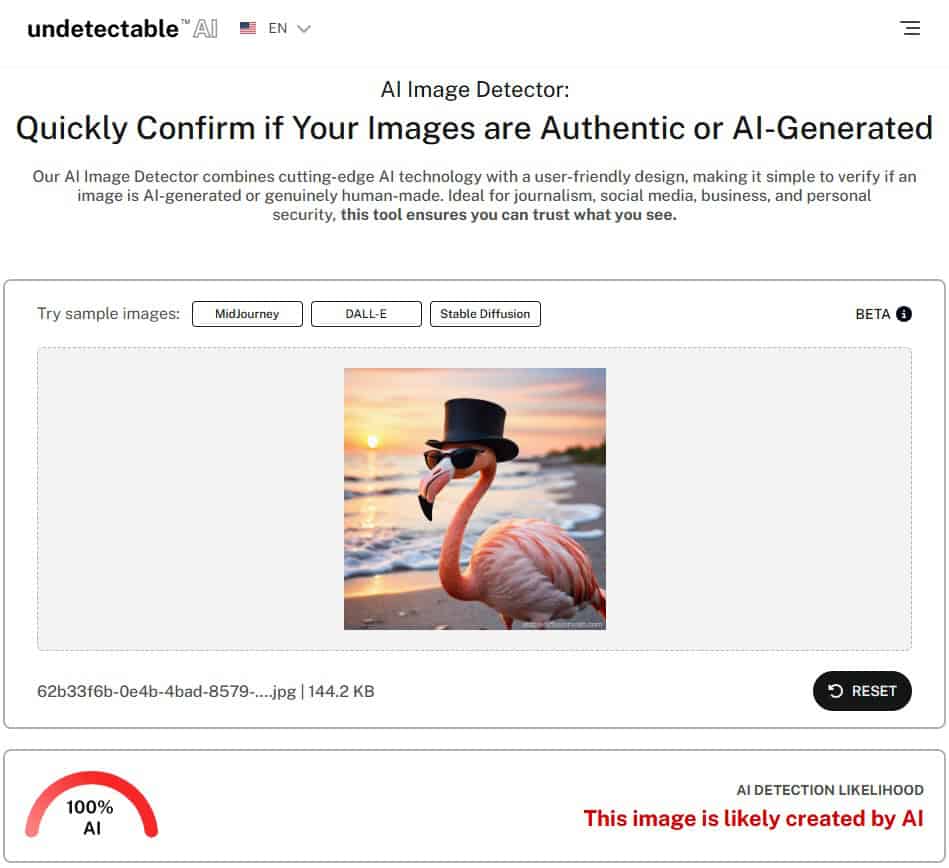

Detetor de imagens AI por Undetectable AI

O Detetor de Imagens com IA da Undetectable AI torna a deteção de deepfake mais fácil, mesmo para quem não tem conhecimentos técnicos.

O detetor funciona através da análise de vários elementos numa imagem carregada, tais como padrões de cor, texturas, caraterísticas faciais e inconsistências estruturais.

Suporta a deteção de suportes criados com os geradores de imagens de IA mais conhecidos, como

- A meio da viagem

- DALL-E

- Difusão estável

- Ideograma

- Modelos baseados em GAN

Para a utilizar, basta carregar uma imagem, deixar que a ferramenta a analise e receber um veredito claro com uma pontuação de confiança.

Se não tiver a certeza de que uma imagem que encontrou é genuína, experimente a nossa Detetor de imagens AI para verificar se há sinais de adulteração da IA.

Agora, vamos colocar Detetor de IA da Undetectable para testar e ver se consegue dizer com exatidão que a imagem é gerada por IA.

Como se pode ver, o detetor de IA de imagens da Undetectable AI assinalou esta imagem como sendo 100% gerada por IA.

Técnicas visuais e comportamentais para a deteção manual

Existem também técnicas práticas que as pessoas podem utilizar para detetar manualmente os deepfakes, especialmente em situações em que é necessária uma análise imediata.

Alguns sinais de alerta visuais incluem:

- Posicionamento facial estranho ou expressões estranhas.

- Iluminação ou coloração inconsistente em diferentes partes da imagem ou do vídeo.

- Cintilação à volta do rosto ou da linha do cabelo, especialmente durante o movimento.

- Falta de pestanejo natural ou movimento irregular dos olhos.

- Discrepâncias na sincronização labial quando o áudio não coincide com o discurso.

De um ponto de vista comportamental, os deepfakes têm muitas vezes dificuldade em imitar caraterísticas humanas subtis. Preste atenção à linguagem corporal, às expressões emocionais e aos gestos habituais.

E nas conversas em tempo real, especialmente nos vídeos em direto, peça uma vista de perfil lateral.

Muitos modelos deepfake ainda têm dificuldade em reproduzir com precisão um ângulo facial de 90 graus ou movimentos complexos, como virar a cabeça, mantendo expressões naturais.

Detetar falsificações profundas no texto e no contexto

As deepfakes não se limitam a imagens. Algumas versões envolvem texto, voz ou comportamento sintéticos que imitam o estilo de comunicação de alguém.

Ao analisar o conteúdo textual ou o diálogo, esteja atento:

- Erros ortográficos e gramática estranha.

- Frases que parecem forçadas ou que não fluem naturalmente.

- Endereços de correio eletrónico pouco usuais ou frases incoerentes.

- Mensagens que parecem fora de contexto ou não relacionadas com a situação.

O contexto também é importante. Se um vídeo ou mensagem aparecer num contexto que não faz sentido, como um político a anunciar casualmente uma decisão importante num clip de baixa qualidade, vale a pena questionar a sua autenticidade.

Curioso sobre o nosso Detetor de IA e Humanizador? Experimente-os no widget abaixo!

FAQs sobre Deepfakes

As deepfakes são ilegais?

Os deepfakes não são ilegais por defeito, mas podem sê-lo se violarem leis existentes, como as que abrangem a difamação, a pornografia infantil ou o conteúdo explícito não consensual.

Alguns estados dos EUA aprovaram leis que visam os deepfakes que influenciam as eleições ou envolvem pornografia de vingança.

Projectos de lei federais como a Lei DEFIANCE e Lei NO FAKES estão também em curso para regular as utilizações maliciosas da tecnologia "deepfake".

Alguém pode fazer um deepfake?

Sim, quase qualquer pessoa pode criar um deepfake utilizando software gratuito ou de baixo custo e ferramentas de IA.

Muitas plataformas oferecem agora interfaces de fácil utilização, pelo que não são necessárias competências técnicas avançadas para começar.

Como é que me posso proteger dos deepfakes?

Limite a sua exposição, evitando publicar imagens ou vídeos de alta resolução online. Utilize definições de privacidade e ferramentas de deteção como IA indetetável ou TruthScan para verificar qualquer coisa suspeita.

Existem aplicações de deteção de deepfake?

Sim, o TruthScan foi concebido para utilizadores empresariais que necessitam de analisar conteúdos de vídeo em escala, enquanto os detectores da Undetectable AI servem indivíduos e criadores que procuram verificar volumes mais pequenos de conteúdos.

Considerações finais

Os deepfakes estão a remodelar a forma como vemos a verdade online. Quer esteja a proteger a sua marca, a gerir comunicações públicas ou apenas a navegar em segurança, a utilização das ferramentas de deteção corretas faz toda a diferença.

Para empresas e instituições, TruthScan proporciona uma proteção a nível empresarial contra a desinformação baseada em IA.

Para os indivíduos, IA indetetável Detetor de imagens AI oferece uma forma simples e rápida de consultar imagens e manter-se informado.

Juntos, ajudam a garantir que o que vê e partilha permanece real.