Säkerhet och etik inom AI är fortfarande en gråzon. Trots alla framsteg vi har gjort är många AI-verktyg idag ökända för att samla in tvivelaktiga data, producera partiska resultat och fungera med liten insyn i hur de faktiskt fungerar.

Claude AI är ett av de få system som öppet marknadsför sig med löftet om etisk intelligens. Tillverkarna hävdar att de har byggt en AI som endast förlitar sig på fritt flödande information och evidensbaserade resonemang.

Naturligtvis väcker sådana djärva påståenden frågor.

Vem är det egentligen som står bakom Claude AI? Och hur stödjer bolagets struktur dess värderingar i stället för att kompromissa med dem för att tjäna pengar?

I den här artikeln diskuterar jag vem som äger Claude AI och hur företagets ägarmodell stöder dess moraliska kompass.

Viktiga slutsatser

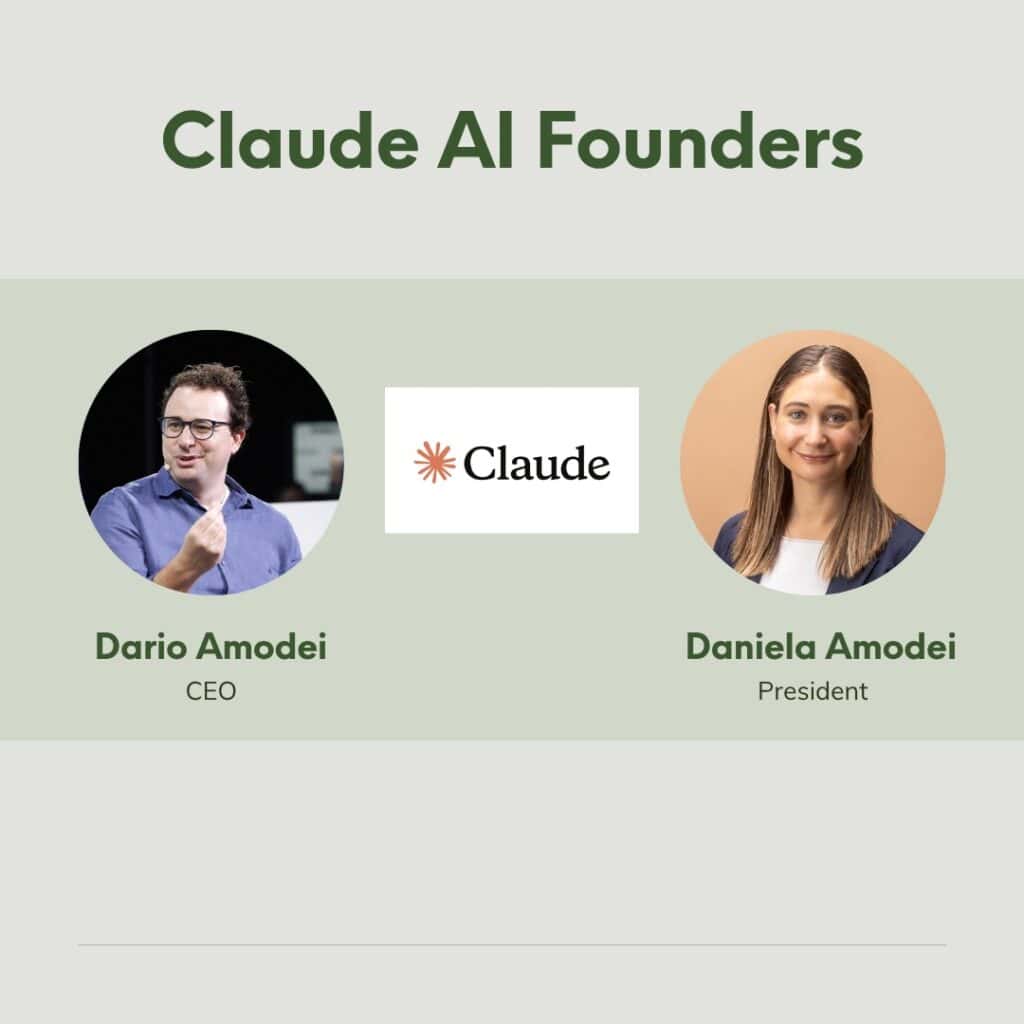

- Claude AI är byggt och ägs av Anthropic, ett AI-företag som grundades 2021 av de tidigare OpenAI-forskarna Dario och Daniela Amodei.

- Anthropic drivs som ett allmännyttigt företag (PBC), dvs. det är juridiskt bundet att balansera vinst med syfte. Amazon och Google har gjort stora investeringar i bolaget, men de har inte något att säga till om i beslutsfattandet.

- Claude använder konstitutionell AI, vilket innebär att den själv kontrollerar sina svar mot en skriven uppsättning etiska regler som inspirerats av principer om mänskliga rättigheter, ärlighet och integritet.

Vem äger Claude AI

Claude AI ägs och utvecklas av ett San Francisco-baserat företag Antropisk, ett startup-företag inom artificiell intelligens som grundades 2021.

Anthropic grundades av tidigare OpenAI-forskare, däribland Dario Amodei och Daniela Amodei, som är syskon.

Dario, VD, var tidigare OpenAI:s vice forskningschef och en av nyckelpersonerna bakom GPT-2 och GPT-3. Daniela, VD, ansvarade för OpenAI:s säkerhetspolicy.

Oroa dig aldrig för att AI upptäcker dina texter igen. Undetectable AI Kan hjälpa dig:

- Få din AI-assisterade skrivning att synas människoliknande.

- Bypass alla större AI-detekteringsverktyg med bara ett klick.

- Användning AI säkert och självsäkert i skolan och på jobbet.

Claude, deras flaggskeppsmodell inom AI, är uppkallad efter Claude Shannon, matematikern som kallas informationsteorins fader.

Den första versionen av Claude lanserades i mars 2023, följt av förbättrade Claude 2, Claude 3 och de senaste iterationerna som konkurrerar med OpenAI:s GPT-modeller.

Anthropics forskningsmetoder, i synnerhet konstitutionell AI-utbildning, där Claude lär sig genom uttryckliga etiska riktlinjer, utgör också grunden för många andra AI-system, inklusive Undetectable AI:s AI-chatt.

AI Chat är alltså en säker, integritetsvänlig samtalsassistent som inspirerats av Claudes rigorösa designprinciper.

Anthropics investerare och ägarstruktur

Anthropic är ett privatägt allmännyttigt företag (PBC) som är registrerat i Delaware. "Public-benefit"-biten innebär att det är juridiskt stadgat att balansera vinst med ett uppdrag.

I Claudes fall handlar det om att bygga AI i linje med mänskliga värderingar snarare än att jaga kortsiktiga ekonomiska vinster.

Vem äger Claude AI Anthropic, det grundande företaget?

Ägandet av bolaget är fördelat på flera personer.

Grundarna, inklusive syskonen Dario Amodei (VD) och Daniela Amodei (koncernchef), har ett stort inflytande över bolagets inriktning.

Tidigt anställda har också aktieoptioner, vilket är vanligt i nystartade teknikföretag.

De största investerarna i bolaget är bl.a:

- Amazon gjorde en investering på flera miljarder dollar i Anthropic till att bli en av sina största externa finansiärer. År 2023 tillkännagav det upp till $4 miljarder, och i efterföljande drag ökade det åtagandet.

- Google innehar för närvarande cirka 14% Anthropic-aktier och kommer att lägga till ytterligare $750 miljoner i år, vilket kommer att öka den totala investeringen i bolaget till över $3 miljarder.

Utöver detta bidrar många riskkapitalbolag (som Spark Capital, Lightspeed Venture Partners och Iconiq Capital) och institutionella investerare till bolaget.

Anthropic har också skapat en "Long-Term Benefit Trust" (ibland kallad "purpose trust").

Trusten har vissa styrningsrättigheter för att säkerställa att företagets uppdrag förblir opåverkat av investerare. Det gör Amazon och Google till stora minoritetsaktieägare snarare än kontrollerande ägare.

I september 2025, Anthropic tog också in cirka $13 miljarder i en finansieringsrunda som värderade bolaget till cirka $183 miljarder kronor.

Hur Claude AI fungerar

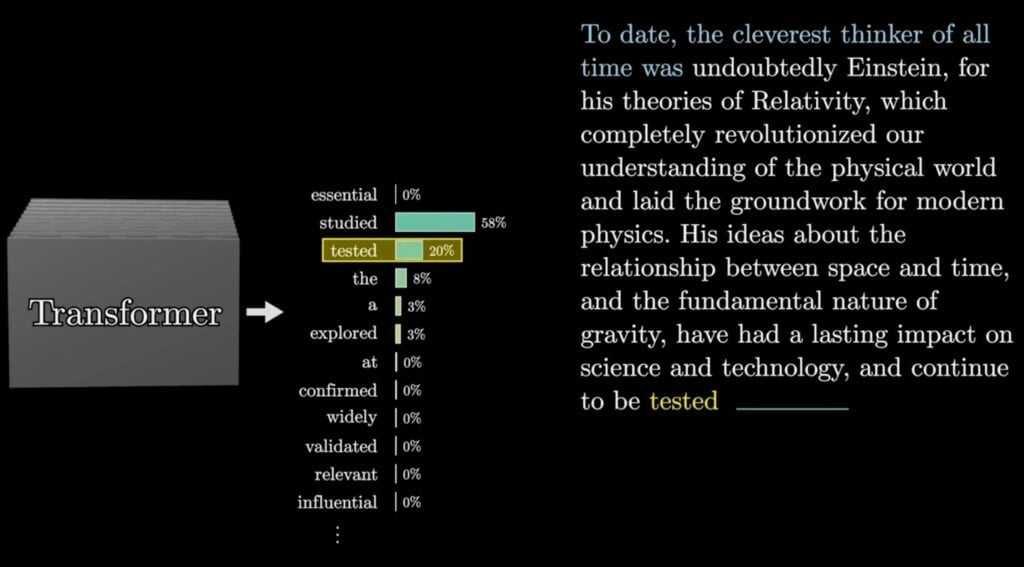

Claude AI fungerar ungefär som alla generativa AI-verktyg som har läst det mesta av internet och lärt sig att förutsäga ett svar på dina uppmaningar.

Det är en stor språkmodell (LLM) som tränats på massiva textdataset. Men det som skiljer Claude från andra chatbottar är hur den har tränats att själv kontrollera och bete sig säkert.

Tekniskt sett bygger Claude på en transformatorarkitektur (samma generella struktur som används i GPT- och Gemini-modellerna), vilket gör att den kan hantera långa kontexter.

Du kan Titta på den här videon om du vill förstå hur transformatorarkitekturen fungerar när det gäller att träna AI-modeller.

Modellserien Claude

Claude-serien inleddes med lanseringen av Claude 1 i mars 2023.

Det var Anthropics första publika modell, som omedelbart uppmärksammades för att vara ett mer transparent alternativ till andra chatbottar.

Claude 2, som lanserades i juli 2023, kom med förbättrad resonemangs-, skriv- och kontextuell förståelse.

Claude 3 släpptes i mars 2024 och innebar ett stort steg framåt i verktygets utveckling. Det introducerade en familj av flera andra modeller med olika styrkor, inklusive:

- Haiku, den snabbaste och lättaste versionen av Claude 3 för realtidsuppgifter och kundtjänstrobotar

- Sonettsom balanserar snabbhet med intelligens, är idealisk för affärs- och forskningsbruk.

- OpusAnthropics hittills mest kapabla modell används för djupa resonemang, kreativt skrivande och datatung problemlösning

De senaste Claude-modellerna (från och med oktober 2025) är Claude Sonnet 4.5, Claude Haiku 4.5 och Claude Opus 4.1.

| Funktion | Claude Sonett 4.5 | Claude Haiku 4.5 | Claude Opus 4.1 |

| Beskrivning | Avancerad modell byggd för kodning, automatisering och resonemangstunga uppgifter. | Lättviktig och extremt snabb modell som är idealisk för vardagliga frågor och produktivitet. | Premiummodell optimerad för djupa resonemang och komplexa analyser. |

| Hastighet | Snabb | Snabbast | Måttlig |

| Sammanhang Gräns | 200 000 tokens (upp till 1 miljon i betaversionen) | 200 000 tokens | 200 000 tokens |

| Maximal utmatning | 64K polletter | 64K polletter | 32K polletter |

| Utökat tankemönster | Tillgänglig | Tillgänglig | Tillgänglig |

| Prioriterad åtkomst | Ingår | Ingår | Ingår |

| Kunskap Tillförlitlighet | Fram till januari 2025 | Fram till februari 2025 | Fram till januari 2025 |

| Avgränsning för träningsdata | juli 2025 | juli 2025 | mars 2025 |

| Jämförande latenstid | Balanserad för de flesta arbetsflöden | Snabbast totalt | Långsammare, fokus på djup och precision |

| Idealiska användningsfall | Kodningsagenter, storskalig automatisering, djupgående skrivning | Snabba svar, allmän produktivitet, chattapplikationer | Forskning, tolkning av data och beslutsfattande som kräver nyanserade resonemang |

| API-prissättning | $3 / ingång M-token - $15 / utgång M-token | $1 / ingång M-token - $5 / utgång M-token | $15 / ingång M-token - $75 / utgång M-token |

Vad är konstitutionell AI?

De flesta chatbottar tränas genom en metod som kallas "inlärning genom förstärkning från mänsklig feedback."

Det innebär i princip att människor sätter sig ner och läser massor av AI-genererade svar och markerar de som låter bättre.

Fungerar det? Ja, det gör det.

Men är den effektiv? Inte så mycket.

Anthropic kom på idén att ge modellen en skriftlig konstitution, en uppsättning tydliga och transparenta regler för hur den ska bete sig. Konstitutionell AI.

Reglerna är hämtade från verkliga etiska ramverk som den allmänna förklaringen om de mänskliga rättigheterna och allmänna idéer om ärlighet och integritet.

Claude får kritisera sina egna svar för att kontrollera om de följer de konstitutionella reglerna. Denna process, som kallas självjustering, säkerställer att modellen förbättrar sitt omdöme utan ständig mänsklig korrigering.

Claude AI vs. ChatGPT vs. Gemini

Claude, ChatGPT och Gemini är alla stora språkmodeller som är gjorda för att förstå mänsklig input och svara på den.

Kärnkonceptet bakom dem alla är också detsamma, dvs. att förutsäga nästa mest sannolika ord i en mening med hjälp av massiva träningsdata.

Varje system var dock utformat på olika sätt.

Claude, som vi just diskuterade, använder konstitutionell AI att förfina sina svar baserat på en uppsättning förutbestämda regler.

Du kommer att se att den pausar för att förklara sitt resonemang eller beskriva sina begränsningar. Så den är mindre benägen att vara övermodig.

Dessutom har Claudes senaste serie, som inkluderar Haiku, Sonnet och Opus, ett massivt kontextfönster på upp till 200 000 tokens.

Det är så stort att det kan analysera hela böcker utan att förlora tråden. ChatGPT och Gemini kan inte komma nära det ännu.

ChatGPT är den hittills mest använda AI-modellen med en funktion för livewebbning. Dess modeller (GPT-3.5, GPT-4, GPT-4 Turbo och GPT-5 som är den nuvarande avancerade versionen) tränas med hjälp av förstärkningsinlärning från mänsklig feedback (RLHF).

Den lär sig i princip från tusentals exempel på vad människor gillar eller ogillar i svar. Naturligtvis kommer ChatGPT att producera svar som du kommer att komma överens om.

Ibland kan de vara felaktiga (t.ex. kan det ibland "hallucinerar" detaljer), men det är den bästa konversationspartnern.

I de aktuella versionerna av ChatGPT ingår även DALL-E 3 (för bilder), Code Interpreter/Advanced Data Analysis och anpassade GPT:er.

Gemini, som tidigare hette Bard, kombinerar Google-sökning och AI-modellering på ett och samma ställe. Dess främsta styrka är den verifierade informationen i realtid som hämtas från Google Search.

Eftersom det är en av Google LLC-produkterna är den också helt integrerad i Google Workspace (Docs, Sheets, Gmail, Slides).

När det gäller arkitektur introducerade Gemini 1.5 resonemang med lång kontext på upp till en miljon tokens i forskningsversionen. Gemini tenderar att låta lite mer faktabaserad än ChatGPT.

Här är några detaljerade riktmärken för att jämföra prestandan för Claude AI vs. ChatGPT vs. Gemini.

| Riktmärke/uppgift | Claude Sonett 4.5 | Claude Haiku 4.5 | Claude Sonett 4 | GPT-5 | Gemini 2.5 Pro |

| Agentisk kodning (SWE-bench verifierad) | 77.2 % | 73.3 % | 72.7 % | 72,8 % (GPT-5 hög) / 74,5 % (Codex) | 67.2% |

| Terminalkodning (Terminal-Bench) | 50.0 % | 41.0 % | 36.4 % | 43.8 % | 25.3% |

| Prestanda för verktygsanvändning (t2-bench) | Detaljhandel 86,2% Flygbolag 70% Telekom 98% | Detaljhandel 83,2% Flygbolag 63,6% Telekom 83% | Detaljhandel 83,8% Flygbolag 63% Telekom 49,6% | Detaljhandel 81,1% Flygbolag 62,6 % Telekom 96,7 % | - |

| Datoranvändning (OSWorld) | 61.4% | 50.7% | 42.2% | - | - |

| Matematiktävling (AIME 2025) | 100% (Python) / 87.0 % (utan verktyg) | 96,3% (Python) / 80,7% (utan verktyg) | 70.5% (utan verktyg) | 99.6% (Python) / 94.6% (utan verktyg) | 88% |

| Resonemang på högskolenivå (GPQA Diamond) | 83.4% | 73% | 76.1% | 85.7% | 86.4% |

| Flerspråkiga frågor och svar (MMLU) | 89.1% | 83% | 86.5% | 89.4% | - |

| Visuellt resonemang (MMMU-validering) | 77.8% | 73.2% | 74.4% | 84.2% | 82% |

Använd den AI-kontroll för att bedöma om Claudes svar innehåller AI-genererade mönster.

Klistra in utdata i verktyget och det analyserar omedelbart frasering, ton och struktur för att visa hur mänsklig eller maskinskriven texten låter.

Det är ett snabbt sätt att verifiera innehållets kvalitet innan du delar eller publicerar Claudes svar.

Vanliga missuppfattningar om Claude AI

De flesta av oss har inte vuxit upp med AI som en del av vår vardag, så det är bara naturligt att vissa av dess begrepp fortfarande känns abstrakta.

Här är några vanliga missuppfattningar om Claude AI, och sanningen bakom dem.

- Claude AI kan överträffa människans intellekt

Många människor på nätet gillar att säga att Claude, eller egentligen vilken stor AI-modell som helst, kan överträffa mänsklig intelligens. Konceptet låter riktigt kul som en sci-fi-filmsintrig, men det är inte sant.

Alla AI-modeller producerar sina svar baserat på matematik. För varje inmatning tittar de på mönster i de data som de tränats på för att förutsäga vilken text som ska komma härnäst. Ingen självmedvetenhet, förståelse eller faktiskt resonemang i mänsklig mening är inblandad i processen.

Men människor förlitar sig hela tiden på instinktivt beslutsfattande, som psykologer kallar heuristik. Dessa instinkter bygger på levda erfarenheter.

Claude kan definitivt överträffa människor, men det är inte samma sak som att vara smartare.

- Claude kan lära sig på egen hand

Tanken att Claude kan "lära sig på egen hand" låter nästan trovärdig eftersom den är byggd på konstitutionell AI.

Men att utvärdera sina svar på etiska grunder innebär inte att man lär sig något på riktigt.

Claude lär inte sig själv ny information eller uppgraderar sina förmågor över tid. Varje förbättring som du någonsin har sett i en ny Claude-version, Claude 1, 2, 3, 4 Opus, Sonnet, berodde på mänskliga ingenjörers ansträngningar.

Konstitutionell AI är helt enkelt en kontrollerad träningsmekanism som ingenjörer skapat för att få Claude att tillämpa konsekventa etiska resonemang. När träningen är klar är modellen statisk. Den kan inte förvärva ny kunskap på egen hand.

- Claude är mer etisk så den kommer inte att ljuga eller hallucinera

Många människor antar också att eftersom Claude har ett rykte om sig att vara "etiskt", kommer det inte att hitta på saker.

Saken är den att Claude fortfarande är en AI-modell. Och Anthropic hävdade aldrig att den var ofelbar. Faktum är att de har varit uppfriskande transparenta om det.

Företaget har öppet sagt att Claude fortfarande kan "hallucinera", helt enkelt på grund av vad det förutspår ska komma härnäst, enligt statistik.

Claude Docs ger användarna ett praktiskt tips om att uttryckligen tala om för systemet att det är okej att säga "jag vet inte". Instruktionen har visat sig minska risken för hallucinationer.

Kom igång med vår AI Detector och Humanizer i widgeten nedan!

Slutsats

Claude AI är definitivt ett riktmärke för hur AI bör utvecklas på ett ansvarsfullt sätt. Verktyget återspeglar Anthropics engagemang för att bygga AI som respekterar och överensstämmer med mänskliga värderingar.

Med detta sagt kommer den grundläggande, kostnadsfria versionen av Claude med användningsgränser som återställs var femte timme, vilket är lite av ett problem om du behöver kontinuerlig åtkomst.

Om du letar efter en liknande pålitlig, säkerhetsmedveten AI-plattform som också är gratis att använda, kolla in Undetectable AI.

Förutom en enkel chatbot har Undetectable AI också riktigt coola specialverktyg som AI Humanizer, AI Paraphraser, Grammar Checker, AI SEO Writer, etc. Alla produkter följer samma höga bar för integritet som Claude!

Ge Odetekterbar AI ett försök idag!