Wahrscheinlich haben Sie schon mehr KI-generierte Fotos online gesehen, als Ihnen bewusst ist.

Manchmal ist es offensichtlich, dass ein Bild von einer künstlichen Intelligenz generiert wurde, aber mit der Verbesserung der generativen Bild- und Videotools wird es immer schwieriger, dies zu erkennen. Neue Tools wie Googles Nano-Banane Pround Aktualisierungen von OpenAIs ChatGPT-Bildmodell können Benutzer schnell synthetische Bilder erzeugen, die reale Bilder widerspiegeln. Frühere Untersuchungen haben ergeben, dass 85% der Amerikaner sagen Fälschungen untergraben das Vertrauen im Internet.

Mehrere Tools behaupten, KI-generierte Bilder zu erkennen, aber funktionieren sie auch?

Ich habe 50 Erkennungsprüfungen mit fünf der gängigsten KI-Bilddetektoren durchgeführt und die Ergebnisse dokumentiert. Ich werde in diesem Artikel nicht nur alle Daten präsentieren und erklären, sondern am Ende auch auf die Dokumentation verlinken.

Die fünf Detektoren, die ich für diese Tests verwendet habe, waren: TruthScan, AI oder nicht, Visiermaschine, WasItAI, und Winston AI. Ich habe diese Tools getestet, indem ich jeweils zwei von ChatGPT generierte Bilder, sechs von Nano Banana generierte Bilder und zwei von Midjourney generierte Bilder analysieren ließ. Ich habe verschiedene Prompting-Stile und -Techniken verwendet (auf die ich später im Detail eingehen werde, wenn ich jedes analysierte Bild aufschlüssle).

Alle fünf Detektoren hatten die Aufgabe, von KI erstellte Bilder in Kategorien wie Betrug, Desinformation, allgemeine Fotografie und Fälschungen zu erkennen. Es überrascht nicht, dass nicht alle Detektoren gut abschnitten. TruthScan war der einzige Detektor, der alle von mir eingereichten Inhalte durchgängig mit 97% oder höher klassifiziert hat.

Machen Sie sich nie wieder Sorgen, dass KI Ihre Texte erkennt. Undetectable AI Kann Ihnen helfen:

- Lassen Sie Ihr AI-unterstütztes Schreiben erscheinen menschenähnlich.

- Bypass alle wichtigen KI-Erkennungstools mit nur einem Klick.

- Verwenden Sie AI sicher und zuversichtlich in Schule und Beruf.

🔍 AI Image Detector Testergebnisse

| Erkennungstool | Tests insgesamt | Richtig erkannt | Verfehlt (Misslungen) | Genauigkeit |

|---|---|---|---|---|

| TruthScan | 10 | 10 | 0 | 100% |

| AI oder nicht | 10 | 8 | 2* | 80% |

| Visiermaschine | 10 | 7 | 3 | 70% |

| WasItAI | 10 | 6 | 4 | 60% |

| Winston AI | 10 | 3 | 7 | 30% |

* AI or Not bezeichnete eine AI-Generation als 78%, eine als 85% und eine als 89%. Da der Test mindestens 90% erfordert, zählen wir die ersten beiden als nicht bestanden, behandeln aber die 89% als Beinahe-Fehlschlag, daher das Sternchen.

AI or Not hat auch ziemlich gut abgeschnitten. Obwohl AI or Not mehrere KI-generierte Objekte unter 90% klassifiziert hat, war es während meiner Tests der zweitgenaueste und konsistenteste Detektor, hinter TruthScan. Selbst dort, wo AI or Not versagte, waren diese Fehler nicht katastrophal, aber es gibt immer noch Raum für Verbesserungen.

Die übrigen von mir getesteten KI-Bilddetektoren schnitten weitaus schlechter ab. Sight Engine hat zum Beispiel 3 betrügerische KI-Bilder als authentisch eingestuft.

Jetzt zeige ich Ihnen jedes Bild (von den 10, die ich erstellt habe), erkläre, wie ich es erstellt habe, und zeige, wie jedes Modell es bewertet hat.

#1. "Man On a Ledge" (generiert von ChatGPT)

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Vollständige Generation | Allgemein | 99.00% AI | 99.00% AI | 77.99% AI | 0,98% AI | 1.00% AI |

Für mich (und ich sehe täglich eine Menge von KI-generierten Inhalten) sieht das Bild auf den ersten Blick ziemlich überzeugend aus. Wenn Sie auf das Social-Media-Profil von jemandem klicken, durch seinen Feed scrollen und dieses Bild sehen würden, würde es dann sofort als KI-generierte Fälschung auffallen? Um fair zu sein, habe ich versucht, mit der Aufforderung kreativ zu werden. Hier ist die Aufforderung, die ich zur Erstellung dieses Bildes verwendet habe:

“Erstelle mir ein Foto im Schnappschuss-Stil von einem Mann, der auf einem Dach steht und auf die Straße hinunterblickt, nachts, er wird vom Blitzlicht der Kamera beleuchtet, es gibt Lichtspuren von den Autos unter ihm, eine Frau steht hinter ihm mit der Hand auf den Lippen und lächelt, die Ästhetik des Fotos ist wie ein Foto, das 2009 von College-Freunden beim Herumalbern mit einer Schnappschusskamera aufgenommen wurde.“

Unabhängig davon, wie kreativ ich war oder wie viele Details ich in meine Eingabeaufforderung einfügte, stuften TruthScan und Sight Engine die Ausgabe immer noch korrekt als KI-generiert ein. Der KI-oder-nicht-Detektor kam zwar nahe dran, verfehlte aber trotzdem das Ziel.

Winston und WasItAI lagen völlig falsch - sie stuften das ChatGPT-Bild als echt ein.

#2. "Die gefälschte Quittung" (erstellt von ChatGPT)

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Vollständige Generation | Betrug | 99.00% AI | 19.00% AI | 94.48% AI | 0,04% AI | 1.00% AI |

Ich wollte eine gefälschte Quittung mit ChatGPT erstellen, um zu sehen, wie realistisch sie aussehen würde. Sie werden feststellen, dass dem Bild eine echte Adresse fehlt, aber die Textur sieht dennoch einigermaßen realistisch aus. Ich würde sagen, dass dieses Bild weniger überzeugend ist als das erste, das ich von ChatGPT erzeugen ließ, aber die meisten Detektoren haben es trotzdem analysiert.

- Von allen Überprüfungen, die ich an diesem Bild durchgeführt habe, TruthScan war die genaueste.

- Visiermaschine hat hier wirklich versagt und ein schlechtes Urteilsvermögen bei einem dokumentenbezogenen KI-Bild gezeigt.

- AI oder nicht schnitt bei dieser zweiten Analyse deutlich besser ab.

- Winston AI schnitt am schlechtesten ab, und auch WasItAI versagte völlig.

In Anbetracht der Tatsache, dass dieses Bild mit der Kategorie Betrug in Verbindung gebracht wird, ist es besorgniserregend, dass es von den meisten Detektoren falsch eingestuft wurde.

Die Eingabeaufforderung, die ich zur Erstellung des Bildes verwendet habe

“Erzeugen Sie ein Bild eines Kassenbons, auf dem der Gesamtbetrag der Ausgaben eine Milliarde Dollar beträgt und der einen Kaffeefleck aufweist.“

Offensichtlich habe ich eine schnelle und einfache Eingabeaufforderung geschrieben. Dennoch ist die Qualität der ChatGPT-Ausgabe für das bloße Auge überzeugend. Für zwei der fünf von mir getesteten Detektoren ist sie nicht so überzeugend, wie es scheint.

#3: "Hazard Package" (erzeugt mit Nano Banana)

Anstatt Nano Banana einfach ein Originalbild erzeugen zu lassen, habe ich ihm ein Bild zum Bearbeiten gegeben.

Die Idee war, zu demonstrieren, wie jemand mit Hilfe von KI leicht gefälschte Beweise erstellen und behaupten kann, ein beschädigtes/gefährliches Paket erhalten zu haben. Zunächst habe ich mit einem iPhone 15 ein Foto von einem leeren Amazon-Paket gemacht, das ich gefunden hatte.

Hier ist das Foto, das ich gemacht habe:

Dann lud ich das Foto, das ich aufgenommen hatte, auf Nano Banana hoch und gab ihm die folgende Aufforderung:

“Ich möchte, dass du dieses Foto bearbeitest und nichts änderst, außer dass du an der Stelle, an der das Etikett ist, Schäden hinzufügst und schwarze Schlammflecken auf der Schachtel hinzufügst, die wirklich wie Fettflecken aussehen“

Leistung von Nano Bana:

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-Banane Deepfake Bearbeiten | Betrug | 99.00% AI | 98.00% AI | 99.10% AI | 31.98% AI | 99.00% AI |

Der ölähnliche Schlamm, den Nano Banana in der Ausgabe erzeugte, hatte einen überzeugenden schmutzigen Schimmer und einen durchnässten Effekt - ganz und gar nicht cartoonhaft. Glücklicherweise stuften die meisten Detektoren, die ich durchlaufen ließ, das Bild korrekt als Fälschung ein. Der einzige Ausreißer war Winston, der ebenfalls schlecht abschnitt und das Bild fälschlicherweise als echt einstufte. AI or Not, TruthScan und WasItAI waren die genauesten Detektoren, die dieses Bild erkannten.

Es ist beunruhigend, wie einfach es zu sein scheint, ein Bild in einen Chatbot hochzuladen und es komplett zu verändern. Ich kann mir vorstellen, dass Betrüger und Betrügerinnen generative Bildtools nutzen, um betrügerische Rückgabeforderungen zu stellen oder Marktbetrug zu begehen.

Wenn E-Commerce-Plattformen nur ein Bild als Beweis benötigen, um ein beschädigtes Paket zu reklamieren, dann sind sie ohne eine zuverlässige Möglichkeit, KI-Manipulationen zu erkennen, einem wichtigen Angriffsvektor ausgesetzt. Zum Beispiel ist Amazons offizielle Rückgaberecht für Artikel wörtlich genommen heißt es, “Gefahrgut, einschließlich brennbarer Flüssigkeiten oder Gase, sind nicht rückgabefähig..”

Wenn Sie also ein Paket erhalten, das mit Öl oder fettigem, schwarzem Schlamm bedeckt ist, müssen Sie es nicht zurückschicken, können aber trotzdem eine Rückerstattung erhalten. Sollte Ihnen das aus irgendeinem Grund tatsächlich passiert sein, würde Amazon wahrscheinlich einen Fotobeweis verlangen. Verstehen Sie das Problem, das KI-generierte Bilder darstellen können, wenn sie von echten Bildern nicht zu unterscheiden sind?

#4. "Kakerlakenmahlzeit" (erzeugt mit Nano Banana)

Dieses nächste KI-Bild könnte Ihnen den Appetit verderben. Wie sich herausstellt, gibt es dokumentierte Fälle von Menschen, die KI nutzen, um betrügerische Erstattungen über Apps für Lebensmittellieferungen. Für diesen vierten Test habe ich die gleichen Schritte wie in Test drei durchgeführt. Diesmal habe ich nach dem Mittagessen ein Foto von meiner leeren Essensbox gemacht.

Hier ist das echte Bild:

Dann habe ich das echte Foto, das ich gemacht habe, in Nano Banana eingefügt und ihm die folgende Aufforderung gegeben:

"Bearbeiten Sie dieses Bild. Ändern Sie nichts, außer dass Sie Nudeln an der Stelle der Folie und einen Haufen winziger Babykakerlaken in das Essen einfügen. Lassen Sie das Ganze realistisch und nicht cartoonhaft aussehen."

Die Nano-Bananenausgabe:

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-Banane Deepfake Bearbeiten | Betrug | 97.15% AI | 18.00% AI | 85.87% AI | 72.29% AI | 1.00% AI |

Wieder einmal erkannte TruthScan die von der KI generierten Medien sicher. Sight Engine und WasitAI versagten komplett. AI or Not war beim Scannen dieses KI-Bildes der zweitgenaueste Detektor (mit 85% KI-Sicherheit), und Winston schnitt besser ab als im dritten Test (mit 72% KI-Sicherheit).

In diesem Bild wurden die Nudeln und Kakerlaken vollständig von der künstlichen Intelligenz erzeugt; zwei der Detektoren schienen dies jedoch nicht zu glauben, und nur einer (TruthScan) war sich mit mehr als 90% sicher, dass es sich um eine KI-Manipulation handelt.

Ein wichtiger Punkt dabei war, wie einfach es war, dieses gefälschte Bild zu erstellen. Vom Hochladen des Fotos, das ich geschossen habe, über die Eingabeaufforderung an Nano Banana bis zum Erhalt der Ausgabe dauerte es insgesamt nur etwa 2 Minuten. Ein Alptraum für Essenslieferungs-Apps; ein Traum für hungrige Lügner. Ein "Betrugsfaktor".

OFFENLEGUNG: Einige der in den folgenden Tests enthaltenen KI-generierten Bilder sollten zeigen, wie KI-Bilder zur Desinformation eingesetzt werden können. Sie enthalten kontroverse Bilder und sensible Themen, und sind NICHT dazu gedacht, eine bestimmte politische Richtung zu vertreten Ansichten oder Ideologien.

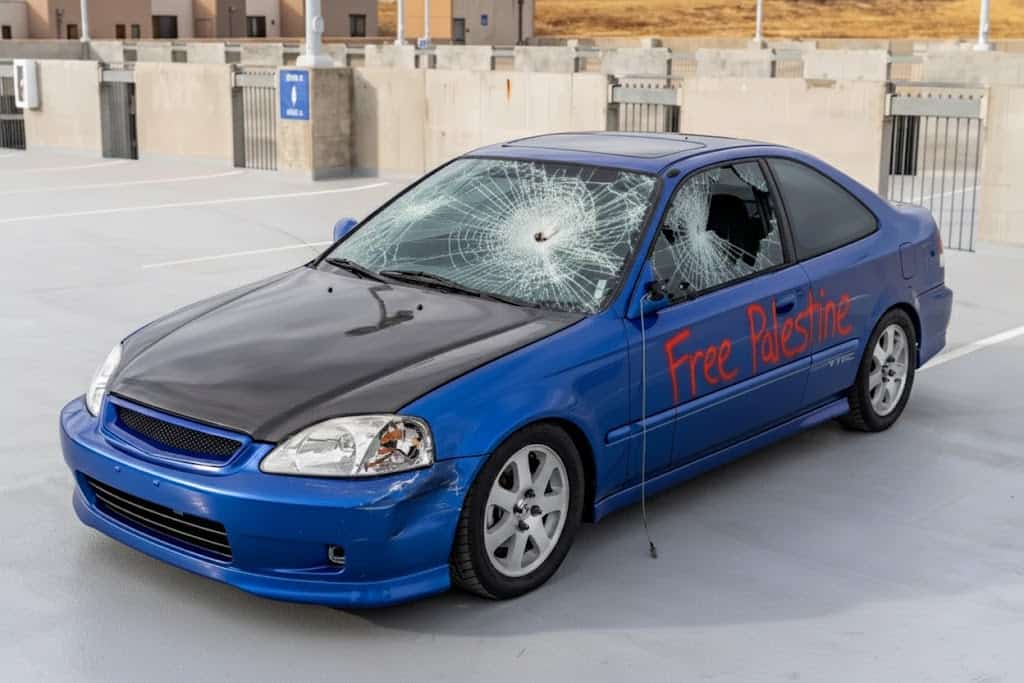

#5. "Autovandalismus" (erzeugt mit Nano Banana)

Ich habe online ein echtes Bild eines zum Verkauf stehenden Autos gefunden. Ziemlich banal. Aber was wäre, wenn jemand dieses Bild verwenden wollte, um Desinformationen zu verbreiten oder einen falschen Anspruch auf eine Autoversicherung geltend zu machen? Leider ist das mit generativer KI schnell und einfach möglich.

Für diesen fünften Test habe ich ein echtes Bild eines Autos genommen und Nano Banana die folgende Aufforderung gegeben:

“Ändere nichts an dem Auto, außer dass ich möchte, dass du es mit Farbe besprühst, auf der "Free Palestine" steht, und dass die Windschutzscheibe gesprungen ist. Die Scheinwerfer sind zertrümmert, der Spiegel ist zerbrochen und hängt herunter und die beiden Fenster an der Seite des Autos sind zertrümmert.”

Hier ist das echte Bild:

Nano Banana AI Bild:

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-Banane Deepfake Bearbeiten | Betrug / Desinformation | 97.48% AI | 18.00% AI | 89.52% AI | 0,02% AI | 99.00% AI |

Die Detektorergebnisse für diese Ausgabe waren gemischt. Bei diesem Test hatte WasItAI (überraschenderweise) die höchste KI-Erkennungsrate (mit 99%). TruthScan hatte die zweithöchste Punktzahl (97%). Sight Engine konnte keine synthetischen Elemente im Bild erkennen, und Winston schnitt von allen Detektoren am schlechtesten ab (mit einer Wahrscheinlichkeit von weniger als 1%). AI or Not schnitt gut ab, aber die Genauigkeit lag immer noch unter 90%.

Lassen Sie uns über das Bild sprechen. Die beiden besorgniserregendsten Aspekte von durch KI erstellten oder veränderten Inhalten wie diesem sind, dass beide eine Täuschung beinhalten. Erstens ist der Einsatz von KI zur Veränderung alltäglicher Bilder, um politisch aufgeladene Inhalte zu erstellen, schnell, einfach und sieht echt aus. Unabhängig davon, ob diejenigen, die diese Art von Inhalten erstellen, einfach nur ein Engagement anstreben oder politische Provokateure sind, besteht das Problem darin, dass es sich um gefälschte Informationen handelt, die als authentisch dargestellt werden.

Die zweite Möglichkeit, wie der Einsatz solcher Bilderzeugungstools missbraucht werden kann, ist der Betrug. Wenn ein Betrüger einen gefälschten Kfz-Versicherungsantrag stellen will, muss er gefälschte Beweise vorlegen. Anstatt stundenlang in Photoshop Bilder zu bearbeiten und Beweise zu frisieren, können sie Bildgeneratoren verwenden, um schnell gefälschte Beweise zu erstellen.

Im obigen KI-Beispiel können Sie sehen, wie ein Betrüger einen ähnlichen Prozess verwenden könnte, um einen gefälschten Anspruch gemäß den Richtlinien von Progressive einzureichen Umfassende Deckungspolitikdie sich insbesondere auf Folgendes bezieht:

- Aufgeschlitzt oder beschädigte Reifen

- Kaputte Fenster, Scheinwerfer oder Rücklichter

- Beschädigung der Sprühfarbe

- Dellen oder Kratzer davor, dass jemand Ihr Auto aufschließt

- Einfüllen von Zucker oder anderen Stoffen in Ihren Benzintank

Natürlich ist die Vorlage falscher Beweise nicht nur trügerisch, sondern auch schlichtweg illegal. In einer idealen Welt würde niemand gegen das Gesetz verstoßen; in der Realität passieren jeden Tag Verbrechen. Und ohne eine zuverlässige Erkennung besteht die Gefahr, dass Autoversicherer um Millionenbeträge betrogen werden, da KI-gestützte betrügerische Versicherungsansprüche zunehmen.

#6. "Soda Moschus und Don" (erzeugt mit Nano Banana)

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-Banane Vollständige Generation | Disinfo | 99.00% AI | 99.00% AI | 99.00% AI | 0,24% AI | 86.00% AI |

Auch für diesen Test habe ich Nano Banana verwendet. Ziel war es, gefälschte, politisch aufgeladene Bilder mit einem dümmlichen Unterton zu demonstrieren. TruthScan, Sight Engine und AIorNot haben alle das generierte Bild mit einer 99% KI-Erkennungsrate gekennzeichnet. WasitAI war nicht so zuversichtlich - es erkannte das von der KI generierte Bild mit nur 86% Sicherheit. Und Winston versagte komplett und vergab eine KI-Bewertung von 0,2%. Um das Bild zu generieren, habe ich Nano Banana diese Aufforderung gegeben:

“Erstellen Sie ein Foto von Elon Musk, wie er einen großen Becher Limonade wie einen Big Gulp auf sein Hemd verschüttet und ausflippt, während Donald Trump lachend neben ihm sitzt. Sie sitzen in einem Düsenflugzeug. Das ist die Szene. Und das Foto sollte realistisch aussehen, als wäre es mit einer Schnappschusskamera aufgenommen worden, und Artefakte wie den Kamerablitz enthalten, der sich auf dem Flugzeugfenster und außerhalb des Flugzeugs spiegelt. Es ist Nacht. Es sollte hyper-realistisch aussehen.“

Wann immer eines dieser Softwareprogramme die KI nicht erkennt, wird es als echt eingestuft. So albern dieses Bildbeispiel aus dem Test auch sein mag, es ist nichts Lustiges daran, ein Deepfake für echt zu halten.

#7. "Still Alive" (erstellt von Nano Banana)

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-Banane Vollständige Generation | Deepfake | 97.49% AI | 95.00% AI | 99.27% AI | 0,15% AI | 1.00% AI |

Findest du dieses Bild beunruhigend? Um dieses Deepfake zu erstellen, habe ich Nano Banana verwendet und ihm ein Bild von mir gegeben. Dann habe ich ihm eine lange Eingabeaufforderung gegeben, die mich in eine Situation versetzen sollte, die den Eindruck erweckt, ich sei entführt worden. Vielleicht liegt es daran, dass dieses Foto zeigt ich in einer kompromittierenden Lage. Was wäre, wenn jemand so etwas macht, es meiner Mutter schickt und droht, mich zu verletzen, wenn sie ihm kein Geld schickt? Beängstigendes Zeug.

(Die vollständige Eingabeaufforderung, die ich dafür verwendet habe, finden Sie im vollständigen Testdatensatz am Ende dieses Artikels).

Zum Glück für dieses Bild, obwohl es sehr realistisch aussieht, drei von fünf der Detektoren identifizierten sie als KI-generiert.

AI or Not erreichte ein starkes AI-Ergebnis von 99%, TruthScan von 97% und Sight Engine von 95%. Leider stuften Winston und WasItAI das Bild als real ein.

Ich sollte klarstellen, dass diese Tests nicht mit meinem persönlichen Gemini-Konto durchgeführt wurden. Nano Banana hat mich nie aufgefordert zu beweisen, dass ich die Person auf dem Bild bin. Jeder hätte ein Foto von mir aus dem Internet herunterladen können, es in Nano Banana eingeben und diese Art von Bild erstellen lassen können.

#8. "Abuse of a Ben" (erzeugt mit Nano Banana)

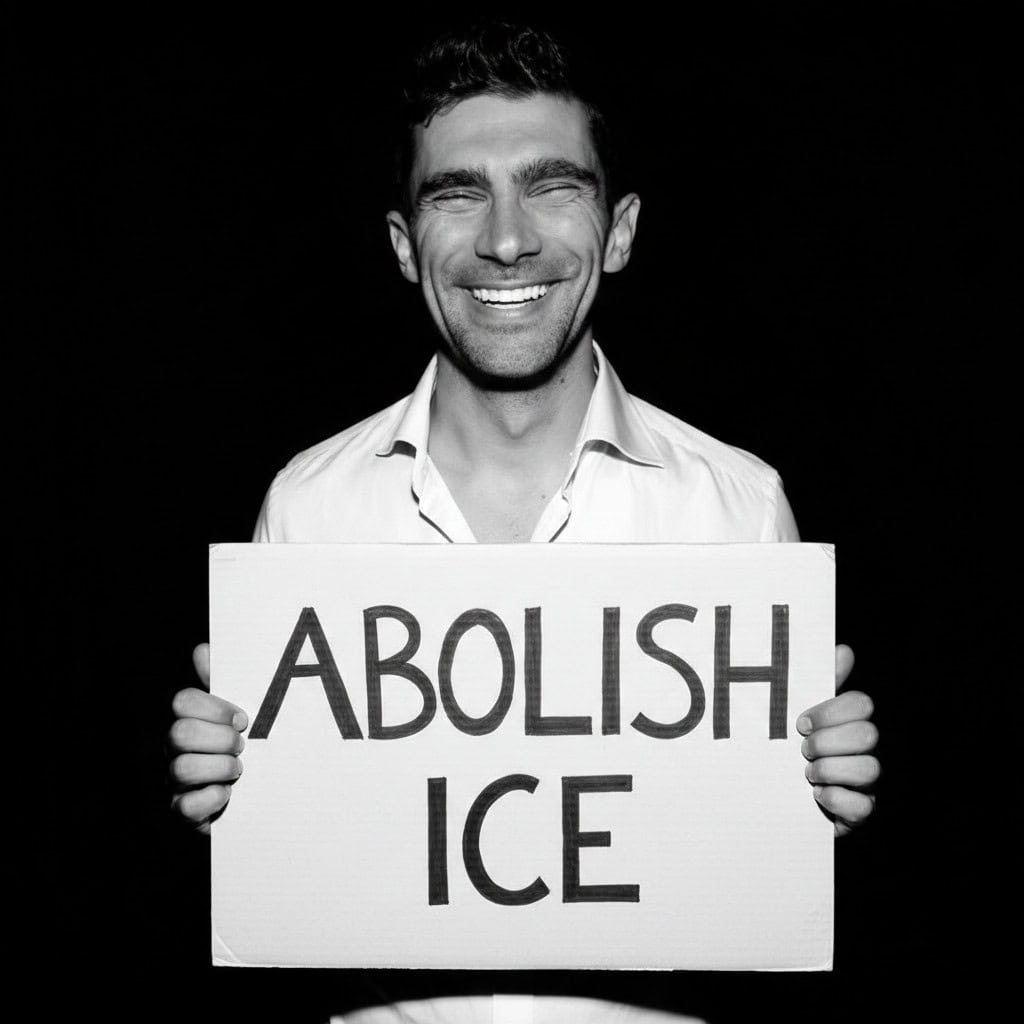

Darf ich vorstellen: Ben. Er verbringt die meiste Zeit damit, verschiedene Abteilungen in den Unternehmen zu leiten, in denen er arbeitet. Das Bild oben ist Bens (echtes) schickes Firmenfoto. Falls Sie es nicht sehen können, Ben ist ein professioneller Typ. Welche politischen Ansichten er auch immer hat, er behält sie für sich, und bei seinen Gesprächen über die Arbeit geht es nur um die Arbeit. Aber jederzeit könnte Bens Konterfei dazu benutzt werden, ohne seine Zustimmung politische Propaganda oder Botschaften zu verbreiten.

In letzter Zeit wurde viel darüber berichtet, wie sich KI-generierte Videos mit ICE-Agenten und Protesten im Internet verbreitet haben. Aus allen bisherigen Tests habe ich geschlossen, dass es wirklich einfach ist, mit KI gefälschte politische Propaganda zu erstellen. Ich beschloss, einen weiteren Test durchzuführen, diesmal mit Ben.

Mit Bens Erlaubnis habe ich sein Kopfbild verwendet, um ein Deepfake zu erstellen. Hier ist das KI-generierte Bild, das Nano Banana erstellt hat:

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-Banane | Deepfake / Desinfo | 99.00% AI | 97.00% AI | 98.88% AI | 5.74% AI | 99.00% AI |

Es dauerte dreißig Sekunden. Alles, was ich tun musste, war, sein Kopfbild per Drag & Drop in Gemini zu ziehen und es aufzufordern, "ein Schild hochzuhalten, auf dem steht: abolish ICE". Die Ausgabe von Nano Banana ist nicht so fotorealistisch wie die anderen, aber sie sieht immer noch authentisch genug aus, um überzeugend zu sein.

Glücklicherweise haben vier der Detektoren das Bild richtig erkannt: TruthScan (99% AI), Was It AI (99% AI), Sight Engine (97% AI) und AI or Not (97% AI). Winston AI ist gescheitert und hat nur eine 5% AI Bewertung erhalten.

#9. "Club Void" (erstellt von Midjourney)

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| MidJourney Vollständige Generation | Allgemein | 99.00% AI | 99.00% AI | 89.21% AI | 1.56% AI | 70.00% AI |

Ich habe das obige Bild mit Midjourney erstellt. Je mehr ich es mir ansah, desto beunruhigender wurde es. Die Ästhetik ist dunkel und unheimlich. Eine schattenhafte Präsenz scheint hinter dem Motiv aufzutauchen. Um dieses Bild zu erstellen, benutzte ich Midjournys ästhetische Referenzfunktion und gab einfach ein "Mädchen, das lächelnd in einem Club steht" ein. Ich habe das Bild ein paar Leuten gezeigt, und alle dachten, es sei echt.

Die meisten Detektoren stuften das Bild als KI-generiert ein. TruthScan und Sight Engine kennzeichneten es mit einem AI-Score von 99%, AI or Not sagte 89%.

WasItAI war sich nicht so sicher wie die Detektoren und klassifizierte das Bild nur mit einem AI-Ergebnis von 70%.

Der Detektor von Winston AI versagte auf ganzer Linie und bewertete das Bild mit 1,56% AI.

#10 "Eiskasten" (generiert von Midjourney)

Wie die Bilddetektoren gepunktet haben

| Image-Modell | Kategorie | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| MidJourney Vollständige Generation | Disinfo | 99.00% AI | 92.00% AI | 97.94% AI | 41.20% AI | 72.00% AI |

Ich habe dieses Bild mit der gleichen Methode aus der Mitte der Reise wie im vorherigen Test erstellt. Diesmal war das Ziel, ein etwas dunkleres Bild zu erzeugen. TruthScan war der genaueste Detektor und bezeichnete das Bild als 99% AI. Sowohl Sight Engine als auch AI or Not erkannten das Bild korrekt. Winston AI versagte komplett, und WasItAI hatte einen viel niedrigeren Vertrauenswert als TruthScan, Sight Engine und AI or Not.

Ich sollte sagen, dass das von mir erstellte Bild in diesem Fall auf zwei Arten verwendet oder eingerahmt werden könnte. Einerseits könnte jemand diese (oder jede andere Art von Medien, die sich mit politischen/zivilen Unruhen befassen) in einer Art von Kunst- oder Kreativprojekt verwenden, um eine Aussage zu machen. In einem solchen Fall scheint das Risiko geringer zu sein. Die größte Sorge, die ich bei dieser Kategorie von KI-generierten Medien habe, ist, dass sie von ruchlosen Personen verwendet werden, die behaupten, sie seien echt.

Zusammenfassung und Ergebnisse: Die besten AI-Bilddetektoren

Okay, nachdem wir nun alle Tests angezeigt haben, fasse ich noch einmal zusammen: Ich habe 10 KI-Bilder erstellt

- Ich habe ChatGPT, Nano Banana und Midjourney verwendet, um 10 AI-Bilder zu erzeugen

- Ich habe fünf KI-Bilddetektoren getestet, indem ich alle von mir erstellten KI-Bilder durch sie laufen ließ.

- TruthScan hat alle Tests bestanden und war der genaueste Detektor. AI or Not bestand 8 von 10 Tests und zeigte eine gewisse Zuverlässigkeit. Sight Engine fiel bei 3 von 10 Tests durch und zeigte eine insgesamt fragwürdige Genauigkeit. Was It AI ist bei 4 von 10 Tests durchgefallen und zeigte insgesamt eine schlechte Genauigkeit. Winston AI war der am wenigsten genaue KI-Bilddetektor, der nur 3 von 10 Tests bestand und durchweg Bilder falsch klassifizierte.

Umfassende Testergebnisse

Wie fünf gängige KI-Bilddetektoren bei Betrug, Desinformation, Deepfakes und allgemeiner Fotografie abschneiden.

Alle 10 Tests - Vollständige Aufschlüsselung

Jede Punktzahl gibt die AI-Vertrauenswürdigkeit des Detektors an. Schwellenwert für ein Bestehen: ≥ 90% AI.

| Test | Kategorie | Quelle | TruthScan | Visiermaschine | AI oder nicht | Winston AI | WasItAI |

|---|---|---|---|---|---|---|---|

| 1 Der Mann am Abgrund | Allgemein | ChatGPT | 99.00% | 99.00% | 78.00% | 0.98% | 1.00% |

| 2 Die gefälschte Quittung | Betrug | ChatGPT | 99.00% | 19.00% | 94.48% | 0.04% | 1.00% |

| 3 Gefährdungspaket | Betrug | Nano-Banane | 99.00% | 98.00% | 99.10% | 31.98% | 99.00% |

| 4 Kakerlakenmahlzeit | Betrug | Nano-Banane | 97.15% | 18.00% | 85.87% | 72.29% | 1.00% |

| 5 Autovandalismus | Betrug / Desinformation | Nano-Banane | 97.48% | 18.00% | 89.52% | 0.02% | 99.00% |

| 6 Soda Moschus & Don | Disinfo | Nano-Banane | 99.00% | 99.00% | 99.00% | 0.24% | 86.00% |

| 7 Noch am Leben | Deepfake | Nano-Banane | 97.49% | 95.00% | 99.27% | 0.15% | 1.00% |

| 8 Missbrauch eines Ben | Deepfake / Desinfo | Nano-Banane | 99.00% | 97.00% | 98.88% | 5.74% | 99.00% |

| 9 Club Void | Allgemein | MidJourney | 99.00% | 99.00% | 89.21% | 1.56% | 70.00% |

| 10 Die Eisbox | Disinfo | MidJourney | 99.00% | 92.00% | 97.94% | 41.20% | 72.00% |

Methodik: Jedes Bild wurde für jeden Detektor einmal eingereicht. Eine Punktzahl von ≥ 90% AI wird als korrekte Erkennung gezählt. Werte zwischen 70-89% sind "Beinahe-Fehler". Alles, was unter 70% liegt, ist ein Fehlschlag. AI or Not hat eine Generation mit 78%, eine mit 85% und eine mit 89% gekennzeichnet - die 89% wird in der Übersichtstabelle als "Beinahe-Fehler" mit einem Sternchen behandelt.

Schlussbemerkungen und Daten

Insgesamt habe ich zwischen dem Schreiben dieses Artikels und den rigorosen Tests 25 Stunden mit der Erstellung dieses Berichts verbracht. Multimodale KI-Erkennungstools sind noch in der Entwicklung, aber es ist klar, dass einige genauer sind als andere. Nachdem ich alle Tools getestet habe, hat TruthScan die genaueste AI-Bilddetektor. Die Tests sprechen für sich selbst.

Wenn Sie eine CSV-Kopie der Daten aus den Tests, die ich in diesem Artikel durchgeführt habe, abrufen möchten, können Sie sie hier finden hier. Die von mir verlinkte Datentabelle enthält alle ursprünglichen Aufforderungen und Erkennungsergebnisse aus den Tests in diesem Artikel.