Alat AI generatif telah mengembangkan deepfake dari penelitian ilmiah menjadi perhatian utama masyarakat. Orang-orang menunjukkan ketakutan terhadap media sintetis sekaligus menunjukkan ketidakmampuan untuk mendeteksinya menurut hasil survei Juni 2025.

FBI menyatakan bahwa teknologi deepfake AI memungkinkan aktivitas kriminal melalui tiga metode utama, yaitu pesan spam yang dibuat oleh AI, persona media sosial yang dibuat oleh AI, dan situs web phishing yang dikodekan oleh AI.

Tujuan dari skema ini menargetkan organisasi bisnis dan konsumen individu untuk eksploitasi finansial. Kombinasi teknologi deepfake dengan AI menghasilkan lebih dari Kerugian sebesar $200 juta selama tahun 2025.

Mayoritas orang Amerika (85%) kehilangan kepercayaan mereka terhadap informasi online selama setahun terakhir karena deepfakes dan 81% takut akan bahaya pribadi dari konten audio dan video palsu. Lebih dari 90% pengguna gagal memanfaatkan alat deteksi. Data ini menunjukkan meningkatnya "kesenjangan kepercayaan" yang menuntut intervensi segera dari regulator dan operator platform serta ahli teknologi.

Temuan Utama

| Wawasan | Data Pendukung |

|---|---|

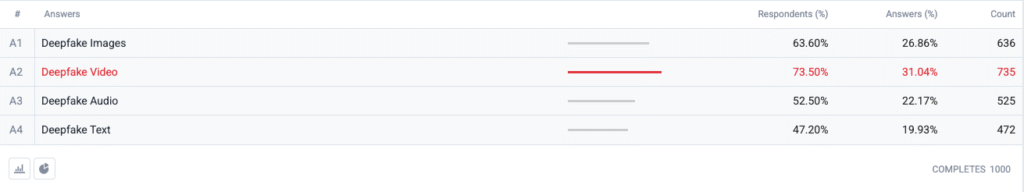

| Video Deepfake menduduki peringkat teratas dalam indeks ketakutan. | 73,5 persen responden memilih video deepfake sebagai format yang "paling mereka khawatirkan", diikuti oleh gambar (63,6 persen), audio (52,5 persen), dan teks (47,2 persen). |

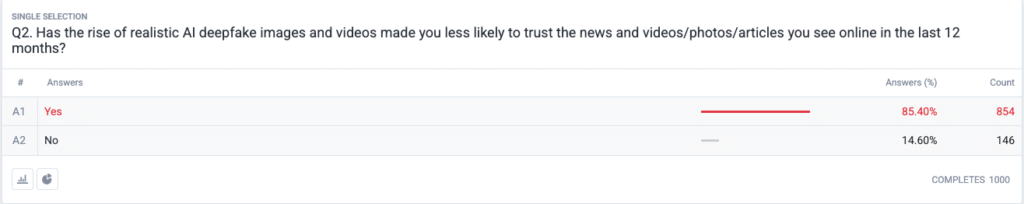

| Krisis kepercayaan sedang berlangsung. | 85,4 % melaporkan bahwa mereka cenderung tidak mempercayai berita, foto, atau video online dalam 12 bulan terakhir karena adanya pemalsuan yang realistis. |

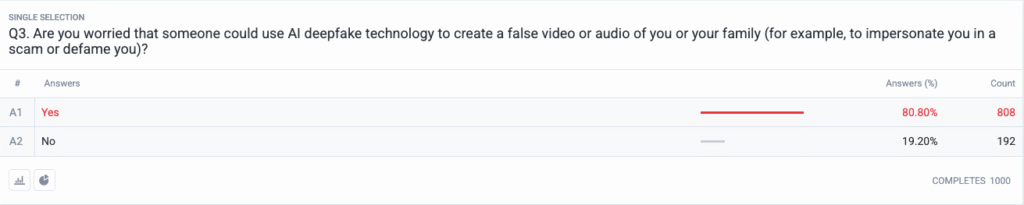

| Ancaman pribadi telah menjadi arus utama. | 80,8 % khawatir bahwa penipu atau pelaku kejahatan dapat menggunakan konten deepfake untuk melawan mereka atau keluarga mereka. |

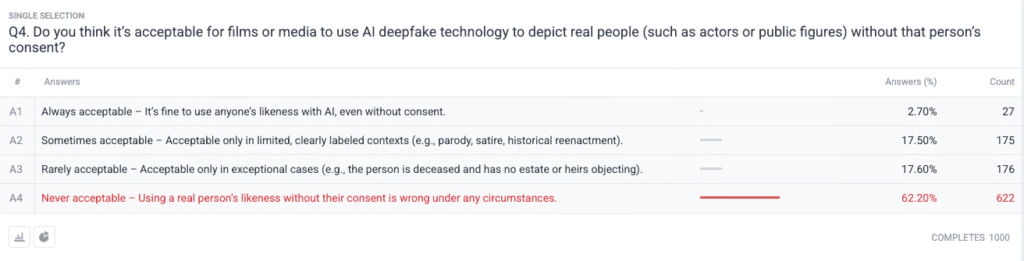

| Konsensus moral yang kuat tentang persetujuan. | 62.2 % mengatakan bahwa menggunakan kemiripan dengan orang sungguhan tanpa izin adalah tidak pernah dapat diterima; hanya 2,7 % yang mengatakan bahwa ini selalu dapat diterima. |

Metodologi

- Sampel & Kerja Lapangan. Kami merekrut 1.000 orang dewasa di Amerika Serikat menggunakan kuota usia, jenis kelamin, dan wilayah yang selaras dengan tolok ukur Sensus AS. Kerja lapangan diselesaikan pada 18 Juni 2025.

- Desain Pertanyaan. Lima pertanyaan tertutup mengukur kekhawatiran tentang format deepfake yang berbeda, perubahan terkini dalam kepercayaan, risiko pribadi yang dirasakan, pandangan etis tentang persetujuan, dan penggunaan perangkat lunak pendeteksi sebelumnya.

- Margin Kesalahan. ±3,1 poin persentase pada tingkat kepercayaan 95 %.

- Pembobotan. Pembobotan pasca stratifikasi mengoreksi penyimpangan kecil dari demografi nasional.

Pertanyaan

T1: Bentuk AI Deepfakes mana yang paling Anda khawatirkan? (Pilih semua yang berlaku)

T2: Apakah maraknya gambar dan video deepfake AI yang realistis membuat Anda kurang mempercayai berita dan video/foto/artikel yang Anda lihat secara online dalam 12 bulan terakhir?

T3: Apakah Anda khawatir bahwa seseorang dapat menggunakan teknologi AI deepfake untuk membuat video atau audio palsu tentang Anda atau keluarga Anda (misalnya, untuk meniru Anda dalam penipuan atau mencemarkan nama baik Anda)?

T4: Menurut Anda, apakah boleh film atau media menggunakan teknologi AI deepfake untuk menggambarkan orang sungguhan (seperti aktor atau figur publik) tanpa persetujuan orang tersebut?

Analisis Tren

- Kecemasan Video Melebihi Format Lainnya

Di masa lalu, video berdiri sebagai media tepercaya yang dipercaya oleh orang-orang ketika mereka melihatnya. Kekhawatiran akan video sintetis sekarang mendominasi pikiran orang Amerika sejak video kehilangan statusnya sebagai media terpercaya. Orang-orang lebih takut pada video daripada gambar dengan selisih 10 poin (73.5% vs 63.6%) karena gerakan video yang digabungkan dengan suara yang tersinkronisasi dan tampilan yang realistis meningkatkan kekhawatiran mereka. Organisasi media harus menerapkan prosedur otentikasi yang ketat untuk konten video sebelum merilisnya ke publik.

- Erosi Kepercayaan Informasi

Penurunan besar-besaran pada tingkat kepercayaan di kalangan masyarakat menunjukkan keraguan yang meluas terhadap semua jenis konten digital, terlepas dari kurangnya kredibilitasnya. Teori "ucapan murahan" menunjukkan betapa mudahnya fabrikasi membuat verifikasi kebenaran menjadi tanggung jawab konsumen. Tokoh masyarakat dan jurnalis bersama dengan pembuat kebijakan perlu mempersiapkan diri untuk meningkatkan pengawasan dengan berinvestasi pada metode verifikasi yang jelas (seperti tanda air kriptografi dan metadata yang ditandatangani).

Jangan Pernah Khawatir AI Mendeteksi Teks Anda Lagi. Undetectable AI Dapat Membantu Anda:

- Membuat tulisan dengan bantuan AI Anda muncul seperti manusia.

- Bypass semua alat pendeteksi AI utama hanya dengan satu klik.

- Gunakan AI dengan aman dan dengan percaya diri di sekolah dan tempat kerja.

- Deepfakes Menjadi Pribadi

Mayoritas responden (85%) membayangkan diri mereka sendiri atau anggota keluarga mereka menjadi korban serangan deepfake. Persepsi deepfake sebagai alat disinformasi politik yang berfokus pada pemilihan umum dan selebriti telah bergeser menjadi ancaman pribadi dalam beberapa siklus terakhir. Penyebaran aplikasi voice-cloning dan face-swap AI telah membuat pencurian identitas dan penipuan keuangan menjadi ancaman yang masuk akal bagi rumah tangga biasa, yang telah memicu tuntutan untuk meningkatkan mekanisme bantuan bagi korban dan undang-undang perlindungan identitas.

- Permintaan Persetujuan yang Hampir Universal

Pertanyaan etis dalam survei ini mengungkapkan bagaimana komunitas Hollywood masih terpecah mengenai aktor sintetis dan penampilan anumerta. Sikap publik yang kuat terhadap pelanggaran hak-hak individu muncul sebagai pilihan "tidak pernah dapat diterima" yang mendapat dukungan dari 62,2 persen partisipan. Pejabat publik harus menggunakan bukti ini untuk membuat undang-undang yang mewajibkan persetujuan eksplisit dari individu sebelum membuat representasi kemiripan yang dihasilkan oleh AI dan memastikan pengungkapan pelabelan yang tepat.

- Kesenjangan Kesiapan dan Peluang Pendidikan

Meskipun ada keprihatinan yang mendalam tentang masalah ini, 89,5 persen responden belum menggunakan alat deteksi. Pasar menunjukkan potensi laten karena tingkat minat melebihi kemampuan penggunaan saat ini yang mengindikasikan masalah kegunaan dan kesadaran serta keraguan tentang efektivitas. AI yang tidak terdeteksi bersama dengan pemain industri lainnya harus membuat proses orientasi yang sederhana sambil menambahkan alat deteksi ke platform konsumen dan mengembangkan program edukasi yang menjelaskan teknologi AI kepada publik.

Implikasi bagi Pemangku Kepentingan

| Pemangku kepentingan | Hasil yang Dapat Ditindaklanjuti |

|---|---|

| Platform Berita & Sosial | Menerapkan standar media yang diautentikasi (C2PA, asal W3C) dan lencana "asal terverifikasi" untuk membangun kembali kepercayaan audiens. |

| Studio Hiburan | Terapkan kontrak keikutsertaan secara eksplisit untuk kemiripan sintetis dan terapkan pengungkapan di layar saat rekreasi AI digunakan. |

| Regulator | Memajukan rancangan undang-undang hak publisitas dan pelabelan deepfake untuk menyelaraskan dengan ekspektasi persetujuan publik. |

| Bisnis & Merek | Secara proaktif memantau citra merek dari manipulasi dan mengedukasi karyawan untuk menemukan konten yang mencurigakan. |

| Konsumen | Carilah alat pendeteksi yang memiliki reputasi baik dan praktikkan "jeda, verifikasi, bagikan" kebersihan digital sebelum memperkuat media. |

Komentar

Kami mengumpulkan tanggapan tambahan dari peserta survei terkait penggunaan alat pendeteksi palsu dalam AI, yang mengungkapkan bahwa beberapa orang telah menggunakannya dan sebagian besar orang mengatakan bahwa mereka tidak menyadarinya, tetapi tertarik untuk mempelajarinya lebih lanjut. Data survei lengkap tersedia berdasarkan permintaan.

Laporan ini adalah ringkasan AI dari temuan lengkap kami, yang tersedia berdasarkan permintaan. Penelitian ini dilakukan atas kerja sama dengan TruthScansebuah solusi pendeteksi pemalsuan dan anti-penipuan.

Kesimpulan

Kekhawatiran deepfake pada tahun 2025 ditentukan oleh paradoks yang mencolok: melonjaknya alarm publik yang bersinggungan dengan tindakan perlindungan minimal. Dengan menurunnya kepercayaan, organisasi menghadapi mandat yang mendesak untuk memverifikasi, memberi label, dan mengautentikasi konten digital.

Penggunaan Wajar

Silakan gunakan informasi ini dalam artikel atau postingan blog, selama Anda memberikan tautan dan kutipan kepada kami. Untuk akses ke kumpulan data survei lengkap, jangan ragu untuk menghubungi kami secara langsung.

Untuk pertanyaan pers atau akses ke tabel silang lengkap, hubungi [email protected] atau [email protected]