Prawdopodobnie widziałeś w sieci więcej zdjęć wygenerowanych przez sztuczną inteligencję, niż ci się wydaje.

Czasami oczywiste jest, że obraz został wygenerowany przez sztuczną inteligencję, ale coraz trudniej jest to stwierdzić w miarę ulepszania narzędzi do generowania obrazów i wideo. Nowe narzędzia, takie jak Google Nano Banana Proi aktualizacje OpenAI Model obrazu ChatGPT pozwalają użytkownikom szybko generować syntetyczne obrazy, które odzwierciedlają rzeczywiste. Poprzednie badania wykazały, że 85% Amerykanów twierdzi, że Podróbki podkopują zaufanie w sieci.

Wiele narzędzi twierdzi, że wykrywa obrazy generowane przez sztuczną inteligencję, ale czy działają?

Przeprowadziłem 50 testów wykrywania w pięciu najpopularniejszych detektorach obrazów AI i udokumentowałem wyniki. Nie tylko przedstawię wszystkie dane w tym artykule i wyjaśnię je, ale także podam link do dokumentacji na końcu.

Do testów użyłem pięciu detektorów: TruthScan, Sztuczna inteligencja czy nie, Silnik celowniczy, WasItAIoraz Winston AI. Przetestowałem te narzędzia, każąc każdemu z nich przeanalizować dwa obrazy wygenerowane przez ChatGPT, sześć obrazów wygenerowanych przez Nano Banana i dwa obrazy wygenerowane przez Midjourney. Użyłem wielu stylów i technik podpowiedzi (które szczegółowo omówię później, gdy będę analizował każdy analizowany obraz).

Wszystkie pięć detektorów miało za zadanie wykryć obrazy stworzone przez sztuczną inteligencję w kategoriach takich jak oszustwo, dezinformacja, fotografia ogólna i deepfake. Nic dziwnego, że nie wszystkie detektory wypadły dobrze. TruthScan był jedynym wykrywaczem, który konsekwentnie klasyfikował wszystkie przesłane przeze mnie treści na poziomie 97% lub wyższym.

Nigdy więcej nie martw się, że sztuczna inteligencja wykryje twoje teksty. Undetectable AI Może ci pomóc:

- Spraw, by pisanie wspomagane przez sztuczną inteligencję wyglądało podobny do człowieka.

- Obejście wszystkie główne narzędzia do wykrywania AI za pomocą jednego kliknięcia.

- Użycie AI bezpiecznie i pewnie w szkole i pracy.

Wyniki testu detektora obrazu AI

| Narzędzie do wykrywania | Testy ogółem | Prawidłowo wykryty | Chybiony (Nieudany) | Dokładność |

|---|---|---|---|---|

| TruthScan | 10 | 10 | 0 | 100% |

| Sztuczna inteligencja czy nie | 10 | 8 | 2* | 80% |

| Silnik celowniczy | 10 | 7 | 3 | 70% |

| WasItAI | 10 | 6 | 4 | 60% |

| Winston AI | 10 | 3 | 7 | 30% |

* AI or Not oznaczyło jedną generację AI jako 78%, jedną jako 85% i jedną jako 89%. Ponieważ test wymaga co najmniej 90%, liczymy pierwsze dwa jako nieudane, ale traktujemy 89% jako prawie nieudany, stąd gwiazdka.

AI or Not również wypadł całkiem dobrze. W rzeczywistości, podczas gdy AI or Not sklasyfikował wiele elementów wygenerowanych przez AI poniżej pewności 90%, był to drugi najdokładniejszy i najbardziej spójny detektor podczas moich testów, za TruthScan. Nawet tam, gdzie AI or Not zawiodło, awarie te nie były katastrofalne, ale wciąż jest miejsce na poprawę.

Pozostałe testowane przeze mnie wykrywacze obrazów AI radziły sobie znacznie gorzej. Na przykład Sight Engine błędnie zaklasyfikował 3 obrazy AI związane z oszustwami jako autentyczne.

Teraz pokażę ci każdy obraz (z 10, które wygenerowałem), wyjaśnię, jak go stworzyłem i pokażę, jak każdy model go ocenił.

#1. "Man On a Ledge" (Wygenerowane przez ChatGPT)

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Pełna generacja | Ogólne | 99.00% AI | 99.00% AI | 77.99% AI | 0.98% AI | 1.00% AI |

Dla mnie (a codziennie widzę wiele treści generowanych przez sztuczną inteligencję) obraz wygląda całkiem przekonująco na pierwszy rzut oka. Gdybyś kliknął na czyjś profil w mediach społecznościowych, przewinął jego kanał i zobaczył ten obraz, czy od razu wyróżniałby się jako fałszywy wygenerowany przez sztuczną inteligencję? Aby być uczciwym, starałem się być kreatywny z podpowiedzią. Oto ten, którego użyłem do wygenerowania tego obrazu:

“Wygeneruj mi zdjęcie w stylu migawki aparatu fotograficznego przedstawiające mężczyznę stojącego na szczycie dachu i patrzącego w dół na ulicę, noc, jest oświetlony lampą błyskową aparatu, są ślady światła z samochodów poniżej, kobieta stoi za nim z ręką na ustach, uśmiechnięta, estetyka zdjęcia przypomina zdjęcie zrobione migawką aparatu w 2009 roku przez przyjaciół z college'u.“

Niezależnie od tego, jak bardzo byłem kreatywny lub ile szczegółów zawarłem w mojej podpowiedzi, TruthScan i Sight Engine nadal poprawnie klasyfikowały dane wyjściowe jako wygenerowane przez AI. Detektor AI or Not był blisko, ale wciąż nie trafiał.

Winston i WasItAI zdecydowanie się mylili, klasyfikując obraz ChatGPT jako prawdziwy.

#2. "Fałszywy paragon" (wygenerowany przez ChatGPT)

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Pełna generacja | Oszustwo | 99.00% AI | 19.00% AI | 94.48% AI | 0.04% AI | 1.00% AI |

Chciałem wygenerować fałszywy paragon za pomocą ChatGPT, aby zobaczyć, jak realistycznie będzie wyglądał. Można zauważyć, że na obrazie brakuje prawdziwego adresu, ale tekstura nadal wygląda nieco realistycznie. Powiedziałbym, że ten obraz jest mniej przekonujący niż pierwszy, który wygenerowałem za pomocą ChatGPT, ale większość detektorów nadal go analizowała.

- Ze wszystkich kontroli, które przeprowadziłem na tym obrazie, TruthScan był najdokładniejszy.

- Silnik celowniczy Tutaj naprawdę zawiodła, pokazując słabą ocenę obrazu AI związanego z dokumentami.

- Sztuczna inteligencja czy nie wypadła zauważalnie lepiej w tej drugiej analizie.

- Winston AI wypadł najgorzej, a WasItAI również całkowicie zawiódł.

Biorąc pod uwagę, że ten obraz jest powiązany z kategorią oszustwa, niepokojące jest to, że większość detektorów błędnie go sklasyfikowała.

Monit, którego użyłem do wygenerowania obrazu

“Wygeneruj obraz paragonu z Best Buy, który mówi, że łączna kwota wydanych pieniędzy wynosi miliard dolarów i jest na nim plama po kawie.“

Najwyraźniej napisałem szybki i prosty monit. Mimo to jakość danych wyjściowych ChatGPT jest atrakcyjna wizualnie gołym okiem. Wydaje się, że nie jest tak atrakcyjna dla dwóch z pięciu testowanych przeze mnie detektorów.

#3: "Pakiet zagrożeń" (wygenerowany przy użyciu Nano Banana)

Zamiast kazać Nano Banana wygenerować oryginalny obraz, dałem mu jeden do zmiany.

Pomysł polegał na zademonstrowaniu, jak ktoś może łatwo wykorzystać sztuczną inteligencję do stworzenia fałszywych dowodów i twierdzenia, że otrzymał uszkodzoną/niebezpieczną paczkę. Najpierw zrobiłem zdjęcie iPhone'em 15 pustej paczki Amazon, którą znalazłem.

Oto zdjęcie, które zrobiłem:

Następnie przesłałem zrobione przeze mnie zdjęcie do Nano Banana i wydałem następujące polecenie:

“Chcę, abyś edytował to zdjęcie, nie zmieniaj niczego oprócz miejsca, w którym znajduje się etykieta, dodaj do niej uszkodzenia i dodaj czarne plamy szlamu na pudełku, które wyglądają jak prawdziwe plamy smaru.“

Wydajność Nano Bana:

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Edycja Deepfake | Oszustwo | 99.00% AI | 98.00% AI | 99.10% AI | 31.98% AI | 99.00% AI |

Olejopodobny szlam generowany przez Nano Banana na wyjściu miał przekonujący brudny połysk, wraz z efektem przemoczenia - wcale nie kreskówkowy. Na szczęście większość wykrywaczy, przez które przeszedłem, poprawnie oznaczyła obraz jako fałszywy. Jedynym wyjątkiem był Winston, który ponownie wypadł słabo, błędnie klasyfikując obraz jako autentyczny. AI or Not, TruthScan i WasItAI były najdokładniejszymi detektorami, które wykryły ten obraz.

Niepokojące jest to, jak proste wydaje się przesłanie obrazu do chatbota i jego całkowita zmiana. Mogę sobie wyobrazić oszustów i scammerów korzystających z narzędzi do generowania obrazów, aby próbować składać fałszywe roszczenia o zwrot pieniędzy lub angażować się w oszustwa na rynku.

Jeśli platformy handlu elektronicznego wymagają jedynie obrazu jako dowodu do zainicjowania roszczenia o uszkodzoną paczkę, to bez żadnego niezawodnego sposobu wykrywania manipulacji AI są one narażone na poważny wektor ataku. Na przykład oficjalna strona Amazon polityka zwrotów przedmiotów dosłownie stwierdza, “Materiały niebezpieczne, w tym łatwopalne ciecze lub gazy, nie podlegają zwrotowi..”

Jeśli więc faktycznie otrzymałeś paczkę pokrytą olejem lub tłustym czarnym szlamem, nie musiałbyś jej zwracać, ale nadal mógłbyś otrzymać zwrot pieniędzy. Jeśli z jakiegoś powodu faktycznie by ci się to przydarzyło, Amazon prawdopodobnie poprosiłby o dowód w postaci zdjęcia. Czy widzisz problem, jaki mogą stanowić obrazy generowane przez sztuczną inteligencję, gdy są one nie do odróżnienia od prawdziwych?

#4. "Cockroach Meal" (wygenerowane przy użyciu Nano Banana)

Ten kolejny obraz AI może sprawić, że stracisz apetyt. Jak się okazuje, istnieją udokumentowane przypadki osób używających sztucznej inteligencji do otrzymywania nieuczciwe zwroty kosztów w aplikacjach z dostawą jedzenia. W czwartym teście wykonałem te same kroki, co w teście trzecim. Tym razem zrobiłem zdjęcie mojego pustego pudełka po obiedzie.

Oto prawdziwy obraz:

Następnie umieściłem prawdziwe zdjęcie w Nano Banana i wydałem następujące polecenie:

"Edytuj ten obraz. Nie zmieniaj niczego poza dodaniem makaronu w miejscu, gdzie znajduje się folia i dodaniem kilku małych karaluchów w jedzeniu. Niech wszystko wygląda realistycznie, a nie kreskówkowo".

Wyjście Nano Banana:

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Edycja Deepfake | Oszustwo | 97.15% AI | 18.00% AI | 85.87% AI | 72.29% AI | 1.00% AI |

Po raz kolejny TruthScan pewnie wykrył media wygenerowane przez AI. Sight Engine i WasitAI całkowicie zawiodły. AI or Not był drugim najdokładniejszym wykrywaczem (z pewnością 85% AI) podczas skanowania tego obrazu AI, a Winston wypadł lepiej niż w trzecim teście (z pewnością 72% AI).

Na tym obrazie makaron i karaluchy zostały w całości wygenerowane przez sztuczną inteligencję; jednak dwa detektory nie wydawały się tak myśleć, a tylko jeden (TruthScan) był powyżej 90% pewny manipulacji przez sztuczną inteligencję.

Niepokojące było to, jak proste było stworzenie tego fałszywego obrazu. Od przesłania zdjęcia, które zrobiłem, do podpowiedzi Nano Banana i otrzymania wyniku, w sumie zajęło to tylko około 2 minut. Koszmar dla aplikacji dostarczających jedzenie; marzenie dla głodnych kłamców. Czynnik oszustwa.

UJAWNIENIE: Niektóre z obrazów generowanych przez sztuczną inteligencję zawartych w poniższych testach miały na celu zademonstrowanie, w jaki sposób obrazy AI mogą być wykorzystywane do dezinformacji. Zawierają one kontrowersyjne obrazy i wrażliwe tematy, i NIE mają na celu reprezentowania jakichkolwiek konkretnych poglądy lub ideologie.

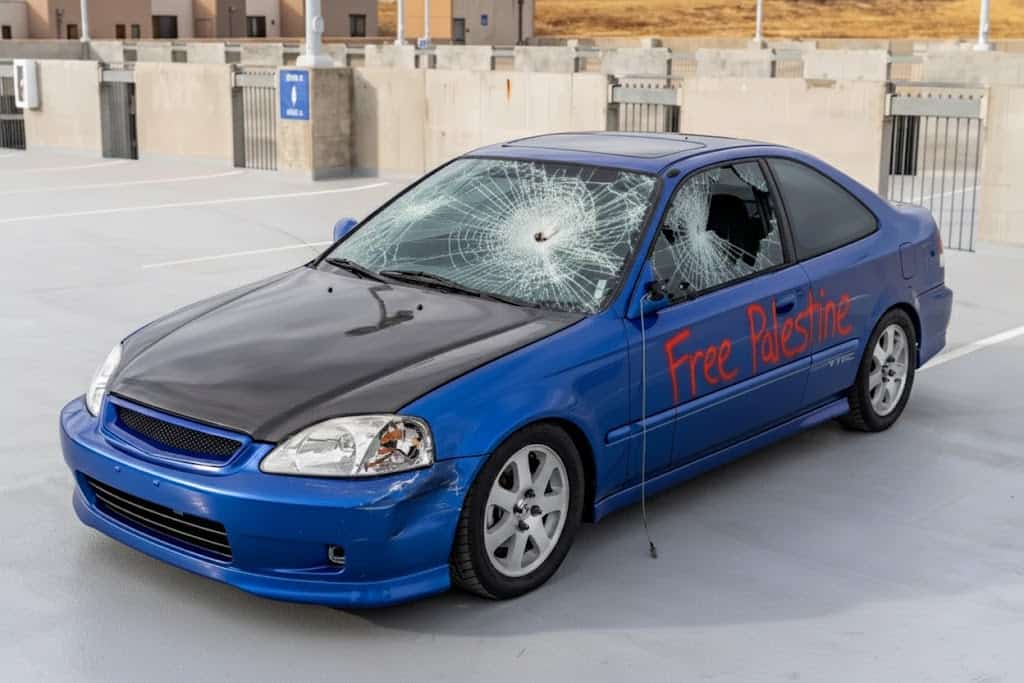

#5. "Autowandalizm" (wygenerowane przez Nano Banana)

Znalazłem prawdziwe zdjęcie samochodu na sprzedaż online. Całkiem przyziemne. Ale co by było, gdyby ktoś chciał wykorzystać ten obraz do rozpowszechniania dezinformacji lub złożenia fałszywego roszczenia ubezpieczeniowego? Niestety, generatywna sztuczna inteligencja sprawia, że jest to szybkie i łatwe.

W piątym teście wziąłem prawdziwy obraz samochodu i dałem Nano Banana następujące polecenie:

“Nie zmieniaj niczego w samochodzie, z wyjątkiem tego, że chcesz dodać do niego farbę w sprayu z napisem "Wolna Palestyna", a przednia szyba jest pęknięta. Reflektory są rozbite, lusterko jest złamane i zwisa w dół, a dwie szyby z boku samochodu są uszkodzone. rozbity.”

Oto prawdziwy obraz:

Obraz Nano Banana AI:

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Edycja Deepfake | Oszustwo / Dezinformacja | 97.48% AI | 18.00% AI | 89.52% AI | 0.02% AI | 99.00% AI |

Wyniki wykrywania dla tego wyjścia były mieszane. W tym teście WasItAI (zaskakująco) uzyskał najwyższy wynik wykrywania AI (99%). TruthScan miał drugi najwyższy wynik (97%). Sight Engine znacząco nie wykrył żadnych syntetycznych elementów na obrazie, a Winston poradził sobie najgorzej ze wszystkich detektorów (przypisując mniej niż 1% szansy na zaangażowanie). AI or Not poradziło sobie dobrze, ale dokładność nadal była poniżej 90%.

Porozmawiajmy o obrazie. Dwa najbardziej niepokojące aspekty treści stworzonych przez sztuczną inteligencję lub zmienionych w ten sposób to fakt, że oba wiążą się z oszustwem. Po pierwsze, wykorzystanie sztucznej inteligencji do zmiany przyziemnych obrazów w celu stworzenia treści o charakterze politycznym jest szybkie, łatwe i wygląda realistycznie. Niezależnie od tego, czy osoby tworzące tego typu treści mają na celu jedynie zaangażowanie, czy też są politycznymi prowokatorami, problem polega na tym, że są to fałszywe informacje przedstawiane jako autentyczne.

Drugim sposobem wykorzystania takich narzędzi do generowania obrazów jest oszustwo. Jeśli oszust chce złożyć fałszywe roszczenie z tytułu ubezpieczenia autocasco, będzie musiał przedstawić fałszywe dowody. Zamiast spędzać godziny w Photoshopie na edytowaniu obrazów i poprawianiu dowodów, mogą użyć generatorów obrazów, aby szybko stworzyć fałszywy dowód.

W powyższym przykładzie obrazu AI zauważ, jak oszust może wykorzystać podobny proces do złożenia fałszywego roszczenia zgodnie z Progressive's Kompleksowa polityka ochronyktóry w szczególności obejmuje:

- Cięcie lub uszkodzone opony

- Uszkodzone szyby, reflektory lub tylne światła

- Uszkodzenia farby w sprayu

- Wgniecenia lub zadrapania przed włamaniem do samochodu

- Wsypywanie cukru lub innych substancji do zbiornika paliwa

Oczywiście składanie fałszywych dowodów jest nie tylko zwodnicze, ale także całkowicie nielegalne. W idealnym świecie nikt nie łamałby prawa; w rzeczywistości przestępstwa zdarzają się każdego dnia. A bez niezawodnego wykrywania, firmy ubezpieczeniowe ryzykują, że zostaną oszukane na miliony, ponieważ rośnie liczba fałszywych roszczeń ubezpieczeniowych z wykorzystaniem sztucznej inteligencji.

#6. "Soda Musk i Don" (wygenerowane przy użyciu Nano Banana)

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Pełna generacja | Disinfo | 99.00% AI | 99.00% AI | 99.00% AI | 0.24% AI | 86.00% AI |

Po raz kolejny użyłem Nano Banana do tego testu, a celem było zademonstrowanie fałszywych, politycznie naładowanych obrazów o głupszym wydźwięku. TruthScan, Sight Engine i AIorNot oznaczyły wygenerowany obraz z oceną wykrywania AI 99%. WasitAI nie był tak pewny siebie - wykrywając obraz wygenerowany przez sztuczną inteligencję z pewnością tylko 86%. Winston całkowicie zawiódł, przypisując wynik AI na poziomie 0,2%. Aby wygenerować obraz, dałem Nano Banana ten monit:

“Wygeneruj zdjęcie, na którym Elon Musk rozlewa duży kubek napoju gazowanego jak Big Gulp na swoją koszulę i wariuje, podczas gdy Donald Trump siedzi obok niego i się śmieje. Są w samolocie odrzutowym. To jest ta scena. A zdjęcie powinno wyglądać realistycznie, jakby zostało zrobione aparatem fotograficznym i zawierać artefakty, takie jak lampa błyskowa aparatu odbijająca się w oknie samolotu i na zewnątrz samolotu. Jest noc. Powinno wyglądać hiperrealistycznie.“

Ilekroć jeden z tych programów nie wykryje sztucznej inteligencji, oznaczają go jako autentyczny. Jakkolwiek głupi może być ten przykład obrazu z testu, nie ma nic zabawnego w myśleniu, że deepfake jest prawdziwy.

#7. "Still Alive" (wygenerowane przez Nano Banana)

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Pełna generacja | Deepfake | 97.49% AI | 95.00% AI | 99.27% AI | 0.15% AI | 1.00% AI |

Czy uważasz, że ten obraz jest niepokojący? Aby wygenerować ten deepfake, użyłem Nano Banana i dałem mu swoje zdjęcie. Następnie dałem mu długą podpowiedź, która miała postawić mnie w sytuacji sugerującej, że zostałem uprowadzony. Może dlatego, że to zdjęcie pokazuje ja w kompromitującej pozycji. Co by było, gdyby ktoś stworzył coś takiego, wysłał to mojej matce i zagroził, że mnie skrzywdzi, jeśli nie wyśle mu pieniędzy? Straszne rzeczy.

(Pełny monit, którego użyłem w tym celu, można znaleźć w pełnym zestawie danych testowych na końcu tego artykułu).

Na szczęście ten obraz ma bardzo realistyczny wygląd, Trzy na pięć detektorów zidentyfikowało je jako wygenerowane przez sztuczną inteligencję.

AI or Not uzyskało wynik 99%, TruthScan 97%, a Sight Engine 95%. Niestety, Winston i WasItAI sklasyfikowały obraz jako prawdziwy.

Powinienem wyjaśnić, że testy te nie zostały przeprowadzone na moim osobistym koncie Gemini. Nano Banana nigdy nie poprosiła mnie o udowodnienie, że jestem osobą na zdjęciu. Każdy mógł pobrać moje zdjęcie z Internetu, umieścić je w Nano Banana i zlecić stworzenie tego typu obrazu.

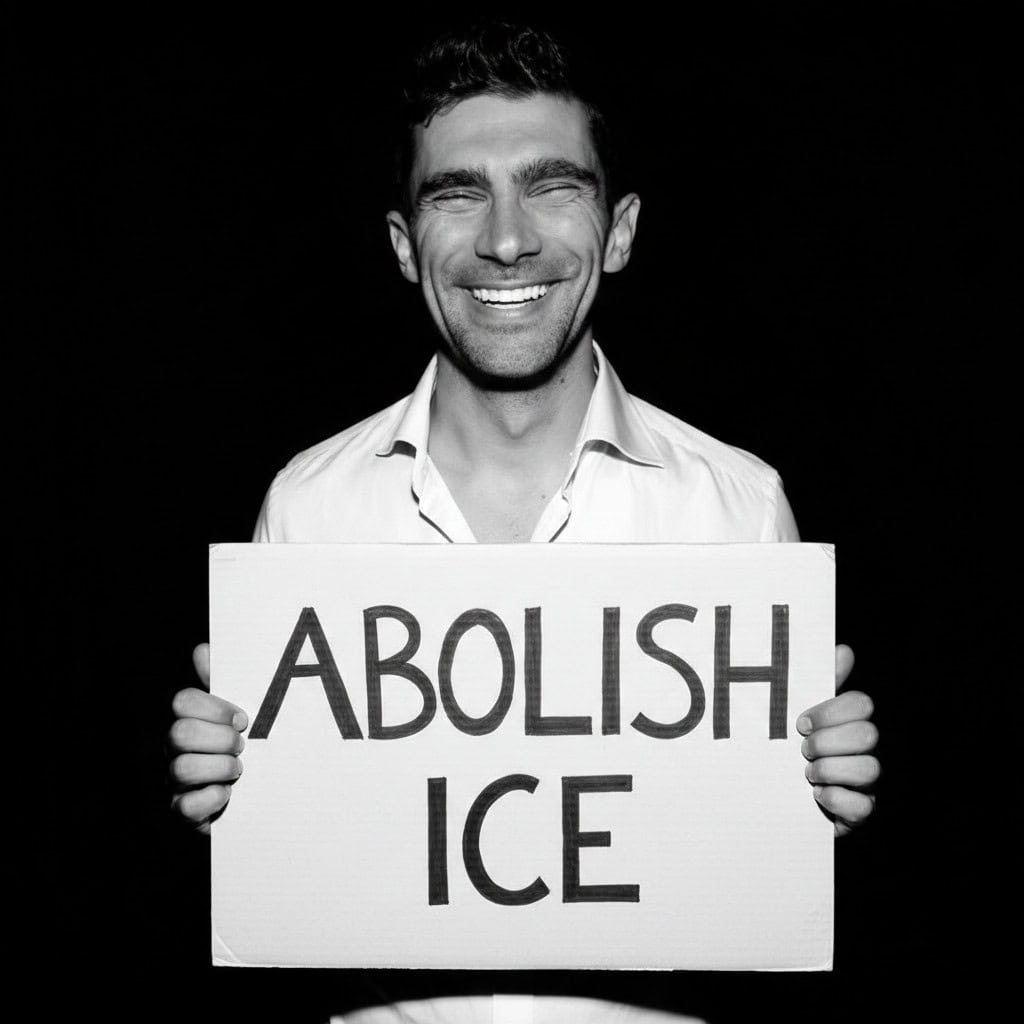

#8. "Abuse of a Ben" (wygenerowane przy użyciu Nano Banana)

Poznaj Bena. Większość czasu spędza na zarządzaniu różnymi działami w firmach, w których pracuje. Powyższe zdjęcie to (prawdziwy) elegancki firmowy headshot Bena. Jeśli trudno się domyślić, Ben jest profesjonalistą. Bez względu na to, jakie ma poglądy polityczne, zachowuje je dla siebie, a jego rozmowy w pracy dotyczą tylko pracy. Jednak w każdej chwili podobizna Bena może zostać wykorzystana do rozpowszechniania propagandy politycznej lub wiadomości bez jego zgody.

Ostatnio pojawiło się wiele doniesień o tym, jak generowane przez sztuczną inteligencję filmy z udziałem agentów ICE i protestów rozprzestrzeniają się w Internecie. Na podstawie wszystkich dotychczasowych testów doszedłem do wniosku, że tworzenie fałszywej propagandy politycznej za pomocą sztucznej inteligencji jest naprawdę łatwe. Postanowiłem przetestować ponownie, tym razem używając Bena.

Za zgodą Bena wykorzystałem jego zdjęcie głowy do stworzenia deepfake'a. Oto obraz wygenerowany przez sztuczną inteligencję, który stworzył Nano Banana:

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana | Deepfake / Disinfo | 99.00% AI | 97.00% AI | 98.88% AI | 5.74% AI | 99.00% AI |

Zajęło to trzydzieści sekund. Wszystko, co musiałem zrobić, to przeciągnąć i upuścić jego zdjęcie głowy do Gemini i poprosić go o "podniesienie znaku z napisem zniesienia ICE". Wynik z Nano Banana nie jest tak fotorealistyczny jak inne, ale nadal wygląda wystarczająco autentycznie, by być przekonującym.

Na szczęście cztery detektory dokładnie zidentyfikowały obraz: TruthScan (99% AI), Was It AI (99% AI), Sight Engine (97% AI) i AI or Not (97% AI). Winston AI zawiódł, przypisując tylko wynik 5% AI.

#9. "Club Void" (Wygenerowane przez Midjourney)

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| MidJourney Pełna generacja | Ogólne | 99.00% AI | 99.00% AI | 89.21% AI | 1.56% AI | 70.00% AI |

Wygenerowałem powyższy obraz za pomocą Midjourney. Im dłużej na niego patrzyłem, tym bardziej wydawał mi się niepokojący. Estetyka jest mroczna i niesamowita. Wydaje się, że zza obiektu wyłania się cienista obecność. Aby stworzyć ten obraz, użyłem funkcji odniesienia estetycznego Midjourney i po prostu poprosiłem, aby była to "dziewczyna stojąca w klubie i uśmiechająca się". Pokazałem obraz kilku osobom i wszyscy myśleli, że jest prawdziwy.

Większość wykrywaczy oznaczyła obraz jako wygenerowany przez sztuczną inteligencję. TruthScan i Sight Engine oznaczyły go z wynikiem 99% AI, AI or Not powiedział 89%.

WasItAI nie był tak pewny jak detektory, klasyfikując obraz tylko z wynikiem 70% AI.

Detektor Winston AI całkowicie zawiódł, dając obrazowi wynik 1,56% AI.

#10 "Ice Box" (wygenerowane przez Midjourney)

Jak zostały ocenione detektory obrazu

| Model obrazu | Kategoria | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| MidJourney Pełna generacja | Disinfo | 99.00% AI | 92.00% AI | 97.94% AI | 41.20% AI | 72.00% AI |

Stworzyłem ten obraz przy użyciu tej samej metody w połowie podróży, co w poprzednim teście. Tym razem celem było wygenerowanie czegoś nieco ciemniejszego. TruthScan był najdokładniejszym wykrywaczem, oznaczając obraz jako 99% AI. Sight Engine i AI or Not poprawnie wykryły obraz. Winston AI całkowicie zawiódł, a WasItAI miał znacznie niższy wynik zaufania niż TruthScan, Sight Engine i AI or Not.

Powinienem powiedzieć, że w tym przypadku wygenerowany przeze mnie obraz można wykorzystać lub oprawić na dwa sposoby. Z jednej strony, ktoś mógłby użyć tego (lub dowolnego innego o tematyce politycznej/niepokojów społecznych) rodzaju mediów w jakimś projekcie artystycznym lub kreatywnym, aby złożyć oświadczenie. W takim przypadku ryzyko wydaje się mniejsze. Główną obawą, jaką mam w związku z tą kategorią mediów generowanych przez sztuczną inteligencję, jest to, że są one wykorzystywane przez nikczemne osoby, które twierdzą, że są prawdziwe.

Podsumowanie i wyniki: Najlepsze wykrywacze obrazów AI

Ok, więc teraz, gdy wyświetliliśmy wszystkie testy, podsumuję: Wygenerowałem 10 obrazów AI

- Użyłem ChatGPT, Nano Banana i Midjourney do wygenerowania 10 obrazów AI

- Przetestowałem pięć wykrywaczy obrazów AI, przepuszczając przez nie wszystkie wygenerowane przeze mnie obrazy AI.

- TruthScan przeszedł wszystkie testy i był najdokładniejszym wykrywaczem. AI or Not przeszedł 8 z 10 testów, wykazując pewną niezawodność. Sight Engine nie przeszedł 3 z 10 testów i wykazał się ogólnie wątpliwą dokładnością. Was It AI nie zdał 4 z 10 testów i wykazał się słabą dokładnością. Winston AI był najmniej dokładnym wykrywaczem obrazów AI, przechodząc tylko 3 z 10 testów, konsekwentnie błędnie klasyfikując obrazy.

Kompleksowe wyniki testów

Jak pięć popularnych wykrywaczy obrazów AI radziło sobie z oszustwami, dezinformacją, deepfake'ami i ogólną fotografią.

Wszystkie 10 testów - pełne zestawienie

Każdy wynik reprezentuje ocenę zaufania AI detektora. Próg zaliczenia: ≥ 90% AI.

| Test | Kategoria | Źródło | TruthScan | Silnik celowniczy | Sztuczna inteligencja czy nie | Winston AI | WasItAI |

|---|---|---|---|---|---|---|---|

| 1 Człowiek na krawędzi | Ogólne | ChatGPT | 99.00% | 99.00% | 78.00% | 0.98% | 1.00% |

| 2 Fałszywy paragon | Oszustwo | ChatGPT | 99.00% | 19.00% | 94.48% | 0.04% | 1.00% |

| 3 Pakiet zagrożeń | Oszustwo | Nano Banana | 99.00% | 98.00% | 99.10% | 31.98% | 99.00% |

| 4 Mączka z karalucha | Oszustwo | Nano Banana | 97.15% | 18.00% | 85.87% | 72.29% | 1.00% |

| 5 Autowandalizm | Oszustwo / Dezinformacja | Nano Banana | 97.48% | 18.00% | 89.52% | 0.02% | 99.00% |

| 6 Soda Musk & Don | Disinfo | Nano Banana | 99.00% | 99.00% | 99.00% | 0.24% | 86.00% |

| 7 Wciąż żywy | Deepfake | Nano Banana | 97.49% | 95.00% | 99.27% | 0.15% | 1.00% |

| 8 Znęcanie się nad Benem | Deepfake / Disinfo | Nano Banana | 99.00% | 97.00% | 98.88% | 5.74% | 99.00% |

| 9 Club Void | Ogólne | MidJourney | 99.00% | 99.00% | 89.21% | 1.56% | 70.00% |

| 10 Pojemnik na lód | Disinfo | MidJourney | 99.00% | 92.00% | 97.94% | 41.20% | 72.00% |

Metodologia: Każdy obraz został przesłany raz do każdego detektora. Wynik ≥ 90% AI jest liczony jako prawidłowe wykrycie. Wyniki w przedziale 70-89% to "bliskie pominięcia". Wszystko poniżej 70% jest porażką. AI or Not oznaczyło jedną generację przy 78%, jedną przy 85% i jedną przy 89% - 89% jest traktowane jako bliskie pominięcia z gwiazdką w tabeli podsumowującej.

Uwagi końcowe i dane

W sumie, między napisaniem tego artykułu a rygorystycznymi testami, spędziłem 25 godzin na przygotowaniu tego raportu. Multimodalne narzędzia do wykrywania sztucznej inteligencji wciąż się rozwijają, ale jasne jest, że niektóre są dokładniejsze od innych. Po przetestowaniu wszystkich narzędzi, TruthScan okazał się najdokładniejszy. Detektor obrazu AI. Testy mówią same za siebie.

Jeśli chcesz uzyskać dostęp do kopii CSV danych z testów, które przeprowadziłem w tym artykule, możesz ją znaleźć tutaj. Arkusz danych, do którego link zamieściłem, zawiera wszystkie oryginalne podpowiedzi i wyniki wykrywania z testów opisanych w tym artykule.