Haben Sie diesen Viral gesehen? Foto des Papstes im Jahr 2023 in einer schicken weißen Pufferjacke?

Millionen von Menschen teilten es, Nachrichtenseiten berichteten darüber, und alle sprachen darüber, wie elegant der Papst aussah.

Es gab nur ein Problem - es ist nie passiert. Das Bild wurde vollständig von künstlicher Intelligenz erstellt.

Oder Sie erinnern sich vielleicht an das schockierende Bild eines Explosion im Pentagon die den Aktienmarkt kurzzeitig erschütterte. Gefälscht!

Was ist mit den Bildern von Trump wird angegriffen und verhaftet? Auch sie wurden vollständig von der KI erfunden.

Gefälschte KI-Bilder haben echten Schaden angerichtet.

Menschen haben Geld verloren, wenn sie aufgrund von gefälschten Nachrichtenfotos investiert haben.

Prominente und normale Menschen gleichermaßen haben ihre Gesichter in peinlichen oder unangemessenen Situationen auf andere Körper gesetzt.

Politiker wurden dabei erwischt, wie sie Dinge sagten und taten, die sie in Wirklichkeit nie getan haben.

Wenn wir unseren eigenen Augen nicht mehr trauen können, brauchen wir neue Wege, um herauszufinden, was real ist und was nicht.

In diesem Blog zeige ich Ihnen, wie sich die KI- und DeepFake-Technologie im Laufe der Jahre entwickelt hat, wie wichtig es ist, KI von echten Bildern zu unterscheiden, wie Sie feststellen können, ob ein Bild KI-generiert ist, und welches das beste Tool ist, um KI-generierte Bilder zu erkennen.

Wie sich KI-Kunst und Deepfake-Technologie entwickelt haben

Reden wir über AI zuerst...

Noch vor nicht allzu langer Zeit sahen KI-generierte Bilder wie ein schlechter Traum aus - verschwommene Gesichter, zusätzliche Finger und eine ganze Reihe von Merkwürdigkeiten. Aber heute ist die KI-Kunst schockierend realistisch.

Alles begann um 2014 mit GANs (Generative Adversarial Networks), bei dem sich zwei KI-Modelle - das eine erstellt Fälschungen, das andere erkennt sie - gegenseitig immer weiter verbessern.

Machen Sie sich nie wieder Sorgen, dass KI Ihre Texte erkennt. Undetectable AI Kann Ihnen helfen:

- Lassen Sie Ihr AI-unterstütztes Schreiben erscheinen menschenähnlich.

- Bypass alle wichtigen KI-Erkennungstools mit nur einem Klick.

- Verwenden Sie AI sicher und zuversichtlich in Schule und Beruf.

Die ersten GAN-Bilder waren ziemlich schlecht - verschwommene Gesichter mit seltsamen Augen und fehlenden Ohren.

Bis zum Jahr 2020 wurde die Lage mit "Diffusionsmodelle".

Sie beginnen mit einem unordentlichen Bild voller Punkte und säubern es langsam, bis es echt aussieht.

Das war ein enormer Sprung nach vorn. Plötzlich konnte die KI viel klarere, realistischere Bilder machen.

Deepfake-Technologie funktioniert auf die gleiche, aber schwierigere Weise.

Dabei werden sowohl KI als auch Deepfake-Technologie eingesetzt.

Die KI lernt, wie das Gesicht eines Menschen aus verschiedenen Blickwinkeln und mit verschiedenen Gesichtsausdrücken aussieht, indem sie viele Videos und Bilder von ihm studiert.

Dann kann es das Gesicht dieser Person auf den Körper einer anderen Person in einem anderen Video übertragen.

Der Computer lernt, die Beleuchtung, den Hautton und sogar winzige Gesichtsausdrücke so anzupassen, dass es echt aussieht.

Frühe Deepfakes aus dem Jahr 2017 sahen offensichtlich und fehlerhaft aus. Die heutigen Deepfakes können nahezu perfekt sein.

Um den Vergleich zu sehen, sehen Sie sich die Videos unten an:

Deepfake im Jahr 2017 - Gefälschtes Obama-Video

Deepfake im Jahr 2023 - Emma Watson in "Get Out (2017)"

Im Jahr 2022 haben die Menschen etwa 6 Millionen Bilder mithilfe von KI erstellt. Bis Anfang 2023 stieg diese Zahl auf über 20 Millionen Bilder pro Tag.

Heute gibt es Milliarden von KI-Bildern im Internet, und die meisten von uns sehen sie täglich, ohne es zu wissen.

Risiken von KI-generierten Bildern bei Fehlinformationen

Falsche Nachrichten verbreiten sich in den sozialen Medien 6-mal schneller als echte Nachrichten.

Der Schaden ist meist schon angerichtet, wenn jemand darauf hinweist, dass ein Bild gefälscht ist.

Die mit gefälschten Bildern verbundenen Risiken sind:

1) Manipulation - Falsche Bilder erzeugen falsche Erzählungen über andere, einschließlich Wahlen, führende Politiker und Weltereignisse. Zum Beispiel, KI-generierte Bilder zeigten fälschlicherweise die Verhaftung von US-Präsident Donald Trump.

2) Verleumdung - Gefälschte Bilder können den Ruf ruinieren. Zum Beispiel, Im Januar 2024 zirkulierten im Internet KI-generierte Bilder von Taylor Swift, die sie falsch darstellten.

3) Soziale Unruhen - Ein einziges gefälschtes Bild kann Empörung, Aufruhr oder sogar Gewalt auslösen. Zum Beispiel, Im Mai 2023 kursierte in den sozialen Medien ein von der KI generiertes Bild, das eine Explosion in der Nähe des Pentagons zeigte.

4) Betrug - Betrüger verwenden gefälschte Bilder, um Menschen zum Senden von Geld zu verleiten. Zum Beispiel; Michael Hewson (Finanzanalyst) gab sich als solcher aus, um für betrügerische Investitionspläne zu werben.

Da diese Betrügereien oft mit einem “verifizierten” Prominentenbild beginnen, reicht normale Vorsicht nicht aus. Lassen Sie den begleitenden Link oder die Nachricht durch unsere Undetectable AI laufen Betrugsdetektor.

Es bietet eine wichtige Sicherheitsebene, indem es betrügerische Domains und hochriskante “Werde-schnell-reich”-Sprache kennzeichnet, die oft mit KI-generierten Deepfakes von Finanzanalysten oder Persönlichkeiten des öffentlichen Lebens einhergeht.

Es gibt noch ein weiteres Problem, das sich jetzt stellt, nämlich die "Lügendividende".

Da KI-Fälschungen immer häufiger werden, tun Menschen, die in echte Skandale verwickelt sind, die Beweise einfach als "Deepfake" - selbst wenn sie echt ist. Die Politiker haben bereits damit begonnen, diese Taktik anzuwenden.

Die Bedeutung der Unterscheidung zwischen KI und echten Bildern

Die Notwendigkeit, das echte und das gefälschte Bild zu verstehen, ist aus mehreren Gründen wichtiger denn je:

1 - Untergrabung des öffentlichen Vertrauens

Unsere Gesellschaft lebt vom Vertrauen. Unser Gehirn akzeptiert, was es in den Nachrichten, vor Gericht oder von unseren Führern sieht.

Aber jetzt, wo die KI so überzeugende gefälschte Bilder macht, bricht dieses Vertrauen zusammen.

Wenn wir alle weiterhin so misstrauisch sind, wird dies unsere Beziehung zur Welt völlig verändern.

2 - Rechtliche Implikationen und aufkommende Vorschriften

Die Regierungen versuchen herauszufinden, wie sie mit gefälschten KI-Bildern umgehen sollen.

Zum Beispiel,

- Kalifornien hat gerade ein Gesetz verabschiedet die die Erstellung gefälschter politischer Anzeigen mit Hilfe von KI während der Wahlzeit illegal macht.

- Die Das EU-Nachrichtendienstgesetz erlegt Verpflichtungen auf zur Kennzeichnung der Anforderungen von KI und Deepfake-Materialien.

3 - Auswirkungen auf die digitale Kompetenz

Da KI immer besser darin wird, gefälschte Bilder zu erstellen, müssen wir alle besser darin werden, sie zu erkennen.

Die Schulen müssen die Schüler über KI und die sich ständig weiterentwickelnde Technologie von Deepfake unterrichten.

Wir müssen ein umfassendes Verständnis entwickeln, damit wir nicht einfach glauben, was wir im Internet sehen.

4 - Aufrechterhaltung von Authentizitätsketten

Eine Lösung kann sein "Echtheitsketten."

Das bedeutet, dass wir verfolgen müssen, woher ein Bild kommt - von dem Moment an, in dem es entsteht, bis zu dem Zeitpunkt, an dem wir es sehen.

Mit einer speziellen Technologie können echte Fotos mit unsichtbaren Markierungen versehen werden, aus denen hervorgeht, wer und wann sie aufgenommen wurden.

Auf diese Weise können wir die Geschichte eines Bildes und seine Authentizität überprüfen.

Woran man erkennt, ob ein Bild AI-generiert ist (Hauptmerkmale)

Die von der künstlichen Intelligenz erzeugten Bilder sehen so echt aus, dass ein Neuling kaum einen Unterschied feststellen kann.

Wenn Sie wissen möchten, wie Sie erkennen können, ob ein Bild von einer künstlichen Intelligenz generiert wurde, achten Sie auf diese wichtigen Details:

- 1. Unnatürliche oder surreale Details

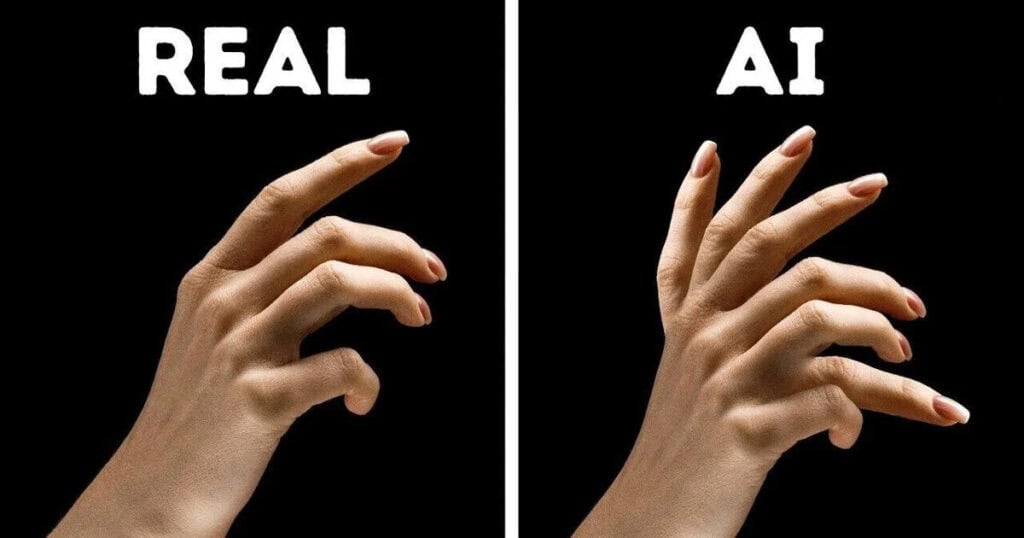

AI kann bestimmte Körperteile nicht erkennen, insbesondere Hände.

Wir haben 5 Finger an jeder Hand, aber die KI gibt den Menschen oft 6-8 Finger, verschmolzene Finger oder seltsam aussehende Daumen. Sehen Sie sich die Hände an.

Quelle = Flugzeiten

Auch die KI baut Mist Zähne eine Menge.

Achten Sie auf Zähne, die zu perfekt erscheinen, auf zu viele Zähne in einem Mund oder auf Zähne, die nicht richtig ausgerichtet sind.

Manchmal verschmelzen alle Zähne zu einem weißen Fleck.

Bild generiert von ChatGPT

Andere Körperfehler sind:

- Augen, die nicht zueinander passen oder in leicht unterschiedliche Richtungen schauen

- Ohren, die nicht zueinander passen oder unterschiedlich hoch sind

- Brillen, die sich seltsam verziehen oder aus dem Gesicht schweben

- Schmuck, der mit der Haut verschmilzt oder sich den Bewegungen des Körpers nicht anpasst.

- 2. Übermäßig glatte oder plastikähnliche Texturen

Echte Haut hat Textur (Poren, Linien, kleine Unvollkommenheiten). Allerdings lässt AI die Haut oft wie eine Plastikpuppe aussehen - zu perfekt!

Haare sind ein weiteres Indiz. Echtes Haar hat einzelne Strähnen, die in verschiedene Richtungen verlaufen.

KI-Haar sieht oft wie ein einziges Stück aus, vor allem im Stirnbereich.

Der Haaransatz könnte wie aufgemalt aussehen, anstatt einzelne Haare zu zeigen.

Quelle = Mikestuzzi

Kleidung in AI-Bildern sind entweder sehr glatt oder haben seltsame Falten, die physikalisch keinen Sinn ergeben.

Schauen Sie sich an, wie sich Stoffe falten - biegen sie sich wie echte Materialien?

KI lässt Stoffe oft so aussehen, als seien sie auf unmögliche Weise geschmolzen oder gefroren.

Wie kommt es dazu? Die KI versteht die Physik und die Materialien nicht - sie kopiert nur Muster, die sie schon einmal gesehen hat.

Zum Beispiel,

Sie könnte wissen wie Denim aussiehtaber nicht, wie sich Jeansstoff verhält, wenn sich jemand darauf setzt. Suchen Sie nach diesen Hinweisen.

- 3. Verschwommener oder kauderwelschartiger Text im Bild

Text ist die größte Schwäche von AI.

Wenn Sie Wörter oder Buchstaben in einem KI-Bild sehen, sind sie oft verschwommen, unsinnig oder einfach nur falsch.

Bild generiert von ChatGPT

Suchen Sie nach:

- Wörter, die normal beginnen, aber zu Kauderwelsch werden

- Buchstaben, die sich vermischen oder ihre Form verändern

- Unmögliche Kombinationen von Symbolen

- Text auf Schildern oder T-Shirts, der keinen Sinn ergibt

Das liegt daran, dass die KI die Sprache nicht auf die gleiche Weise versteht wie die Bilder. Die Texte scheinen ein weiteres visuelles Muster zu sein.

- 4. Inkonsistente Beleuchtung und Schatten

KI-generierte Bilder befolgen oder verstehen die Regeln von Licht und Schatten nicht.

Zum Beispiel, Manchmal sieht es so aus, als gäbe es mehrere Sonnen am Himmel.

Oder es gibt Schatten auf Objekten (Haut, Metall, Glas), die einfach keinen Sinn ergeben.

Die KI versteht die Lichtphysik nicht. Sie versucht nur, Muster zu erkennen, die sie schon einmal gesehen hat, und nicht zu berechnen, wie das Licht reflektiert und gebrochen wird.

Quelle = Creator.nightcafe.club

Diese Lichtprobleme werden zwar immer besser, sind aber selbst bei hochwertigen KI-Bildern immer noch häufig.

- 5. Seltsame Hintergründe oder unrealistische Tiefenwahrnehmung

Der Hintergrund in KI-Bildern enthält oft Hinweise darauf, dass etwas nicht stimmt. Suchen Sie danach:

- Gebäude mit unmöglicher Architektur (Fenster, die nicht in einer Reihe stehen, Türen, die ins Leere führen)

- Objekte, die miteinander oder mit dem Hintergrund zu verschmelzen scheinen

- Dinge, die weit weg sein sollten, aber genauso groß aussehen wie aus der Nähe

Quelle = Wallpaperaccess.com

Manchmal sieht die Kante, an der eine Person auf den Hintergrund trifft, seltsam aus - entweder zu scharf oder zu unscharf. Das passiert, weil die KI die Person und den Hintergrund separat erstellt und dann versucht, sie zusammenzufügen.

- 6. Prüfen Sie die Metadaten und Quellinformationen

Jedes mit einer echten Kamera aufgenommene Foto hat "Metadaten" - Informationen darüber, wann und wie das Bild aufgenommen wurde.

AI-Bilder haben keine Metadaten oder Metadaten, die zeigen, dass sie von Programmen wie DALL-E oder Midjourney gemacht wurden.

Sie können die Metadaten mit überprüfen:

- Klicken Sie mit der rechten Maustaste auf ein Bild und sehen Sie sich "Eigenschaften" oder "Info" an.

- Mit Websites wie metadata2go.com

- Verwenden Sie auf dem Telefon Apps wie Photo Investigator

Wenn Sie sich nicht sicher sind, versuchen Sie eine umgekehrte Bildsuche.

- Zu Google Images gehen

- Laden Sie das Bild hoch, um zu sehen, ob es an anderer Stelle im Internet oder in anderen Versionen erscheint.

Denken Sie daran: Nur weil jemand behauptet, ein Foto gemacht zu haben, muss es noch lange nicht wahr sein.

Wer hat das geschrieben und warum? Wollen sie mich wütend oder ängstlich machen?

Dies sind oft Anzeichen für gefälschte Bilder.

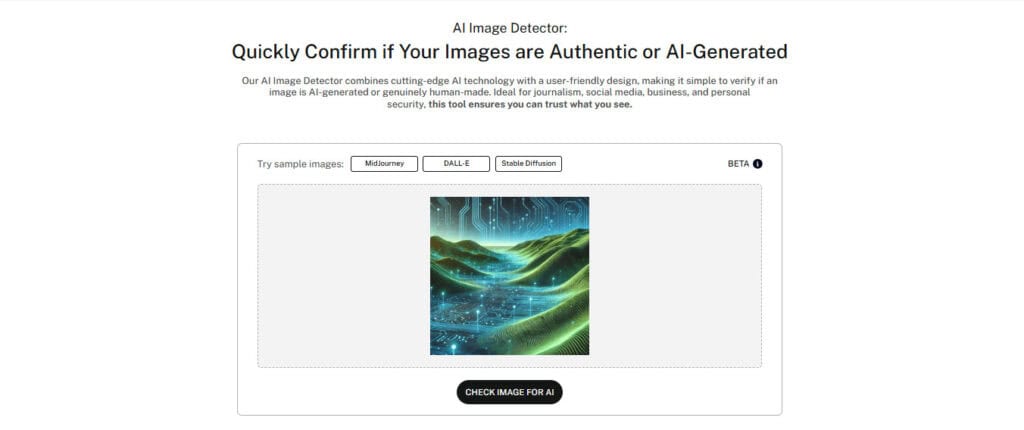

Bestes Tool zur Erkennung von AI-generierten Bildern

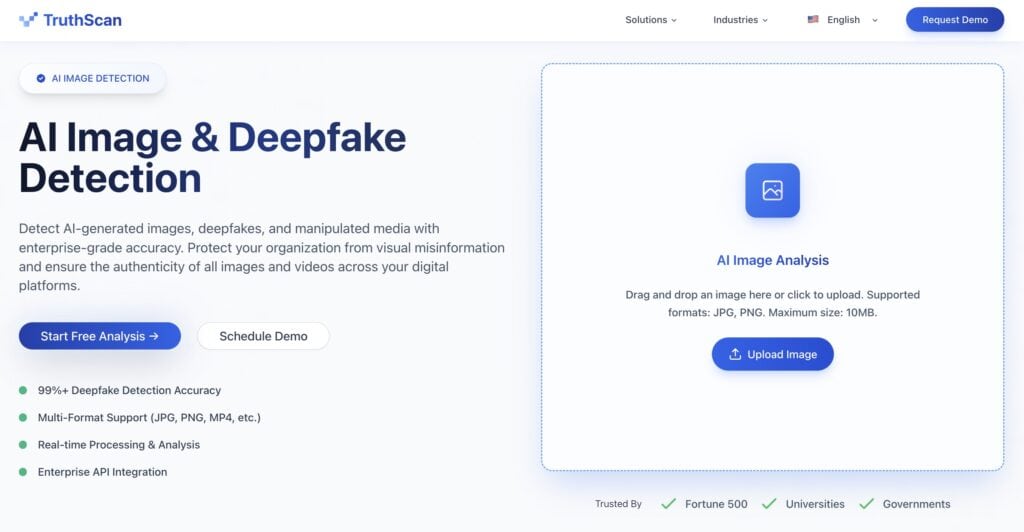

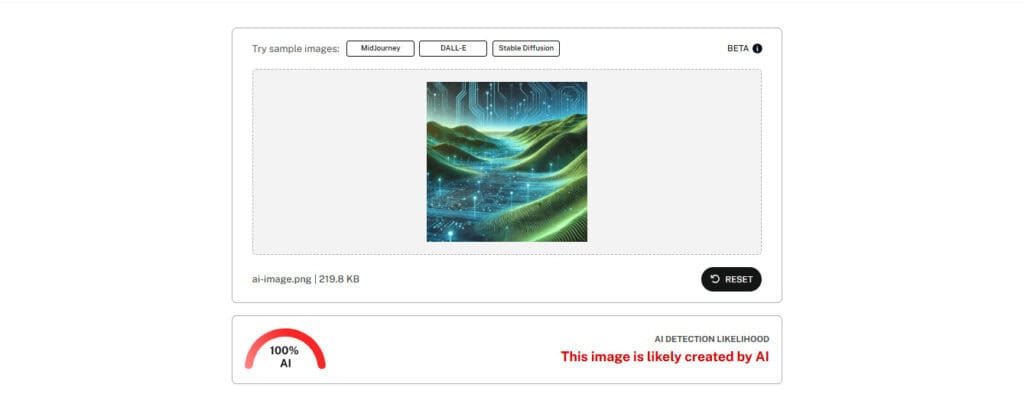

Überraschenderweise gibt es auch andere KI-geschulte Tools, die bei der Erkennung von KI helfen. In diesem Fall ist das Werkzeug AI-Bild-Detektor.

Werfen wir einen Blick darauf, was einen guten KI-Detektor ausmacht.

1 - Genauigkeit: Einige Detektorwerkzeuge sind meistens richtig, während andere Fehler machen.

Der beste Detektor von heute liegt in etwa 80-85% der Fälle richtig, was zwar nicht perfekt ist, aber viel besser als Raten.

2 - Welche KI-Generatoren er erkennen kann: Einige Tools sind gut darin, eine Quelle zu erkennen (z. B. DALL-E-Bilder), übersehen aber andere (z. B. Midjourney-Fälschungen).

Dieses Werkzeug ist auf alle wichtigen KI-Tools geschult - DALL-E, Midjourney, Stable Diffusion und mehr.

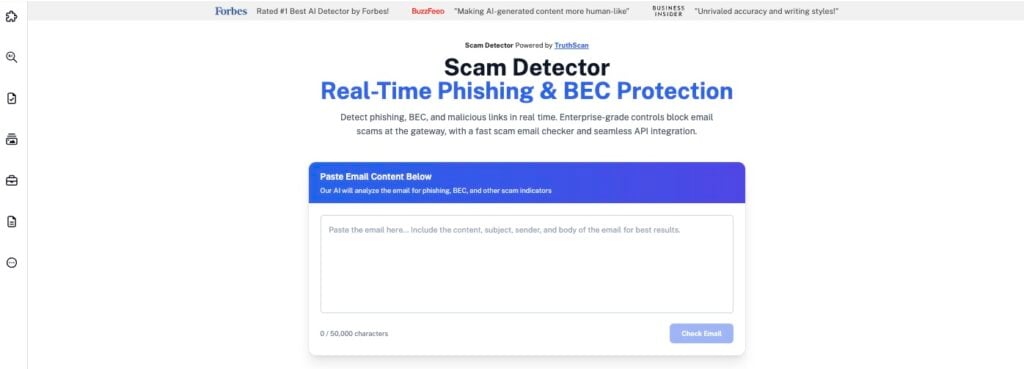

Für fortgeschrittene und forensische Analysen, TruthScans AI-Bild-Detektor ist ein weiteres leistungsfähiges Werkzeug, das Sie in Ihr Werkzeugset zur Bildüberprüfung aufnehmen sollten.

Sie geht über die Musteranalyse auf Pixelebene hinaus, um Anzeichen für manipulierte oder KI-generierte Inhalte zu erkennen - einschließlich Deepfakes und synthetischer Medien.

Ganz gleich, ob Sie es mit potenziellen Fehlinformationen, Fragen der Markensicherheit oder digitalen Beweisen zu tun haben, TruthScan stellt sicher, dass die Bilder, die Sie verwenden oder auf die Sie stoßen, authentisch, nachvollziehbar und rechtlich sicher sind.

Deepfake-Detektion zur Bestätigung der Echtheit von Bildern

Für Situationen, in denen es wirklich auf visuelle Genauigkeit ankommt, bietet die Undetectable AI Deepfake-Erkennung bietet eine präzise Möglichkeit zu überprüfen, ob ein Bild oder Video künstlich erzeugt oder manipuliert wurde.

Sie prüft Konsistenz der Beleuchtung, Pixelmuster und Ausrichtung der Gesichter um selbst die subtilsten Anzeichen von Deepfake oder synthetischer Bearbeitung zu erkennen.

Wenn Sie Ihre Datei hochladen, erhalten Sie eine Authentizitätsbewertung und visuelle Indikatoren, die mögliche Manipulationsbereiche hervorheben.

In Kombination mit dem AI Image Detector sorgt die Deepfake-Erkennung dafür, dass jedes Bild, das Sie teilen oder veröffentlichen, verifiziert, authentisch und vertrauenswürdig ist.

Für Teams oder Institutionen, die auch Audio-Beiträge wie gesprochene persönliche Statements oder aufgezeichnete Bewerbungsantworten prüfen, ist es hilfreich, zu überprüfen, ob die Stimme, die Sie hören, echt ist.

Nicht nachweisbare AI's AI Sprachdetektor kann hochgeladene Audiodateien analysieren und auf Anzeichen von Sprachsynthese oder Klonen überprüfen.

Es gibt Ihnen ein klares Signal, ob die Sprache von einem echten Sprecher erzeugt oder von einem KI-Modell generiert wurde, was jeder sprachbasierten Einreichung eine zusätzliche Ebene von Vertrauen und Authentizität verleiht.

3 - Benutzerfreundlichkeit: Um zu prüfen, ob ein Bild gefälscht ist, sollte man kein Informatikstudium absolviert haben.

Sie laden einfach das Bild hoch und erhalten das Ergebnis in wenigen Sekunden.

4 - Datenschutz: Einige Detektoren behalten alle Bilder, die Sie hochladen, was ein Problem sein kann, wenn Sie sensible Fotos prüfen. Dieses Tool löscht die Bilder nach der Prüfung.

So verwenden Sie unser AI-Bild-Detektor:

- Klicken Sie auf diesen Link, um die Website zu besuchen.

- Wählen Sie das gewünschte Bild von Ihrem Computer oder Telefon aus. Das Tool akzeptiert JPEG- und PNG-Formate bis zu einer Größe von 4,5 MB.

- Klicken Sie auf die Schaltfläche und warten Sie ein paar Sekunden.

- Eine Gesamtbewertung von 1-100 zeigt an, wie wahrscheinlich es ist, dass das Bild von einer künstlichen Intelligenz generiert wurde.

Die besten Ergebnisse erzielen Sie mit Bildern, die nicht stark komprimiert oder in der Größe verändert wurden.

Screenshots und Bilder aus sozialen Medien sind oft komprimiert, was die Erkennung erschweren kann.

Manchmal irren sich die Detektoren in zweierlei Hinsicht:

- Falsch-positive Meldungen passieren, wenn der Detektor sagt, dass ein Bild von der KI generiert wurde, es aber echt ist. Dies kann bei stark bearbeiteten Fotos, Illustrationen oder Bildern mit ungewöhnlicher Beleuchtung vorkommen.

Falsche Negative passieren, wenn der Detektor ein Bild für echt hält, es aber in Wirklichkeit von der KI generiert wurde.

Das passiert am häufigsten bei stark bearbeiteten KI-Bildern oder solchen, die von neueren KI-Modellen stammen, die der Detektor noch nicht kennt.

Wenn Sie nach einer einfachen Möglichkeit suchen, KI-generierte Inhalte zu analysieren, sehen Sie sich unseren KI-Detektor und Humanizer im Widget unten an!

FAQs zur Erkennung von AI-generierten Bildern

Wie erkenne ich, ob ein Bild oder Video AI-generiert ist?

KI-generierte Bilder haben oft Probleme mit Text, symmetrischen Objekten und der Darstellung von konsistenten Hintergründen.

In Videos können sich Personen unnatürlich bewegen, ihre Stimmen stimmen nicht mit ihren Lippen überein, oder Teile des Videos flackern von Bild zu Bild.

Gibt es Wasserzeichen auf KI-generierten Bildern?

Ja, einige KI-Tools wie Midjourney und DALL-E von OpenAI verstecken geheime Wasserzeichen in ihren Bildern.

Können KI-generierte Bilder völlig unauffindbar sein?

Die Antwort lautet "Nein" ab 2025. Fortgeschrittene KI-Modelle erzeugen zwar sehr überzeugende Bilder, aber die technischen Artefakte sind immer noch auf demselben Niveau.

Gegenwärtig kann die Technik etwa 85% der Dinge, die wahrgenommen werden können, entfernen, aber sie kann noch nicht etwas völlig unsichtbar machen.

Warum sehen manche KI-Bilder hyperrealistisch aus?

Die neuesten KI-Modelle machen dank intelligenter Technologie superrealistische Bilder.

Sie wurden an Milliarden hochwertiger Bilder trainiert und werden durch spezielle Upgrades ständig verbessert.

Diese Modelle eignen sich besonders gut zum Erfassen von Fotostilen, realistischer Beleuchtung und detaillierten Texturen.

Was ist der beste KI-Detektor für Bilder?

Die AI-Bild-Detektor von Undetectable AI erkennt AI-generierte Bilder mit einer Genauigkeit von bis zu 85%.

Es verwendet einen intelligenten, mehrstufigen Prozess, um winzige Details in Bildern zu überprüfen.

Es sucht nach Mustern in den Pixeln, versteckten Daten und kleinen Fehlern, die anderen Tools möglicherweise nicht auffallen.

Letzte Überlegungen: Wie man AI-generierte Bilder erkennt

Das ist eine Zusammenfassung, und bevor wir diesen Blog beenden, habe ich noch eine Frage an Sie.

Warum lässt sich unser Gehirn so leicht von KI-Bildern täuschen?

Die Antwort liegt in der menschlichen Psychologie.

Unsere Gehirne folgen dem "Bildüberlegenheitseffekt".

Demnach bleiben Bilder besser im Gedächtnis haften als Worte.

Wenn etwas echt aussieht und zu dem passt, was wir bereits glauben, stellen wir es nicht in Frage. Außerdem sind wir oft zu beschäftigt, um zu überprüfen, ob ein Bild echt oder gefälscht ist.

In diesem Fall können Sie nach den Hinweisen suchen, die wir oben besprochen haben. Seltsame Hände, seltsamer Text und perfekte Haut können Ihnen helfen, KI-Fälschungen zu erkennen.

Das Wichtigste ist, dass Ihre Augen getäuscht werden können. Nur weil ein Bild echt aussieht, heißt das nicht, dass es auch echt ist.

Wenn Sie online etwas Erstaunliches oder Schockierendes sehen, nehmen Sie sich eine Minute Zeit, um darüber nachzudenken, bevor Sie es teilen oder ein Urteil abgeben.

Da KI jeden Tag weiterentwickelt wird, müssen wir alle besser darin werden, sie zu erkennen. Wenn Sie das nächste Mal ein großartiges Bild sehen, werden Sie dann zum Super-Bilddetektiv und suchen nach Hinweisen?