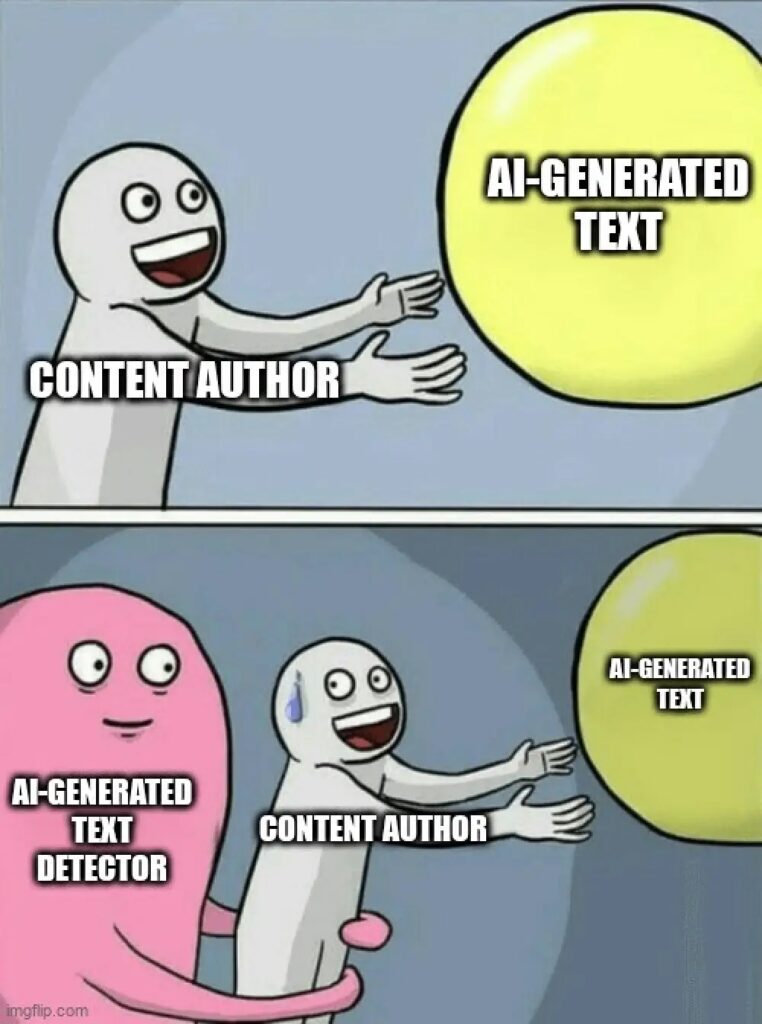

Dans l'univers A : Les entreprises utilisent l'IA partout mais la détectent activement.

En fait, près de 3 messages commerciaux sur 4 sont créés par l'IA, ce qui fait perdre la confiance des clients. Le contenu se divise en deux mondes : "humain haut de gamme" et "IA bon marché".

Dans l'univers B : Les entreprises intelligentes ajoutent des outils de détection de l'IA. Elles utilisent toujours l'IA pour gagner en rapidité, mais le signalent clairement.

Les clients continuent à leur faire confiance. Le contenu s'améliore. L'IA s'occupe de la routine, les humains s'occupent de la perspicacité.

Dans l'univers C : L'IA et les détecteurs jouent au chat et à la souris. L'IA devient presque invisible. Les détecteurs de contenu de l'IA cessent de fonctionner.

Et vous savez quoi ? Nous vivons dans les trois univers à la fois :

- Chaque fois que vous publiez des informations non vérifiées sur l'IA → vous êtes dans l'illégalité A.

- Lorsque vous utilisez la détection de manière intelligente → vous êtes dans le coup. B.

- Lorsque vous ignorez la détection → vous risquez C.

Dans ce blog, nous examinerons le fonctionnement de la détection par l'IA, ses limites et la manière dont votre entreprise peut élaborer des politiques intelligentes pour rester dans l'univers B et éviter les ennuis.

Plongeons dans le vif du sujet.

Principaux enseignements

- La détection de contenu par l'IA n'est que 60-90% précise, mais sa véritable force réside dans la gestion des risques, de la confiance et de la conformité.

- L'IA incontrôlée érode la confiance, la détection stratégique la maintient, et ignorer la détection risque de provoquer le chaos. Les entreprises intelligentes choisissent la détection.

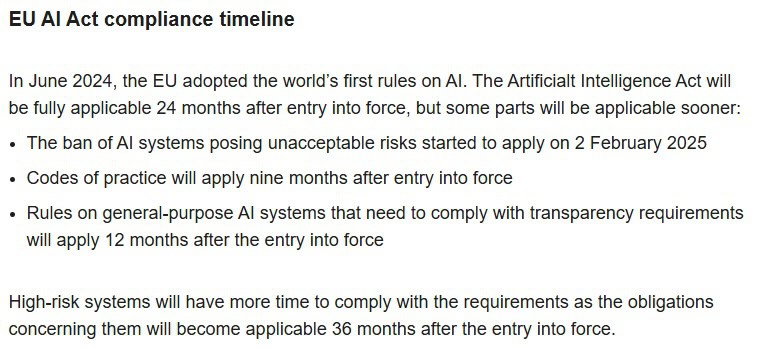

- La loi européenne sur l'IA exige la divulgation d'informations, et la réparation des dommages causés à la marque coûte beaucoup plus cher que la prévention.

- Les consommateurs veulent des contenus étiquetés par l'IA, et la divulgation d'informations sous contrôle humain renforce la crédibilité.

- La détection de contenu par l'IA ne fonctionne que si elle est liée à des politiques claires, à des points de contrôle, à des voies d'escalade et à la formation.

Qu'est-ce que la détection de contenu par l'IA ?

- Définition et aperçu technique

La détection de contenu par l'IA consiste à vérifier si un texte a été écrit par une personne ou créé par un outil d'IA.

Les détecteurs de contenu d'IA fonctionnent en recherchant de minuscules "empreintes digitales" qui révèlent l'écriture d'une machine.

- Empreintes digitales de l'IA → De petits indices dans le choix des mots, le déroulement des phrases et la structure qui ne correspondent pas tout à fait à la façon dont les gens écrivent naturellement.

Les humains ajoutent de la mémoire, de l'émotion et de l'intention à leurs paroles. L'IA ne le fait pas. Elle se contente de prédire le mot suivant le plus probable.

Ne vous inquiétez plus jamais de la détection de vos messages par l'IA. Undetectable AI peut vous aider :

- Faites apparaître votre écriture assistée par l'IA à l'image de l'homme.

- By-pass tous les principaux outils de détection de l'IA en un seul clic.

- Utilisation AI en toute sécurité et en toute confiance à l'école et au travail.

C'est pourquoi les textes de l'IA peuvent sembler un peu trop lisses et manquer du mélange naturel de rythmes que l'on trouve dans les textes humains.

Pour ce faire, les détecteurs se concentrent sur deux signaux principaux :

- Perplexité → Le degré de prévisibilité du texte. Si chaque mot semble évident, il s'agit probablement d'IA.

- Burstiness → La variation de la longueur des phrases. Les humains mélangent naturellement les phrases courtes et les phrases longues, tandis que l'IA a tendance à les uniformiser.

Exemple :

Un être humain pourrait écrire, "C'est énorme. Vraiment énorme. Et ça change tout." L'IA est plus susceptible d'écrire, "Il s'agit d'une évolution importante qui modifiera de nombreux aspects de notre vie.

- Fonctionnement des détecteurs d'IA (filigranes, motifs statistiques, etc.)

Les outils modernes de détection de contenu d'IA utilisent deux méthodes pour identifier le contenu généré par l'IA :

Méthode # 1 : détecteurs basés sur des règles :

Ils recherchent des modèles fixes, tels que des phrases répétées. Les méthodes les plus courantes sont les suivantes :

- Filigrane → Les modèles d'IA intègrent les "vert" ou "rouge" le choix des mots dans le texte.

- Analyse stylométrique → Il vérifie la longueur des phrases, la diversité du vocabulaire et l'uniformité du style.

- Contrôles de cohérence sémantique → Les humains se promènent, ajoutent des commentaires ou racontent des histoires. L'IA reste trop parfaitement sur la bonne voie.

- Analyse de N-grammes → Décompose le texte en groupes de mots courts pour vérifier si les phrases correspondent à des modèles d'intelligence artificielle courants.

Exemple de ce qui est signalé :

- Chaque phrase a la même longueur.

- Pas de pronoms personnels ni de bizarreries humaines.

- Utilisation abondante de transitions telles que "en outre" ou "de plus".

Méthode # 2 : Détecteurs à réseau neuronal:

Au lieu de règles, ils sont formés à partir de vastes ensembles d'écrits humains et d'IA.

Cela leur permet de repérer des schémas subtils que les gens ne remarqueraient pas. Les méthodes les plus courantes sont les suivantes :

- Analyse de l'attention du transformateur → Étudier comment les modèles d'IA "focus" sur les mots lors de la génération du texte, révélant ainsi des modèles uniques.

- Signaux statistiques → Trouve des textes trop prévisibles ou trop uniformes par rapport à l'écriture humaine.

- Approches d'ensemble → Combine plusieurs modèles neuronaux (et parfois des vérifications basées sur des règles) pour une plus grande précision.

Points forts :

- Plus adaptables que les systèmes basés sur des règles.

- Permet de repérer les textes subtils de l'IA qui n'enfreignent pas les règles évidentes.

Quelle est l'efficacité de ces méthodes ?

La précision des outils actuels de détection de contenu par l'IA se situe généralement entre 60% et 90%, les performances variant en fonction du type de contenu et du contexte.

Limites de la technologie de détection actuelle

Les outils de détection de contenu par l'IA ont fait de grands progrès, mais ils sont encore loin d'être parfaits.

En fait, ils sont confrontés à plusieurs défis importants que les entreprises doivent comprendre.

- Faiblesse de la paraphrase

Une réécriture ou une paraphrase rapide peut tromper les détecteurs. Exemple :

- "Le chat s'est assis sur le tapis" → "Le chat s'est assis sur le tapis".

Pour les humains, le sens est le même, mais pour un détecteur, il semble "nouveau".

- Points aveugles du domaine

Les domaines très structurés, comme la rédaction juridique, médicale ou technique, ressemblent naturellement à des textes d'IA. Cela peut déclencher de fausses alertes, même lorsque le contenu est entièrement rédigé par un être humain.

- Lacunes linguistiques

La plupart des détecteurs de contenu d'IA sont formés principalement en langue anglaise. Leurs performances sont souvent médiocres dans des contextes multilingues ou régionaux.

Les auteurs dont l'anglais n'est pas la langue maternelle sont parfois signalés comme étant des IA parce que leur style ne correspond pas aux "irrégularités" des locuteurs natifs.

- Sensibilité de la version

Un détecteur réglé pour GPT-3.5 peut échouer sur GPT-4 ou Claude, car chaque modèle présente des particularités uniques. Ce qui ressemble à de l'IA dans un modèle peut passer pour de l'humain lorsqu'il est écrit par un autre modèle.

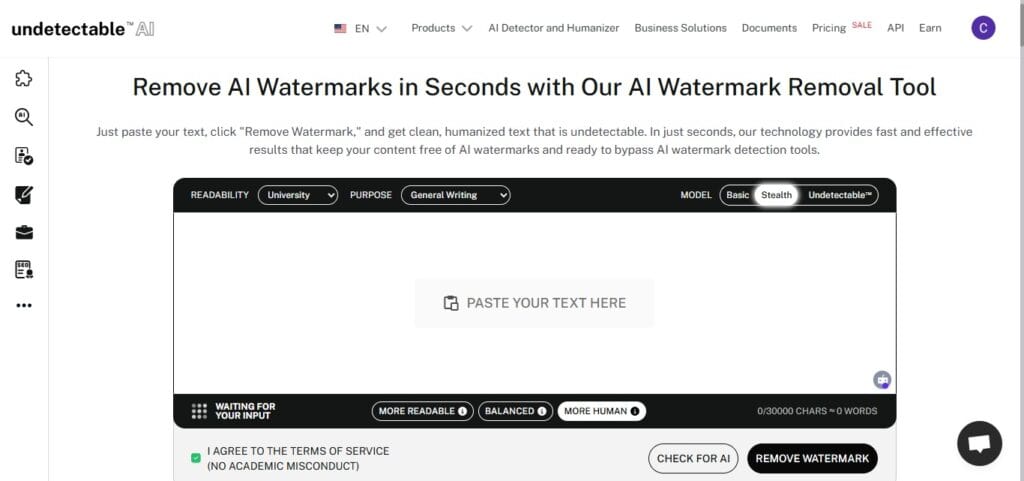

- Fragilité du filigrane

Les filigranes d'IA (motifs de jetons cachés) peuvent être "délavé" si le texte est :

- Copié dans un autre format

- Reformaté

- Légèrement paraphrasé

Le filigrane n'est donc pas fiable en tant que seule mesure de protection.

Pour les équipes chargées de réviser ou d'affiner les textes générés par l'IA, le logiciel Undetectable AI's Suppression du filigrane du texte AI peut aider à éliminer les identificateurs d'IA cachés qui pourraient déclencher des systèmes de détection automatisés.

Il rétablit la lisibilité et le ton naturels du contenu, ce qui permet aux entreprises de revérifier, d'éditer et d'approuver plus facilement le texte sans drapeaux inutiles.

Pourquoi les entreprises ont-elles besoin de la détection de l'IA ?

Les entreprises ont besoin de la détection de contenu par l'IA pour les six raisons suivantes :

- Conformité réglementaire

La loi européenne sur l'IA (2024-25) stipule que si une entreprise utilise l'IA pour créer ou modifier du contenu, elle doit l'indiquer clairement. Les seules exceptions concernent des éléments tels que l'art ou la satire.

Le nouvel office européen de l'IA publiera également des règles sur la présentation de cet étiquetage.

Pour rester en sécurité, les entreprises ont besoin d'un système de détection capable de prouver que l'IA a été utilisée.

- Intégrité de la marque

Les entreprises ont déjà été échaudées par l'utilisation imprudente de l'IA :

- CNET a dû corriger et réécrire des dizaines d'articles financiers rédigés par l'IA après que des plagiats et des erreurs ont été révélés.

- DPD, une société de livraison, a fermé son chatbot après qu'il a commencé à insulter les clients.

- WIROUGE et Business Insider a retiré des articles liés à un "pigiste en IA" suspect.

Chacune d'entre elles s'est transformée en un embarras public et en un fait divers.

Une fois la confiance rompue, la réparer coûte bien plus cher que de prévenir le problème dès le départ.

Lancement d'un nouvel outil ou d'une nouvelle plate-forme axé(e) sur la détection ?

Nos IA indétectables Générateur de noms d'entreprise vous aide à créer instantanément des noms de marque distinctifs et dignes de confiance qui communiquent la transparence et la crédibilité - ce qui est essentiel pour les solutions basées sur l'IA et la conformité.

- Contrôle de la qualité

Les textes d'IA manquent souvent d'authenticité. La moitié des consommateurs peuvent déjà s'en apercevoir et plus de la moitié d'entre eux se désengagent lorsqu'ils s'en aperçoivent.

Une fois divulguée, la détection de contenu par l'IA est jugée moins originale et moins profonde sur le plan émotionnel.

La détection permet d'identifier rapidement les faiblesses d'un texte afin que les humains puissent le peaufiner avant sa publication.

- Veille concurrentielle

De nombreuses marques utilisent désormais l'IA dans le marketing et l'édition, comme par exemple entreprises de mode avec Firefly pour les actifs, les médias testant des articles rédigés par l'IA.

La détection de contenu par l'IA dans les blogs, les rapports ou les publicités des concurrents révèle à quel point ils s'appuient sur l'automatisation, où la créativité humaine vous donne encore un avantage, et comment affiner votre positionnement.

- Implications en termes de coûts

Les erreurs d'IA non détectées peuvent rapidement coûter cher. Les fausses citations déclenchent des risques juridiques, des incendies de relations publiques, des retraits et des rétractations qui érodent la confiance.

Une seule atteinte à la réputation peut anéantir la valeur du marché du jour au lendemain.

Il est beaucoup moins coûteux d'empêcher la détection, l'acheminement et l'examen du contenu par l'IA que de faire le ménage après une crise.

- Confiance des parties prenantes

Les consommateurs et les investisseurs exigent de plus en plus de clarté.

Les enquêtes montrent que près de 90% veulent Le contenu généré par l'IA est étiqueté et le scepticisme à l'égard des informations en ligne augmente.

Les études sur les publicités confirment que la divulgation, si elle est bien faite, maintient la confiance, mais qu'une divulgation bâclée l'érode. Un système cohérent de détection et de divulgation est le seul moyen évolutif de prouver une utilisation responsable.

Détecteur d'IA et humanisateur est un outil de détection de contenu et d'humanisation de l'IA qui peut simplement rester en arrière-plan et aider les équipes à repérer et à corriger les textes signalés avant qu'ils ne soient publiés.

Elle permet de préserver la confiance sans ralentir le travail.

Cas d'utilisation courants pour la détection de l'IA dans les entreprises

- Révision du contenu marketing

Les outils de détection de contenu par l'IA peuvent passer au crible les flux de travail marketing à grande échelle. Par exemple :

- Les campagnes de courrier électronique peuvent être vérifiées pour s'assurer que les lignes d'objet ne sont pas des sorties génériques d'IA,

- Les messages sur les médias sociaux peuvent être vérifiés afin d'éviter les "appâts d'engagement" automatisés.

- Le texte d'un site web peut être signalé s'il est trop formel,

- Le texte de la publicité peut être vérifié pour s'assurer qu'il est conforme aux règles de la FTC,

- Valider la communication de l'entreprise

En 2023, CNET a dû publier des corrections massives après s'être appuyé sur l'IA pour des articles financiers. Cet incident a montré à quel point un texte d'IA non détecté peut être risqué.

Le même risque s'applique à la communication d'entreprise, aux relations avec les investisseurs et aux déclarations des dirigeants.

La détection de contenu par l'IA agit comme un garde-fou qui permet de s'assurer que ces messages à fort enjeu restent exacts, authentiques et humains.

Lorsque les projets signalés ont besoin d'être affinés, Rédacteur furtif de l'IA peut les transformer en communications indétectables et sûres.

- Contrôle du contenu généré par les utilisateurs

Amazon est aux prises avec de faux avis générés par l'intelligence artificielle. Cela montre à quel point la confiance peut s'éroder facilement lorsque l'authenticité n'est pas garantie.

Les outils de détection de contenu par l'IA peuvent intervenir pour vérifier que les avis des clients sont authentiques, éviter que les forums ne contiennent des messages spammy de l'IA et s'assurer que les témoignages proviennent bien d'expériences réelles.

Et si le contenu doit être retravaillé plutôt que supprimé, Rédacteur furtif de l'IA le rend transparent. Il :

- Le texte de l'IA s'affine et prend un ton naturel et humain

- Veiller à la cohérence de la voix de la marque sur l'ensemble des canaux

- Polir le contenu pour qu'il reste indétectable

- Vérification de l'originalité des documents de formation interne

Le contenu de la formation interne explique comment les employés apprennent, travaillent et représentent l'entreprise. Si ce matériel s'appuie trop fortement sur l'IA, il peut créer des risques.

La détection garantit que ces documents restent originaux, précis et humains, afin que les employés puissent se fier à ce qu'ils lisent et appliquent dans leur travail quotidien.

Les défis auxquels les entreprises sont confrontées avec le contenu de l'IA

Les entreprises pourraient être confrontées à ces défis avec le contenu de l'IA :

- Traînée d'intégration - Les liens avec les API et les processus de traitement par lots ralentissent l'adoption.

- Interruptions du flux de travail - Les outils de détection perturbent les flux d'approbation habituels.

- Lacunes en matière de formation - Les équipes piétinent sans avoir de mesures claires à prendre concernant les contenus signalés.

- Faux positifs - Perte de temps et de confiance lorsque le contenu réel est signalé.

- Résultats incohérents - Difficile d'aligner le courrier électronique, le web et les réseaux sociaux.

- Doutes sur le retour sur investissement - En l'absence de mesures claires, la détection semble être une dépense risquée.

Comment élaborer une politique interne autour du contenu de l'IA

Une fois que vous avez compris ce qu'est la détection de contenu par l'IA, l'étape suivante pour toute entreprise est de créer une politique claire.

Voici les six étapes nécessaires à l'élaboration d'une politique interne efficace en matière de contenu IA :

- Définir l'utilisation acceptable ou restreinte de l'IA

La première étape de toute politique de contenu IA consiste à clarifier ce qui est autorisé et ce qui est interdit.

| Utilisation acceptableDomaines dans lesquels l'IA peut être utile mais ne comporte pas de risque élevé : [SECTEUR 1][SECTEUR 2][SECTEUR 3] | Usage restreintZones à haut risque où la production d'IA doit être soigneusement contrôlée ou évitée : [SECTEUR 1][SECTEUR 2][SECTEUR 3] |

- Établir des points de contrôle

Fixez 2 ou 3 points de contrôle dans les équipes concernées, telles que le marketing, le service juridique et la communication, afin de vous assurer que le contenu généré par l'IA est correctement examiné avant d'être publié ou partagé.

- Sélection et intégration des outils de détection

Choisissez des outils d'IA adaptés à votre flux de travail. Intégrez-les dans les pipelines de contenu pour que la détection se fasse avant la distribution.

- Créer une voie d'escalade

Définir ce qui se passe lorsqu'un contenu est signalé :

- Qui l'examine ?

- Qui approuve les révisions ?

- Quand faire appel aux équipes juridiques ou de conformité.

- Former les employés

Sensibiliser les équipes :

- Utilisation responsable de l'IA

- Fonctionnement des détecteurs

- Comment réviser le contenu de l'IA pour assurer la conformité et l'expression de la marque ?

- Vérifier et affiner les politiques tous les trimestres

Examiner les schémas d'utilisation et les contenus signalés. Mettre à jour les politiques pour refléter les nouveaux outils de détection de contenu d'IA, les changements de modèle ou les exigences réglementaires.

Exemple :

| Secteur bancaire | Marque de consommateur |

| Faible tolérance. L'IA ne peut être utilisée que pour les projets, tous les contenus destinés aux clients doivent être revus. | Tolérance plus élevée. L'IA peut créer des posts sociaux ou des textes publicitaires avec une légère supervision. |

Veillez à ce que votre politique s'aligne sur les cadres de conformité de l'industrie, tels que

- GDPR → Obligations en matière de protection de la vie privée

- Règles de la SEC → Normes de publicité pour les communications financières

Découvrez la puissance de notre détecteur d'IA et de notre humanisateur dans le widget ci-dessous !

Réflexions finales

Les outils de détection de l'IA ne sont pas parfaits et n'ont pas besoin de l'être.

Leur objectif est de protéger la confiance, d'assurer la conformité des entreprises et de prévenir les atteintes à la réputation qui sont pratiquement impossibles à réparer.

Alors que l'IA continue de se perfectionner, les véritables gagnants seront les entreprises qui la gèrent avec intention.

La détection ne consiste pas seulement à signaler l'IA, mais aussi à montrer aux clients et aux parties prenantes que vous accordez de l'importance à la transparence et à la responsabilité.

Ceux qui choisissent de l'ignorer ? Ils jouent avec la confiance, la réputation et l'avenir.

La démarche la plus intelligente est claire : faites de la détection de contenu par l'IA un élément central de votre stratégie, ou risquez d'être laissé pour compte.

Avant de le faire, tirez parti des fonctionnalités de l'IA indétectable. Détecteur d'IA et humanisateur pour vérifier et humaniser le contenu afin d'en maximiser l'authenticité, et utiliser l'outil d'évaluation de la qualité de l'information. Rédacteur furtif de l'IA pour produire un texte original et indétectable qui correspond à la voix de votre marque.

Le choix intelligent est clair : intégrer la détection dans votre stratégie de base ou risquer d'être distancé.

Commencer à utiliser IA indétectable aujourd'hui pour rester conforme, digne de confiance et en avance sur la concurrence.