Le terme deepfake est apparu pour la première fois sur Reddit en 2017La Commission européenne a lancé une campagne de sensibilisation à l'égard de l'Internet, lorsqu'un utilisateur portant le même pseudonyme a commencé à partager des vidéos modifiées utilisant l'IA pour échanger des visages, initialement dans des contenus pour adultes.

Bien que Reddit ait interdit le subreddit original, l'idée avait déjà fait son chemin.

Mais les racines de cette technologie remontent encore plus loin.

En 1997, des chercheurs avaient déjà commencé à expérimenter le montage vidéo par l'apprentissage automatique.

Leur premier outil de synchronisation des lèvres, appelé Réécriture de la vidéo peut faire croire que quelqu'un a dit quelque chose qu'il n'a pas dit.

Il ne s'agissait pas techniquement d'un deepfake selon les normes actuelles, mais il a jeté les bases de ce qui allait suivre.

Le blog d'aujourd'hui traite du fonctionnement de cette technologie en constante évolution, de son utilisation dans la vie quotidienne et des risques et avantages qu'elle comporte.

Commençons par comprendre ce qu'est un deepfake.

Principaux enseignements :

- Les "deepfakes" sont des médias générés par l'IA qui donnent l'impression que les gens disent ou font des choses qu'ils n'ont jamais faites en réalité.

- Avec des outils gratuits et des compétences de base, presque tout le monde peut désormais créer des vidéos, des images ou des clips audio deepfake convaincants.

- Si les "deepfakes" peuvent être créatifs ou divertissants, ils présentent également des risques sérieux tels que l'escroquerie, la diffamation et la désinformation.

- Vous pouvez repérer la plupart des deepfakes en utilisant des outils de détection ou en observant attentivement les incohérences visuelles et comportementales.

Qu'est-ce qu'un Deepfake ?

Un deepfake est un faux média, généralement une vidéo, un clip audio ou une image, qui a été modifié à l'aide d'une intelligence artificielle pour donner l'impression qu'une personne fait ou dit quelque chose qu'elle n'a jamais fait en réalité.

Il ne faut pas croire qu'il s'agit d'un mauvais travail de Photoshop ou d'une voix off peu convaincante.

Il s'agit d'une manipulation de haut niveau utilisant une technologie appelée apprentissage profond, qui est un sous-ensemble de l'IA.

Ne vous inquiétez plus jamais de la détection de vos messages par l'IA. Undetectable AI peut vous aider :

- Faites apparaître votre écriture assistée par l'IA à l'image de l'homme.

- By-pass tous les principaux outils de détection de l'IA en un seul clic.

- Utilisation AI en toute sécurité et en toute confiance à l'école et au travail.

C'est ce qu'implique le terme "deepfake" : apprentissage profond et faux contenu.

L'objectif d'un deepfake est généralement de créer quelque chose qui semble suffisamment réel pour tromper les gens.

Maybe you’ve seen those viral videos of celebrities doing bizarre things or politicians making outrageous statements they’d never actually say.

Il s'agit là de cas classiques d'utilisation de deepfake. Ce que vous voyez n'est pas réel, mais la technologie sous-jacente est devenue suffisamment performante pour que votre cerveau ne détecte pas immédiatement la fausseté, à moins que vous ne cherchiez vraiment.

C'est là que des outils comme TruthScan en marche.

TruthScan est conçu pour les organisations qui ont besoin de vérifier les médias à grande échelle - entreprises, salles de presse, universités et organismes publics. Il aide les équipes à repérer les manipulations avant que les faux contenus ne nuisent à la confiance ou à la réputation.

En fait, selon l'équipe de recherche d'Undetectable AI, 85 % des Américains déclarent que les "deepfakes" ont érodé leur confiance dans les informations en ligne.

Vous venez d'apprendre ce qu'est une vidéo ou un média deepfake, voyons maintenant comment les gens les fabriquent.

Comment sont fabriqués les Deepfakes

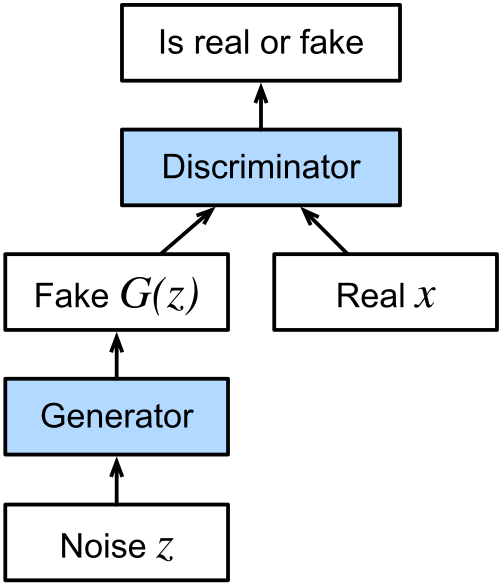

La technologie qui sous-tend la plupart des deepfakes est une catégorie d'algorithmes d'apprentissage automatique appelés réseaux adversaires génératifs (GAN).

Les GAN sont constitués de deux parties : un générateur et un discriminateur.

Le générateur crée de faux médias sur la base de ce qu'il a été entraîné à reproduire, et le discriminateur a pour tâche d'identifier ce qui semble faux.

Ils continuent d'aller et venir jusqu'à ce que le générateur devienne meilleur dans la création de faux contenus qui peuvent passer le test du discriminateur.

Au fil du temps, ce va-et-vient aboutit à des médias qui paraissent étonnamment réalistes.

Qu'est-ce qu'un processus de génération de fausses vidéos ?

Lors de la création d'une vidéo "deepfake", le système analyse les vidéos sous plusieurs angles, étudie la façon dont la personne parle, les mouvements de son visage et de son corps.

Toutes ces informations sont introduites dans le générateur afin qu'il puisse créer un contenu qui imite ces comportements.

Ensuite, le discriminateur aide à l'affiner en signalant ce qui ne va pas jusqu'à ce que le résultat final soit parfait.

C'est pourquoi l'illusion tient si bien en mouvement.

Différentes techniques sont utilisées en fonction de l'objectif de la vidéo "deepfake".

Si l'idée est de faire en sorte que quelqu'un semble dire ou faire quelque chose dans une vidéo qu'il n'a en fait jamais dit ou fait, il s'agit alors de ce que l'on appelle un deepfake de vidéo source.

Un autoencodeur de deepfake, composé d'un encodeur et d'un décodeur, étudie la séquence originale et y applique les expressions, les gestes et les mouvements subtils de la tête de la cible.

Audio Deepfakes

Un deepfake audio consiste à cloner la voix d'une personne, toujours à l'aide de GAN, sur la base d'enregistrements de la façon dont elle parle naturellement.

Une fois entraîné, le modèle peut générer un nouveau discours dans cette voix, même si la personne n'a jamais prononcé ces mots.

Une autre couche souvent ajoutée est la synchronisation labiale.

Dans ce cas, le système fait correspondre un son généré ou préenregistré à une vidéo.

L'objectif est de faire correspondre les lèvres de la vidéo aux mots de l'audio.

Exemples concrets de "deepfakes

Les "deepfakes" sont omniprésents ces jours-ci.

Nous allons vous présenter quelques deepfakes populaires qui montrent à quel point la technologie a évolué.

Le Deepfake du président Zelenskyy demandant aux troupes ukrainiennes de se rendre

En mars 2022, au début de la guerre entre la Russie et l'Ukraine, une vidéo a fait surface en ligne. montrant le président ukrainien Volodymyr Zelenskyy et exhorte ses soldats à se rendre.

On aurait dit un discours national, avec la voix et les manières de Zelenskyy.

La vidéo s'est répandue sur les réseaux sociaux et a même été publiée sur un site d'information ukrainien compromis.

Le président a réagi rapidement et a publié une déclaration officielle par l'intermédiaire de ses canaux vérifiés afin de démentir les images.

L'image virale Deepfake du pape François dans un blouson bouffant de marque

Parfois, une image falsifiée n'a pas besoin d'être malveillante pour semer la confusion.

En 2023, une photo virale de Le pape François se promène dans une élégante veste blanche Balenciaga. a pris l'internet d'assaut.

Elle a été visionnée des dizaines de millions de fois et a été largement partagée sur toutes les plateformes.

L'image a été créée à l'aide d'un outil d'intelligence artificielle appelé Midjourney par un utilisateur anonyme de Chicago.

Les Deepfakes d'Elon Musk utilisés dans les escroqueries en ligne

En 2024, deepfakes avec Elon Musk est devenu un élément central de plusieurs escroqueries en ligne à grande échelle.

Des vidéos de Musk générées par l'IA ont commencé à apparaître sur Facebook, TikTok et d'autres plateformes, faisant la promotion de faux cadeaux en crypto-monnaie et de plans d'investissement.

Ces clips semblaient et semblaient remarquablement réels.

Les dégâts ne sont pas seulement théoriques. Un retraité âgé aurait perdu près de $700 000 après s'être laissé convaincre par l'une de ces vidéos.

L'appel téléphonique de Joe Biden qui a ciblé les électeurs américains

Début 2024, juste avant les primaires du New Hampshire, électeurs ont reçu des appels téléphoniques non sollicités qui ressemblait à s'y méprendre au président américain Joe Biden.

Lors de cet appel, Joe Biden a exhorté les électeurs à rester chez eux et à réserver leur vote pour les élections générales de novembre. L'intention était de semer la confusion et d'induire les électeurs en erreur pour qu'ils ne participent pas aux élections primaires.

L'incident a déclenché des appels à la réglementation. Les groupes de pression ont demandé à la Commission électorale fédérale des États-Unis d'intervenir, mais celle-ci a finalement refusé, citant les limites de son autorité.

Entre-temps, l'entreprise de télécommunications responsable de la diffusion du robocall a accepté de payer une amende de $1 million d'euros.

Utilisation de Deepfake politiques lors des élections indiennes de 2020

Toutes les utilisations de la technologie deepfake ne sont pas nuisibles ou trompeuses (nous reviendrons sur ce point plus loin dans ce blog).

Lors de l'élection de l'assemblée législative de Delhi en 2020, le Le Bharatiya Janata Party a utilisé l'IA pour adapter une publicité de campagne pour des publics linguistiques différents.

Le parti a pris une vidéo de son dirigeant Manoj Tiwari s'exprimant en anglais et a eu recours à une fausse synchronisation labiale pour produire une version en haryanvi, un dialecte régional.

Alors que la voix off provenait d'un acteur, les images ont été modifiées pour correspondre au nouveau son grâce à une IA entraînée à partir d'images réelles de Tiwari.

Les membres du parti y ont vu une application positive de la technologie qui leur permettait d'entrer en contact avec les électeurs dans une langue qu'ils comprenaient, même si le candidat ne la parlait pas couramment.

Comment vérifier les "deepfakes" dans le monde réel ?

Avec la propagation des deepfakes dans la politique, le divertissement et la communication quotidienne, il n'a jamais été aussi important de savoir comment vérifier la véracité d'une information.

Malgré la multiplication des exemples sophistiqués, il existe des outils fiables pour contrer la menace que représente la technologie deepfake.

IA indétectables Détecteur vidéo IA est l'un de ces outils, démontrant qu'il existe des outils fiables pour contrer les exemples sophistiqués de technologie deepfake.

C'est là qu'intervient Undetectable AI. Détection de fausses informations (Deepfake) arrive.

Il est conçu pour vérifier si le contenu audio ou vidéo a été généré artificiellementLa recherche de l'image et de la voix, en utilisant des modèles médico-légaux avancés qui analysent le mouvement image par image, la cohérence au niveau du pixel et l'empreinte vocale.

En quelques secondes, les utilisateurs peuvent voir si une vidéo a été modifiée numériquement ou si une voix a été clonée par l'IA.

Il suffit de télécharger le fichier et l'outil fournit un rapport d'authenticité détaillé avec une ventilation visuelle et un indice de confiance.

Qu'il s'agisse d'un clip viral, d'une interview suspecte ou d'un enregistrement partagé, Deepfake Detection aide les journalistes, les éducateurs et les utilisateurs quotidiens à découvrir la vérité derrière ce qu'ils voient et entendent.

Les Deepfakes sont-ils dangereux ? Risques et inquiétudes

Jusqu'à présent, nous avons examiné ce qu'est un deepfake, comment il est fabriqué et où il est déjà apparu dans le monde réel.

La technologie est indéniablement impressionnante, mais les risques qui y sont liés sont sérieux et augmentent rapidement.

Les "deepfakes" peuvent être utilisés de multiples façons. Voici quelques-unes des principales préoccupations.

Diffamation

Lorsque l'image ou la voix d'une personne est utilisée pour créer de fausses remarques, déclarations ou vidéos, en particulier celles qui sont offensantes ou controversées, cela peut ruiner la réputation presque instantanément.

Et contrairement aux anciens canulars ou aux fausses citations, un deepfake convaincant laisse peu de place au doute dans l'esprit du spectateur.

À cet égard, les "deepfakes" peuvent susciter l'indignation, détruire des relations ou simplement faire avancer un récit préjudiciable.

Ce qui est particulièrement inquiétant, c'est que le deepfake n'a même pas besoin d'être parfait.

Tant que la personne est reconnaissable et que le contenu est suffisamment crédible, cela peut avoir un impact durable sur l'opinion publique.

Crédibilité de l'information

Une autre préoccupation majeure est la façon dont les deepfakes sapent l'idée même de vérité.

Avec la multiplication des "deepfakes", il devient de plus en plus difficile de savoir si ce que l'on voit ou entend est réel. Avec le temps, cela pourrait conduire à une plus grande érosion de la confiance dans toute forme de communication numérique.

Cette crise de crédibilité va au-delà des incidents individuels.

Dans les sociétés démocratiques, les gens s'appuient sur des faits partagés pour prendre des décisions, débattre de questions et résoudre des problèmes collectifs.

Mais si les électeurs, les téléspectateurs ou les citoyens commencent à tout remettre en question, il devient beaucoup plus facile de manipuler l'opinion publique ou de rejeter les vérités qui dérangent en les qualifiant de "nouvelles supercheries".

Chantage

Les médias générés par l'IA peuvent être utilisés pour incriminer faussement des individus en faisant croire qu'ils ont fait quelque chose d'illégal, de contraire à l'éthique ou d'embarrassant.

Ce type de preuves fabriquées peut ensuite être utilisé pour les menacer ou les contrôler.

Et cela va dans les deux sens. Les "deepfakes" étant désormais si réalistes, une personne confrontée à un véritable chantage pourrait prétendre que la preuve est fausse, même si ce n'est pas le cas.

C'est ce que l'on appelle parfois l'inflation du chantage, où le simple volume de faux crédibles finit par réduire la valeur des éléments incriminants réels.

La crédibilité des preuves réelles se perd dans le brouillard, ce qui ne fait qu'ajouter une couche de complexité supplémentaire lorsqu'il s'agit de dénoncer des actes répréhensibles.

Fraude et escroquerie

En utilisant des vidéos générées par l'IA ou des voix de personnalités de confiance, les fraudeurs créent des stratagèmes incroyablement convaincants.

Dans certains cas, des "deepfakes" de célébrités comme Elon Musk, Tom Hanks ou Oprah Winfrey sont utilisés pour promouvoir des produits ou des services dont ils n'ont jamais entendu parler.

Ces vidéos sont ensuite diffusées sur les plateformes sociales, où elles atteignent des millions de personnes.

Même les particuliers sont en danger, en particulier dans les campagnes de spearphishing qui ciblent des personnes spécifiques avec un contenu personnalisé destiné à les manipuler ou à les tromper.

Selon un 2024 rapport de ForbesLes fraudes basées sur les "deepfakes" ont déjà entraîné des pertes mondiales estimées à $12 milliards d'euros, et ce chiffre devrait plus que tripler au cours des prochaines années.

C'est pourquoi la détection n'est pas réservée aux particuliers. Elle est essentielle pour les entreprises qui traitent des données sensibles, des communications ou du contenu public. TruthScan aide ces organisations à identifier les vidéos modifiées avant que la désinformation ne se propage.

Utilisations positives et créatives des Deepfakes

Il convient de noter que toutes les applications de la technologie ne sont pas négatives.

Alors que de nombreux blogs expliquant ce qu'est un deepfake se concentrent sur les abus, il existe une liste croissante de façons créatives et productives d'utiliser les deepfakes.

Néanmoins, pour les entreprises, même les utilisations artistiques ou marketing des deepfakes doivent être vérifiées avant leur diffusion.

Des outils tels que TruthScan peuvent confirmer qu'aucune manipulation involontaire ne subsiste dans la version finale.

Voici quelques exemples notables.

Films et représentations théâtrales

Les studios commencent à s'appuyer sur la technologie du "deepfake" pour des choses telles que :

- Amélioration des effets visuels

- Réduction des coûts de production

- Faire revenir des personnages disparus

Disneypar exemple, a perfectionné des modèles d'imitations profondes à haute résolution qui permettent d'échanger les visages et de vieillir les acteurs avec un réalisme impressionnant.

Leur technologie fonctionne à une résolution de 1024 x 1024 et peut suivre avec précision les expressions faciales afin de rajeunir les personnages ou de les rendre plus expressifs.

Au-delà d'Hollywood, les "deepfakes" ont permis de mener des campagnes mondiales, comme lorsque David Beckham a été cloné numériquement pour diffuser un message de santé dans plusieurs langues.

L'art

En 2018, l'artiste multimédia Joseph Ayerle a utilisé la technologie deepfake pour créer un acteur IA qui mélangeait le visage de la star de cinéma italienne Ornella Muti avec le corps de Kendall Jenner.

Le résultat est une exploration surréaliste de l'identité générationnelle et une provocation artistique, qui fait partie d'une œuvre vidéo intitulée Un'emozione per sempre 2.0.

Les "deepfakes" ont également fait leur apparition dans les satires et les parodies.

La web-série Sassy Justice, créée par les créateurs de South Park, Trey Parker et Matt Stone, en est un excellent exemple.

Elle utilisait des personnalités publiques "deepfakées" pour se moquer de l'actualité tout en sensibilisant à la technologie elle-même.

Service clientèle

En dehors des industries créatives, les entreprises trouvent une utilité aux deepfakes pour les services en contact avec la clientèle.

Certains centres d'appel utilisent désormais des voix synthétiques alimentées par la technologie deepfake pour automatiser les demandes de base, telles que les demandes de renseignements sur les comptes ou l'enregistrement des plaintes.

Dans ces cas, l'intention n'est pas malveillante, mais simplement de rationaliser.

Les systèmes de réponse aux appels peuvent être personnalisés à l'aide de voix générées par l'IA afin de rendre les services automatisés plus naturels et attrayants.

Les tâches traitées étant généralement peu risquées et répétitives, les "deepfakes" permettent dans ce contexte de réduire les coûts et de libérer des agents humains pour des questions plus complexes.

L'éducation

Les plateformes éducatives ont également commencé à intégrer des tuteurs alimentés par deepfake pour aider les apprenants de manière plus interactive.

Ces tuteurs pilotés par l'IA peuvent dispenser des cours à l'aide de voix synthétiques et de conseils personnalisés.

Outils et techniques de détection des fausses pistes (Deepfake)

À mesure que les "deepfakes" se perfectionnent et deviennent plus accessibles, il devient de plus en plus nécessaire de les identifier avant qu'ils ne causent des dommages.

Les personnes et les organisations ont également besoin des bons outils et des bonnes techniques pour garder une longueur d'avance. Voici donc quelques outils et techniques.

Pour une vérification centrée sur l'image, Détecteur d'images AI de TruthScan analyse l'éclairage, les motifs de pixels et les éléments composés pour repérer en temps réel les images générées ou modifiées par l'IA.

Il aide les équipes à confirmer rapidement l'authenticité des images et des vidéos avant que le contenu ne soit publié ou partagé.

TruthScan : Détection de Deepfake à l'échelle de l'entreprise

TruthScan est conçu pour les entreprises, les universités et les médias qui ont besoin de vérifier à grande échelle des contenus visuels et audio.

Il analyse l'authenticité des vidéos à travers de multiples dimensions :

- Détection de changement de visage : Identifie les traits du visage manipulés image par image.

- Empreintes comportementales : Détecte les modèles d'expression subtils et les micro-mouvements incompatibles avec le comportement humain naturel.

- Vidéo judiciaire : Examine la compression des images, le bruit des pixels et l'altération de la voix.

- Détection en temps réel : Permet la vérification en direct lors d'appels vidéo, de communiqués de presse ou de flux de diffusion.

Grâce à TruthScan, les équipes peuvent authentifier les vidéos avant leur publication ou leur diffusion publique, ce qui permet d'éviter les atteintes à la réputation et les pertes financières.

Pour les utilisateurs quotidiens, les outils d'Undetectable AI offrent une protection similaire au niveau individuel.

AI Image Detector par Undetectable AI

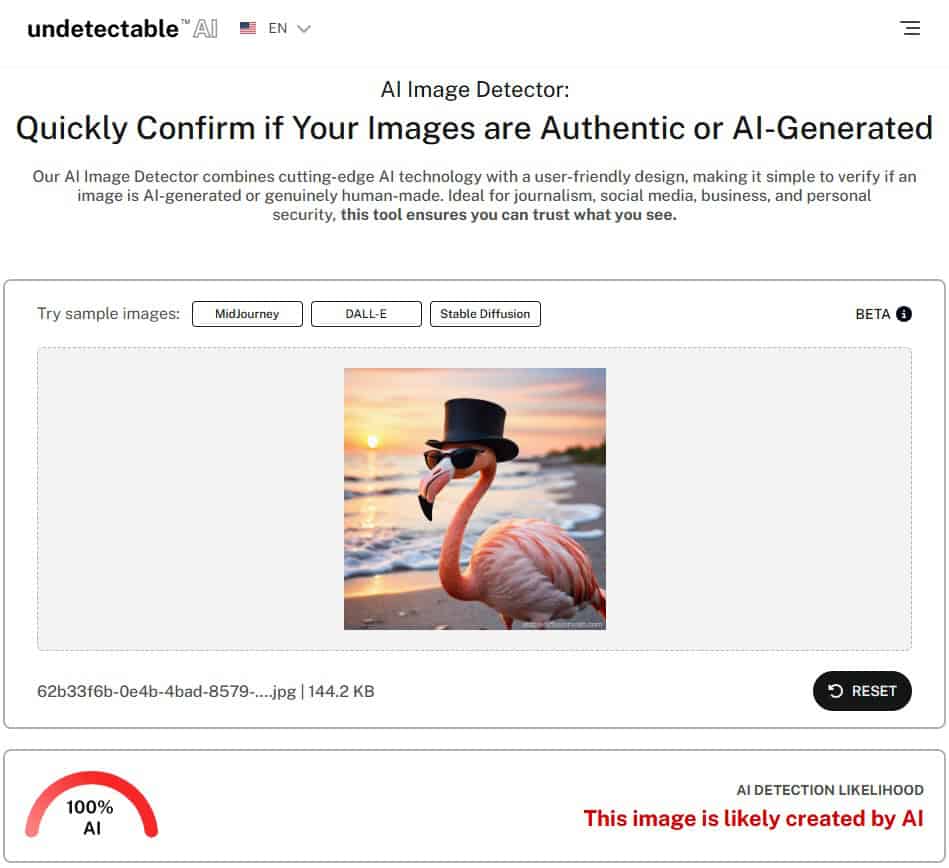

Le détecteur d'images AI d'Undetectable AI facilite la détection des deepfakes, même pour ceux qui n'ont pas de connaissances techniques.

Le détecteur fonctionne en analysant divers éléments d'une image téléchargée, tels que les motifs de couleur, les textures, les traits du visage et les incohérences structurelles.

Il prend en charge la détection des médias créés à l'aide des générateurs d'images d'IA les plus connus, tels que

- Voyage à mi-parcours

- DALL-E

- Diffusion stable

- Idéogramme

- Modèles basés sur le GAN

Pour l'utiliser, il suffit de télécharger une image, de laisser l'outil l'analyser et de recevoir un verdict clair avec une note de confiance.

Si vous n'êtes pas sûr de l'authenticité d'une image que vous avez trouvée, essayez notre Détecteur d'images AI pour vérifier s'il y a des signes d'altération de l'IA.

Maintenant, mettons Le détecteur d'IA d'Undetectable pour voir s'il est capable de dire avec précision que l'image est générée par l'IA.

Comme vous pouvez le voir, le détecteur d'IA de Undetectable AI a identifié cette image comme étant 100% générée par l'IA.

Techniques visuelles et comportementales pour la détection manuelle

Il existe également des techniques pratiques que les particuliers peuvent utiliser pour détecter manuellement les deepfakes, en particulier dans les situations où une analyse immédiate est nécessaire.

Voici quelques signaux d'alarme visuels :

- Positionnement maladroit du visage ou expressions bizarres.

- Un éclairage ou une coloration incohérente dans différentes parties de l'image ou de la vidéo.

- Scintillement autour du visage ou de la racine des cheveux, en particulier lors des mouvements.

- Absence de clignement naturel ou mouvement irrégulier des yeux.

- Divergences dans la synchronisation labiale lorsque l'audio ne correspond pas à la parole.

D'un point de vue comportemental, les deepfakes s'efforcent souvent d'imiter des traits humains subtils. Faites attention au langage corporel, aux expressions émotionnelles et aux gestes habituels.

Dans les conversations en temps réel, en particulier dans les vidéos en direct, demandez une vue de profil.

De nombreux modèles de deepfake peinent encore à rendre avec précision un angle facial de 90 degrés ou des mouvements complexes tels que tourner la tête tout en conservant des expressions naturelles.

Repérer les "deepfakes" dans le texte et le contexte

Les "deepfakes" ne se limitent pas aux images. Certaines versions impliquent un texte synthétique, une voix ou un comportement qui imite le style de communication d'une personne.

Lors de l'analyse d'un texte ou d'un dialogue, soyez attentifs aux éléments suivants :

- Fautes d'orthographe et de grammaire.

- Phrases qui semblent forcées ou qui ne s'enchaînent pas naturellement.

- Adresses électroniques inhabituelles ou formulation incohérente.

- Messages hors contexte ou sans rapport avec la situation.

Le contexte est également important. Si une vidéo ou un message apparaît dans un contexte qui n'a pas de sens, comme un homme politique annonçant nonchalamment une décision importante dans un clip de mauvaise qualité, il convient de s'interroger sur son authenticité.

Curieux de découvrir notre AI Detector et notre Humanizer ? Essayez-les dans le widget ci-dessous !

FAQ sur les Deepfakes

Les "deepfakes" sont-ils illégaux ?

Les "deepfakes" ne sont pas illégaux par défaut, mais ils peuvent l'être s'ils enfreignent des lois existantes telles que celles relatives à la diffamation, à la pédopornographie ou aux contenus explicites non consensuels.

Certains États américains ont adopté des lois visant les "deepfakes" qui influencent les élections ou impliquent du "revenge porn".

Les projets de loi fédéraux tels que la loi DEFIANCE et Loi sur les NON-FAÇONS sont également en cours pour réglementer les utilisations malveillantes de la technologie "deepfake".

Quelqu'un peut-il faire un deepfake ?

Oui, presque tout le monde peut créer un deepfake à l'aide de logiciels et d'outils d'intelligence artificielle gratuits ou peu coûteux.

De nombreuses plateformes offrent désormais des interfaces conviviales, de sorte qu'aucune compétence technique avancée n'est nécessaire pour démarrer.

Comment puis-je me protéger des "deepfakes" ?

Limitez votre exposition en évitant de mettre en ligne des images ou des vidéos de haute résolution. Utilisez les paramètres de confidentialité et les outils de détection tels que IA indétectable ou TruthScan pour vérifier tout ce qui est suspect.

Existe-t-il des applications de détection de deepfake ?

En effet, TruthScan est conçu pour les utilisateurs professionnels qui ont besoin d'analyser du contenu vidéo à grande échelle, tandis que les détecteurs d'Undetectable AI s'adressent aux particuliers et aux créateurs qui cherchent à vérifier de plus petits volumes de contenu.

Réflexions finales

Les "deepfakes" modifient notre perception de la vérité en ligne. Que vous protégiez votre marque, gériez des communications publiques ou naviguiez simplement en toute sécurité, l'utilisation des bons outils de détection fait toute la différence.

Pour les entreprises et les institutions, TruthScan offre une protection au niveau de l'entreprise contre la désinformation induite par l'IA.

Pour les particuliers, les IA indétectables Détecteur d'images AI offre un moyen simple et rapide de vérifier les images et de rester informé.

Ensemble, ils veillent à ce que ce que vous voyez et partagez reste réel.