ChatGPTのようなAIツールがより洗練され、利用しやすくなるにつれ、教育分野では差し迫った懸念が浮上している:

大学はChatGPTが作成したコンテンツを確実に検出できるのか?

本稿では、ジェネレーティブAIの台頭に対して各機関がどのように対応しているのか、2025年にはどのような検出方法が用いられているのかを検証する。

彼らが直面する課題と、学生がアカデミック・インテグリティを損なうことなく、責任を持ってAIを利用する方法。

要点

- 大学はChatGPTを検出できますが、完璧な精度ではありません。TurnitinやCopyleaksのようなツールは一般的に使用されていますが、それでも偽陽性や偽陰性が発生します。

- 生徒の過去の作品と新しい提出作品との間の矛盾を評価するには、人間によるレビューと文体分析が鍵となる。

- 検出は言語的、統計的、文脈的パターンに依存するが、高度なAIの出力はしばしば表面的な分析を回避することができる。

- 教育関係者は、検知ツールだけへの依存を減らすために、方針を更新し、口頭試験、リアルタイムの作文課題、AIを考慮した評価を採用している。

- 倫理的なAIの使用は可能であり、特に透明性、学問的誠実さ、そしてUndetectable AIのようなツールに導かれていればなおさらである。

ChatGPTは2025年に検出可能か?

ChatGPTをはじめとする大規模な言語モデルは、自然で一貫性のある、人間のようなテキストを生成する能力が飛躍的に向上した。

この進歩は、強力な教育的可能性を引き出す一方で、学生の作品の完全性を保持しようとする教育機関に新たな課題をもたらす。

ほとんどのAI検出器は大学による-TurnitinのAI検出機能を含む)。 言語パターン, 当惑そして バースト性 AIが作成した文章にフラグを立てる。

もうAIがあなたのテキストを検出する心配はありません。 Undetectable AI あなたを助けることができる:

- AIがアシストする文章を出現させる 人間らしい。

- バイパス ワンクリックですべての主要なAI検出ツール。

- 用途 AI 無事に そして 堂々 学校でも仕事でも。

しかし、これらのシステムは無謬ではない。多くの学生は、検知を回避するために、高度なツールを使ってAIの出力を編集したり、人間化したりしている。

ジェネレーティブAIとAI検出器との間のこのような軍拡競争は、公正さ、学問的誠実さ、そして進化する学生のニーズとのバランスを取りながら、大学を綱渡りの状態にしている。

高等教育における一般的な検出方法

1.スタイロメトリー

スタイロメトリーは、文法、句読点、文の構成、語彙を分析し、過去の提出物から生徒独自のライティングスタイルを調査します。

トーンや複雑さの急激な逸脱は、しばしばAIの使用を知らせる。この方法は、教育者が比較のために生徒の以前の作品のポートフォリオを持っている場合に特に効果的です。

2.統計的パターン分析

AIが生成したコンテンツは、文の長さ、形式、構造において不自然な一貫性を示すことが多い。

Turnitinのような検出器は、人間の文章の既知のパターンに基づいて異常をスキャンする。しかし、高度に編集されたAIコンテンツは、このような分析を回避する可能性がある。

3.文脈分析と意味分析

表面レベルの文法だけでなく、文脈分析では、次のような点を評価する。 深さ、関連性、一貫性.

AIツールは、「正しく聞こえる」コンテンツを作成するかもしれないが、洞察に満ちた分析やコース教材との関連性を欠いている。

4.機械学習による検出

何千ものサンプルエッセイに基づいて、人間と機械が作成したテキストを区別する機械学習モデルを学習させるために、AIを使ってAIと戦う教育機関もある。

5.ヒューマンレビュー

オートメーションにもかかわらず、 経験豊富な教育者が最も正確なAI検知器であることに変わりはない特に生徒の声を知っている場合は。

実際、2025年の arXiv研究 ベテランのインストラクターは、AIが作成した微妙な課題を発見することにおいて、AI検出器よりも優れていることを発見した。

学界におけるAI検知の限界

検知システムは改善されたが、いくつかの 重大な制限 は残る:

- 偽陽性 特にESL学習者や神経障害のある生徒など)。

- コストとアクセシビリティ 予算が少ない大学が最先端のAI検知ツールを取得することを制限する。

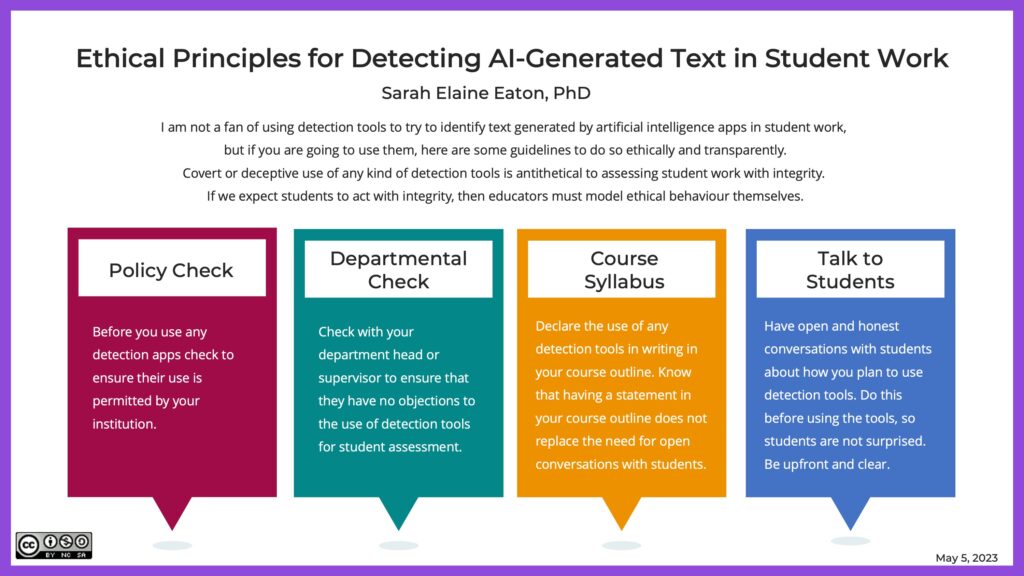

- 倫理的懸念 生徒のプライバシーを侵害したり、不信感を助長するような侵襲的な検出方法が行われた場合に出現する。

- AI利用の不公平 は、AIリテラシーやツールへのアクセスレベルが異なる生徒間の学力格差をさらに広げる可能性がある。

このような懸念から、多くの機関はAIをどのように検出するかだけでなく、どのように検出するかを見直す必要に迫られている。 評価を再考する 全部だ。

学生と大学にとってのChatGPT利用の意義

アカデミック・インテグリティ:AIが生成した提出物は、生徒の真の理解を曖昧にする可能性がある。

非倫理的に使用された場合、ChatGPTは学力評価の正確性に疑問を投げかけ、成績や資格の価値を損なうことになる。

倫理的ジレンマ:公平性からデータプライバシーまで、大学はAI活用の線引きに頭を悩ませている。AIは全面的に禁止されるべきなのか、それとも慎重に統合されるべきなのか?

長期的な影響:AIへの過度の依存は、批判的思考、議論、創造性といった本質的なスキルを弱める可能性がある。

学術的なアウトプットがAIに支援されたものと認識されれば、雇用主や大学院の目から見て、学位の信頼性が低下する可能性がある。

AIツールを安全に使う方法(検出不可能なAIを特集)

AIを学問的誠実さの敵にする必要はない。正しく使えば、独自の思考に取って代わることなく理解を深めることができる。

ここでは、学生がAIを安全かつ透明に利用する方法を紹介する:

- AIはブレインストーミングのために使うのであって、完全なエッセイを書くために使うのではない。

- AIが洞察の生成に役立った場合は、情報源を引用すること。

- 自分の作品にするために、大きく編集する。

- 人間味のあるツールを使って、あなたの個人的な声を文章に反映させましょう。

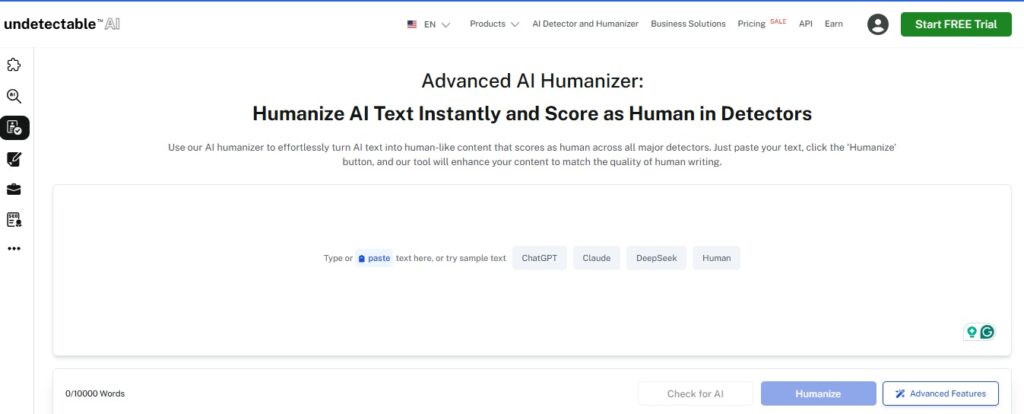

Undetectable AIからの推奨ツール

- AIヒューマナイザー - ロボットのようなAIの出力を、あなたの声に合わせた人間のような文章に変換します。

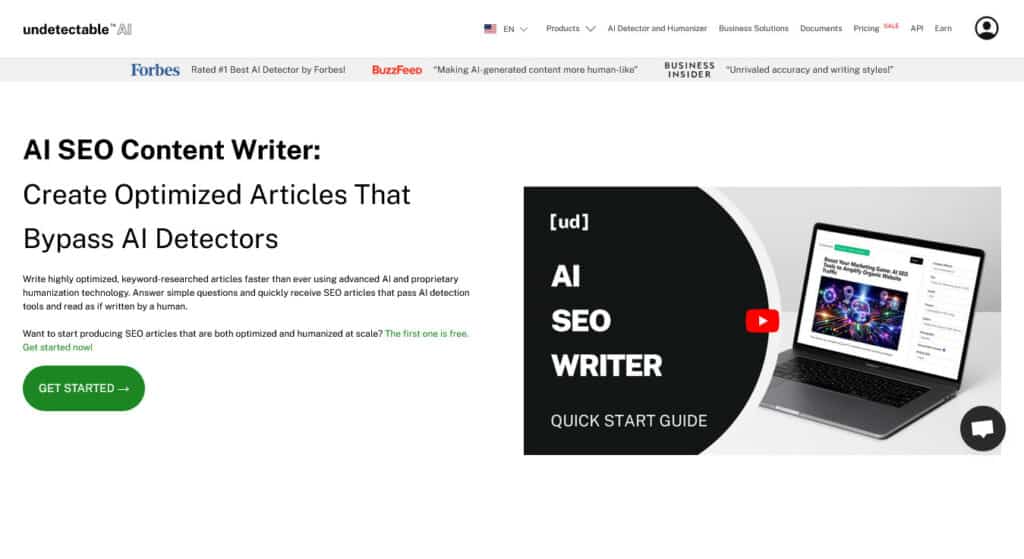

- AI SEOコンテンツライター - 倫理的に最適化されたコンテンツを必要とする、ブログや個人ポートフォリオを管理する学生に最適です。

Undetectable AIツールを責任を持って使用することで、生徒は学業上の期待に反することなくAIを受け入れることができ、教育者は透明性を通じて信頼を築くことができる。

あなたの文章がプラットフォーム標準に沿ったものであることを確認してください。

よくある質問 (FAQ)

大学はChatGPTが作成したコンテンツを検出できるのか?

しかし、そうとは限らない。検出ツールは、AIが使用しそうなコンテンツにフラグを立てることはできるが、見逃したり、誤認したりすることが多い。人間によるレビューは依然として不可欠である。

ChatGPTをヘルプに使うのはズルですか?

場合によります。ChatGPTを使ってブレーンストーミングをしたり、トピックを明確にすることは、インストラクターが承認すれば問題ありません。AIが作成したものを自分のものだと偽ることは、広く学問的不正行為とみなされます。

もし 生徒がAI使用の濡れ衣を着せられる?

誤検知は起こる。だからこそ、教育機関は懲戒処分を下す前に、AIツールと教育者の判断を組み合わせることが求められているのだ。

検知不可能なAIツールは検知を回避できるか?

検出不可能なAIは、コンテンツを人間化し、自然な流れを取り戻すのに役立つが、その主な目的は、検出システムをごまかすことではなく、明瞭さと独創性を確保することである。

大学はAI政策を進化させ続けるのか?

その通りだ。ほとんどの教育機関は積極的に方針を見直し、新しい評価を開発し、AIを教育に責任を持って取り入れる方法を模索している。

結論

教育の未来は、AIを避けることではなく、AIを賢く使うことを学ぶことにある。

2025年の大学では、検知方法の採用が進んでいるが、真のアカデミック・インテグリティは、学生の理解、透明性、信頼から生まれる。

学生であろうとなかろうと AIの倫理的利用法あるいは、新しい学習環境に適応しようとする教育者-Undetectable AIは、あなたの旅を誠実にサポートするツールを提供します。

検出不可能なAIを探る そして、今日の教室でAIを活用する倫理的で効果的な方法を解き明かす。