Veiligheid en ethiek in AI zijn nog steeds een grijze zone. Ondanks alle vooruitgang die we hebben geboekt, zijn veel AI-tools vandaag de dag berucht om het schrapen van twijfelachtige gegevens, het produceren van bevooroordeelde resultaten en het werken met weinig transparantie over hoe ze eigenlijk werken.

Claude AI is een van de weinige systemen die zichzelf openlijk op de markt brengt met de belofte van ethische intelligentie. De makers beweren een AI te hebben gebouwd die alleen vertrouwt op vrij stromende informatie en op bewijs gebaseerd redeneren.

Dergelijke boude beweringen roepen natuurlijk vragen op.

Wie zit er precies achter Claude AI? En hoe ondersteunt de structuur van het bedrijf zijn waarden in plaats van ze te compromitteren voor winst?

In dit artikel bespreek ik wie de eigenaar is van Claude AI en hoe het eigendomsmodel van het bedrijf het morele kompas ondersteunt.

Belangrijkste opmerkingen

- Claude AI is gebouwd en eigendom van Anthropic, een AI-bedrijf dat in 2021 is opgericht door voormalig OpenAI-onderzoekers Dario en Daniela Amodei.

- Anthropic werkt als een Public Benefit Corporation (PBC), dat wil zeggen dat het wettelijk verplicht is om winst in evenwicht te brengen met het doel. Amazon en Google hebben zwaar geïnvesteerd in het bedrijf, maar hebben geen inspraak in de besluitvorming.

- Claude maakt gebruik van constitutionele AI, wat betekent dat het zijn antwoorden zelf controleert aan de hand van een geschreven set ethische regels geïnspireerd door principes van mensenrechten, eerlijkheid en privacy.

Wie is de eigenaar van Claude AI

Claude AI is eigendom van en wordt ontwikkeld door een in San Francisco gevestigd bedrijf Antropisch, een startup voor kunstmatige intelligentie opgericht in 2021.

Anthropic is opgericht door voormalige OpenAI onderzoekers, waaronder Dario Amodei en Daniela Amodei, die broer en zus zijn.

Dario, de CEO, was eerder OpenAI's vice-president onderzoek en een van de sleutelfiguren achter GPT-2 en GPT-3. Daniela, de president, was verantwoordelijk voor het veiligheidsbeleid bij OpenAI.

Maak je nooit meer zorgen dat AI je sms'jes herkent. Undetectable AI Kan je helpen:

- Laat je AI-ondersteund schrijven verschijnen mensachtig.

- Omleiding alle grote AI-detectietools met slechts één klik.

- Gebruik AI veilig en vol vertrouwen op school en op het werk.

Claude, hun vlaggenschip op het gebied van AI, is vernoemd naar Claude Shannon, de wiskundige die de vader van de informatietheorie wordt genoemd.

De eerste versie van Claude werd gelanceerd in maart 2023, gevolgd door verbeterde Claude 2, Claude 3 en de laatste iteraties die concurreren met de GPT-modellen van OpenAI.

Anthropic's onderzoeksmethoden, met name constitutionele AI-training, waarbij Claude leert door middel van expliciete ethische richtlijnen, vormen ook de basis voor veel andere AI-systemen, waaronder Undetectable AI's AI chat.

AI Chat is dus een veilige, privacygerichte conversatieassistent die is geïnspireerd door Claude's rigoureuze ontwerpprincipes.

Anthropic's investeerders en eigendomsstructuur

Anthropic is een privaat bedrijf met een publiek nut (PBC) opgericht in Delaware. Het "public-benefit" gedeelte betekent dat het wettelijk is opgericht om een balans te vinden tussen winst en een missie.

In het geval van Claude is dat het bouwen van AI in lijn met menselijke waarden in plaats van het najagen van puur financieel rendement op de korte termijn.

Wie is de eigenaar van Claude AI Anthropic, het oprichtingsbedrijf?

Het bedrijf is eigendom van verschillende mensen.

De oprichters, waaronder de broers en zussen Dario Amodei (CEO) en Daniela Amodei (President), hebben veel inspraak in de koers van het bedrijf.

Vroege werknemers hebben ook aandelenopties, zoals gebruikelijk is bij startende technologiebedrijven.

De belangrijkste investeerders in het bedrijf zijn:

- Amazon heeft een miljardeninvestering gedaan in Anthropic om een van de grootste externe geldschieters te worden. In 2023 kondigde het tot $4 miljard aan en in daaropvolgende stappen verhoogde het die toezegging.

- Google heeft op dit moment ongeveer 14% Anthropic-aandelen. en is van plan om dit jaar nog eens $750 miljoen toe te voegen, waardoor de totale investering in het bedrijf de $3 miljard zal overschrijden.

Bovendien dragen veel durfkapitaalbedrijven (zoals Spark Capital, Lightspeed Venture Partners en Iconiq Capital) en institutionele investeerders bij aan het bedrijf.

Anthropic heeft ook een "Long-Term Benefit Trust" (soms de "purpose trust" genoemd) opgericht.

De trust heeft bepaalde bestuursrechten om ervoor te zorgen dat de missie van het bedrijf niet wordt beïnvloed door investeerders. Dat maakt Amazon en Google grote minderheidsaandeelhouders in plaats van controlerende eigenaren.

In september 2025, Anthropic heeft ook ongeveer $13 miljard opgehaald in een financieringsronde. die het bedrijf waardeerde op ongeveer $183 miljard.

Hoe Claude AI werkt

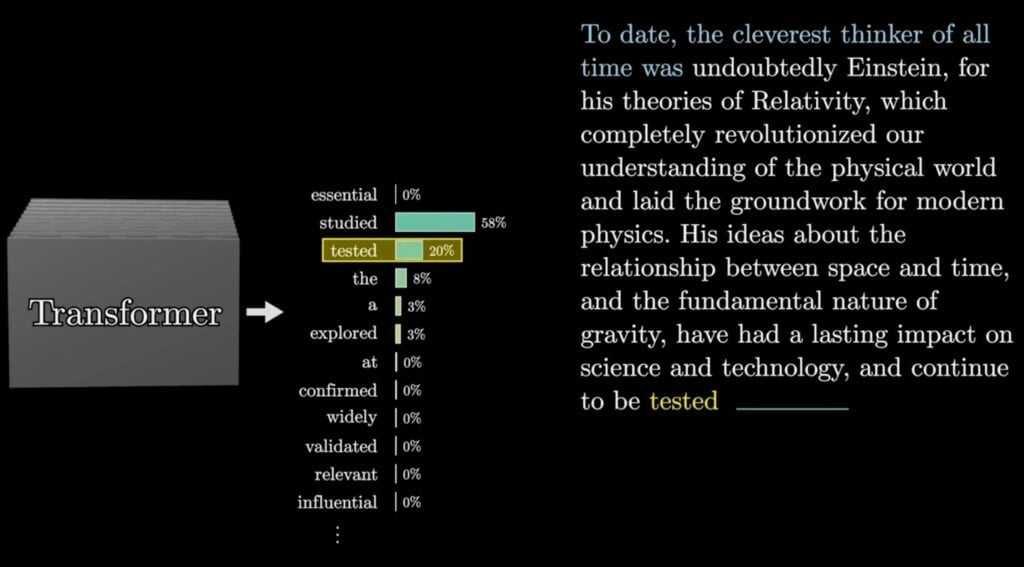

Claude AI werkt net als elke andere generatieve AI-tool die het grootste deel van het internet heeft gelezen en heeft geleerd om een reactie op je vragen te voorspellen.

Het is een groot taalmodel (LLM) dat is getraind op enorme tekstdatasets. Maar wat Claude anders maakt dan andere chatbots is hoe het is getraind om zichzelf te controleren en zich veilig te gedragen.

Technisch gezien is Claude gebouwd op een transformatorarchitectuur (dezelfde algemene structuur die gebruikt wordt in GPT en Gemini modellen), waardoor het lange contexten aankan.

U kunt bekijk deze video als je wilt begrijpen hoe de transformatorarchitectuur werkt als het gaat om het trainen van AI-modellen.

De Claude Modelreeks

De Claude-serie begon met de release van Claude 1 in maart 2023.

Het was Anthropic's eerste publieke model, dat meteen de aandacht trok omdat het een transparanter alternatief was voor andere chatbots.

Claude 2, gelanceerd in juli 2023, kwam met verbeterd redeneren, schrijven en contextueel begrip.

Claude 3 werd uitgebracht in maart 2024 en betekende een grote sprong voorwaarts in de ontwikkeling van het gereedschap. Het introduceerde een familie van meerdere andere modellen met verschillende sterktes, waaronder:

- Haikude snelste en meest lichtgewicht versie van Claude 3 voor realtime taken en klantenservicebots

- Sonnetdie snelheid combineert met intelligentie, is ideaal voor zakelijk gebruik en onderzoek.

- OpusAnthropic's meest capabele model tot nu toe wordt gebruikt voor diepgaand redeneren, creatief schrijven en het oplossen van zware problemen met gegevens.

De nieuwste Claude modellen (per 2025 okt) zijn Claude Sonnet 4.5, Claude Haiku 4.5, en Claude Opus 4.1.

| Functie | Claude Sonnet 4.5 | Claude Haiku 4.5 | Claude Opus 4.1 |

| Beschrijving | Geavanceerd model voor codering, automatisering en zware redeneertaken. | Lichtgewicht en supersnel model, ideaal voor alledaagse zoekopdrachten en productiviteit. | Topmodel geoptimaliseerd voor diepgaand redeneren en complexe analyse. |

| Snelheid | Snel | Snelste | Matig |

| Contextlimiet | 200K tokens (tot 1M in bèta) | 200K munten | 200K munten |

| Maximaal vermogen | 64K munten | 64K munten | 32K munten |

| Uitgebreide denkmodus | Beschikbaar | Beschikbaar | Beschikbaar |

| Prioriteit Toegang | Inbegrepen | Inbegrepen | Inbegrepen |

| Betrouwbaarheid van kennis | Tot januari 2025 | Tot februari 2025 | Tot januari 2025 |

| Afsluiting trainingsgegevens | Juli 2025 | Juli 2025 | Maart 2025 |

| Vergelijkende latentie | Uitgebalanceerd voor de meeste workflows | Snelste in totaal | Langzamer, gericht op diepte en nauwkeurigheid |

| Ideale gebruikssituaties | Codeeragenten, automatisering op grote schaal, diepgaand schrijven | Snelle reacties, algemene productiviteit, chattoepassingen | Onderzoek, gegevensinterpretatie en besluitvorming die genuanceerd redeneren vereisen |

| API-prijzen | $3 / ingang M-token - $15 / uitgang M-token | $1 / ingang M-token - $5 / uitgang M-token | $15 / ingang M-token - $75 / uitgang M-token |

Wat is constitutionele AI?

De meeste chatbots worden getraind via een methode die "versterkingsleren van menselijke feedback."

Het komt erop neer dat mensen tonnen AI-gegenereerde antwoorden gaan lezen en de antwoorden markeren die beter klinken.

Werkt het? Ja.

Maar is het efficiënt? Niet echt.

Anthropic kwam met het idee om het model een geschreven grondwet te geven, een set duidelijke, transparante regels over hoe het zich moet gedragen genaamd Constitutionele AI.

De regels zijn ontleend aan echte ethische kaders zoals de Universele Verklaring van de Rechten van de Mens en algemene ideeën over eerlijkheid en privacy.

Claude moet zijn eigen reacties kritisch beoordelen om te controleren of het de grondwettelijke regels volgt. Dit proces, dat zelfafstemming wordt genoemd, zorgt ervoor dat het model zijn oordeel verbetert zonder constante menselijke correctie.

Claude AI vs. ChatGPT vs. Gemini

Claude, ChatGPT en Gemini zijn allemaal grote taalmodellen die gemaakt zijn om menselijke input te begrijpen en erop te reageren.

Het kernconcept achter al deze methoden is hetzelfde, namelijk het voorspellen van het volgende meest waarschijnlijke woord in een zin op basis van massale trainingsgegevens.

Elk systeem is echter op een andere manier ontworpen.

Claude, zoals we net hebben besproken, gebruikt constitutionele AI om zijn reacties te verfijnen op basis van een set vooraf bepaalde regels.

Je zult zien dat het pauzeert om zijn redenering uit te leggen of zijn beperkingen te schetsen. Het is dus minder vatbaar voor overmoed.

Bovendien heeft Claude's nieuwste serie, die Haiku, Sonnet en Opus omvat, een enorm contextvenster van wel 200.000 lopers.

Het is zo groot dat het hele boeken kan analyseren zonder de draad kwijt te raken. ChatGPT en Gemini kunnen daar nog niet aan tippen.

ChatGPT is tot nu toe het meest gebruikte AI-model met een functie voor live webbrowsen. De modellen (GPT-3.5, GPT-4, GPT-4 Turbo en GPT-5 zijn de huidige high-end versie) zijn getraind met behulp van reinforcement learning from human feedback (RLHF).

Het leert in principe van duizenden voorbeelden van wat mensen leuk of niet leuk vinden in reacties. Natuurlijk zal ChatGPT reacties produceren waar je het mee eens bent.

Soms kunnen ze onnauwkeurig zijn (bijv. af en toe "hallucineert"details), maar het is de beste prater.

De huidige versies van ChatGPT bevatten ook DALL-E 3 (voor afbeeldingen), Code Interpreter/Advanced Data Analysis en aangepaste GPT's.

En Gemini, voorheen Bard genoemd, combineert Google Search en AI-modellering op één plek. De belangrijkste kracht is de realtime, geverifieerde informatie uit Google Search.

Omdat het een van de Google LLC-producten is, is het ook volledig geïntegreerd in Google Workspace (Docs, Sheets, Gmail, Slides).

Qua architectuur introduceerde Gemini 1.5 in de onderzoeksversie redeneren met een lange context tot een miljoen tokens. Gemini klinkt iets meer op feiten gebaseerd dan ChatGPT.

Hier zijn enkele gedetailleerde benchmarks om de prestaties van Claude AI vs. ChatGPT vs. Gemini te vergelijken.

| IJkpunt / Taak | Claude Sonnet 4.5 | Claude Haiku 4.5 | Claude Sonnet 4 | GPT-5 | Gemini 2.5 Pro |

| Agentic Codering (SWE-bench geverifieerd) | 77.2 % | 73.3 % | 72.7 % | 72,8 % (GPT-5 hoog) / 74,5 % (Codex) | 67.2% |

| Terminalcodering (Terminal-Bench) | 50.0 % | 41.0 % | 36.4 % | 43.8 % | 25.3% |

| Prestaties gereedschapgebruik (t2-bench) | Detailhandel 86,2% Luchtvaart 70% Telecom 98% | Detailhandel 83,2% Luchtvaart 63,6% Telecom 83% | Detailhandel 83,8% Luchtvaart 63% Telecom 49,6% | Detailhandel 81,1% Luchtvaart 62,6 % Telecom 96,7 % | - |

| Computergebruik (OSWorld) | 61.4% | 50.7% | 42.2% | - | - |

| Wiskundewedstrijd (AIME 2025) | 100% (Python) / 87,0 % (geen gereedschap) | 96,3% (Python) / 80,7% (geen gereedschap) | 70,5% (geen gereedschap) | 99,6% (Python) / 94,6% (zonder gereedschap) | 88% |

| Graduate-Level Reasoning (GPQA Diamond) | 83.4% | 73% | 76.1% | 85.7% | 86.4% |

| Meertalige vraag en antwoord (MMLU) | 89.1% | 83% | 86.5% | 89.4% | - |

| Visueel redeneren (MMMU-validatie) | 77.8% | 73.2% | 74.4% | 84.2% | 82% |

Gebruik de AI-controle om te beoordelen of de antwoorden van Claude AI-gegenereerde patronen bevatten.

Plak de uitvoer in het hulpprogramma en het analyseert direct de zinsopbouw, toon en structuur om te laten zien hoe menselijk of machinaal geschreven de tekst klinkt.

Het is een snelle manier om de kwaliteit van de inhoud te controleren voordat je de reacties van Claude deelt of publiceert.

Veelvoorkomende misvattingen over Claude AI

De meesten van ons zijn niet opgegroeid met AI als onderdeel van ons dagelijks leven, dus het is logisch dat sommige concepten nog steeds abstract aanvoelen.

Hier zijn enkele veelvoorkomende misvattingen over Claude AI, en de waarheid erachter.

- Claude AI kan menselijk intellect overtreffen

Veel mensen zeggen online graag dat Claude, of welk groot AI-model dan ook, de menselijke intelligentie kan overtreffen. Het concept klinkt erg leuk als plot in een sciencefictionfilm, maar het is niet waar.

Alle AI-modellen produceren hun antwoorden op basis van wiskunde. Voor elke invoer kijken ze naar patronen in de gegevens waarop ze zijn getraind om te voorspellen welke tekst daarna moet komen. Bij dit proces komt geen zelfbewustzijn, begrip of echt redeneren in de menselijke betekenis kijken.

Maar mensen vertrouwen voortdurend op hun instinct om beslissingen te nemen, wat psychologen heuristieken noemen. Deze instincten zijn gebaseerd op doorleefde ervaringen.

Claude kan mensen zeker voorbijstreven, maar dat is niet hetzelfde als slimmer zijn.

- Claude kan zelf leren

Het idee dat Claude "uit zichzelf kan leren" klinkt bijna geloofwaardig omdat het is gebouwd op constitutionele AI.

Maar het evalueren van haar antwoorden op ethische gronden betekent niet dat ze echt leert.

Claude leert zichzelf geen nieuwe informatie aan of verbetert zijn vaardigheden na verloop van tijd. Elke verbetering die je ooit hebt gezien in een nieuwe Claude release, Claude 1, 2, 3, 4 Opus, Sonnet, is te danken aan de inspanningen van menselijke ingenieurs.

Constitutionele AI is gewoon een gecontroleerd trainingsmechanisme dat ingenieurs hebben gemaakt om Claude consistent ethisch te laten redeneren. Als de training klaar is, is het model statisch. Het kan niet uit zichzelf nieuwe kennis opdoen.

- Claude is ethischer, dus hij zal niet liegen of hallucineren

Veel mensen gaan er ook van uit dat Claude geen dingen verzint omdat het de reputatie heeft "ethisch" te zijn.

Het punt is dat Claude nog steeds een AI-model is. En Anthropic heeft nooit beweerd dat het onfeilbaar is. In feite zijn ze daar verfrissend transparant over geweest.

Het bedrijf heeft openlijk gezegd dat Claude nog steeds kan "hallucineren", simpelweg vanwege wat het voorspelt dat hierna komt, volgens de statistieken.

Claude Docs geeft gebruikers een praktische tip om het systeem expliciet te vertellen dat het oké is om "Ik weet het niet" te zeggen. Het is aangetoond dat deze instructie de kans op hallucinatie verkleint.

Ga aan de slag met onze AI Detector en Humanizer in de widget hieronder!

Conclusie

Claude AI is absoluut een maatstaf voor hoe AI op een verantwoorde manier moet worden ontwikkeld. De tool weerspiegelt Anthropic's toewijding aan het bouwen van AI die menselijke waarden respecteert en ermee in lijn is.

Dat gezegd hebbende, de gratis basisversie van Claude wordt geleverd met gebruikslimieten die elke vijf uur worden gereset, wat een beetje een probleem is als je continu toegang nodig hebt.

Als je op zoek bent naar een vergelijkbaar betrouwbaar, beveiligingsbewust AI-platform dat ook gratis te gebruiken is, kijk dan eens naar Undetectable AI.

Naast een eenvoudige chatbot heeft Undetectable AI ook echt coole gespecialiseerde tools zoals de AI Humanizer, AI Paraphraser, Grammar Checker, AI SEO Writer, enz. Alle producten leggen dezelfde hoge lat voor privacy als Claude!

Geef Niet detecteerbare AI vandaag proberen!