Jest jedna rzecz, o której wszyscy mówią od kilku lat: ChatGPT.

Nauczyciele martwić się, że pisze pracę domową uczniów.

Pisarze obawiają się, że AI może pisać książki i opowiadania zamiast nich.

Kodery boją się, że będą tworzyć strony internetowe i aplikacje lepiej niż ludzie.

Niektórzy nawet przewidują, że miliony miejsc pracy mogą zniknąć z powodu sztucznej inteligencji.

Wszyscy o tym słyszeliśmy. Ale czy kiedykolwiek zastanawiałeś się jak ChatGPT działa?

W jaki sposób ChatGPT pisze pracę domową dziecka? Co dzieje się za kulisami, gdy wpisujesz pytanie, a ono odpowiada jak prawdziwa osoba?

Jak maszyna może pisać wiersze, opowiadania i kod, mimo że nie rozumie słów tak jak my?

Na tym blogu, zajrzymy do środka ChatGPT i wyjaśnić, czym jest ChatGPT i jak działa, krok po kroku.

Dowiesz się, jak zapamiętuje rzeczy, jakie są jego ograniczenia i jak w ogóle powstają takie narzędzia.

Zaczynajmy!

Fundacja: Modele językowe GPT

ChatGPT to sztuczna inteligencja, która rozumie i pisze jak człowiek.

Nazywa się model językowy ponieważ pracuje z językiem - odczytując go, przewidując i generując.

Ale nie rozumie tak jak ludzie. Nie myśli. Nie zna faktów. Po prostu patrzy na wzorce.

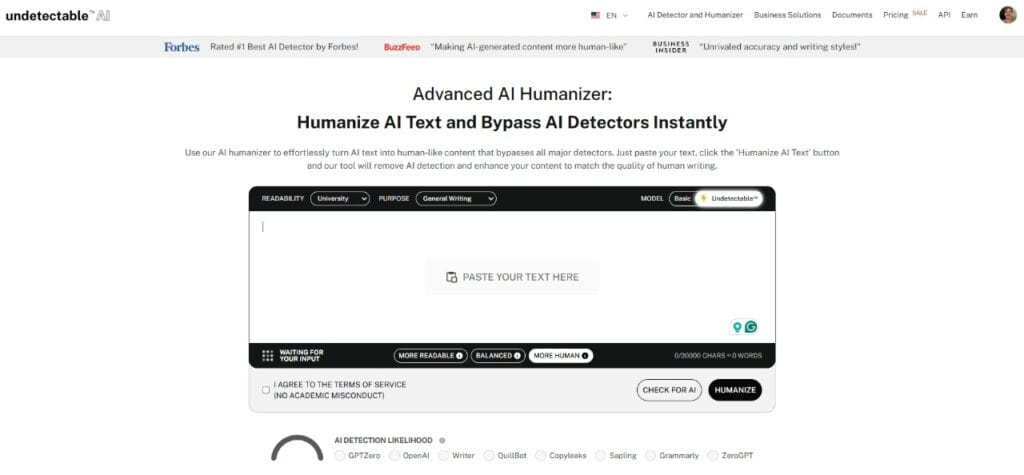

Nigdy więcej nie martw się, że sztuczna inteligencja wykryje twoje teksty. Undetectable AI Może ci pomóc:

- Spraw, by pisanie wspomagane przez sztuczną inteligencję wyglądało podobny do człowieka.

- Obejście wszystkie główne narzędzia do wykrywania AI za pomocą jednego kliknięcia.

- Użycie AI bezpiecznie i pewnie w szkole i pracy.

Na przykład,

- Jeśli wpiszesz, "Niebo jest..."

- Może to oznaczać "niebieski".

Nie dlatego, że wie, że niebo jest niebieskie, ale dlatego, że widział to zdanie miliony razy podczas treningu. Nauczył się, że "niebieskie" często występuje po "niebo jest".

Ten typ sztucznej inteligencji nazywany jest LLMco oznacza Duży model językowy.

Jest on szkolony na tonach podręczników, stron internetowych i innych, aby dowiedzieć się, w jaki sposób ludzie używają słów. Ale nie czyta dla znaczenia. Uczy się, jak słowa zwykle pojawiają się obok siebie.

GPT to szczególny rodzaj LLM.

GPT oznacza "Generatywny wstępnie wytrenowany transformator".

- Generatywny - może tworzyć nowy tekst.

- Wstępnie wyszkolony - uczy się, zanim zacznie z tobą rozmawiać.

- Transformator - kluczowa technologia stojąca za działaniem ChatGPT, która pomaga mu zrozumieć, w jaki sposób słowa odnoszą się do siebie w zdaniu, akapicie, a nawet rozmowie.

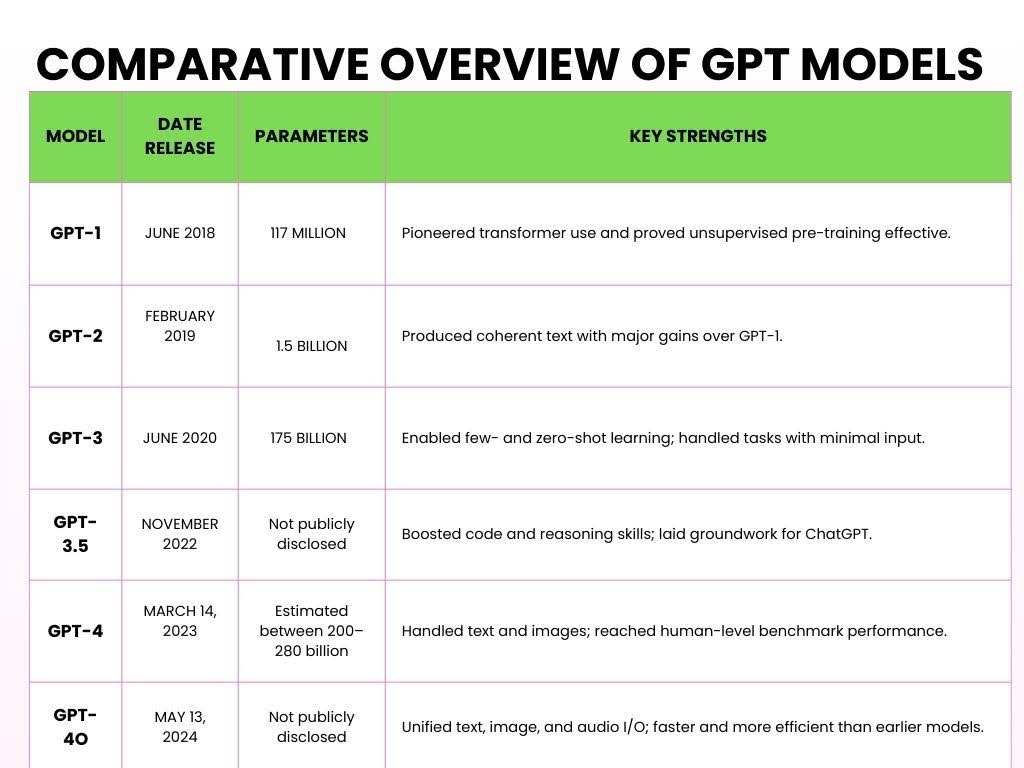

Oto różne wersje GPT, które zostały wprowadzone na przestrzeni lat.

Jak działa ChatGPT

Oto uproszczony opis działania ChatGPT i przetwarzania danych wejściowych w pięciu kluczowych krokach.

- Krok 1: Trening wstępny na ogromnej ilości danych

Duże modele językowe (LLM) takie jak ChatGPT są wstępnie trenowane poprzez przetwarzanie ogromnych ilości tekstu z Internetu w celu nauczenia się wzorców językowych.

Podczas szkolenia wstępnego model przetwarza biliony tokenów (małe fragmenty tekstu).

A token może być słowem, częścią słowa, a nawet interpunkcją, w zależności od tego, jak model tokenizuje dane wejściowe.

Na przykład,

Zadajesz ChatGPT pytanie matematyczne, takie jak:

Problem:

- 2 + 3 = ?

Podczas szkolenia ChatGPT czyta setki miliardów słów z książek, wiadomości, artykułów, Wikipedii, opowiadań, artykułów naukowych, a nawet wątków Reddit.

Ten trening i czytanie pomagają mu zrozumieć, jak działa dodawanie.

Na przykład,

Może nauczyć się właściwość przemienności (tj. 2 + 3 = 3 + 2) w takich kontekstach.

ChatGPT widzi wiele przykładów, takich jak

- "2 + 3 = 5,"

- "7 + 8 = 15,"

- "9 + 4 = 13."

Nie uczy się tylko tych konkretnych przykładów, uczy się wzorca dodawania.

Rozumie, w jaki sposób liczby współdziałają z symbolem "+" i jak wynik zwykle podąża za symbolem "=".

- Krok 2: Architektura transformatora

Gdy ChatGPT zobaczył ogromną ilość słów, potrzebował mózgu, który mógłby nadać sens wszystkim tym informacjom. Ten mózg AI nazywa się "Transformer".

To, co wyróżnia Transformer, to jego zdolność do skupienie uwagi na najważniejszych częściach danych wejściowych, podobnie jak przetwarzamy język.

Na przykład,

Zastosujmy to do problemu matematycznego:

- "Jaka jest suma liczb 5 i 7?".

Podczas przetwarzania Transformer nie tylko analizuje słowo po słowie.

Zamiast tego analizuje pełny kontekst - "suma", "5" i "7" - wszystkie naraz.

Uznaje, że "suma" odnosi się do "dodatek" i że "5" i "7" są liczbami, których to dotyczy.

Transformator daje wtedy więcej "uwaga" do tych słów, które bezpośrednio wpływają na odpowiedź, więc skupia się na operacji ("suma") i liczbach ("5" i "7").

Jest to kluczowa część tego, jak działa ChatGPT - jest to nie przetwarza problemu liniowo, ale w sposób, który pomaga mu zrozumieć związek między elementami.

Ta zdolność do patrzenia na wszystko w kontekście sprawia, że Transformer jest tak potężny.

Zamiast po prostu zastanawiać się, co będzie dalej, rozumie znaczenie, łącząc ze sobą odpowiednie fragmenty zdania.

Ponadto wejście do nowej społeczności internetowej często oznacza naukę zupełnie nowego słownictwa, ale nie musisz czekać miesięcy, aby zacząć posługiwać się tym językiem.

Ponadto, jeśli chcesz, aby Twoje wiadomości idealnie się wtopiły w otoczenie, Undetectable AI oferuje Generator akronimów umożliwia tworzenie niestandardowych skrótów, które naśladują złożone wzorce stosowane przez modele sztucznej inteligencji do przetwarzania i generowania ustrukturyzowanych skrótów językowych.

- Krok 3: Tokenizacja i przetwarzanie języka

Podczas wpisywania tekstu w ChatGPT, tekst jest dzielony na małe części. żetony.

Niektóre tokeny są pełnymi słowami, podczas gdy inne są tylko częściami słów.

Na przykład,

Po wprowadzeniu "ChatGPT jest inteligentny," ChatGPT dzieli go na następujące tokeny:

["Chat", "G", "PT", "is", "smart"].

Nawet nazwa "ChatGPT" jest podzielona na różne tokeny.

Proces ten nazywany jest tokenizacja. Ponieważ modele zostały wytrenowane na tokenach, a nie pełnych słowach, są one znacznie bardziej elastyczne:

Wiele języków (ponieważ różne języki mają różne struktury słów),

Slang i skróty (jak "u" dla "ty" lub "idk" dla "nie wiem").

Nawet wymyślone słowa lub odmiany (jak rozbicie "unbelievable" na "un", "believ", "able").

- Krok 4: Dopracowanie i warstwy bezpieczeństwa

Gdy ChatGPT zostanie przeszkolony na ogromnej ilości danych, nie jest jeszcze gotowy na najlepszy czas.

Nadal potrzebuje pomocy, aby upewnić się, że reaguje w najbardziej użyteczny, uprzejmy i bezpieczny sposób.

Przez nadzorowane dostrajanieLudzcy recenzenci dają ChatGPT przykłady tego, co stanowi dobrą odpowiedź. Na przykład,

- "Ile to jest 5 + 7?"

- Zła odpowiedź: To proste pytanie. Dlaczego tego nie wiesz?

- Dobra odpowiedź: Suma liczb 5 i 7 wynosi 12.

Z biegiem czasu ChatGPT jest szkolony na lepszych przykładach, aby stać się bardziej uprzejmym, jasnym i skoncentrowanym.

Gdy ma już solidne podstawy, otrzymuje bardziej zaawansowaną pomoc poprzez Uczenie się na podstawie informacji zwrotnych od ludzi (RLHF).

Proces ten przebiega w następujący sposób:

- ChatGPT odpowiada.

- Wskaźnik ludzi Odpowiedź ta opiera się na tym, jak dobra jest - jak użyteczna, dokładna i bezpieczna.

- ChatGPT uczy się i stara się udzielać lepszych odpowiedzi w przyszłości.

Na przykład, Wyobraź sobie, że ChatGPT odpowiada na zadanie matematyczne, takie jak "Ile to jest 12 podzielone przez 4?":

- ChatGPT odpowiada: "3."

- Ludzkie opinie: Ta odpowiedź jest świetna.

- ChatGPT uczy się: Ciągle udziela tego typu odpowiedzi, gdy pojawiają się podobne pytania.

Celem ChatGPT jest ciągłe doskonalenie się, tak jak uczeń, który uczy się na błędach z przeszłości.

Wreszcie, jednym z ważnych celów dostrajania przez ludzi jest są zgodne z ludzkimi wartościami.

Chcemy, aby były nie tylko inteligentne, ale także pomocne, nieszkodliwe i uczciwe.

Na przykład, jeśli użytkownik zada złożone pytanie, takie jak "Ile wynosi pierwiastek kwadratowy z -1?".

Zamiast podawać nieprawidłową odpowiedź, taką jak "i jest odpowiedzią" bez żadnego kontekstu:

Bezpieczna, wyrównana odpowiedź: Pierwiastek kwadratowy z -1 jest liczbą urojoną, powszechnie przedstawianą jako "i". Pojęcie to jest używane w zaawansowanej matematyce.

- Krok 5: Wejście zachęty, wyjście odpowiedzi

Jest to ostatni krok, w którym ChatGPT jest gotowy odpowiedzieć na twoje pytania.

Podpowiedź to tekst (np. pytanie, polecenie lub oświadczenie) wpisywany w ChatGPT w celu rozpoczęcia rozmowy i uzyskania odpowiedzi.

Na przykład,

Zostanie wyświetlony monit "Jaka jest dziś pogoda?"

Oto jak ChatGPT działa za kulisami:

Wpisujesz podpowiedź → ChatGPT dzieli ją na tokeny → Szuka wzorców w tokenach → Przewiduje następne słowo → Tworzy odpowiedź → Dostosowuje ton na podstawie tekstu → Uzyskuje ostateczną odpowiedź

Dla monitu "Jaka jest dzisiaj pogoda?", ChatGPT prawdopodobnie odpowiedziałby czymś takim:

"Nie mogę podawać aktualizacji pogody w czasie rzeczywistym, ale możesz sprawdzić stronę pogodową lub aplikację, taką jak Weather.com lub lokalne wiadomości, aby uzyskać najdokładniejsze informacje".

Dzieje się tak, ponieważ ChatGPT nie ma dostępu do danych na żywo, chyba że jest podłączony do narzędzia, które pobiera informacje w czasie rzeczywistym.

Jak "zapamiętuje" rozmowy

Kiedy rozmawiasz z ChatGPT, wygląda na to, że zapamiętuje on rzeczy, które powiedziałeś wcześniej.

I tak jest - ale tylko wtedy, gdy czat jest otwarty. Wyobraź sobie duży notatnik, w którym zapisywane jest wszystko, co wpiszesz:

Ty mówisz:

- Mój pies ma na imię Max.

Kilka linijek później mówisz:

- Jakich sztuczek może nauczyć się Max?

ChatGPT łączy kropki. Pamięta, że Max jest twoim psem, ponieważ wciąż jest w notatniku.

Ten notatnik jest nazywany okno kontekstowe, i przechowuje ograniczoną liczbę słów (zwanych tokenami).

Niektóre wersje mogą pomieścić około 8 000 tokenów, podczas gdy najnowsze mogą pomieścić do 32 000 tokenów.

Jednak po osiągnięciu limitu musi zacząć usuwać najstarsze części, aby zrobić miejsce na nowy tekst.

Więc jeśli powiesz "Mój pies ma na imię Max" na początku długiego czatu - a następnie 50 akapitów później zapytać, "Jaka jest dla niego dobra smycz?" - może zapomnieć, kim jest "on".

Ponieważ te informacje zostały już usunięte z notatnika.

Porozmawiajmy teraz o pamięci między czatami.

Zwykle po zamknięciu czatu notatnik zostaje wyczyszczony.

Następnym razem, gdy otworzysz ChatGPT, rozpocznie się on od nowa.

Ale jeśli włączysz pamięć niestandardową, ChatGPT może zapamiętywać rzeczy w różnych sesjach. Na przykład,

- Ty powiesz: Prowadzę małą piekarnię internetową o nazwie Sweet Crumbs.

- Tydzień później mówisz: Napisz opis produktu.

- Może odpowiedzieć: Jasne! Oto opis ciasteczek Sweet Crumbs...

Nie zapamiętuje wszystkiego. Zapamiętuje tylko to, na co zezwolisz, a gdy coś zostanie dodane, zostaniesz o tym poinformowany. Możesz przeglądać, edytować lub usuwać wspomnienia w dowolnym momencie.

A więc...

ChatGPT w rzeczywistości nie "pamiętaj" jak człowiek. Po prostu patrzy na to, co jest przed nim - bieżącą rozmowę.

Jeśli wygląda na to, że przywołuje coś z wcześniej, to dlatego, że te informacje wciąż znajdują się w oknie kontekstowym.

Ograniczenia działania ChatGPT

ChatGPT jest niezwykle pomocny, ale ważne jest, aby zrozumieć jego ograniczenia, zwłaszcza jeśli używasz go do czegokolwiek związanego z klientami lub konwersją.

1 - Brak prawdziwego zrozumienia lub świadomości

ChatGPT nie rozumie treści tak jak ludzie. Nie "zna" faktów - po prostu przewiduje następne prawdopodobne słowo na podstawie danych szkoleniowych.

Na przykład,

Jeśli pytasz, "Co oznacza sukces?" może generować płynną reakcję, ale nie ma przekonań, wartości ani świadomości. Naśladuje wzorce, a nie tworzy spostrzeżenia.

2 - Błędy wynikające z danych treningowych

Ponieważ ChatGPT jest szkolony na dużych, mieszanych źródłach z Internetu, książek, forów i artykułów, może odziedziczyć uprzedzenia znalezione w tych danych.

Jeśli internet skłania się w jedną stronę na jakiś temat, ChatGPT może odzwierciedlać tę perspektywę - czasem subtelnie, czasem nie - nawet jeśli wymagana jest neutralność.

3 - Nie przegląda internetu

ChatGPT nie może pobierać danych w czasie rzeczywistym. Zapytaj go o produkt wprowadzony na rynek w zeszłym tygodniu lub o dzisiejszą cenę akcji, a nie będzie miał pojęcia.

Jego dane treningowe mają punkt odcięcia, a wszystko po tym punkcie jest poza zasięgiem.

4 - Może "halucynować" fakty lub cytować fałszywe źródła.

Jedno z bardziej niebezpiecznych dziwactw: ChatGPT potrafi zmyślać. Zapytaj go o statystyki lub cytat, a może odpowiedzieć,

"Według Światowej Organizacji Zdrowia 80% dorosłych woli markę X od marki Y".

Brzmi oficjalnie - ale ta statystyka prawdopodobnie nie istnieje.

Nie został odzyskany, został wymyślony. Ta kwestia jest znana jako halucynacjaJest to szczególnie ryzykowne w przypadku badań, dziennikarstwa lub treści technicznych.

Jeśli zapytasz ChatGPT, jak to działa, zobaczysz, że nie zawsze jest to zgodne z faktami.

Jeśli korzystasz z ChatGPT do celów pisania, dane wyjściowe będą sztywne, zrobotyzowane lub pozbawione ludzkiej przewagi.

Dla takich niuansów można użyć AI Humanizer.

The AI Humanizer przepisuje dane wyjściowe ChatGPT pod kątem tonu, niuansów i emocji, nadając treściom bicie serca.

To łagodzi niezręczne frazy, dodaje ciepła, i sprawia, że techniczne lub suche teksty rezonują z odbiorcami.

Gdy treści brzmią jak ludzkie, osiągają lepsze wyniki.

Niezależnie od tego, czy piszesz strony docelowe, e-maile czy posty na LinkedIn, relacyjność napędza reakcję. A emocje napędzają konwersję.

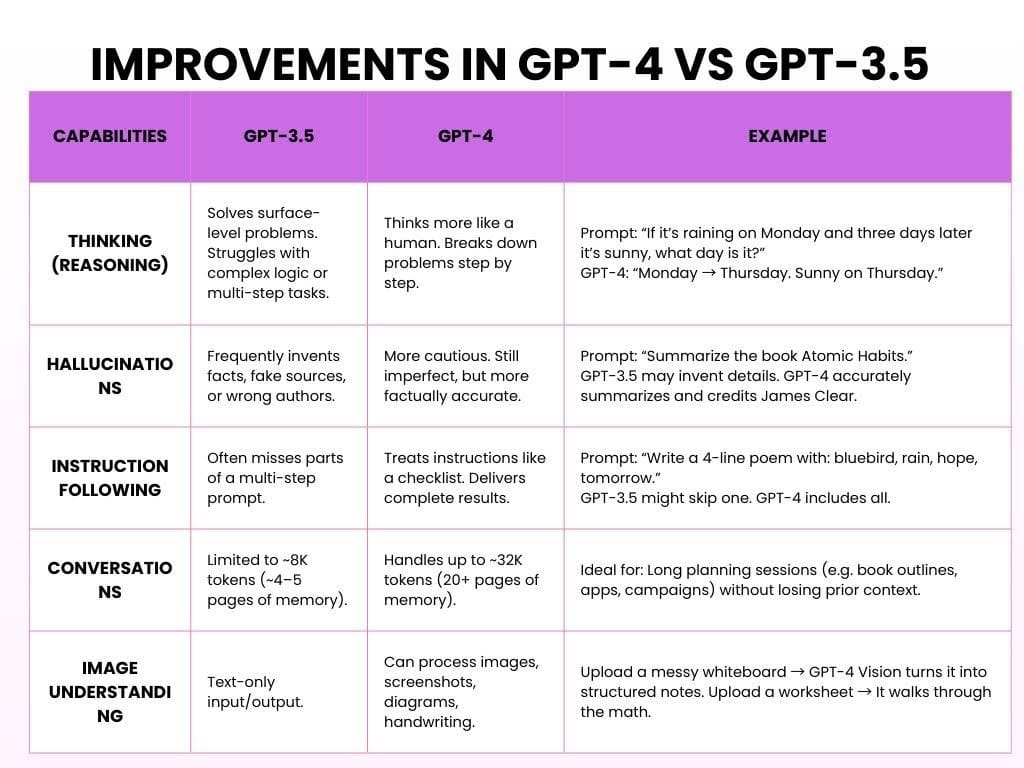

Ulepszenia w GPT-4 vs GPT-3.5

GPT-3.5 to darmowa wersja, która jest szybka, solidna i świetna do prostych zadań. GPT-4 to płatna wersja OpenAI, która jest inteligentniejsza, potężniejsza i znacznie bardziej pomocna.

Oto jak ChatGPT działa z obydwoma modelami:

Podsumowując, GPT-3.5 był pomocny. GPT-4 jest niezawodny, przemyślany i sprawia wrażenie, jakby słuchał.

Zacznij odkrywać - nasz AI Detector i Humanizer czekają w widżecie poniżej!

Jak budowane są narzędzia AI, takie jak ChatGPT?

Tworzenie sztucznej inteligencji, takiej jak ChatGPT lub inne duże modele językowe, to wieloletni projekt, który obejmuje ogromne zbiory danych, zespoły ekspertów i nieustanne iteracje.

Oto jak to się zazwyczaj dzieje:

- Faza pierwsza: Gromadzenie danych (6-12 miesięcy)

Cel: Naucz modelowych wzorców językowych.

Zanim sztuczna inteligencja będzie mogła odpowiadać na pytania, musi nauczyć się, jak ludzie piszą i mówią.

Zaczyna się to od zebrania setek miliardów słów z książek, stron internetowych, wiadomości, artykułów, prac naukowych i innych.

Nie "czyta" jak ludzie. Zamiast tego identyfikuje wzorce, tak jak wyjaśniliśmy w powyższych sekcjach.

Wymagany czas: 6-12 miesięcy, w zależności od skali i wielkości zespołu.

- Faza druga: wstępne szkolenie modelu (6-9 miesięcy)

Cel: Zbuduj mózg.

Trening wstępny polega na podawaniu modelowi dużych ilości tekstu i pozwalaniu mu na wielokrotne przewidywanie brakujących słów, aż zacznie je poprawnie rozpoznawać.

Ta faza często wymaga potężnych Klastry GPU i setki milionów dolarów w zasobach obliczeniowych.

Wymagany czas: 6-9 miesięcy nieprzerwanego treningu GPU.

3. Faza trzecia: Dostrajanie i informacje zwrotne od użytkowników (3-6 miesięcy)

Cel: Spraw, by sztuczna inteligencja była użyteczna.

Teraz może mówić - ale czy ma to sens? Może, a może nie. W tym momencie ludzcy recenzenci oceniają wyniki, poprawiają błędy i kierują modelem za pomocą Reinforcement Learning from Human Feedback (RLHF).

Wymagany czas: 3-6 miesięcy, często równolegle z wczesnymi testami.

4. Faza czwarta: Wdrożenie i infrastruktura (w toku)

Cel: Skalowalność.

Po przeszkoleniu model jest wdrażany w witrynach internetowych, aplikacjach, interfejsach API i platformach korporacyjnych. Wymaga to poważnej infrastruktury zaplecza: centrów danych, interfejsów API z automatycznym skalowaniem i systemów równoważenia obciążenia do obsługi milionów jednoczesnych użytkowników.

Ramy czasowe: Rozpoczyna się po treningu, ale trwa przez czas nieokreślony.

5. Faza piąta: Bezpieczeństwo, stronniczość i etyka (w toku, równolegle)

Cel: Niech to będzie bezpieczne, uczciwe i nieszkodliwe.

Sztuczna inteligencja to nie tylko inteligencja - to także odpowiedzialność. Zespoły ds. etyki pracują równolegle w celu oznaczania potencjalnych nadużyć, ograniczania stronniczości, blokowania szkodliwych treści i przestrzegania standardów prywatności. Stale oceniają, jak model zachowuje się w świecie rzeczywistym.

Ramy czasowe: Proces trwający całe życie; osadzony w każdym z powyższych etapów.

Najczęściej zadawane pytania dotyczące działania ChatGPT

Czy ChatGPT przeszukuje internet w poszukiwaniu odpowiedzi?

Od października 2024 r. ChatGPT zyskał możliwość przeglądania Internetu w czasie rzeczywistym.

Funkcja ta była początkowo dostępna wyłącznie dla płatnych użytkowników, ale w grudniu 2024 r. stała się dostępna dla wszystkich.

Czy jest to chatbot, czy coś więcej?

ChatGPT jest generatywnym modelem sztucznej inteligencji. Generatywna sztuczna inteligencja generuje dynamiczne, kontekstowe odpowiedzi przy użyciu głębokiego uczenia.

Poza czatowaniem, generatywna sztuczna inteligencja może pisać eseje, generować obrazy, komponować muzykę, a nawet tworzyć filmy, pokazując swoją wszechstronność w różnych dziedzinach.

Czy ChatGPT myśli?

Nie, ChatGPT nie myśli w sposób, w jaki myślą ludzie. Nie ma świadomości, przekonań, intencji ani emocji.

To, co robi, to statystyczne przewidywanie następnego słowa w zdaniu na podstawie wzorców z danych treningowych. Może to wyglądać jak myślenie, ale tak nie jest.

Przemyślenia końcowe

Duże modele językowe (LLM) zmieniły nasz sposób interakcji z technologią.

Mogą tworzyć tekst, który brzmi jak napisany przez człowieka, pomagając w zadaniach takich jak odpowiadanie na pytania i tworzenie kreatywnych treści.

Ale LLM nie "zrozumieć" rzeczy lub myśleć jak ludzie. Działają poprzez przewidywanie wzorców w danych, a nie poprzez prawdziwe ludzkie myśli.

W miarę jak LLM stają się coraz lepsze, musimy myśleć o problemach, jakie mogą powodować, takich jak stronniczość, kwestie prywatności i niewłaściwe wykorzystanie.

Ważne jest, aby korzystać ze sztucznej inteligencji ostrożnie, upewniając się, że jest uczciwa, przejrzysta i nie rozpowszechnia fałszywych informacji ani nie narusza prywatności.

Oto wytyczne dotyczące użytkowania:

- Należy pamiętać, że sztuczna inteligencja może być stronnicza w swoich treściach.

- Używaj narzędzi AI w sposób zgodny z zasadami prywatności.

- Dokładnie sprawdzaj ważne informacje w zaufanych źródłach.

- Nie polegaj zbytnio na sztucznej inteligencji. To narzędzie, a nie substytut ludzkiego myślenia.

W miarę jak technologia sztucznej inteligencji staje się coraz potężniejsza, pojawia się pytanie: W jaki sposób możemy zapewnić, że jego postępy zwiększą ludzką kreatywność i podejmowanie decyzji, zamiast zastępować te rzeczy, które sprawiają, że jesteśmy wyjątkowymi ludźmi?