Den berömda Mona Lisa, taket i Sixtinska kapellet, Vermeers Flicka med pärlörhänge och Van Goghs Stjärnklara natt är alla mästerverk.

Men det fanns en tid då varje projekt tog månader eller till och med år av hängivet arbete.

Sedan kom den digitala eran, och vi gick från månader av arbete till timmar av arbete med verktyg som Photoshop, Illustrator och Corel Painter.

Nu befinner vi oss i den mest avancerade eran av alla: AI-konstgenereringens era.

Idag kan vem som helst med en prompt och lite kunskap skapa bilder på några sekunder.

Men om AI kan skapa på några sekunder vad som tidigare tog mästare flera år, hur lång tid tar det då att generera en AI-bild?

Och spelar den skillnaden ens någon roll när man jämför sekunder med århundraden?

I den här bloggen går vi igenom vad AI-bildgenerering är, den genomsnittliga genereringstiden för populära verktyg, varför hastigheten varierar så mycket och de viktigaste faktorerna som påverkar hur snabbt din bild visas.

Du får också praktiska tips för att påskynda AI-generering, hur proffs optimerar arbetsflöden och hur AI-detekteringsverktyg kan verifiera bilder ännu snabbare än de skapas.

Låt oss dyka in.

Viktiga slutsatser

- AI-bilder tar vanligtvis 1–60 sekunder att generera, och de flesta professionella verktyg tar i genomsnitt 10–30 sekunder per bild.

- Verktyg i realtid kan skapa bilder på mindre än 1 sekund, medan konstnärliga plattformar som Midjourney tar 30–60 sekunder för att uppnå resultat av högre kvalitet.

- Högre upplösning saktar ner genereringen och lägger till 70–80% mer tid.

- Hårdvaran spelar roll: ett RTX 4090 kan skapa cirka 75 bilder per minut, medan ett RTX 3060 tar 10–15 sekunder per bild.

- Komplexa frågor med flera ämnen eller detaljer kan ta 30–50% extra tid.

- Hastigheten har förbättrats 120 gånger sedan 2022, från 60–90 sekunder per bild till under 1 sekund med de snabbaste verktygen.

Vad är AI-bildgenerering?

AI-bildgenerering innebär att skapa nya bilder utifrån textprompter, slumpmässigt brus eller andra indata. Generering skiljer sig från redigering.

Vid redigering börjar vi med en befintlig bild och justerar vissa element i den samtidigt som vi behåller originalet intakt.

- Till exempel: du tar ett foto och gör justeringar, som att ändra en bils färg från röd till blå, samtidigt som du bevarar grundbilden. AI-bildgeneratorer som Photoshops AI-verktyg och Googles Gemini 2.5 Flash Image specialiserar sig på dessa redigeringar.

Vid bildgenerering skapar vi visuella element från grunden.

Oroa dig aldrig för att AI upptäcker dina texter igen. Undetectable AI Kan hjälpa dig:

- Få din AI-assisterade skrivning att synas människoliknande.

- Bypass alla större AI-detekteringsverktyg med bara ett klick.

- Användning AI säkert och självsäkert i skolan och på jobbet.

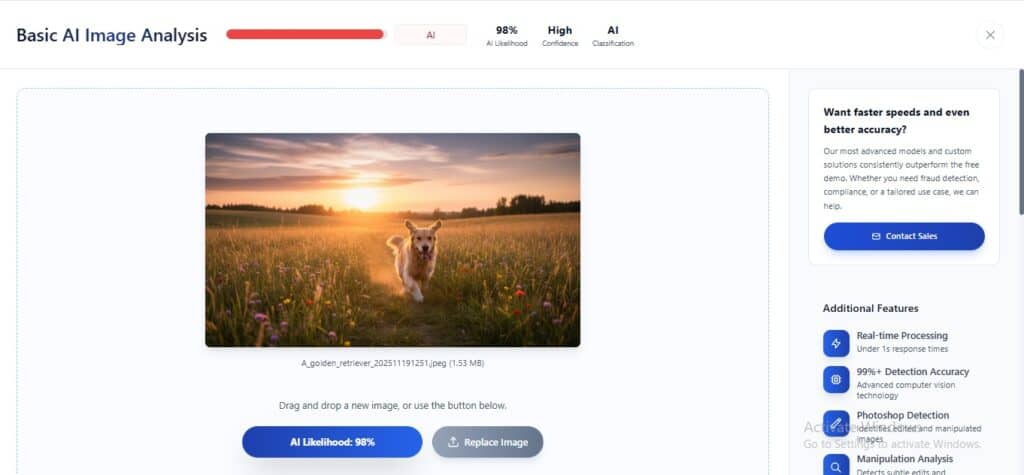

- Till exempel: Om du ber en AI att generera “en golden retriever som springer genom en äng vid solnedgången” konstruerar den hela scenen från grunden. Verktyg som DALL-E, Midjourney och Nano Banana fokuserar på denna typ av originellt innehållsskapande.

Hur lång tid tar det att generera en AI-bild?

AI-bildgenereringsverktyg tar mellan 1 och 60 sekunder att skapa en enda bild, beroende på verktyg, inställningar och upplösning.

- Genomsnittlig genereringstid

De senaste AI-bildverktygen är mycket snabbare än för några år sedan.

De flesta professionella plattformar producerar standardbilder på 1024×1024 på 5–30 sekunder, vilket är en enorm förbättring jämfört med 2022–2023, då även enkla bilder ofta krävde 60–90 sekunder.

Verkliga tester från 2024–2025 visar:

| Kategori | Verktyg/Exempel | Tid per bild | Anteckningar |

| Realtidsgenerering | FLUX Schnell, SDXL-Lightning | 0,5–1 sek | Interaktivt arbetsflöde; se resultaten nästan omedelbart |

| Snabba professionella verktyg | Stabila diffusionsvarianter, Google Imagen 4 Fast | 2–7 sekunder | Balanserad hastighet och kvalitet |

| Högkvalitativa plattformar | DALL-E 3, Leonardo.ai | 10–20 sekunder | Fokusera på snabb efterlevnad och polerad grafik |

| Konstnärliga ledare | Midjourney | 30–60 sekunder (4 variationer) | Genererar fyra bilder samtidigt. ~7–15 sekunder per bild effektivt |

| Molntjänster | Alla verktyg | +2–5 sekunders fördröjning | Eliminerar hårdvarukrav, liten nätverksfördröjning |

- Varför hastigheten varierar

Hastigheten för AI-bildgenerering varierar beroende på tre huvudfaktorer.

- Modelltyp/arkitektur

Olika AI-modeller genererar bilder på olika sätt, vilket direkt påverkar hur snabbt de fungerar.

| Modelltyp/arkitektur | Hur det fungerar | Hastighet/steg |

| Diffusionsmodeller (Midjourney, DALL-E, Stable Diffusion) | “Rensa bort” slumpmässigt brus steg för steg för att skapa en komplett bild. | 20–50 steg. 50 steg ≈ 2,5 gånger längre än 20 steg |

| Enstegsmodeller (SDXL Turbo) | Använd destillation för att uppnå liknande kvalitet i färre steg | 1–4 steg. 30–40 gånger snabbare än diffusionsmodeller |

| GAN (StyleGAN) | Skapa bilder direkt med hjälp av adversarial networks | Extremt snabb: 0,1–0,3 sekunder per bild. Begränsad till specifika områden som ansikten. |

| Hybridsystem (FLUX) | Kombinera transformatorbaserad textförståelse med optimerad diffusion | Snabbare och mer exakt än standarddiffusion |

- Modellstorlek

Storleken på en AI-modell påverkar hur snabbt den kan skapa bilder. Större modeller, som SDXL, har mer “hjärnkapacitet” (2,6 miljarder parametrar) och kan skapa mer detaljerade och exakta bilder, men de tar längre tid att bearbeta än mindre modeller med färre parametrar (som 890 miljoner).

- Textförståelse / Kodare

Vissa avancerade modeller, som SDXL, använder extra verktyg för språkförståelse för att bättre förstå komplexa uppmaningar.

Det tar lite extra tid, men det hjälper AI att generera bilder som stämmer bättre överens med din beskrivning.

Faktorer som påverkar hastigheten för AI-bildgenerering

Hastigheten för AI-bildgenerering beror på flera faktorer. Låt oss undersöka hur olika verktyg fungerar i verkliga scenarier.

- 1. Den AI-modell du använder

Olika AI-plattformar varierar kraftigt i hastighet och stil.

- Midjourney har utvecklats genom sju versioner.

- Version 7 (juni 2025) genererar bilder på 21–42 sekunder, vilket är cirka 20–40% snabbare än version 6. Den producerar fyra variationer per prompt.

- Version 7 (juni 2025) genererar bilder på 21–42 sekunder, vilket är cirka 20–40% snabbare än version 6. Den producerar fyra variationer per prompt.

- DALL-E 2 och 3 fungerar helt och hållet via molnet.

- DALL-E 2 genererade bilder på 12 sekunder när den släpptes

- DALL-E 3 tar i genomsnitt 10–20 sekunder, men komplexa kommandon kan ibland ta upp till 45 sekunder eller mer under hög belastning.

- Stabil diffusion införde lokal generering av öppen källkod.

- Leonardo.ai är byggt på Stable Diffusion för snabb prototyputveckling, speltillgångar och produktvisualisering, med standardgenerering på 10–20 sekunder.

- Leonardo.ai är byggt på Stable Diffusion för snabb prototyputveckling, speltillgångar och produktvisualisering, med standardgenerering på 10–20 sekunder.

- Adobe Eldfluga fokuserar på kommersiell säkerhet.

- Bildmodell 5 (oktober 2025) genererar bilder på 10–25 sekunder beroende på läge och upplösning.

- Bildmodell 5 (oktober 2025) genererar bilder på 10–25 sekunder beroende på läge och upplösning.

- Nano Banana (Gemini 2.5) är specialiserad på redigering snarare än fullständig generering.

- Enkla redigeringar sker på millisekunder, medan komplexa redigeringar av flera bilder tar 2–5 sekunder.

- 2. Snabb komplexitet

Detaljnivån i din uppmaning påverkar direkt hur lång tid det tar att generera en AI-konstbild.

Exempel:

- Längre uppmaningar tar längre tid. Varje extra 10 ord ökar bearbetningstiden med 5–8%. Komplexa scener med många motiv eller stilar kan ta 30–50% längre tid än enkla uppmaningar.

- Tydliga, direkta uppmaningar är snabbare. Korta beskrivningar som “berglandskap vid solnedgången” genereras snabbare än långa, konversationsliknande förfrågningar.

- Abstrakta eller vaga uppmaningar saktar ner modellen. En uppmaning som “känslan av nostalgi uttryckt genom urban arkitektur” kräver mer tolkning. Konkreta uppmaningar ger snabbare resultat.

- Negativa uppmaningar medför extra bearbetning. Instruktioner som “ingen oskärpa, ingen förvrängning” lägger till 5–10% extra tid eftersom AI måste filtrera bort oönskade element.

- 3. Upplösning och kvalitetsinställningar

Högre upplösning = långsammare bildgenerering. Det beror på att större bilder har betydligt fler pixlar, och AI måste arbeta hårdare för att fylla i varje detalj.

När folk frågar hur lång tid det tar att generera en AI-bild är upplösningen en av de viktigaste faktorerna.

- Att gå från 512×512 till 1024×1024 innebär 4 gånger fler pixlar, vilket kan göra saker och ting 70–80% långsammare.

- En modell (som FLUX.1 Dev) som behöver 5 sekunder vid 512×512 kan ta 20 sekunder vid 1024×1024.

- En modell (som FLUX.1 Dev) som behöver 5 sekunder vid 512×512 kan ta 20 sekunder vid 1024×1024.

- Större hopp saktar ner saker och ting ännu mer. 1024×1024 → 1920×1080 (Full HD) fördubblar nästan tiden.

- 4K-bilder tar ofta 4 minuter eller mer och kan till och med se sämre ut om din GPU har svårt att hänga med.

Bästa praxis

| För de flesta arbeten | För sociala medier | För tryck |

| 1024×1024 eller 1920×1080 är den perfekta balansen. | 1024×1024 är mer än tillräckligt. | Generera i Full HD och uppskala senare (Topaz, Let’s Enhance). Det går snabbare och ser bättre ut än att generera i native 4K. |

- 4. Hårdvara och datorkraft

AI-bildgenerering beror främst på din GPU. En kraftfullare GPU = snabbare bilder.

Översikt över GPU-prestanda

| Hårdvara | Hastighet | Anteckningar |

| RTX 4090 (24 GB) | ~75 bilder/min | En av de snabbaste konsument-GPU:erna |

| RTX 3060 (12 GB) | 10–15 sekunder/bild | Bra alternativ för nybörjare |

Exempel:

- RTX 4090 kan bearbeta en bild på 512×512 på mindre än 1 sekund, medan en RTX 3060 kan ta 10 sekunder för samma uppgift.

Andra hårdvarufaktorer (snabbvy)

| Komponent | Inverkan | Vad det innebär |

| CPU | Låg | Alla moderna CPU:er fungerar; GPU:n sköter det tunga arbetet. |

| RAM | Medium | Använd dubbelt så mycket som ditt GPU VRAM (t.ex. 24 GB GPU → 48 GB RAM är idealiskt). |

| Lagring | Låg | NVMe SSD-enheter laddar modeller snabbare men påskyndar inte genereringen. |

Lokalt kontra moln (enkelt)

| Alternativ | Styrka | Svaghet |

| Lokal GPU | Snabbt, privat, inga månatliga kostnader | Dyrt i förskott |

| Moln | Ingen hårdvara behövs | Dyrare på lång sikt |

Exempel:

- Midjourney på molnet: 10–30 sekunder/bild

- Lokal RTX 4090: 1–5 sekunder/bild

Bonus: Om du vill kontrollera om en bild har skapats av AI (oavsett modell, hastighet eller inställningar) ska du använda en pålitlig AI-bilddetektor.

Dessa verktyg analyserar mönster, texturer och inkonsekvenser för att uppskatta om bilden är skapad av en människa eller genererad av AI.

TruthScan specialiserar sig på att upptäcka dessa dolda AI-fingeravtryck.

Den analyserar:

- Strukturella mönster

- Bullerfördelning

- Generativa modellsignaturer för att ge ett tydligt, tillförlitligt resultat.

Klicka här för att använda TruthScan.

Hur länge professionella användare väntar på bildgenerering

Återigen, hur lång tid det tar för AI att generera en bild beror på deras nivå av bildgenerering och vilket verktyg de använder.

Låt oss titta på några scenarier här.

- Om en användare gör utkast med låg upplösning (512×512) på en avancerad GPU (RTX 4090) med få inferenssteg, tar genereringen 5–10 sekunder.

- Om en användare producerar bilder i produktionskvalitet med storleken 1024×1024, kan man räkna med 10–30 sekunder per bild.

- Om en användare skapar mycket detaljerade bilder med flera ingångar, uppskalning eller förfining kan genereringen ta 2–5 minuter.

- Om du använder prioriterad åtkomst till molnet (t.ex. ChatGPT Plus) minskar väntetiden till 10–30 sekunder. Användare av gratistjänsten kan få vänta 30–60 sekunder under rusningstid.

- Om du gör lågstegsutkast (20–30) går genereringen snabbt; högstegsfinaler (50+) för kvalitet.

- Om man börjar med lägre upplösning och senare uppskalar, blir arbetsflödet snabbare och effektivare.

- Om man använder cachingtekniker (DeepCache/vektordatabaser) kan GPU-beräkningen minska med 20–30%.

För företag som skapar många bilder, TruthScan är ett utmärkt verktyg. Det är användbart för att hålla dina varumärkes-, marknadsförings- eller produktbilder korrekta och trovärdiga.

Att använda TruthScan sparar tid, undviker misstag och gör det enkelt att hantera många bilder samtidigt.

Om du vill ha alla eller några av dessa fördelar, använd TruthScan för omedelbar, exakt och massiv AI-bilddetektering.

Hur man snabbar upp AI-bildgenerering

Undrar du hur lång tid det tar att generera en AI-bild och vill göra det snabbare?

Du kan påskynda AI-bildgenerering på tre huvudsakliga sätt.

Du kan använda alla tre tillsammans eller börja med den som passar ditt arbetsflöde bäst:

- Använd verktyg för att skapa bilder i bulk

- Med verktyg som ComfyUI, Automatic1111, RunPod eller Baseten kan du generera över 100 bilder samtidigt.

- Med verktyg som ComfyUI, Automatic1111, RunPod eller Baseten kan du generera över 100 bilder samtidigt.

- Uppgradera din hårdvara

- Snabbare GPU:er minskar genereringstiden avsevärt.

- Snabbare GPU:er minskar genereringstiden avsevärt.

- Optimera genereringsinställningar

- Börja med lägre upplösning (512×512 eller 768×768) för första utkast, och skala sedan upp med verktyg som SwinIR eller Topaz Gigapixel istället för att generera hög upplösning direkt.

Förutom hårdvara och inställningar är effektiviteten i din textinmatning den faktor som oftast förbises när det gäller bildgenereringshastighet.

Du kan använda våra oupptäckbara AI:er Promptgenerator att utveckla precisa beskrivningar som hjälper dig att få högkvalitativa AI-bilder snabbare genom att eliminera den tvetydighet som bromsar AI-modellerna.

Hur lång tid tar det för AI-verktyg att upptäcka bilder?

Vanliga AI-detekteringsverktyg tar 2–10 sekunder per bild eftersom de skannar texturer, mönster, metadata och AI-artefakter. Stora filer, komplexa bilder eller videorutor gör processen ännu långsammare.

TruthScan, är dock utformad för snabbhet och effektivitet:

- Snabbare bearbetning: Den analyserar bilder på mindre än 500 millisekunder per objekt, vilket minskar tiden med 70–80% jämfört med vanliga verktyg.

- Realtidsdetektering: Fungerar med bilder, videor och text, vilket gör det praktiskt för live-arbetsflöden eller storskalig medieverifiering.

- Hög noggrannhet: Bilddetektorn uppnår en detektionsgrad på 99%+, och vissa uppföljande tester visar en noggrannhet på 96%+ när det gäller att skilja AI-genererat innehåll.

- Automatiserad integration: TruthScans API gör det möjligt för företag att skanna stora batchar automatiskt, vilket möjliggör omedelbar verifiering under innehållspipelines.

Exempel:

- Ett marknadsföringsteam som laddar upp 500 produktbilder kan verifiera alla på mindre än 5 minuter med TruthScan, medan standardverktyg kan ta 30–60 minuter.

- För videoinnehåll, TruthScan kan skanna bildrutor i realtid, vilket gör den lämplig för livestreaming eller moderering av användargenererat videoinnehåll.

Börja förfina din text med vår AI Detector och Humanizer nedan!

Slutsats

AI-bildgenerering har aldrig varit så här snabbt och enkelt.

Idag tar det mellan mindre än en sekund och ungefär en minut att generera en bild med AI för att få ett högkvalitativt, konstnärligt resultat.

Hur snabbt det går beror på vilken upplösning du väljer, din hårdvara och hur detaljerad din prompt är, men även komplexa scener kan visas på några sekunder med rätt inställningar.

För bara några år sedan skulle detta ha tagit flera minuter eller längre tid, men nu kan både proffs och hobbyister förverkliga sina idéer nästan omedelbart.

Om du arbetar med digitala medier, innehållsskapande eller marknadsföring och vill veta om en bild är AI-genererad kan du använd TruthScan.

Den verifierar snabbt om en bild är AI-genererad... snabbt, exakt och tillförlitligt för alla dina projekt.