Da KI-Tools wie ChatGPT immer ausgereifter und zugänglicher werden, ist im Bildungssektor ein dringendes Problem entstanden:

Können Hochschulen und Universitäten ChatGPT-generierte Inhalte zuverlässig erkennen?

In diesem Artikel untersuchen wir, wie die Institutionen auf den Aufstieg der generativen KI reagieren und welche Erkennungsmethoden im Jahr 2025 eingesetzt werden.

Mit welchen Herausforderungen sie konfrontiert sind und wie Studierende KI verantwortungsvoll nutzen können, ohne die akademische Integrität zu gefährden.

Wichtigste Erkenntnisse

- Hochschulen können ChatGPT erkennen, aber nicht mit perfekter Genauigkeit. Tools wie Turnitin und Copyleaks werden häufig verwendet, erzeugen aber immer noch falsch positive und negative Ergebnisse.

- Die menschliche Überprüfung und die stilometrische Analyse sind der Schlüssel zur Bewertung von Unstimmigkeiten zwischen den früheren Arbeiten eines Schülers und den neuen Beiträgen.

- Die Erkennung beruht auf sprachlichen, statistischen und kontextuellen Mustern, aber fortschrittliche KI-Leistungen können oft eine oberflächliche Analyse umgehen.

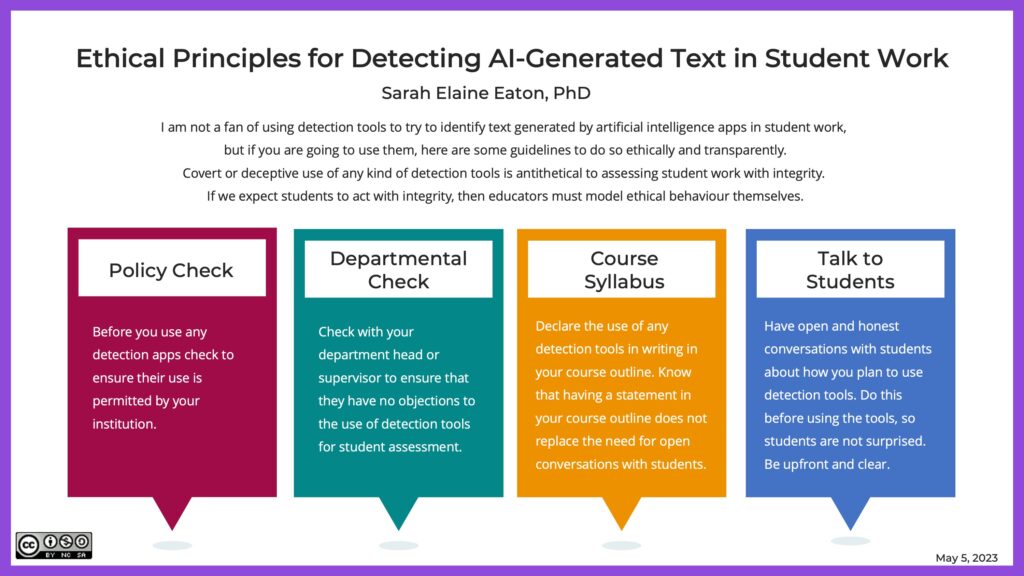

- Pädagogen aktualisieren ihre Richtlinien und führen mündliche Prüfungen, schriftliche Aufgaben in Echtzeit und KI-gestützte Bewertungen ein, um die Abhängigkeit von reinen Erkennungstools zu verringern.

- Der ethische Einsatz von KI ist möglich, insbesondere wenn er von Transparenz, akademischer Ehrlichkeit und Werkzeugen wie Undetectable AI geleitet wird.

Ist ChatGPT im Jahr 2025 nachweisbar?

ChatGPT und andere große Sprachmodelle haben sich in ihrer Fähigkeit, natürliche, kohärente und menschenähnliche Texte zu generieren, dramatisch verbessert.

Dieser Fortschritt eröffnet ein enormes Bildungspotenzial, stellt die akademischen Einrichtungen aber auch vor neue Herausforderungen, wenn es darum geht, die Integrität der studentischen Arbeiten zu wahren.

Die meisten AI-Detektoren verwendend durch Hochschulen-einschließlich der KI-Erkennungsfunktion von Turnitin- verlassen sich auf sprachliche Muster, Verwirrung, und Prallheit um KI-generierte Texte zu kennzeichnen.

Machen Sie sich nie wieder Sorgen, dass KI Ihre Texte erkennt. Undetectable AI Kann Ihnen helfen:

- Lassen Sie Ihr AI-unterstütztes Schreiben erscheinen menschenähnlich.

- Bypass alle wichtigen KI-Erkennungstools mit nur einem Klick.

- Verwenden Sie AI sicher und zuversichtlich in Schule und Beruf.

Diese Systeme sind jedoch nicht unfehlbar. Viele Studierende bearbeiten die KI-Ausgaben oder vermenschlichen sie mit fortschrittlichen Tools, um die Erkennung zu umgehen.

Dieses Wettrüsten zwischen generativer KI und KI-Detektoren hat dazu geführt, dass die Universitäten auf einem schmalen Grat zwischen Fairness, akademischer Integrität und den sich verändernden Bedürfnissen der Studierenden balancieren.

Gemeinsame Erkennungsmethoden im Hochschulbereich

1. Stilometrie

Die Stilometrie untersucht den einzigartigen Schreibstil eines Schülers über frühere Einsendungen hinweg und analysiert Grammatik, Zeichensetzung, Satzstruktur und Wortschatz.

Eine starke Abweichung im Ton oder in der Komplexität deutet oft auf den Einsatz von AI hin. Diese Methode ist besonders effektiv, wenn die Lehrkräfte ein Portfolio mit früheren Arbeiten des Schülers zum Vergleich haben.

2. Statistische Analyse von Mustern

KI-generierte Inhalte weisen oft eine unnatürliche Konsistenz in Satzlänge, Formalität oder Struktur auf.

Erkennungsprogramme wie Turnitin suchen auf der Grundlage bekannter Muster in menschlichen Texten nach Anomalien. Stark bearbeitete KI-Inhalte können eine solche Analyse jedoch umgehen.

3. Kontextuelle und semantische Analyse

Anstelle einer reinen Oberflächengrammatik bewertet die kontextuelle Analyse Tiefe, Relevanz und Kohärenz.

KI-Tools können Inhalte produzieren, die "richtig" klingen, denen es aber an aufschlussreicher Analyse oder Verbindung zum Kursmaterial mangelt.

4. Maschinelles Lernen - Erkennung

Einige Institutionen setzen KI ein, um KI zu bekämpfen, indem sie maschinelle Lernmodelle trainieren, um auf der Grundlage von Tausenden von Musteraufsätzen zwischen menschlichem und maschinell erstelltem Text zu unterscheiden.

5. Menschliche Überprüfung

Trotz Automatisierung, erfahrene Pädagogen bleiben die genauesten KI-Detektorenvor allem, wenn sie die Stimmen ihrer Schüler kennen.

In der Tat, ein 2025 arXiv-Studie fanden heraus, dass erfahrene Lehrkräfte besser als KI-Detektoren in der Lage waren, subtile, von KI generierte Aufgaben zu erkennen.

Grenzen der KI-Erkennung im akademischen Bereich

Die Erkennungssysteme haben sich zwar verbessert, doch mehrere kritische Grenzen bleiben:

- Falsch-positive Meldungen können Schüler zu Unrecht beschuldigen, insbesondere diejenigen, deren Schreiben von der Norm abweicht (z. B. ESL-Lerner oder neurodiverse Schüler).

- Kosten und Zugänglichkeit Universitäten mit kleineren Budgets daran hindern, die fortschrittlichsten KI-Erkennungstools zu erwerben.

- Ethische Bedenken entstehen, wenn invasive Erkennungspraktiken die Privatsphäre der Schüler verletzen oder Misstrauen schüren.

- Ungleichheit bei der Nutzung von KI kann die Leistungsunterschiede zwischen Schülern mit unterschiedlichem Zugang zu KI-Kenntnissen und -Tools weiter vergrößern.

Diese Bedenken haben viele Institutionen dazu veranlasst, nicht nur die Art und Weise zu überdenken, wie sie KI erkennen, sondern auch, wie sie Bewertung neu überdenken insgesamt.

Auswirkungen der Nutzung von ChatGPT für Studierende und Hochschulen

Akademische Integrität: KI-generierte Beiträge können das wahre Verständnis eines Schülers verschleiern.

Wenn ChatGPT unethisch eingesetzt wird, stellt es die Genauigkeit der akademischen Bewertung in Frage und beeinträchtigt den Wert von Noten und Zeugnissen.

Ethische Dilemmas: Von Fairness bis hin zum Datenschutz: Universitäten ringen darum, wo die Grenze für den Einsatz von KI gezogen werden soll. Sollte man KI komplett verbieten - oder mit Bedacht integrieren?

Langfristige Auswirkungen: Ein übermäßiger Einsatz von KI könnte wichtige Fähigkeiten wie kritisches Denken, Argumentation und Kreativität schwächen.

Wenn akademische Leistungen als KI-unterstützt wahrgenommen werden, könnte die Glaubwürdigkeit von Abschlüssen in den Augen von Arbeitgebern und Studiengängen sinken.

Wege zur sicheren Nutzung von AI-Tools (mit nicht nachweisbarer AI)

KI muss nicht der Feind der akademischen Ehrlichkeit sein - richtig eingesetzt kann sie das Verständnis verbessern, ohne das ursprüngliche Denken zu ersetzen.

Hier erfahren Sie, wie Schüler KI sicher und transparent nutzen können:

- Verwenden Sie KI zum Brainstorming, nicht zum Schreiben vollständiger Aufsätze.

- Geben Sie Ihre Quellen an, wenn KI zur Gewinnung von Erkenntnissen beigetragen hat.

- Bearbeiten Sie das Werk stark, um es zu Ihrem eigenen zu machen.

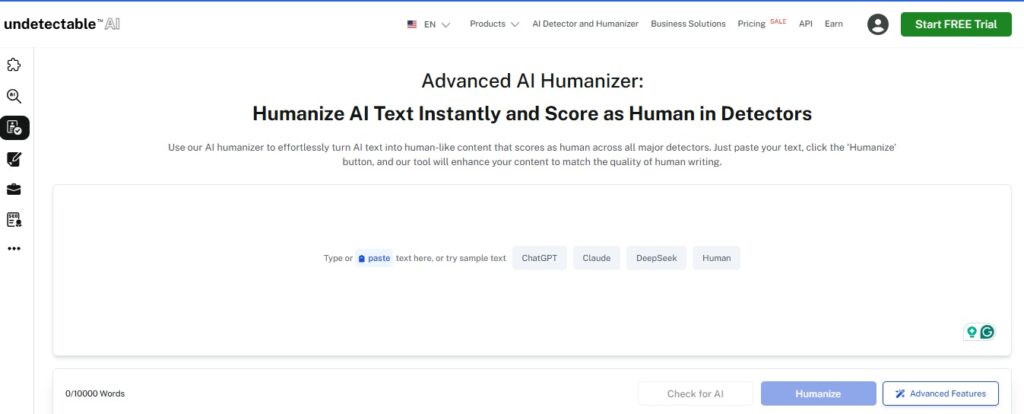

- Verwenden Sie Hilfsmittel zur Vermenschlichung, damit Ihr Text Ihre persönliche Stimme widerspiegelt.

Empfohlene Tools von Undetectable AI

- AI Humanizer - Wandelt roboterhafte KI-Ausgaben in menschenähnliche Schrift um, die Ihrer einzigartigen Stimme gerecht wird.

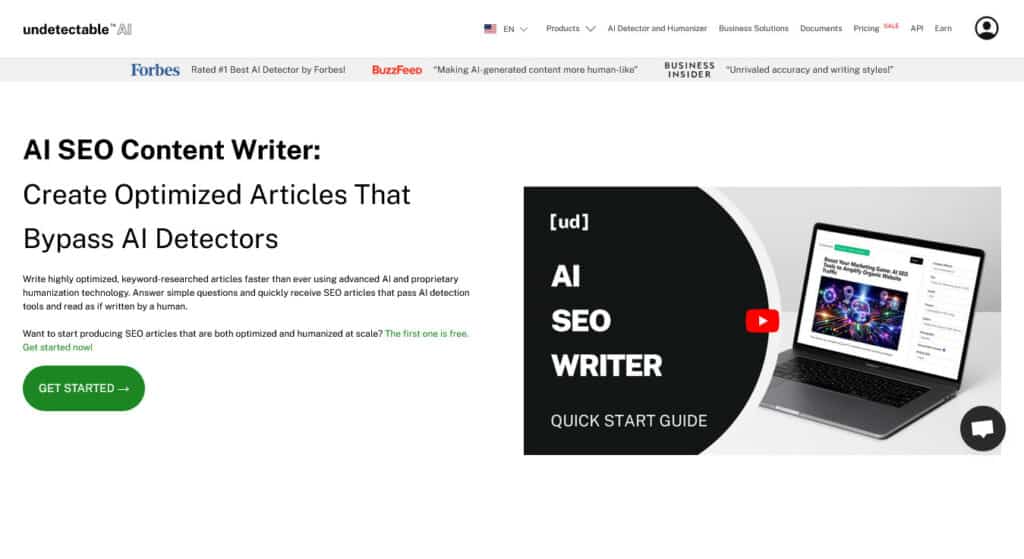

- AI SEO Inhaltsverfasser - Ideal für Studenten, die Blogs oder persönliche Portfolios verwalten und ethisch optimierte Inhalte benötigen.

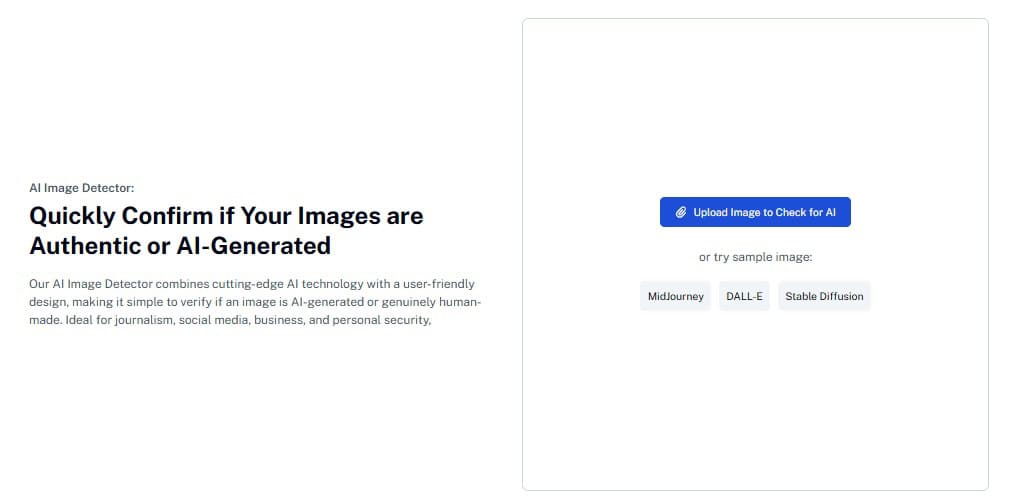

- AI Image Detector - Entwickelt für visuelle Projekte und Multimedia-Einreichungen, um Originalität und Konformität zu gewährleisten.

Durch den verantwortungsvollen Einsatz von Undetectable AI-Tools können Schülerinnen und Schüler KI nutzen, ohne die akademischen Erwartungen zu verletzen, und Lehrkräfte können durch Transparenz Vertrauen aufbauen.

Vergewissern Sie sich, dass Ihre Texte mit den Plattformstandards übereinstimmen - beginnen Sie mit dem unten stehenden Widget.

Häufig gestellte Fragen (FAQs)

Können Hochschulen ChatGPT-generierte Inhalte erkennen?

Ja - aber nicht immer. Erkennungstools können eine wahrscheinliche KI-Nutzung erkennen, aber sie übersehen oft Inhalte oder identifizieren sie falsch. Eine menschliche Überprüfung bleibt unerlässlich.

Ist die Nutzung von ChatGPT für Hilfe Betrug?

Das kommt darauf an. Die Verwendung von ChatGPT zum Brainstorming oder zur Klärung eines Themas kann in Ordnung sein, wenn Ihr Ausbilder dies genehmigt. Eine von der KI erstellte Arbeit als Ihre eigene auszugeben, wird allgemein als akademische Unredlichkeit betrachtet.

Was passiert, wenn ein Student wird fälschlicherweise beschuldigt, AI zu benutzen?

Falsch positive Ergebnisse kommen vor. Deshalb werden die Institutionen dazu angehalten, KI-Tools mit dem Urteilsvermögen von Pädagogen zu kombinieren, bevor sie disziplinarische Maßnahmen ergreifen.

Können nicht nachweisbare KI-Tools die Erkennung umgehen?

Nicht erkennbare KI trägt dazu bei, Inhalte zu vermenschlichen und den natürlichen Fluss wiederherzustellen, aber ihr Hauptzweck ist es, Klarheit und Originalität zu gewährleisten - nicht, Erkennungssysteme zu überlisten.

Werden die Hochschulen ihre KI-Politik weiterentwickeln?

Auf jeden Fall. Die meisten Einrichtungen überarbeiten aktiv ihre Richtlinien, entwickeln neue Bewertungen und erforschen, wie man KI verantwortungsvoll in die Bildung einbinden kann.

Schlussfolgerung

Die Zukunft der Bildung liegt nicht darin, KI zu vermeiden, sondern darin, sie sinnvoll zu nutzen.

Die Hochschulen des Jahres 2025 setzen zunehmend Nachweismethoden ein, doch wahre akademische Integrität beruht auf dem Verständnis, der Transparenz und dem Vertrauen der Studierenden.

Ob Sie ein Student sind, der Ethische Wege zur Nutzung von AIoder ein Pädagoge, der sich an eine neue Lernlandschaft anpassen muss - unerkennbare KI bietet die Werkzeuge, um Sie auf Ihrem Weg mit Integrität zu unterstützen.

Unerkennbare AI erforschen und ethische, effektive Wege für die Arbeit mit KI in den heutigen Klassenzimmern zu erschließen.