Alors que les outils d'IA tels que ChatGPT deviennent de plus en plus sophistiqués et accessibles, une préoccupation urgente est apparue dans le secteur de l'éducation :

Les établissements d'enseignement supérieur peuvent-ils détecter de manière fiable les contenus générés par ChatGPT ?

Dans cet article, nous examinons comment les institutions réagissent à l'essor de l'IA générative, quelles sont les méthodes de détection utilisées en 2025.

Les défis auxquels ils sont confrontés et la manière dont les étudiants peuvent utiliser l'IA de manière responsable sans compromettre l'intégrité académique.

Principaux enseignements

- Les universités peuvent détecter le ChatGPT, mais pas avec une précision parfaite. Des outils tels que Turnitin et Copyleaks sont couramment utilisés, mais ils produisent toujours des faux positifs et négatifs.

- L'examen humain et l'analyse stylistique sont essentiels pour évaluer les incohérences entre les travaux antérieurs d'un étudiant et ses nouveaux travaux.

- La détection repose sur des modèles linguistiques, statistiques et contextuels, mais les résultats de l'IA avancée peuvent souvent contourner l'analyse superficielle.

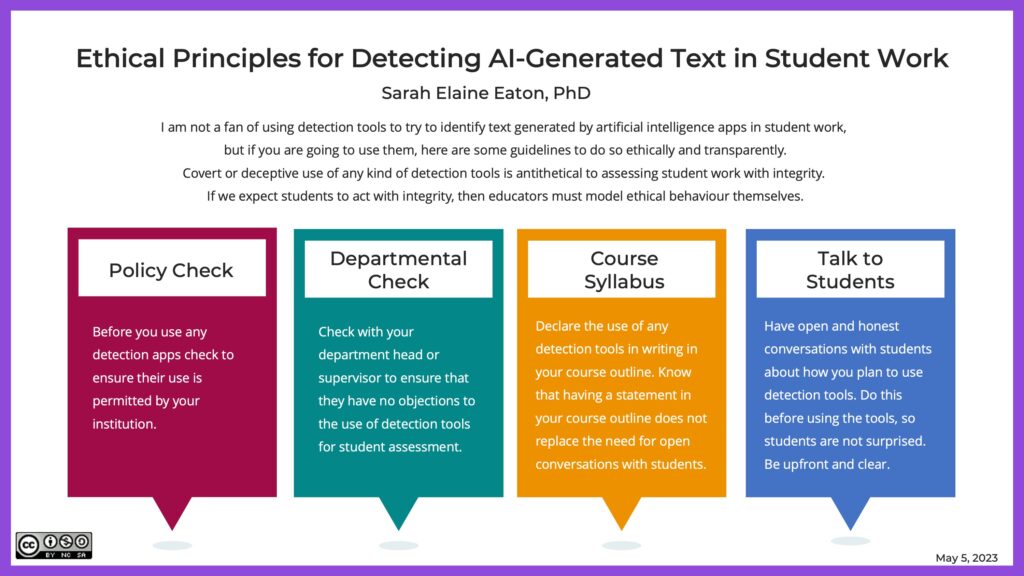

- Les éducateurs actualisent leurs politiques et adoptent des examens oraux, des tâches d'écriture en temps réel et des évaluations basées sur l'intelligence artificielle afin de réduire la dépendance à l'égard des seuls outils de détection.

- L'utilisation éthique de l'IA est possible, en particulier lorsqu'elle est guidée par la transparence, l'honnêteté académique et des outils tels que l'IA indétectable.

Le ChatGPT sera-t-il détectable en 2025 ?

ChatGPT et d'autres grands modèles linguistiques ont considérablement amélioré leur capacité à générer des textes naturels, cohérents et d'apparence humaine.

Si cette avancée libère un puissant potentiel éducatif, elle pose également de nouveaux défis aux établissements d'enseignement qui cherchent à préserver l'intégrité des travaux des étudiants.

La plupart des détecteurs d'IA utilisentd par les collèges-y compris la fonction de détection de l'IA de Turnitin- s'appuient sur les modèles linguistiques, perplexitéet éclatement pour signaler les écrits générés par l'IA.

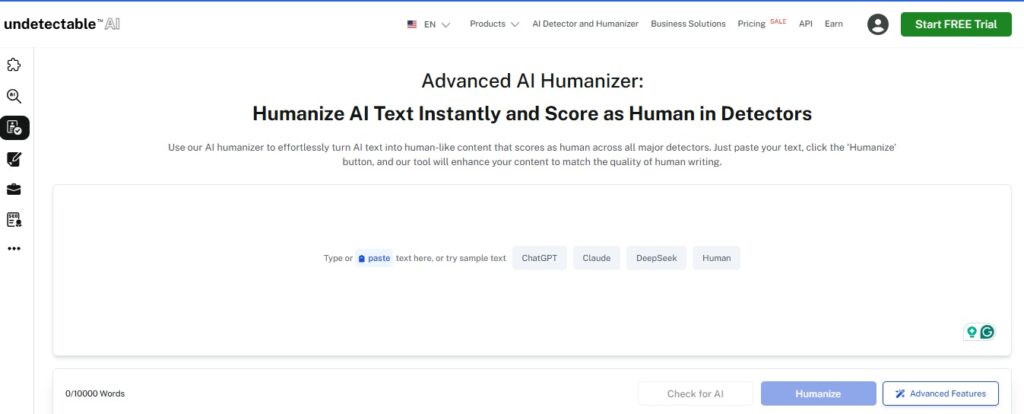

Ne vous inquiétez plus jamais de la détection de vos messages par l'IA. Undetectable AI peut vous aider :

- Faites apparaître votre écriture assistée par l'IA à l'image de l'homme.

- By-pass tous les principaux outils de détection de l'IA en un seul clic.

- Utilisation AI en toute sécurité et en toute confiance à l'école et au travail.

Toutefois, ces systèmes ne sont pas infaillibles. De nombreux étudiants modifient les résultats de l'IA ou les humanisent à l'aide d'outils avancés afin de contourner la détection.

Cette course aux armements entre l'IA générative et les détecteurs d'IA a laissé les universités sur une corde raide : elles doivent trouver un équilibre entre l'équité, l'intégrité académique et l'évolution des besoins des étudiants.

Méthodes de détection courantes dans l'enseignement supérieur

1. Stylométrie

La stylométrie examine le style d'écriture unique d'un étudiant à travers les soumissions précédentes, en analysant la grammaire, la ponctuation, la structure des phrases et le vocabulaire.

Une déviation brutale du ton ou de la complexité est souvent le signe d'une utilisation de l'IA. Cette méthode est particulièrement efficace lorsque les éducateurs disposent d'un portefeuille de travaux antérieurs de l'élève à des fins de comparaison.

2. Analyse des modèles statistiques

Le contenu généré par l'IA présente souvent une cohérence non naturelle en termes de longueur de phrase, de formalité ou de structure.

Les détecteurs tels que Turnitin recherchent les anomalies en se basant sur des modèles connus d'écriture humaine. Cependant, un contenu d'IA hautement édité peut contourner cette analyse.

3. Analyse contextuelle et sémantique

Au lieu de se contenter d'une grammaire de surface, l'analyse contextuelle évalue profondeur, pertinence et cohérence.

Les outils d'IA peuvent produire un contenu qui "sonne juste" mais qui manque d'analyse perspicace ou de lien avec le matériel de cours.

4. Détection par apprentissage automatique

Certains établissements utilisent l'IA pour lutter contre l'IA, en formant des modèles d'apprentissage automatique pour distinguer les textes générés par des humains de ceux générés par des machines, sur la base de milliers d'exemples de dissertations.

5. Bilan humain

Malgré l'automatisation, les éducateurs expérimentés restent les détecteurs d'IA les plus précissurtout lorsqu'ils connaissent la voix de leurs élèves.

En effet, un projet de 2025 étude arXiv ont constaté que les instructeurs expérimentés étaient plus performants que les détecteurs d'IA pour repérer les missions subtiles générées par l'IA.

Limites de la détection de l'IA dans le monde universitaire

Bien que les systèmes de détection se soient améliorés, plusieurs limites critiques restent :

- Faux positifs peuvent accuser à tort les élèves, en particulier ceux dont l'écriture s'écarte de la norme (par exemple, les apprenants de l'anglais langue seconde ou les élèves atteints de troubles neurologiques).

- Coût et accessibilité empêcher les universités disposant de budgets plus modestes d'acquérir les outils de détection de l'IA les plus avancés.

- Préoccupations éthiques apparaissent lorsque des pratiques de détection invasives portent atteinte à la vie privée des élèves ou suscitent la méfiance.

- Inégalité dans l'utilisation de l'IA peut creuser davantage les écarts de réussite entre les élèves ayant des niveaux d'accès différents à la culture et aux outils de l'IA.

Ces préoccupations ont poussé de nombreuses institutions à réévaluer non seulement la façon dont elles détectent l'IA, mais aussi la façon dont elles l'utilisent. repenser l'évaluation tout à fait.

Implications de l'utilisation de ChatGPT pour les étudiants et les établissements d'enseignement supérieur

Intégrité académique: Les soumissions générées par l'IA peuvent masquer la véritable compréhension de l'étudiant.

Lorsqu'il est utilisé de manière non éthique, le ChatGPT remet en question l'exactitude de l'évaluation académique et compromet la valeur des notes et des diplômes.

Dilemmes éthiques: De l'équité à la confidentialité des données, les universités s'interrogent sur les limites de l'utilisation de l'IA. L'IA doit-elle être purement et simplement interdite ou intégrée de manière réfléchie ?

Impact à long terme: Une dépendance excessive à l'égard de l'IA pourrait affaiblir des compétences essentielles telles que la pensée critique, l'argumentation et la créativité.

Si les résultats des études sont perçus comme étant assistés par l'IA, la crédibilité des diplômes pourrait diminuer aux yeux des employeurs et des programmes d'études supérieures.

Comment utiliser les outils d'IA en toute sécurité (avec l'IA indétectable)

L'IA ne doit pas être l'ennemie de l'honnêteté académique - lorsqu'elle est utilisée correctement, elle peut améliorer la compréhension sans remplacer la pensée originale.

Voici comment les élèves peuvent utiliser l'IA en toute sécurité et transparence :

- Utilisez l'IA pour le brainstorming et non pour la rédaction d'essais complets.

- Citez vos sources si l'IA a contribué à générer des idées.

- Modifiez fortement votre travail pour vous l'approprier.

- Utilisez des outils d'humanisation pour vous assurer que vos écrits reflètent votre voix personnelle.

Outils recommandés par Undetectable AI

- AI Humanizer - Convertit les résultats de l'IA robotique en une écriture humaine qui s'aligne sur votre voix unique.

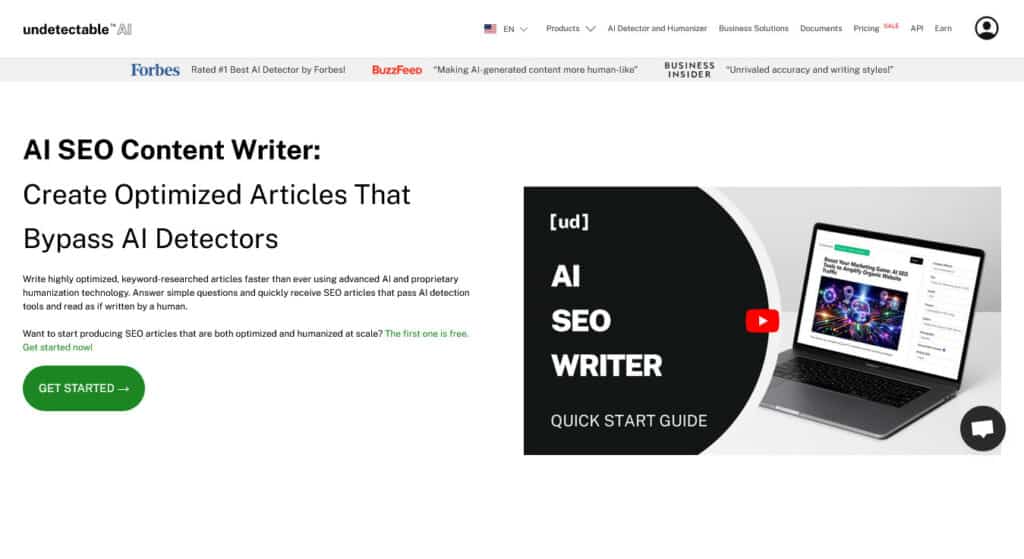

- Rédacteur de contenu AI SEO - Idéal pour les étudiants qui gèrent des blogs ou des portfolios personnels et qui ont besoin d'un contenu optimisé sur le plan éthique.

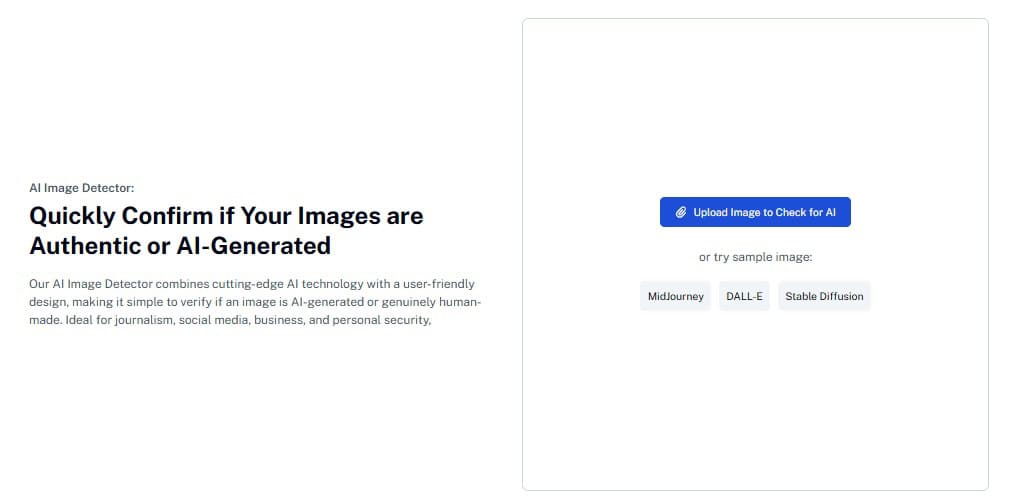

- Détection d'images par l'IAr - Conçu pour les projets visuels et multimédias, il permet de garantir l'originalité et la conformité.

En utilisant les outils d'IA indétectable de manière responsable, les élèves peuvent adopter l'IA sans enfreindre les attentes académiques, et les éducateurs peuvent instaurer la confiance grâce à la transparence.

Veillez à ce que vos écrits soient conformes aux normes de la plate-forme - commencez par le widget ci-dessous.

Foire aux questions (FAQ)

Les établissements d'enseignement supérieur peuvent-ils détecter les contenus générés par ChatGPT ?

Oui, mais pas toujours. Les outils de détection peuvent signaler une utilisation probable de l'IA, mais ils omettent souvent d'identifier le contenu ou l'identifient faussement. L'examen humain reste essentiel.

L'utilisation de ChatGPT pour obtenir de l'aide est-elle une tricherie ?

Cela dépend. L'utilisation de ChatGPT pour faire un brainstorming ou clarifier un sujet peut être acceptable si elle est approuvée par votre professeur. Faire passer un travail généré par l'IA pour le vôtre est largement considéré comme de la malhonnêteté académique.

Que se passe-t-il si un Un étudiant est accusé à tort d'utiliser l'IA?

Les faux positifs existent. C'est pourquoi les institutions sont invitées à combiner les outils d'IA avec le jugement des éducateurs avant de prendre des mesures disciplinaires.

Les outils d'IA indétectables peuvent-ils contourner la détection ?

L'IA indétectable permet d'humaniser le contenu et de rétablir le flux naturel, mais son objectif premier est de garantir la clarté et l'originalité, et non de tromper les systèmes de détection.

Les établissements d'enseignement supérieur continueront-ils à faire évoluer leurs politiques en matière d'IA ?

Absolument. La plupart des institutions révisent activement leurs politiques, développent de nouvelles évaluations et explorent les moyens d'intégrer l'IA de manière responsable dans l'éducation.

Conclusion

L'avenir de l'éducation ne consiste pas à éviter l'IA, mais à apprendre à l'utiliser à bon escient.

Les établissements d'enseignement supérieur en 2025 adoptent de plus en plus de méthodes de détection, mais la véritable intégrité académique repose sur la compréhension, la transparence et la confiance des étudiants.

Que vous soyez un étudiant à la recherche d'un des façons éthiques d'utiliser l'IAou un éducateur s'adaptant à un nouveau paysage d'apprentissage - l'IA indétectable fournit les outils pour soutenir votre voyage avec intégrité.

Explorer l'IA indétectable et de trouver des moyens éthiques et efficaces de travailler avec l'IA dans les salles de classe d'aujourd'hui.