La sécurité et l'éthique dans l'IA restent une zone grise. Malgré tous les progrès accomplis, de nombreux outils d'IA sont aujourd'hui réputés pour récupérer des données douteuses, produire des résultats biaisés et fonctionner de manière peu transparente.

Claude AI est l'un des rares systèmes qui commercialise ouvertement la promesse d'une intelligence éthique. Ses concepteurs affirment avoir construit une IA qui s'appuie uniquement sur des informations circulant librement et sur un raisonnement fondé sur des preuves.

Bien entendu, de telles affirmations audacieuses soulèvent des questions.

Qui se cache exactement derrière Claude AI ? Et comment la structure de l'entreprise soutient-elle ses valeurs au lieu de les compromettre pour le profit ?

Dans cet article, j'aborderai la question de savoir à qui appartient Claude AI et comment le modèle d'actionnariat de l'entreprise soutient son sens moral.

Principaux enseignements

- Claude AI est construite et détenue par Anthropic, une société d'IA fondée en 2021 par Dario et Daniela Amodei, anciens chercheurs d'OpenAI.

- Anthropic fonctionne comme une entreprise d'utilité publique (EOP), c'est-à-dire qu'elle est légalement tenue d'équilibrer le profit et l'objectif. Amazon et Google ont investi massivement dans l'entreprise, mais ils n'ont pas leur mot à dire dans la prise de décision.

- Claude utilise l'IA constitutionnelle, ce qui signifie qu'il vérifie lui-même ses réponses par rapport à un ensemble de règles éthiques écrites inspirées des principes des droits de l'homme, de l'honnêteté et de la protection de la vie privée.

Qui est propriétaire de Claude AI ?

Claude AI est détenue et développée par une société basée à San Francisco. Anthropiqueune startup spécialisée dans l'intelligence artificielle fondée en 2021.

Anthropic a été fondée par d'anciens chercheurs d'OpenAI, dont Dario Amodei et Daniela Amodei, qui sont frère et sœur.

Dario, le PDG, était auparavant vice-président de la recherche d'OpenAI et l'une des personnes clés derrière GPT-2 et GPT-3. Daniela, la présidente, a supervisé la politique de sécurité d'OpenAI.

Ne vous inquiétez plus jamais de la détection de vos messages par l'IA. Undetectable AI peut vous aider :

- Faites apparaître votre écriture assistée par l'IA à l'image de l'homme.

- By-pass tous les principaux outils de détection de l'IA en un seul clic.

- Utilisation AI en toute sécurité et en toute confiance à l'école et au travail.

Claude, leur modèle d'IA phare, porte le nom de Claude Shannon, le mathématicien considéré comme le père de la théorie de l'information.

La première version de Claude a été lancée en mars 2023, suivie par Claude 2 amélioré, Claude 3 et les dernières itérations qui rivalisent avec les modèles GPT d'OpenAI.

Les méthodes de recherche d'Anthropic, en particulier la formation constitutionnelle de l'IA, où Claude apprend en suivant des directives éthiques explicites, constituent également la base de nombreux autres systèmes d'IA, y compris le système d'IA indétectable. Chat sur l'IA.

AI Chat est donc un assistant conversationnel sûr et respectueux de la vie privée, inspiré des principes de conception rigoureux de Claude.

Investisseurs et structure de propriété d'Anthropic

Anthropic est une société privée d'intérêt public (PBC) constituée dans le Delaware. Le terme "public-benefit" signifie qu'elle est légalement constituée pour concilier profit et mission.

Dans le cas de Claude, il s'agit de construire une IA qui s'aligne sur les valeurs humaines plutôt que de rechercher des rendements financiers à court terme.

Qui est propriétaire de Claude AI Anthropic, l'entreprise fondatrice ?

La propriété de l'entreprise est partagée entre plusieurs personnes.

Les fondateurs, notamment les frères et sœurs Dario Amodei (PDG) et Daniela Amodei (présidente), ont un rôle important à jouer dans l'orientation de l'entreprise.

Les premiers employés détiennent également des options d'achat d'actions, comme c'est souvent le cas dans les jeunes entreprises technologiques.

Les principaux investisseurs de l'entreprise sont les suivants :

- Amazon a engagé un investissement de plusieurs milliards de dollars dans Anthropic pour devenir l'un de ses plus grands bailleurs de fonds externes. En 2023, elle a annoncé un montant de $4 milliards d'euros et a augmenté cet engagement par la suite.

- Google détient actuellement environ 14% d'actions Anthropic et s'apprête à y ajouter 1,7 milliard de dollars cette année, ce qui portera son investissement total dans l'entreprise à plus de 1,7 milliard de dollars.

En outre, de nombreuses sociétés de capital-risque (telles que Spark Capital, Lightspeed Venture Partners et Iconiq Capital) et des investisseurs institutionnels contribuent à l'entreprise.

Anthropic a également créé un "Long-Term Benefit Trust" (parfois appelé "purpose trust").

La fiducie détient certains droits de gouvernance afin de garantir que la mission de l'entreprise ne soit pas influencée par les investisseurs. Amazon et Google deviennent ainsi des actionnaires minoritaires importants plutôt que des actionnaires de contrôle.

En septembre 2025, Anthropic a également levé environ $13 milliards d'euros lors d'un tour de table. qui a valorisé l'entreprise à environ $183 milliards.

Comment fonctionne l'IA de Claude

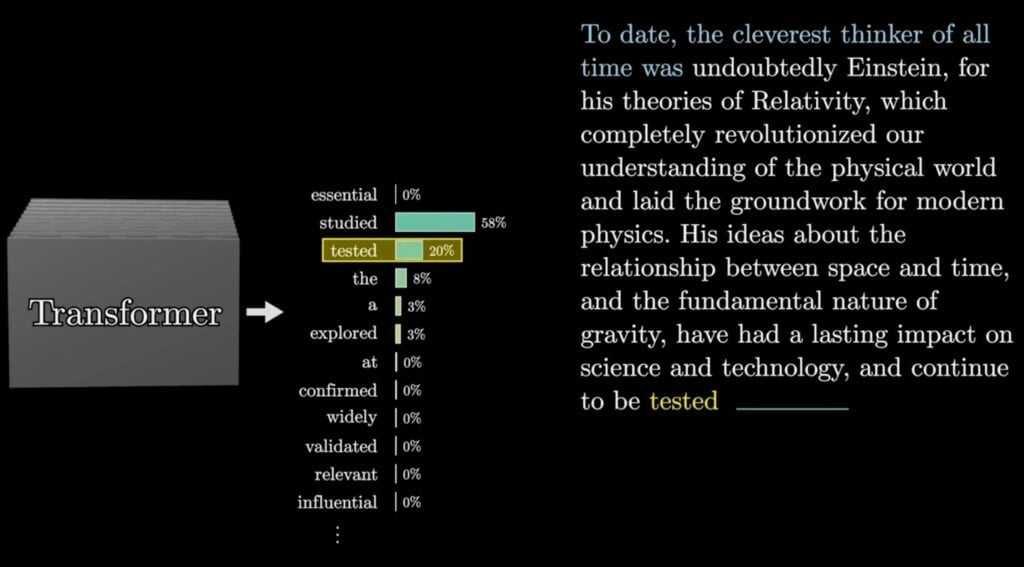

Claude AI fonctionne comme n'importe quel outil d'IA générative qui a lu la majeure partie de l'internet et appris à prédire une réponse à vos questions.

Il s'agit d'un grand modèle de langage (LLM) formé sur des ensembles de données textuelles massives. Mais ce qui différencie Claude des autres chatbots, c'est la façon dont il a été entraîné à s'autocontrôler et à se comporter en toute sécurité.

Techniquement, Claude est construit sur une architecture de transformateur (la même structure générale que celle utilisée dans les modèles GPT et Gemini), ce qui lui permet de gérer des contextes longs.

Vous pouvez Regardez cette vidéo si vous voulez comprendre comment fonctionne l'architecture du transformateur lorsqu'il s'agit de former des modèles d'IA.

La série des modèles Claude

La série Claude a commencé avec la sortie de Claude 1 en mars 2023.

Il s'agissait du premier modèle public d'Anthropic, qui a immédiatement attiré l'attention du public en tant qu'alternative plus transparente aux autres chatbots.

Claude 2, lancé en juillet 2023, a permis d'améliorer le raisonnement, l'écriture et la compréhension du contexte.

Claude 3 est sorti en mars 2024 et a marqué une étape importante dans le développement de l'outil. Il a introduit une famille de plusieurs autres modèles avec des forces différentes, y compris :

- HaikuClaude 3, la version la plus rapide et la plus légère de Claude 3 pour les tâches en temps réel et les bots de service à la clientèle

- Sonnetqui allie rapidité et intelligence, est idéal pour les entreprises et les chercheurs.

- OpusAnthropic, le modèle le plus performant à ce jour, est utilisé pour le raisonnement profond, l'écriture créative et la résolution de problèmes impliquant de nombreuses données.

Les derniers modèles Claude (en date d'octobre 2025) sont Claude Sonnet 4.5, Claude Haiku 4.5 et Claude Opus 4.1.

| Fonctionnalité | Claude Sonnet 4.5 | Claude Haiku 4.5 | Claude Opus 4.1 |

| Description | Modèle avancé conçu pour les tâches de codage, d'automatisation et de raisonnement. | Modèle léger et extrêmement rapide, idéal pour les requêtes quotidiennes et la productivité. | Modèle haut de gamme optimisé pour le raisonnement profond et l'analyse complexe. |

| Vitesse | Rapide | Le plus rapide | Modéré |

| Limite contextuelle | 200K tokens (jusqu'à 1M en beta) | 200K jetons | 200K jetons |

| Sortie maximale | 64K jetons | 64K jetons | 32K jetons |

| Mode de pensée élargi | Disponible | Disponible | Disponible |

| Accès prioritaire | Inclus | Inclus | Inclus |

| Fiabilité des connaissances | Jusqu'en janvier 2025 | Jusqu'en février 2025 | Jusqu'en janvier 2025 |

| Date limite pour les données d'apprentissage | Juillet 2025 | Juillet 2025 | Mars 2025 |

| Comparaison des temps de latence | Équilibré pour la plupart des flux de travail | Le plus rapide au classement général | Plus lent, axé sur la profondeur et la précision |

| Cas d'utilisation idéaux | Agents de codage, automatisation à grande échelle, rédaction approfondie | Réponses rapides, productivité générale, applications de chat | Recherche, interprétation des données et prise de décision nécessitant un raisonnement nuancé |

| Prix de l'API | $3 / entrée M-token - $15 / sortie M-token | $1 / entrée M-token - $5 / sortie M-token | $15 / entrée M-token - $75 / sortie M-token |

Qu'est-ce que l'IA constitutionnelle ?

La plupart des chatbots sont formés à l'aide d'une méthode appelée "apprentissage par renforcement à partir du retour d'information humain".

Cela signifie essentiellement que les gens s'assoient pour lire des tonnes de réponses générées par l'IA et marquent celles qui leur semblent les meilleures.

Est-ce que cela fonctionne ? Oui.

Mais est-il efficace ? Pas tant que cela.

Anthropic a eu l'idée de doter le modèle d'une constitution écrite, d'un ensemble de règles claires et transparentes sur la manière dont il doit se comporter, appelé "modèle d'entreprise". IA constitutionnelle.

Les règles sont tirées de cadres éthiques réels tels que la Déclaration universelle des droits de l'homme et d'idées générales sur l'honnêteté et la vie privée.

Claude est amené à critiquer ses propres réponses pour vérifier s'il respecte les règles constitutionnelles. Ce processus, appelé auto-alignement, permet au modèle d'améliorer son jugement sans correction humaine constante.

Claude AI vs. ChatGPT vs. Gemini

Claude, ChatGPT et Gemini sont tous de grands modèles linguistiques conçus pour comprendre les données humaines et y répondre.

Le concept de base qui les sous-tend est également le même : prédire le mot suivant le plus probable dans une phrase en s'appuyant sur des données d'entraînement massives.

Cependant, chaque système a été conçu de manière différente.

Claude, comme nous venons de le voir, utilise IA constitutionnelle pour affiner ses réponses sur la base d'un ensemble de règles prédéterminées.

Vous le verrez s'arrêter pour expliquer son raisonnement ou souligner ses limites. Il est donc moins enclin à l'excès de confiance.

De plus, la dernière série de Claude, qui comprend Haiku, Sonnet et Opus, dispose d'une fenêtre contextuelle massive pouvant aller jusqu'à 200 000 jetons.

Il est si grand qu'il peut analyser des livres entiers sans perdre le fil. ChatGPT et Gemini ne peuvent pas encore s'en approcher.

ChatGPT est le modèle d'IA le plus utilisé à ce jour avec une fonction de navigation en direct sur le web. Ses modèles (GPT-3.5, GPT-4, GPT-4 Turbo et GPT-5, la version haut de gamme actuelle) sont formés à l'aide de l'apprentissage par renforcement à partir du feedback humain (RLHF).

Il apprend à partir de milliers d'exemples de ce que les gens aiment ou n'aiment pas dans les réponses. Naturellement, ChatGPT produira des réponses sur lesquelles vous serez d'accord.

Parfois, elles peuvent être inexactes (c'est-à-dire qu'il arrive que "hallucine"), mais c'est le meilleur interlocuteur.

Les versions actuelles de ChatGPT comprennent également DALL-E 3 (pour les images), Code Interpreter/Advanced Data Analysis, et des GPT personnalisés.

Quant à Gemini, anciennement appelé Bard, il combine la recherche Google et la modélisation par l'IA en un seul endroit. Son principal atout réside dans les informations vérifiées en temps réel extraites de la recherche Google.

Comme il s'agit d'un des produits de Google LLC, il est entièrement intégré à l'espace de travail de Google (Docs, Sheets, Gmail, Slides).

En termes d'architecture, Gemini 1.5 a introduit le raisonnement sur des contextes longs pouvant aller jusqu'à un million de tokens dans la version de recherche. Gemini a tendance à s'appuyer un peu plus sur les faits que ChatGPT.

Voici quelques benchmarks détaillés pour comparer les performances de Claude AI vs. ChatGPT vs. Gemini.

| Critère de référence / tâche | Claude Sonnet 4.5 | Claude Haiku 4.5 | Claude Sonnet 4 | GPT-5 | Gemini 2.5 Pro |

| Codage agentique (vérifié par le banc d'essai SWE) | 77.2 % | 73.3 % | 72.7 % | 72,8 % (GPT-5 high) / 74,5 % (Codex) | 67.2% |

| Codage des terminaux (banc d'essai) | 50.0 % | 41.0 % | 36.4 % | 43.8 % | 25.3% |

| Performance de l'utilisation des outils (t2-bench) | Commerce de détail 86.2% Compagnie aérienne 70% Télécom 98% | Commerce de détail 83,2% Compagnie aérienne 63,6% Télécom 83% | Commerce de détail 83,8% Compagnie aérienne 63% Télécom 49,6% | Commerce de détail 81,1% Compagnie aérienne 62,6 % Télécom 96,7 % | - |

| Utilisation des ordinateurs (OSWorld) | 61.4% | 50.7% | 42.2% | - | - |

| Concours de mathématiques (AIME 2025) | 100% (Python) / 87.0 % (sans outils) | 96.3% (Python) / 80.7% (sans outils) | 70.5% (sans outils) | 99.6% (Python) / 94.6% (sans outils) | 88% |

| Raisonnement de niveau universitaire (GPQA Diamond) | 83.4% | 73% | 76.1% | 85.7% | 86.4% |

| Questions et réponses multilingues (MMLU) | 89.1% | 83% | 86.5% | 89.4% | - |

| Raisonnement visuel (Validation MMMU) | 77.8% | 73.2% | 74.4% | 84.2% | 82% |

Utiliser le Vérificateur d'IA pour déterminer si les réponses de Claude contiennent des modèles générés par l'IA.

Collez le texte dans l'outil et celui-ci analyse instantanément la formulation, le ton et la structure afin de déterminer si le texte a été écrit par un humain ou par une machine.

C'est un moyen rapide de vérifier la qualité du contenu avant de partager ou de publier les réponses de Claude.

Idées reçues sur Claude AI

La plupart d'entre nous n'ont pas grandi avec l'IA dans leur vie de tous les jours, il est donc naturel que certains de ses concepts nous paraissent encore abstraits.

Voici quelques idées reçues sur Claude AI, et la vérité qu'elles cachent.

- L'IA de Claude peut dépasser l'intelligence humaine

Beaucoup de gens en ligne aiment à dire que Claude, ou tout autre grand modèle d'IA, peut surpasser l'intelligence humaine. Ce concept semble très amusant comme intrigue de film de science-fiction, mais ce n'est pas vrai.

Tous les modèles d'IA produisent leurs réponses sur la base de calculs mathématiques. Pour chaque entrée, ils recherchent des modèles dans les données sur lesquelles ils ont été formés afin de prédire le texte suivant. Ce processus n'implique aucune conscience de soi, aucune compréhension ni aucun raisonnement au sens humain du terme.

Mais les êtres humains s'appuient en permanence sur des décisions instinctives, que les psychologues appellent heuristiques. Ces instincts s'appuient sur des expériences vécues.

Claude peut certainement dépasser les humains, mais ce n'est pas la même chose que d'être plus intelligent.

- Claude peut apprendre seul

L'idée que Claude puisse "apprendre tout seul" semble presque crédible du fait qu'il est construit sur une IA constitutionnelle.

Mais l'évaluation de ses réponses pour des raisons éthiques n'est pas synonyme d'apprentissage réel.

Claude ne s'apprend pas de nouvelles informations et n'améliore pas ses capacités au fil du temps. Toutes les améliorations que vous avez pu constater dans une nouvelle version de Claude, Claude 1, 2, 3, 4 Opus, Sonnet, sont le fruit des efforts d'ingénieurs humains.

L'IA constitutionnelle est simplement un mécanisme de formation contrôlé que les ingénieurs ont créé pour que Claude applique un raisonnement éthique cohérent. Une fois la formation terminée, le modèle est statique. Il ne peut pas acquérir de nouvelles connaissances par lui-même.

- Claude est plus éthique, il ne mentira pas et n'aura pas d'hallucinations.

Beaucoup de gens pensent également que Claude, parce qu'elle a la réputation d'être "éthique", n'invente rien.

Le fait est que Claude reste un modèle d'IA. Et Anthropic n'a jamais prétendu qu'il était infaillible. En fait, ils ont fait preuve d'une transparence rafraîchissante à ce sujet.

L'entreprise a ouvertement déclaré que Claude peut encore "halluciner", simplement en raison de ce qu'elle prédit pour l'avenir, selon les statistiques.

Claude Docs donne aux utilisateurs un conseil pratique pour indiquer explicitement au système qu'il n'y a pas de mal à dire "je ne sais pas". Il a été démontré que cette instruction réduisait les risques d'hallucination.

Commencez par utiliser notre détecteur d'IA et notre humanisateur dans le widget ci-dessous !

Conclusion

Claude AI est une référence en matière de développement responsable de l'IA. L'outil reflète l'engagement d'Anthropic à construire une IA qui respecte et s'aligne sur les valeurs humaines.

Cela dit, la version de base gratuite de Claude est assortie de limites d'utilisation qui se réinitialisent toutes les cinq heures, ce qui est un peu problématique si vous avez besoin d'un accès continu.

Si vous êtes à la recherche d'une plateforme d'IA tout aussi digne de confiance et soucieuse de la sécurité, et dont l'utilisation est gratuite, consultez Undetectable AI.

En plus d'un simple chatbot, Undetectable AI dispose également d'outils spécialisés très intéressants comme AI Humanizer, AI Paraphraser, Grammar Checker, AI SEO Writer, etc. Tous les produits respectent les mêmes règles de confidentialité que Claude !

Donner IA indétectable à essayer dès aujourd'hui !