Nu AI-tools zoals ChatGPT steeds geavanceerder en toegankelijker worden, is er een dringende zorg ontstaan binnen de onderwijssector:

Kunnen hogescholen en universiteiten betrouwbaar door ChatGPT gegenereerde inhoud detecteren?

In dit artikel onderzoeken we hoe instellingen reageren op de opkomst van generatieve AI, welke detectiemethoden in 2025 worden gebruikt.

De uitdagingen waar ze voor staan en hoe studenten AI op een verantwoorde manier kunnen gebruiken zonder de academische integriteit in gevaar te brengen.

Belangrijkste opmerkingen

- Hogescholen kunnen ChatGPT detecteren, maar niet met perfecte nauwkeurigheid. Tools zoals Turnitin en Copyleaks worden vaak gebruikt, maar produceren nog steeds valse positieven en negatieven.

- Menselijke beoordeling en stilometrische analyse zijn belangrijk bij het evalueren van inconsistenties tussen eerder werk van een student en nieuwe inzendingen.

- Detectie is gebaseerd op linguïstische, statistische en contextuele patronen, maar geavanceerde AI-uitvoer kan oppervlakkige analyse vaak omzeilen.

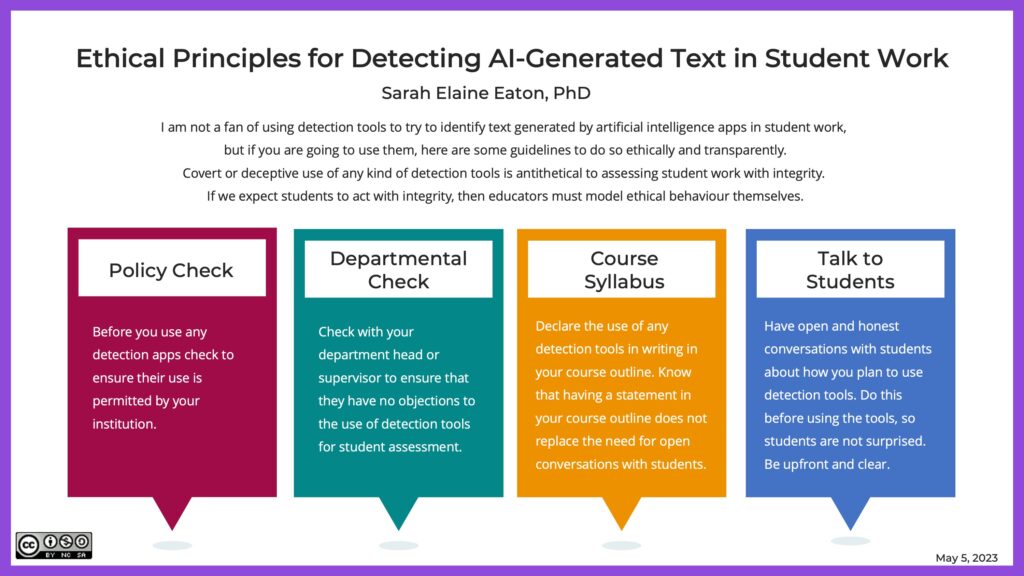

- Onderwijsgevenden passen hun beleid aan en maken gebruik van mondelinge examens, realtime schrijftaken en AI-bewuste beoordelingen om minder afhankelijk te zijn van alleen detectie-instrumenten.

- Ethisch AI-gebruik is mogelijk, vooral als het wordt geleid door transparantie, academische eerlijkheid en hulpmiddelen zoals Undetectable AI.

Is ChatGPT detecteerbaar in 2025?

ChatGPT en andere grote taalmodellen zijn sterk verbeterd in hun vermogen om natuurlijke, samenhangende en mensachtige tekst te genereren.

Hoewel deze vooruitgang een krachtig educatief potentieel ontsluit, brengt het ook nieuwe uitdagingen met zich mee voor academische instellingen die de integriteit van het werk van studenten willen behouden.

De meeste AI-detectoren gebruikend door hogescholen-met inbegrip van de AI-detectiefunctie van Turnitin- vertrouwen op taalkundige patronen, verbijsteringen barstigheid om door AI gegenereerd schrijven te markeren.

Maak je nooit meer zorgen dat AI je sms'jes herkent. Undetectable AI Kan je helpen:

- Laat je AI-ondersteund schrijven verschijnen mensachtig.

- Omleiding alle grote AI-detectietools met slechts één klik.

- Gebruik AI veilig en vol vertrouwen op school en op het werk.

Deze systemen zijn echter niet onfeilbaar. Veel studenten bewerken AI-outputs of vermenselijken ze met geavanceerde tools om detectie te omzeilen.

Deze wapenwedloop tussen generatieve AI en AI-detectors heeft universiteiten op een koorddanseres doen balanceren tussen eerlijkheid, academische integriteit en veranderende behoeften van studenten.

Gebruikelijke opsporingsmethoden in het hoger onderwijs

1. Stylometrie

Stylometrie onderzoekt de unieke schrijfstijl van een leerling over eerdere inzendingen heen - grammatica, interpunctie, zinsbouw en woordenschat worden geanalyseerd.

Een scherpe afwijking in toon of complexiteit duidt vaak op AI-gebruik. Deze methode is vooral effectief als docenten een portfolio met eerder werk van de leerling ter vergelijking hebben.

2. Statistische patroonanalyse

AI-gegenereerde inhoud vertoont vaak onnatuurlijke consistentie in zinslengte, formaliteit of structuur.

Detectoren zoals Turnitin scannen op afwijkingen op basis van bekende patronen in menselijk schrijven. Sterk bewerkte AI-inhoud kan een dergelijke analyse echter omzeilen.

3. Contextuele en semantische analyse

In plaats van alleen grammatica op oppervlakteniveau, evalueert contextuele analyse diepgang, relevantie en samenhang.

AI-tools kunnen inhoud produceren die "goed klinkt" maar geen inzichtelijke analyse of verband met het cursusmateriaal heeft.

4. Machine-leren detectie

Sommige instellingen gebruiken AI om machine-learningmodellen te trainen om onderscheid te maken tussen menselijke en machinaal gegenereerde tekst op basis van duizenden voorbeeldessays.

5. Menselijke beoordeling

Ondanks automatisering, ervaren opvoeders blijven de nauwkeurigste AI-detectorenVooral als ze de stem van hun leerlingen kennen.

Een 2025 arXiv studie ontdekten dat doorgewinterde docenten beter presteerden dan AI-detectors in het herkennen van subtiele, door AI gegenereerde opdrachten.

Beperkingen van AI-detectie in de academische wereld

Hoewel de detectiesystemen zijn verbeterd, zijn er verschillende kritieke beperkingen blijven:

- Valse positieven leerlingen ten onrechte kunnen beschuldigen, vooral leerlingen van wie het schrijven afwijkt van de norm (bijv. ESL-leerlingen of leerlingen met neurodiversiteit).

- Kosten en toegankelijkheid universiteiten met kleinere budgetten beperken in het aanschaffen van de meest geavanceerde AI-detectietools.

- Ethische zorgen ontstaan wanneer invasieve detectiepraktijken inbreuk maken op de privacy van leerlingen of wantrouwen kweken.

- Ongelijkheid in AI-gebruik kan de prestatiekloof tussen studenten met verschillende toegangsniveaus tot AI-vaardigheden en -hulpmiddelen verder vergroten.

Deze zorgen hebben veel instellingen ertoe aangezet om niet alleen opnieuw te evalueren hoe ze AI detecteren, maar ook hoe ze beoordeling heroverwegen helemaal.

Implicaties van het gebruik van ChatGPT voor studenten en hogescholen

Academische integriteit: AI-gegenereerde inzendingen kunnen het werkelijke begrip van een leerling vertroebelen.

Wanneer ChatGPT onethisch wordt gebruikt, wordt de nauwkeurigheid van academische evaluaties in twijfel getrokken en wordt de waarde van cijfers en referenties aangetast.

Ethische dilemma's: Van eerlijkheid tot gegevensprivacy: universiteiten worstelen met de vraag waar ze de grens moeten trekken bij het gebruik van AI. Moet AI volledig worden verboden of doordacht worden geïntegreerd?

Impact op lange termijn: Te veel vertrouwen op AI kan essentiële vaardigheden zoals kritisch denken, argumenteren en creativiteit verzwakken.

Als academische resultaten worden gezien als AI-ondersteund, kan de geloofwaardigheid van diploma's afnemen in de ogen van werkgevers en afstudeerrichtingen.

Manieren om AI-tools veilig te gebruiken (met niet-detecteerbare AI)

AI hoeft niet de vijand te zijn van academische eerlijkheid - als het op de juiste manier wordt gebruikt, kan het het begrip vergroten zonder origineel denken te vervangen.

Dit is hoe studenten AI veilig en transparant kunnen gebruiken:

- Gebruik AI om te brainstormen, niet om volledige essays te schrijven.

- Citeer je bronnen als AI heeft geholpen inzichten te genereren.

- Sterk bewerken om het werk je eigen te maken.

- Gebruik humaniserende hulpmiddelen om ervoor te zorgen dat je schrijven je persoonlijke stem weerspiegelt.

Aanbevolen tools van Undetectable AI

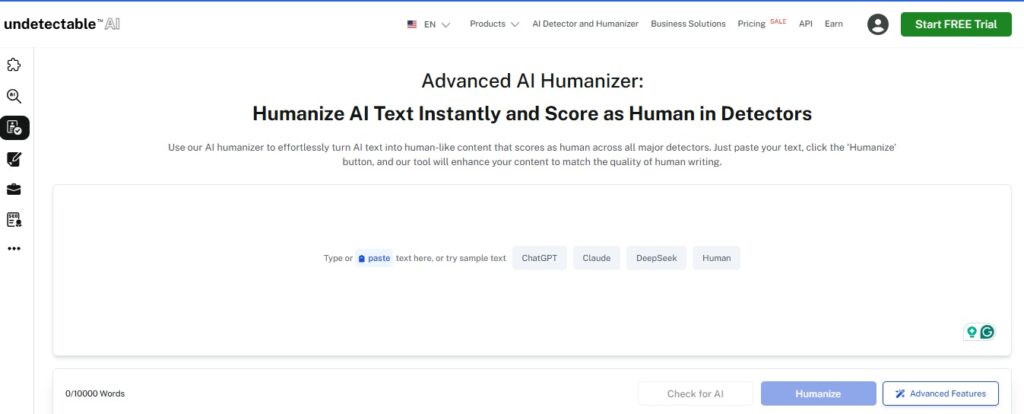

- AI Humanizer - Zet robotachtige AI-uitvoer om in mensachtig schrift dat aansluit bij jouw unieke stem.

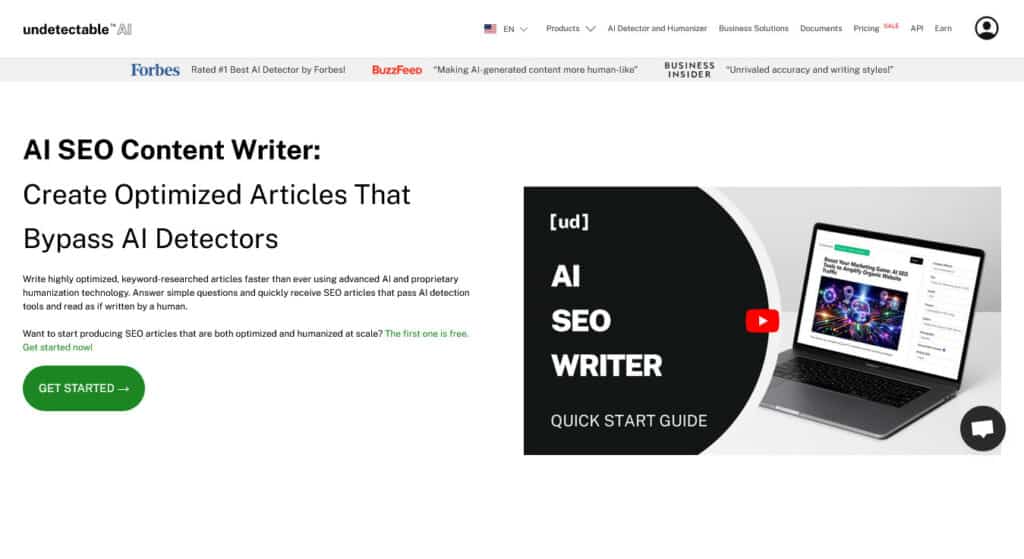

- AI SEO Content Schrijver - Ideaal voor studenten die blogs of persoonlijke portfolio's beheren en behoefte hebben aan ethisch geoptimaliseerde inhoud.

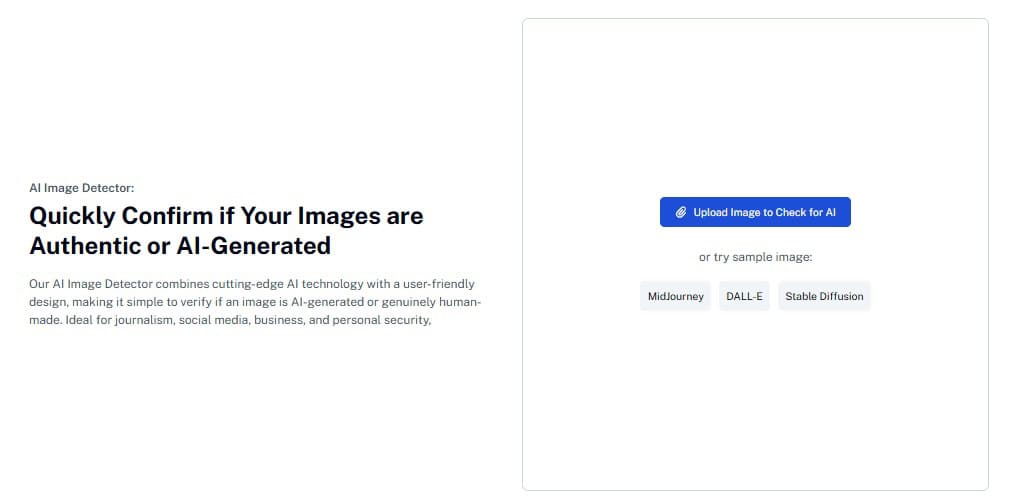

- AI beelddetectier - Ontworpen voor visuele projecten en multimedia-inzendingen, om originaliteit en naleving te garanderen.

Door Undetectable AI-tools op een verantwoorde manier te gebruiken, kunnen leerlingen AI omarmen zonder academische verwachtingen te schenden en kunnen docenten vertrouwen opbouwen door transparantie.

Zorg ervoor dat je schrijven voldoet aan de standaarden van het platform - begin met de widget hieronder.

Veelgestelde vragen (FAQ's)

Kunnen hogescholen door ChatGPT gegenereerde inhoud detecteren?

Ja, maar niet altijd. Detectietools kunnen waarschijnlijk AI-gebruik signaleren, maar ze missen vaak inhoud of identificeren deze ten onrechte. Menselijke beoordeling blijft essentieel.

Is het gebruik van ChatGPT voor hulp valsspelen?

Dat hangt ervan af. ChatGPT gebruiken om over een onderwerp te brainstormen of het te verduidelijken kan prima zijn, mits goedgekeurd door je docent. AI-gegenereerd werk laten doorgaan voor je eigen werk wordt algemeen beschouwd als academische oneerlijkheid.

Wat gebeurt er als een student wordt vals beschuldigd van het gebruik van AI?

Fout-positieven komen voor. Daarom worden instellingen aangespoord om AI-tools te combineren met het oordeel van een opvoeder voordat ze disciplinaire maatregelen nemen.

Kunnen niet-detecteerbare AI-tools detectie omzeilen?

Niet-opspoorbare AI helpt om inhoud menselijker te maken en de natuurlijke stroom te herstellen, maar het primaire doel is om helderheid en originaliteit te garanderen, niet om detectiesystemen te bedriegen.

Zullen hogescholen hun AI-beleid blijven ontwikkelen?

Absoluut. De meeste instellingen zijn actief bezig met het herzien van beleid, het ontwikkelen van nieuwe beoordelingen en het onderzoeken hoe ze AI op een verantwoorde manier in het onderwijs kunnen integreren.

Conclusie

De toekomst van het onderwijs ligt niet in het vermijden van AI, maar in het verstandig leren gebruiken ervan.

Hogescholen in 2025 passen steeds vaker detectiemethoden toe, maar echte academische integriteit komt voort uit begrip, transparantie en vertrouwen van studenten.

Of je nu een student bent die ethische manieren om AI te gebruikenof een opvoeder die zich aanpast aan een nieuw leerlandschap, biedt Unndetectable AI de tools om uw reis met integriteit te ondersteunen.

Ontdek niet-detecteerbare AI en ontsluit ethische, effectieve manieren om met AI te werken in de klas van vandaag.