AI-detektorer är som Voight-Kampff-testet i Blade Runner, ett verktyg som används för att skilja mellan riktiga och artificiella människor.

Men i stället för att ställa känslomässiga frågor och skanna ögonrörelser förlitar sig AI-detektorer på maskininlärning (ML) och bearbetning av naturligt språk (NLP) för att identifiera AI-genererat innehåll.

Ironiskt, eller hur?

ChatGPT och andra kända AI-verktyg använder också ML och NLP för att generera innehåll.

Det är som att använda samma ritning för att bygga ett hus och anklaga det för att vara en kopia.

Så, hur fungerar AI-detektorer egentligen? Och vad betyder de för skribenter som du? Låt oss ta reda på det.

Viktiga slutsatser

Innan vi går in i detta kaninhål, här är de viktigaste punkterna du bör komma ihåg:

- Upptäckt är inte perfekt. Även de bästa AI-innehållsdetektorerna gör fel. Falska positiva och falska negativa resultat inträffar regelbundet.

- Noggrannheten varierar kraftigt. Vissa detektorer presterar knappt bättre än slumpmässig gissning. Andra uppnår hyfsade resultat men gör ändå betydande fel.

- Kontexten spelar större roll än du tror. Skrivstil, ämneskomplexitet och innehållslängd påverkar alla detekteringsnoggrannheten.

- Hybridmetoder fungerar bättre. Verktyg som kombinerar upptäckt med omskrivning av innehåll erbjuder mer praktiska lösningar än enbart upptäckt.

- Öppenhet är sällsynt. De flesta företag publicerar inte verkliga mätvärden för noggrannhet. När de gör det är siffrorna ofta missvisande.

Hur fungerar AI-innehållsdetektorer?

AI-innehållsdetektorer är som system för mönsterigenkänning. De tränas på massiva datamängder av mänskligt skriven och AI-genererad text.

Målet är enkelt: lär dig att se skillnaderna.

Men det är här det blir komplicerat.

Oroa dig aldrig för att AI upptäcker dina texter igen. Undetectable AI Kan hjälpa dig:

- Få din AI-assisterade skrivning att synas människoliknande.

- Bypass alla större AI-detekteringsverktyg med bara ett klick.

- Användning AI säkert och självsäkert i skolan och på jobbet.

Dessa verktyg letar efter specifika mönster i skrivandet. Saker som meningsstruktur, ordval och styckeflöde. De tilldelar sannolikhetspoäng baserat på hur "AI-lik" texten verkar.

Vad är problemet? Det blir allt svårare att skilja mellan mänskligt skrivande och AI-skrivande. Modernt AI-modeller som GPT-4o kan producera text som är anmärkningsvärt människoliknande.

Detta skapar en grundläggande utmaning för detekteringssystem.

De flesta detektorer använder en av två tillvägagångssätt. Den första är perplexitetsanalys. Denna mäter hur "överraskad" detektorn blir av ordval.

AI tenderar att välja mer förutsägbara ord, medan människor är mer slumpmässiga.

Det andra tillvägagångssättet är detektion av burstiness. Här tittar man på variationen i meningslängd och komplexitet. Människor tenderar att skriva med mer variation. AI producerar ofta mer konsekventa mönster.

Inget av tillvägagångssätten är idiotsäkert. Bra AI-skrivande kan efterlikna mänsklig slumpmässighet.

Mänskligt skrivande kan ibland verka mycket systematiskt.

Vad ska betraktas som AI-innehåll?

Den här frågan är knepigare än den verkar.

Är innehåll som är 50% AI-genererat betraktat som AI-innehåll? Hur är det med mänskligt skrivet innehåll som har redigerats av AI?

Branschen har inte enats om tydliga definitioner. Vissa detektorer flaggar allt innehåll med AI-hjälp. Andra flaggar bara helt AI-genererad text.

Denna inkonsekvens gör det nästan omöjligt att göra korrekta jämförelser.

Tänk på dessa scenarier:

- En människa skriver ett utkast och använder sedan AI för att förbättra grammatik och flöde. Är detta AI-innehåll?

- Någon använder AI för att generera idéer och skriver sedan allt från grunden. AI-innehåll eller inte?

- En skribent använder AI för att skapa en disposition och skriver sedan originalinnehåll enligt den strukturen.

Dessa specialfall visar varför noggrannhetsmätningar kan vara missvisande. Olika verktyg definierar "AI-innehåll" på olika sätt.

Detta påverkar deras rapporterade träffsäkerhet.

Av praktiska skäl fokuserar de flesta verktyg på att upptäcka innehåll som i första hand är AI-genererat. Men gränserna är fortfarande luddiga.

Vad gör en AI-innehållsdetektor "exakt"?

Noggrannhet i AI-detektering handlar inte bara om att få rätt svar. Det handlar om att få rätt svar på ett konsekvent sätt, för olika typer av innehåll och användningsfall.

Det är därför vissa är avfärda dessa verktyg.

Vissa hävdar att dessa detektorer kan vara lika inkonsekventa som en lyckokakas förutsägelser, vilket väcker viktiga frågor om tillförlitlighet och förtroende.

Men verklig noggrannhet kräver att man balanserar två typer av fel. Falska positiva resultat hända när mänskligt innehåll flaggas som AI.

Falska negativ uppstår när AI-innehåll uppfattas som skrivet av människor.

Kostnaden för dessa fel varierar beroende på sammanhang. När det gäller akademisk integritet kan falska positiva resultat förstöra studenternas förtroende.

När det gäller innehållsmarknadsföring kan falska negativ leda till sanktioner från sökmotorer.

Noggrannheten beror också på kvaliteten på träningsdata. Detektorer som tränats med äldre AI-modeller kan få problem med nyare, mer sofistikerad AI-skrivning.

Detta skapar en ständig kapprustning mellan detektering och generering.

De bästa detektorerna tar hänsyn till flera faktorer:

- Statistiska mönster i ordanvändning och meningsbyggnad

- Semantisk koherens och logiskt flöde

- Enhetlig skrivstil genom hela innehållet

- Domänspecifik kunskap och demonstration av expertis

Men även omfattande metoder har sina begränsningar. Mänskligt skrivande varierar enormt. Vissa människor skriver naturligt i mönster som utlöser AI-detektorer.

Andra kan efterlikna AI-liknande konsekvens.

Målet är inte perfekt precision. Det är tillförlitlig precision som tillgodoser dina specifika behov.

Och även om ingen detektor är felfri, kan rätt verktyg göra skillnaden mellan en säker inlämning och ett flaggat dokument.

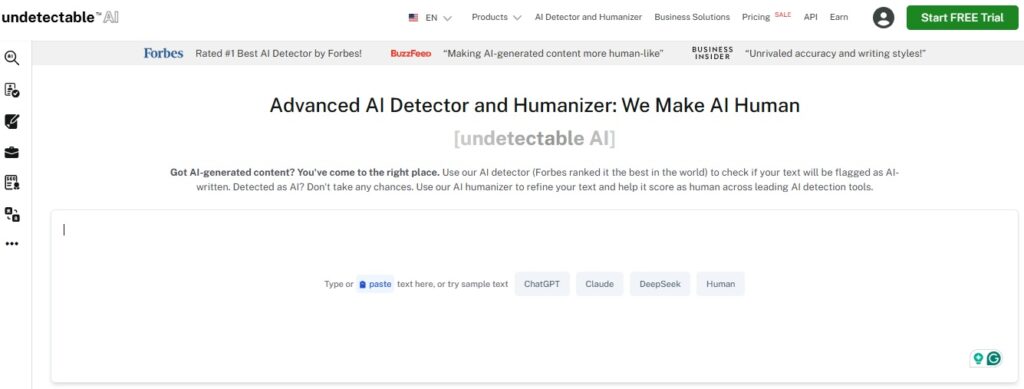

Oupptäckbar AI:s detektor och humaniserare arbetar tillsammans i ett enda arbetsflöde och erbjuder ett balanserat tillvägagångssätt som inte bara identifierar AI-genererad text utan också skriver om den på ett naturligt sätt.

Med den här integrerade lösningen får du både noggrannhet och praktiska lösningar i en och samma sömlösa upplevelse.

Prova Undetectable AI Detector and Humanizer idag och upplev tryggheten med AI-fritt, autentiskt innehåll som är redo för alla utmaningar.

Hur vi mäter noggrannheten hos våra AI-detektorer

De flesta företag slänger sig med procentsatser för noggrannhet utan att förklara hur de har beräknat dem. Vi tror på transparens.

Vår noggrannhetstestning följer rigorös metodik.

Vi använder olika dataset som innehåller innehåll från flera AI-modeller, mänskliga skribenter med olika kompetensnivåer och olika typer av innehåll.

Här är vår testprocess:

- Skapande av dataset: Tusentals AI-genererade textexempel. Omfattar akademiska uppsatser, marknadsföringstexter, kreativt skrivande och teknisk dokumentation. Vi hämtade AI-innehåll direkt från ledande modeller och sammanställde mänsklig text för bred representation.

- Blind testning: Vår detektor analyserar varje prov utan att känna till dess källa och ger ut konfidenspoäng och klassificeringar (AI vs människa).

- Statistisk analys: Därifrån räknar vi ut:

- Sanna positiva / Falska positiva / Sanna negativa / Falska negativa

- Precision, recall och F1-score, som är standardmått vid utvärdering av maskininlärning.

- Korsvalidering: Vi testar olika typer av innehåll och längder för att mäta prestanda i verkliga användningsfall: akademiskt, marknadsföring, tekniskt och kreativt. Studier visar att kreativt skrivande är svårast att upptäcka korrekt, så vi ägnar extra uppmärksamhet åt det.

- Kontinuerlig övervakning: AI-modeller utvecklas snabbt. Detektorer som utbildats på äldre data underpresterar på nyare utdata. Vi spårar prestanda över tid och omskolar när det behövs för att bibehålla noggrannheten.

Våra nuvarande tester visar på betydande variationer beroende på typ av innehåll.

Akademiska texter är lättast att upptäcka korrekt. Kreativt skrivande innebär de största utmaningarna.

Aktuell noggrannhet för vår AI-innehållsdetektor

Med Undetectable AI förlitar vi oss inte på hörsägen. Vi sätter själva vår detektor i rampljuset:

- Branschledande extern validering: Oberoende tester visar att Undetectable AI:s detektor uppnår 85 till 95% noggrannhet på blandat mänskligt och AI-innehåll, vilket konkurrerar med de bästa verktygen inom området.

- Förmågan att upptäcka parafraser: Forskning visar att Undetectable AI exakt upptäcker parafraserad AI-text 100% av tiden i flera verktygsjämförelser, inklusive gratisverktyg som Sapling och QuillBot.

- Självreflekterande testning: Undetectables eget GPTZero-jämförelsetest flaggade 99% av AI-genererat innehåll korrekt, medan GPTZero flaggade endast 85%.

- Kontinuerlig förbättring genom blind swapping: När användare humaniserar AI-text via Undetectable AI sjunker traditionella detektorer (som Originality.ai) från över 90% detekteringsfrekvenser till under 30%, vilket bevisar styrkan i vår omskrivningsmodell.

- Uppbackad av miljoner: Rankad som nummer ett bland AI-detektorer av Forbes, med över 4 miljoner användare och fri användning på alla plattformar.

I praktiken innebär det att Undetectable AI levererar förstklassig detekteringsnoggrannhet och kombinerar den med en toppmodern humanizer för sömlös omskrivning.

Testa ditt innehåll nu - gratis skanning med vår AI-detektor. Börja med självförtroende: kontrollera det du skriver, få omedelbara insikter och vidta åtgärder.

Varför vi kopplar ihop AI Detector + Humanizer

Enbart upptäckt är inte tillräckligt. Att veta att innehåll kan vara AI-genererat löser inte det underliggande problemet.

Du behöver handlingsbara lösningar.

Det är därför vi har byggt vår plattform kring arbetsflödet detector-humanizer. Istället för att bara flagga för potentiellt AI-innehåll hjälper vi dig att ta itu med det.

Så här fungerar det parvisa tillvägagångssättet:

- Detektering först: Vår AI-detektor analyserar ditt innehåll och identifierar avsnitt som kan vara AI-genererade. Du får specifika förtroendepoäng för olika stycken.

- Riktad omskrivning: Vår humanizer fokuserar på de flaggade avsnitten. I stället för att skriva om allt modifierar den på ett intelligent sätt bara de delar som behöver förbättras.

- Verifieringsslinga: Efter humanisering kör vi detektering igen för att bekräfta att innehållet nu läses som skrivet av en människa.

- Bevarande av kvalitet: Processen bibehåller din ursprungliga mening och stil samtidigt som den minskar AI-detekteringssignaturer.

Det här arbetsflödet löser verkliga problem. Innehållsskapare kan säkerställa att deras arbete inte utlöser falska positiva resultat. Studenter kan verifiera att deras texter ser ut att vara autentiskt mänskliga.

Marknadsförare kan producera innehåll som går att upptäcka med bibehållen kvalitet.

Alternativet är ren detektering, vilket innebär att du får problem men inga lösningar.

Att veta att innehåll kan vara AI-genererat hjälper inte om du inte kan åtgärda det.

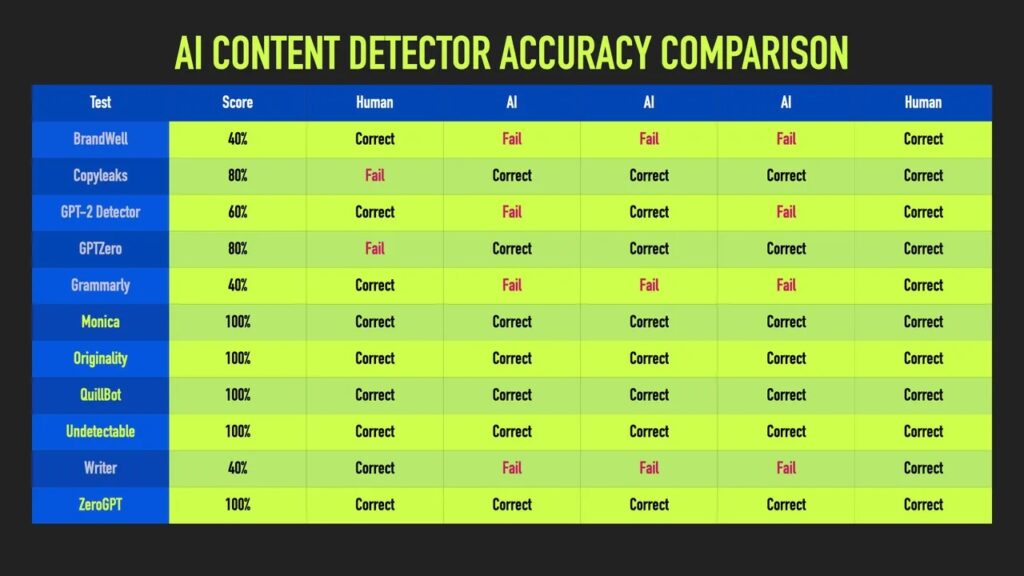

Hur vi står oss i jämförelse med andra AI-innehållsdetektorer

Landskapet för AI-detektering är fullt av verktyg som gör ambitiösa anspråk på noggrannhet. Oberoende tester ger en klarare bild av vad som faktiskt fungerar.

ZDNets djupdykning i 10 stora AI-innehållsdetektorer innebar att man skickade samma AI-genererade prover till varje verktyg och kontrollerade vilket som konsekvent identifierade AI-skriven text.

Många detektorer kom till korta. Vissa som påstod sig ha nästan perfekt noggrannhet fick knappt bättre än slumpen när de testades på verkligt innehåll.

Undetectable AI utmärkte sig dock och hamnade bland de fem bästa för konsekvent AI-textdetektering i alla prover.

ZDNet testade 10 AI-detektorer med identiska AI-genererade prover.

Av dessa var det bara tre verktyg som flaggade AI-text 100% av tiden i alla testade prover.

Framför allt var våra resultat stabila oavsett innehållstyp, inte bara när det gällde utvalda, enkla exempel.

- Konsekvent prestanda över ett brett spektrum av AI-modeller och innehållstyper. Medan konkurrenterna ofta utmärker sig i snäva förhållanden, upprätthåller vi noggrannheten över hela linjen.

- Tydlig metodik. Vi förklarar våra testförfaranden och uppdaterar prestandamätvärden regelbundet utan några vaga påståenden.

- Integrerade lösningar. Vi kopplar ihop detektering med omskrivning via vår Humanizer. Verktyg som enbart fokuserar på upptäckt ger dig problem men inga lösningar.

- Frekvent omskolning. Vi omskolar kontinuerligt våra modeller i takt med att AI-generationen utvecklas. Statiska detektorer förlorar snabbt sin relevans.

- Ärliga begränsningar. Vi kommunicerar tydligt utmaningar och gränsfall. Att lova för mycket leder till frustration hos användarna och dåliga beslut.

ZDNets studie betonade en viktig punkt: konsistens trumfar flashiga höjder. En detektor som är tillförlitlig 95% av tiden slår en som träffar 99% ibland men kraschar till 60% i andra sammanhang.

Testa ditt innehåll nu | Gratis skanning med vår AI-detektor.

Se direkt var du står. Skanna dina texter, få pålitliga resultat och ta nästa steg.

Se vår AI Detector och Humanizer i aktion - använd bara widgeten nedan!

Förtroende, öppenhet och verktyg som levererar

Noggrannhet i AI-innehållsdetektorer är mer än bara siffror. Det handlar om att förstå vad dessa verktyg kan och inte kan göra på ett tillförlitligt sätt.

Detekteringstekniken är lovande men ofullkomlig. Även de bästa verktygen gör misstag. Att känna till dessa begränsningar hjälper dig att använda dem på ett klokt sätt.

Framtiden för AI-detektering ser ut att gå mot multimodal analys, beteendemönster och verifiering genom samarbete.

För närvarande bör detekteringsverktyg som Undetectable AI behandlas som hjälpsamma assistenter, inte slutliga domare. Kombinera dem med mänskligt omdöme och välj lösningar som passar dina behov.

Ren detektering löser sällan verkliga problem. Det är därför Undetectable AI erbjuder ett integrerat arbetsflöde som balanserar upptäckt med innehållsförbättring.

Målet är inte att eliminera AI från skrivandet, utan att säkerställa transparens, upprätthålla kvaliteten och bevara förtroendet.

Förståelse för detektorns noggrannhet, särskilt med Odetekterbar AIger dig kontroll över processen.