Såg du det virala Påvens foto i en snygg vit pufferjacka år 2023?

Miljontals människor delade den, nyhetssajter rapporterade om den och alla pratade om hur elegant påven såg ut.

Det fanns bara ett problem - det hände aldrig. Bilden var helt skapad av artificiell intelligens.

Eller så kanske du minns den chockerande bilden av en explosion i Pentagon som kortvarigt skakade om aktiemarknaden. Falska!

Hur är det med bilderna av Trump tacklas och grips? Återigen, de var också helt uppdiktade av AI.

Falska AI-bilder har orsakat verklig skada.

Människor har förlorat pengar på att investera baserat på falska nyhetsbilder.

Både kändisar och vanliga människor har fått sina ansikten placerade på andra kroppar i pinsamma eller olämpliga situationer.

Politiker har visats säga och göra saker som de egentligen aldrig har gjort.

När vi inte kan lita på våra egna ögon behöver vi nya sätt att ta reda på vad som är verkligt och vad som inte är det.

I den här bloggen visar jag dig hur AI- och DeepFake-tekniken har utvecklats under åren, vikten av att identifiera AI kontra riktiga bilder, hur man ser om en bild är AI-genererad eller det bästa verktyget för att upptäcka AI-genererade bilder.

Hur AI-konst och Deepfake-teknik har utvecklats

Låt oss prata om AI ...först...

För inte så länge sedan såg AI-genererade bilder ut som en mardröm - suddiga ansikten, extra fingrar och en hel del konstigheter. Men idag är AI-konst chockerande realistisk.

Det hela började runt 2014 med GANs (Generative Adversarial Networks), där två AI-modeller - en som skapar förfalskningar, den andra som upptäcker dem - hela tiden förbättrar varandra.

Oroa dig aldrig för att AI upptäcker dina texter igen. Undetectable AI Kan hjälpa dig:

- Få din AI-assisterade skrivning att synas människoliknande.

- Bypass alla större AI-detekteringsverktyg med bara ett klick.

- Användning AI säkert och självsäkert i skolan och på jobbet.

De första GAN-bilderna var ganska dåliga - suddiga ansikten med konstiga ögon och saknade öron.

År 2020 blev saker och ting mycket bättre med "Diffusionsmodeller."

De börjar med en rörig bild full av prickar och snyggar långsamt till den tills den ser riktig ut.

Detta var ett stort steg framåt. Plötsligt kunde AI skapa mycket tydligare och mer realistiska bilder.

Deepfake-teknik fungerar på samma sätt, men på ett knepigare sätt.

Det handlar om användning av både AI- och Deepfake-teknik.

AI lär sig hur en persons ansikte ser ut från många vinklar och uttryck genom att studera massor av videor och bilder av dem.

Sedan kan den sätta den personens ansikte på någon annans kropp i en annan video.

Datorn lär sig att matcha belysning, hudton och till och med små uttryck för att få det att se verkligt ut.

Tidiga deepfakes från 2017 såg uppenbara och glitchiga ut. Dagens deepfakes kan vara nästan perfekta.

För att se jämförelsen, titta på videoklippen nedan:

Deepfake år 2017 - Falsk Obama-video

Deepfake år 2023 - Emma Watson i "Get Out (2017)"

Under 2022 skapade människor cirka 6 miljoner bilder med hjälp av AI. I början av 2023 hade antalet ökat till över 20 miljoner bilder varje dag.

Idag finns det miljarder AI-skapade bilder på nätet, och de flesta av oss ser dem dagligen utan att ens veta om det.

Riskerna med AI-genererade bilder i felaktig information

Falska nyheter sprids 6 gånger snabbare än sanna nyheter på sociala medier.

Skadan är oftast redan skedd när någon påpekar att en bild är falsk.

De risker som är förknippade med falska bilder är:

1) Manipulation - Falska bilder skapar falska berättelser om andra, till exempel val, ledare och världshändelser. Till exempel, AI-genererade bilder visade felaktigt arresteringen av USA:s president Donald Trump.

2) Ärekränkning - Falska bilder kan förstöra ryktet. Till exempel, i januari 2024 cirkulerade AI-genererade bilder av Taylor Swift på nätet som falskeligen porträtterade henne.

3) Social oro - En enda falsk bild kan skapa upprördhet, upplopp eller till och med våld. Till exempel, i maj 2023 fick en AI-genererad bild som visade en explosion nära Pentagon stor spridning på sociala medier.

4) Bedrägeri Bedragare använder deepfake-bilder för att lura människor att skicka pengar. Till exempel; Michael Hewson (finansanalytiker) utgav sig för att marknadsföra bedrägliga investeringsprogram.

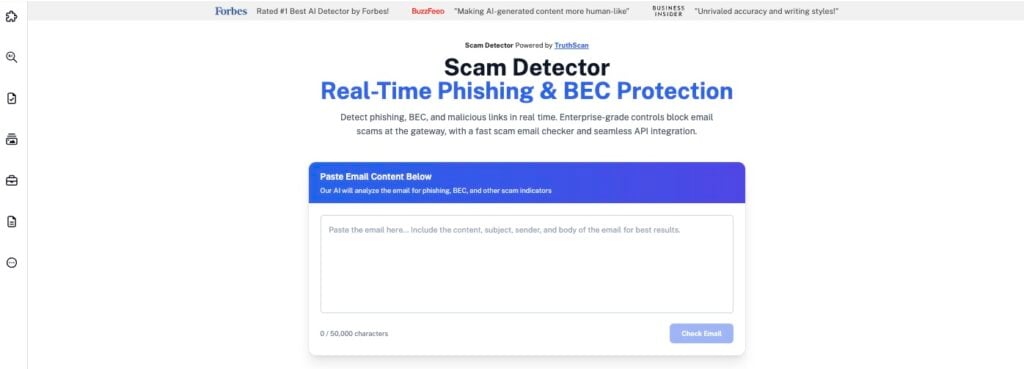

Eftersom dessa bedrägerier ofta börjar med en “verifierad” kändisbild räcker det inte med vanlig försiktighet. Kör den medföljande länken eller meddelandet genom vår Undetectable AI:s Detektor för bedrägerier.

Det ger ett viktigt säkerhetslager genom att flagga för bedrägliga domäner och högriskspråk för “bli rik snabbt” som ofta följer med AI-genererade deepfakes av finansanalytiker eller offentliga personer.

Det finns ett annat problem som inträffar nu som kallas "Lögnarens utdelning."

I takt med att AI-förfalskningar blir allt vanligare avfärdar människor som råkat ut för riktiga skandaler helt enkelt bevisen som "deepfake" - även när det är äkta. Politikerna har redan börjat använda denna taktik.

Vikten av att identifiera AI kontra verkliga bilder

Behovet av att förstå skillnaden mellan äkta och falsk bild är större än någonsin av ett par skäl:

1 - Erosion av allmänhetens förtroende

Vårt samhälle bygger på tillit. Vår hjärna accepterar vad den ser i nyheterna, i domstolar eller från våra ledare.

Men nu, när AI skapar så övertygande falska bilder, håller det förtroendet på att brytas ner.

Om vi alla fortsätter att vara så här misstänksamma kommer det att helt förändra hur vi kommunicerar med världen.

2 - Juridiska konsekvenser och nya regleringar

Myndigheterna försöker komma fram till vad de ska göra åt falska AI-bilder.

Till exempel,

- Kalifornien har just antagit en lag som gör det olagligt att skapa falska politiska annonser med hjälp av AI under valtider.

- Den EU:s underrättelselag medför skyldigheter om märkning av kraven på AI- och deepfake-material.

3 - Påverkan på digitala färdigheter

AI blir allt bättre på att skapa falska bilder, och vi måste alla bli bättre på att upptäcka dem.

Skolor måste lära eleverna om AI & Deepfakes ständigt utvecklande teknik.

Vi måste utveckla en fullständig förståelse så att vi inte bara tror på vad vi ser på nätet.

4 - Upprätthållande av autenticitetskedjor

En lösning kan vara "Äkthetskedjor."

Det innebär att man spårar varifrån en bild kommer - från det ögonblick den skapas till dess att vi ser den.

Med hjälp av specialteknik kan man lägga till osynliga märken på riktiga foton som visar vem som tog dem och när.

Om vi använder detta kan vi verifiera en bilds historia och dess äkthet.

Hur man vet om en bild är AI-genererad (viktiga tecken)

De bilder som genereras av AI är så verklighetstrogna att en nybörjare har svårt att se skillnaden.

Om du är någon som försöker lära dig hur man identifierar om en bild är AI-genererad ska du leta efter dessa viktiga detaljer:

- 1. Onaturliga eller surrealistiska detaljer

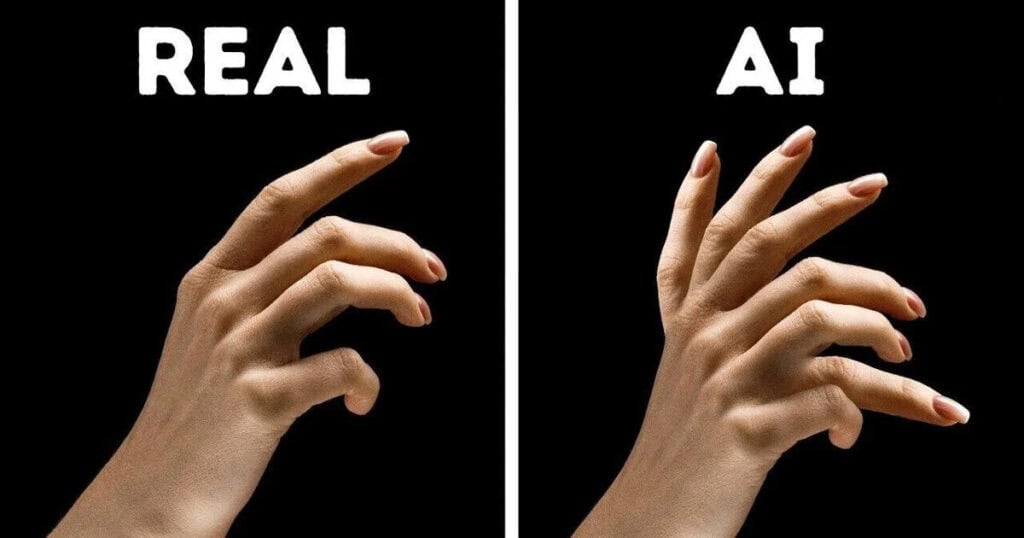

AI kan inte räkna ut vissa kroppsdelar, särskilt inte händer.

Vi har 5 fingrar på varje hand, men AI ger ofta människor 6-8 fingrar, sammanväxta fingrar eller tummar som ser konstiga ut. Titta på händerna.

Källa = Tider

AI strular också till det tänder mycket.

Leta efter tänder som verkar för perfekta, för många tänder i munnen eller tänder som inte står i rätt linje.

Ibland smälter alla tänder samman till en vit klump.

Bild genererad av ChattGPT

Andra kroppsmisstag inkluderar:

- Ögon som inte matchar eller tittar i lite olika riktningar

- Öron som inte passar ihop eller är i olika höjder

- Glasögon som vrider sig konstigt eller flyter av ansiktet

- Smycken som smälter in i huden eller inte följer kroppens rörelser.

- 2. Alltför släta eller plastliknande texturer

Riktig hud har textur (porer, linjer, små skönhetsfel). AI får dock ofta huden att se ut som en plastdocka - för perfekt!

Håret är en annan ledtråd. Riktigt hår har individuella strån som går i olika riktningar.

AI-hår ser ofta ut som en enda stor bit, särskilt där det möter pannan.

Hårfästet kan se målat ut snarare än att visa enskilda hårstrån.

Källa = Mikestuzzi

Kläder i AI-bilder är antingen mycket släta eller har konstiga rynkor som inte har någon fysisk mening.

Titta på hur tygerna viks - böjer de sig som riktiga material skulle göra?

Ofta får AI tyget att se ut som om det har smält eller frusit på omöjliga sätt.

Varför blir det så här? AI förstår inte fysik och material - det kopierar bara mönster som det har sett förut.

Till exempel,

Den kanske vet hur denim ser utmen inte hur denim beter sig när någon sätter sig på den. Leta efter dessa ledtrådar.

- 3. Suddig text i bilden

Text är AI:s största svaghet.

När du ser ord eller bokstäver i en AI-bild är de ofta suddiga, nonsensartade eller helt enkelt felaktiga.

Bild genererad av ChattGPT

Leta efter..:

- Ord som börjar normalt men blir till rappakalja

- Bokstäver som blandas eller ändrar form

- Omöjliga kombinationer av symboler

- Text på skyltar eller t-shirts som inte är begriplig

Det beror på att AI inte förstår språk på samma sätt som det förstår bilder. Texterna verkar vara ett annat visuellt mönster.

- 4. Inkonsekvent belysning och skuggor

AI-genererade bilder följer inte eller förstår inte reglerna för ljus och skugga.

Till exempel, Ibland ser det ut som om det finns flera solar på himlen.

Eller så skulle det finnas skuggor på föremål (hud, metall, glas) som helt enkelt inte är logiska.

AI förstår inte ljusfysik. Den försöker bara matcha mönster som den har sett förut, inte beräkna hur ljus studsar och reflekteras.

Källa = Skapare.nattkafé.klubb

Dessa ljusproblem blir allt bättre, men de är fortfarande vanliga även i högkvalitativa AI-bilder.

- 5. Konstiga bakgrunder eller orealistisk djupuppfattning

Bakgrunden i AI-bilder innehåller ofta ledtrådar om att något inte står rätt till. Håll utkik efter:

- Byggnader med omöjlig arkitektur (fönster som inte sitter i linje, dörrar som inte leder någonstans)

- Föremål som verkar smälta in i varandra eller i bakgrunden

- Saker som borde vara långt borta men som ser ut att vara lika stora som saker på nära håll

Källa = Bakgrundsaccess.com

Ibland ser kanten där en person möter bakgrunden konstig ut - antingen för skarp eller för suddig. Det beror på att AI skapar personen och bakgrunden var för sig och sedan försöker foga samman dem.

- 6. Kontrollera metadata och källinformation

Varje foto som tas med en riktig kamera har "Metadata" - information om när och hur bilden togs.

AI-bilder har inga metadata eller metadata som visar att de har skapats av program som DALL-E eller Midjourney.

Du kan kontrollera metadata med hjälp av:

- Högerklicka på en bild och titta på "Egenskaper" eller "Info"

- Med hjälp av webbplatser som metadata2go.com

- På telefonen kan du använda appar som Photo Investigator

Om du är osäker kan du prova en omvänd bildsökning.

- Gå till Google Bilder

- Ladda upp bilden för att se om den finns någon annanstans på nätet eller i olika versioner.

Kom ihåg att bara för att någon påstår sig ha tagit ett foto behöver det inte vara sant.

Vem har skrivit det här och varför? Vill de göra mig arg eller rädd?

Det är ofta tecken på falska bilder.

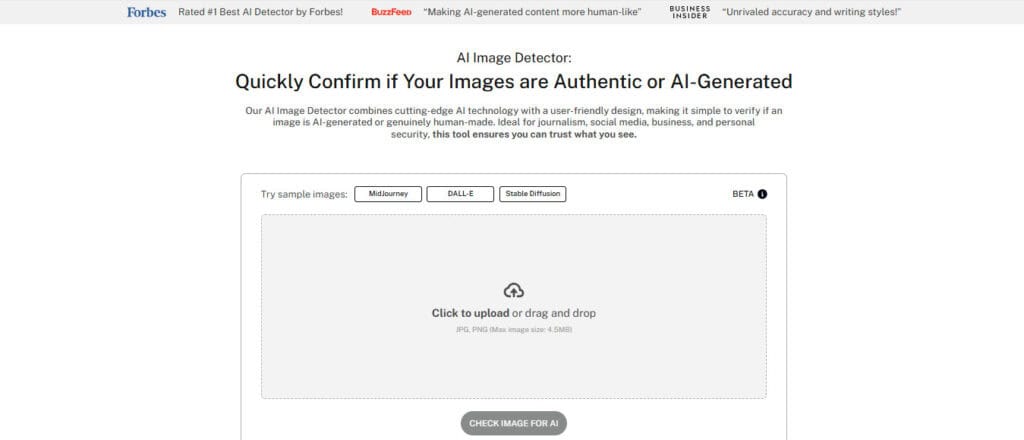

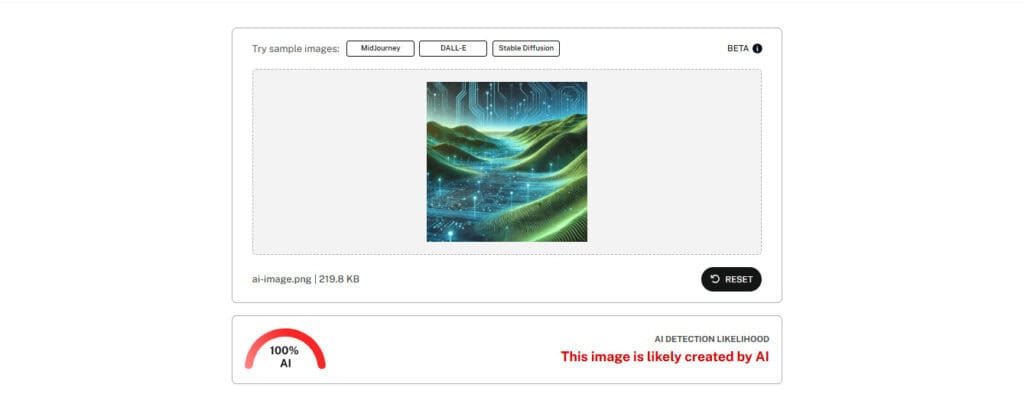

Bästa verktyget för att upptäcka AI-genererade bilder

Förvånansvärt nog finns det andra AI-utbildade verktyg som hjälper till att upptäcka AI. I det här fallet är verktyget AI-bilddetektor.

Låt oss ta en titt på vad som gör en bra AI-detektor.

1 - Noggrannhet: Vissa detektorverktyg är oftast rätt, medan andra gör misstag.

Den bästa detektorn idag får rätt ungefär 80-85% av tiden, vilket inte är perfekt men mycket bättre än att gissa.

2 - Vilka AI-generatorer den kan upptäcka: Vissa verktyg är bra på att upptäcka en källa (t.ex. DALL-E-bilder) men missar andra (t.ex. Midjourney-förfalskningar).

Detta verktyg är utbildad på alla de stora AI-verktygen - DALL-E, Midjourney, Stable Diffusion med flera.

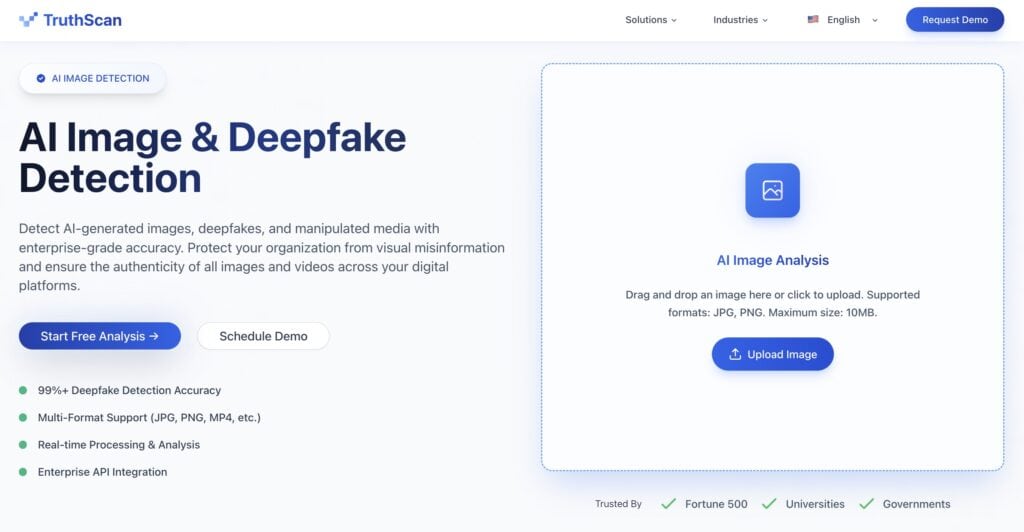

För mer avancerad analys på kriminalteknisk nivå, TruthScans AI-bilddetektor är ett annat kraftfullt verktyg som är värt att lägga till i din verktygslåda för bildverifiering.

Den går utöver mönsteranalys på pixelnivå för att upptäcka tecken på manipulerat eller AI-genererat innehåll - inklusive deepfakes och syntetiska medier.

Oavsett om du har att göra med potentiell felaktig information, varumärkessäkerhetsfrågor eller digitala bevis hjälper TruthScan till att säkerställa att de bilder du använder eller stöter på är autentiska, spårbara och juridiskt säkra att dela.

Deepfake-detektering för att bekräfta bilders äkthet

För situationer där visuell noggrannhet verkligen är viktig, kan Undetectable AI:s Detektering av deepfake ger ett exakt sätt att verifiera om en bild eller video har genererats eller manipulerats på konstgjord väg.

Den granskar konsekvent belysning, pixelmönster och ansiktsinriktning för att upptäcka även de mest subtila tecknen på deepfake eller syntetisk redigering.

Genom att ladda upp din fil får du en äkthetspoäng och visuella indikatorer som belyser potentiella manipulationsområden.

I kombination med AI Image Detector säkerställer Deepfake Detection att varje bild du delar eller publicerar är verifierad, autentisk och pålitlig.

För team eller institutioner som även granskar ljudinspelningar, såsom personliga uttalanden eller inspelade svar på ansökningar, är det bra att kunna verifiera att rösten du hör är äkta.

Oupptäckbara AI:s AI-röstdetektor kan analysera uppladdat ljud och kontrollera om det finns tecken på röstsyntes eller kloning.

Det ger dig en tydlig signal om talet har producerats av en riktig talare eller genererats av en AI-modell, vilket ger ett extra lager av förtroende och äkthet till alla röstbaserade inlägg.

3 - Användarvänlighet: Du behöver inte ha en examen i datavetenskap för att kontrollera om en bild är falsk.

Du laddar helt enkelt upp bilden och får resultatet på några sekunder.

4 - Sekretess: Vissa detektorer behåller alla bilder som du laddar upp, vilket kan vara ett problem om du kontrollerar känsliga foton. Det här verktyget raderar bilder efter att ha kontrollerat dem.

Så här använder du vår AI-bilddetektor:

- Klicka på den här länken för att komma till webbplatsen.

- Välj önskad bild från din dator eller telefon. Verktyget accepterar JPEG- och PNG-format med en storlek på upp till 4,5 MB.

- Klicka på knappen och vänta några sekunder.

- En totalpoäng från 1-100 visar hur sannolikt det är att bilden är AI-genererad

Bästa resultat får du om du använder bilder som inte har komprimerats kraftigt eller ändrats i storlek.

Skärmdumpar och bilder från sociala medier är ofta komprimerade, vilket kan göra det svårare att upptäcka dem.

Ibland gör detektorer fel på två huvudsakliga sätt:

- Falska positiva resultat inträffar när detektorn säger att en bild är AI-genererad, men den är verklig. Detta kan hända med mycket redigerade foton, illustrationer eller bilder med ovanlig belysning.

Falska negationer inträffar när detektorn säger att en bild är äkta, men den i själva verket är AI-genererad.

Detta händer oftast med kraftigt redigerade AI-bilder eller bilder som skapats av nyare AI-modeller som detektorn inte har lärt sig något om ännu.

Om du letar efter ett enkelt sätt att analysera AI-genererat innehåll kan du kolla in vår AI Detector och Humanizer i widgeten nedan!

Vanliga frågor om detektering av AI-genererade bilder

Hur vet man om en bild eller video är AI-genererad?

AI-genererade bilder har ofta problem med text, symmetriska objekt och att återge konsekventa bakgrunder.

I videor kan människor röra sig onaturligt, deras röster kanske inte matchar läpparna eller så kan delar av videon flimra från bildruta till bildruta.

Finns det vattenstämplar på AI-genererade bilder?

Ja, vissa AI-verktyg som Midjourney och OpenAI:s DALL-E döljer hemliga vattenstämplar i sina bilder.

Kan AI-genererade bilder vara helt omöjliga att upptäcka?

Svaret är "nej" från och med 2025. Avancerade AI-modeller skapar mycket övertygande bilder, men de tekniska artefakterna är fortfarande på samma nivå.

För närvarande kan tekniken ta bort cirka 85% av de saker som kan märkas, men den kan ännu inte göra något helt osynligt.

Varför ser vissa AI-bilder hyperrealistiska ut?

De nyaste AI-modellerna ger superrealistiska bilder med hjälp av smart teknik.

De har tränats på miljarder högkvalitativa bilder och fortsätter att förbättras med särskilda uppgraderingar.

Dessa modeller är särskilt bra på att fånga fotograferingsstilar, realistisk belysning och detaljerade texturer.

Vilken är den bästa AI-detektorn för bilder?

Den AI-bilddetektor från Undetectable AI upptäcker AI-genererade bilder med upp till 85% noggrannhet.

Den använder en smart process i flera steg för att kontrollera små detaljer i bilder.

Den tittar på mönster i pixlarna, dolda data och små misstag som andra verktyg kanske inte upptäcker.

Slutliga tankar: Hur man upptäcker AI-genererade bilder

Det var en sammanfattning, och innan vi avslutar den här bloggen har jag en fråga till dig.

Varför är vår hjärna så lättlurad av AI-bilder?

Svaret ligger i den mänskliga psykologin.

Våra hjärnor följer "Bildöverlägsenhetseffekt."

Enligt detta fastnar bilder i våra sinnen bättre än ord.

När något ser äkta ut och passar in i det vi redan tror på ifrågasätter vi det inte. Dessutom är vi ofta för upptagna för att dubbelkolla om en bild är äkta eller falsk.

I det här fallet kan du leta efter de ledtrådar vi har diskuterat ovan. Konstiga händer, konstig text och perfekt hud kan hjälpa dig att upptäcka AI-förfalskningar.

Det viktigaste att komma ihåg är att dina ögon kan luras. Bara för att en bild ser äkta ut betyder det inte att den är det.

När du ser något fantastiskt eller chockerande på nätet, ta en minut och fundera på det innan du delar med dig eller dömer någon.

AI blir allt bättre för varje dag som går och vi måste alla bli bättre på att upptäcka dem. Nästa gång du ser en fantastisk bild, kommer du att vara en superbilddetektiv och leta efter ledtrådarna?