À medida que as ferramentas de IA, como o ChatGPT, se tornam mais sofisticadas e acessíveis, surge uma preocupação urgente no setor educacional:

As faculdades e universidades podem detectar de forma confiável o conteúdo gerado pelo ChatGPT?

Neste artigo, examinamos como as instituições estão respondendo ao aumento da IA generativa e quais métodos de detecção estão sendo usados em 2025.

Os desafios que eles enfrentam e como os alunos podem usar a IA de forma responsável sem comprometer a integridade acadêmica.

Principais conclusões

- As faculdades podem detectar o ChatGPT, mas não com precisão perfeita. Ferramentas como Turnitin e Copyleaks são comumente usadas, mas ainda produzem falsos positivos e negativos.

- A revisão humana e a análise estilométrica são fundamentais para avaliar as inconsistências entre o trabalho anterior de um aluno e os novos envios.

- A detecção se baseia em padrões linguísticos, estatísticos e contextuais, mas os resultados avançados de IA podem, muitas vezes, ignorar a análise superficial.

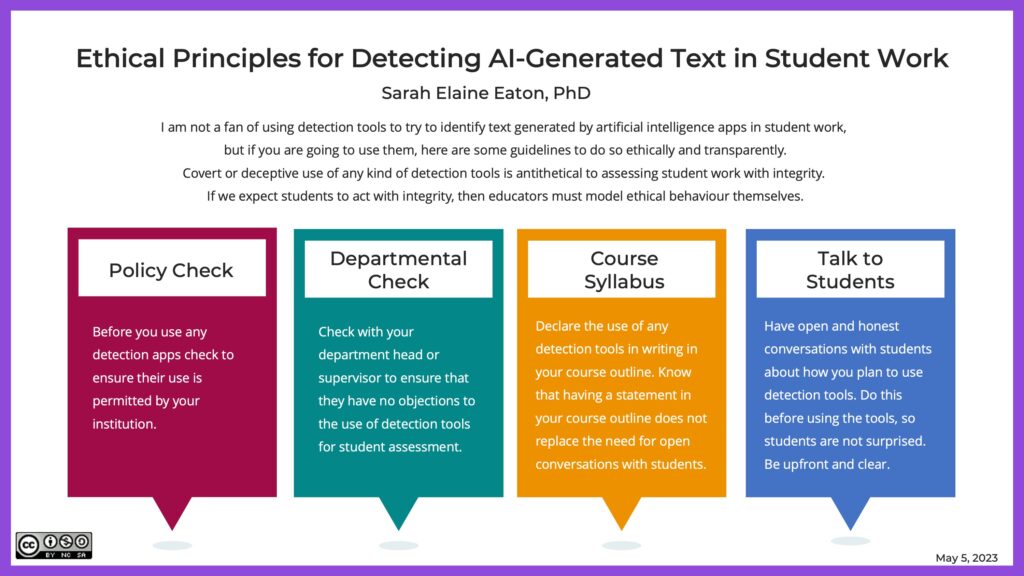

- Os educadores estão atualizando as políticas e adotando exames orais, tarefas de redação em tempo real e avaliações com reconhecimento de IA para reduzir a dependência apenas das ferramentas de detecção.

- O uso ético da IA é possível, especialmente quando orientado pela transparência, honestidade acadêmica e ferramentas como a Undetectable AI.

O ChatGPT poderá ser detectado em 2025?

O ChatGPT e outros modelos de linguagem de grande porte melhoraram muito em sua capacidade de gerar textos naturais, coerentes e semelhantes aos humanos.

Embora esse avanço revele um potencial educacional poderoso, ele também apresenta novos desafios para as instituições acadêmicas que buscam preservar a integridade do trabalho dos alunos.

A maioria dos detectores de IA usad por faculdades-incluindo o recurso de detecção de IA do Turnitin - dependem de padrões linguísticos, perplexidadee explosão para sinalizar a escrita gerada por IA.

Nunca mais se preocupe com a detecção de seus textos pela IA. Undetectable AI Pode lhe ajudar:

- Faça sua escrita assistida por IA aparecer semelhante ao humano.

- Bypass todas as principais ferramentas de detecção de IA com apenas um clique.

- Uso IA com segurança e com confiança na escola e no trabalho.

Entretanto, esses sistemas não são infalíveis. Muitos alunos editam os resultados da IA ou os humanizam usando ferramentas avançadas para evitar a detecção.

Essa corrida armamentista entre a IA generativa e os detectores de IA deixou as universidades em uma corda bamba, equilibrando a justiça, a integridade acadêmica e a evolução das necessidades dos alunos.

Métodos comuns de detecção no ensino superior

1. Estilometria

A estilometria examina o estilo de redação exclusivo de um aluno em envios anteriores, analisando gramática, pontuação, estrutura de frases e vocabulário.

Um desvio acentuado no tom ou na complexidade geralmente indica o uso de IA. Esse método é particularmente eficaz quando os educadores têm um portfólio de trabalhos anteriores do aluno para comparação.

2. Análise de padrão estatístico

O conteúdo gerado por IA geralmente apresenta consistência não natural no comprimento, na formalidade ou na estrutura das frases.

Detectores como o Turnitin procuram anomalias com base em padrões conhecidos da escrita humana. Entretanto, o conteúdo de IA altamente editado pode ignorar essa análise.

3. Análise contextual e semântica

Em vez de apenas a gramática de nível superficial, a análise contextual avalia profundidade, relevância e coerência.

As ferramentas de IA podem produzir conteúdo que "soa bem", mas carece de análise perspicaz ou de conexão com o material do curso.

4. Detecção de aprendizado de máquina

Algumas instituições usam a IA para combater a IA - treinando modelos de aprendizado de máquina para distinguir entre texto humano e texto gerado por máquina com base em milhares de amostras de redações.

5. Revisão humana

Apesar da automação, educadores experientes continuam sendo os detectores de IA mais precisosespecialmente quando conhecem a voz de seus alunos.

De fato, um 2025 Estudo do arXiv descobriram que instrutores experientes superaram os detectores de IA na identificação de atribuições sutis geradas por IA.

Limitações da detecção de IA na academia

Embora os sistemas de detecção tenham melhorado, vários limitações críticas permanecer:

- Falsos positivos podem acusar injustamente os alunos, especialmente aqueles cuja redação foge à norma (por exemplo, alunos de ESL ou alunos com neurodiversidade).

- Custo e acessibilidade restringir as universidades com orçamentos menores de adquirir as ferramentas de detecção de IA mais avançadas.

- Preocupações éticas surgem quando as práticas invasivas de detecção violam a privacidade do aluno ou geram desconfiança.

- Desigualdade no uso de IA pode aumentar ainda mais as lacunas de desempenho entre os alunos com diferentes níveis de acesso a ferramentas e alfabetização em IA.

Essas preocupações levaram muitas instituições a reavaliar não apenas como detectam a IA, mas como repensar a avaliação completamente.

Implicações do uso do ChatGPT para alunos e faculdades

Integridade acadêmica: Os envios gerados por IA podem obscurecer a verdadeira compreensão do aluno.

Quando usado de forma antiética, o ChatGPT desafia a precisão da avaliação acadêmica e compromete o valor das notas e credenciais.

Dilemas éticos: Da justiça à privacidade dos dados, as universidades estão lutando para saber onde traçar os limites do uso da IA. A IA deve ser totalmente banida ou integrada cuidadosamente?

Impacto a longo prazo: O excesso de confiança na IA pode enfraquecer habilidades essenciais, como pensamento crítico, argumentação e criatividade.

Se os resultados acadêmicos forem percebidos como assistidos por IA, a credibilidade dos diplomas poderá diminuir aos olhos dos empregadores e dos programas de pós-graduação.

Maneiras de usar ferramentas de IA com segurança (com IA indetectável)

A IA não precisa ser inimiga da honestidade acadêmica - quando usada corretamente, ela pode melhorar a compreensão sem substituir o pensamento original.

Veja como os alunos podem usar a IA de forma segura e transparente:

- Use a IA para fazer brainstorming, não para escrever redações completas.

- Cite suas fontes se a IA ajudou a gerar insights.

- Edite bastante para tornar o trabalho seu.

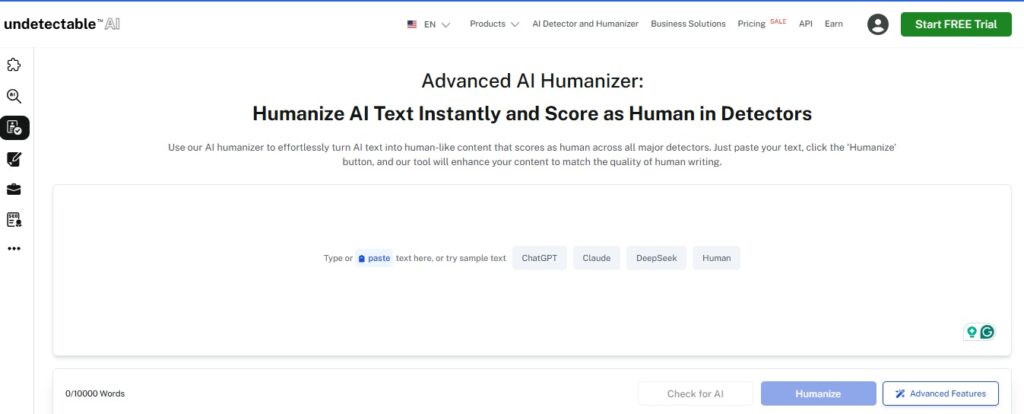

- Use ferramentas de humanização para garantir que sua redação reflita sua voz pessoal.

Ferramentas recomendadas da Undetectable AI

- Humanizador de IA - Converte os resultados da IA robótica em uma escrita semelhante à humana que se alinha com sua voz exclusiva.

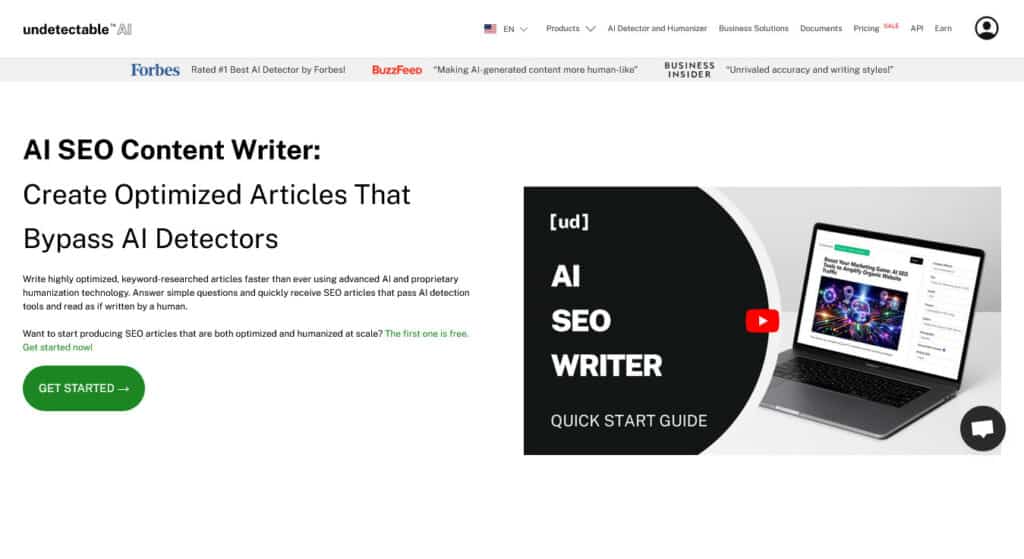

- Redator de conteúdo de SEO para IA - Ideal para alunos que gerenciam blogs ou portfólios pessoais e precisam de conteúdo otimizado eticamente.

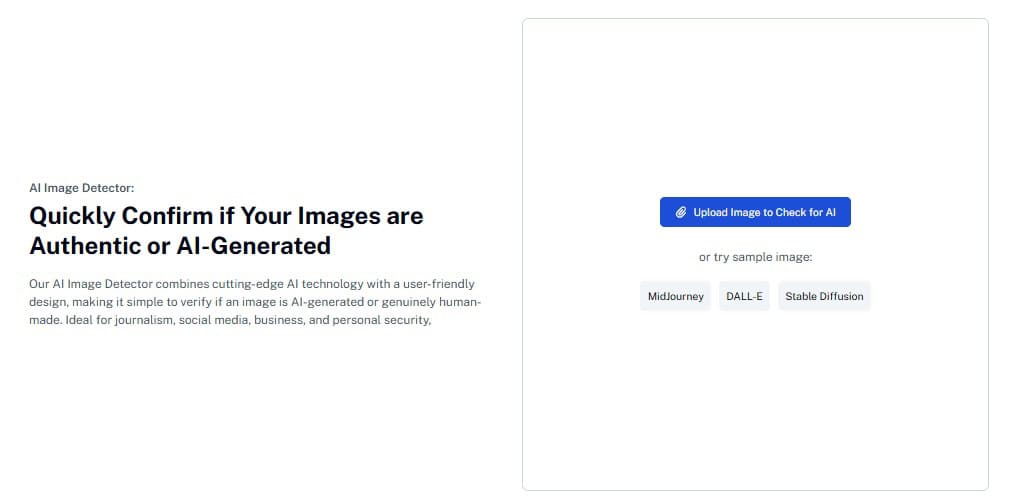

- Detecção de imagens por IAr - Desenvolvido para projetos visuais e envios de multimídia, ajudando a garantir a originalidade e a conformidade.

Ao usar as ferramentas de IA indetectável de forma responsável, os alunos podem adotar a IA sem violar as expectativas acadêmicas - e os educadores podem criar confiança por meio da transparência.

Certifique-se de que sua redação esteja alinhada com os padrões da plataforma - comece com o widget abaixo.

Perguntas frequentes (FAQs)

As faculdades podem detectar o conteúdo gerado pelo ChatGPT?

Sim, mas nem sempre. As ferramentas de detecção podem sinalizar o provável uso de IA, mas muitas vezes elas não identificam ou identificam falsamente o conteúdo. A revisão humana continua sendo essencial.

Usar o ChatGPT para obter ajuda é trapaça?

Depende. Usar o ChatGPT para fazer um brainstorming ou esclarecer um tópico pode ser aceitável se aprovado por seu instrutor. Passar um trabalho gerado por IA como se fosse seu é amplamente considerado desonestidade acadêmica.

O que acontece se um estudante é falsamente acusado de usar IA?

Falsos positivos acontecem. É por isso que as instituições são instadas a combinar as ferramentas de IA com o julgamento dos educadores antes de tomar medidas disciplinares.

As ferramentas de IA indetectáveis podem contornar a detecção?

A IA indetectável ajuda a humanizar o conteúdo e a restaurar o fluxo natural, mas seu objetivo principal é garantir a clareza e a originalidade, não enganar os sistemas de detecção.

As faculdades continuarão a desenvolver suas políticas de IA?

Com certeza. A maioria das instituições está revisando ativamente as políticas, desenvolvendo novas avaliações e explorando como incorporar a IA de forma responsável na educação.

Conclusão

O futuro da educação não está em evitar a IA, mas em aprender a usá-la com sabedoria.

As faculdades em 2025 estão adotando cada vez mais métodos de detecção, mas a verdadeira integridade acadêmica vem da compreensão, transparência e confiança do aluno.

Se você é um estudante em busca de maneiras éticas de usar a IAou um educador se adaptando a um novo cenário de aprendizado - a IA indetectável fornece as ferramentas para apoiar sua jornada com integridade.

Explore a IA indetectável e desvendar maneiras éticas e eficazes de trabalhar com IA nas salas de aula atuais.