Com o prompt de IA corretovocê pode fazer basicamente qualquer coisa. É assim que as ferramentas de IA já são poderosas.

As ferramentas de IA reformularam a forma como as empresas operam, permitindo que elas simplifiquem os processos e aumentem a eficiência como nunca antes.

Uma área em que a IA realmente se destaca é a criação de conteúdo. Não estamos falando apenas de elaborar esboços ou gerar publicações em mídias sociais.

A IA pode até ajudar você escrever livros e Completar trabalhos de pesquisa complexos.

Mas com grande poder vem grande responsabilidade, e nem sempre se pode confiar na IA para fazer a coisa certa.

Às vezes, a IA produz o que é conhecido como "alucinações". Esses são resultados incorretos ou bizarros que podem enganar os usuários.

Quase metade das organizações relatam desafios de qualidade de dados que prejudicam as iniciativas de IA.

Não é uma solução mágica, mas o "aterramento" visa garantir que os resultados da IA sejam baseados em informações confiáveis.

Embora possa parecer complexo, a resposta à pergunta "O que é aterramento e alucinações em IA?" é fundamental para quem usa essas ferramentas poderosas.

Vamos entrar nos detalhes da alucinação por IA para que você possa maximizar com confiança sua produção com IA e, ao mesmo tempo, garantir que suas informações permaneçam precisas.

Principais conclusões

- As alucinações de IA ocorrem quando os modelos geram informações falsas ou enganosas devido a lacunas nos dados ou ajuste excessivo.

- O aterramento ancora as saídas de IA a dados verificados do mundo real para reduzir alucinações e aumentar a confiabilidade.

- As alucinações na criação de conteúdo podem prejudicar a credibilidade, espalhar informações errôneas e causar problemas legais.

- Evite problemas usando ferramentas confiáveis, verificando o conteúdo e fornecendo avisos claros e detalhados.

- A combinação de detecção de IA e supervisão humana - como no caso da Undetectable AI - garante precisão e autenticidade.

O que é aterramento e alucinações em IA?

Quando se trata de entender o que é alucinação em IA, saber como ela pode ocorrer é especialmente útil para organizações que exigem informações tão precisas quanto possível.

Ao aprender sobre aterramento e alucinações de inteligência artificial, você poderá entender melhor como as ferramentas de IA funcionam e garantir que seu Conteúdo gerado por IA você continua sendo confiável.

O que são alucinações na IA?

Imagine que você pediu a um chatbot de IA informações sobre uma pessoa.

Nunca mais se preocupe com a detecção de seus textos pela IA. Undetectable AI Pode lhe ajudar:

- Faça sua escrita assistida por IA aparecer semelhante ao humano.

- Bypass todas as principais ferramentas de detecção de IA com apenas um clique.

- Uso IA com segurança e com confiança na escola e no trabalho.

O modelo fornece com precisão os detalhes frequentemente mencionados em diferentes fontes on-line.

Mas, ao cruzar as informações fornecidas, você percebe que a IA também adivinha incorretamente informações menos conhecidas, como idade e formação educacional.

Esses detalhes errados são conhecidos como "alucinações".

Taxas de alucinação pode variar entre os modelos. O ChatGPT informou anteriormente que cerca de 3%enquanto os sistemas do Google foram estimados em até 27%.

Esses chatbots são orientados por um grande modelo de linguagem que aprende com a análise de grandes quantidades de texto.

Isso acontece porque esses modelos são treinados para prever palavras com base em padrões nos dados que analisaram, sem entender o que é verdadeiro ou não.

As alucinações decorrem principalmente de dados de treinamento incompletos.

Lembre-se de que o modelo pode captar e reproduzir erros, dependendo do que você recebe.

Há também o "ajuste excessivo", em que o modelo identifica padrões ou conexões falsas nos dados.

Resolver as alucinações da IA é um desafio porque esses modelos, que operam com probabilidades e padrões, inevitavelmente produzirão resultados falsos.

Isso pode enganar os usuários que podem confiar no conteúdo da IA como ele é. Por isso, é importante que você esteja ciente dessa limitação ao usar a IA para criação de conteúdo e verificação de fatos.

O que é Grounding AI?

O aterramento da IA é um método eficaz para reduzir as alucinações. Ele funciona ancorando as respostas da IA a dados do mundo real.

Por exemplo, um sistema fundamentado usaria um banco de dados confiável desde o início para fornecer respostas factuais, reduzindo a probabilidade de a IA inventar coisas.

Em vez de confiar apenas na previsão da próxima palavra com base em padrões, um sistema fundamentado primeiro recupera informações de uma fonte confiável.

O modelo também é mais eticamente aceitável porque admite que o contexto é insuficiente e, portanto, não poderá fornecer todas as informações de que você precisa, em vez de apenas adivinhar.

Para maximizar o valor da IA e, ao mesmo tempo, minimizar as imprecisões, as organizações devem investir tempo antecipadamente na coleta de dados de treinamento precisos, diretrizes e outras informações básicas necessárias.

Essa preparação ajuda os resultados de IA a permanecerem baseados na realidade e a serem confiáveis para os usuários.

Portanto, embora o aterramento não seja uma solução infalível, ele pode melhorar significativamente a qualidade das saídas de IA.

Qual é o problema de alucinação da IA na criação de conteúdo?

Na criação de conteúdo, as alucinações de IA podem assumir diferentes formas.

Ao criar um post ou artigo de blog, a IA pode incluir fatos falsos, estatísticas incorretas ou citações inventadas.

A alucinação da IA também não é um engano intencional. O modelo não pode mentir, pois não tem motivação para enganar, nem está ciente de que o que está dizendo é falso.

Você simplesmente não tem uma noção de quão confiáveis são seus resultados.

As consequências das alucinações da IA na criação de conteúdo podem ser graves.

- Disseminação de desinformação: Mais de uma em cada cinco pessoas admitem que podem ter compartilhado notícias falsas sem verificar.

- Danos à credibilidade: Se uma pessoa ou empresa publica conteúdo com informações enganosas, sua reputação pode ser prejudicada. A confiança é fundamental para os usuários e, uma vez perdida, pode ser difícil recuperá-la novamente.

- Repercussões jurídicas e financeiras: A publicação de informações falsas pode levar a possíveis dores de cabeça e até mesmo a processos judiciais. É uma batalha cara que você não vai querer enfrentar.

- Impacto negativo nas decisões de negócios: As empresas que dependem da IA para produzir relatórios e insights para a tomada de decisões podem fazer escolhas ruins com base em dados incorretos. Informações falsas prejudicam tanto o público quanto a empresa ou o indivíduo que usa a IA para a criação de conteúdo. E as alucinações da IA podem, na verdade, piorar esse problema, gerando conteúdo que parece confiável, mas que, na verdade, é falho.

Como evitar problemas causados por alucinações de IA

Sabemos como as ferramentas de IA são valiosas na criação de conteúdo. O uso da IA é até mesmo considerado um dos melhores maneiras de ganhar dinheiro hoje e para se manter competitivo no setor.

É também por isso que resolver o problema das alucinações da IA é crucial para garantir que o conteúdo que você usa com a IA seja preciso.

Entenda as limitações da IA

Embora já saibamos o quanto a IA é poderosa, ela tem suas limitações.

Quando se trata de criação de conteúdo, ele funciona muito bem no reconhecimento de padrões e na geração de texto com base em enormes conjuntos de dados, mas ainda não tem nenhum senso de realidade.

Tenha em mente essas limitações ao usar a IA:

- Tem dificuldade para entender o contexto ou compreender distinções culturais sutis

- Depende muito da qualidade e da quantidade de informações disponíveis

- Tendência a criar preconceitos com base nos dados de treinamento

- Falta criatividade e originalidade semelhantes às humanas

- Pode gerar conteúdo moralmente questionável

- Tem dificuldade para resolver problemas fora do que o sistema conhece

- Dificuldade de se adaptar a situações variáveis ou de fornecer informações em tempo real

- Vulnerável a ataques e pode comprometer a privacidade dos dados

Conhecer seus limites também evita alucinações de IA. Os limites ajudam a definir expectativas realistas e facilitam a detecção de imprecisões antes que elas se tornem públicas.

Use modelos e ferramentas confiáveis

O melhores ferramentas de IA para criação de conteúdo facilitar as coisas. Essas ferramentas não são perfeitas, mas o que você usa deve definitivamente dar conta do recado.

Para chatbots com IA, o ChatGPT ainda é o mais forte do mercado. O GPT-4 apresenta uma alta taxa de precisão de 97% e a menor taxa de alucinações ChatGPT.

Apenas certifique-se de que você dê instruções claras e verifique os resultados em fontes confiáveis.

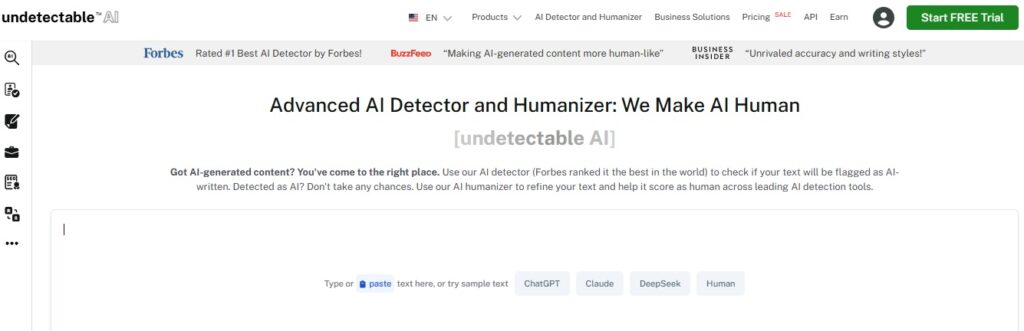

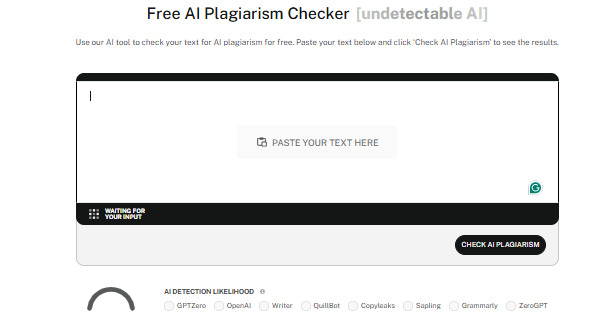

Você também deve usar ferramentas confiáveis de detecção de IA, como Undetectable AI.

Os detectores analisam o conteúdo de forma eficaz para detectar até mesmo os elementos de IA mais sutis, mantendo a autenticidade em qualquer conteúdo que você produza e mantendo sua credibilidade.

O Undetectable também tem um Humanizador de IA que refina ainda mais o texto para que soe natural.

Com ele, você não apenas passa na detecção de IA, mas também garante a qualidade do seu conteúdo.

Verificar conteúdo

Independentemente de como você usa a IA no processo de criação de conteúdo, é sempre importante verificar o conteúdo que você produziu.

Essas são algumas maneiras comuns de verificar o conteúdo da IA:

- Faça a verificação cruzada, comparando informações de várias fontes confiáveis

- Use ferramentas de verificação de fatos para agilizar a eliminação da desinformação

- Busque insights de especialistas no assunto ou profissionais da área

- Ter o conteúdo revisado por colegas para ajudar a identificar possíveis erros, preconceitos ou imprecisões

- Use o software de detecção de IA para garantir a originalidade e evitar que você se torne um usuário de Internet. plágio não intencional

- Considere o contexto histórico ao fazer referência a eventos ou dados para obter precisão

Tomar precauções vale a pena. A verificação do conteúdo de IA lhe dá a confiança necessária de que o que você produz é sempre confiável.

Forneça instruções claras

Uma das principais causas da alucinação por IA são as instruções pouco claras.

Se você fizer perguntas muito vagas à IA, sem nenhum contexto adicional, é mais provável que ela gere respostas que não façam muito sentido.

São os avisos claros e específicos que mantêm a IA no caminho certo.

Portanto, seja específico e detalhado em suas solicitações.

Em vez de fazer perguntas muito amplas, como "Qual é o melhor restaurante asiático?", tente algo mais focado, como "Quais são as lojas de ramen mais bem avaliadas em Kyoto?".

A especificidade ajuda a IA a se manter no caminho certo e a produzir resultados precisos que atendam às suas expectativas.

Mantenha-se atualizado

A tecnologia continua avançando, e em ritmo acelerado, portanto, certifique-se de que você se mantenha atualizado.

A IA aprende essencialmente com os dados em que foi treinada, mas as informações podem ficar desatualizadas rapidamente.

Isso é especialmente verdadeiro em campos de rápida evolução, como pesquisa científica ou saúde.

Você pode se manter informado seguindo fontes confiáveis nas mídias sociais, ou pode fazer cursos relacionados ao seu setor e participar de eventos do setor.

Dessa forma, você terá insights sobre a credibilidade do conteúdo fornecido pela IA.

As próprias ferramentas de IA também são atualizadas com frequência, portanto, fique por dentro dos últimos desenvolvimentos para que você sempre tenha certeza de que está usando as melhores.

Conhecimento humano

Humanos e IA devem trabalhar juntos para garantir a qualidade, a precisão e a autenticidade na criação de conteúdo

Afinal, em última análise, somos nós que trazemos o pensamento crítico, a criatividade e o julgamento ético para a mesa.

Combinando os recursos de IA com a supervisão humana, você pode verificar se o conteúdo não é apenas preciso, mas também contextualmente relevante, além de ser envolvente e atingir as notas certas.

Especialistas humanos podem identificar vieses, verificar informações e tomar decisões que a IA sozinha talvez não consiga entender.

Humanos e IA, juntos, podem criar conteúdo confiável, perspicaz e impactante.

Confira nosso Detector de IA e Humanizador no widget abaixo!

Conclusão

Entender o que é aterramento e alucinações em IA é essencial para quem usa ferramentas de IA em seu trabalho.

O aterramento torna a IA mais precisa e mantém a integridade do seu conteúdo usando dados reais e verificados.

Estar ciente das alucinações de IA também ajuda você a conhecer as maneiras corretas de evitá-las e a ficar longe de possíveis armadilhas.

Manter a precisão do conteúdo de IA é apenas um lado do processo. Garanta que seu conteúdo permaneça autêntico e de alta qualidade usando a IA indetectável.

Essa ferramenta funciona como um detector de IA e um humanizador, garantindo que o conteúdo gerado por IA se misture perfeitamente com a escrita humana e possa ser aprovado nas detecções.

Escolha as melhores opções de verificação de conteúdo de IA para suas necessidades e deixe que Undetectable AI mantém seu conteúdo confiável, original e humano de forma consistente. Comece a usá-lo hoje mesmo.