Termín deepfake se poprvé objevil na Redditu v roce 2017, když uživatel se stejným jménem začal sdílet pozměněná videa, která využívala umělou inteligenci k výměně obličejů, zpočátku v obsahu pro dospělé.

Reddit sice původní subreddit zakázal, ale myšlenka se již ujala.

Kořeny této technologie však sahají ještě dále.

Již v roce 1997 začali vědci experimentovat se střihem videa pomocí strojového učení.

Jejich raný nástroj pro synchronizaci rtů, tzv. Přepis videa by mohl vyvolat dojem, že někdo říká něco, co neřekl.

Technicky vzato to nebyl deepfake podle dnešních standardů, ale položil základy pro to, co mělo přijít později.

Dnešní blog se zabývá tím, jak tato vyvíjející se technologie funguje, kde se objevuje v každodenním životě a jaká rizika a výhody s sebou přináší.

Začněme tím, co je to vlastně deepfake.

Klíčové poznatky:

- Deepfakes jsou média generovaná umělou inteligencí, která vytvářejí dojem, že lidé říkají nebo dělají věci, které ve skutečnosti neudělali.

- S bezplatnými nástroji a základními dovednostmi může nyní téměř každý vytvořit přesvědčivá deepfake videa, obrázky nebo zvukové klipy.

- Deepfakes mohou být kreativní nebo zábavné, ale představují také vážná rizika, jako jsou podvody, pomluvy a dezinformace.

- Většinu deepfakes můžete odhalit pomocí detekčních nástrojů nebo pozorným sledováním vizuálních a behaviorálních nesrovnalostí.

Co je Deepfake?

Deepfake je falešné médium, obvykle video, zvukový klip nebo obrázek, který byl upraven pomocí umělé inteligence tak, aby někdo vypadal nebo zněl, jako by dělal nebo říkal něco, co ve skutečnosti nedělal.

Neberte to jako špatnou práci ve Photoshopu nebo jako špatný hlasový projev.

Mluvíme o manipulaci na vysoké úrovni pomocí technologie zvané hluboké učení, což je podmnožina umělé inteligence.

Už nikdy se nemusíte obávat, že umělá inteligence rozpozná vaše texty. Undetectable AI Může vám pomoci:

- Zpřístupněte psaní s asistencí umělé inteligence podobný člověku.

- Bypass všechny hlavní nástroje pro detekci umělé inteligence jediným kliknutím.

- Použijte AI bezpečně a sebevědomě ve škole a v práci.

To je to, co termín "deepfake" naznačuje: hluboké učení a falešný obsah.

Cílem deepfake je obvykle vytvořit něco, co vypadá dostatečně reálně, aby to lidi oklamalo.

Možná jste viděli virální videa, na kterých celebrity dělají bizarní věci nebo politici pronášejí pobuřující výroky, které by ve skutečnosti nikdy neřekli.

To jsou klasické případy použití deepfake. To, co vidíte, není skutečné, ale technologie, která za tím stojí, je natolik dobrá, že váš mozek podvrh okamžitě nepostřehne, pokud se opravdu nedíváte.

K tomu slouží nástroje, jako je TruthScan vstoupit.

Služba TruthScan je určena pro organizace, které potřebují ověřovat média ve velkém měřítku - společnosti, redakce, univerzity a veřejné agentury. Pomáhá týmům odhalit manipulaci dříve, než falešný obsah poškodí důvěru nebo pověst.

Podle výzkumného týmu společnosti Undetectable AI, 85 % Američanů tvrdí, že deepfakes narušily jejich důvěru v online informace..

Právě jste se dozvěděli, co je vlastně deepfake video nebo médium, a nyní se podíváme, jak je lidé vytvářejí.

Jak vznikají deepfakes

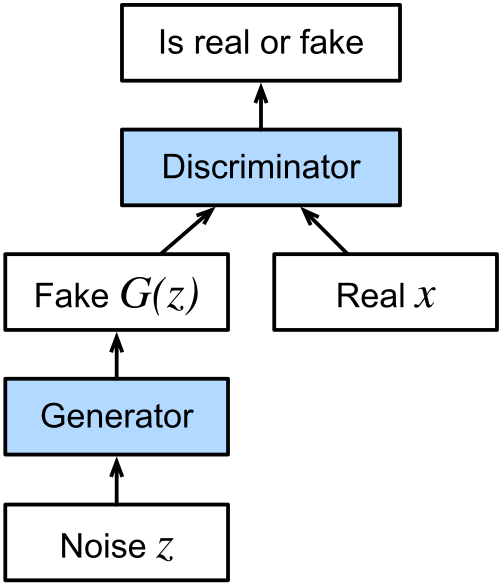

Technologií, která stojí za většinou deepfakes, je kategorie algoritmů strojového učení nazývaná generativní adversariální sítě (GAN).

GAN se skládají ze dvou částí: generátoru a diskriminátoru.

Generátor vytváří falešná média na základě toho, k čemu byl vyškolen, a úkolem rozlišovače je odhalit, co vypadá jako falešné.

Vracejí se tam a zpět, dokud se generátor nezlepší ve vytváření falešného obsahu, který projde testem diskriminátoru.

Postupem času tato vzájemná komunikace vede k médiím, která vypadají až šokujícím způsobem realisticky.

Co je to proces generování falešných videí?

Při vytváření deepfake videa systém analyzuje videa z více úhlů, zkoumá, jak osoba mluví, jak se pohybuje její obličej, jak se pohybuje její tělo.

Všechny tyto informace se vloží do generátoru, aby mohl vytvořit obsah, který toto chování napodobuje.

Diskriminátor pak pomáhá s doladěním a upozorňuje na nedostatky, dokud konečný výsledek nevypadá správně.

Proto iluze tak dobře drží v pohybu.

V závislosti na účelu deepfake videa se používá několik různých technik.

Pokud jde o to, aby se zdálo, že někdo ve videu říká nebo dělá něco, co ve skutečnosti neřekl nebo neudělal, pak se jedná o tzv. deepfake zdrojového videa.

Hluboký autokodér, který se skládá z kodéru a dekodéru, studuje původní záznam a aplikuje na něj výrazy, gesta a jemné pohyby hlavy cílové osoby.

Zvukové podvrhy Deepfakes

Zvukový deepfake funguje tak, že se na základě nahrávek přirozené mluvy naklonuje něčí hlas, opět pomocí GAN.

Jakmile je model vycvičen, může generovat novou řeč tímto hlasem, i když daná osoba tato slova nikdy neřekla.

Další často přidávanou vrstvou je synchronizace rtů.

Zde systém mapuje generovaný nebo předem nahraný zvuk na video.

Cílem je, aby rty ve videu odpovídaly slovům ve zvuku.

Reálné příklady hlubokých podvrhů

Deepfakes se v těchto dnech objevují všude.

Představíme vám několik populárních deepfakes, které ukazují, jak daleko tato technologie pokročila.

Deepfake prezidenta Zelenského, který žádá ukrajinské vojáky, aby se vzdali

V březnu 2022, v počátečních fázích rusko-ukrajinské války, se na internetu objevilo video. zobrazující ukrajinského prezidenta Volodymyra Zelenského vyzýval své vojáky, aby se vzdali.

Vypadalo to jako celostátní projev, doplněný Zelenského hlasem a manýrami.

Video se rozšířilo po sociálních sítích a bylo dokonce zveřejněno na kompromitovaném ukrajinském zpravodajském webu.

Prezident jednal rychle a prostřednictvím svých ověřených kanálů vydal oficiální prohlášení, v němž záběry vyvrátil.

Virální Deepfake obrázek papeže Františka v designové péřové bundě

Někdy nemusí být deepfake obrázek škodlivý, aby způsobil zmatek.

V roce 2023 se objeví virální fotografie Papež František se prochází ve stylové bílé bundě Balenciaga vzal internet útokem.

Zaznamenal desítky milionů zhlédnutí a byl hojně sdílen na různých platformách.

Obrázek vytvořil anonymní uživatel z Chicaga pomocí nástroje umělé inteligence Midjourney.

Elon Musk Deepfakes používaný při online podvodech

V roce 2024, deepfakes s Elonem Muskem se stal ústřední součástí několika rozsáhlých online podvodů.

Na Facebooku, TikToku a dalších platformách se začala objevovat Muskova videa generovaná umělou inteligencí, která propagovala falešné nabídky kryptoměn a investiční programy.

Tyto klipy vypadaly a zněly pozoruhodně reálně.

Škody nebyly jen teoretické. Starší důchodce údajně přišel o téměř $700 000 poté, co se nechal přesvědčit jedním z těchto videí.

Robovýzva Joe Bidena, která se zaměřila na americké voliče

Na začátku roku 2024, těsně před primárkami v New Hampshire, voliči obdrželi robotické hovory který zněl přesně jako americký prezident Joe Biden.

Joe Biden ve svém telefonátu vyzýval voliče, aby zůstali doma a nechali si svůj hlas na listopadové parlamentní volby. Záměrem bylo zmást a uvést voliče v omyl, aby primárky vynechali.

Incident vyvolal volání po regulaci. Obhajující skupiny vyzvaly americkou Federální volební komisi, aby zasáhla, ale ta to nakonec odmítla s odkazem na omezení svých pravomocí.

Mezitím telekomunikační společnost odpovědná za distribuci robocallů souhlasila se zaplacením pokuty ve výši $1 milionu EUR..

Využití politických falešných zpráv v indických volbách v roce 2020

Ne všechna použití technologie deepfake jsou škodlivá nebo klamavá (více o tom později na blogu).

Během voleb do zákonodárného shromáždění v Dillí v roce 2020. Strana Bharatiya Janata použila umělou inteligenci k vytvoření reklamy v kampani pro různé jazykové skupiny.

Strana převzala video svého lídra Manoje Tiwariho, který mluví anglicky, a pomocí falešného dabingu vytvořila verzi v regionálním dialektu haryanvi.

Hlas namluvil herec, ale vizuální stránka byla upravena tak, aby odpovídala novému zvuku, a to pomocí umělé inteligence vycvičené na skutečných záběrech Tiwariho.

Členové strany to považovali za pozitivní využití technologií, které jim umožnilo navázat kontakt s voliči v jazyce, kterému rozumějí, i když jím kandidát nemluví plynně.

Jak ověřovat hluboké podvrhy v reálném světě

S rozšiřováním deepfakes v politice, zábavě a každodenní komunikaci je nyní důležitější než kdy jindy vědět, jak ověřit, co je skutečné.

Navzdory nárůstu sofistikovaných příkladů existují spolehlivé nástroje, které mohou čelit hrozbě technologie deepfake.

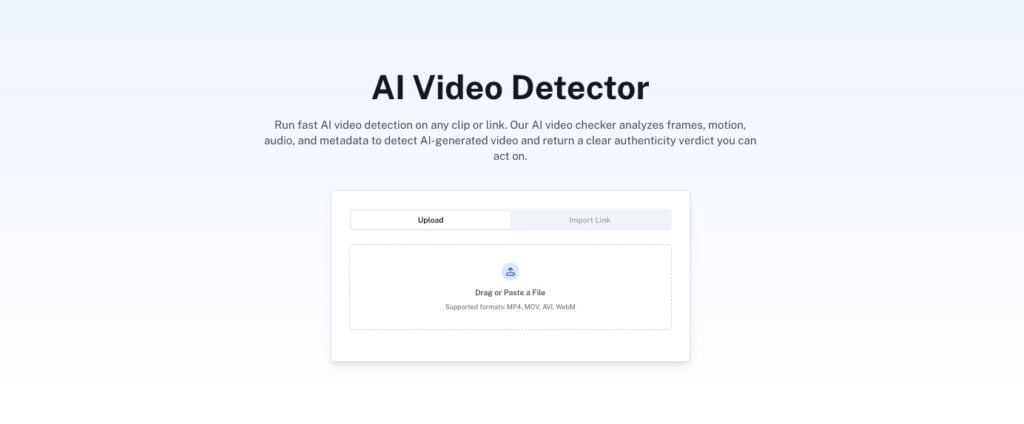

Nezjistitelné AI Detektor videa s umělou inteligencí je jedním z takových nástrojů, který dokazuje, že existují spolehlivé nástroje pro boj proti sofistikovaným příkladům technologie deepfake.

To je místo, kde Undetectable AI Detekce hlubokých podvrhů přichází.

Je určen k ověření, zda zvukový nebo obrazový obsah byl uměle vytvořen, pomocí pokročilých forenzních modelů, které analyzují pohyb po jednotlivých snímcích, konzistenci na úrovni pixelů a otisky hlasu.

Během několika sekund mohou uživatelé zjistit, zda bylo video digitálně upraveno nebo zda byl hlas naklonován umělou inteligencí.

Stačí nahrát soubor a nástroj poskytne podrobnou zprávu o pravosti s vizuálním rozdělením a skóre důvěryhodnosti.

Ať už jde o virální klip, podezřelý rozhovor nebo sdílenou nahrávku, služba Deepfake Detection pomáhá novinářům, pedagogům i běžným uživatelům odhalit pravdu, která se skrývá za tím, co vidí a slyší.

Jsou deepfakes nebezpečné? Rizika a obavy

Dosud jsme se zabývali tím, co je to deepfake, jak vzniká a kde se již objevil v reálném světě.

Tato technologie je nesporně působivá, ale rizika s ní spojená jsou vážná a rychle rostou.

Deepfakes lze využít různými způsoby. Zde je několik hlavních obav.

Pomluva

Pokud je něčí podoba nebo hlas použit k vytvoření falešných výroků, prohlášení nebo videí, zejména těch, které jsou urážlivé nebo kontroverzní, může to téměř okamžitě zničit pověst.

A na rozdíl od starších hoaxů nebo falešných citátů nenechává přesvědčivý deepfake v divákově mysli příliš prostoru pro pochybnosti.

V tomto ohledu mohou deepfakes vyvolat pobouření, zničit vztahy nebo jednoduše prosazovat škodlivý narativ.

Obzvláště znepokojivé je, že deepfake ani nemusí být dokonalý.

Pokud je osoba rozpoznatelná a obsah dostatečně věrohodný, může zanechat trvalý dopad na veřejné mínění.

Důvěryhodnost informací

Další velkou obavou je, jak deepfakes podkopávají samotnou myšlenku pravdy.

S rostoucím výskytem deepfakes je stále těžší zjistit, zda to, co vidíme nebo slyšíme, je skutečné. Časem by to mohlo vést k širšímu poklesu důvěry v jakoukoli formu digitální komunikace.

Tato krize důvěryhodnosti přesahuje rámec jednotlivých incidentů.

V demokratických společnostech se lidé při rozhodování, debatách a řešení společných problémů opírají o sdílená fakta.

Pokud však voliči, diváci nebo občané začnou o všem pochybovat, je mnohem snazší manipulovat veřejným míněním nebo odmítat nepohodlné pravdy jako "další deepfake".

Vydírání

Média generovaná umělou inteligencí mohou být použita k falešnému obvinění jednotlivců, aby to vypadalo, že udělali něco nezákonného, neetického nebo trapného.

Tento druh vyrobených důkazů pak může být použit k jejich zastrašování nebo kontrole.

A to v obou směrech. Vzhledem k tomu, že falešné důkazy jsou dnes tak reálné, může někdo, kdo čelí skutečnému vydírání, tvrdit, že důkazy jsou falešné, i když nejsou.

Někdy se tomu říká vyděračská inflace, kdy samotný objem věrohodných padělků nakonec snižuje hodnotu skutečného usvědčujícího materiálu.

Důvěryhodnost skutečných důkazů se ztrácí v mlze, a to jen přidává další vrstvu složitosti při snaze odhalit protiprávní jednání.

Podvody a podvodná jednání

Pomocí videí generovaných umělou inteligencí nebo hlasů důvěryhodných veřejných osobností vytvářejí podvodníci neuvěřitelně přesvědčivé schémata.

V některých případech jsou deepfakes známých osobností, jako je Elon Musk, Tom Hanks nebo Oprah Winfrey, používány k propagaci produktů nebo služeb, o kterých nikdy neslyšeli.

Tato videa se pak šíří na sociálních platformách, kde se dostanou k milionům lidí.

Ohroženy jsou i soukromé osoby, zejména při spearphishingových kampaních, které se zaměřují na konkrétní osoby s personalizovaným obsahem určeným k manipulaci nebo oklamání.

Podle 2024 zpráva časopisu Forbes, podvody způsobené falešnými stránkami již způsobily celosvětové ztráty v odhadované výši $12 miliard a očekává se, že se tato částka v příštích několika letech více než ztrojnásobí.

Proto není detekce určena jen pro jednotlivce. Je zásadní i pro společnosti, které zpracovávají citlivá data, komunikaci nebo veřejný obsah. TruthScan těmto organizacím pomáhá identifikovat pozměněná videa dříve, než se rozšíří dezinformace.

Pozitivní a kreativní využití Deepfakes

Stojí za zmínku, že ne každá aplikace této technologie je negativní.

Zatímco mnoho blogů vysvětlujících, co je to deepfake, se zaměřuje na zneužití, roste seznam kreativních a produktivních způsobů využití deepfake.

Přesto by se u firem měla před zveřejněním ověřit pravost i uměleckých nebo marketingových deepfakes.

Nástroje, jako je TruthScan, mohou potvrdit, že ve finální verzi nezůstala žádná nezamýšlená manipulace.

Níže uvádíme několik významných příkladů.

Filmové a herecké výkony

Studia se začínají spoléhat na technologii deepfake, například pro:

- Zlepšení vizuálních efektů

- Snížení výrobních nákladů

- Návrat postav, které již nejsou k dispozici

Disneynapříklad zdokonaluje modely deepfake s vysokým rozlišením, které umožňují výměnu obličejů a stárnutí herců s působivým realismem.

Jejich technologie pracuje s rozlišením 1024 x 1024 a dokáže přesně sledovat výrazy obličeje, aby postavy vypadaly mladší nebo výraznější.

Kromě Hollywoodu umožnily deepfakes i globální kampaně, jako když např. David Beckham byl digitálně naklonován předávat zdravotní sdělení ve více jazycích.

Art

V roce 2018 použil multimediální umělec Joseph Ayerle technologii deepfake k vytvoření herce s umělou inteligencí, který spojil tvář italské filmové hvězdy Ornelly Muti s tělem Kendall Jenner.

Výsledkem bylo surrealistické zkoumání generační identity a umělecká provokace, součást videoartového díla s názvem Un'emozione per sempre 2.0.

Deepfakes se objevily také v satiře a parodii.

Ukázkovým příkladem je webový seriál Sassy Justice z roku 2020, který vytvořili tvůrci South Parku Trey Parker a Matt Stone.

Využíval deepfaked veřejných osobností, aby si dělal legraci z aktuálních událostí a zároveň zvyšoval povědomí o samotné technologii.

Zákaznický servis

Mimo kreativní odvětví nacházejí firmy využití deepfakes i ve službách pro zákazníky.

Některá call centra nyní používají syntetické hlasy podporované technologií deepfake k automatizaci základních požadavků, jako jsou dotazy na účet nebo přihlašování stížností.

V těchto případech se nejedná o zlý úmysl, ale o pouhé zefektivnění.

Systémy odezvy volajícího lze přizpůsobit pomocí hlasů generovaných umělou inteligencí, aby automatizované služby zněly přirozeněji a poutavěji.

Vzhledem k tomu, že zpracovávané úkoly jsou obvykle málo rizikové a opakující se, pomáhají deepfakes v tomto kontextu snížit náklady a uvolnit lidské agenty pro složitější problémy.

Vzdělávání

Vzdělávací platformy také začaly využívat výukové programy využívající technologii deepfake, které pomáhají studentům interaktivnějším způsobem.

Tito lektoři s umělou inteligencí mohou poskytovat lekce pomocí syntetických hlasů a personalizovaných pokynů.

Nástroje a techniky pro detekci hlubokých falzifikátů

S tím, jak jsou deepfakes stále dokonalejší a dostupnější, roste i potřeba identifikovat je dříve, než způsobí škodu.

Lidé a organizace také potřebují správné nástroje a techniky, aby byli o krok napřed. Zde je tedy několik nástrojů a technik.

Pro ověření zaměřené na obraz, Detektor obrazu s umělou inteligencí TruthScan analyzuje osvětlení, vzory pixelů a složené prvky a označuje vizuální prvky vytvořené nebo upravené umělou inteligencí v reálném čase.

Pomáhá týmům rychle potvrdit pravost obrázků a videosnímků před zveřejněním nebo sdílením obsahu.

TruthScan: Hloubková detekce podvrhů na podnikové úrovni

TruthScan je určen pro podniky, univerzity a mediální organizace, které potřebují rozsáhlé ověřování vizuálního a zvukového obsahu.

Analyzuje autenticitu videa v několika rozměrech:

- Detekce výměny obličeje: Identifikuje manipulované rysy obličeje snímek po snímku.

- Behaviorální snímání otisků prstů: Detekuje jemné výrazové vzorce a mikropohyby, které neodpovídají přirozenému lidskému chování.

- Forenzní video: Zkoumá kompresi snímků, šum pixelů a manipulaci s hlasem.

- Detekce v reálném čase: Umožňuje živé ověřování během videohovorů, tiskových zpráv nebo vysílání.

S nástrojem TruthScan mohou týmy ověřit pravost videí před jejich zveřejněním nebo veřejným šířením, a zabránit tak poškození pověsti a finančním škodám.

Pro běžné uživatele nabízejí nástroje Undetectable AI podobnou ochranu na individuální úrovni.

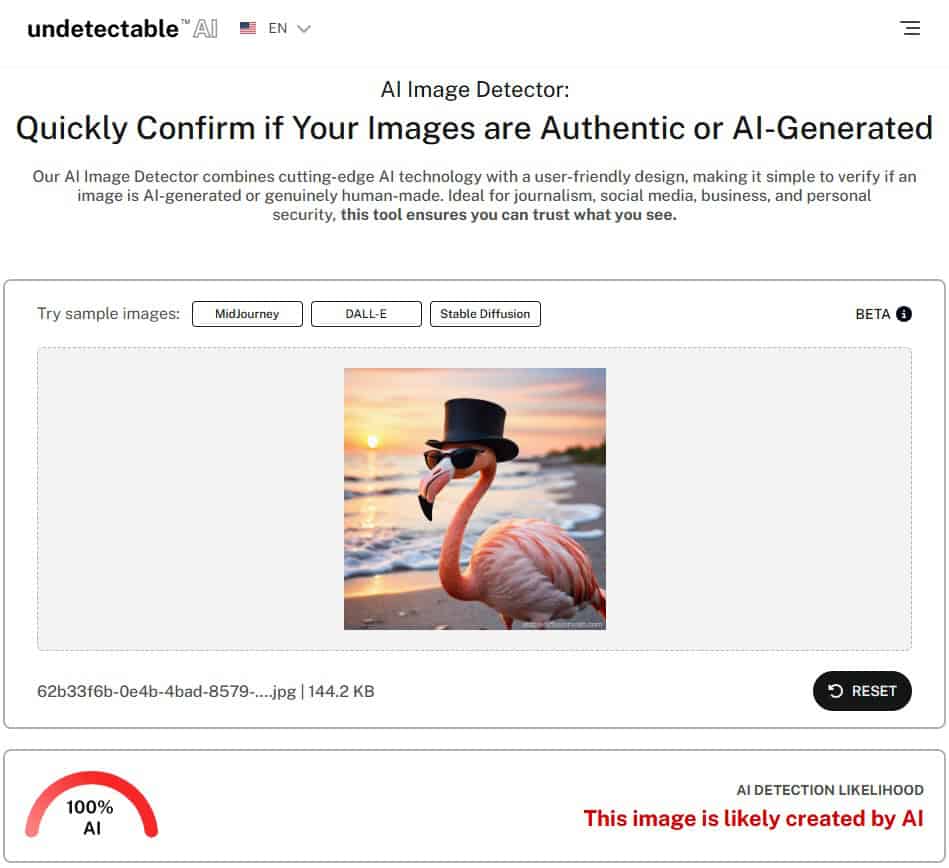

Detektor obrázků AI od Undetectable AI

Detektor obrázků s umělou inteligencí od společnosti Undetectable AI usnadňuje detekci deepfake i těm, kteří nemají technické vzdělání.

Detektor funguje na základě analýzy různých prvků v nahraném obrázku, jako jsou barevné vzory, textury, rysy obličeje a strukturální nesrovnalosti.

Podporuje detekci médií vytvořených pomocí nejznámějších generátorů obrázků AI, jako je např.

- MidJourney

- DALL-E

- Stabilní difúze

- Ideogram

- Modely založené na GAN

Chcete-li jej použít, stačí nahrát obrázek, nechat jej analyzovat a získat jasný verdikt s hodnocením důvěryhodnosti.

Pokud si nejste jisti, zda je obrázek, na který jste narazili, pravý, vyzkoušejte naši aplikaci. Detektor obrazu AI zkontrolovat, zda se neobjevily známky manipulace s umělou inteligencí.

Nyní vložíme Detektor umělé inteligence společnosti Undetectable a zjistit, zda dokáže přesně rozpoznat, že je obrázek vytvořen umělou inteligencí.

Jak vidíte, detektor umělé inteligence obrázku od společnosti Undetectable AI označil tento obrázek jako 100% vytvořený umělou inteligencí.

Vizuální a behaviorální techniky pro manuální detekci

Existují také praktické techniky, které mohou jednotlivci použít k ručnímu odhalení deepfakes, zejména v situacích, kdy je potřeba okamžitá analýza.

Mezi vizuální varovné signály patří:

- Rozpačité držení tváře nebo zvláštní výrazy.

- Nekonzistentní osvětlení nebo zbarvení v různých částech snímku nebo videa.

- Mihotání kolem obličeje nebo linie vlasů, zejména při pohybu.

- Nedostatek přirozeného mrkání nebo nepravidelný pohyb očí.

- Nesrovnalosti v synchronizaci rtů, kdy zvuk neodpovídá řeči.

Z hlediska chování se deepfakes často snaží napodobit jemné lidské rysy. Věnujte pozornost řeči těla, emočním projevům a obvyklým gestům.

A v konverzacích v reálném čase, zejména u živých videí, požádejte o pohled z bočního profilu.

Mnoho deepfake modelů má stále problémy s přesným vykreslením 90stupňového úhlu obličeje nebo složitých pohybů, jako je otáčení hlavy, při zachování přirozeného výrazu.

Rozpoznávání hlubokých podvrhů v textu a kontextu

Deepfakes se neomezují jen na vizuální efekty. Některé verze zahrnují syntetický text, hlas nebo chování, které napodobují něčí komunikační styl.

Při analýze textového obsahu nebo dialogu si dávejte pozor na:

- Pravopisné chyby a zvláštní gramatika.

- Věty, které působí nuceně nebo neplynou přirozeně.

- Neobvyklé e-mailové adresy nebo nekonzistentní formulace.

- Zprávy, které jsou vytržené z kontextu nebo nesouvisejí s danou situací.

Záleží také na kontextu. Pokud se video nebo zpráva objeví v prostředí, které nedává smysl, jako například politik, který v nekvalitním klipu náhodně oznamuje důležité rozhodnutí, stojí za to pochybovat o jeho pravosti.

Zajímá vás náš detektor umělé inteligence a humanizér? Vyzkoušejte je ve widgetu níže!

Časté dotazy o službě Deepfakes

Jsou deepfakes nelegální?

Deepfakes nejsou standardně nezákonné, ale mohou být, pokud porušují stávající zákony, například zákony týkající se pomluvy, dětské pornografie nebo nepovoleného explicitního obsahu.

Některé státy USA přijaly zákony zaměřené na deepfakes, které ovlivňují volby nebo zahrnují pornografii z pomsty.

Federální návrhy zákonů, jako je DEFIANCE Act a Žádné falzifikáty probíhá také regulace škodlivého používání technologie deepfake.

Může někdo vytvořit deepfake?

Ano, deepfake může vytvořit téměř každý pomocí bezplatného nebo levného softwaru a nástrojů umělé inteligence.

Mnoho platforem dnes nabízí uživatelsky přívětivá rozhraní, takže pro začátek není třeba žádných pokročilých technických dovedností.

Jak se mohu chránit před deepfakes?

Omezte svou expozici tím, že nebudete na internetu zveřejňovat obrázky nebo videa ve vysokém rozlišení. Používejte nastavení ochrany soukromí a detekční nástroje, jako jsou např. Nezjistitelná AI nebo TruthScan překontrolovat cokoli podezřelého.

Existují aplikace pro detekci deepfake?

Ano, TruthScan je určen pro firemní uživatele, kteří potřebují analyzovat video obsah ve velkém měřítku, zatímco detektory Undetectable AI slouží jednotlivcům a tvůrcům, kteří chtějí ověřovat menší objemy obsahu.

Závěrečné myšlenky

Deepfakes mění náš pohled na pravdu online. Ať už chráníte svou značku, spravujete komunikaci s veřejností nebo jen bezpečně procházíte web, používání správných detekčních nástrojů má velký význam.

Pro podniky a instituce, TruthScan poskytuje ochranu na podnikové úrovni proti dezinformacím způsobeným umělou inteligencí.

Pro jednotlivce: Nezjistitelná AI. Detektor obrazu AI nabízí jednoduchý a rychlý způsob, jak kontrolovat obrázky a být informován.

Společně pomáhají zajistit, aby to, co vidíte a sdílíte, zůstalo skutečné.