Termi deepfake ilmestyi Redditiin vuonna 2017, kun käyttäjä, jolla oli sama näyttönimi, alkoi jakaa muokattuja videoita, joissa tekoälyä käytettiin kasvojen vaihtamiseen, aluksi aikuissisältöön.

Vaikka Reddit kielsi alkuperäisen subredditin, idea oli jo lähtenyt liikkeelle.

Tämän tekniikan juuret ulottuvat kuitenkin vieläkin kauemmas.

Vuonna 1997 tutkijat olivat jo alkaneet kokeilla videoeditointia koneoppimisen avulla.

Heidän varhainen huulisynkronointityökalunsa, nimeltään Videon uudelleenkirjoitus voi saada jonkun näyttämään sanovan jotain, mitä hän ei ole sanonut.

Se ei ollut teknisesti katsoen deepfake nykypäivän standardien mukaan, mutta se loi pohjan sille, mitä seuraavaksi tulisi.

Tämänpäiväisessä blogissa käsitellään sitä, miten tämä kehittyvä teknologia toimii, missä se näkyy jokapäiväisessä elämässä ja mitä riskejä ja hyötyjä se tuo mukanaan.

Aloitetaan ymmärtämällä, mitä deepfake oikeastaan on.

Keskeiset asiat:

- Deepfakes ovat tekoälyn luomia medioita, jotka saavat ihmiset näyttämään sanovan tai tekevän asioita, joita he eivät ole koskaan tehneet.

- Ilmaisilla työkaluilla ja perustaidoilla lähes kuka tahansa voi nyt luoda vakuuttavia väärennettyjä videoita, kuvia tai äänileikkeitä.

- Vaikka väärennökset voivat olla luovia tai viihdyttäviä, niihin liittyy myös vakavia riskejä, kuten huijauksia, kunnianloukkauksia ja väärää tietoa.

- Voit havaita useimmat väärennökset käyttämällä tunnistustyökaluja tai tarkkailemalla tarkasti visuaalisia ja käyttäytymiseen liittyviä epäjohdonmukaisuuksia.

Mikä on Deepfake?

Deepfake on väärennettyä mediaa, yleensä videota, äänileikettä tai kuvaa, jota on muokattu tekoälyn avulla, jotta joku näyttäisi tai kuulostaisi siltä kuin hän tekisi tai sanoisi jotain, mitä hän ei ole koskaan tehnyt.

Älä pidä tätä vain huonona Photoshop-työnä tai huonona ääninäyttelynä.

Kyse on korkean tason manipuloinnista, jossa käytetään teknologiaa nimeltä syväoppiminen, joka on tekoälyn osa-alue.

Älä enää koskaan murehdi tekoälyn havaitsevan tekstejäsi. Undetectable AI Voi auttaa sinua:

- Tee tekoälyavusteinen kirjoittaminen näkyväksi ihmisen kaltainen.

- Bypass kaikki tärkeimmät tekoälyn tunnistustyökalut yhdellä napsautuksella.

- Käytä AI turvallisesti ja luottavaisesti koulussa ja työssä.

Siihen termi "deepfake" viittaa: syväoppiminen ja väärennetty sisältö.

Deepfaken tavoitteena on yleensä luoda jotain, joka näyttää tarpeeksi aidolta huijatakseen ihmisiä.

Ehkä olet nähnyt noita viraalivideoita, joissa julkkikset tekevät omituisia asioita tai poliitikot antavat törkeitä lausuntoja, joita he eivät koskaan sanoisi.

Nämä ovat klassisia deepfake-käyttötapauksia. Se, mitä näet, ei ole todellista, mutta tekniikka sen takana on kehittynyt niin hyväksi, että aivosi eivät heti huomaa väärennöstä, ellet todella etsi sitä.

Tässä kohtaa työkalut, kuten TruthScan astu sisään.

TruthScan on suunniteltu organisaatioille, joiden on varmennettava mediaa laajassa mittakaavassa - yrityksille, uutistoimistoille, yliopistoille ja julkisille virastoille. Se auttaa tiimejä havaitsemaan manipuloinnin ennen kuin väärä sisältö vahingoittaa luottamusta tai mainetta.

Itse asiassa Undetectable AI:n tutkimusryhmän mukaan, 85 % amerikkalaisista sanoo, että väärennökset ovat heikentäneet heidän luottamustaan verkkotietoihin..

Olet juuri oppinut, mitä deepfake-video tai -media oikeastaan on, nyt on vuorossa, miten ihmiset tekevät niitä.

Miten Deepfakes tehdään

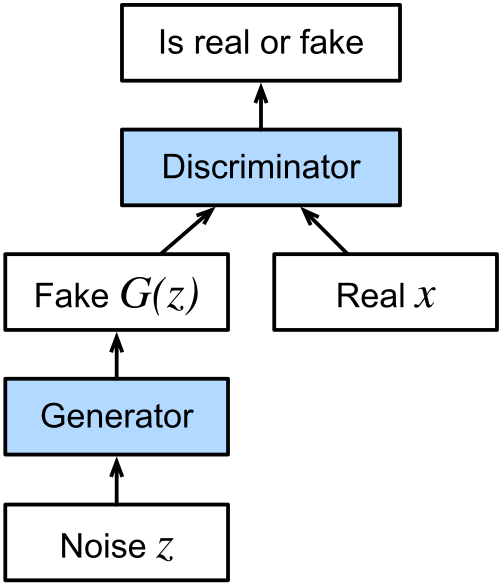

Useimpien syväpetosten taustalla oleva teknologia on koneoppimisalgoritmien luokka, jota kutsutaan generatiivisiksi vastakkaisverkoiksi (generative adversarial networks, GAN).

GANit koostuvat kahdesta osasta: generaattorista ja erottimesta.

Generaattori luo väärennettyä mediaa sen perusteella, mitä se on koulutettu jäljittelemään, ja erottelijan tehtävänä on havaita, mikä näyttää väärennetyltä.

Ne jatkavat edestakaisin, kunnes generaattori oppii tekemään paremmin väärennettyä sisältöä, joka läpäisee erottelijan testin.

Ajan mittaan tämä edestakainen toiminta johtaa median tuottamiseen, joka näyttää järkyttävän realistiselta.

Mikä on Deepfake-videon luomisprosessi?

Kun järjestelmä rakentaa deepfake-videota, se analysoi videoita useista eri kuvakulmista, tutkii, miten henkilö puhuu, miten hänen kasvonsa liikkuvat ja miten hänen kehonsa liikkuu.

Kaikki nämä tiedot syötetään generaattoriin, jotta se voi luoda sisältöä, joka jäljittelee kyseistä käyttäytymistä.

Sen jälkeen erottelija auttaa hienosäätämään sitä huomauttamalla siitä, mikä on pielessä, kunnes lopputulos näyttää juuri oikealta.

Siksi illuusio kestää niin hyvin liikkeessä.

Deepfake-videon tarkoituksesta riippuen käytetään muutamia erilaisia tekniikoita.

Jos tarkoituksena on saada joku näyttämään sanovan tai tekevän videolla jotain, mitä hän ei ole koskaan sanonut tai tehnyt, kyseessä on niin sanottu lähdevideon väärennös.

Enkooderin ja dekooderin muodostama deepfake-autokooderi tutkii alkuperäistä kuvamateriaalia ja soveltaa siihen kohteen ilmeitä, eleitä ja hienovaraisia päänliikkeitä.

Audio Deepfakes

Äänen väärennös toimii kloonaamalla jonkun henkilön ääni, jälleen GANien avulla, perustuen tallenteisiin siitä, miten hän luonnollisesti puhuu.

Kun malli on kerran koulutettu, se voi tuottaa uutta puhetta kyseisellä äänellä, vaikka henkilö ei olisi koskaan sanonut kyseisiä sanoja.

Toinen usein lisätty taso on huulisynkronointi.

Järjestelmä kuvaa luotua tai ennalta nauhoitettua ääntä videolle.

Tavoitteena on saada videon huulet vastaamaan äänen sanoja.

Todellisia esimerkkejä syväväärennöksistä

Deepfakeja näkyy nykyään kaikkialla.

Esittelemme sinulle muutamia suosittuja deepfake-tekstejä, jotka osoittavat, miten pitkälle teknologia on edennyt.

Deepfake presidentti Zelenskystä, joka pyytää Ukrainan joukkoja antautumaan.

Maaliskuussa 2022, Venäjän ja Ukrainan sodan alkuvaiheessa, verkkoon ilmestyi video, jossa kerrotaan Ukrainan presidentin Volodymyr Zelenskyyn esittelyssä kehottaen sotilaitaan antautumaan.

Se näytti kansalliselta puheelta, jossa oli Zelenskyyn ääni ja maneerit.

Video levisi sosiaalisessa mediassa, ja se julkaistiin jopa vaarantuneella ukrainalaisella uutissivustolla.

Presidentti toimi nopeasti ja julkaisi vahvistettujen kanaviensa kautta virallisen lausunnon, jossa hän kumosi kuvamateriaalin.

Viral Deepfake-kuva paavi Franciscuksesta suunnittelijan puskuritakissa

Joskus väärennetyn kuvan ei tarvitse olla pahantahtoinen aiheuttaakseen hämmennystä.

Vuonna 2023 leviää kuva Paavi Franciscus kävelee ympäriinsä tyylikkäässä valkoisessa Balenciagan puskuritakissa valloitti internetin myrskyssä.

Se keräsi kymmeniä miljoonia katselukertoja, ja sitä jaettiin laajalti eri alustoilla.

Kuva on luotu Midjourney-nimisellä tekoälytyökalulla, jonka on luonut nimettömänä pysyttelevä chicagolainen käyttäjä.

Elon Musk Deepfakes käytetään online-huijauksissa

Vuonna 2024, deepfakes featuring Elon Musk tuli keskeinen osa useita laajamittaisia verkkohuijauksia.

Tekoälyn luomat videot Muskista alkoivat ilmestyä Facebookiin, TikTokiin ja muille alustoille, ja niissä mainostettiin väärennettyjä kryptovaluuttojen lahjoituksia ja sijoitusjärjestelmiä.

Nämä klipit näyttivät ja kuulostivat hämmästyttävän aidoilta.

Vahingot eivät olleet vain teoreettisia. Eräs iäkäs eläkeläinen menetti tiettävästi lähes $700 000 euroa saatuaan vakuutettua itsensä yhdellä näistä videoista.

Joe Bidenin Deepfake-robopuhelu, joka kohdistui yhdysvaltalaisiin äänestäjiin.

Vuoden 2024 alussa, juuri ennen New Hampshiren esivaaleja, äänestäjät saivat robocall-puheluita joka kuulosti aivan Yhdysvaltain presidentiltä Joe Bidenilta.

Puhelussa Joe Biden kehotti äänestäjiä pysymään kotona ja säästämään äänensä marraskuun parlamenttivaaleihin. Tarkoituksena oli hämmentää ja johtaa äänestäjiä harhaan, jotta he jättäisivät esivaalit väliin.

Tapaus johti sääntelyn vaatimiseen. Asianajajaryhmät kehottivat Yhdysvaltain liittovaltion vaalikomissiota puuttumaan asiaan, mutta FEC kieltäytyi lopulta vetoamalla toimivaltuuksiensa rajoituksiin.

Samaan aikaan teleyhtiö, joka on vastuussa robocall-puhelun jakelusta, - suostui maksamaan $1 miljoonan sakon.

Poliittinen väärennösten käyttö Intian vuoden 2020 vaaleissa

Kaikki väärennösteknologian käyttö ei ole haitallista tai harhaanjohtavaa (tästä lisää myöhemmin blogissa).

Vuoden 2020 Delhin lakiasäätävän kokouksen vaalien aikana Delhi Bharatiya Janata Party käytti tekoälyä kampanjamainoksen räätälöintiin eri kielisille yleisöille.

Puolue otti videon johtajastaan Manoj Tiwarista, joka puhui englantia, ja käytti huulisynkronointia tuottaakseen version alueellisella murteella, haryanvilla.

Vaikka ääni tuli näyttelijältä, visuaalinen ilme muokattiin vastaamaan uutta ääntä käyttämällä tekoälyä, joka oli koulutettu Tiwarista otetun todellisen kuvamateriaalin perusteella.

Puolueen jäsenet pitivät sitä tekniikan myönteisenä sovelluksena, jonka avulla he pystyivät pitämään yhteyttä äänestäjiin kielellä, jota he ymmärsivät, vaikka ehdokas ei puhuisikaan sitä sujuvasti.

Kuinka todentaa Deepfakes reaalimaailmassa?

Deepfake-tekniikan levitessä politiikassa, viihdeteollisuudessa ja jokapäiväisessä viestinnässä on entistä tärkeämpää osata tunnistaa, mikä on aitoa.

Huolimatta kehittyneiden esimerkkien lisääntymisestä, on olemassa luotettavia työkaluja deepfake-tekniikan uhan torjumiseksi.

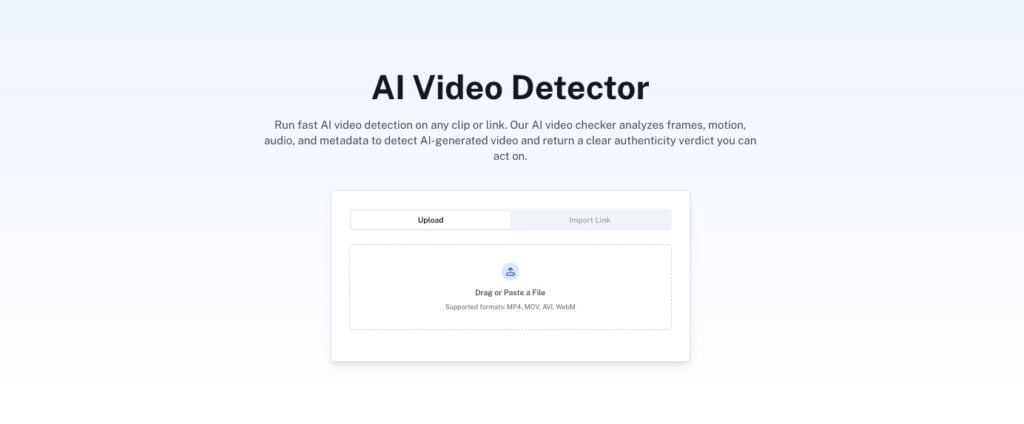

Havaitsematon tekoäly AI-videotunnistin on yksi tällainen työkalu, joka osoittaa, että on olemassa luotettavia työkaluja kehittyneiden deepfake-tekniikoiden torjumiseksi.

Siellä Undetectable AI:n Deepfake-tunnistus tulee sisään.

Sen tarkoituksena on tarkistaa, onko ääni- tai videosisältö on tuotettu keinotekoisesti, käyttäen kehittyneitä rikosteknisiä malleja, joissa analysoidaan ruutukohtaista liikettä, pikselitason johdonmukaisuutta ja äänten sormenjälkiä.

Käyttäjät näkevät muutamassa sekunnissa, onko videota muutettu digitaalisesti tai onko ääni kloonattu tekoälyllä.

Lataa tiedosto, ja työkalu antaa yksityiskohtaisen aitouden raportin, jossa on visuaalinen erittely ja luotettavuuspisteet.

Deepfake Detection auttaa toimittajia, kouluttajia ja tavallisia käyttäjiä paljastamaan totuuden näkemänsä ja kuulemansa takaa, olipa kyseessä sitten virusklippi, epäilyttävä haastattelu tai jaettu tallenne.

Ovatko Deepfakes vaarallisia? Riskit ja huolenaiheet

Tähän mennessä olemme tarkastelleet, mikä on deepfake, miten se tehdään ja missä sitä on jo näkynyt todellisuudessa.

Teknologia on kiistatta vaikuttavaa, mutta siihen liittyvät riskit ovat vakavia ja kasvavat nopeasti.

Syväväärennöksiä voidaan käyttää aseena monin eri tavoin. Seuraavassa on muutamia keskeisiä huolenaiheita.

Loukkaus

Kun jonkun henkilön hahmoa tai ääntä käytetään väärennettyjen huomautusten, lausuntojen tai videoiden luomiseen, erityisesti jos ne ovat loukkaavia tai kiistanalaisia, maine voi tuhoutua lähes välittömästi.

Toisin kuin vanhemmat huijaukset tai väärennetyt lainaukset, vakuuttava deepfake ei jätä katsojalle juurikaan tilaa epäilyille.

Tältä osin väärennökset voivat herättää närkästystä, tuhota ihmissuhteita tai yksinkertaisesti edistää vahingollista tarinaa.

Erityisen huolestuttavaa on se, että väärennöksen ei edes tarvitse olla täydellinen.

Kunhan henkilö on tunnistettavissa ja sisältö riittävän uskottava, se voi vaikuttaa pysyvästi yleiseen mielipiteeseen.

Tietojen uskottavuus

Toinen suuri huolenaihe on se, miten väärennökset heikentävät totuuden käsitettä.

Kun väärennökset yleistyvät, on yhä vaikeampi tietää, onko näkemämme tai kuulemamme todellinen. Ajan mittaan tämä voi johtaa siihen, että luottamus kaikenlaiseen digitaaliseen viestintään heikkenee.

Tämä uskottavuuskriisi on laajempi kuin yksittäiset tapaukset.

Demokraattisissa yhteiskunnissa ihmiset tukeutuvat jaettuihin tosiasioihin tehdessään päätöksiä, keskustellessaan asioista ja ratkaistessaan yhteisiä ongelmia.

Mutta jos äänestäjät, katsojat tai kansalaiset alkavat kyseenalaistaa kaiken, on paljon helpompaa manipuloida yleistä mielipidettä tai hylätä epämiellyttävät totuudet "vain yhtenä syvävalheena".

Kiristys

Tekoälyn luomaa mediaa voidaan käyttää yksilöiden vääränlaiseen syyllistämiseen saamalla heidät näyttämään siltä, että he ovat tehneet jotain laitonta, epäeettistä tai noloa.

Tällaisia valmistettuja todisteita voidaan sitten käyttää uhkailuun tai valvontaan.

Ja se on molempiin suuntiin. Koska väärennökset ovat nykyään niin realistisia, todellisen kiristyksen kohteeksi joutunut saattaa väittää todisteen olevan väärennös, vaikka se ei olisikaan.

Tätä kutsutaan joskus kiristysinflaatioksi, jossa uskottavien väärennösten suuri määrä alentaa todellisen raskauttavan materiaalin arvoa.

Todellisten todisteiden uskottavuus katoaa sumuun, ja se vain lisää monimutkaisuutta, kun yritetään paljastaa väärinkäytöksiä.

Petokset ja huijaukset

Huijaajat käyttävät tekoälyn luomia videoita tai luotettavien julkisuuden henkilöiden ääniä ja luovat uskomattoman vakuuttavia järjestelmiä.

Joissakin tapauksissa Elon Muskin, Tom Hanksin tai Oprah Winfreyn kaltaisten julkkisten deepfake-kuvauksia käytetään mainostamaan tuotteita tai palveluita, joista he eivät ole koskaan kuulleetkaan.

Nämä videot levitetään sitten sosiaalisille alustoille, joissa ne tavoittavat miljoonia ihmisiä.

Jopa yksityishenkilöt ovat vaarassa, erityisesti spearphishing-kampanjoissa, jotka kohdistuvat tiettyihin henkilöihin manipuloimalla tai harhauttamalla heitä henkilökohtaisella sisällöllä.

Erään Forbesin raportti 2024, deepfake-pohjaiset petokset ovat jo aiheuttaneet arviolta $12 miljardin euron tappiot maailmanlaajuisesti, ja tämän luvun odotetaan yli kolminkertaistuvan lähivuosina.

Siksi havaitseminen ei ole vain yksityishenkilöille. Se on välttämätöntä yrityksille, jotka käsittelevät arkaluonteisia tietoja, viestintää tai julkista sisältöä. TruthScan auttaa näitä organisaatioita tunnistamaan muutetut videot ennen kuin väärää tietoa leviää.

Deepfakesin myönteiset ja luovat käyttötavat

On syytä huomata, että kaikki teknologian sovellukset eivät ole negatiivisia.

Vaikka monissa blogeissa, joissa selitetään, mikä on deepfake, keskitytään väärinkäytöksiin, on yhä enemmän luovia ja tuottavia tapoja käyttää deepfakeja.

Yritysten kannalta jopa väärennösten taiteellinen tai markkinointikäyttö olisi kuitenkin tarkistettava niiden aitous ennen julkaisemista.

TruthScanin kaltaisilla työkaluilla voidaan varmistaa, ettei lopulliseen versioon jää tahattomia manipulaatioita.

Seuraavassa on joitakin merkittäviä esimerkkejä.

Elokuvat ja näytteleminen

Studiot alkavat luottaa deepfake-teknologiaan esimerkiksi seuraavissa asioissa:

- Visuaalisten vaikutusten parantaminen

- Tuotantokustannusten vähentäminen

- Palautetaan hahmoja, joita ei enää ole olemassa.

Disneyon esimerkiksi kehittänyt korkearesoluutioisia deepfake-malleja, jotka mahdollistavat näyttelijöiden kasvojen vaihtamisen ja ikääntymisen poistamisen vaikuttavan realistisesti.

Heidän tekniikkansa toimii 1024 x 1024:n resoluutiolla ja pystyy seuraamaan tarkasti kasvojen ilmeitä, jotta hahmot näyttäisivät nuoremmilta tai ilmeikkäämmiltä.

Hollywoodin lisäksi deepfakes on mahdollistanut maailmanlaajuisen kampanjatyön, kuten esimerkiksi kun David Beckham kloonattiin digitaalisesti välittää terveysviestiä useilla kielillä.

Taide

Vuonna 2018 multimediataiteilija Joseph Ayerle käytti deepfake-teknologiaa luodakseen tekoälynäyttelijän, joka sekoitti italialaisen elokuvatähti Ornella Mutin kasvot Kendall Jennerin vartaloon.

Tuloksena oli surrealistinen sukupolvi-identiteetin ja taiteellisen provokaation tutkimus, joka oli osa videoteosta Un'emozione per sempre 2.0.

Deepfakes on esiintynyt myös satiirissa ja parodiassa.

South Parkin luojien Trey Parkerin ja Matt Stonen vuonna 2020 tekemä verkkosarja Sassy Justice on tästä hyvä esimerkki.

Siinä käytettiin väärennettyjä julkisuuden henkilöitä pilkkaamaan ajankohtaisia tapahtumia ja samalla lisäämään tietoisuutta itse teknologiasta.

Asiakaspalvelu

Luovien alojen ulkopuolella yritykset ovat löytäneet deepfake-ominaisuuksista hyötyjä asiakaspalveluissa.

Jotkin puhelinpalvelukeskukset käyttävät nykyään synteettisiä ääniä, jotka perustuvat deepfake-teknologiaan, automatisoidakseen peruspyyntöjä, kuten tilitiedusteluja tai valitusten kirjaamista.

Näissä tapauksissa tarkoitus ei ole pahansuopa, vaan yksinkertaisesti tehostaa toimintaa.

Soittajavastausjärjestelmiä voidaan personoida käyttämällä tekoälyn tuottamia ääniä, jotta automaattiset palvelut kuulostavat luonnollisemmilta ja houkuttelevammilta.

Koska käsiteltävät tehtävät ovat yleensä vähäriskisiä ja toistuvia, deepfakes auttaa tässä yhteydessä vähentämään kustannuksia ja vapauttamaan henkilöstöä monimutkaisempiin tehtäviin.

Koulutus

Koulutusalustat ovat myös alkaneet sisällyttää deepfake-pohjaisia tutoreita auttaakseen oppijoita vuorovaikutteisemmin.

Nämä tekoälypohjaiset opettajat voivat antaa oppitunteja synteettisten äänten ja henkilökohtaisen ohjauksen avulla.

Deepfake-tunnistustyökalut ja -tekniikat

Koska väärennökset ovat yhä kehittyneempiä ja helpommin saatavilla, ne on tunnistettava ennen kuin ne aiheuttavat vahinkoa.

Ihmiset ja organisaatiot tarvitsevat myös oikeita työkaluja ja tekniikoita pysyäkseen askeleen edellä. Tässä on siis muutamia työkaluja ja tekniikoita.

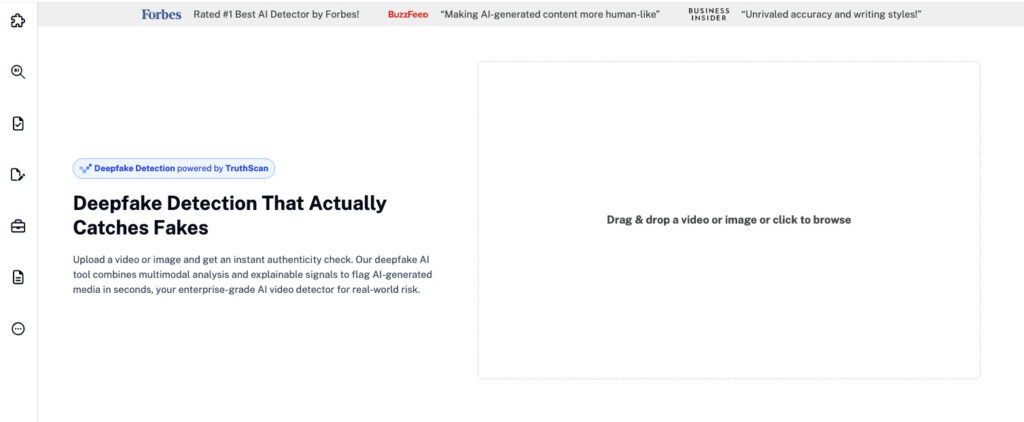

Kuvakeskitetty tarkistus, TruthScanin tekoälyn kuvantunnistin analysoi valaistusta, pikselikuvioita ja yhdistettyjä elementtejä, jotta tekoälyn luomat tai muokatut visuaaliset elementit voidaan merkitä reaaliaikaisesti.

Sen avulla tiimit voivat varmistaa kuvien ja videokuvien aitouden nopeasti ennen sisällön julkaisemista tai jakamista.

TruthScan: Deepfake-tunnistus

TruthScan on suunniteltu yrityksille, yliopistoille ja mediaorganisaatioille, jotka tarvitsevat laajamittaista visuaalisen ja audiosisällön todentamista.

Se analysoi videon aitoutta useilla eri ulottuvuuksilla:

- Kasvojen vaihdon tunnistus: Tunnistaa manipuloidut kasvonpiirteet kehys kerrallaan.

- Käyttäytymiseen liittyvät sormenjäljet: Havaitsee hienovaraiset ilme- ja mikroliikkeet, jotka eivät vastaa ihmisen luonnollista käyttäytymistä.

- Videotekniset tutkimukset: Tutkii kuvapakkausta, pikselikohinaa ja äänen peukalointia.

- Reaaliaikainen havaitseminen: Mahdollistaa live-tarkistuksen videopuheluiden, lehdistötiedotteiden tai lähetysvirtojen aikana.

TruthScanin avulla tiimit voivat todentaa videot ennen niiden julkaisemista tai julkista levittämistä, mikä estää maine- ja taloudelliset vahingot.

Undetectable AI:n työkalut tarjoavat jokapäiväisille käyttäjille samanlaista suojaa yksilötasolla.

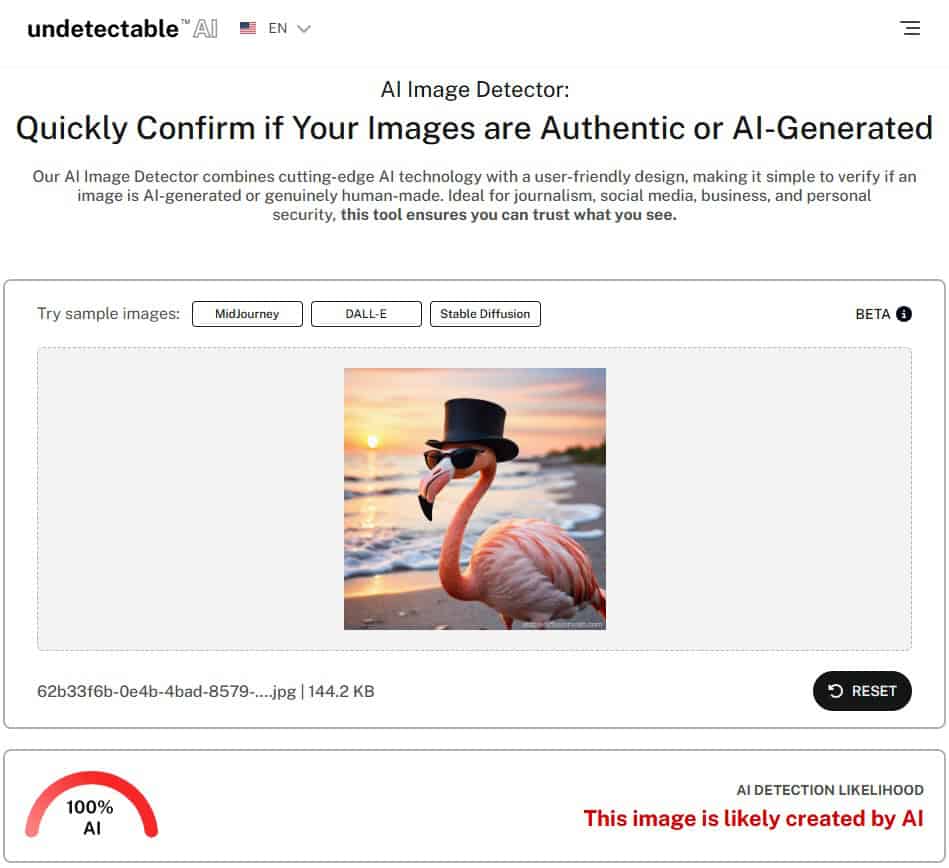

AI Image Detector by Undetectable AI

Undetectable AI:n AI Image Detector tekee väärennösten havaitsemisesta helpompaa myös niille, joilla ei ole teknistä taustaa.

Tunnistin toimii analysoimalla ladatun kuvan eri elementtejä, kuten värikuvioita, tekstuureja, kasvonpiirteitä ja rakenteellisia epäjohdonmukaisuuksia.

Se tukee tunnetuimpien tekoälykuvageneraattoreiden avulla luotujen medioiden tunnistusta, kuten

- Matkan puolivälissä

- DALL-E

- Vakaa diffuusio

- Ideogrammi

- GAN-pohjaiset mallit

Lataa kuva, anna työkalun analysoida se ja saat selkeän tuomion ja luottamuspisteet.

Jos olet epävarma siitä, onko löytämäsi kuva aito, kokeile meidän AI Image Detector tarkistamaan, ettei tekoälyä ole peukaloitu.

Laitetaan nyt Undetectable's AI Detector testiin ja katso, pystyykö se tunnistamaan tarkasti, että kuva on tekoälyn tuottama.

Kuten näet, Undetectable AI:n tekoälyilmaisin on merkinnyt tämän kuvan 100%:n tekoälyn tuottamaksi.

Visuaaliset ja käyttäytymistekniikat manuaalista havaitsemista varten

On myös käytännön tekniikoita, joita yksityishenkilöt voivat käyttää väärennösten havaitsemiseen manuaalisesti, erityisesti tilanteissa, joissa tarvitaan välitöntä analyysia.

Joitakin visuaalisia punaisia lippuja ovat:

- Kasvojen hankala asento tai oudot ilmeet.

- Epäjohdonmukainen valaistus tai väritys kuvan tai videon eri osissa.

- Välkkyminen kasvojen tai hiusrajan ympärillä, erityisesti liikkeen aikana.

- Luonnollisen räpyttelyn puute tai epäsäännöllinen silmien liike.

- Huulisynkronoinnissa on ristiriitaisuuksia, kun ääni ei vastaa puhetta.

Käyttäytymisen näkökulmasta katsottuna väärennösten on usein vaikea jäljitellä hienovaraisia inhimillisiä piirteitä. Kiinnitä huomiota kehonkieleen, tunneilmaisuihin ja tavanomaisiin eleisiin.

Pyydä reaaliaikaisissa keskusteluissa ja erityisesti suorissa videoissa sivuprofiilinäkymää.

Monilla deepfake-malleilla on edelleen vaikeuksia esittää tarkasti 90 asteen kasvokulmaa tai monimutkaisia liikkeitä, kuten pään kääntämistä, säilyttäen samalla luonnolliset ilmeet.

Deepfakesin havaitseminen tekstistä ja kontekstista

Syväväärennökset eivät rajoitu vain visuaalisiin tekijöihin. Joihinkin versioihin kuuluu synteettinen teksti, ääni tai käyttäytyminen, joka jäljittelee jonkun viestintätyyliä.

Kun analysoit tekstisisältöä tai vuoropuhelua, pidä silmällä:

- Kirjoitusvirheitä ja outoa kielioppia.

- Lauseet, jotka tuntuvat väkinäisiltä tai eivät suju luonnollisesti.

- Epätavalliset sähköpostiosoitteet tai epäjohdonmukainen muotoilu.

- Viestit, jotka tuntuvat asiayhteydestä irrotetuilta tai tilanteeseen liittymättömiltä.

Myös asiayhteydellä on merkitystä. Jos video tai viesti ilmestyy ympäristössä, jossa ei ole järkeä, kuten poliitikko, joka ilmoittaa rennosti tärkeästä päätöksestä heikkolaatuisessa klipissä, sen aitous kannattaa kyseenalaistaa.

Oletko utelias AI Detectorista ja Humanizerista? Kokeile niitä alla olevassa widgetissä!

Usein kysytyt kysymykset Deepfakesista

Ovatko väärennökset laittomia?

Syväväärennökset eivät oletusarvoisesti ole laittomia, mutta ne voivat olla laittomia, jos ne rikkovat voimassa olevia lakeja, kuten kunnianloukkausta, lapsipornoa tai ei-suostumuksellista, yksiselitteistä sisältöä koskevia lakeja.

Joissakin Yhdysvaltojen osavaltioissa on säädetty lakeja, jotka kohdistuvat vaaleihin vaikuttaviin tai kostopornoon liittyviin väärennöksiin.

Liittovaltion lakiehdotukset, kuten DEFIANCE Act ja NO FAKES Act on myös käynnissä deepfake-teknologian haitallisen käytön sääntelyä.

Voiko kukaan tehdä deepfakea?

Kyllä, melkein kuka tahansa voi tehdä deepfakea käyttämällä ilmaisia tai edullisia ohjelmistoja ja tekoälytyökaluja.

Monet alustat tarjoavat nykyään käyttäjäystävällisiä käyttöliittymiä, joten alkuun pääseminen ei vaadi kehittyneitä teknisiä taitoja.

Miten voin suojautua deepfakeilta?

Rajoita altistumista välttämällä korkearesoluutioisten kuvien tai videoiden julkaisemista verkossa. Käytä yksityisyysasetuksia ja tunnistustyökaluja, kuten Havaitsematon tekoäly tai TruthScan tarkistamaan kaikki epäilyttävät asiat.

Onko olemassa deepfake-tunnistussovelluksia?

TruthScan on suunniteltu yrityskäyttäjille, joiden on analysoitava videosisältöä laajassa mittakaavassa, kun taas Undetectable AI:n ilmaisimet palvelevat yksityishenkilöitä ja tekijöitä, jotka haluavat tarkistaa pienempiä määriä sisältöä.

Lopulliset ajatukset

Syväväärennökset muokkaavat tapaa, jolla näemme totuuden verkossa. Olipa kyse brändin suojaamisesta, julkisen viestinnän hallinnasta tai vain turvallisesta selaamisesta, oikeiden tunnistustyökalujen käyttö ratkaisee kaiken.

Yrityksille ja laitoksille, TruthScan tarjoaa yritystason suojan tekoälyn tuottamaa väärää tietoa vastaan.

Yksilöiden osalta havaitsematon tekoäly. AI Image Detector tarjoaa yksinkertaisen ja nopean tavan tarkistaa kuvia ja pysyä ajan tasalla.

Yhdessä ne auttavat varmistamaan, että näkemäsi ja jakamasi asiat pysyvät todellisina.