A deepfake kifejezés először 2017-ben bukkant fel a Redditen, amikor egy azonos felhasználónévvel rendelkező felhasználó olyan módosított videókat kezdett megosztani, amelyekben mesterséges intelligenciát használtak az arcok felcserélésére, kezdetben felnőtt tartalmakban.

Bár a Reddit betiltotta az eredeti subredditet, az ötlet máris beindult.

De ennek a technológiának a gyökerei még korábbra nyúlnak vissza.

1997-ben a kutatók már elkezdtek kísérletezni a videoszerkesztéssel a gépi tanulás segítségével.

A korai ajakszinkronizáló eszközük, az úgynevezett Videó átírása úgy tűnhet, hogy valaki olyasmit mondott, amit nem mondott.

Ez technikailag nem volt deepfake a mai szabványok szerint, de megalapozta azt, ami ezután következett.

A mai blog arról szól, hogyan működik ez a fejlődő technológia, hol jelenik meg a mindennapi életben, és milyen kockázatokkal és előnyökkel jár.

Kezdjük azzal, hogy megértjük, mi is valójában a deepfake.

A legfontosabb tudnivalók:

- A deepfakes olyan mesterséges intelligencia által generált média, amely olyan embereket tesz úgy, mintha olyasmit mondanának vagy tennének, amit valójában nem tettek meg.

- Ingyenes eszközökkel és alapvető készségekkel ma már szinte bárki képes meggyőző deepfake videókat, képeket vagy hangklipeket készíteni.

- Bár a deepfake-ek lehetnek kreatívak vagy szórakoztatóak, komoly kockázatokat is jelentenek, mint például csalások, rágalmazás és félretájékoztatás.

- A legtöbb deepfake-et felismerő eszközök használatával vagy a vizuális és viselkedésbeli ellentmondások pontos megfigyelésével lehet kiszúrni.

Mi az a Deepfake?

A deepfake egy hamis média, általában egy videó, hangklip vagy kép, amelyet mesterséges intelligencia segítségével módosítottak, hogy valaki úgy tűnjön vagy hangozzon, mintha olyasmit tenne vagy mondana, amit valójában nem is tett.

Ne tévessze ezt össze egy rossz Photoshop-munkával vagy egy vázlatos hangalámondással.

Magas szintű manipulációról beszélünk, amely a mélytanulás nevű technológiát használja, amely a mesterséges intelligencia egy alcsoportja.

Soha többé ne aggódj amiatt, hogy a mesterséges intelligencia felismeri a szövegeidet. Undetectable AI Segíthet:

- Tegye láthatóvá az AI-asszisztált írást ember-szerű.

- Bypass az összes főbb AI-érzékelő eszköz egyetlen kattintással.

- Használja a címet. AI biztonságosan és magabiztosan az iskolában és a munkahelyen.

Ezt jelenti a "deepfake" kifejezés: mélytanulás és hamisított tartalom.

A deepfake célja általában az, hogy valami olyat hozzon létre, ami elég valódinak tűnik ahhoz, hogy megtévessze az embereket.

Talán láttad már azokat a vírusvideókat, amelyeken hírességek bizarr dolgokat művelnek, vagy politikusok olyan felháborító kijelentéseket tesznek, amelyeket valójában soha nem mondanának ki.

Ezek klasszikus deepfake felhasználási esetek. Amit lát, az nem valódi, de a mögötte lévő technológia elég jó ahhoz, hogy az agya ne vegye észre azonnal a hamisítást, hacsak nem keresi nagyon.

Ez az, ahol az olyan eszközök, mint a TruthScan lépj be.

A TruthScan olyan szervezetek számára készült, amelyeknek a médiát méretarányosan kell ellenőrizniük - vállalatok, szerkesztőségek, egyetemek és közintézmények. Segít a csapatoknak kiszűrni a manipulációt, mielőtt a hamis tartalom károsítaná a bizalmat vagy a hírnevet.

Az Undetectable AI kutatócsoportja szerint, Az amerikaiak 85 %-je szerint az online információkba vetett bizalmuk a deepfakes miatt romlott meg.

Épp most tanultad meg, hogy mi is valójában a deepfake videó vagy média, most pedig azt, hogy hogyan készítik ezeket az emberek.

Hogyan készülnek a Deepfakes

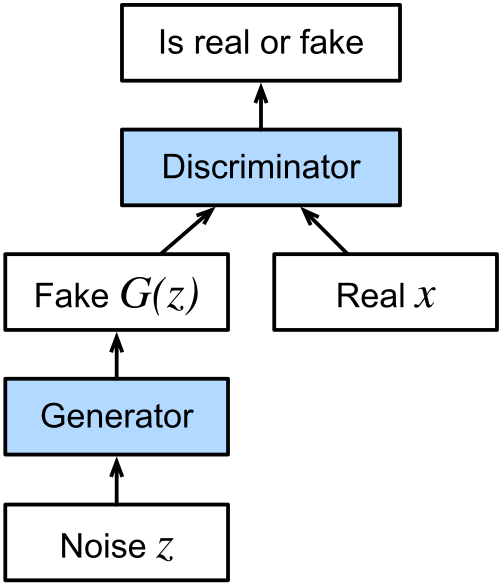

A legtöbb mélyhamisítás mögött álló technológia a gépi tanulási algoritmusok egy kategóriája, az úgynevezett generatív adverzális hálózatok, vagy GAN-ok.

A GAN-ok két részből állnak: egy generátorból és egy diszkriminátorból.

A generátor hamis médiát hoz létre az alapján, aminek a lemásolására betanították, a megkülönböztető feladata pedig az, hogy kiszűrje a hamisnak tűnő dolgokat.

Addig járnak oda-vissza, amíg a generátor egyre jobbá nem válik a hamis tartalom előállításában, amely átmegy a megkülönböztető tesztjén.

Idővel ez az oda-vissza játék olyan médiát eredményez, amely megdöbbentően valósághűnek tűnik.

Mi az a Deepfake videó generálási folyamat?

Egy deepfake videó elkészítésekor a rendszer több szögből készült videókat elemez, tanulmányozza, hogyan beszél a személy, hogyan mozog az arca, hogyan mozog a teste.

Az összes ilyen információ bekerül a generátorba, így az képes olyan tartalmat létrehozni, amely utánozza ezeket a viselkedéseket.

Ezután a diszkriminátor segít a finomhangolásban, rámutatva a hibákra, amíg a végeredmény megfelelő nem lesz.

Ezért tartja magát az illúzió olyan jól mozgásban.

A deepfake videó céljától függően többféle technikát használnak.

Ha a cél az, hogy úgy tűnjön, mintha valaki olyasmit mondana vagy tenne egy videóban, amit valójában nem mondott vagy tett meg, akkor egy úgynevezett forrásvideó deepfake-ről van szó.

A kódolóból és dekódolóból álló deepfake autoencoder tanulmányozza az eredeti felvételt, és a célszemély arckifejezéseit, gesztusait és finom fejmozdulatait alkalmazza rá.

Audio Deepfakes

Egy audio deepfake úgy működik, hogy valakinek a hangját klónozzák, szintén GAN-ok segítségével, a természetes beszédmódról készült felvételek alapján.

A betanítás után a modell képes új beszédet generálni az adott hangon, még akkor is, ha a személy valójában soha nem mondta ki ezeket a szavakat.

Egy másik, gyakran hozzáadott réteg a szájszinkronizálás.

Itt a rendszer generált vagy előre felvett hangot képez le egy videóra.

A cél az, hogy a videón látható ajkak megegyezzenek a hangban szereplő szavakkal.

A Deepfakes valós példái

Manapság mindenhol megjelennek a deepfake-ek.

Bemutatunk néhány népszerű deepfake-et, amelyek megmutatják, milyen messzire jutott a technológia.

Az ukrán csapatok megadására kérő Zelenszkij elnök deepfake-je

2022 márciusában, az orosz-ukrán háború kezdeti szakaszában felbukkant egy videó az interneten. Volodimir Zelenszkij ukrán elnök bemutatása megadásra szólította fel katonáit.

Úgy nézett ki, mint egy országos beszéd, Zelenszkij hangjával és modorával.

A videó a közösségi média platformokon terjedt el, és még egy kompromittált ukrán hírportálon is megjelent.

Az elnök gyorsan cselekedett, és hivatalos közleményt adott ki az ellenőrzött csatornáin keresztül, hogy megcáfolja a felvételeket.

A vírusos Deepfake kép Ferenc pápáról egy dizájner pufferdzsekiben

Néha egy deepfake képnek nem kell rosszindulatúnak lennie ahhoz, hogy zavart okozzon.

2023-ban egy vírusos fotó Ferenc pápa stílusos fehér Balenciaga pufferdzsekiben sétálgatott viharszerűen bejárta az internetet.

Több tízmilliós nézettséget ért el, és széles körben megosztották a különböző platformokon.

A képet a Midjourney nevű mesterséges intelligencia eszközzel készítette egy névtelen chicagói felhasználó.

Elon Musk Deepfakes használt online csalásokban

2024-ben, deepfakes featuring Elon Musk több nagyszabású online csalás központi részévé vált.

A Facebookon, a TikTokon és más platformokon mesterséges intelligenciával generált videók jelentek meg Muskról, amelyek hamis kriptopénz-ajándékokat és befektetési programokat népszerűsítettek.

Ezek a klipek rendkívül valóságosnak tűntek és hangzottak.

A kár nem csak elméleti volt. Egy idős nyugdíjas állítólag közel $700,000-et vesztett, miután meggyőzte őt az egyik ilyen videó.

A Joe Biden Deepfake robothívás, amely az amerikai szavazókat célozta meg

2024 elején, közvetlenül a New Hampshire-i előválasztás előtt, a szavazók kaptak robothívásokat ami pontosan úgy hangzott, mint Joe Biden amerikai elnöké.

A telefonhívásban Joe Biden arra buzdította a szavazókat, hogy maradjanak otthon, és tartsák meg szavazatukat a novemberi általános választásokra. A szándék az volt, hogy összezavarják és félrevezessék a szavazókat, hogy kihagyják az előválasztást.

Az incidens miatt szabályozásra szólítottak fel. Érdekvédelmi csoportok sürgették az Egyesült Államok Szövetségi Választási Bizottságát, hogy lépjen közbe, de az FEC végül elutasította ezt, hatáskörének korlátaira hivatkozva.

Eközben a telefonos hívások terjesztéséért felelős távközlési vállalat beleegyezett, hogy $1 millió bírságot fizet..

Politikai Deepfake használata a 2020-as indiai választásokon

A deepfake technológia nem minden felhasználása káros vagy megtévesztő szándékú (erről bővebben a blog későbbi részében).

A 2020-as delhi törvényhozó választások során a Delhi törvényhozó gyűlés A Bharatiya Janata Party a mesterséges intelligenciát használta egy kampányhirdetés testre szabásához a különböző nyelvi célközönség számára.

A párt vett egy videót, amelyen vezetője, Manoj Tiwari angolul beszél, és egy regionális dialektusban, a haryanvi nyelvjárásban készült változatot készített deepfake szájszinkronizálással.

Míg a szinkronhang egy színésztől származik, a képi megjelenítést Tiwari valódi felvételein képzett mesterséges intelligencia segítségével módosították, hogy illeszkedjen az új hanghoz.

A párttagok a technológia pozitív alkalmazását látták benne, amely lehetővé tette számukra, hogy olyan nyelven lépjenek kapcsolatba a választókkal, amelyet azok értenek, még akkor is, ha a jelölt nem beszéli folyékonyan a nyelvet.

Hogyan ellenőrizhetjük a Deepfakes-t a való világban?

A deepfake-ek terjedésével a politikában, a szórakoztatóiparban és a mindennapi kommunikációban soha nem volt még ennyire fontos tudni, hogyan lehet ellenőrizni, hogy mi a valóság.

A kifinomult példák elterjedése ellenére léteznek megbízható eszközök a deepfake technológia jelentette fenyegetés ellensúlyozására.

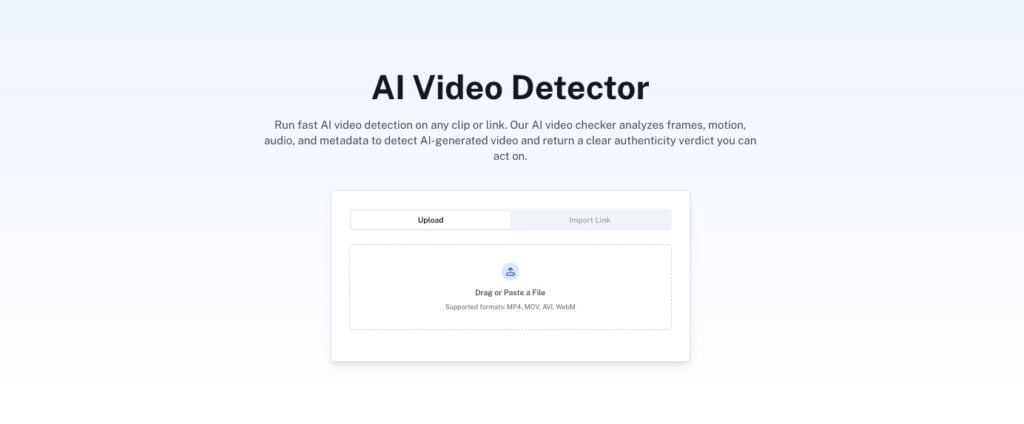

Kimutathatatlan mesterséges intelligencia AI videó detektor egy ilyen eszköz, amely bizonyítja, hogy léteznek megbízható eszközök a deepfake technológia kifinomult példáinak ellensúlyozására.

Ez az, ahol az Undetectable AI Deepfake észlelés jön be.

Célja annak ellenőrzése, hogy a hang- vagy videotartalom mesterségesen lett létrehozva, olyan fejlett törvényszéki modellek segítségével, amelyek képkockánként elemzik a mozgást, a pixel-szintű konzisztenciát és a hangi ujjlenyomatot.

A felhasználók másodpercek alatt láthatják, hogy egy videót digitálisan megváltoztattak-e - vagy ha egy hangot mesterséges intelligencia klónozott.

Csak töltse fel a fájlt, és az eszköz részletes hitelességi jelentést készít, vizuális bontással és bizalmi pontszámmal.

Legyen szó vírusklipről, gyanús interjúról vagy megosztott felvételről, a Deepfake Detection segít az újságíróknak, oktatóknak és a hétköznapi felhasználóknak felfedni a látottak és hallottak mögött rejlő igazságot.

Veszélyesek a Deepfakes? Kockázatok és aggályok

Eddig azt néztük meg, hogy mi az a deepfake, hogyan készül, és hol jelent meg már a való világban.

A technológia kétségtelenül lenyűgöző, de a hozzá kapcsolódó kockázatok komolyak és gyorsan növekednek.

A deepfakes többféleképpen is fegyverként használható. Íme néhány fő aggály.

Rágalmazás

Ha valakinek a képmását vagy hangját hamis megjegyzések, nyilatkozatok vagy videók készítésére használják fel, különösen ha azok sértőek vagy ellentmondásosak, az szinte azonnal tönkreteheti a hírnevet.

És a régebbi átverésekkel vagy hamis idézetekkel ellentétben egy meggyőző deepfake nem sok kétséget hagy a nézőben.

Ebben a tekintetben a deepfake-ek felháborodást kelthetnek, kapcsolatokat rombolhatnak le, vagy egyszerűen csak egy káros narratívát terjeszthetnek.

Ami különösen aggasztó, hogy a deepfake-nek nem is kell tökéletesnek lennie.

Amíg a személy felismerhető, és a tartalom elég hihető, addig maradandó hatást gyakorolhat a közvéleményre.

Az információ hitelessége

A másik fő aggodalomra ad okot, hogy a mélyhamisítások hogyan ássák alá az igazság fogalmát.

Ahogy a deepfakes egyre gyakoribbá válik, egyre nehezebb eldönteni, hogy amit látunk vagy hallunk, az valódi-e. Ez idővel a digitális kommunikáció bármely formájába vetett bizalom szélesebb körű csökkenéséhez vezethet.

A hitelesség válsága túlmutat az egyedi eseteken.

A demokratikus társadalmakban az emberek a közös tényekre támaszkodnak a döntéshozatalban, a vitákban és a kollektív problémák megoldásában.

De ha a választók, a nézők vagy a polgárok mindent megkérdőjeleznek, sokkal könnyebb lesz manipulálni a közvéleményt, vagy a kényelmetlen igazságokat "csak egy újabb mélységi hamisításként" elutasítani.

Zsarolás

A mesterséges intelligencia által generált média felhasználható arra, hogy hamisan gyanúba keverjen egyéneket, mert úgy állítja be, mintha valami illegális, etikátlan vagy kínos dolgot tettek volna.

Ez a fajta gyártott bizonyíték aztán felhasználható arra, hogy megfenyegessék vagy irányítsák őket.

És ez mindkét irányba hat. Mivel a deepfakes ma már annyira valósághűek, valaki, aki valódi zsarolással néz szembe, azt állíthatja, hogy a bizonyíték hamis, még akkor is, ha nem az.

Ezt néha zsarolási inflációnak nevezik, amikor a hihető hamisítványok puszta mennyisége csökkenti a tényleges terhelő anyagok értékét.

A valódi bizonyítékok hitelessége elveszik a ködben, és ez csak még egy újabb réteggel bonyolítja a helyzetet, amikor megpróbáljuk leleplezni a visszaéléseket.

Csalások és átverések

A csalók mesterséges intelligencia által generált videókat vagy megbízható közszereplők hangját használva hihetetlenül meggyőző módszereket dolgoznak ki.

Egyes esetekben olyan hírességek, mint Elon Musk, Tom Hanks vagy Oprah Winfrey deepfake-eit használják arra, hogy olyan termékeket vagy szolgáltatásokat támogassanak, amelyekről soha nem is hallottak.

Ezeket a videókat aztán a közösségi platformokon terjesztik, ahol milliókhoz jutnak el.

Még a magánszemélyek is veszélyben vannak, különösen a spearphishing kampányok esetében, amelyek konkrét személyeket céloznak meg személyre szabott tartalommal, amelyet manipulációra vagy megtévesztésre terveztek.

Egy 2024 jelentés a Forbes által, a deepfake által vezérelt csalások már eddig is $12 milliárdra becsült globális veszteséget okoztak, és ez a szám a következő néhány évben várhatóan több mint háromszorosára nő.

Ezért az észlelés nem csak magánszemélyek számára készült. Elengedhetetlen az érzékeny adatokat, kommunikációt vagy nyilvános tartalmakat kezelő vállalatok számára. A TruthScan segít ezeknek a szervezeteknek azonosítani a módosított videókat, mielőtt a félretájékoztatás elterjedne.

A Deepfakes pozitív és kreatív felhasználása

Érdemes megjegyezni, hogy a technológia nem minden alkalmazása negatív.

Míg sok blog, amely elmagyarázza, hogy mi a deepfake, a visszaélésekre összpontosít, egyre több kreatív és produktív módja van a deepfake-ek használatának.

Mégis, a vállalkozások számára még a mélyhamisítványok művészi vagy marketing célú felhasználását is ellenőrizni kell a hitelesség szempontjából a közzététel előtt.

Az olyan eszközök, mint a TruthScan, megerősíthetik, hogy a végleges változatban nem maradtak nem szándékos manipulációk.

Az alábbiakban néhány figyelemre méltó példa.

Film és színészi előadások

A stúdiók kezdenek a deepfake technológiára támaszkodni olyan dolgokban, mint például:

- Vizuális hatások javítása

- A termelési költségek csökkentése

- A már nem létező karakterek visszahozatala

Disneypéldául olyan nagy felbontású deepfake modelleket fejlesztett ki, amelyek lehetővé teszik az arcok cseréjét és a színészek lenyűgöző realizmussal történő öregedését.

Technológiájuk 1024 x 1024-es felbontással működik, és képes pontosan követni az arckifejezéseket, hogy a karakterek fiatalabbnak vagy kifejezőbbnek tűnjenek.

Hollywoodon kívül a deepfakes lehetővé tette a globális kampánymunkát, például amikor David Beckhamet digitálisan klónozták egészségügyi üzenetet közvetíteni több nyelven.

Art

2018-ban Joseph Ayerle multimédiaművész a deepfake technológiát használta arra, hogy létrehozzon egy mesterséges intelligenciával rendelkező színészt, aki az olasz filmsztár, Ornella Muti arcát Kendall Jenner testével keverte.

Az eredmény a generációs identitás és a művészi provokáció szürreális feltárása lett, az Un'emozione per sempre 2.0 című videóművészeti alkotás részeként.

A deepfakes a szatírában és a paródiában is megjelentek.

A South Park alkotói, Trey Parker és Matt Stone által készített Sassy Justice című 2020-as websorozat erre kiváló példa.

A filmben mélyen hamisított közszereplőket használtak fel arra, hogy az aktuális eseményeken viccelődjenek, miközben felhívták a figyelmet magára a technológiára.

Ügyfélszolgálat

A kreatív iparágakon kívül a vállalkozások a mélyhamisítások hasznosságát az ügyfelekkel kapcsolatos szolgáltatásokban is megtalálják.

Egyes call centerek ma már a deepfake technológiával működő szintetikus hangokat használnak az alapvető kérések, például a számlakérések vagy a panaszbejelentések automatizálására.

Ezekben az esetekben a szándék nem rosszindulatú, hanem egyszerűen csak racionalizálás.

A hívásfogadó rendszerek személyre szabhatók mesterséges intelligencia által generált hangok segítségével, hogy az automatizált szolgáltatások természetesebbnek és vonzóbbnak tűnjenek.

Mivel a kezelt feladatok általában alacsony kockázatúak és ismétlődőek, a deepfakes ebben a kontextusban segít csökkenteni a költségeket, és felszabadítja az emberi ügynököket az összetettebb problémákra.

Oktatás

Az oktatási platformok is elkezdték beépíteni a deepfake-alapú oktatókat, hogy interaktívabb módon segítsék a tanulókat.

Ezek a mesterséges intelligencia által vezérelt oktatók szintetikus hangok és személyre szabott útmutatás segítségével tarthatnak leckéket.

Deepfake detektálási eszközök és technikák

Ahogy a deepfakes egyre fejlettebbé és hozzáférhetőbbé válik, úgy válik szükségessé a felismerésük, mielőtt még kárt okoznának.

Az embereknek és a szervezeteknek is szükségük van a megfelelő eszközökre és technikákra, hogy egy lépéssel előrébb maradjanak. Íme tehát néhány eszköz és technika.

Képfókuszú ellenőrzéshez, A TruthScan AI képdetektora elemzi a megvilágítást, a pixelmintákat és a kompozitált elemeket, hogy valós időben jelezze az AI által generált vagy szerkesztett vizuális elemeket.

Segítségével a csapatok gyorsan megerősíthetik a képek és videók hitelességét, mielőtt a tartalmat közzéteszik vagy megosztják.

TruthScan: Vállalati szintű Deepfake-érzékelés

TruthScan olyan vállalkozások, egyetemek és médiaszervezetek számára készült, amelyeknek nagyszabású vizuális és audió tartalmak ellenőrzésére van szükségük.

Több dimenzióban elemzi a videó hitelességét:

- Arccsere-érzékelés: Képkockánként azonosítja a manipulált arcvonásokat.

- Viselkedési ujjlenyomatok: A természetes emberi viselkedéssel összeegyeztethetetlen finom kifejezésmintákat és mikro-mozdulatokat észleli.

- Videó törvényszéki vizsgálat: Vizsgálja a képkocka tömörítést, a pixelzajt és a hanghamisítást.

- Valós idejű észlelés: Lehetővé teszi az élő ellenőrzést videohívások, sajtóközlemények vagy közvetítések során.

A TruthScan segítségével a csapatok hitelesíthetik a videókat a közzététel vagy nyilvános terjesztés előtt, megelőzve a hírnév és a pénzügyi károkat.

A mindennapi felhasználók számára az Undetectable AI eszközei egyéni szinten is hasonló védelmet nyújtanak.

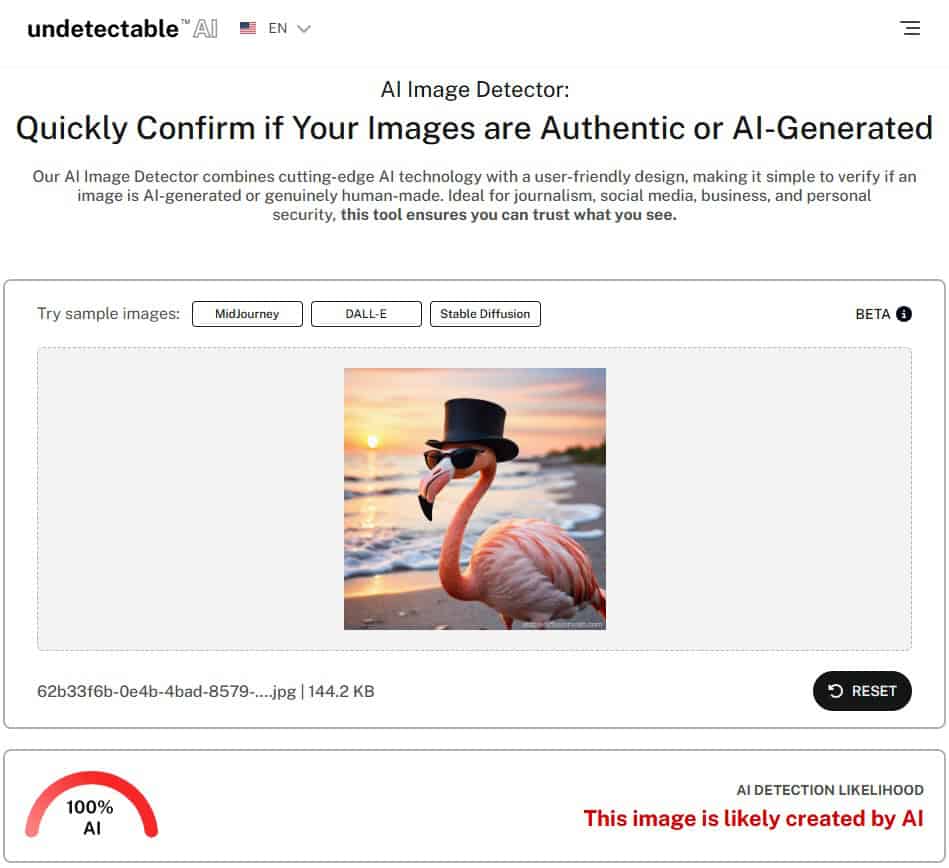

AI Image Detector által Undetectable AI

Az Undetectable AI AI Image Detector megkönnyíti a deepfake felismerését, még a technikai háttérrel nem rendelkezők számára is.

A detektor a feltöltött kép különböző elemeinek, például színmintáknak, textúráknak, arcvonásoknak és strukturális ellentmondásoknak az elemzésével működik.

Támogatja a legismertebb AI képgenerátorok segítségével létrehozott médiák felismerését, mint például

- MidJourney

- DALL-E

- Stabil diffúzió

- Ideogram

- GAN-alapú modellek

Használatához egyszerűen töltsön fel egy képet, hagyja, hogy az eszköz elemezze azt, és kap egy egyértelmű ítéletet egy bizalmi pontszámmal.

Ha nem vagy biztos benne, hogy egy kép, amivel találkoztál, valódi, próbáld meg a AI képérzékelő hogy ellenőrizze, nincs-e jele a mesterséges intelligencia manipulációjának.

Most pedig tegyük Az Undetectable AI Detector a teszthez, és megnézzük, hogy pontosan meg tudja-e állapítani, hogy a kép mesterséges intelligencia által generált.

Amint láthatja, az Undetectable AI által készített AI-érzékelő a képet 100% AI-generáltnak jelölte meg.

Vizuális és viselkedési technikák a kézi felderítéshez

Vannak olyan gyakorlati technikák is, amelyekkel az egyének manuálisan is felismerhetik a mély hamisítványokat, különösen olyan helyzetekben, amikor azonnali elemzésre van szükség.

Néhány vizuális piros zászló:

- Kínos arcpozíció vagy furcsa arckifejezések.

- A kép vagy a videó különböző részein a megvilágítás vagy a színezés nem következetes.

- Az arc vagy a hajvonal körül, különösen mozgás közbeni villódzás.

- A természetes pislogás hiánya vagy szabálytalan szemmozgás.

- Eltérések a szájszinkronizálásban, amikor a hang nem egyezik a beszéddel.

Viselkedés szempontjából a mélyhamisítók gyakran küzdenek azzal, hogy finom emberi tulajdonságokat utánozzanak. Figyeljen a testbeszédre, az érzelmi megnyilvánulásokra és a megszokott gesztusokra.

A valós idejű beszélgetésekben, különösen az élő videókban pedig kérjen oldalnézetből.

Sok deepfake modell még mindig nehezen tudja pontosan visszaadni a 90 fokos arcszöget vagy az olyan összetett mozdulatokat, mint a fej elfordítása, a természetes arckifejezés fenntartása mellett.

Deepfakes kiszűrése szövegben és kontextusban

A mélyhamisítások nem korlátozódnak a vizuális elemekre. Egyes változatok szintetikus szöveget, hangot vagy viselkedést tartalmaznak, amelyek valakinek a kommunikációs stílusát utánozzák.

A szöveges tartalom vagy párbeszéd elemzésekor tartsa nyitva a szemét:

- Helyesírási hibák és furcsa nyelvtan.

- Erőltetettnek tűnő vagy nem természetesen áramló mondatok.

- Szokatlan e-mail címek vagy következetlen megfogalmazás.

- A kontextusból kiragadottnak vagy a helyzethez nem kapcsolódónak tűnő üzenetek.

A kontextus is számít. Ha egy videó vagy üzenet olyan környezetben jelenik meg, amelynek nincs értelme, például ha egy politikus egy rossz minőségű klipben lazán bejelent egy fontos döntést, érdemes megkérdőjelezni a hitelességét.

Kíváncsi az AI Detector és Humanizer rendszerünkre? Próbálja ki őket az alábbi widgetben!

GYIK a Deepfakes-ről

A deepfakes illegális?

A mélyhamisítások alapesetben nem illegálisak, de azok lehetnek, ha megsértik a hatályos törvényeket, például a rágalmazásra, a gyermekpornográfiára vagy a nem konszenzusos explicit tartalomra vonatkozó törvényeket.

Néhány amerikai állam törvényt fogadott el a választásokat befolyásoló vagy bosszúpornót tartalmazó deepfake-ek ellen.

Az olyan szövetségi törvényjavaslatok, mint a DEFIANCE Act és a NO FAKES törvény folyamatban van a deepfake technológia rosszindulatú felhasználásának szabályozása is.

Tud valaki deepfake-et készíteni?

Igen, szinte bárki készíthet deepfake-et ingyenes vagy olcsó szoftverek és mesterséges intelligencia eszközök segítségével.

Számos platform ma már felhasználóbarát felületet kínál, így a kezdéshez nincs szükség fejlett technikai ismeretekre.

Hogyan védekezhetek a deepfakes ellen?

Korlátozza a kitettséget azzal, hogy nem tesz közzé nagy felbontású képeket vagy videókat az interneten. Használja az adatvédelmi beállításokat és az olyan észlelő eszközöket, mint Kimutathatatlan AI vagy TruthScan hogy kétszer is ellenőrizzék a gyanús dolgokat.

Vannak deepfake-felismerő alkalmazások?

Igen, a TruthScan olyan üzleti felhasználók számára készült, akiknek videótartalmakat kell nagy léptékben elemezniük, míg az Undetectable AI detektorai olyan magánszemélyeket és alkotókat szolgálnak, akik kisebb mennyiségű tartalmat szeretnének ellenőrizni.

Végső gondolatok

A mélyhamisítások átformálják az online igazság megítélését. Akár a márkáját védi, akár a nyilvános kommunikációt kezeli, akár csak biztonságosan böngészik, a megfelelő felismerő eszközök használata mindent megváltoztat.

Vállalkozások és intézmények számára, TruthScan vállalati szintű védelmet nyújt a mesterséges intelligencia által vezérelt félretájékoztatás ellen.

Egyének esetében a nem kimutatható mesterséges intelligencia AI képérzékelő egyszerű és gyors módot kínál a képek ellenőrzésére és a tájékoztatásra.

Együttesen segítenek biztosítani, hogy amit lát és megoszt, az valós maradjon.