である。 右のAIプロンプト基本的に何でもできる。それくらい、AIツールはすでにパワフルなのだ。

AIツールはビジネスのやり方を変え、かつてないほどプロセスを合理化し、効率を高めることを可能にした。

AIが真に得意とする分野のひとつに、コンテンツ作成がある。私たちが話しているのは、アウトラインの下書きやソーシャルメディアの投稿の作成だけではない。

AIはあなたを助けることもできる。 本を書く そして 複雑な研究論文を完成させる.

しかし、大きな力には大きな責任が伴うものであり、AIが常に正しいことをするとは限らない。

時々、AIは "幻覚 "と呼ばれるものを作り出す。これは、ユーザーを惑わす不正確な、あるいは奇妙な出力である。

半数近くの組織が次のように報告している。 AIイニシアチブを危うくするデータ品質の課題.

銀の弾丸ではないが、「グラウンディング」はAIのアウトプットが信頼できる情報に基づいていることを保証することを目的としている。

複雑に聞こえるかもしれないが、「AIにおけるグラウンディングと幻覚とは何か」という問いに対する答えは、これらの強力なツールを使う人にとって極めて重要である。

AIの幻覚について詳しく説明しよう。そうすることで、情報を正確に保ちながら、自信を持ってAIを活用したアウトプットを最大化することができる。

要点

- AIの幻覚は、データギャップやオーバーフィッティングによってモデルが誤った情報を生成したり、誤解を招いたりすることで起こる。

- グラウンディングは、AIの出力を検証された実世界のデータに固定し、幻覚を減らして信頼性を向上させる。

- コンテンツ制作における幻覚は、信頼性を損ない、誤った情報を広め、法的問題を引き起こす可能性がある。

- 信頼できるツールを使用し、コンテンツを検証し、明確で詳細なプロンプトを提供することで、問題を未然に防ぐ。

- Undetectable AI」のように、AIによる検知と人間による監視を組み合わせることで、正確性と信憑性を確保している。

AIにおけるグラウンディングと幻覚とは何か?

AIにおける幻覚とは何かを理解する上で、それがどのように発生するかを知ることは、可能な限り正確な情報を必要とする組織にとって特に有益である。

グラウンディングと人工知能の幻覚について学ぶことで、AIツールがどのように機能するのかをよりよく理解することができる。 AIが生成したコンテンツ 信用できる。

AIにおける幻覚とは何か?

AIチャットボットにある人物の情報を求めたとしよう。

もうAIがあなたのテキストを検出する心配はありません。 Undetectable AI あなたを助けることができる:

- AIがアシストする文章を出現させる 人間らしい。

- バイパス ワンクリックですべての主要なAI検出ツール。

- 用途 AI 無事に そして 堂々 学校でも仕事でも。

このモデルは、さまざまなオンライン情報源で頻繁に言及されている詳細を正確に提供している。

しかし、提供された情報を照合するうちに、AIが年齢や学歴といったあまり知られていない情報も誤って推測していることに気づく。

こうした間違った詳細は、いわゆる "幻覚 "である。

幻覚率 はモデルによって異なります。ChatGPTは以前 3%一方、グーグルのシステムは以下のように見積もられている。 27%.

これらのチャットボットは、大量のテキストを分析して学習する大規模な言語モデルによって駆動される。

このようなことが起こるのは、これらのモデルが、何が真実かそうでないかを理解することなく、分析したデータのパターンに基づいて単語を予測するように訓練されているからだ。

幻覚の多くは、不完全なトレーニングデータから生じる。

モデルは、入力されたものによってエラーを拾ったり再現したりすることを忘れないでほしい。

モデルがデータの誤ったパターンやつながりを識別してしまう「オーバーフィット」もある。

AIの幻覚を解決するのは困難である。なぜなら、確率とパターンに基づいて動作するこれらのモデルは、不可避的に誤った結果を生み出すからである。

これは、AIのコンテンツをそのまま信用するかもしれないユーザーを惑わす可能性がある。だからこそ、AIをコンテンツ制作やファクトチェックに利用する際には、この限界を認識しておくことが重要なのだ。

グラウンディングAIとは何か?

AIのグラウンディングは、幻覚を減らすための効果的な方法だ。これは、AIの反応を現実世界のデータに固定することで機能する。

例えば、根拠のあるシステムは、最初から信頼できるデータベースを使用して事実に基づいた回答を提供し、AIがでっち上げる可能性を減らすだろう。

パターンに基づいて次の単語を予測することだけに頼るのではなく、地に足のついたシステムは、まず信頼できる情報源から情報を検索する。

このモデルは、文脈が不十分であることを認めているため、必要な情報をすべて提供することはできない。

不正確さを最小限に抑えながらAIの価値を最大化するために、組織は正確なトレーニングデータ、ガイドライン、その他の必要な背景情報を収集するために、前もって時間を投資すべきである。

この準備によって、AIの出力が現実に即したものとなり、ユーザーから信頼されるようになる。

つまり、グラウンドの確保は確実な解決策ではないが、AIの出力の質を大幅に向上させることができるのだ。

コンテンツ制作におけるAIの幻覚問題とは何か?

コンテンツ制作において、AIの幻覚はさまざまな形で現れる。

ブログ記事や記事を作成する際、AIは虚偽の事実や間違った統計、でっち上げの引用を含むかもしれない。

AIの幻覚も意図的な欺瞞ではない。モデルには欺く動機がないし、言っていることが嘘だという自覚もないのだから、嘘をつくことはできない。

ただ、その結果がどの程度信頼できるものなのかという感覚に欠けているのだ。

コンテンツ制作におけるAIの幻覚がもたらす結果は深刻だ。

- 誤った情報の拡散: 5人に1人以上 フェイクニュースを確認せずにシェアした可能性は認める。

- 信頼性へのダメージ:個人や企業が誤解を招くような情報を掲載すると、その企業の評判が落ちる可能性がある。ユーザーにとって信用は非常に重要であり、一度失った信用を再び取り戻すのは難しい。

- 法的・経済的影響:虚偽の情報を公表することは、頭痛の種になる可能性があり、訴訟にまで発展する。それは、あなたが遭遇したくない高価な戦いである。

- 経営判断への悪影響:意思決定のためのレポートや洞察の作成をAIに依存している企業は、誤ったデータに基づいて誤った選択をする可能性がある。誤った情報は、視聴者と、コンテンツ作成にAIを使用している企業や個人の両方に害をもたらす。また、AIの幻覚は、信頼できるように見えて実は欠陥のあるコンテンツを生成することで、この問題を実際に悪化させる可能性がある。

AIの幻覚が引き起こす問題を防ぐには

私たちは、コンテンツ制作においてAIツールがいかに貴重であるかを知っている。AIを活用することは、コンテンツ制作の お金を稼ぐ最高の方法 今日、そして業界で競争力を維持するために。

AIを使ったコンテンツが正確であることを保証するためには、AIの幻覚問題に取り組むことが極めて重要な理由でもある。

AIの限界を理解する

AIがいかに強力であるかはすでに分かっているが、それには限界がある。

コンテンツ作成に関しては、パターン認識や膨大なデータセットに基づくテキスト生成は非常にうまくいくが、現実感がまだ欠けている。

AIを使用する際には、これらの制限を念頭に置いておこう:

- 文脈を把握したり、微妙な文化の違いを理解したりするのに苦労する。

- 入手可能な情報の質と量に大きく依存する

- トレーニングデータに基づいてバイアスを作り出す傾向がある。

- 人間らしい創造性や独創性に欠ける

- 道徳的に問題のあるコンテンツを生み出す可能性がある

- システムが知っていること以外の問題を解決するのが苦手である。

- 状況の変化への適応やリアルタイムのインプットが難しい。

- 攻撃を受けやすく、データのプライバシーを侵害する可能性がある。

限界を知ることで、AIの幻覚も防ぐことができる。境界線は、現実的な期待を設定し、不正確さが公になる前に発見することを容易にする。

信頼できるモデルとツールを使う

について コンテンツ制作に最適なAIツール 物事を簡単にする。これらのツールは完璧ではないが、あなたが使うものは間違いなく仕事をこなしてくれるはずだ。

AIチャットボットにとって、ChatGPTはまだ重要である。 最強だ.GPT-4は97%という高い精度を誇り、ChatGPT幻覚の発生率は最も低い。

ただ、明確なプロンプトを与え、信頼できる情報源と照らし合わせて結果をチェックするようにしよう。

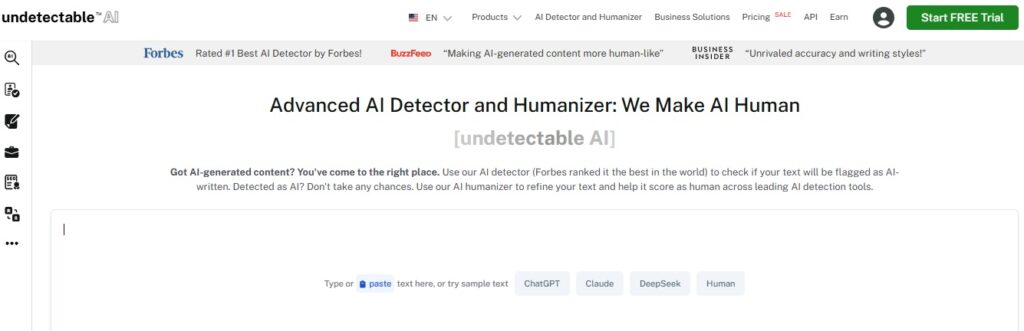

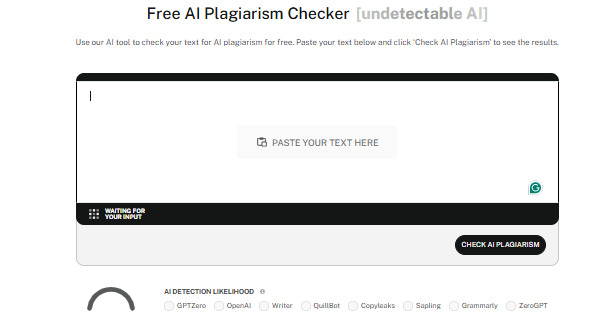

また、次のような信頼できるAI検出ツールを使うべきである。 検出不可能なAI.

ディテクターは、コンテンツを効果的に分析し、最も微妙なAI要素も検出するため、制作するコンテンツの信憑性を維持し、信頼性を保つことができる。

検出不能はまた、次のような特徴を持つ。 AIヒューマナイザー これは、テキストを自然に聞こえるようにさらに洗練させるものだ。

これを使えば、AI検出に合格するだけでなく、コンテンツの品質も保証される。

コンテンツを検証する

コンテンツ制作のプロセスでAIをどのように活用するにしても、制作したコンテンツを検証することは常に重要だ。

これらは、AIのコンテンツを検証するための一般的な方法である:

- 信頼できる複数の情報源の情報を比較し、相互検証する。

- ファクトチェックツールを使って、誤報の論破を効率化する

- その分野の専門家や専門家に洞察を求める。

- 潜在的な誤り、偏見、不正確さを特定するために、同僚や同僚にコンテンツをレビューしてもらう。

- AI検出ソフトウェアを使用して、オリジナリティを確保し、回避する。 意図しない盗作

- 出来事やデータを参照する際には、正確さを期すために歴史的背景を考慮する。

予防策を講じることは報われる。AIのコンテンツを検証することで、あなたが生み出すものが常に信頼に足るものであるという、必要不可欠な自信を得ることができる。

明確な指示を出す

AIの幻覚の主な原因のひとつは、指示が不明瞭であることだ。

もしAIに漠然とした質問をし、追加的な文脈がなければ、あまり意味のない答えが返ってくる可能性が高くなる。

明確で具体的なプロンプトが、AIを軌道に乗せる。

だから、プロンプトは具体的かつ詳細に書くこと。

"アジアで一番おいしいレストランは?"といった大雑把な質問ではなく、"京都で一番評価の高いラーメン屋は?"といった焦点を絞った質問をしてみよう。

具体性を持たせることで、AIは軌道を維持し、期待に応える正確な結果を出すことができる。

最新情報

テクノロジーは日進月歩であり、そのスピードも速い。

AIは基本的に訓練されたデータから学習するが、情報はすぐに古くなってしまう。

これは、科学研究やヘルスケアのような動きの速い分野では特に当てはまる。

ソーシャルメディアで信頼できる情報源をフォローすることで情報を得ることもできるし、自分の業界に関連するコースを受講したり、業界のイベントに参加したりすることもできる。

こうすることで、AIが提供するコンテンツが信頼に足るものであることを洞察することができる。

AIツール自体も頻繁に更新されるため、常に最新の動向を把握し、常に最適なものを使用できるようにしよう。

人間の専門知識

人間とAI コンテンツ制作において、品質、正確性、信憑性を確保するために協力しなければならない。

結局のところ、クリティカルシンキング、創造性、倫理的判断をもたらすのは、最終的には私たちなのだ。

AIの能力と人間の監視を組み合わせることで、コンテンツが正確であるだけでなく、文脈に即していること、さらに魅力的で適切な音程であることを検証できる。

人間の専門家はバイアスを見抜き、情報をダブルチェックし、AIだけでは把握できないような判断を下すことができる。

人間とAIが一緒になれば、信頼性が高く、洞察力に富み、インパクトのあるコンテンツを作ることができる。

下のウィジェットでAIディテクターとヒューマナイザーをご覧ください!

結論

AIにおけるグラウンディングと幻覚とは何かを理解することは、AIツールを仕事に使う人にとって不可欠である。

グラウンディングはAIをより正確にし、実際に検証されたデータを使用することでコンテンツの完全性を維持する。

AIの幻覚を認識することは、それを避ける正しい方法を知り、潜在的な落とし穴から逃れることにもつながる。

AIのコンテンツを正確に保つことは、プロセスの一面に過ぎない。Undetectable AIを使用することで、コンテンツが本物で高品質であることを保証しよう。

このツールは、AI検出器とヒューマナイザーの両方の役割を果たし、AIが生成したコンテンツが人間の文章とシームレスに調和し、検出をパスできることを確認する。

お客様のニーズに最適なAIコンテンツ検証オプションをお選びください。 検出不可能なAI 一貫して、信頼性が高く、オリジナルで、人間味のあるコンテンツを提供しましょう。今すぐご利用ください。