Begrepet deepfake dukket først opp på Reddit i 2017da en bruker med samme skjermnavn begynte å dele endrede videoer som brukte kunstig intelligens til å bytte ansikter, i første omgang i voksent innhold.

Selv om Reddit forbød den opprinnelige subredditen, hadde ideen allerede tatt av.

Men røttene til denne teknologien går enda lenger tilbake.

Allerede i 1997 begynte forskere å eksperimentere med videoredigering ved hjelp av maskinlæring.

Deres tidlige leppesynkroniseringsverktøy, kalt Omskriving av video kan få noen til å se ut som om de har sagt noe de ikke har sagt.

Teknisk sett var det ikke en deepfake etter dagens standarder, men det la grunnlaget for det som skulle komme.

Dagens blogg handler om hvordan denne teknologien fungerer, hvor den dukker opp i hverdagen, og hvilke risikoer og fordeler den fører med seg.

La oss begynne med å forstå hva en deepfake egentlig er.

De viktigste erfaringene:

- Deepfakes er AI-genererte medier som får det til å se ut som om folk sier eller gjør ting de i virkeligheten aldri har gjort.

- Med gratis verktøy og grunnleggende ferdigheter kan nesten hvem som helst nå lage overbevisende deepfake-videoer, -bilder eller -lydklipp.

- Selv om deepfakes kan være kreative eller underholdende, utgjør de også en alvorlig risiko i form av svindel, ærekrenkelse og feilinformasjon.

- Du kan oppdage de fleste deepfakes ved å bruke deteksjonsverktøy eller se nøye etter visuelle og atferdsmessige uoverensstemmelser.

Hva er en Deepfake?

En deepfake er falske medier, vanligvis en video, et lydklipp eller et bilde, som har blitt endret ved hjelp av kunstig intelligens for å få noen til å se ut eller høres ut som om de gjør eller sier noe de aldri har gjort i virkeligheten.

Ikke tro at dette bare er en dårlig Photoshop-jobb eller en dårlig voiceover.

Vi snakker om manipulering på høyt nivå ved hjelp av en teknologi som kalles dyp læring, som er en undergruppe av AI.

Aldri bekymre deg for at AI oppdager tekstene dine igjen. Undetectable AI Kan hjelpe deg:

- Få AI-assistert skriving til å vises ...menneskelignende.

- Bypass alle de viktigste AI-deteksjonsverktøyene med bare ett klikk.

- Bruk AI trygt og selvsikkert i skole og arbeid.

Det er det begrepet "deepfake" innebærer: dyp læring og falskt innhold.

Målet med en deepfake er vanligvis å skape noe som ser ekte nok ut til å lure folk.

Kanskje har du sett de virale videoene av kjendiser som gjør bisarre ting, eller politikere som kommer med opprørende uttalelser de egentlig aldri ville sagt.

Dette er klassiske tilfeller av deepfake-bruk. Det du ser er ikke ekte, men teknologien bak er blitt god nok til at hjernen din ikke umiddelbart oppdager forfalskningen, med mindre du virkelig ser etter.

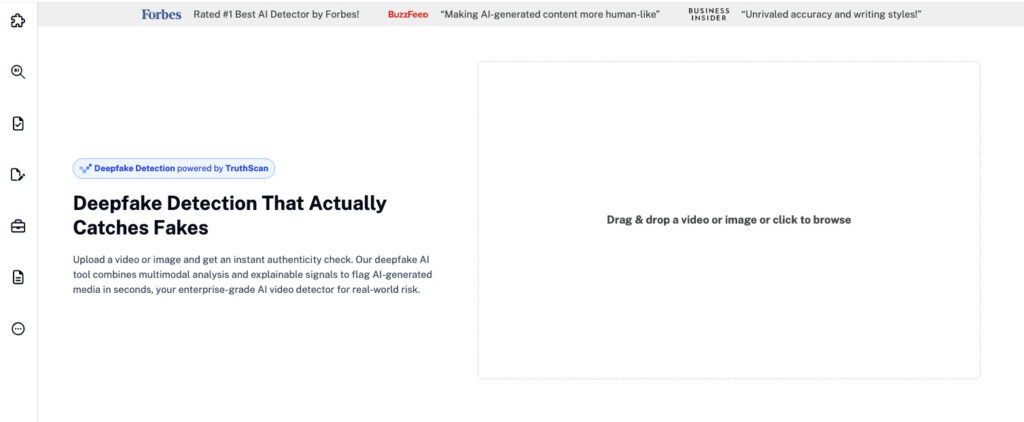

Det er her verktøy som TruthScan gå inn.

TruthScan er utviklet for organisasjoner som har behov for å verifisere medier i stor skala - bedrifter, nyhetsredaksjoner, universiteter og offentlige etater. Det hjelper teamene med å oppdage manipulasjon før falskt innhold skader tilliten eller omdømmet.

Ifølge forskerteamet til Undetectable AI er det faktisk slik, 85 % av amerikanerne sier at deepfakes har svekket deres tillit til informasjon på nettet.

Du har nettopp lært hva en deepfake-video eller -medie egentlig er, og nå skal vi se på hvordan folk lager disse.

Hvordan deepfakes blir laget

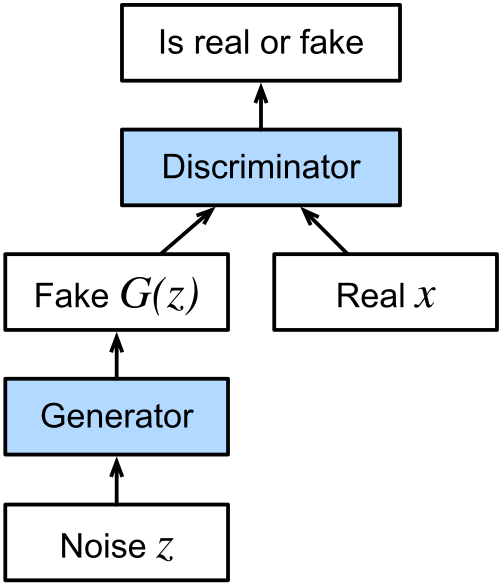

Teknologien bak de fleste deepfakes er en kategori av maskinlæringsalgoritmer som kalles generative adversarial networks, eller GAN.

GAN består av to deler: en generator og en diskriminator.

Generatoren skaper falske medier basert på det den er opplært til å gjenskape, og diskriminatorens jobb er å avsløre det som ser falskt ut.

De fortsetter frem og tilbake til generatoren blir flinkere til å lage falskt innhold som kan bestå diskriminatorens test.

Over tid fører dette frem og tilbake til medier som ser sjokkerende realistiske ut.

Hva er en Deepfake Video Generation-prosess?

Når systemet lager en deepfake-video, analyserer det videoer fra flere vinkler, studerer hvordan personen snakker, hvordan ansiktet beveger seg og hvordan kroppen beveger seg.

All denne informasjonen mates inn i generatoren, slik at den kan skape innhold som etterligner denne atferden.

Deretter hjelper diskriminatoren til med å finjustere den ved å påpeke det som er feil, helt til sluttresultatet ser helt riktig ut.

Det er derfor illusjonen holder seg så godt i bevegelse.

Det brukes noen ulike teknikker avhengig av formålet med deepfake-videoen.

Hvis ideen er å få det til å se ut som om noen sier eller gjør noe i en video som de faktisk aldri har sagt eller gjort, har vi å gjøre med det som kalles en kildevideo deepfake.

En deepfake autoencoder, som består av en koder og en dekoder, studerer de originale opptakene og bruker målpersonens ansiktsuttrykk, gester og subtile hodebevegelser på dem.

Audio Deepfakes

En deepfake av lyd fungerer ved å klone en persons stemme, igjen ved hjelp av GAN-er, basert på opptak av hvordan vedkommende snakker naturlig.

Når modellen er opplært, kan den generere ny tale med den stemmen, selv om personen faktisk aldri har sagt ordene.

Et annet lag som ofte legges til, er leppesynkronisering.

Her tilordner systemet generert eller forhåndsinnspilt lyd til en video.

Målet er å få leppene i videoen til å stemme overens med ordene i lyden.

Eksempler på deepfakes fra den virkelige verden

Deepfakes dukker opp overalt i disse dager.

La oss introdusere deg for noen populære deepfakes som viser hvor langt teknologien har kommet.

Deepfake av president Zelenskyj som ber ukrainske tropper om å overgi seg

I mars 2022, i de tidlige stadiene av krigen mellom Russland og Ukraina, dukket det opp en video på nettet viser Ukrainas president Volodymyr Zelenskyj og oppfordret soldatene sine til å overgi seg.

Det så ut som en nasjonal tale, komplett med Zelenskyjs stemme og væremåte.

Videoen ble spredt på sosiale medier og ble til og med lagt ut på et kompromittert ukrainsk nyhetsnettsted.

Presidenten handlet raskt og sendte ut en offisiell uttalelse gjennom sine verifiserte kanaler for å avkrefte opptakene.

Det virale Deepfake-bildet av pave Frans i en designer-pufferjakke

Noen ganger trenger ikke et deepfake-bilde å være ondsinnet for å skape forvirring.

I 2023 ble et viralt bilde av Pave Frans går rundt i en stilig hvit Balenciaga-pufferjakke tok internett med storm.

Den ble sett flere titalls millioner ganger og delt på mange plattformer.

Bildet ble skapt ved hjelp av et AI-verktøy kalt Midjourney av en anonym bruker i Chicago.

Elon Musk Deepfakes brukt i nettsvindel

I 2024, deepfakes med Elon Musk ble en sentral del av flere store nettsvindler.

AI-genererte videoer av Musk begynte å dukke opp på Facebook, TikTok og andre plattformer, der han promoterte falske kryptovaluta-gaver og investeringsopplegg.

Disse klippene så og hørtes bemerkelsesverdig ekte ut.

Skaden var ikke bare teoretisk. En eldre pensjonist skal ha tapt nesten $700 000 etter å ha latt seg overbevise av en av disse videoene.

Joe Biden Deepfake Robocall som var rettet mot amerikanske velgere

Tidlig i 2024, rett før primærvalget i New Hampshire, velgere mottok robocalls som hørtes ut akkurat som USAs president Joe Biden.

I samtalen oppfordret Joe Biden velgerne til å bli hjemme og spare stemmen sin til parlamentsvalget i november. Hensikten var å forvirre og villede velgerne til å droppe primærvalget.

Hendelsen utløste krav om regulering. Interessegrupper oppfordret den amerikanske valgkommisjonen til å gripe inn, men FEC avslo til slutt med henvisning til begrensninger i sin myndighet.

I mellomtiden har teleselskapet som er ansvarlig for distribusjonen av robocall gikk med på å betale en bot på $1 million.

Politisk bruk av deepfake i det indiske valget i 2020

Ikke all bruk av deepfake-teknologi er skadelig eller villedende (mer om dette senere i bloggen).

Under valget til Delhis lovgivende forsamling i 2020 ble Bharatiya Janata Party brukte kunstig intelligens til å skreddersy en kampanjeannonse for ulike språklige målgrupper.

Partiet tok en video av sin leder Manoj Tiwari som snakket engelsk, og brukte deepfake lip-syncing for å lage en versjon på haryanvi, en regional dialekt.

Mens stemmen kom fra en skuespiller, ble det visuelle modifisert for å matche den nye lyden ved hjelp av kunstig intelligens som var trent opp på ekte opptak av Tiwari.

Partimedlemmene så det som en positiv anvendelse av teknologien som gjorde det mulig for dem å komme i kontakt med velgerne på et språk de forsto, selv om kandidaten ikke snakket det flytende.

Slik verifiserer du deepfakes i den virkelige verden

Med deepfakes som sprer seg i politikk, underholdning og daglig kommunikasjon, har det aldri vært viktigere å vite hvordan man kan bekrefte hva som er ekte.

Til tross for fremveksten av sofistikerte eksempler, finnes det pålitelige verktøy for å motvirke trusselen fra deepfake-teknologi.

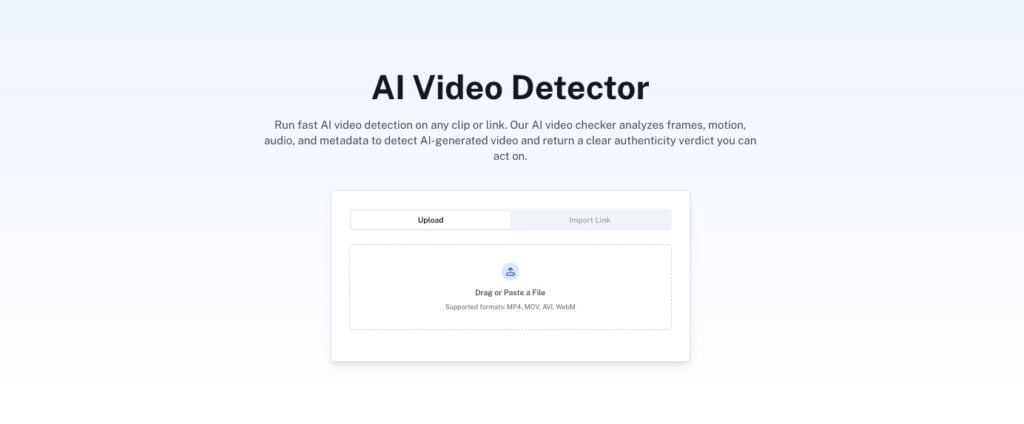

Uoppdagelige AI-er AI-videodetektor er et slikt verktøy, som viser at det finnes pålitelige verktøy for å motvirke sofistikerte eksempler på deepfake-teknologi.

Det er der Undetectable AI kommer inn. Deteksjon av deepfake kommer inn.

Den er utformet for å verifisere om lyd- eller videoinnhold har blitt kunstig generertved hjelp av avanserte kriminaltekniske modeller som analyserer bevegelse bilde for bilde, konsistens på pikselnivå og vokale fingeravtrykk.

På få sekunder kan brukerne se om en video har blitt endret digitalt - eller om en stemme har blitt klonet av kunstig intelligens.

Det er bare å laste opp filen, så gir verktøyet en detaljert autentisitetsrapport med en visuell oversikt og konfidensscore.

Enten det dreier seg om et viralt klipp, et mistenkelig intervju eller et delt opptak, hjelper Deepfake Detection journalister, lærere og vanlige brukere med å avdekke sannheten bak det de ser og hører.

Er deepfakes farlige? Risiko og bekymringer

Så langt har vi sett på hva en deepfake er, hvordan den lages, og hvor den allerede har dukket opp i den virkelige verden.

Teknologien er unektelig imponerende, men risikoen knyttet til den er alvorlig og vokser raskt.

Deepfakes kan brukes som våpen på flere måter. Her er noen av de største bekymringene.

Ærekrenkelse

Når en persons likhet eller stemme brukes til å lage falske kommentarer, uttalelser eller videoer, spesielt de som er støtende eller kontroversielle, kan det ødelegge omdømmet nesten umiddelbart.

Og i motsetning til eldre bløff eller falske sitater, etterlater en overbevisende deepfake lite rom for tvil hos betrakteren.

I så måte kan deepfakes vekke forargelse, ødelegge relasjoner eller rett og slett fremme et skadelig narrativ.

Det som er spesielt bekymringsfullt, er at deepfake ikke engang trenger å være perfekt.

Så lenge personen er gjenkjennelig, og innholdet er troverdig nok, kan det sette varige spor i opinionen.

Informasjonens troverdighet

En annen stor bekymring er hvordan deepfakes undergraver selve sannhetsbegrepet.

Etter hvert som deepfakes blir stadig vanligere, blir det vanskeligere å vite om det vi ser eller hører, er ekte. Over tid kan dette føre til at tilliten til alle former for digital kommunikasjon svekkes.

Denne troverdighetskrisen går utover enkelthendelser.

I demokratiske samfunn er folk avhengige av felles fakta for å ta beslutninger, debattere saker og løse kollektive problemer.

Men hvis velgere, seere eller borgere begynner å stille spørsmål ved alt, blir det mye lettere å manipulere opinionen eller å avfeie ubekvemme sannheter som "bare nok en deepfake".

Utpressing

AI-genererte medier kan brukes til å feilaktig inkriminere enkeltpersoner ved å få det til å se ut som om de har gjort noe ulovlig, uetisk eller pinlig.

Denne typen fabrikkerte bevis kan deretter brukes til å true eller kontrollere dem.

Og det går begge veier. Fordi deepfakes nå er så realistiske, kan noen som blir utsatt for ekte utpressing hevde at bevisene er falske, selv om de ikke er det.

Dette omtales noen ganger som utpressingsinflasjon, der mengden av troverdige forfalskninger ender opp med å redusere verdien av faktisk belastende materiale.

Troverdigheten til reelle bevis forsvinner i tåken, og det gjør det bare enda mer komplisert å avsløre kritikkverdige forhold.

Bedrageri og svindel

Ved hjelp av AI-genererte videoer eller stemmer fra pålitelige offentlige personer skaper svindlere utrolig overbevisende opplegg.

I noen tilfeller brukes deepfakes av kjendiser som Elon Musk, Tom Hanks eller Oprah Winfrey til å reklamere for produkter eller tjenester de aldri har hørt om.

Disse videoene blir deretter spredt på sosiale plattformer, der de når ut til millioner av mennesker.

Selv privatpersoner er i faresonen, spesielt i spearphishing-kampanjer som retter seg mot bestemte personer med persontilpasset innhold utformet for å manipulere eller lure.

Ifølge en 2024-rapport fra Forbeshar deepfake-drevet svindel allerede ført til et estimert globalt tap på $12 milliarder kroner, og dette tallet forventes å bli mer enn tredoblet i løpet av de neste årene.

Derfor er deteksjon ikke bare for enkeltpersoner. Det er avgjørende for bedrifter som håndterer sensitive data, kommunikasjon eller offentlig innhold. TruthScan hjelper disse organisasjonene med å identifisere endrede videoer før feilinformasjon spres.

Positiv og kreativ bruk av deepfakes

Det er verdt å merke seg at ikke alle anvendelser av teknologien er negative.

Mens mange blogger som forklarer hva en deepfake er, fokuserer på misbruk, er det en voksende liste over kreative og produktive måter deepfakes brukes på.

For bedrifter bør likevel selv kunstnerisk eller markedsføringsmessig bruk av deepfakes sjekkes for autentisitet før publisering.

Verktøy som TruthScan kan bekrefte at ingen utilsiktet manipulering gjenstår i den endelige versjonen.

Nedenfor er noen bemerkelsesverdige eksempler.

Film- og skuespilleropptredener

Studioer begynner å stole på deepfake-teknologi for ting som:

- Forbedring av visuelle effekter

- Redusere produksjonskostnadene

- Å bringe tilbake karakterer som ikke lenger finnes

Disneyhar for eksempel videreutviklet høyoppløselige deepfake-modeller som gjør det mulig å bytte ansikt og de-age skuespillere med imponerende realisme.

Teknologien har en oppløsning på 1 024 x 1 024 og kan spore ansiktsuttrykk med stor nøyaktighet, slik at figurene ser yngre eller mer uttrykksfulle ut.

Utover Hollywood har deepfakes muliggjort globalt kampanjearbeid, som da David Beckham ble digitalt klonet for å formidle et helsebudskap på flere språk.

Kunst

I 2018 brukte multimediakunstneren Joseph Ayerle deepfake-teknologi til å skape en AI-skuespiller som blandet ansiktet til den italienske filmstjernen Ornella Muti med kroppen til Kendall Jenner.

Resultatet ble en surrealistisk utforskning av generasjonsidentitet og kunstnerisk provokasjon, som en del av et videokunstverk med tittelen Un'emozione per sempre 2.0.

Deepfakes har også dukket opp i satire og parodier.

Webserien Sassy Justice fra 2020, skapt av South Park-skaperne Trey Parker og Matt Stone, er et godt eksempel.

Den brukte deepfaked offentlige personer til å gjøre narr av aktuelle hendelser og samtidig øke bevisstheten om selve teknologien.

Kundeservice

Også utenfor de kreative bransjene ser bedrifter nytten av deepfakes for kunderettede tjenester.

Noen kundesentre bruker nå syntetiske stemmer drevet av deepfake-teknologi for å automatisere grunnleggende forespørsler, for eksempel kontoforespørsler eller klagelogging.

I disse tilfellene er ikke hensikten ondsinnet, men rett og slett å effektivisere.

Systemer for innringersvar kan tilpasses ved hjelp av AI-genererte stemmer for å få automatiserte tjenester til å høres mer naturlige og engasjerende ut.

Siden oppgavene som håndteres, vanligvis er repetitive og forbundet med lav risiko, bidrar deepfakes i denne sammenhengen til å redusere kostnadene og frigjøre menneskelige agenter til mer komplekse problemstillinger.

Utdanning

Utdanningsplattformer har også begynt å innlemme deepfake-drevne veiledere for å hjelpe elevene på mer interaktive måter.

Disse AI-drevne veilederne kan gi leksjoner ved hjelp av syntetiske stemmer og personlig veiledning.

Verktøy og teknikker for deteksjon av deepfake

Etter hvert som deepfakes blir mer avanserte og tilgjengelige, øker også behovet for å identifisere dem før de forårsaker skade.

Mennesker og organisasjoner trenger også de riktige verktøyene og teknikkene for å ligge et skritt foran. Her er noen verktøy og teknikker.

For bildefokusert verifisering, TruthScans AI-bildedetektor analyserer belysning, pikselmønstre og sammensatte elementer for å flagge AI-genererte eller redigerte bilder i sanntid.

Det hjelper teamene med å bekrefte autentisitet raskt på tvers av bilder og videobilder før innholdet publiseres eller deles.

TruthScan: Deepfake-deteksjon på bedriftsnivå

TruthScan er utviklet for bedrifter, universiteter og medieorganisasjoner som har behov for å verifisere visuelt og auditivt innhold i stor skala.

Den analyserer videoautentisitet på tvers av flere dimensjoner:

- Deteksjon av ansiktsbytte: Identifiserer manipulerte ansiktstrekk bilde for bilde.

- Behavioral Fingerprinting: Oppdager subtile uttrykksmønstre og mikrobevegelser som ikke stemmer overens med naturlig menneskelig atferd.

- Videoetterforskning: Undersøker bildekomprimering, pikselstøy og stemmeforvrengning.

- Deteksjon i sanntid: Muliggjør direkteverifisering under videosamtaler, pressemeldinger eller kringkastingsstrømmer.

Med TruthScan kan teamene autentisere videoer før publisering eller offentlig distribusjon, noe som forhindrer skade på omdømme og økonomi.

For hverdagsbrukere tilbyr Undetectable AIs verktøy lignende beskyttelse på individnivå.

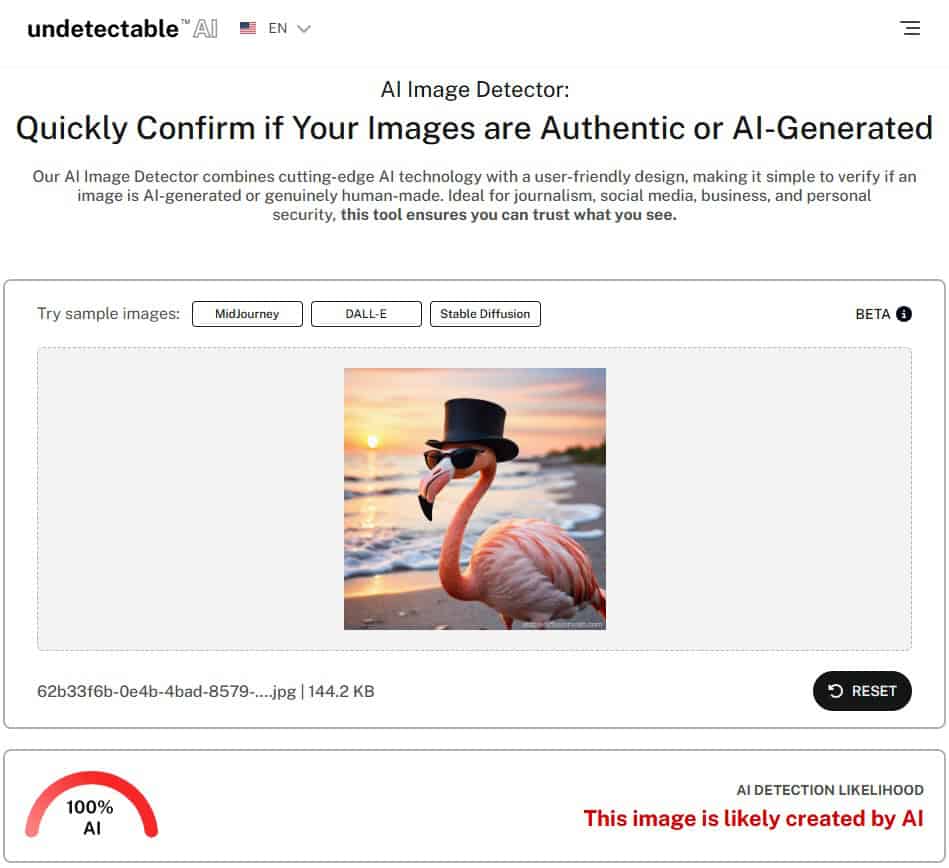

AI-bildedetektor av Undetectable AI

Undetectable AIs AI Image Detector gjør det enklere å oppdage deepfake, selv for dem som ikke har teknisk bakgrunn.

Detektoren fungerer ved å analysere ulike elementer i et opplastet bilde, for eksempel fargemønstre, teksturer, ansiktstrekk og strukturelle uoverensstemmelser.

Den støtter deteksjon for medier som er opprettet ved hjelp av de mest kjente AI-bildegeneratorene som

- Midt på reisen

- DALL-E

- Stabil diffusjon

- Ideogram

- GAN-baserte modeller

For å bruke det er det bare å laste opp et bilde, la verktøyet analysere det og få en klar dom med en tillitsscore.

Hvis du er usikker på om et bilde du har kommet over er ekte, kan du prøve vår AI-bildedetektor for å se etter tegn på AI-manipulering.

Nå, la oss sette Undetectables AI-detektor til testen og se om den kan se nøyaktig om bildet er AI-generert.

Som du kan se, har bilde-AI-detektoren fra Undetectable AI markert dette bildet som 100% AI-genererte.

Visuelle og atferdsmessige teknikker for manuell deteksjon

Det finnes også praktiske teknikker som enkeltpersoner kan bruke for å oppdage deepfakes manuelt, spesielt i situasjoner der det er behov for umiddelbar analyse.

Noen visuelle røde flagg inkluderer:

- Ubekvem ansiktsposisjon eller merkelige ansiktsuttrykk.

- Inkonsekvent belysning eller fargelegging i ulike deler av bildet eller videoen.

- Flimring rundt ansiktet eller hårfestet, særlig under bevegelse.

- Mangel på naturlig blunking eller uregelmessige øyebevegelser.

- Uoverensstemmelser i leppesynkroniseringen når lyden ikke stemmer overens med talen.

Når det gjelder atferd, sliter deepfakes ofte med å etterligne subtile menneskelige trekk. Vær oppmerksom på kroppsspråk, følelsesuttrykk og vanlige gester.

Og i sanntidssamtaler, spesielt livevideoer, bør du be om en sideprofil.

Mange deepfake-modeller sliter fortsatt med å gjengi en 90-graders ansiktsvinkel eller komplekse bevegelser som å vri hodet samtidig som de opprettholder et naturlig uttrykk.

Å oppdage deepfakes i tekst og kontekst

Deepfakes er ikke begrenset til det visuelle. Noen versjoner involverer syntetisk tekst, stemme eller oppførsel som etterligner en persons kommunikasjonsstil.

Når du analyserer tekstinnhold eller dialog, må du holde øye med:

- Feilstavinger og merkelig grammatikk.

- Setninger som føles forcerte eller ikke flyter naturlig.

- Uvanlige e-postadresser eller inkonsekvente formuleringer.

- Meldinger som føles utenfor kontekst eller som ikke er relatert til situasjonen.

Konteksten er også viktig. Hvis en video eller et budskap dukker opp i en setting som ikke gir mening, for eksempel en politiker som uten videre kunngjør en viktig beslutning i et klipp av lav kvalitet, er det verdt å stille spørsmål ved autentisiteten.

Er du nysgjerrig på AI Detector og Humanizer? Prøv dem i widgeten nedenfor!

Vanlige spørsmål om Deepfakes

Er deepfakes ulovlig?

Deepfakes er ikke ulovlige som standard, men de kan være det hvis de bryter med eksisterende lover, for eksempel lover som dekker ærekrenkelser, barnepornografi eller eksplisitt innhold uten samtykke.

Noen amerikanske delstater har vedtatt lover rettet mot deepfakes som påvirker valg eller involverer hevnporno.

Føderale lovforslag som DEFIANCE-loven og NO FAKES Act er også i gang for å regulere ondsinnet bruk av deepfake-teknologi.

Kan noen lage en deepfake?

Ja, nesten hvem som helst kan lage en deepfake ved hjelp av gratis eller rimelig programvare og AI-verktøy.

Mange plattformer har nå brukervennlige grensesnitt, slik at det ikke er nødvendig med avanserte tekniske ferdigheter for å komme i gang.

Hvordan kan jeg beskytte meg mot deepfakes?

Begrens eksponeringen din ved å unngå å legge ut høyoppløselige bilder eller videoer på nettet. Bruk personverninnstillinger og oppdagelsesverktøy som Ikke påvisbar AI eller TruthScan for å dobbeltsjekke alt som er mistenkelig.

Finnes det apper som oppdager deepfake?

TruthScan er utviklet for forretningsbrukere som trenger å analysere videoinnhold i stor skala, mens Undetectable AIs detektorer er beregnet på enkeltpersoner og skapere som ønsker å verifisere mindre mengder innhold.

Avsluttende tanker

Deepfakes er i ferd med å endre måten vi ser sannheten på nettet. Enten du skal beskytte merkevaren din, håndtere offentlig kommunikasjon eller bare surfe trygt, er det avgjørende at du bruker de riktige verktøyene for å oppdage dem.

For bedrifter og institusjoner, TruthScan gir beskyttelse på bedriftsnivå mot AI-drevet feilinformasjon.

For enkeltpersoner, Uoppdagelig AI AI-bildedetektor tilbyr en enkel og rask måte å sjekke bilder og holde seg oppdatert på.

Sammen bidrar de til å sikre at det du ser og deler, forblir ekte.