Is ai inhoudsdetectie altijd accuraat? Hoe werkt het precies? Dit zijn vragen waar iedereen, van studenten tot bedrijfseigenaren, een antwoord op zou moeten hebben in 2026.

Recente ontwikkelingen in kunstmatige intelligentie hebben geleid tot de creatie van ongelooflijk realistische AI-gegenereerde content die de grens tussen mens en machine doet vervagen.

Hoewel dit nieuwe mogelijkheden biedt in verschillende sectoren, vormt het ook een enorme uitdaging om onderscheid te maken tussen door mensen en door AI gegenereerde inhoud.

Als toonaangevend product heeft Undetectable AI bewezen dat machinaal geschreven tekst inderdaad vrijwel niet te onderscheiden is van menselijk proza.

In deze gids onderzoeken we het identificatieproces, verkennen we de technieken, detectietools en de toekomst van inhoudsauthenticiteit.

Laten we erin duiken.

Belangrijkste opmerkingen

- AI-detectie is eerder probabilistisch dan definitief, wat betekent dat tools de waarschijnlijkheid van een machineoorsprong berekenen op basis van wiskundige patronen.

- Nauwkeurigheid blijft een belangrijke hindernis voor de industrie omdat valse positieven vaak niet-moedertaalsprekers van het Engels of zeer formele menselijke schrijvers markeren.

- Hybride strategieën zijn het meest effectief voor het identificeren van synthetische tekst, waarbij geautomatiseerde software wordt gecombineerd met menselijk redactioneel toezicht en fact-checking.

- De wapenwedloop tussen AI en detectie is constant omdat generatieve modellen zich elke dag ontwikkelen om menselijke “imperfecties” effectiever na te bootsen.

- Transparantie wordt waardevoller dan controle, omdat veel organisaties zich nu richten op de kwaliteit en behulpzaamheid van inhoud in plaats van op de technische oorsprong.

Wat is AI-inhouddetectie en waarom het belangrijk is

AI-inhoudsdetectie is het proces waarbij gespecialiseerde software wordt gebruikt om tekst te analyseren en te bepalen of deze is geproduceerd door een Large Language Model (LLM) zoals ChatGPT of Claude.

Dit is belangrijk omdat het de kern van digitaal vertrouwen raakt.

In het onderwijs helpt het de academische integriteit te handhaven; in de journalistiek zorgt het ervoor dat verslaggeving gebaseerd is op menselijke observatie; en in zoekmachineoptimalisatie helpt het platforms bij het identificeren van spam met weinig moeite die het web zou kunnen vervuilen.

Maak je nooit meer zorgen dat AI je sms'jes herkent. Undetectable AI Kan je helpen:

- Laat je AI-ondersteund schrijven verschijnen mensachtig.

- Omleiding alle grote AI-detectietools met slechts één klik.

- Gebruik AI veilig en vol vertrouwen op school en op het werk.

Nu we steeds dichter bij 2026 komen, is de mogelijkheid om synthetische inhoud te identificeren een veiligheidskwestie geworden.

Van deepfake artikelen tot geautomatiseerde misinformatiecampagnes, het kennen van de bron van informatie is essentieel voor een functionele samenleving.

Detectietools fungeren als een eerste verdedigingslinie en helpen gebruikers te controleren of de “stem” waarnaar ze luisteren wordt ondersteund door menselijke ervaring en verantwoordelijkheid.

Hoe AI-inhouddetectietools echt werken

Om te begrijpen hoe een detector een zin markeert, moet je je realiseren dat deze tools niet naar betekenis “lezen” zoals een mens dat doet. In plaats daarvan voeren ze een diepgaande statistische analyse uit van de structuur van de tekst.

Patroonherkenning en voorspelbaarheid

AI-modellen zijn ontworpen om het meest waarschijnlijke volgende woord in een reeks te voorspellen. Dit leidt tot een hoge mate van wiskundige “vloeiendheid” in de tekst.

Detectoren zoeken naar dit gebrek aan wrijving; als elk woord de statistisch meest waarschijnlijke keuze is, identificeert de tool het als een machinaal gegenereerd patroon.

Perplexiteit en barstigheid eenvoudig uitgelegd

Perplexiteit meet hoe “verrassend” de tekst is voor een model. Mensen schrijven vaak met een hoge perplexiteit omdat we onverwachte woordkeuzes maken.

Burstiness verwijst naar de variatie in zinslengte en -structuur. Mensen schrijven in uitbarstingen-een lange, bloemrijke zin gevolgd door een korte, krachtige zin. AI heeft de neiging om heel gelijkmatig te zijn, waardoor een vlakke, ritmische “brom” ontstaat die detectors snel herkennen.

Taal Modellering Signalen

Detectors gebruiken vaak een “spiegel”-versie van de AI die ze proberen te vangen.

Door een passage door een detectiemodel te laten lopen, kan de software zien of de tekst perfect overeenkomt met de waarschijnlijkheidskaarten van een generator. Als de tekst precies het pad volgt dat een machine zou volgen, levert dit een hoge detectiescore op.

Machine Learning Classifiers achter detectie

De meeste moderne tools gebruiken “classifiers” die getraind zijn op miljoenen voorbeelden van zowel menselijke als AI-tekst. Deze classificeerders leren de kleine, onzichtbare verschillen te herkennen in hoe mensen en machines functiewoorden als “het”, “het” of “is” gebruiken.”

Na verloop van tijd worden deze modellen zeer gevoelig voor de subtiele “stijfheid” van synthetisch proza.

Waarom detectieresultaten waarschijnlijkheden zijn, geen zekerheden

Het is belangrijk om te begrijpen dat een AI-detector geen “Ja” of “Nee” antwoord geeft. In plaats daarvan geeft het een waarschijnlijkheidsscore, zoals “85% waarschijnlijk AI”.”

Omdat menselijk schrijven soms voorspelbaar en formeel kan zijn en AI schrijven kan worden aangepast om chaotisch te zijn, kunnen deze tools alleen een gefundeerde gok doen op basis van de huidige gegevens.

Veelvoorkomende tekenen van AI-gegenereerde inhoud

Hoewel software nuttig is, kan het menselijk oog vaak “verklikker”-symbolen van een machine herkennen als je weet waar je op moet letten.

- Overgepolijst maar algemeen taalgebruik: AI schrijft vaak grammaticaal perfect, maar zonder persoonlijkheid of unieke “smaak”.”

- Herhalende zinsconstructies: Machines beginnen vaak meerdere zinnen achter elkaar met hetzelfde woord of gebruiken exact dezelfde lengte voor elke zin in een alinea.

- Gebrek aan persoonlijke ervaring of specifieke details: Een AI kan een concept beschrijven, maar kan geen specifieke anekdote delen over een fout die hij heeft gemaakt of een uniek zintuiglijk detail van een echte gebeurtenis.

- Voorspelbare alineastroom: AI-gegenereerde inhoud volgt meestal een zeer strikt “Inleiding, Punt A, Punt B, Punt C, Conclusie” formaat zonder de organische zwerftocht van menselijke gedachten.

- Vage overgangen en veilige conclusies: Let op zinnen als “Concluderend”, “Het is belangrijk om op te merken” of “Verder” die op een mechanische manier worden gebruikt zonder echte waarde toe te voegen aan het verhaal.

Populairste AI-inhouddetectietools vandaag

Verschillende tools zijn naar voren gekomen als de leiders in deze sector, elk met zijn eigen sterke punten voor verschillende soorten gebruikers.

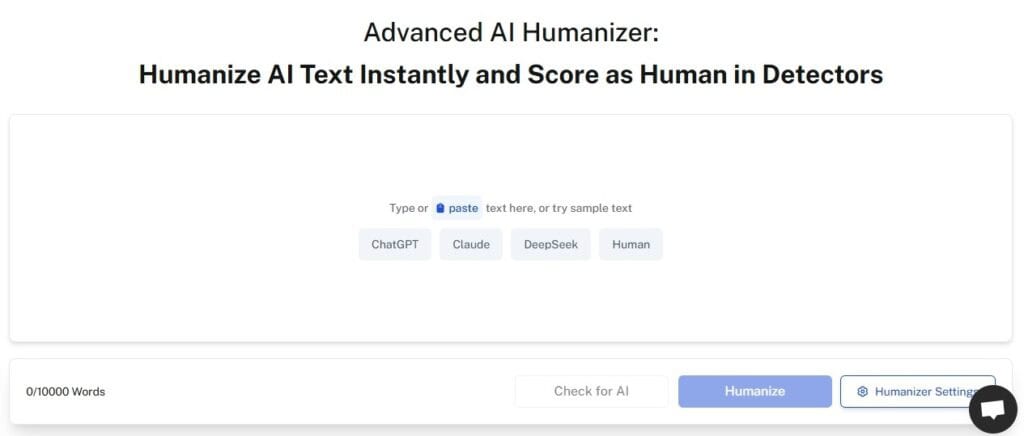

Niet detecteerbare AI

Niet detecteerbare AI is uniek omdat het een multi-model aanpak biedt. In plaats van te vertrouwen op één enkel algoritme, combineert de vrije detector de logica van meer dan zeven verschillende detectiemodellen in één enkele interface.

Dit geeft gebruikers een “breder” beeld van hoe hun tekst zou kunnen worden waargenomen door verschillende systemen op het web.

Turnitin AI-detectie

Draaiitin is de dominante kracht in de academische wereld. De tool is specifiek afgestemd op het vinden van AI in essays en onderzoekspapers van studenten.

Het wordt wereldwijd op grote schaal gebruikt door universiteiten, hoewel het ook kritiek te verduren kreeg omdat het soms origineel menselijk werk als machinaal gegenereerd bestempelde.

GPTZero

GPTZero werd oorspronkelijk gemaakt als afstudeerproject in Princeton en was een van de eerste gereedschappen die populair werd. Het staat bekend om zijn “Perplexity” en “Burstiness” scores, die gebruikers helpen de exacte wiskundige redenen te zien waarom een stuk tekst “robotachtig” aanvoelt.”

Copyleaks

Copyleaks wordt geprefereerd door bedrijven en ondernemingen vanwege de hoge nauwkeurigheid en het vermogen om “geparafraseerd” plagiaat te detecteren. Het is met name effectief in het identificeren wanneer iemand AI-tekst heeft genomen en kleine handmatige wijzigingen heeft aangebracht om te proberen het te verbergen.

Originaliteit.ai

Deze tool is vooral gericht op webuitgevers en SEO-professionals. Het is ontworpen om zeer gevoelig te zijn en zelfs kleine hoeveelheden AI-hulp te signaleren. Het is een favoriet voor degenen die er zeker van moeten zijn dat de inhoud die ze van freelancers kopen 100% door mensen is geschreven.

Het nauwkeurigheidsprobleem: kan AI-inhoudsdetectie worden vertrouwd?

Het meest controversiële aspect van de industrie is de betrouwbaarheid. Hoewel de detectie-instrumenten steeds beter worden, zijn ze verre van perfect en hun fouten kunnen gevolgen hebben voor de echte wereld.

Fout-positieven bij menselijk schrijven

Een “vals positief” doet zich voor wanneer een hulpmiddel menselijk schrijven ten onrechte als AI identificeert. Dit gebeurt vaak bij zeer gestructureerd schrijven, zoals juridische documenten, wetenschappelijke rapporten of zelfs de Bijbel. Dit heeft geleid tot veel gevallen van studenten die ten onrechte worden beschuldigd van spieken.

Valse negatieven bij AI-inhoud

Er is sprake van een “vals negatief” wanneer een door AI gegenereerde tekst doorgaat voor een menselijke tekst.

Met hulpmiddelen zoals de Undetectable AI's AI Humanizer, Het is nu mogelijk om machinetekst zo te herschrijven dat de complexiteit en willekeur van menselijk proza wordt nagebootst, waardoor bijna alle huidige detectoren worden omzeild.

Vooroordelen tegen schrijvers die Engels niet als moedertaal hebben

Onderzoek heeft aangetoond dat AI-detectors eerder het schrijven van niet-moedertaalsprekers van het Engels markeren.

Omdat deze schrijvers vaak een formeler, minder gevarieerd vocabulaire gebruiken, weerspiegelt hun werk van nature de statistische patronen waar detectors naar zoeken, wat leidt tot oneerlijke vooroordelen in academische en professionele omgevingen.

Wie gebruikt AI-inhouddetectie (en waarom)

Het gebruik van deze tools is wijdverspreid, maar de motivaties verschillen per branche.

| Gebruikersgroep | Primair doel | Waarom resultaten vaak variëren |

| Onderwijsinstellingen | Academische oneerlijkheid en spieken voorkomen. | Academisch schrijven is van nature formeel, wat veel basisdetectoren in de war brengt. |

| Contentmarketingteams | Zorg ervoor dat inhoud “nuttig” is en goed scoort bij zoekopdrachten. | Verschillende tools geven prioriteit aan verschillende SEO-signalen en zoekwoorddichtheden. |

| Uitgevers en media | Behoud de autoriteit van het merk en de menselijke stem. | In de journalistiek worden vaak korte, rake zinnen gebruikt die er voor AI uit kunnen zien als “low burstiness”. |

| Wervers | Filter in massa geproduceerde, door AI geschreven sollicitatiebrieven. | Professionele cv's gebruiken gestandaardiseerde sjablonen die machines perfect nabootsen. |

Hoe ondetecteerbare AI helpt om schrijven zoals mensen te verbeteren

Detectie is één kant van de medaille, maar de andere kant is “vermenselijking”. Undetectable AI biedt een reeks hulpmiddelen waarmee schrijvers AI op een verantwoorde manier kunnen gebruiken en er tegelijkertijd voor kunnen zorgen dat hun eindproduct authentiek aanvoelt.

Voorspelbare AI-patronen verminderen

De software analyseert je klad en identificeert de “machine-achtige” reeksen die normaal gesproken een vlag zouden activeren. Vervolgens worden deze secties op intelligente wijze opnieuw geordend en geformuleerd om een natuurlijker verloop te creëren.

Natuurlijke stroming en stem verbeteren

Door gebruik te maken van de AI Humanizer, kunnen schrijvers de “levendigheid” en taalkundige variatie injecteren die machines meestal missen. Dit resulteert in tekst die niet alleen “ondetecteerbaar” is, maar ook echt boeiender voor de menselijke lezer.

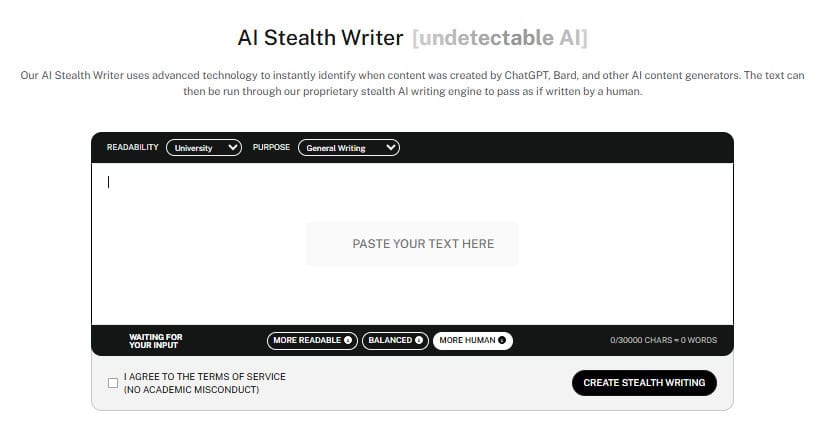

Toon en zinsvariatie verfijnen

Onze AI Stealth Schrijver stelt gebruikers in staat om te kiezen uit verschillende “Mens”-niveaus, van middelbare schoolniveau tot universitair of professioneel niveau.

Dit zorgt ervoor dat de toon consistent blijft met het beoogde publiek en voorkomt de “tonale whiplash” die optreedt als onbewerkte AI te slim probeert te klinken.

Verantwoord AI-gebruik ondersteunen

Het doel is niet om te misleiden, maar om te verbeteren. Door een AI-inhouddetector Naast humaniseringstools moedigt Undetectable AI schrijvers aan om hun werk te controleren, hun bronnen te citeren en ervoor te zorgen dat hun uiteindelijke inzending een getrouwe afspiegeling is van hun eigen ideeën en redactie.

De toekomst van AI-inhouddetectie

Als we kijken naar 2027 en verder, zal de strijd tussen generatie en detectie blijven bepalen hoe we omgaan met online informatie.

- De voortdurende wapenwedloop tussen AI en detectie: Elke keer dat een detector slimmer wordt, worden de generatoren beter in het nabootsen van menselijke “ruis”. Deze cyclus zal waarschijnlijk doorgaan totdat we een punt van “perfecte pariteit” bereiken.”

- Slimmere detectiealgoritmen: Toekomstige tools zullen waarschijnlijk kijken naar “metadata” en “fingerprinting” technieken, zoals verborgen watermerken die zijn ingesloten door de bedrijven die de AI-modellen maken.

- De verschuiving naar transparantie in plaats van politie: Veel experts suggereren dat we uiteindelijk stop met proberen AI te “vangen en zich in plaats daarvan richten op verifieerbare “human-in-the-loop” workflows.

- Waarom schrijfvaardigheid er nog steeds toe doet: Zelfs in een wereld vol AI blijft het vermogen om te redigeren, feiten te controleren en een uniek menselijk perspectief te bieden de meest waardevolle vaardigheid die een schrijver kan bezitten.

Probeer onze AI Detector en Humanizer in de widget hieronder!

FAQs

Is AI-inhoudsdetectie altijd accuraat?

Nee, het is probabilistisch. Valse positieven komen vaak voor, vooral bij formeel of niet-native Engels schrijven. Je moet detectieresultaten altijd gebruiken als een startpunt voor onderzoek en niet als een eindoordeel.

Kan Google me straffen voor AI-gegenereerde inhoud?

Volgens Google Centraal zoeken, Google richt zich op de kwaliteit en behulpzaamheid van de inhoud. Als je AI-inhoud niet nuttig is of puur is gemaakt om rankings te manipuleren, zal deze worden bestraft, ongeacht of deze door een machine is geschreven.

Hoe maak ik mijn AI-inhoud ondetecteerbaar?

De meest effectieve manier is het gebruik van een humaniseringstool zoals Undetectable AI, dat de tekst herstructureert zodat deze overeenkomt met menselijke linguïstische patronen. De beste resultaten krijg je echter door je eigen persoonlijke verhalen en unieke inzichten handmatig toe te voegen.

Vangt Turnitin alle AI-inhoud?

Turnitin is zeer geavanceerd, maar kan nog steeds omzeild worden door geavanceerd herschrijven en humaniseren. Het wordt het best gebruikt door leerkrachten om te zoeken naar algemene patronen van inconsistentie in het werk van een leerling in de loop van de tijd.

Conclusie

Nu kunstmatige intelligentie een vast onderdeel wordt van ons creatieve en professionele leven, is inzicht in de detectie van ai inhoud essentieel voor het behoud van integriteit en vertrouwen.

Hoewel detectiehulpmiddelen een waardevolle kijk bieden op de wiskundige oorsprong van een tekst, zijn het geen onfeilbare beoordelaars.

De meest succesvolle makers in 2026 zijn degenen die deze tools op verantwoorde wijze gebruiken en de efficiëntie van AI combineren met de onvervangbare warmte en nuance van een menselijke stem.

Door op de hoogte te blijven en een meerlagige benadering van verificatie te gebruiken, kunt u met vertrouwen over het moderne web navigeren.

Authenticiteit is de meest waardevolle valuta in het tijdperk van automatisering. Zorg ervoor dat je stem wordt gehoord, niet alleen je aanwijzingen.

Klaar om ervoor te zorgen dat je schrijven zowel van hoge kwaliteit als authentiek jou is? Ontdek Niet detecteerbare AI om je ontwerpen menselijker te maken en je professionele kant te behouden.