Widziałeś ten wirus Zdjęcie papieża w stylowej białej kurtce puchowej w 2023 roku?

Miliony ludzi udostępniło to zdjęcie, serwisy informacyjne donosiły o tym, a wszyscy mówili o tym, jak stylowo wyglądał papież.

Był tylko jeden problem - to się nigdy nie wydarzyło. Obraz został w całości stworzony przez sztuczną inteligencję.

A może pamiętasz szokujący obrazek przedstawiający eksplozja w Pentagonie która na krótko wstrząsnęła rynkiem akcji. Fake!

A co ze zdjęciami Trump został zatrzymany i aresztowany? Ponownie, zostały one również całkowicie wymyślone przez AI.

Fałszywe obrazy AI spowodowały prawdziwe szkody.

Ludzie stracili pieniądze inwestując w oparciu o fałszywe wiadomości.

Zarówno celebryci, jak i zwykli ludzie ich twarze zostały umieszczone na innych ciałach w żenujących lub nieodpowiednich sytuacjach.

Pokazano polityków mówiących i robiących rzeczy, których w rzeczywistości nigdy nie zrobili.

Kiedy nie możemy ufać własnym oczom, potrzebujemy nowych sposobów na ustalenie, co jest prawdziwe, a co nie.

Na tym blogu pokażę, jak technologia AI i DeepFake ewoluowała na przestrzeni lat, jakie znaczenie ma identyfikacja AI w porównaniu z prawdziwymi obrazami, jak stwierdzić, czy obraz jest generowany przez AI, czy też najlepsze narzędzie do wykrywania obrazów generowanych przez AI.

Jak ewoluowała sztuka AI i technologia Deepfake

Porozmawiajmy o AI najpierw...

Jeszcze niedawno obrazy generowane przez sztuczną inteligencję wyglądały jak zły sen - rozmazane twarze, dodatkowe palce i cała masa dziwactw. Ale dziś sztuka sztucznej inteligencji jest szokująco realistyczna.

Wszystko zaczęło się około 2014 roku od GAN (Generative Adversarial Networks), w którym dwa modele sztucznej inteligencji - jeden tworzący podróbki, drugi je wykrywający - stale się nawzajem ulepszały.

Nigdy więcej nie martw się, że sztuczna inteligencja wykryje twoje teksty. Undetectable AI Może ci pomóc:

- Spraw, by pisanie wspomagane przez sztuczną inteligencję wyglądało podobny do człowieka.

- Obejście wszystkie główne narzędzia do wykrywania AI za pomocą jednego kliknięcia.

- Użycie AI bezpiecznie i pewnie w szkole i pracy.

Wczesne obrazy GAN były dość kiepskie - rozmyte twarze z dziwnymi oczami i brakującymi uszami.

Do 2020 r. sytuacja znacznie się poprawiła dzięki "modele dyfuzji".

Zaczynają od niechlujnego obrazu pełnego kropek i powoli go oczyszczają, aż wygląda realistycznie.

Był to ogromny krok naprzód. Nagle sztuczna inteligencja mogła tworzyć znacznie wyraźniejsze, bardziej realistyczne obrazy.

Technologia Deepfake działa w ten sam, ale bardziej skomplikowany sposób.

Wiąże się to z wykorzystaniem zarówno sztucznej inteligencji, jak i technologii Deepfake.

Sztuczna inteligencja uczy się, jak wygląda czyjaś twarz pod wieloma kątami i wyrazami, analizując wiele filmów i zdjęć.

Następnie może umieścić twarz tej osoby na ciele innej osoby w innym filmie.

Komputer uczy się dopasowywać oświetlenie, odcień skóry, a nawet drobne wyrazy twarzy, aby wyglądały realistycznie.

Wczesne deepfake'i z 2017 roku wyglądały na oczywiste i wadliwe. Dzisiejsze deepfake'i mogą być niemal idealne.

Aby zobaczyć porównanie, obejrzyj poniższe filmy:

Deepfake w 2017 r. Fałszywe wideo Obamy

Deepfake w 2023 r. Emma Watson w filmie "Get Out (2017)"

W 2022 r. ludzie stworzyli około 6 milionów obrazów przy użyciu sztucznej inteligencji. Na początku 2023 r. liczba ta wzrosła do ponad 20 milionów obrazów dziennie.

Obecnie w Internecie istnieją miliardy obrazów stworzonych przez sztuczną inteligencję, a większość z nas widzi je codziennie, nawet o tym nie wiedząc.

Ryzyko związane z obrazami generowanymi przez sztuczną inteligencję w dezinformacji

Fałszywe wiadomości rozprzestrzeniają się w mediach społecznościowych 6 razy szybciej niż prawdziwe.

Szkody są zwykle wyrządzane do czasu, gdy ktoś wskaże, że obraz jest fałszywy.

Ryzyko związane z fałszywymi obrazami jest następujące:

1) Manipulacja - Fałszywe obrazy tworzą fałszywe narracje o innych, w tym o wyborach, przywódcach i wydarzeniach na świecie. Na przykład, Obrazy wygenerowane przez sztuczną inteligencję fałszywie przedstawiały aresztowanie prezydenta USA Donalda Trumpa.

2) Zniesławienie - Fałszywe obrazy mogą zrujnować reputację. Na przykład, W styczniu 2024 r. wygenerowane przez sztuczną inteligencję obrazy Taylor Swift krążyły w Internecie, fałszywie ją przedstawiając.

3) Niepokoje społeczne - Pojedynczy fałszywy obraz może wywołać oburzenie, zamieszki, a nawet przemoc. Na przykład, W maju 2023 r. wygenerowany przez sztuczną inteligencję obraz przedstawiający eksplozję w pobliżu Pentagonu krążył szeroko w mediach społecznościowych.

4) Oszustwo - Oszuści wykorzystują fałszywe obrazy, aby nakłonić ludzi do wysyłania pieniędzy. Na przykład; Michael Hewson (analityk finansowy) podszywał się pod niego w celu promowania oszukańczych programów inwestycyjnych.

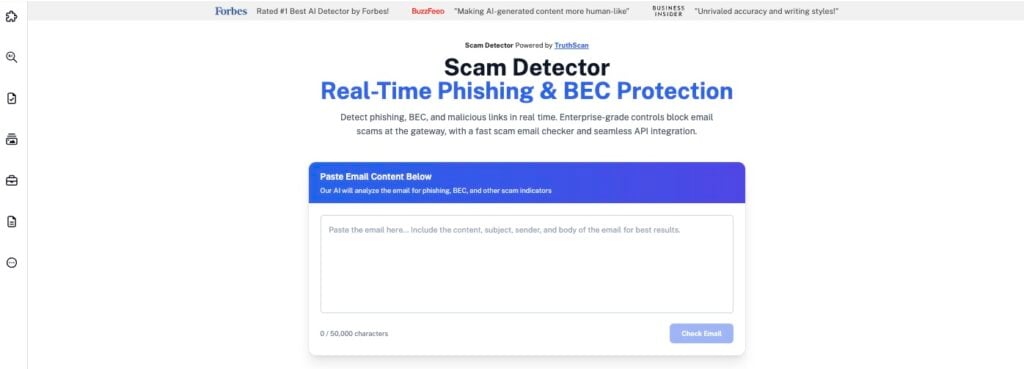

Ponieważ te oszustwa często zaczynają się od “zweryfikowanego” wizerunku celebryty, standardowa ostrożność nie wystarczy. Przeprowadź załączony link lub wiadomość przez naszą niewykrywalną sztuczną inteligencję Wykrywacz oszustw.

Zapewnia istotną warstwę bezpieczeństwa, oznaczając fałszywe domeny i ryzykowny język “szybkiego wzbogacenia się”, który często towarzyszy generowanym przez sztuczną inteligencję podróbkom analityków finansowych lub osób publicznych.

Jest jeszcze jeden problem, który nazywa się "dywidenda kłamcy".

Ponieważ podróbki sztucznej inteligencji stają się powszechne, ludzie przyłapani na prawdziwych skandalach po prostu odrzucają dowody. "deepfake" - nawet jeśli są prawdziwe. Politycy już zaczęli stosować tę taktykę.

Znaczenie identyfikacji sztucznej inteligencji i rzeczywistych obrazów

Potrzeba zrozumienia prawdziwego i fałszywego wizerunku jest większa niż kiedykolwiek z kilku powodów:

1 - Erozja zaufania publicznego

Nasze społeczeństwo opiera się na zaufaniu. Nasz mózg akceptuje to, co widzi w wiadomościach, w sądzie lub od naszych przywódców.

Ale teraz, gdy sztuczna inteligencja tworzy tak przekonujące fałszywe obrazy, zaufanie to spada.

Jeśli wszyscy nadal będziemy tak podejrzliwi, całkowicie zmieni to sposób, w jaki łączymy się ze światem.

2 - Implikacje prawne i nowe regulacje

Rządy próbują dowiedzieć się, co zrobić z fałszywymi obrazami AI.

Na przykład,

- Kalifornia właśnie uchwaliła prawo która czyni nielegalnym tworzenie fałszywych reklam politycznych przy użyciu sztucznej inteligencji w czasie wyborów.

- The Unijna ustawa o wywiadzie nakłada obowiązki w sprawie oznaczania wymagań dotyczących materiałów AI i deepfake.

3 - Wpływ na umiejętności cyfrowe

Ponieważ sztuczna inteligencja staje się coraz lepsza w tworzeniu fałszywych obrazów, wszyscy musimy być lepsi w ich wykrywaniu.

Szkoły muszą uczyć uczniów o sztucznej inteligencji i stale rozwijającej się technologii Deepfake.

Musimy rozwinąć pełne zrozumienie, aby nie wierzyć tylko w to, co widzimy w Internecie.

4 - Utrzymywanie łańcuchów autentyczności

Jednym z rozwiązań może być "Łańcuchy autentyczności."

Oznacza to śledzenie, skąd pochodzi obraz - od momentu jego utworzenia do momentu, w którym go widzimy.

Specjalna technologia może dodawać niewidoczne oznaczenia do prawdziwych zdjęć, które pokazują, kto i kiedy je zrobił.

Gdybyśmy tego użyli, moglibyśmy zweryfikować historię obrazu i jego autentyczność.

Jak sprawdzić, czy obraz jest generowany przez sztuczną inteligencję (kluczowe znaki)?

Obrazy generowane przez sztuczną inteligencję wyglądają tak realistycznie, że początkująca osoba będzie miała trudności ze znalezieniem różnicy.

Jeśli jesteś kimś, kto próbuje dowiedzieć się, jak rozpoznać, czy obraz jest generowany przez sztuczną inteligencję, zwróć uwagę na te kluczowe szczegóły:

- 1. Nienaturalne lub surrealistyczne szczegóły

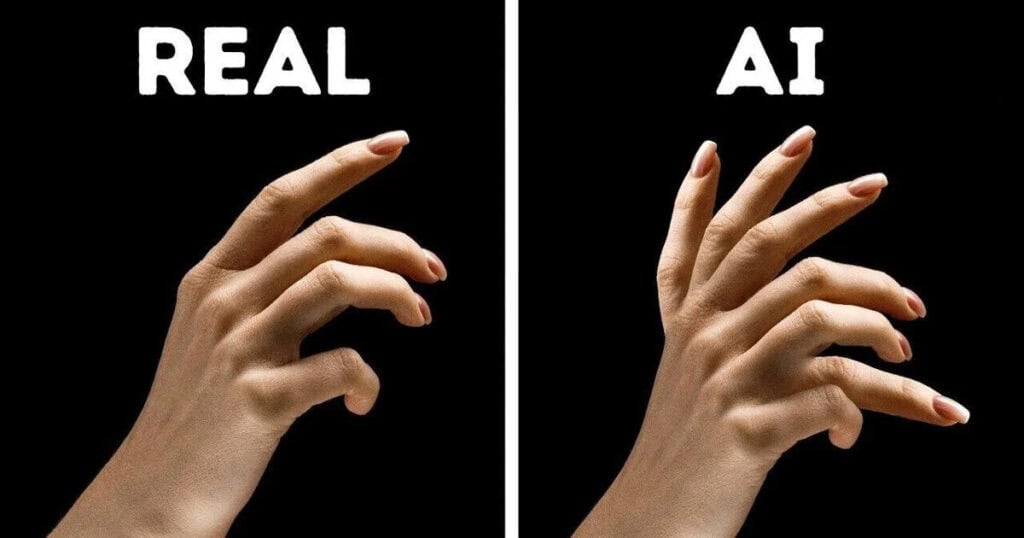

Sztuczna inteligencja nie może zrozumieć niektórych części ciała, zwłaszcza ręce.

Mamy 5 palców na każdej dłoni, ale AI często daje ludziom 6-8 palców, zrośnięte palce lub dziwnie wyglądające kciuki. Spójrz na dłonie.

Źródło = Fltimes

Sztuczna inteligencja również nawala zęby dużo.

Zwróć uwagę na zęby, które wydają się zbyt idealne, zbyt wiele zębów w jamie ustnej lub zęby, które nie układają się prawidłowo.

Czasami wszystkie zęby zlewają się w jedną białą plamę.

Obraz wygenerowany przez ChatGPT

Inne błędy ciała obejmują:

- Oczy, które nie pasują do siebie lub patrzą w nieco innych kierunkach

- Uszy, które nie pasują do siebie lub są na różnych wysokościach

- Okulary, które dziwnie się odkształcają lub zsuwają z twarzy

- Biżuteria, która wtapia się w skórę lub nie podąża za ruchem ciała.

- 2. Zbyt gładkie lub plastikowe tekstury

Prawdziwa skóra ma teksturę (pory, linie, drobne niedoskonałości). Jednak AI często sprawia, że skóra wygląda jak plastikowa lalka - zbyt idealna!

Włosy to kolejna wskazówka. Prawdziwe włosy mają pojedyncze pasma, które biegną w różnych kierunkach.

Włosy AI często wyglądają jak jeden solidny kawałek, zwłaszcza w miejscu, w którym stykają się z czołem.

Linia włosów może wyglądać na namalowaną, zamiast pokazywać pojedyncze włosy.

Źródło = Mikestuzzi

Ubrania w obrazach AI są albo bardzo gładkie, albo mają dziwne zmarszczki, które nie mają fizycznego sensu.

Przyjrzyj się, jak składają się tkaniny - czy wyginają się tak, jak prawdziwe materiały?

Często sztuczna inteligencja sprawia, że tkanina wygląda jak stopiona lub zamrożona w niemożliwy sposób.

Dlaczego tak się dzieje? Sztuczna inteligencja nie rozumie fizyki i materiałów - po prostu kopiuje wzorce, które widziała wcześniej.

Na przykład,

Może wiedzieć Jak wygląda denimale nie to, jak denim zachowuje się, gdy ktoś na nim usiądzie. Poszukaj tych wskazówek.

- 3. Niewyraźny lub bełkotliwy tekst na obrazie

Tekst jest największą słabością AI.

Kiedy widzisz słowa lub litery na obrazie AI, często są one rozmyte, nonsensowne lub po prostu błędne.

Obraz wygenerowany przez ChatGPT

Szukaj:

- Słowa, które zaczynają się normalnie, ale zamieniają się w bełkot.

- Litery mieszające się lub zmieniające kształt

- Niemożliwe kombinacje symboli

- Bezsensowny tekst na znakach lub koszulkach

Dzieje się tak, ponieważ sztuczna inteligencja nie rozumie języka w taki sam sposób, jak rozumie obrazy. Teksty wydają się być kolejnym wizualnym wzorem.

- 4. Niespójne oświetlenie i cienie

Obrazy generowane przez sztuczną inteligencję nie przestrzegają ani nie rozumieją zasad światła i cienia.

Na przykład, Czasami wygląda to tak, jakby na niebie było wiele słońc.

Albo cienie na obiektach (skóra, metal, szkło), które po prostu nie mają sensu.

Sztuczna inteligencja nie rozumie fizyki światła. Próbuje tylko dopasować wzory, które widziała wcześniej, a nie oblicza, jak światło odbija się i odbija.

Źródło = Creator.nightcafe.club

Te problemy ze światłem są coraz lepsze, ale nadal są powszechne nawet w wysokiej jakości obrazach AI.

- 5. Dziwne tła lub nierealistyczne postrzeganie głębi

Tło w obrazach AI często zawiera wskazówki, że coś jest nie tak. Szukaj:

- Budynki o niemożliwej architekturze (okna, które nie są w jednej linii, drzwi, które prowadzą donikąd)

- Obiekty, które wydają się zlewać ze sobą lub z tłem

- Rzeczy, które powinny być daleko, ale wyglądają tak samo jak rzeczy z bliska.

Źródło = Wallpaperaccess.com

Czasami krawędź, na której osoba styka się z tłem, wygląda dziwnie - albo jest zbyt ostra, albo zbyt rozmyta. Dzieje się tak, ponieważ sztuczna inteligencja tworzy osobę i tło osobno, a następnie próbuje je połączyć.

- 6. Sprawdź metadane i informacje o źródle

Każde zdjęcie zrobione prawdziwym aparatem ma "Metadane" - informacje o tym, kiedy i w jaki sposób zdjęcie zostało zrobione.

Obrazy AI nie mają metadanych ani metadanych wskazujących, że zostały wykonane przez programy takie jak DALL-E lub Midjourney.

Metadane można sprawdzić za pomocą:

- Kliknięcie obrazu prawym przyciskiem myszy i wybranie opcji "Właściwości" lub "Informacje"

- Korzystanie z witryn takich jak metadata2go.com

- W telefonie użyj aplikacji takich jak Photo Investigator

Jeśli nie masz pewności, wypróbuj odwrotne wyszukiwanie obrazów.

- Przejdź do Google Images

- Prześlij zdjęcie, aby sprawdzić, czy pojawiło się w innym miejscu online lub w innych wersjach.

Pamiętaj, że to, że ktoś twierdzi, że zrobił zdjęcie, nie oznacza, że jest ono prawdziwe.

Kto to opublikował i dlaczego? Chcą mnie rozzłościć czy przestraszyć?

Są to często oznaki fałszywych obrazów.

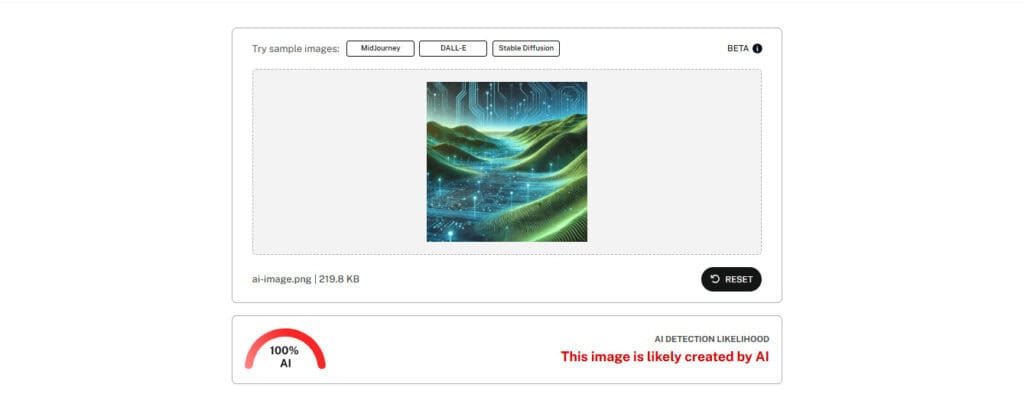

Najlepsze narzędzie do wykrywania obrazów generowanych przez sztuczną inteligencję

Co zaskakujące, mamy inne narzędzia wyszkolone pod kątem AI, które pomagają w wykrywaniu AI. W tym przypadku narzędziem jest Detektor obrazu AI.

Przyjrzyjmy się, co sprawia, że detektor AI jest dobry.

1 - Dokładność: Niektóre narzędzia wykrywające są w większości poprawne, podczas gdy inne popełniają błędy.

Najlepszy dzisiejszy wykrywacz trafia prawidłowo w około 80-85% przypadków, co nie jest idealne, ale jest znacznie lepsze niż zgadywanie.

2 - Które generatory AI może wykryć: Niektóre narzędzia są świetne w wykrywaniu jednego źródła (np. obrazów DALL-E), ale pomijają inne (np. podróbki Midjourney).

To narzędzie jest przeszkolony we wszystkich głównych narzędziach artystycznych AI - DALL-E, Midjourney, Stable Diffusion i innych.

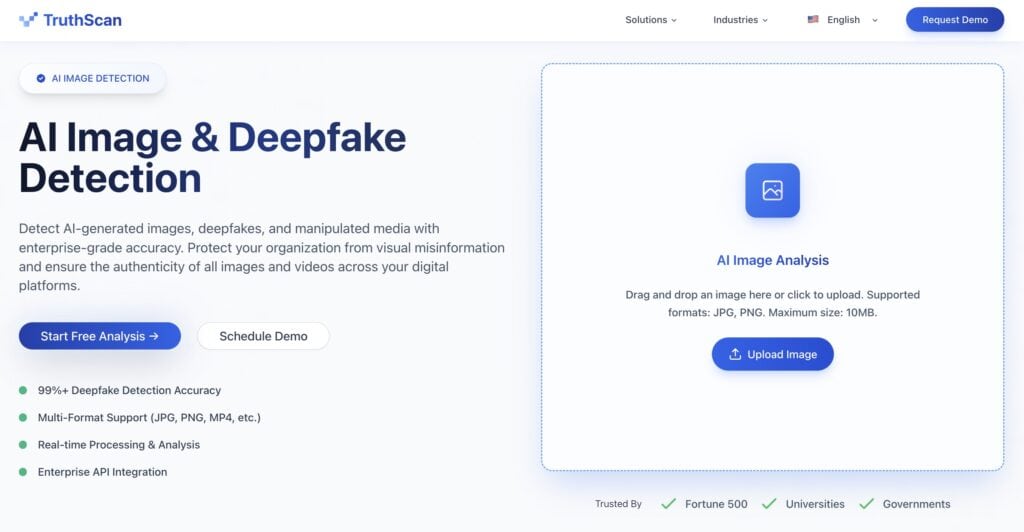

Dla bardziej zaawansowanej analizy na poziomie kryminalistycznym, Detektor obrazów AI TruthScan to kolejne potężne narzędzie, które warto dodać do swojego zestawu narzędzi do weryfikacji obrazu.

Wykracza poza analizę wzorców na poziomie pikseli, aby wykryć oznaki zmanipulowanej lub wygenerowanej przez sztuczną inteligencję treści - w tym deepfakes i mediów syntetycznych.

Niezależnie od tego, czy masz do czynienia z potencjalnymi dezinformacjami, kwestiami bezpieczeństwa marki czy dowodami cyfrowymi, TruthScan pomaga zapewnić, że obrazy, których używasz lub napotykasz, są autentyczne, identyfikowalne i bezpieczne pod względem prawnym.

Deepfake Detection do potwierdzania autentyczności obrazu

W sytuacjach, w których dokładność wizualna naprawdę ma znaczenie, Undetectable AI's Wykrywanie fałszerstw zapewnia precyzyjny sposób weryfikacji, czy obraz lub wideo zostały sztucznie wygenerowane lub zmanipulowane.

Bada Spójność oświetlenia, wzory pikseli i wyrównanie twarzy aby wykryć nawet najbardziej subtelne oznaki deepfake lub syntetycznej edycji.

Po przesłaniu pliku otrzymasz ocenę autentyczności i wskaźniki wizualne, które podkreślają potencjalne obszary manipulacji.

W połączeniu z wykrywaczem obrazów AI, funkcja Deepfake Detection zapewnia, że każda udostępniana lub publikowana grafika jest zweryfikowana, autentyczna i godna zaufania.

W przypadku zespołów lub instytucji, które sprawdzają również materiały audio, takie jak osobiste oświadczenia lub nagrane odpowiedzi na pytania zawarte w aplikacji, pomocne jest zweryfikowanie, czy głos, który słyszysz, jest autentyczny.

Niewykrywalna sztuczna inteligencja Detektor głosu AI może analizować przesłane pliki audio i sprawdzać, czy nie zawierają one śladów syntezy głosu lub klonowania.

Daje to jasny sygnał, czy mowa została wygenerowana przez prawdziwego mówcę, czy też przez model sztucznej inteligencji, co dodaje dodatkową warstwę zaufania i autentyczności do każdego zgłoszenia głosowego.

3 - Łatwość użytkowania: Nie powinieneś potrzebować dyplomu z informatyki, aby sprawdzić, czy obraz jest fałszywy.

Wystarczy przesłać zdjęcie, a wynik pojawi się w ciągu kilku sekund.

4 - Prywatność: Niektóre wykrywacze zachowują wszystkie przesłane obrazy, co może stanowić problem w przypadku sprawdzania wrażliwych zdjęć. To narzędzie usuwa obrazy po ich sprawdzeniu.

Oto jak korzystać z naszego Detektor obrazu AI:

- Kliknij ten link, aby odwiedzić stronę internetową.

- Wybierz żądany obraz z komputera lub telefonu. Narzędzie akceptuje formaty JPEG i PNG o rozmiarze do 4,5 MB.

- Kliknij przycisk i poczekaj kilka sekund.

- Ogólny wynik od 1 do 100 pokazuje, jak prawdopodobne jest, że obraz został wygenerowany przez sztuczną inteligencję

Aby uzyskać najlepsze rezultaty, używaj obrazów, które nie zostały mocno skompresowane ani nie zmieniły rozmiaru.

Zrzuty ekranu i obrazy z mediów społecznościowych są często skompresowane, co może utrudniać ich wykrycie.

Czasami detektory mylą się na dwa główne sposoby:

- Fałszywe alarmy Zdarza się, gdy detektor twierdzi, że obraz jest generowany przez sztuczną inteligencję, ale jest prawdziwy. Może się to zdarzyć w przypadku wysoce edytowanych zdjęć, ilustracji lub obrazów z nietypowym oświetleniem.

Fałszywe negatywy Dzieje się tak, gdy detektor twierdzi, że obraz jest prawdziwy, ale w rzeczywistości jest generowany przez sztuczną inteligencję.

Dzieje się tak najczęściej w przypadku mocno edytowanych obrazów AI lub tych stworzonych przez nowsze modele AI, o których detektor jeszcze się nie dowiedział.

Jeśli szukasz łatwego sposobu na analizę treści generowanych przez sztuczną inteligencję, sprawdź nasz AI Detector i Humanizer w widżecie poniżej!

Najczęściej zadawane pytania dotyczące wykrywania obrazów generowanych przez sztuczną inteligencję

Jak sprawdzić, czy obraz lub film jest generowany przez sztuczną inteligencję?

Obrazy generowane przez sztuczną inteligencję często mają trudności z tekstem, symetrycznymi obiektami i renderowaniem spójnego tła.

W filmach ludzie mogą poruszać się nienaturalnie, ich głosy mogą nie pasować do ich ust lub części wideo mogą migotać z klatki na klatkę.

Czy na obrazach generowanych przez SI znajdują się znaki wodne?

Tak, niektóre narzędzia sztucznej inteligencji, takie jak Midjourney i OpenAI's DALL-E, ukrywają tajne znaki wodne na swoich zdjęciach.

Czy obrazy generowane przez sztuczną inteligencję mogą być całkowicie niewykrywalne?

Odpowiedź brzmi "nie" od 2025 roku. Zaawansowane modele sztucznej inteligencji tworzą bardzo przekonujące obrazy, ale artefakty techniczne pozostają na tym samym poziomie.

Obecnie technologia może usunąć około 85% rzeczy, które można zauważyć, ale nie może jeszcze uczynić czegoś całkowicie niewidocznym.

Dlaczego niektóre obrazy AI wyglądają hiperrealistycznie?

Najnowsze modele AI tworzą super realistyczne obrazy przy użyciu inteligentnej technologii.

Zostały one przeszkolone na miliardach wysokiej jakości obrazów i nadal są ulepszane dzięki specjalnym aktualizacjom.

Modele te są szczególnie dobre w uchwyceniu stylów fotograficznych, realistycznego oświetlenia i szczegółowych tekstur.

Jaki jest najlepszy wykrywacz AI dla obrazów?

The Detektor obrazu AI od Undetectable AI wykrywa obrazy generowane przez sztuczną inteligencję z dokładnością do 85%.

Wykorzystuje inteligentny, wieloetapowy proces do sprawdzania drobnych szczegółów na obrazach.

Przygląda się wzorom w pikselach, ukrytym danym i drobnym błędom, których inne narzędzia mogą nie zauważyć.

Przemyślenia końcowe: Jak rozpoznać obrazy generowane przez sztuczną inteligencję

To podsumowanie, a zanim zakończymy ten blog, mam do ciebie pytanie.

Dlaczego nasz mózg jest tak łatwo oszukiwany przez obrazy AI?

Odpowiedź leży w ludzkiej psychologii.

Nasze mózgi podążają za "efekt wyższości obrazu".

Zgodnie z tym, obrazy zapadają w pamięć lepiej niż słowa.

Kiedy coś wygląda na prawdziwe i pasuje do tego, w co już wierzymy, nie kwestionujemy tego. Ponadto, często jesteśmy zbyt zajęci, aby dwukrotnie sprawdzić, czy zdjęcie jest prawdziwe, czy fałszywe.

W tym przypadku można szukać wskazówek, które omówiliśmy powyżej. Dziwne dłonie, dziwny tekst i idealna skóra mogą pomóc w wykryciu podróbek AI.

Najważniejszą rzeczą do zapamiętania jest to, że oczy można oszukać. To, że zdjęcie wygląda na prawdziwe, nie oznacza, że takie jest.

Kiedy zobaczysz coś niesamowitego lub szokującego w sieci, poświęć chwilę na zastanowienie się nad tym, zanim udostępnisz lub wydasz jakikolwiek osąd.

Ponieważ sztuczna inteligencja rozwija się z każdym dniem, wszyscy musimy być coraz lepsi w jej wykrywaniu. Czy następnym razem, gdy zobaczysz niesamowite zdjęcie, będziesz super detektywem obrazu i poszukasz wskazówek?