Termenul deepfake a apărut pentru prima dată pe Reddit în 2017, când un utilizator cu același nume de utilizator a început să distribuie videoclipuri modificate care foloseau inteligența artificială pentru a schimba fețele, inițial în conținutul pentru adulți.

În timp ce Reddit a interzis subredditul original, ideea luase deja amploare.

Dar rădăcinile acestei tehnologii merg chiar mai departe.

În 1997, cercetătorii începuseră deja să experimenteze cu editarea video prin învățarea automată.

Primul lor instrument de sincronizare a buzelor, numit Rescriere video ar putea face ca cineva să pară că a spus ceva ce nu a spus.

Din punct de vedere tehnic, nu a fost un deepfake după standardele de astăzi, dar a pus bazele a ceea ce avea să urmeze.

Blogul de astăzi este despre cum funcționează această tehnologie în continuă evoluție, unde apare în viața de zi cu zi și ce riscuri și beneficii aduce cu sine.

Să începem prin a înțelege ce este de fapt un deepfake.

Principalele concluzii:

- Deepfakes sunt media generate de AI care fac oamenii să pară că spun sau fac lucruri pe care de fapt nu le-au făcut niciodată.

- Cu instrumente gratuite și abilități de bază, aproape oricine poate crea acum videoclipuri, imagini sau clipuri audio deepfake convingătoare.

- Deși falsurile profunde pot fi creative sau distractive, ele prezintă și riscuri serioase, cum ar fi înșelăciunile, defăimarea și dezinformarea.

- Puteți depista cele mai multe deepfakes utilizând instrumente de detectare sau urmărind cu atenție inconsecvențele vizuale și comportamentale.

Ce este un Deepfake?

Un deepfake este un conținut media fals, de obicei un videoclip, un clip audio sau o imagine, care a fost modificat cu ajutorul inteligenței artificiale pentru a face o persoană să pară că face sau spune ceva ce nu a făcut de fapt.

Acum, nu confundați acest lucru cu un Photoshop prost sau cu un voiceover sumar.

Este vorba despre manipularea la nivel înalt folosind o tehnologie numită învățare profundă, care este un subset al inteligenței artificiale.

Nu vă mai îngrijorați niciodată că AI vă detectează textele. Undetectable AI Vă poate ajuta:

- Faceți să apară scrisul dvs. asistat de AI asemănătoare omului.

- Bypass toate instrumentele majore de detectare AI cu un singur clic.

- Utilizați AI în siguranță și cu încredere în școală și la locul de muncă.

Aceasta este ceea ce implică termenul "deepfake": învățare profundă și conținut fals.

Scopul unui deepfake este, de obicei, de a crea ceva care pare suficient de real pentru a păcăli oamenii.

Poate că ați văzut acele videoclipuri virale cu celebrități care fac lucruri bizare sau politicieni care fac declarații scandaloase pe care nu le-ar spune niciodată de fapt.

Acestea sunt cazuri clasice de utilizare deepfake. Ceea ce vedeți nu este real, dar tehnologia din spatele său a devenit suficient de bună pentru ca creierul dvs. să nu detecteze imediat falsul, decât dacă sunteți foarte atent.

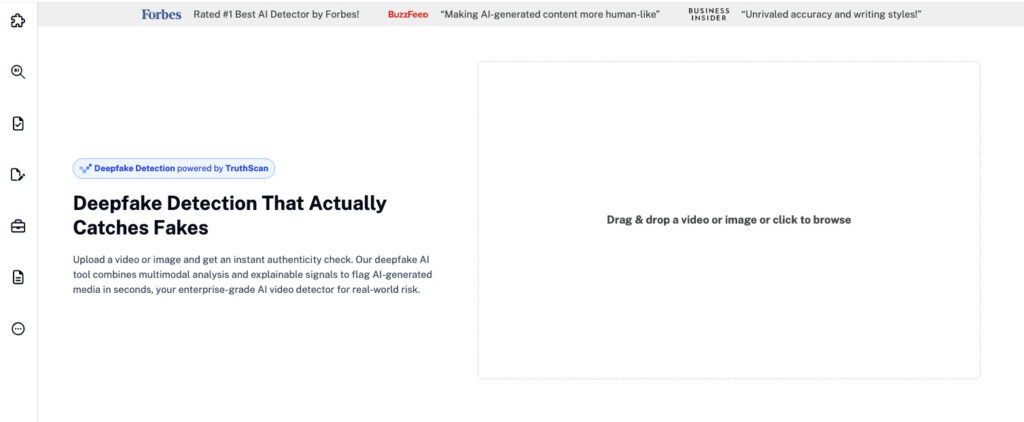

Acesta este locul în care instrumente precum TruthScan pas în.

TruthScan este creat pentru organizațiile care trebuie să verifice media la scară largă - companii, redacții, universități și agenții publice. Ajută echipele să identifice manipularea înainte ca conținutul fals să afecteze încrederea sau reputația.

De fapt, în conformitate cu echipa de cercetare a Undetectable AI, 85 % dintre americani spun că deepfakes le-au erodat încrederea în informațiile online.

Tocmai ați învățat ce este de fapt un videoclip sau un media deepfake, acum aflați cum fac oamenii acest lucru.

Cum sunt realizate Deepfakes

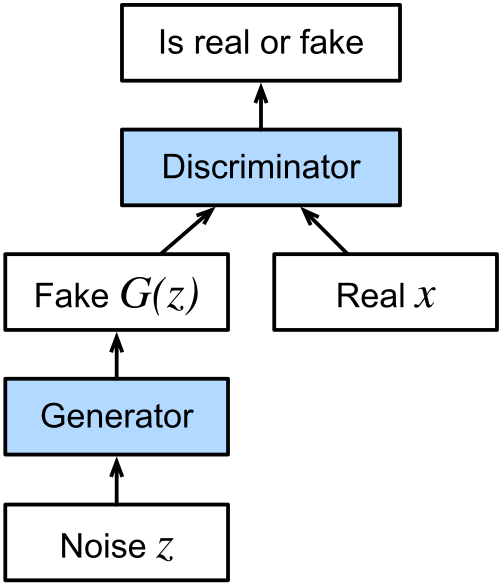

Tehnologia din spatele celor mai multe deepfakes este o categorie de algoritmi de învățare automată numită rețele generative adversariale sau GAN-uri.

GAN-urile sunt alcătuite din două părți: un generator și un discriminator.

Generatorul creează media false pe baza a ceea ce a fost antrenat să reproducă, iar sarcina discriminatorului este de a semnala ceea ce pare fals.

Ei continuă să meargă înainte și înapoi până când generatorul devine mai bun la crearea de conținut fals care poate trece testul discriminatorului.

În timp, acest du-te-vino duce la media care arată șocant de realist.

Ce este un proces de generare video Deepfake?

Atunci când construiește un videoclip deepfake, sistemul analizează videoclipuri din mai multe unghiuri, studiază modul în care persoana vorbește, cum i se mișcă fața, cum i se mișcă corpul.

Toate aceste informații sunt introduse în generator, astfel încât acesta să poată crea conținut care să imite acele comportamente.

Apoi, discriminatorul ajută la ajustarea fină a acestuia, indicând ceea ce nu este în regulă, până când rezultatul final arată exact cum trebuie.

Acesta este motivul pentru care iluzia rezistă atât de bine în mișcare.

Există câteva tehnici diferite utilizate în funcție de scopul videoclipului deepfake.

Dacă ideea este de a face pe cineva să pară că spune sau face ceva într-un videoclip pe care nu l-a spus sau făcut niciodată, atunci avem de-a face cu ceea ce se numește un deepfake video sursă.

Un autoencoder deepfake, format dintr-un codificator și un decodificator, studiază filmarea originală și îi aplică expresiile, gesturile și mișcările subtile ale capului persoanei vizate.

Deepfakes audio

Un deepfake audio funcționează prin clonarea vocii cuiva, folosind din nou GAN-uri, pe baza înregistrărilor cu modul în care persoana vorbește în mod natural.

Odată antrenat, modelul poate genera un nou discurs cu acea voce, chiar dacă persoana nu a spus niciodată acele cuvinte.

Un alt strat adesea adăugat este sincronizarea buzelor.

În acest caz, sistemul mapează sunetul generat sau preînregistrat pe un videoclip.

Scopul este de a face ca buzele din video să se potrivească cu cuvintele din audio.

Exemple reale de Deepfakes

Deepfakes apar peste tot în aceste zile.

Să vă prezentăm câteva deepfakes populare care arată cât de departe a ajuns tehnologia.

Deepfake-ul în care președintele Zelenskyy cere trupelor ucrainene să se predea

În martie 2022, în primele etape ale războiului Rusia-Ucraina, a apărut pe internet un videoclip arată președintele ucrainean Volodymyr Zelenskyy îndemnându-și soldații să se predea.

Arăta ca un discurs național, cu vocea și manierele lui Zelenskyy.

Înregistrarea video s-a răspândit pe platformele de socializare și a fost postată chiar și pe un site de știri ucrainean compromis.

Președintele a acționat rapid și a publicat o declarație oficială prin intermediul canalelor sale verificate pentru a dezminți imaginile.

Imaginea virală Deepfake a Papei Francisc într-o jachetă puffer de designer

Uneori, o imagine deepfake nu trebuie să fie rău intenționată pentru a crea confuzie.

În 2023, o fotografie virală a Papa Francisc se plimbă într-o jachetă albă elegantă Balenciaga a luat internetul cu asalt.

Acesta a adunat zeci de milioane de vizualizări și a fost distribuit pe scară largă pe toate platformele.

Imaginea a fost creată cu ajutorul unui instrument AI numit Midjourney de către un utilizator anonim din Chicago.

Deepfakes ale lui Elon Musk utilizate în escrocherii online

În 2024, deepfakes cu Elon Musk a devenit o parte centrală a mai multor escrocherii online la scară largă.

Pe Facebook, TikTok și alte platforme au început să apară videoclipuri cu Musk generate de inteligența artificială, care promovau cadouri false de criptomonede și scheme de investiții.

Aceste clipuri păreau și sunau remarcabil de reale.

Pagubele nu au fost doar teoretice. Un pensionar în vârstă ar fi pierdut aproape $700.000 după ce a fost convins de unul dintre aceste videoclipuri.

Robocall-ul Joe Biden Deepfake care a vizat alegătorii americani

La începutul anului 2024, chiar înainte de alegerile primare din New Hampshire, alegătorii au primit apeluri automate care a sunat exact ca președintele american Joe Biden.

În apel, Joe Biden îi îndemna pe alegători să rămână acasă și să își păstreze votul pentru alegerile generale din noiembrie. Intenția a fost de a deruta și induce în eroare alegătorii pentru a-i determina să nu participe la alegerile primare.

Incidentul a declanșat apeluri pentru reglementare. Grupurile de advocacy au îndemnat Comisia Electorală Federală a SUA să intervină, dar FEC a refuzat în cele din urmă, invocând limitările autorității sale.

Între timp, compania de telecomunicații responsabilă pentru distribuirea apelului robot a fost de acord să plătească o amendă de $1 milioane.

Utilizarea Deepfake-ului politic în alegerile din India din 2020

Nu toate utilizările tehnologiei deepfake sunt dăunătoare sau au intenții înșelătoare (mai multe detalii pe această temă în continuare pe blog).

În timpul alegerilor pentru Adunarea legislativă din Delhi din 2020, Partidul Bharatiya Janata a folosit inteligența artificială pentru a personaliza un anunț de campanie pentru audiențe lingvistice diferite.

Partidul a preluat o înregistrare video în care liderul său Manoj Tiwari vorbea în limba engleză și a folosit deepfake lip-syncing pentru a produce o versiune în Haryanvi, un dialect regional.

În timp ce vocea a fost dată de un actor, imaginile au fost modificate pentru a se potrivi cu noul sunet, folosind inteligența artificială antrenată pe imagini reale cu Tiwari.

Membrii partidului au considerat că este o aplicație pozitivă a tehnologiei care le permite să intre în contact cu alegătorii într-o limbă pe care o înțeleg, chiar dacă candidatul nu o vorbește fluent.

Cum să verificați Deepfakes în lumea reală

Având în vedere răspândirea deepfake-urilor în politică, divertisment și comunicarea de zi cu zi, nu a fost niciodată mai important ca acum să știm cum să confirmăm ce este real.

În ciuda apariției unor exemple sofisticate, există instrumente fiabile pentru a contracara amenințarea tehnologiei deepfake.

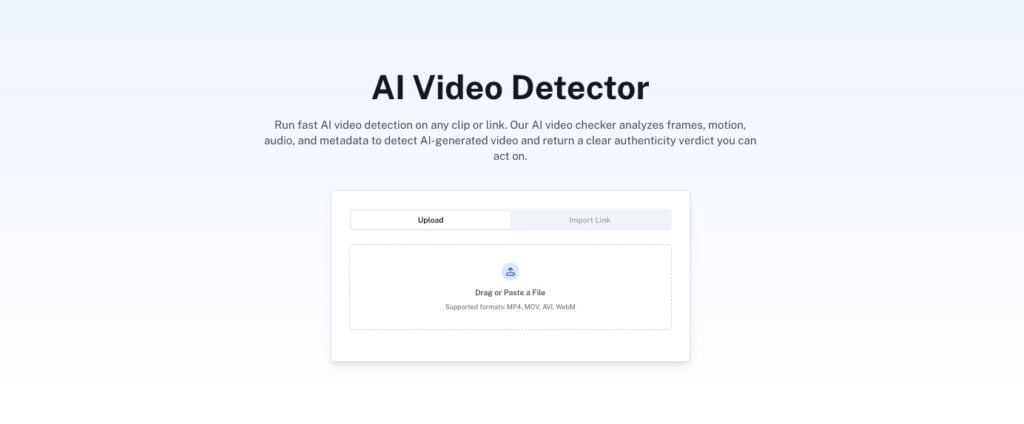

AI nedetectabile Detector video AI este unul dintre aceste instrumente, demonstrând că există instrumente fiabile pentru a contracara exemplele sofisticate ale tehnologiei deepfake.

Aici intervine Undetectable AI. Detectarea Deepfake vine în.

Acesta este conceput pentru a verifica dacă conținutul audio sau video a fost generat artificial, folosind modele criminalistice avansate care analizează mișcarea cadru cu cadru, coerența la nivel de pixel și amprentarea vocală.

În câteva secunde, utilizatorii pot vedea dacă un videoclip a fost alterat digital sau dacă o voce a fost clonată de AI.

Trebuie doar să încărcați fișierul, iar instrumentul oferă un raport de autenticitate detaliat cu o defalcare vizuală și un scor de încredere.

Fie că este vorba de un clip viral, un interviu suspect sau o înregistrare partajată, Deepfake Detection ajută jurnaliștii, educatorii și utilizatorii obișnuiți să descopere adevărul din spatele a ceea ce văd și aud.

Sunt Deepfakes periculoase? Riscuri și îngrijorări

Până acum, am analizat ce este un deepfake, cum este creat și unde a apărut deja în lumea reală.

Tehnologia este incontestabil impresionantă, însă riscurile legate de aceasta sunt serioase și cresc rapid.

Deepfakes pot fi folosite ca arme în mai multe moduri. Iată câteva preocupări principale.

Defăimare

Atunci când asemănarea sau vocea cuiva este folosită pentru a crea remarci, declarații sau videoclipuri false, în special cele care sunt ofensatoare sau controversate, se poate distruge reputația aproape instantaneu.

Și, spre deosebire de farsele mai vechi sau de citatele false, un deepfake convingător lasă puțin loc pentru îndoieli în mintea privitorului.

În acest sens, deepfakes pot stârni indignare, pot distruge relații sau pur și simplu pot promova o poveste dăunătoare.

Ceea ce este deosebit de îngrijorător este faptul că deepfake-ul nici măcar nu trebuie să fie perfect.

Atât timp cât persoana este recunoscută, iar conținutul este suficient de credibil, acesta poate avea un impact de durată asupra opiniei publice.

Credibilitatea informațiilor

O altă preocupare majoră este modul în care deepfakes subminează însăși ideea de adevăr.

Pe măsură ce deepfakes devin din ce în ce mai frecvente, devine din ce în ce mai greu să știm dacă ceea ce vedem sau auzim este real. În timp, acest lucru ar putea duce la o erodare mai largă a încrederii în orice formă de comunicare digitală.

Această criză de credibilitate merge dincolo de incidentele individuale.

În societățile democratice, oamenii se bazează pe fapte comune pentru a lua decizii, a dezbate probleme și a rezolva probleme colective.

Dar dacă alegătorii, telespectatorii sau cetățenii încep să pună totul la îndoială, devine mult mai ușor să manipulezi opinia publică sau să respingi adevărurile incomode ca fiind "doar un alt deepfake".

Șantaj

Mass-media generată de inteligența artificială poate fi utilizată pentru a incrimina în mod fals persoane, făcând să pară că acestea au făcut ceva ilegal, lipsit de etică sau jenant.

Acest tip de dovezi fabricate poate fi apoi folosit pentru a-i amenința sau controla.

Și este valabil în ambele sensuri. Deoarece deepfakes sunt acum atât de realiste, cineva care se confruntă cu un șantaj real ar putea pretinde că dovada este falsă, chiar dacă nu este.

Acest lucru este uneori denumit inflație de șantaj, în care volumul mare de falsuri credibile ajunge să reducă valoarea materialului incriminator real.

Credibilitatea dovezilor reale se pierde în ceață, iar acest lucru nu face decât să adauge un alt nivel de complexitate atunci când se încearcă demascarea faptelor ilicite.

Fraude și escrocherii

Folosind videoclipuri generate de inteligența artificială sau vocile unor persoane publice de încredere, escrocii creează scheme incredibil de convingătoare.

În unele cazuri, deepfakes ale unor celebrități precum Elon Musk, Tom Hanks sau Oprah Winfrey sunt folosite pentru a susține produse sau servicii de care acestea nu au auzit niciodată.

Aceste videoclipuri sunt apoi difuzate pe platformele sociale, unde ajung la milioane de persoane.

Chiar și persoanele fizice sunt expuse riscului, în special în campaniile de spearphishing care vizează anumite persoane cu conținut personalizat conceput pentru a manipula sau înșela.

Potrivit unui 2024 raportul Forbes, frauda provocată de deepfake a adunat deja pierderi globale estimate la $12 miliarde, iar această cifră este de așteptat să se tripleze în următorii câțiva ani.

Acesta este motivul pentru care detectarea nu este doar pentru persoane fizice. Este esențială pentru companiile care gestionează date sensibile, comunicații sau conținut public. TruthScan ajută aceste organizații să identifice videoclipurile alterate înainte ca dezinformarea să se răspândească.

Utilizări pozitive și creative ale Deepfakes

Este demn de remarcat faptul că nu toate aplicațiile tehnologiei sunt negative.

În timp ce multe bloguri care explică ce este un deepfake se concentrează pe utilizarea abuzivă, există o listă din ce în ce mai mare de moduri creative și productive în care sunt utilizate deepfakes.

Totuși, pentru întreprinderi, chiar și utilizările artistice sau de marketing ale deepfakes ar trebui să fie verificate pentru autenticitate înainte de publicare.

Instrumente precum TruthScan pot confirma că în versiunea finală nu a rămas nicio manipulare neintenționată.

Mai jos sunt prezentate câteva exemple notabile.

Film și performanțe actoricești

Studiourile încep să se bazeze pe tehnologia deepfake pentru lucruri precum:

- Îmbunătățirea efectelor vizuale

- Reducerea costurilor de producție

- Aducerea înapoi a personajelor care nu mai există

Disneyde exemplu, a rafinat modele deepfake de înaltă rezoluție care permit schimbarea feței și îmbătrânirea actorilor cu un realism impresionant.

Tehnologia lor funcționează la o rezoluție de 1024 x 1024 și poate urmări cu acuratețe expresiile faciale pentru a face personajele să pară mai tinere sau mai expresive.

Dincolo de Hollywood, deepfakes au permis desfășurarea unor campanii globale, cum ar fi atunci când David Beckham a fost clonat digital pentru a transmite un mesaj de sănătate în mai multe limbi.

Artă

În 2018, artistul multimedia Joseph Ayerle a folosit tehnologia deepfake pentru a crea un actor AI care îmbina chipul starului italian de cinema Ornella Muti cu corpul lui Kendall Jenner.

Rezultatul a fost o explorare suprarealistă a identității generaționale și a provocării artistice, parte a unei lucrări de artă video intitulată Un'emozione per sempre 2.0.

Deepfakes au apărut și în satiră și parodie.

Serialul web Sassy Justice din 2020, creat de creatorii South Park Trey Parker și Matt Stone, este un prim exemplu.

Acesta a folosit figuri publice "deepfaked" pentru a face mișto de evenimentele actuale, sensibilizând în același timp publicul cu privire la tehnologia în sine.

Serviciul Clienți

În afara industriilor creative, întreprinderile găsesc utilitatea deepfakes pentru serviciile de contact cu clienții.

Unele centre de apel utilizează acum voci sintetice bazate pe tehnologia deepfake pentru a automatiza solicitările de bază, cum ar fi solicitările de cont sau înregistrarea plângerilor.

În aceste cazuri, intenția nu este răuvoitoare, ci pur și simplu de eficientizare.

Sistemele de răspuns la apelare pot fi personalizate folosind voci generate de inteligența artificială pentru ca serviciile automate să sune mai natural și mai atractiv.

Deoarece sarcinile gestionate sunt, de obicei, cu risc scăzut și repetitive, în acest context, deepfakes contribuie la reducerea costurilor și eliberează agenți umani pentru probleme mai complexe.

Educație

Platformele educaționale au început, de asemenea, să încorporeze tutori alimentați de deepfake pentru a asista cursanții în moduri mai interactive.

Acești tutori AI-driven pot oferi lecții folosind voci sintetice și îndrumare personalizată.

Instrumente și tehnici de detectare Deepfake

Pe măsură ce deepfakes devin din ce în ce mai avansate și mai accesibile, crește și nevoia de a le identifica înainte ca acestea să producă daune.

De asemenea, oamenii și organizațiile au nevoie de instrumentele și tehnicile potrivite pentru a rămâne cu un pas înainte. Iată așadar câteva instrumente și tehnici.

Pentru verificarea focalizată pe imagine, Detectorul de imagini AI al TruthScan analizează iluminarea, modelele de pixeli și elementele compuse pentru a semnala în timp real elementele vizuale generate sau editate de AI.

Aceasta ajută echipele să confirme rapid autenticitatea imaginilor și a cadrelor video înainte ca conținutul să fie publicat sau partajat.

TruthScan: Detecție Deepfake de nivel enterprise

TruthScan este conceput pentru întreprinderi, universități și organizații media care au nevoie de verificarea pe scară largă a conținutului vizual și audio.

Acesta analizează autenticitatea video pe mai multe dimensiuni:

- Detectarea schimbării feței: Identifică trăsăturile faciale manipulate cadru cu cadru.

- Amprentarea comportamentală: Detectează modele subtile de expresie și micromișcări incompatibile cu comportamentul uman natural.

- Criminalistică video: Examinează compresia cadrelor, zgomotul pixelilor și falsificarea vocii.

- Detecție în timp real: Permite verificarea live în timpul apelurilor video, comunicatelor de presă sau transmisiunilor.

Cu TruthScan, echipele pot autentifica videoclipurile înainte de publicare sau distribuire publică, prevenind daunele financiare și de reputație.

Pentru utilizatorii obișnuiți, instrumentele Undetectable AI oferă o protecție similară la nivel individual.

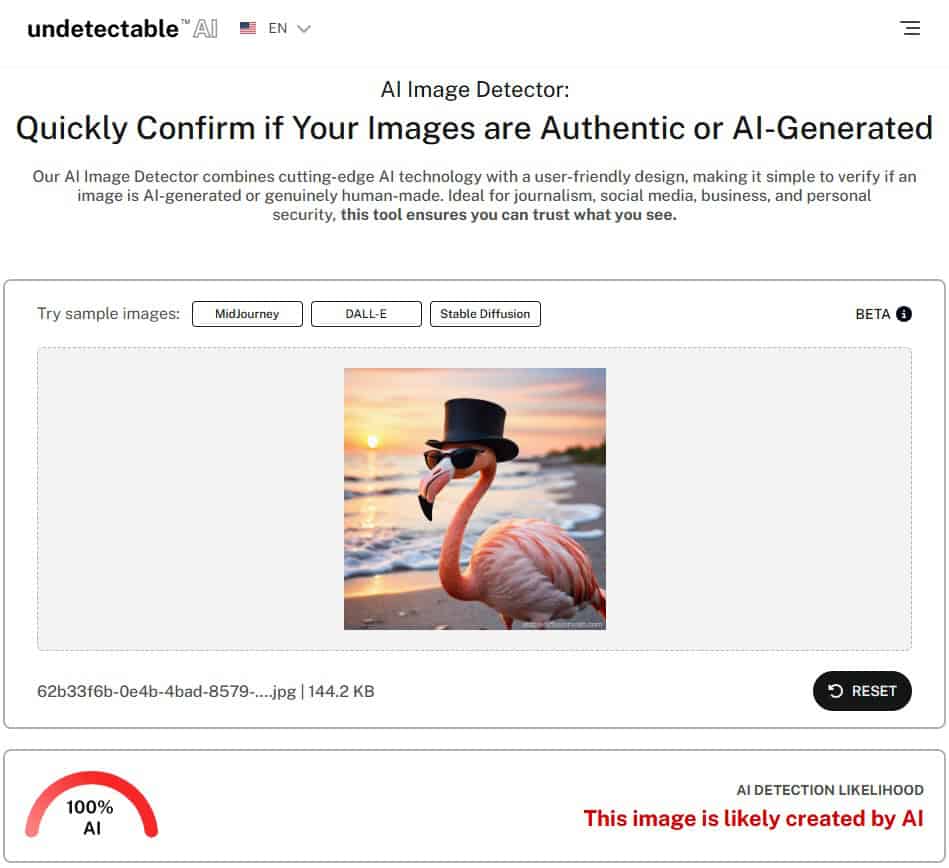

Detector de imagini AI de către AI nedetectabil

Detectorul de imagini AI de la Undetectable AI face detectarea deepfake mai ușoară, chiar și pentru cei fără cunoștințe tehnice.

Detectorul funcționează prin analizarea diferitelor elemente dintr-o imagine încărcată, cum ar fi modelele de culoare, texturile, trăsăturile faciale și neconcordanțele structurale.

Suportă detectarea mediilor create utilizând cele mai cunoscute generatoare de imagini AI, cum ar fi

- Mijlocul călătoriei

- DALL-E

- Difuzie stabilă

- Ideogramă

- Modele bazate pe GAN

Pentru a-l utiliza, pur și simplu încărcați o imagine, lăsați instrumentul să o analizeze și primiți un verdict clar cu un scor de încredere.

Dacă nu sunteți sigur dacă o imagine pe care ați găsit-o este autentică, încercați pagina noastră Detector de imagini AI pentru a verifica dacă există semne de manipulare a AI.

Acum, să punem Detectorul AI al lui Undetectable la test și să vedem dacă poate spune cu exactitate că imaginea este generată de AI.

După cum puteți vedea, detectorul AI de imagini de la Undetectable AI a marcat această imagine ca fiind 100% generată de AI.

Tehnici vizuale și comportamentale pentru detectarea manuală

Există, de asemenea, tehnici practice pe care persoanele fizice le pot utiliza pentru a detecta manual deepfakes, în special în situațiile în care este necesară o analiză imediată.

Unele semnale vizuale de avertizare includ:

- Poziționare facială ciudată sau expresii ciudate.

- Iluminare sau colorare inconsecventă în diferite părți ale imaginii sau videoclipului.

- Pâlpâire în jurul feței sau al liniei părului, în special în timpul mișcării.

- Lipsa clipitului natural sau mișcarea neregulată a ochilor.

- Discrepanțe în sincronizarea buzelor atunci când sunetul nu se potrivește cu discursul.

Din punct de vedere comportamental, deepfakes se străduiesc adesea să imite trăsături umane subtile. Acordați atenție limbajului corpului, expresiilor emoționale și gesturilor obișnuite.

Iar în conversațiile în timp real, în special în videoclipurile live, cereți o vedere din profil.

Multe modele deepfake încă se luptă să redea cu acuratețe un unghi facial de 90 de grade sau mișcări complexe precum întoarcerea capului, menținând în același timp expresii naturale.

Identificarea falsurilor profunde în text și context

Deepfakes nu se limitează la imagini. Unele versiuni implică text sintetic, voce sau comportament care imită stilul de comunicare al cuiva.

Atunci când analizați conținutul textual sau dialogul, fiți atenți la:

- Greșeli de ortografie și gramatică ciudată.

- Propoziții care par forțate sau care nu curg natural.

- Adrese de e-mail neobișnuite sau formulări inconsecvente.

- Mesaje care par ieșite din context sau care nu au legătură cu situația.

Contextul contează, de asemenea. Dacă un videoclip sau un mesaj apare într-un cadru care nu are sens, cum ar fi un politician care anunță întâmplător o decizie majoră într-un clip de calitate scăzută, merită să puneți la îndoială autenticitatea acestuia.

Sunteți curioși cu privire la AI Detector și Humanizer? Încercați-le în widget-ul de mai jos!

Întrebări frecvente despre Deepfakes

Sunt deepfakes ilegale?

Deepfakes nu sunt ilegale în mod implicit, dar pot fi dacă încalcă legile existente, cum ar fi cele care reglementează defăimarea, pornografia infantilă sau conținutul explicit fără consimțământ.

Unele state americane au adoptat legi care vizează deepfakes care influențează alegerile sau implică pornografie din răzbunare.

Facturi federale precum Legea DEFIANCE și NO FAKES Act sunt, de asemenea, în curs de desfășurare pentru a reglementa utilizările malițioase ale tehnologiei deepfake.

Poate cineva să facă un deepfake?

Da, aproape oricine poate face un deepfake folosind software și instrumente de inteligență artificială gratuite sau la prețuri reduse.

Multe platforme oferă acum interfețe ușor de utilizat, astfel încât nu sunt necesare competențe tehnice avansate pentru a începe.

Cum mă pot proteja de deepfakes?

Limitează-ți expunerea evitând să postezi online imagini sau clipuri video de înaltă rezoluție. Utilizați setările de confidențialitate și instrumente de detectare precum AI nedetectabil sau TruthScan pentru a verifica de două ori orice lucru suspect.

Există aplicații de detectare deepfake?

Da, TruthScan este conceput pentru utilizatorii de afaceri care trebuie să analizeze conținutul video la scară largă, în timp ce detectoarele Undetectable AI sunt destinate persoanelor fizice și creatorilor care doresc să verifice volume mai mici de conținut.

Gânduri finale

Deepfakes remodelează modul în care vedem adevărul online. Fie că vă protejați marca, gestionați comunicarea publică sau pur și simplu navigați în siguranță, utilizarea instrumentelor de detectare potrivite face diferența.

Pentru întreprinderi și instituții, TruthScan oferă protecție la nivel de întreprindere împotriva dezinformării generate de AI.

Pentru persoane fizice, AI nedetectabile Detector de imagini AI oferă o modalitate simplă și rapidă de a verifica imaginile și de a rămâne informat.

Împreună, ei contribuie la asigurarea faptului că ceea ce vedeți și împărtășiți rămâne real.