Är AI-innehållsdetektering alltid korrekt? Hur exakt fungerar det? Det här är frågor som alla, från studenter till företagare, bör ha svar på år 2026.

Den senaste tidens framsteg inom artificiell intelligens har lett till skapandet av otroligt realistiskt AI-genererat innehåll som suddar ut gränsen mellan maskin och människa.

Detta har öppnat upp för nya möjligheter inom olika branscher, men innebär också en enorm utmaning när det gäller att skilja mellan innehåll som genererats av människor och innehåll som genererats av AI.

Som en branschledande produkt har Undetectable AI bevisat att maskinskriven text faktiskt kan vara praktiskt taget omöjlig att skilja från mänsklig prosa.

I den här guiden kommer vi att undersöka identifieringsprocessen och utforska tekniker, detektorverktyg och framtiden för innehållsautenticitet.

Låt oss dyka in.

Viktiga slutsatser

- AI-detektering är probabilistisk snarare än definitiv, vilket innebär att verktyg beräknar sannolikheten för ett maskinursprung baserat på matematiska mönster.

- Noggrannheten är fortfarande ett stort hinder för branschen eftersom falska positiva resultat ofta pekar ut personer som inte har engelska som modersmål eller mycket formella mänskliga skribenter.

- Hybridstrategier är de mest effektiva för att identifiera syntetisk text och kombinerar automatiserad programvara med mänsklig redaktionell tillsyn och faktagranskning.

- Kapprustningen mellan AI och detektering är konstant eftersom generativa modeller utvecklas för att efterlikna mänskliga “brister” mer effektivt varje dag.

- Öppenhet blir allt viktigare än kontroll eftersom många organisationer nu fokuserar på innehållets kvalitet och användbarhet snarare än dess tekniska ursprung.

Vad är AI-innehållsdetektering och varför är det viktigt?

AI-innehållsdetektering är en process där specialiserad programvara används för att analysera text och avgöra om den har producerats av en stor språkmodell (LLM) som ChatGPT eller Claude.

Detta är viktigt eftersom det berör kärnan i digitalt förtroende.

Inom utbildning bidrar det till att upprätthålla den akademiska integriteten, inom journalistik säkerställer det att rapporteringen baseras på mänskliga observationer och inom sökmotoroptimering hjälper det plattformar att identifiera skräppost som inte kräver någon större ansträngning.

Oroa dig aldrig för att AI upptäcker dina texter igen. Undetectable AI Kan hjälpa dig:

- Få din AI-assisterade skrivning att synas människoliknande.

- Bypass alla större AI-detekteringsverktyg med bara ett klick.

- Användning AI säkert och självsäkert i skolan och på jobbet.

I takt med att vi närmar oss 2026 har förmågan att identifiera syntetiskt innehåll blivit en säkerhetsfråga.

Från deepfake-artiklar till automatiserade kampanjer för felaktig information - att känna till källan till information är avgörande för ett fungerande samhälle.

Detekteringsverktyg fungerar som en första försvarslinje och hjälper användarna att verifiera att den “röst” de lyssnar på stöds av mänsklig erfarenhet och ansvarstagande.

Hur AI-verktyg för innehållsdetektering faktiskt fungerar

För att förstå hur en detektor flaggar en mening måste du inse att dessa verktyg inte “läser” efter innebörd som en person gör. Istället utför de en djupgående statistisk analys av textens struktur.

Mönsterigenkänning och förutsägbarhet

AI-modellerna är utformade för att förutsäga det mest sannolika nästa ordet i en sekvens. Detta leder till en hög nivå av matematisk “jämnhet” i texten.

Detektorer letar efter denna brist på friktion; om varje ord är det statistiskt sett mest sannolika valet identifierar verktyget det som ett maskingenererat mönster.

Perplexitet och burstiness förklaras enkelt

Perplexitet mäter hur “överraskande” texten är för en modell. Mänskligt skrivande har ofta hög perplexitet eftersom vi gör oväntade ordval.

Burstiness avser variationen i meningslängd och struktur. Människor skriver i intervaller - en lång, blommig mening följs av en kort, slagkraftig mening. AI tenderar att vara mycket enhetligt, vilket skapar ett platt, rytmiskt “hum” som detektorer snabbt identifierar.

Språkmodellering av signaler

Detektorer använder ofta en “spegelversion” av den AI som de försöker fånga.

Genom att köra en passage genom en detektionsmodell kan programvaran se om texten stämmer perfekt överens med sannolikhetskartorna för en generator. Om texten följer exakt den väg som en maskin skulle ta, utlöser den en hög detektionspoäng.

Klassifikatorer för maskininlärning bakom detektering

De flesta moderna verktyg använder “klassificerare” som har tränats på miljontals exempel på både mänsklig och AI-text. Dessa klassificerare lär sig att upptäcka de små, osynliga skillnaderna i hur människor och maskiner använder funktionsord som “the”, “it” eller “is”.”

Med tiden blir dessa modeller mycket känsliga för den subtila “styvheten” hos syntetisk prosa.

Varför detektionsresultat är sannolikheter, inte säkerheter

Det är viktigt att förstå att en AI-detektor inte ger ett “ja” eller “nej”-svar. Istället ger den en sannolikhetspoäng, till exempel “85% är sannolikt AI”.”

Eftersom mänskligt skrivande ibland kan vara förutsägbart och formellt, och AI-skrivande kan anpassas till att vara kaotiskt, kan dessa verktyg bara erbjuda en kvalificerad gissning baserad på aktuella data.

Vanliga tecken på AI-genererat innehåll

Även om programvara är till stor hjälp kan det mänskliga ögat ofta upptäcka “avslöjande” tecken på maskinens ursprung om du vet vad du ska leta efter.

- Överdrivet polerat men generiskt språk: AI skriver ofta på ett sätt som är grammatiskt perfekt men som helt saknar personlighet eller unik “smak”.”

- Upprepade meningsuppbyggnader: Maskiner börjar ofta flera meningar i rad med samma ord eller använder exakt samma längd för varje mening i ett stycke.

- Avsaknad av personlig erfarenhet eller specifika detaljer: En AI kan beskriva ett koncept, men den kan inte dela med sig av en specifik anekdot om ett misstag den gjort eller en unik sensorisk detalj från en verklig händelse.

- Förutsägbart styckeflöde: AI-genererat innehåll följer vanligtvis ett mycket strikt “Introduktion, Punkt A, Punkt B, Punkt C, Slutsats”-format utan den organiska vandringen i den mänskliga tanken.

- Vaga övergångar och säkra slutsatser: Leta efter fraser som “Sammanfattningsvis”, “Det är viktigt att notera” eller “Dessutom” som används på ett mekaniskt sätt som inte tillför något verkligt värde till berättelsen.

De mest populära verktygen för AI-innehållsdetektering idag

Flera verktyg har seglat upp som ledande på området, och vart och ett av dem erbjuder olika styrkor för olika typer av användare.

Odetekterbar AI

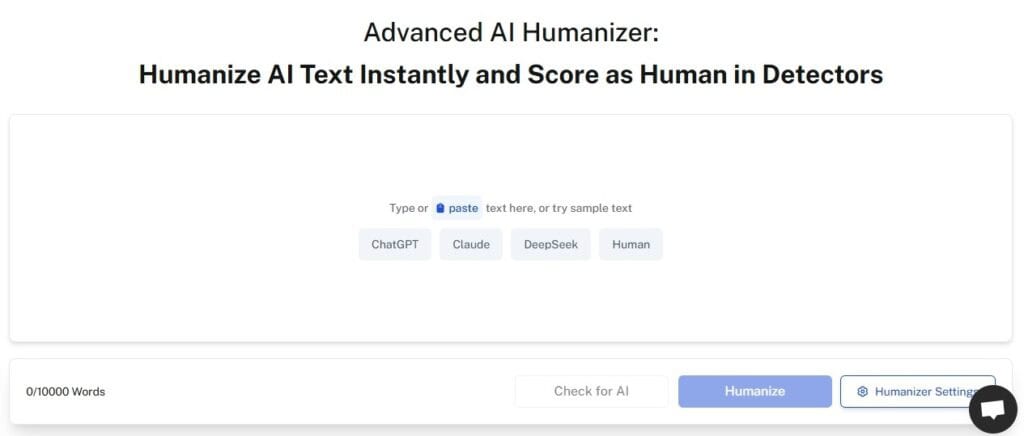

Odetekterbar AI är unikt eftersom det erbjuder ett tillvägagångssätt med flera modeller. I stället för att förlita sig på en enda algoritm kombinerar den kostnadsfria detektorn logiken i över sju olika detektionsmodeller i ett enda gränssnitt.

Detta ger användarna en mer “bred” bild av hur deras text kan uppfattas av olika system på webben.

Turnitin AI-detektering

Vänditin är den dominerande kraften i den akademiska världen. Dess verktyg är särskilt anpassat för att hitta AI i studentuppsatser och forskningsrapporter.

Det används i stor utsträckning av universitet världen över, även om det har fått kritik för att det ibland flaggar för att mänskligt originalarbete är maskingenererat.

GPTZero

GPTZero skapades ursprungligen som ett examensarbete vid Princeton och var ett av de första verktygen som blev allmänt populärt. Det är känt för sina poäng “Perplexity” och “Burstiness”, som hjälper användarna att se de exakta matematiska orsakerna till att en text känns “robotaktig”.”

Copyleaks

Copyleaks föredras av företag och organisationer på grund av dess höga noggrannhet och dess förmåga att upptäcka “parafraserad” plagiering. Det är särskilt effektivt när det gäller att identifiera när någon har tagit AI-text och gjort mindre manuella ändringar för att försöka dölja den.

Originalitet.ai

Det här verktyget marknadsförs främst mot webbpublicister och SEO-proffs. Det är utformat för att vara mycket känsligt och flaggar ofta även små mängder AI-hjälp. Det är en favorit för dem som behöver säkerställa att det innehåll de köper från frilansare är 100% mänskligt författat.

Noggrannhetsproblemet: Kan AI-innehållsdetektering vara tillförlitlig?

Den mest kontroversiella aspekten av branschen är frågan om tillförlitlighet. Även om detektionsverktygen blir allt bättre är de långt ifrån perfekta, och deras fel kan få konsekvenser i den verkliga världen.

Falska positiva resultat på mänsklig skrift

Ett “falskt positivt” resultat uppstår när ett verktyg felaktigt identifierar mänsklig skrift som AI. Detta händer ofta med mycket strukturerade texter, t.ex. juridiska dokument, vetenskapliga rapporter eller till och med Bibeln. Detta har lett till många fall där studenter felaktigt har anklagats för fusk.

Falska negativ på AI-innehåll

Ett “falskt negativt” resultat uppstår när AI-genererad text uppfattas som mänsklig.

Med verktyg som Undetectable AI:s AI Humanizer, är det nu möjligt att skriva om maskintext så att den efterliknar komplexiteten och slumpmässigheten i mänsklig prosa, vilket effektivt kringgår nästan alla nuvarande detektorer.

Fördomar mot skribenter som inte har engelska som modersmål

Forskning har visat att AI-detektorer är mer benägna att flagga för texter skrivna av personer som inte har engelska som modersmål.

Eftersom dessa skribenter ofta använder en mer formell och mindre varierad vokabulär speglar deras arbete naturligt de statistiska mönster som detektorerna letar efter, vilket leder till orättvisa fördomar i akademiska och professionella sammanhang.

Vem använder AI-innehållsdetektering (och varför)

Användningen av dessa verktyg är utbredd, men motiven varierar beroende på bransch.

| Användargrupp | Primärt mål | Varför resultaten ofta varierar |

| Utbildningsinstitutioner | Förebygga akademisk oärlighet och fusk. | Akademiskt skrivande är naturligt formellt, vilket förvirrar många grundläggande detektorer. |

| Team för innehållsmarknadsföring | Se till att innehållet är “användbart” och rankas bra i sökningar. | Olika verktyg prioriterar olika SEO-signaler och sökordstätheter. |

| Utgivare och media | Behåll varumärkets auktoritet och den mänskliga rösten. | Journalistik använder ofta korta, slagkraftiga meningar som kan se ut som “low burstiness” för AI. |

| Rekryterare | Filtrera bort massproducerade, AI-skrivna personliga brev. | Professionella CV:n använder standardiserade mallar som maskinerna efterliknar perfekt. |

Hur odetekterbar AI hjälper till att förbättra mänsklig skrivning

Detektering är den ena sidan av myntet, men den andra är “humanisering”. Undetectable AI tillhandahåller en rad verktyg som hjälper skribenter att använda AI på ett ansvarsfullt sätt och samtidigt säkerställa att slutresultatet känns autentiskt.

Minska antalet förutsägbara AI-mönster

Programvaran analyserar ditt utkast och identifierar de “maskinliknande” sekvenser som normalt skulle utlösa en flagga. Därefter ordnas och omformuleras dessa avsnitt på ett intelligent sätt för att skapa ett mer naturligt flöde.

Förbättrar naturligt flöde och röst

Genom att använda AI Humanizer, kan skribenter tillföra den “spänst” och språkliga variation som maskiner vanligtvis saknar. Resultatet blir en text som inte bara är “omöjlig att upptäcka”, utan som också är mer engagerande för den mänskliga läsaren.

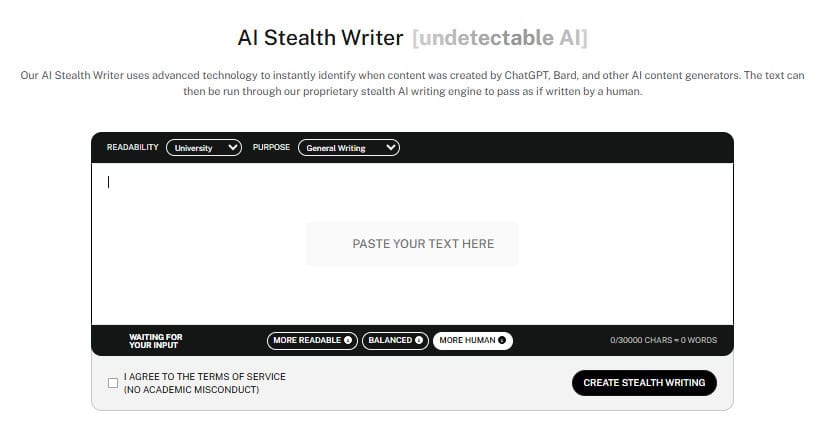

Förfining av ton och variation i meningarna

Vår AI Stealth-författare ger användarna möjlighet att välja mellan olika “Human”-nivåer, från gymnasienivå till universitets- eller yrkesnivå.

Detta säkerställer att tonen förblir konsekvent med den avsedda målgruppen och förhindrar den “tonala whiplash” som uppstår när rå AI försöker låta för smart.

Stöd för ansvarsfull användning av AI

Målet är inte att vilseleda, utan att förbättra. Genom att tillhandahålla en AI-innehållsdetektor Förutom humaniseringsverktyg uppmuntrar Undetectable AI skribenter att kontrollera sitt arbete, ange sina källor och se till att deras slutliga inlämning är en sann återspegling av deras egna idéer och redigering.

Framtiden för AI-innehållsdetektering

När vi blickar mot 2027 och framåt kommer kampen mellan generation och upptäckt att fortsätta att omforma hur vi interagerar med information online.

- Den pågående kapprustningen mellan AI och detektering: Varje gång en detektor blir smartare blir generatorerna bättre på att efterlikna mänskligt “brus”. Denna cykel kommer sannolikt att fortsätta tills vi når en punkt med “perfekt paritet”.”

- Smartare detekteringsalgoritmer: Framtida verktyg kommer sannolikt att titta på tekniker för “metadata” och “fingeravtryck”, t.ex. dolda vattenstämplar som bäddas in av de företag som skapar AI-modellerna.

- Skiftet mot transparens i stället för polisarbete: Många experter menar att vi så småningom kommer att sluta försöka “fånga” AI och istället fokusera på verifierbara “human-in-the-loop”-arbetsflöden.

- Varför skrivkunskaper fortfarande är viktiga: Även i en värld full av AI är förmågan att redigera, faktagranska och ge ett unikt mänskligt perspektiv den mest värdefulla färdighet en skribent kan besitta.

Prova vår AI Detector och Humanizer i widgeten nedan!

Vanliga frågor

Är AI-innehållsdetektering alltid korrekt?

Nej, det är probabilistiskt. Falska positiva resultat är vanligt förekommande, särskilt när det gäller formella texter eller texter som inte är skrivna på modersmålsengelska. Du bör alltid använda detekteringsresultat som en utgångspunkt för utredning snarare än en slutlig bedömning.

Kan Google straffa mig för AI-genererat innehåll?

Enligt Google Sökcentral, fokuserar Google på innehållets kvalitet och användbarhet. Om ditt AI-innehåll är ohjälpsamt eller skapat enbart för att manipulera rankningar kommer det att straffas, oavsett om det har skrivits av en maskin eller inte.

Hur gör jag mitt AI-innehåll omöjligt att upptäcka?

Det mest effektiva sättet är att använda ett humaniseringsverktyg som Undetectable AI, som omstrukturerar texten så att den matchar mänskliga språkmönster. De bästa resultaten får du dock alltid genom att lägga till dina egna personliga berättelser och unika insikter manuellt.

Fångar Turnitin upp allt AI-innehåll?

Turnitin är mycket avancerat men kan fortfarande kringgås genom sofistikerad omskrivning och humanisering. Det används bäst av lärare för att leta efter allmänna mönster av inkonsekvens i en elevs arbete över tid.

Slutsats

I takt med att artificiell intelligens blir en permanent del av våra kreativa och professionella liv är det viktigt att förstå hur man upptäcker AI-innehåll för att upprätthålla integritet och förtroende.

Även om detekteringsverktyg ger en värdefull inblick i en texts matematiska ursprung är de inte ofelbara domare.

De mest framgångsrika kreatörerna år 2026 är de som använder dessa verktyg på ett ansvarsfullt sätt och kombinerar AI:s effektivitet med den mänskliga röstens oersättliga värme och nyansrikedom.

Genom att hålla dig informerad och använda en flerskiktad metod för verifiering kan du navigera på den moderna webben med tillförsikt.

Autenticitet är den mest värdefulla valutan i automatiseringens tidevarv. Se till att din röst hörs, inte bara dina uppmaningar.

Är du redo att säkerställa att dina texter är både högkvalitativa och autentiska? Utforska Odetekterbar AI för att göra dina utkast mer mänskliga och behålla din professionella framtoning.