随着像 ChatGPT 这样的人工智能工具变得越来越复杂和易用,教育领域出现了一个紧迫的问题:

高校能否可靠地检测到 ChatGPT 生成的内容?

在本文中,我们将探讨机构如何应对生成式人工智能的兴起,以及 2025 年正在使用哪些检测方法。

他们面临的挑战,以及学生如何在不影响学术诚信的前提下负责任地使用人工智能。

主要收获

- 高校可以检测 ChatGPT,但并非完全准确。Turnitin 和 Copyleaks 等工具很常用,但仍会产生误报和漏报。

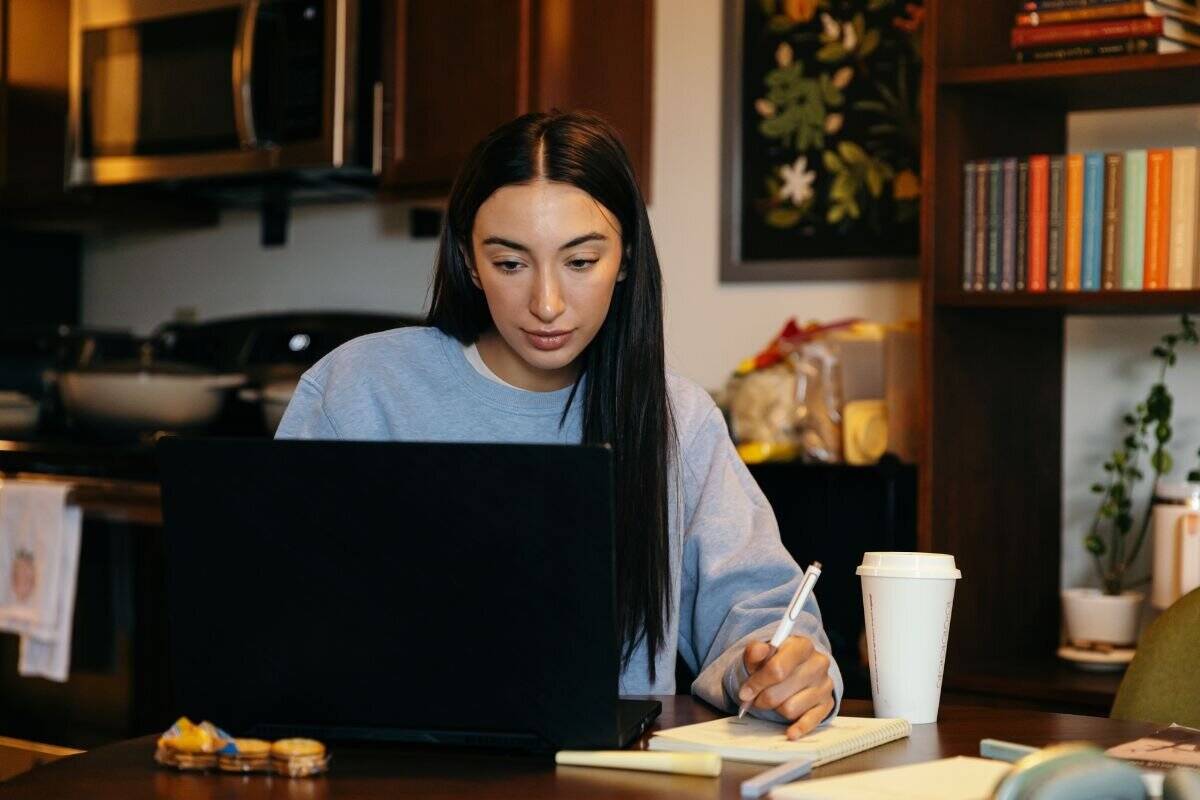

- 人工审核和文体测量分析是评估学生先前作品与新提交作品之间不一致的关键。

- 检测依赖于语言、统计和上下文模式,但先进的人工智能输出往往可以绕过肤浅的分析。

- 教育工作者正在更新政策,采用口试、实时写作任务和人工智能感知评估,以减少对检测工具的依赖。

- 合乎道德地使用人工智能是可能的,尤其是在透明度、学术诚信和 "无法检测的人工智能 "等工具的指导下。

2025 年能检测到 ChatGPT 吗?

ChatGPT 和其他大型语言模型在生成自然、连贯和类人文本方面的能力有了显著提高。

这一进步在释放强大教育潜力的同时,也给寻求保持学生作品完整性的学术机构带来了新的挑战。

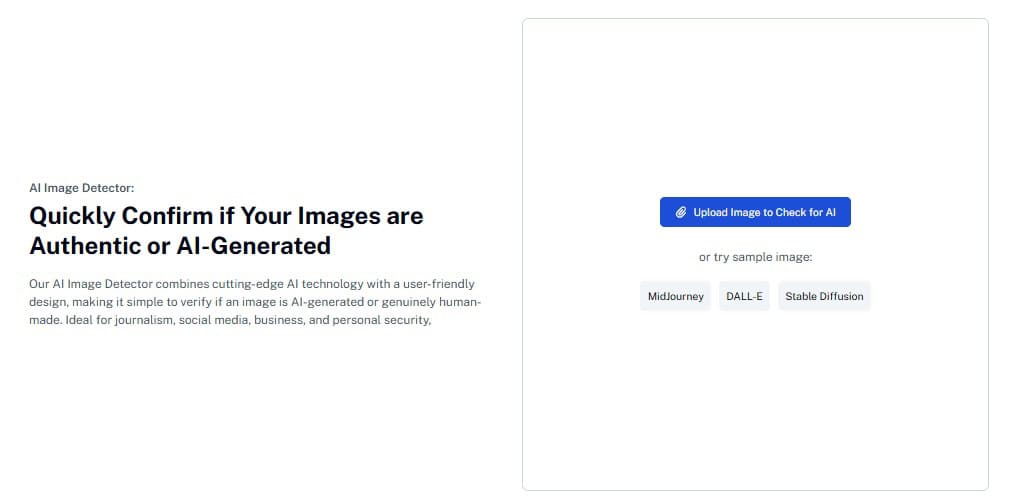

大多数人工智能探测器使用d 由高校提供-包括 Turnitin 的人工智能检测功能在内,都依赖于 语言模式, 迷茫和 爆裂感 来标记人工智能生成的文字。

再也不用担心人工智能检测到你的短信了 Undetectable AI 可以帮助您:

- 让人工智能辅助写作显现出来 像人一样

- 旁路 只需点击一下,就能使用所有主要的人工智能检测工具。

- 使用 人工智能 安全地 和 自信地 在学校和工作中。

然而,这些系统并非无懈可击。许多学生会编辑人工智能的输出结果,或使用先进工具对其进行人性化处理,以绕过检测。

生成式人工智能和人工智能检测器之间的军备竞赛让大学在公平性、学术诚信和不断变化的学生需求之间走钢丝。

高等教育中常见的检测方法

1.造型测量

文体测量法检查学生以往提交的材料中独特的写作风格--分析语法、标点符号、句子结构和词汇。

音调或复杂程度的急剧偏差往往是使用人工智能的信号。如果教育工作者有学生以前的作品集可供比较,这种方法就特别有效。

2.统计模式分析

人工智能生成的内容往往在句子长度、格式或结构方面表现出不自然的一致性。

Turnitin 等检测器会根据已知的人类写作模式扫描异常内容。然而,经过高度编辑的人工智能内容可能会绕过此类分析。

3.语境和语义分析

语境分析不只是对语法进行表面分析,而是对以下方面进行评估 深度、相关性和连贯性.

人工智能工具可能会生成 "听起来正确 "的内容,但缺乏有见地的分析或与课程材料的联系。

4.机器学习检测

一些机构利用人工智能对抗人工智能--根据成千上万篇论文样本训练机器学习模型,以区分人类和机器生成的文本。

5.人类审查

尽管自动化 经验丰富的教育工作者仍是最准确的人工智能检测员尤其是当他们了解学生的心声时。

事实上,2025 arXiv 研究 发现,在发现人工智能生成的微妙作业方面,经验丰富的教师的表现优于人工智能检测器。

学术界人工智能检测的局限性

虽然探测系统有所改进,但仍有一些 关键限制 仍然是

- 误报 可能会错误地指责学生,尤其是那些写作偏离常规的学生(如 ESL 学习者或神经多元化学生)。

- 成本和可及性 限制预算较少的大学获得最先进的人工智能检测工具。

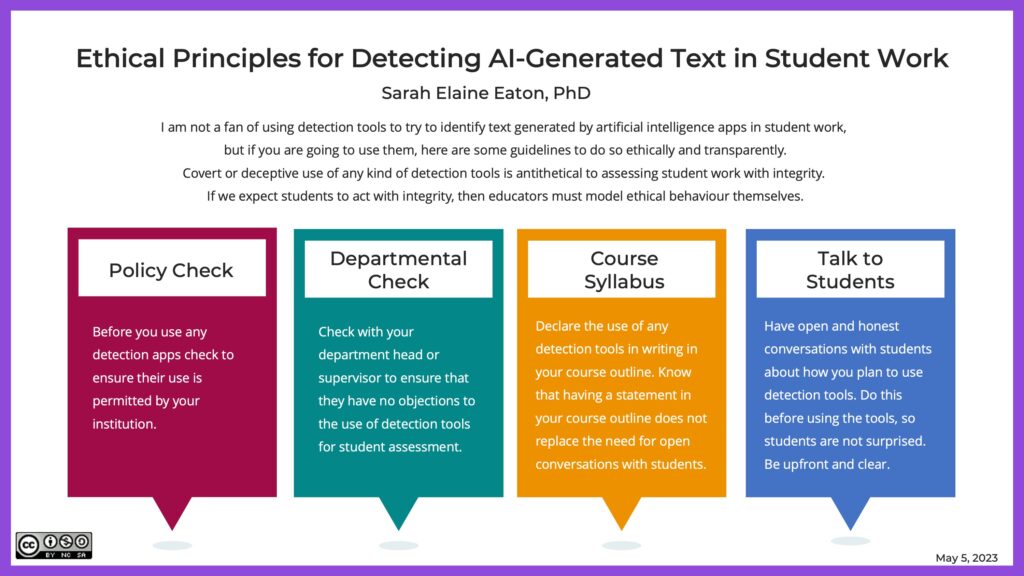

- 伦理问题 当侵犯学生隐私或造成不信任时,就会出现侵入式检测做法。

- 人工智能使用方面的不平等 会进一步拉大不同水平的学生在获取人工智能知识和工具方面的成绩差距。

这些问题促使许多机构不仅重新评估它们如何检测人工智能,而且重新评估它们如何 反思评估 总共

使用 ChatGPT 对学生和高校的影响

学术诚信:人工智能生成的提交材料可能会掩盖学生的真实理解。

如果以不道德的方式使用 ChatGPT,就会挑战学术评价的准确性,损害成绩和证书的价值。

伦理困境:从公平性到数据隐私,各大学都在努力寻找人工智能使用的界限。是彻底禁止人工智能,还是经过深思熟虑后加以整合?

长期影响:过度依赖人工智能可能会削弱批判性思维、论证和创造力等基本技能。

如果学术成果被认为是人工智能辅助的,那么学位在雇主和毕业项目眼中的可信度就会下降。

安全使用人工智能工具的方法(以无法检测的人工智能为特色)

人工智能并不一定是学术诚信的敌人--如果使用得当,它可以增强理解,而不会取代原创性思维。

以下是学生如何安全、透明地使用人工智能的方法:

- 使用人工智能进行头脑风暴,而不是撰写完整的文章。

- 如果人工智能有助于提出见解,请注明出处。

- 对作品进行大量编辑,使之成为自己的作品。

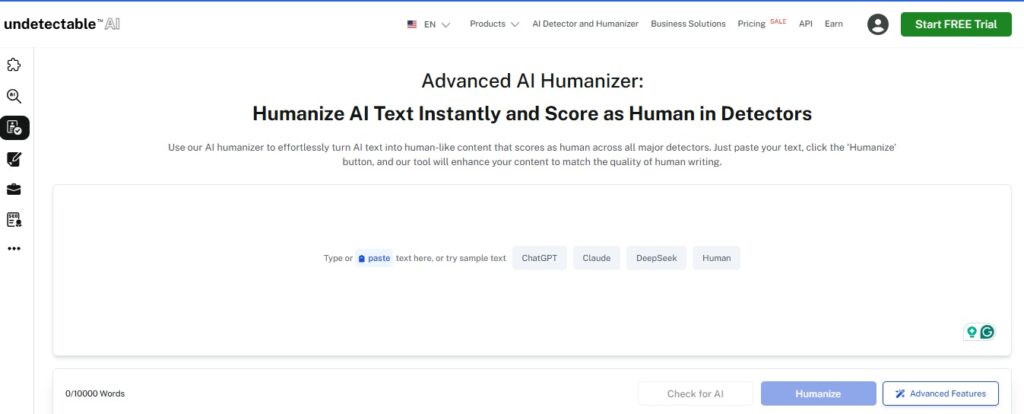

- 使用人性化工具,确保您的写作反映出您的个人声音。

无法检测的人工智能推荐工具

- 人工智能人性化设计器 - 将人工智能机器人的输出转换为符合您独特声音的仿人写作。

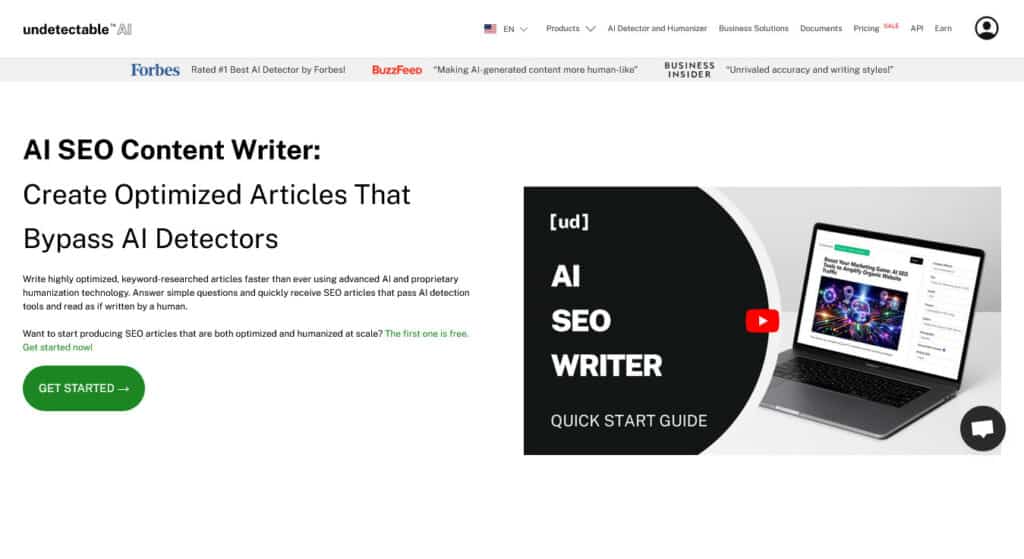

- 人工智能搜索引擎优化内容撰稿人 - 非常适合管理博客或个人作品集、需要道德优化内容的学生。

通过负责任地使用 "检测不到的人工智能 "工具,学生可以在不违反学术要求的情况下接受人工智能,而教育工作者则可以通过透明度建立信任。

确保您的写作符合平台标准--从下面的小工具开始。

常见问题 (FAQ)

高校能检测到 ChatGPT 生成的内容吗?

是的,但并非总是如此。检测工具可以标记出可能使用人工智能的内容,但它们往往会遗漏或错误地识别内容。人工审核仍然至关重要。

使用 ChatGPT 获取帮助是作弊吗?

视情况而定。使用 ChatGPT 来集思广益或澄清主题,如果得到老师的批准,可能是没有问题的。将人工智能生成的作品冒充自己的作品被普遍认为是学术不端行为。

如果 学生被诬告使用人工智能?

误报确实会发生。因此,我们敦促各机构在采取惩戒措施之前,将人工智能工具与教育工作者的判断结合起来。

无法检测的人工智能工具能否绕过检测?

无法检测的人工智能有助于使内容人性化并恢复自然流畅,但其主要目的是确保清晰度和原创性,而不是欺骗检测系统。

高校是否会继续发展人工智能政策?

当然。大多数院校都在积极修订政策、制定新的评估方案,并探索如何将人工智能负责任地融入教育。

结论

教育的未来不在于回避人工智能,而在于学会明智地使用人工智能。

2025 年的高校越来越多地采用检测方法,但真正的学术诚信来自于学生的理解、透明和信任。

无论您是寻求 使用人工智能的道德方式或正在适应新的学习环境的教育工作者--"不可检测的人工智能 "提供了各种工具,以支持您的诚信之旅。

探索无法检测的人工智能 并在当今的课堂上开启符合道德规范的、有效的人工智能工作方法。