Du har sikkert set flere AI-genererede fotos på nettet, end du er klar over.

Nogle gange er det tydeligt, at et billede er genereret af AI, men det bliver sværere at se, efterhånden som de generative billed- og videoværktøjer bliver bedre. Nye værktøjer som Googles Nano Banana Proog opdateringer til OpenAI's ChatGPT-billedmodel giver brugerne mulighed for hurtigt at generere syntetiske billeder, der afspejler virkelige billeder. Tidligere undersøgelser viste, at 85% af amerikanerne siger deepfakes underminerer tilliden på nettet.

Flere værktøjer hævder at kunne opdage AI-genererede billeder, men virker de?

Jeg kørte 50 detektionstjek på tværs af fem af de mest populære AI-billeddetektorer og dokumenterede resultaterne. Jeg vil ikke kun præsentere alle data i denne artikel og forklare dem, jeg vil også linke til dokumentationen til sidst.

De fem detektorer, jeg brugte til disse tests, var TruthScan, AI eller ej, Synsmotor, WasItAIog Winston AI. Jeg testede disse værktøjer ved at lade hver af dem analysere to ChatGPT-genererede billeder, seks Nano Banana-genererede billeder og to billeder genereret af Midjourney. Jeg brugte flere prompting-stilarter og -teknikker (som jeg vil gå i detaljer med senere, når jeg analyserer hvert enkelt billede).

Alle fem detektorer fik til opgave at spotte AI-skabte billeder på tværs af kategorier som svindel, desinformation, generel fotografering og deepfakes. Ikke overraskende klarede ikke alle detektorerne sig godt. TruthScan var den eneste detektor, der konsekvent klassificerede alt det indhold, jeg sendte ind, til 97% eller højere.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

🔍 AI Image Detector testresultater

| Detektionsværktøj | Test i alt | Korrekt opdaget | Mislykket (mislykkes) | Nøjagtighed |

|---|---|---|---|---|

| TruthScan | 10 | 10 | 0 | 100% |

| AI eller ej | 10 | 8 | 2* | 80% |

| Synsmotor | 10 | 7 | 3 | 70% |

| WasItAI | 10 | 6 | 4 | 60% |

| Winston AI | 10 | 3 | 7 | 30% |

* AI or Not mærkede en AI-generation som 78%, en som 85% og en som 89%. Da testen kræver mindst 90%, tæller vi de to første som fejl, men behandler 89% som en næsten fejl, derfor stjernen.

AI or Not klarede sig også ret godt. Selv om AI or Not klassificerede flere AI-genererede genstande under 90%-sikkerhed, var det faktisk den næstmest nøjagtige og konsekvente detektor under mine tests, efter TruthScan. Selv hvor AI or Not fejlede, var disse fejl ikke katastrofale, men der er stadig plads til forbedringer.

Resten af de AI-billeddetektorer, jeg prøvede, klarede sig langt dårligere. For eksempel fejlklassificerede Sight Engine 3 svindelrelaterede AI-billeder som autentiske.

Nu vil jeg vise dig hvert billede (ud af de 10, jeg genererede), forklare, hvordan jeg skabte det, og vise, hvordan hver model scorede det.

#1. "Man On a Ledge" (genereret af ChatGPT)

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Fuld generation | Generelt | 99.00% AI | 99.00% AI | 77.99% AI | 0.98% AI | 1.00% AI |

For mig (og jeg ser dagligt en masse AI-genereret indhold) ser billedet ret overbevisende ud ved første øjekast. Hvis du klikkede på en persons profil på de sociale medier, scrollede gennem deres feed og så dette billede, ville det så straks skille sig ud som et AI-genereret falsum? For at være fair forsøgte jeg at være kreativ med opgaven. Her er den, jeg brugte til at generere dette billede:

“Skab mig et foto i snapshot-kamera-stil af en mand, der står på toppen af et tag og kigger ned på gaden, om natten, han er oplyst af kamerablitzen, der er lysspor fra bilerne nedenunder, en kvinde står bag ham med hånden på læberne og smiler, æstetikken i billedet er som et foto taget med et snapshot-kamera i 2009 af universitetsvenner, der fjoller rundt.“

Uanset hvor kreativ jeg var, eller hvor mange detaljer jeg inkluderede i min prompt, klassificerede TruthScan og Sight Engine stadig korrekt outputtet som AI-genereret. AI or Not-detektoren var tæt på, men ramte stadig ved siden af.

Winston og WasItAI tog helt fejl, da de klassificerede ChatGPT-billedet som ægte.

#2. "Den falske kvittering" (genereret af ChatGPT)

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Fuld generation | Bedrageri | 99.00% AI | 19.00% AI | 94.48% AI | 0.04% AI | 1.00% AI |

Jeg ville generere en falsk kvittering med ChatGPT for at se, hvor realistisk den ville se ud. Du vil måske bemærke, at billedet mangler en legitim adresse, men teksturen ser stadig en smule realistisk ud. Jeg vil sige, at dette billede er mindre overbevisende end det første, jeg fik ChatGPT til at generere, men de fleste detektorer gik stadig i stå, da de analyserede det.

- Ud af alle de tjek, jeg foretog på dette billede, TruthScan var den mest præcise.

- Synsmotor har virkelig fejlet her og udvist dårlig dømmekraft i forbindelse med et dokumentrelateret AI-billede.

- AI eller ej klarede sig mærkbart bedre i denne anden analyse.

- Winston AI klarede sig dårligst, og WasItAI fejlede også fuldstændigt.

I betragtning af at dette billede er forbundet med svindelkategorien, er det bekymrende, at de fleste detektorer fejlklassificerede det.

Den prompt, jeg brugte til at generere billedet

“Generer et billede af en best buy-kvittering, hvor der står, at det samlede beløb, der er brugt, er en milliard dollars, og der er en kaffeplet på den.“

Jeg skrev tydeligvis en hurtig og enkel prompt. Alligevel er kvaliteten af ChatGPT-outputtet visuelt overbevisende for det blotte øje. Ikke så overbevisende for to ud af de fem detektorer, jeg testede, ser det ud til.

#3: "Hazard Package" (genereret med Nano Banana)

I stedet for bare at lade Nano Banana generere et originalt billede, gav jeg den et, den kunne ændre.

Ideen var at demonstrere, hvordan nogen nemt kan bruge AI til at skabe falske beviser og hævde, at de har modtaget en beskadiget/farlig pakke. Først tog jeg et billede med en iPhone 15 af en tom Amazon-pakke, jeg fandt.

Her er det billede, jeg tog:

Derefter uploadede jeg det foto, jeg havde taget, til Nano Banana og gav den følgende besked:

“Jeg vil gerne have, at du redigerer dette foto, og at du ikke ændrer noget, bortset fra der, hvor etiketten er, og tilføjer skader på den og sorte slampletter på kassen, der ligner fedtpletter.“

Nano Bana output:

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-banan Deepfake Edit | Bedrageri | 99.00% AI | 98.00% AI | 99.10% AI | 31.98% AI | 99.00% AI |

Det olielignende slam, som Nano Banana genererede i outputtet, havde et overbevisende snavset skær, komplet med en gennemblødt effekt - slet ikke tegneserieagtigt. Heldigvis stemplede de fleste af de detektorer, jeg kørte det igennem, korrekt billedet som falsk. Den eneste afvigelse var Winston, som igen klarede sig dårligt og fejlklassificerede billedet som autentisk. AI or Not, TruthScan og WasItAI var de mest præcise detektorer til at spotte dette billede.

Det er bekymrende, hvor enkelt det ser ud til at være at uploade et billede til en chatbot og få det fuldstændig ændret. Jeg kan forestille mig, at svindlere og bedragere bruger generative billedværktøjer til at forsøge at lave falske returkrav eller deltage i markedssvindel.

Hvis e-handelsplatforme kun kræver et billede som bevis for at indlede et krav om en beskadiget pakke, er de uden nogen pålidelig måde at opdage AI-manipulation på udsat for en stor angrebsvektor. For eksempel er Amazons officielle Politik for returnering af varer står der bogstaveligt talt, “Hazmat, herunder brændbare væsker eller gasser, kan ikke returneres..”

Så hvis du rent faktisk modtog en pakke, der var dækket af olie eller fedtet sort slam, behøvede du ikke at returnere den, men kunne stadig få pengene tilbage. Hvis det af en eller anden grund faktisk skete for dig, ville Amazon sandsynligvis bede om fotobevis. Kan du se, hvilket problem AI-genererede billeder kan udgøre, når de ikke kan skelnes fra virkelige billeder?

#4. "Kakerlakmåltid" (genereret med Nano Banana)

Det næste AI-billede kan få dig til at miste appetitten. Det viser sig, at der er dokumenterede tilfælde af folk, der bruger AI til at modtage svigagtige tilbagebetalinger på madleveringsapps. Til denne fjerde test fulgte jeg de samme trin som i test tre. Denne gang tog jeg et billede af min tomme takeaway-kasse efter frokost.

Her er det rigtige billede:

Så satte jeg det rigtige foto, jeg tog, ind i Nano Banana og gav den følgende besked:

"Rediger dette billede. Du skal ikke ændre noget, bortset fra at tilføje nudler, hvor folien er, og tilføje en masse bittesmå babykakerlakker i maden. Få det hele til at se realistisk ud og ikke tegneserieagtigt."

Nano-bananens output:

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-banan Deepfake Edit | Bedrageri | 97.15% AI | 18.00% AI | 85.87% AI | 72.29% AI | 1.00% AI |

Endnu en gang opdagede TruthScan med sikkerhed de AI-genererede medier. Sight Engine og WasitAI fejlede fuldstændigt. AI or Not var den næstmest præcise detektor (med 85% AI-sikkerhed), da den scannede dette AI-billede, og Winston klarede sig bedre end i den tredje test (med 72% AI-sikkerhed).

På dette billede blev nudlerne og kakerlakkerne udelukkende genereret af AI, men to af detektorerne syntes ikke at mene det, og kun én (TruthScan) var over 90% sikker på, at der var tale om AI-manipulation.

Et problem her var, hvor enkelt det var at skabe dette falske billede. Fra jeg uploadede det foto, jeg tog, til jeg bad Nano Banana om det og modtog resultatet, tog det i alt kun ca. 2 minutter. Et mareridt for madleveringsapps; en drøm for sultne løgnere. En "svindelfaktor".

AFSLØRING: Nogle af de AI-genererede billeder, der indgår i de følgende tests, havde til formål at demonstrere, hvordan AI-billeder kan bruges til desinformation. De indeholder kontroversielle billeder og følsomme emner, og er IKKE beregnet til at repræsentere nogen bestemt politisk synspunkter eller ideologier.

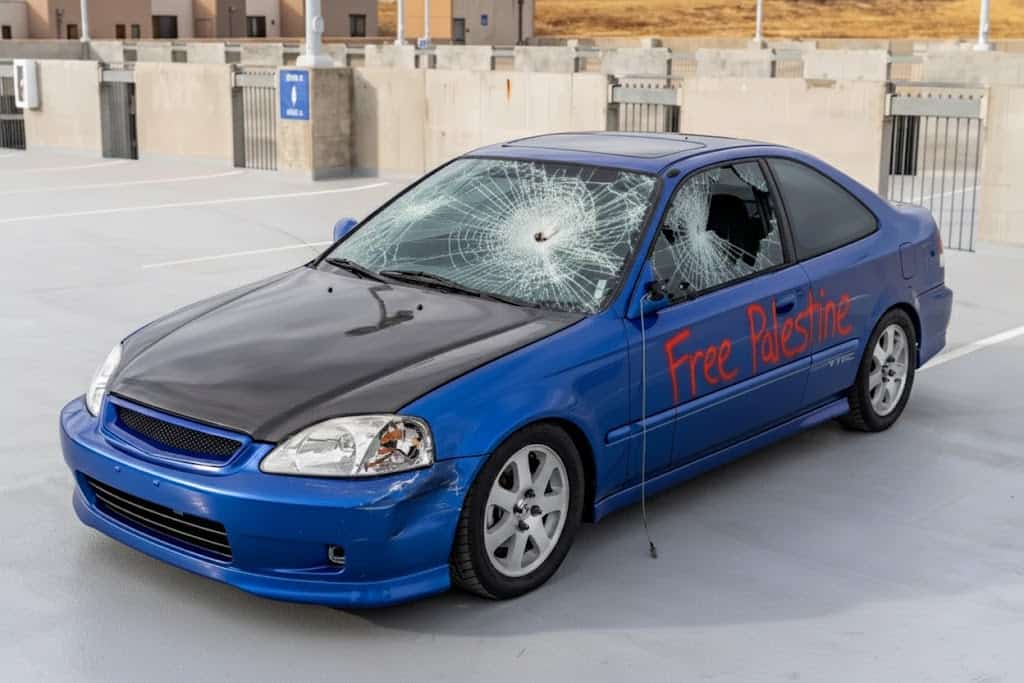

#5. "Autovandalisme" (genereret med Nano Banana)

Jeg fandt et rigtigt billede af en bil til salg på nettet. Ret banalt. Men hvad nu, hvis nogen ville bruge dette billede til at sprede misinformation eller indgive et falsk bilforsikringskrav? Desværre gør generativ AI det hurtigt og nemt.

Til denne femte test tog jeg et rigtigt billede af en bil og gav Nano Banana følgende opfordring:

“Du skal ikke ændre noget ved bilen, bortset fra at du skal spraymale den med "Free Palestine", og at forruden er revnet. Forlygterne er smadret, og spejlet er ødelagt og hænger ned, og de to vinduer på siden af bilen er smadret.”

Her er det rigtige billede:

Nano Banana AI-billede:

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-banan Deepfake Edit | Bedrageri / desinformation | 97.48% AI | 18.00% AI | 89.52% AI | 0,02% AI | 99.00% AI |

Detektorresultaterne for dette output var blandede. I denne test havde WasItAI (overraskende nok) den højeste AI-detektionsscore (99%). TruthScan havde den næsthøjeste score (97%). Sight Engine kunne slet ikke registrere nogen syntetiske elementer i billedet, og Winston klarede sig dårligst af alle detektorerne (med en chance for involvering på mindre end 1%). AI or Not klarede sig okay, men nøjagtigheden var stadig under 90%.

Lad os tale om billedet. De to mest bekymrende aspekter ved AI-skabt eller ændret indhold som dette er, at begge involverer bedrag. For det første er det hurtigt, nemt og ser ægte ud at bruge AI til at ændre hverdagsbilleder for at skabe politisk ladet indhold. Uanset om de, der laver denne type indhold, bare sigter efter engagement eller er politiske provokatører, er problemet, at det er falske oplysninger, der præsenteres som autentiske.

Den anden måde, hvorpå billedgenereringsværktøjer som dette kan misbruges, er til svindel. Hvis en svindler vil indgive et falsk krav om bilforsikring, skal de producere falske beviser. I stedet for at bruge timer i Photoshop på at redigere billeder og manipulere beviser, kan de bruge billedgeneratorer til hurtigt at fremstille falske beviser.

I eksemplet med AI-billedet ovenfor kan du se, hvordan en svindler kan bruge en lignende proces til at indgive et falsk krav i henhold til Progressive's Politik for omfattende dækning, som specifikt dækker:

- Skåret eller beskadigede dæk

- Ødelagte ruder, forlygter eller baglygter

- Skader på spraymaling

- Buler eller ridser fra at nogen stjæler din bil

- Fyld sukker eller andre stoffer i din benzintank

Det er selvfølgelig ikke bare vildledende at indsende falske beviser, det er også direkte ulovligt. I en ideel verden ville ingen bryde loven, men i virkeligheden sker der kriminalitet hver dag. Og uden pålidelig afsløring risikerer bilforsikringsselskaber at blive snydt for millioner, efterhånden som antallet af AI-aktiverede falske forsikringskrav stiger.

#6. "Soda Musk and Don" (genereret med Nano Banana)

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-banan Fuld generation | Disinfo | 99.00% AI | 99.00% AI | 99.00% AI | 0.24% AI | 86.00% AI |

Igen brugte jeg Nano Banana til denne test, og målet var at demonstrere falske, politisk ladede billeder med en mere fjollet undertone. TruthScan, Sight Engine og AIorNot markerede alle det genererede billede med en AI-detektering på 99%. WasitAI var ikke lige så sikker - de opdagede kun det AI-genererede billede med en sikkerhed på 86%. Og Winston fejlede fuldstændigt og gav en AI-score på 0,2%. For at generere billedet gav jeg Nano Banana denne besked:

“Skab et billede af Elon Musk, der spilder en stor kop sodavand som en Big Gulp på sin skjorte og flipper ud, mens Donald Trump sidder ved siden af ham og griner. De sidder i et jetfly. Det er scenen. Og billedet skal se realistisk ud, som om det er taget med et snapshot-kamera og indeholde artefakter som kameraets blitz, der reflekterer på flyvinduet og uden for flyet. Det er om natten. Det skal se hyperrealistisk ud.“

Når et af disse softwareprogrammer ikke opdager AI, betegner de det som autentisk. Hvor fjollet dette billedeeksempel fra testen end er, er der ikke noget sjovt i at tro, at en deepfake er ægte.

#7. "Still Alive" (genereret af Nano Banana)

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-banan Fuld generation | Deepfake | 97.49% AI | 95.00% AI | 99.27% AI | 0.15% AI | 1.00% AI |

Synes du, at dette billede er foruroligende? For at generere denne deepfake brugte jeg Nano Banana og gav den et billede af mig selv. Derefter gav jeg den en lang prompt, som skulle sætte mig i en situation, der antydede, at jeg var blevet bortført. Måske er det, fordi dette billede viser mig i en kompromitterende position. Hvad nu, hvis nogen lavede sådan noget, sendte det til min mor og truede med at gøre mig fortræd, hvis hun ikke sendte dem penge? Skræmmende ting.

(Den fulde prompt, jeg brugte til dette, kan findes i det fulde testdatasæt i slutningen af denne artikel).

Heldigvis for dette billede, på trods af at det ser meget realistisk ud, Tre ud af fem detektorer identificerede den som AI-genereret.

AI or Not kom ind med en stærk AI-score på 99%, TruthScan med 97% og Sight Engine med 95%. Desværre klassificerede Winston og WasItAI billedet som ægte.

Jeg bør præcisere, at disse tests ikke blev udført på min personlige Gemini-konto. Nano Banana bad mig aldrig om at bevise, at jeg var personen på billedet. Enhver kunne have downloadet et billede af mig fra internettet, lagt det ind i Nano Banana og fået det til at skabe denne type billede.

#8. "Abuse of a Ben" (genereret med Nano Banana)

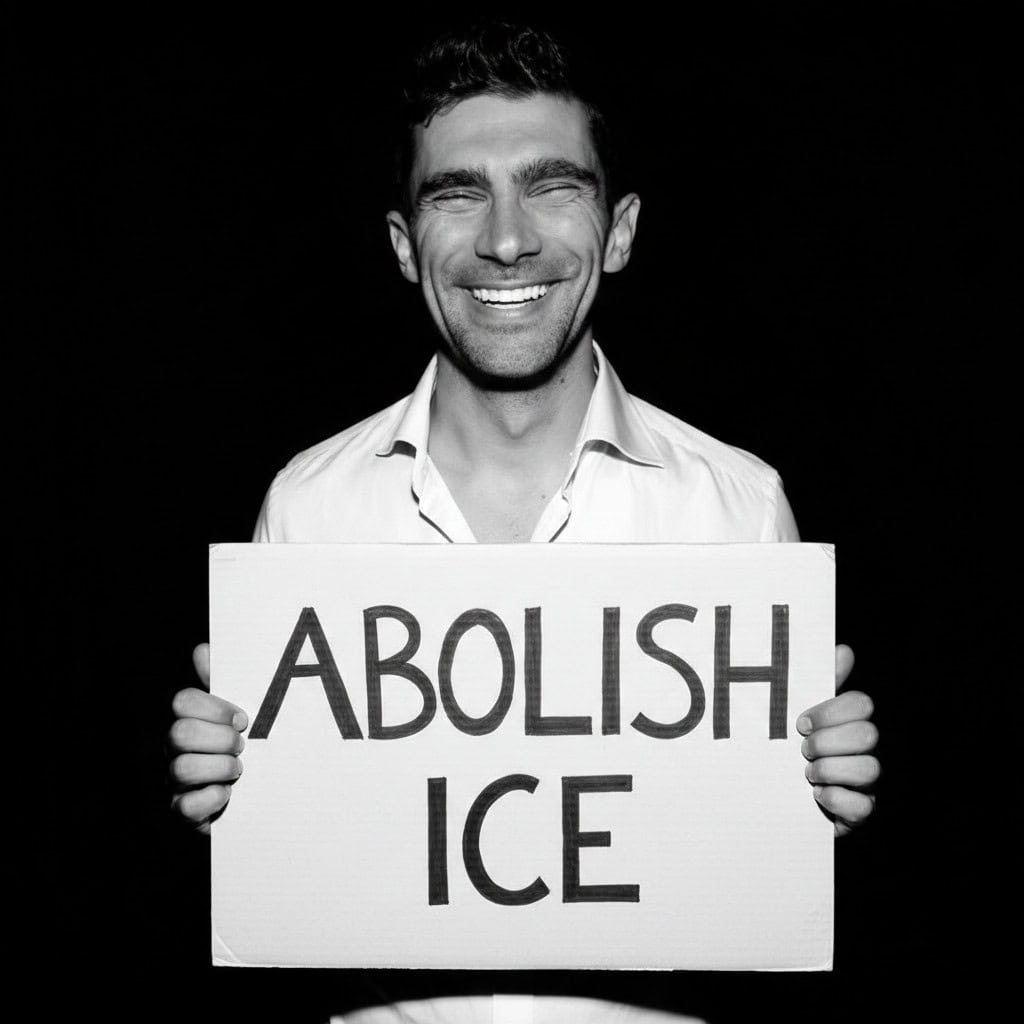

Mød Ben. Han bruger det meste af sin tid på at lede forskellige afdelinger i de virksomheder, hvor han arbejder. Billedet herover er Bens (rigtige) flotte corporate headshot. Hvis du ikke kan se det, så er Ben en professionel fyr. Uanset hvilke politiske meninger han har, holder han dem for sig selv, og hans arbejdssamtaler handler kun om arbejde. Men til enhver tid kan Bens billede blive brugt til at sprede politisk propaganda eller budskaber uden hans samtykke.

Der har på det seneste været en masse rapporter om, hvordan AI-genererede videoer med ICE-agenter og protester har spredt sig på nettet. Baseret på alle de hidtidige tests konkluderede jeg, at det var virkelig nemt at skabe falsk politisk propaganda med AI. Jeg besluttede mig for at teste igen, denne gang med Ben.

Med Bens tilladelse brugte jeg hans headshot til at lave en deepfake. Her er det AI-genererede billede, som Nano Banana skabte:

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano-banan | Deepfake / Disinfo | 99.00% AI | 97.00% AI | 98.88% AI | 5.74% AI | 99.00% AI |

Det tog tredive sekunder. Alt, hvad jeg skulle gøre, var at trække og slippe hans hovedbillede ind i Gemini og bede den om at "holde et skilt op, hvor der står afskaffelse af ICE." Resultatet fra Nano Banana er ikke så fotorealistisk som de andre, men det ser stadig autentisk nok ud til at være overbevisende.

Heldigvis identificerede fire af detektorerne billedet præcist: TruthScan (99% AI), Was It AI (99% AI), Sight Engine (97% AI) og AI or Not (97% AI). Winston AI mislykkedes og fik kun en 5% AI-score.

#9. "Club Void" (genereret af Midjourney)

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Midt på rejsen Fuld generation | Generelt | 99.00% AI | 99.00% AI | 89.21% AI | 1.56% AI | 70.00% AI |

Jeg skabte billedet ovenfor ved hjælp af Midjourney. Jo mere jeg kiggede på det, jo mere foruroligende føltes det. Æstetikken er mørk og uhyggelig. En skyggeagtig tilstedeværelse synes at dukke op bag motivet. For at skabe dette billede brugte jeg Midjourneys æstetiske referencefunktion og bad simpelthen om, at det skulle være en "pige, der står i en klub og smiler". Jeg viste billedet til nogle få mennesker, og de troede alle, at det var ægte.

De fleste detektorer markerede billedet som AI-genereret. TruthScan og Sight Engine markerede det med en 99% AI-score, AI or Not sagde 89%.

WasItAI var ikke lige så sikker som detektorerne og klassificerede kun billedet med en 70% AI-score.

Winston AI's detektor fejlede fuldstændigt og gav billedet en AI-score på 1,56%.

#10 "Isboks" (genereret af Midjourney)

Sådan scorede billeddetektorerne det

| Billedmodel | Kategori | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Midt på rejsen Fuld generation | Disinfo | 99.00% AI | 92.00% AI | 97.94% AI | 41.20% AI | 72.00% AI |

Jeg skabte dette billede ved at bruge den samme metode midt på rejsen som i den forrige test. Denne gang var målet at skabe noget lidt mørkere. TruthScan var den mest nøjagtige detektor og betegnede billedet som 99% AI. Sight Engine og AI or Not registrerede begge billedet korrekt. Winston AI fejlede fuldstændigt, og WasItAI havde en meget lavere tillidsscore end TruthScan, Sight Engine og AI or Not.

Jeg må sige, at i dette tilfælde kunne det billede, jeg skabte, bruges eller indrammes på to måder. På den ene side kunne nogen bruge denne type medie (eller et hvilket som helst medie med tema om politiske/civile uroligheder) i en form for kunst eller kreativt projekt for at komme med et statement. I så fald synes risikoen at være mindre. Den største bekymring, jeg har med denne kategori af AI-genererede medier, er, at de bliver brugt af forbryderiske personer, der hævder, at de er ægte.

Opsummering og resultater: Bedste AI-billeddetektorer

Okay, så nu hvor vi har vist alle testene, vil jeg opsummere: Jeg genererede 10 AI-billeder

- Jeg brugte ChatGPT, Nano Banana og Midjourney til at generere 10 AI-billeder

- Jeg testede fem AI-billeddetektorer ved at sende alle de AI-billeder, jeg genererede, igennem dem.

- TruthScan bestod alle testene og var den mest nøjagtige detektor. AI or Not bestod 8 ud af 10 tests og viste en vis pålidelighed. Sight Engine bestod ikke 3 ud af 10 tests og havde en tvivlsom præcision. Was It AI dumpede 4 ud af 10 tests og havde en dårlig præcision hele vejen rundt. Winston AI var den mindst nøjagtige AI-billeddetektor, som kun bestod 3 ud af 10 tests og konsekvent fejlklassificerede billeder.

Omfattende testresultater

Hvordan fem populære AI-billeddetektorer klarede sig på tværs af svindel, desinformation, deepfakes og generel fotografering.

Alle 10 tests - fuld oversigt

Hver score repræsenterer detektorens AI-tillidsvurdering. Tærskel for at bestå: ≥ 90% AI.

| Test | Kategori | Kilde | TruthScan | Synsmotor | AI eller ej | Winston AI | WasItAI |

|---|---|---|---|---|---|---|---|

| 1 Manden på kanten | Generelt | ChatGPT | 99.00% | 99.00% | 78.00% | 0.98% | 1.00% |

| 2 Den falske kvittering | Bedrageri | ChatGPT | 99.00% | 19.00% | 94.48% | 0.04% | 1.00% |

| 3 Farepakke | Bedrageri | Nano-banan | 99.00% | 98.00% | 99.10% | 31.98% | 99.00% |

| 4 Kakerlak-måltid | Bedrageri | Nano-banan | 97.15% | 18.00% | 85.87% | 72.29% | 1.00% |

| 5 Autovandalisme | Bedrageri / desinformation | Nano-banan | 97.48% | 18.00% | 89.52% | 0.02% | 99.00% |

| 6 Soda Musk & Don | Disinfo | Nano-banan | 99.00% | 99.00% | 99.00% | 0.24% | 86.00% |

| 7 Stadig i live | Deepfake | Nano-banan | 97.49% | 95.00% | 99.27% | 0.15% | 1.00% |

| 8 Misbrug af en Ben | Deepfake / Disinfo | Nano-banan | 99.00% | 97.00% | 98.88% | 5.74% | 99.00% |

| 9 Club Void | Generelt | Midt på rejsen | 99.00% | 99.00% | 89.21% | 1.56% | 70.00% |

| 10 Isboksen | Disinfo | Midt på rejsen | 99.00% | 92.00% | 97.94% | 41.20% | 72.00% |

Metodologi: Hvert billede blev sendt én gang til hver detektor. En score på ≥ 90% AI tæller som en korrekt registrering. Scorer mellem 70-89% er "næsten fejl". Alt under 70% er en fiasko. AI or Not mærkede én generation ved 78%, én ved 85% og én ved 89% - 89% behandles som en "near-miss" med en stjerne i oversigtstabellen.

Afsluttende bemærkninger og data

I alt brugte jeg 25 timer mellem skrivningen af denne artikel og den grundige testning på at sammensætte denne rapport. Multimodale AI-detektionsværktøjer er stadig under udvikling, men det er tydeligt, at nogle er mere præcise end andre. Efter at have testet alle værktøjerne har TruthScan den mest nøjagtige AI-billeddetektor. Testene taler for sig selv.

Hvis du gerne vil have adgang til en CSV-kopi af dataene fra den test, jeg lavede i denne artikel, kan du finde den her. Det data-regneark, jeg linkede til, indeholder alle de oprindelige prompts og detektionsresultater fra testene i denne artikel.