Probabilmente avete visto online più foto generate dall'intelligenza artificiale di quanto pensiate.

A volte è evidente che un'immagine è stata generata dall'intelligenza artificiale, ma è sempre più difficile capirlo con il miglioramento degli strumenti generativi per immagini e video. Nuovi strumenti come Google Nano Banana Proe gli aggiornamenti di OpenAI Modello di immagine ChatGPT consentono agli utenti di generare rapidamente immagini sintetiche che rispecchiano quelle reali. Una precedente ricerca ha rilevato che 85% degli americani affermano che I deepfakes stanno erodendo la fiducia online.

Diversi strumenti dichiarano di rilevare le immagini generate dall'intelligenza artificiale, ma funzionano?

Ho eseguito 50 controlli di rilevamento su cinque dei più popolari rilevatori di immagini AI e ho documentato i risultati. In questo articolo non solo presenterò tutti i dati e li spiegherò, ma alla fine rimanderò anche alla documentazione.

I cinque rilevatori che ho utilizzato per questi test sono stati: TruthScan, AI o no, Motore a vista, WasItAI, e Winston AI. Ho testato questi strumenti facendo analizzare a ciascuno due immagini generate da ChatGPT, sei immagini generate da Nano Banana e due immagini generate da Midjourney. Ho usato diversi stili e tecniche di sollecitazione (di cui parlerò in dettaglio più avanti, quando analizzerò ogni immagine analizzata).

Tutti e cinque i rilevatori avevano il compito di individuare le immagini create dall'intelligenza artificiale in categorie come frode, disinformazione, fotografia generale e deepfake. Non sorprende che non tutti i rilevatori abbiano ottenuto buoni risultati. TruthScan è stato l'unico rilevatore a classificare costantemente tutti i contenuti che ho inviato a 97% o superiore.

Non preoccupatevi più che l'intelligenza artificiale rilevi i vostri messaggi. Undetectable AI Può aiutarvi:

- Fate apparire la vostra scrittura assistita dall'intelligenza artificiale simile all'uomo.

- Bypass tutti i principali strumenti di rilevamento dell'intelligenza artificiale con un solo clic.

- Utilizzo AI in modo sicuro e con fiducia a scuola e al lavoro.

🔍 Risultati del test del rilevatore di immagini AI

| Strumento di rilevamento | Totale test | Rilevato correttamente | Mancato (Fails) | Precisione |

|---|---|---|---|---|

| TruthScan | 10 | 10 | 0 | 100% |

| AI o no | 10 | 8 | 2* | 80% |

| Motore a vista | 10 | 7 | 3 | 70% |

| WasItAI | 10 | 6 | 4 | 60% |

| Winston AI | 10 | 3 | 7 | 30% |

* AI or Not ha etichettato una generazione AI come 78%, una come 85% e una come 89%. Poiché il test richiede almeno 90%, consideriamo i primi due come non riusciti ma trattiamo l'89% come un quasi-miss, da cui l'asterisco.

Anche AI or Not si è comportato piuttosto bene. Infatti, sebbene AI or Not abbia classificato più elementi generati dall'AI al di sotto della certezza di 90%, è stato il secondo rilevatore più accurato e coerente durante i miei test, dopo TruthScan. Anche nei casi in cui AI or Not ha fallito, i fallimenti non sono stati catastrofici, ma c'è ancora margine di miglioramento.

Gli altri rilevatori di immagini AI che ho provato si sono comportati molto peggio. Ad esempio, Sight Engine ha classificato erroneamente come autentiche 3 immagini AI relative a frodi.

Ora vi mostrerò ogni immagine (delle 10 che ho generato), vi spiegherò come l'ho creata e vi mostrerò il punteggio ottenuto da ogni modello.

#1. "Man On a Ledge" (generato da ChatGPT)

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Generazione completa | Generale | 99.00% AI | 99.00% AI | 77.99% AI | 0,98% AI | 1.00% AI |

Per me (e vedo molti contenuti generati dall'intelligenza artificiale ogni giorno), l'immagine sembra abbastanza convincente a prima vista. Se cliccaste sul profilo di qualcuno sui social media, scorrendo il suo feed e vedeste questa immagine, vi sembrerebbe immediatamente un falso generato dall'intelligenza artificiale? A dire il vero, ho cercato di essere creativo con la richiesta. Ecco quello che ho usato per generare questa immagine:

“Generatemi una foto in stile macchina fotografica istantanea di un uomo in piedi in cima a un tetto che guarda giù in strada, di notte, è illuminato dal flash della macchina fotografica, ci sono tracce di luce dalle auto sottostanti, una donna è in piedi dietro di lui con la mano sulle labbra, sorridendo, l'estetica della foto è come una foto scattata con una macchina fotografica istantanea nel 2009 da amici del college che scherzano.“

Indipendentemente dalla mia creatività o dal numero di dettagli inclusi nella richiesta, TruthScan e Sight Engine hanno comunque classificato correttamente l'output come generato dall'IA. Il rilevatore AI or Not ci è andato vicino, ma ha mancato il bersaglio.

Winston e WasItAI si sono sbagliati di grosso, classificando l'immagine di ChatGPT come reale.

#2. "La ricevuta falsa" (generato da ChatGPT)

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| ChatGPT Generazione completa | Frode | 99.00% AI | 19.00% AI | 94.48% AI | 0,04% AI | 1.00% AI |

Ho voluto generare una ricevuta falsa con ChatGPT per vedere quanto sarebbe stata realistica. Si può notare che nell'immagine manca un indirizzo legittimo, ma la texture appare comunque leggermente realistica. Direi che questa immagine è meno convincente della prima che ho fatto generare a ChatGPT, ma la maggior parte dei rilevatori ha comunque fallito quando l'ha analizzata.

- Di tutti i controlli che ho eseguito su questa immagine, TruthScan è stato il più accurato.

- Motore a vista ha davvero fallito in questo caso, dimostrando scarsa capacità di giudizio su un'immagine AI legata a un documento.

- AI o no ha ottenuto risultati nettamente migliori in questa seconda analisi.

- Winston AI si è comportato peggio e anche WasItAI ha fallito completamente.

Dato che questa immagine è associata alla categoria frode, è preoccupante che la maggior parte dei rilevatori l'abbia classificata male.

Il prompt che ho usato per generare l'immagine

“Generare l'immagine di uno scontrino di un best buy, che dice che l'importo totale speso è di un miliardo di dollari, e su cui c'è una macchia di caffè“

Chiaramente, ho scritto un prompt semplice e veloce. Tuttavia, la qualità dell'output di ChatGPT è visivamente convincente a occhio nudo. Non così convincente per due dei cinque rilevatori che ho testato, a quanto pare.

#3: "Pacchetto pericolo" (generato con Nano Banana)

Invece di far generare a Nano Banana un'immagine originale, le ho dato un'immagine da modificare.

L'idea era di dimostrare come qualcuno potesse facilmente utilizzare l'intelligenza artificiale per creare prove false e affermare di aver ricevuto un pacco danneggiato/pericoloso. Per prima cosa, ho scattato una foto con un iPhone 15 a un pacco Amazon vuoto che ho trovato.

Ecco la foto che ho scattato:

Poi ho caricato la foto scattata su Nano Banana e le ho dato la seguente indicazione:

“Voglio che modifichiate questa foto senza cambiare nulla, tranne il punto in cui si trova l'etichetta, aggiungendo danni e macchie di fango nero sulla scatola che sembrano proprio macchie di grasso.“

Uscita Nano Bana:

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Modifica Deepfake | Frode | 99.00% AI | 98.00% AI | 99.10% AI | 31.98% AI | 99.00% AI |

La melma oleosa che Nano Banana ha generato nell'output aveva una convincente lucentezza sporca, completa di un effetto di inzuppamento, per nulla cartoonesco. Fortunatamente, la maggior parte dei rilevatori con cui l'ho confrontata ha etichettato correttamente l'immagine come un falso. L'unica eccezione è stata Winston, che ancora una volta si è comportato male, classificando l'immagine come autentica. AI or Not, TruthScan e WasItAI sono stati i rilevatori più precisi nell'individuare questa immagine.

È preoccupante quanto sembri semplice caricare un'immagine su un chatbot e farla alterare completamente. Posso immaginare che i truffatori e i frodatori utilizzino strumenti di generazione di immagini per cercare di fare richieste di restituzione fraudolente o per commettere frodi sul mercato.

Se le piattaforme di e-commerce richiedono solo un'immagine come prova per avviare una richiesta di risarcimento per un pacco danneggiato, allora, senza un modo affidabile per rilevare la manomissione dell'IA, sono esposte a un importante vettore di attacco. Ad esempio, il sito ufficiale di Amazon politica di restituzione degli articoli afferma letteralmente, “I materiali pericolosi, compresi i liquidi o i gas infiammabili, non sono restituibili..”

Quindi, se si ricevesse effettivamente un pacco ricoperto di olio o di morchia nera e grassa, non sarebbe necessario restituirlo, ma si potrebbe comunque ottenere un rimborso. Se, per qualche motivo, vi capitasse davvero, Amazon probabilmente vi chiederebbe una prova fotografica. Vi rendete conto del problema che possono rappresentare le immagini generate dall'intelligenza artificiale quando sono indistinguibili da quelle reali?

#4. "Pasto di scarafaggi" (generato con Nano Banana)

La prossima immagine AI potrebbe farvi perdere l'appetito. Come risulta, sono stati documentati casi di persone che hanno usato l'intelligenza artificiale per ricevere rimborsi fraudolenti sulle app di consegna di cibo. Per questo quarto test ho seguito gli stessi passi del terzo. Questa volta ho scattato una foto della mia scatola da asporto vuota dopo il pranzo.

Ecco l'immagine reale:

Poi ho inserito la foto reale che ho scattato in Nano Banana e le ho dato la seguente richiesta:

"Modifica questa immagine. Non cambiate nulla, se non l'aggiunta di tagliatelle nel punto in cui si trova la pellicola e l'aggiunta di un gruppo di piccoli scarafaggi nel cibo. Fate in modo che tutto sembri realistico e non da cartone animato".

L'uscita Nano Banana:

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Modifica Deepfake | Frode | 97.15% AI | 18.00% AI | 85.87% AI | 72.29% AI | 1.00% AI |

Ancora una volta, TruthScan ha rilevato con sicurezza i media generati dall'IA. Sight Engine e WasitAI hanno fallito completamente. AI or Not è stato il secondo rilevatore più accurato (con 85% di certezza AI) durante la scansione di questa immagine AI, e Winston ha ottenuto risultati migliori rispetto al terzo test (con 72% di certezza AI).

In questa immagine, gli spaghetti e gli scarafaggi sono stati generati interamente dall'IA; tuttavia, due dei rilevatori non sembrano pensarla così, e solo uno (TruthScan) è stato più di 90% sicuro della manomissione dell'IA.

Un punto di interesse è stata la semplicità con cui è stata creata questa immagine falsa. Dal caricamento della foto scattata, alla richiesta di Nano Banana e alla ricezione del risultato, in tutto ci sono voluti solo 2 minuti. Un incubo per le app di consegna di cibo, un sogno per i bugiardi affamati. Un "fattore di frode".

DISCLOSURE: Alcune delle immagini generate dall'intelligenza artificiale incluse nei seguenti test erano destinate a dimostrare come le immagini dell'intelligenza artificiale possano essere utilizzate per la disinformazione. Esse contengono immagini controverse e soggetti sensibili, e NON intendono rappresentare alcuna particolare politica opinioni o ideologie.

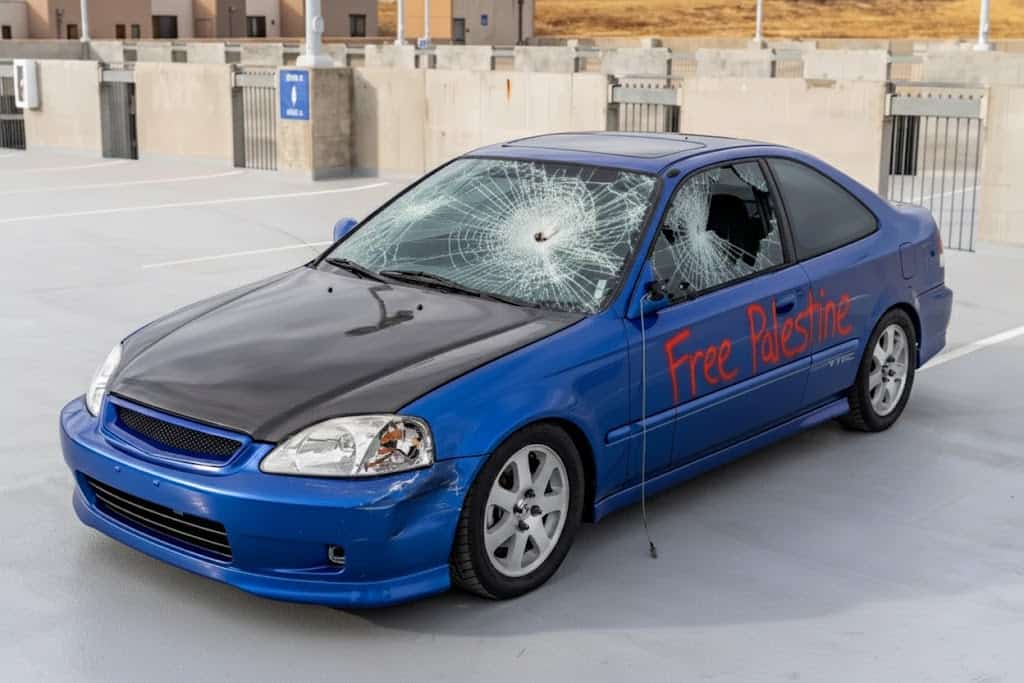

#5. "Autovandalismo" (generato con Nano Banana)

Ho trovato un'immagine reale di un'auto in vendita online. Piuttosto banale. Ma cosa succederebbe se qualcuno volesse usare questa immagine per diffondere disinformazione o per presentare una richiesta di risarcimento per l'assicurazione auto fasulla? Purtroppo, l'intelligenza artificiale generativa lo rende facile e veloce.

Per questo quinto test, ho preso un'immagine reale di un'automobile e ho dato a Nano Banana la seguente richiesta:

“Non cambiare nulla dell'auto, tranne il fatto che devi aggiungere una vernice spray con la scritta "Palestina libera" e che il parabrezza è spaccato. I fari sono distrutti e lo specchietto è rotto e pende verso il basso e i due finestrini sul lato dell'auto sono distrutto.”

Ecco l'immagine reale:

Immagine di Nano Banana AI:

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Modifica Deepfake | Frode / Disinformazione | 97.48% AI | 18.00% AI | 89.52% AI | 0,02% AI | 99.00% AI |

I risultati dei rilevatori per questa uscita sono stati contrastanti. Per questo test, WasItAI (sorprendentemente) ha ottenuto il punteggio di rilevamento AI più alto (99%). TruthScan ha ottenuto il secondo punteggio più alto (97%). Sight Engine non è riuscito a rilevare alcun elemento sintetico nell'immagine e Winston ha ottenuto il risultato peggiore tra tutti i rilevatori (assegnando una probabilità di coinvolgimento inferiore a 1%). AI or Not se l'è cavata bene, ma la precisione era ancora inferiore a 90%.

Parliamo dell'immagine. I due aspetti più preoccupanti di contenuti creati o alterati dall'IA come questo sono che entrambi implicano un inganno. In primo luogo, l'uso dell'intelligenza artificiale per alterare immagini banali e creare contenuti a sfondo politico è veloce, facile e sembra reale. Sia che gli autori di questo tipo di contenuti puntino solo al coinvolgimento, sia che siano provocatori politici, il problema è che si tratta di informazioni false presentate come autentiche.

Il secondo modo in cui si può abusare di strumenti di generazione di immagini come questo è la frode. Se un truffatore vuole presentare una falsa richiesta di risarcimento per l'assicurazione auto, deve produrre prove false. Invece di passare ore e ore in Photoshop a modificare le immagini e a correggere le prove, può usare i generatori di immagini per produrre rapidamente prove false.

Nell'esempio dell'immagine AI qui sopra, si noti come un truffatore potrebbe utilizzare un processo simile per presentare una richiesta di risarcimento falsa secondo Progressive. Politica di copertura globale, che copre specificamente:

- Tagliato o pneumatici danneggiati

- Finestrini, fari o luci posteriori rotti

- Danni da vernice spray

- Ammaccature o graffi da qualcuno che ha preso a colpi di chiave la tua auto

- Mettere zucchero o altre sostanze nel serbatoio del carburante

Ovviamente presentare prove false non è solo ingannevole, ma anche apertamente illegale. In un mondo ideale, nessuno infrangerebbe la legge; in realtà, il crimine avviene ogni giorno. Senza un rilevamento affidabile, le compagnie di assicurazione rischiano di essere truffate per milioni di euro con l'aumento delle richieste di risarcimento fraudolente da parte dell'intelligenza artificiale.

#6. "Soda Musk e Don" (generato con Nano Banana)

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Generazione completa | Disinfo | 99.00% AI | 99.00% AI | 99.00% AI | 0,24% AI | 86.00% AI |

Ancora una volta, per questo test ho utilizzato Nano Banana e l'obiettivo era quello di mostrare immagini false, a sfondo politico, con una sfumatura più sciocca. TruthScan, Sight Engine e AIorNot hanno segnalato l'immagine generata con un punteggio di rilevamento AI di 99%. WasitAI non è stato altrettanto sicuro, rilevando l'immagine generata dall'AI con una certezza di soli 86%. Winston ha fallito completamente, assegnando un punteggio AI di 0,2%. Per generare l'immagine, ho dato a Nano Banana questa richiesta:

“Generare una foto di Elon Musk che si rovescia sulla camicia una grossa tazza di soda come una Big Gulp e dà di matto mentre Donald Trump è seduto accanto a lui e ride. Sono su un aereo. Questa è la scena. La foto deve sembrare realistica, come se fosse stata scattata con una macchina fotografica istantanea, e deve includere artefatti come il flash della macchina fotografica che si riflette sul finestrino dell'aereo e all'esterno dell'aereo. È notte. Dovrebbe sembrare iperrealistica.“

Ogni volta che uno di questi programmi software non riesce a rilevare l'IA, lo etichettano come autentico. Per quanto sciocco possa essere questo esempio di immagine del test, non c'è nulla di divertente nel pensare che un deepfake sia reale.

#7. "Ancora vivo" (generato da Nano Banana)

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana Generazione completa | Deepfake | 97.49% AI | 95.00% AI | 99.27% AI | 0,15% AI | 1.00% AI |

Trovate questa immagine inquietante? Per generare questo deepfake, ho usato Nano Banana e gli ho dato una mia foto. Poi gli ho dato un lungo prompt per mettermi in una situazione che implicasse un rapimento. Forse perché questa foto mostra me in una posizione compromettente. E se qualcuno avesse fatto una cosa del genere, l'avesse inviata a mia madre e avesse minacciato di farmi del male se non gli avesse mandato dei soldi? Roba da far paura.

(Il prompt completo che ho utilizzato per questo scopo si trova nel set di dati di test completo alla fine di questo articolo).

Fortunatamente per questa immagine, nonostante abbia un aspetto molto realistico, tre rilevatori su cinque l'hanno identificata come generata dall'intelligenza artificiale.

AI or Not ha ottenuto un punteggio di 99%, TruthScan di 97% e Sight Engine di 95%. Purtroppo, Winston e WasItAI hanno classificato l'immagine come reale.

Devo precisare che questi test non sono stati fatti sul mio account personale Gemini. Nano Banana non mi ha mai chiesto di dimostrare di essere la persona dell'immagine. Chiunque avrebbe potuto scaricare una mia foto da Internet, inserirla in Nano Banana e farle creare questo tipo di immagine.

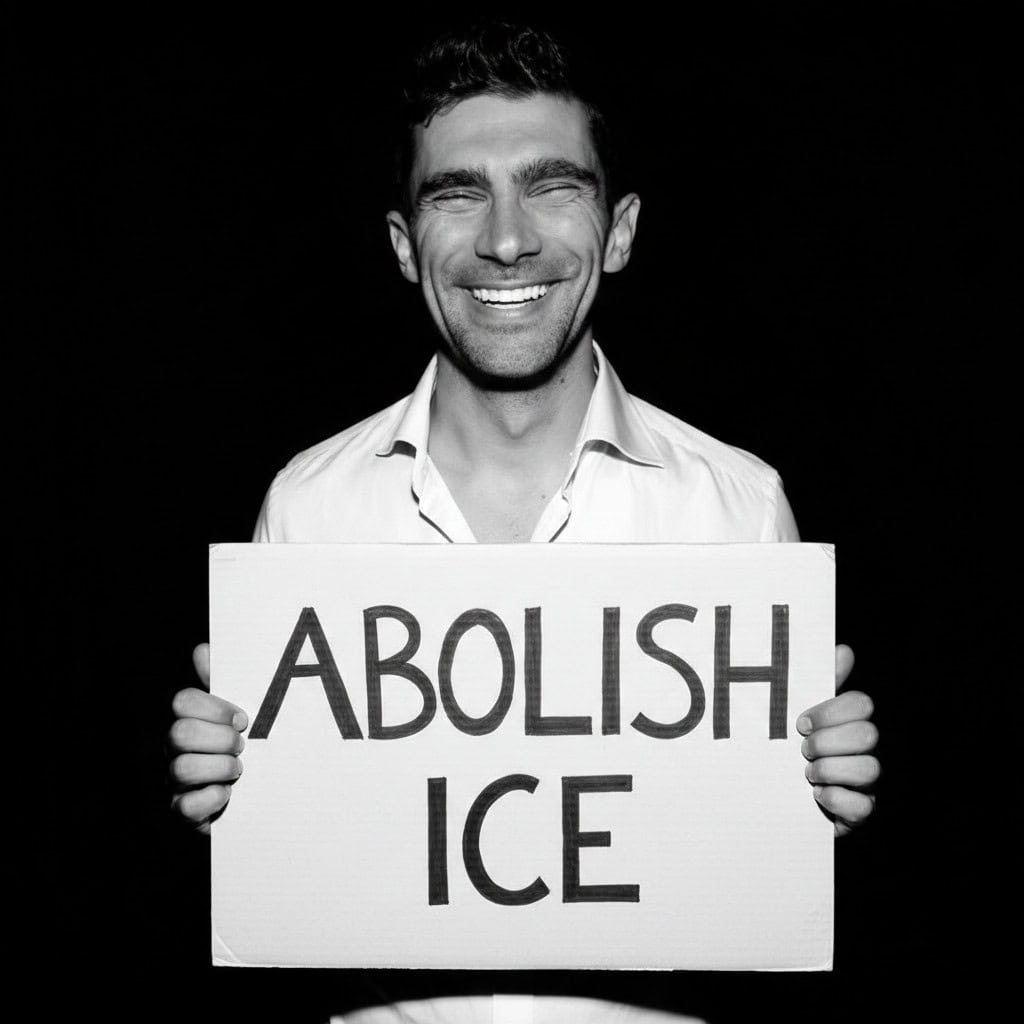

#8. "Abuso di un Ben" (generato con Nano Banana)

Vi presentiamo Ben. Trascorre la maggior parte del suo tempo a gestire vari reparti nelle aziende in cui lavora. L'immagine qui sopra è la (vera) foto aziendale di Ben. Se non si è capito, Ben è un professionista. Qualsiasi opinione politica abbia, la tiene per sé e le sue conversazioni di lavoro riguardano solo il lavoro. Ma in qualsiasi momento, l'immagine di Ben potrebbe essere utilizzata per diffondere propaganda politica o messaggi senza il suo consenso.

Di recente si è parlato molto di come i video generati dall'intelligenza artificiale che coinvolgono agenti dell'ICE e proteste si siano diffusi online. Sulla base di tutti i test condotti finora, ho concluso che la creazione di falsa propaganda politica con l'intelligenza artificiale era davvero facile. Ho deciso di fare un altro test, questa volta utilizzando Ben.

Con il permesso di Ben, ho usato la sua foto frontale per creare un deepfake. Ecco l'immagine generata dall'intelligenza artificiale che Nano Banana ha creato:

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Nano Banana | Deepfake / Disinfo | 99.00% AI | 97.00% AI | 98.88% AI | 5.74% AI | 99.00% AI |

Ci sono voluti trenta secondi. Tutto quello che ho dovuto fare è stato trascinare e rilasciare la sua foto in Gemini e chiedergli di "tenere un cartello con scritto abolire l'ICE". Il risultato di Nano Banana non è fotorealistico come gli altri, ma è comunque abbastanza autentico da risultare persuasivo.

Fortunatamente, quattro dei rilevatori hanno identificato con precisione l'immagine: TruthScan (99% AI), Was It AI (99% AI), Sight Engine (97% AI) e AI or Not (97% AI). Winston AI ha fallito, assegnando solo un punteggio di 5% AI.

#9. "Club Void" (generato da Midjourney)

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Viaggio intermedio Generazione completa | Generale | 99.00% AI | 99.00% AI | 89.21% AI | 1.56% AI | 70.00% AI |

Ho generato l'immagine qui sopra utilizzando Midjourney. Più la guardavo, più mi sembrava inquietante. L'estetica è oscura e inquietante. Una presenza oscura sembra emergere da dietro il soggetto. Per creare questa immagine, ho usato la funzione di riferimento estetico di Midjourney e ho semplicemente chiesto che fosse una "ragazza in piedi in un club che sorride". Ho mostrato l'immagine ad alcune persone e tutte hanno pensato che fosse reale.

La maggior parte dei rilevatori ha segnalato l'immagine come generata dall'IA. TruthScan e Sight Engine l'hanno segnalata con un punteggio AI di 99%, mentre AI or Not ha indicato 89%.

WasItAI non è stato altrettanto sicuro dei rilevatori, classificando l'immagine con un punteggio AI di 70%.

Il rilevatore di Winston AI ha fallito completamente, assegnando all'immagine un punteggio AI di 1,56%.

#10 "Ice Box (generato da Midjourney)

Come sono stati valutati i rilevatori di immagini

| Modello di immagine | Categoria | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|

| Viaggio intermedio Generazione completa | Disinfo | 99.00% AI | 92.00% AI | 97.94% AI | 41.20% AI | 72.00% AI |

Ho creato questa immagine utilizzando lo stesso metodo a metà percorso del test precedente. Questa volta, l'obiettivo era generare qualcosa di più scuro. TruthScan è stato il rilevatore più accurato, etichettando l'immagine come 99% AI. Sight Engine e AI or Not hanno entrambi rilevato correttamente l'immagine. Winston AI ha fallito completamente e WasItAI ha ottenuto un punteggio di confidenza molto più basso rispetto a TruthScan, Sight Engine e AI or Not.

Devo dire che in questo caso l'immagine che ho generato potrebbe essere utilizzata o incorniciata in due modi. Da un lato, qualcuno potrebbe utilizzare questo tipo di media (o qualsiasi altro a tema politico/di disordini civili) in una sorta di progetto artistico o creativo per fare una dichiarazione. In questo caso, il rischio sembra minore. La preoccupazione principale che nutro nei confronti di questa categoria di media generati dall'intelligenza artificiale è che vengano utilizzati da individui malintenzionati che sostengono che siano reali.

Riepilogo e risultati: I migliori rilevatori di immagini AI

Ok, ora che abbiamo visualizzato tutti i test, ricapitoliamo: Ho generato 10 immagini AI

- Ho usato ChatGPT, Nano Banana e Midjourney per generare 10 immagini di intelligenza artificiale.

- Ho testato cinque rilevatori di immagini AI sottoponendo ad essi tutte le immagini AI che ho generato.

- TruthScan ha superato tutti i test ed è stato il rilevatore più preciso. AI or Not ha superato 8 test su 10, dimostrando una certa affidabilità. Sight Engine ha fallito 3 test su 10 e ha dimostrato una precisione tutto sommato discutibile. Was It AI ha fallito 4 test su 10 e ha dimostrato una scarsa precisione. Winston AI è stato il rilevatore di immagini AI meno accurato, superando solo 3 test su 10 e sbagliando costantemente la classificazione delle immagini.

Risultati completi dei test

Come si sono comportati cinque popolari rilevatori di immagini AI per frodi, disinformazione, deepfakes e fotografia in generale.

Tutti i 10 test - Ripartizione completa

Ogni punteggio rappresenta l'indice di fiducia dell'AI del rilevatore. Soglia per il passaggio: ≥ 90% AI.

| Test | Categoria | Fonte | TruthScan | Motore a vista | AI o no | Winston AI | WasItAI |

|---|---|---|---|---|---|---|---|

| 1 L'uomo sul cornicione | Generale | ChatGPT | 99.00% | 99.00% | 78.00% | 0.98% | 1.00% |

| 2 La ricevuta falsa | Frode | ChatGPT | 99.00% | 19.00% | 94.48% | 0.04% | 1.00% |

| 3 Pacchetto pericoli | Frode | Nano Banana | 99.00% | 98.00% | 99.10% | 31.98% | 99.00% |

| 4 Farina di scarafaggi | Frode | Nano Banana | 97.15% | 18.00% | 85.87% | 72.29% | 1.00% |

| 5 Autovandalismo | Frode / Disinformazione | Nano Banana | 97.48% | 18.00% | 89.52% | 0.02% | 99.00% |

| 6 Soda Musk & Don | Disinfo | Nano Banana | 99.00% | 99.00% | 99.00% | 0.24% | 86.00% |

| 7 Ancora vivo | Deepfake | Nano Banana | 97.49% | 95.00% | 99.27% | 0.15% | 1.00% |

| 8 Abuso di un Ben | Deepfake / Disinfo | Nano Banana | 99.00% | 97.00% | 98.88% | 5.74% | 99.00% |

| 9 Club Void | Generale | Viaggio intermedio | 99.00% | 99.00% | 89.21% | 1.56% | 70.00% |

| 10 La scatola del ghiaccio | Disinfo | Viaggio intermedio | 99.00% | 92.00% | 97.94% | 41.20% | 72.00% |

Metodologia: Ogni immagine è stata presentata una volta per ogni rilevatore. Un punteggio di ≥ 90% AI è considerato un rilevamento corretto. I punteggi compresi tra 70-89% sono "near-miss". Qualsiasi punteggio inferiore a 70% è un fallimento. AI or Not ha etichettato una generazione a 78%, una a 85% e una a 89% - l'89% è trattato come un near-miss con un asterisco nella tabella riassuntiva.

Osservazioni conclusive e dati

In totale, tra la stesura di questo articolo e i test rigorosi, ho impiegato 25 ore per mettere insieme questo rapporto. Gli strumenti di rilevamento dell'intelligenza artificiale multimodale sono ancora in fase di sviluppo, ma è chiaro che alcuni sono più precisi di altri. Dopo aver testato tutti gli strumenti, TruthScan è quello più accurato. Rilevatore di immagini AI. I test parlano da soli.

Se si desidera accedere a una copia CSV dei dati dei test effettuati in questo articolo, è possibile trovarla qui. Il foglio di calcolo dei dati che ho linkato contiene tutte le richieste originali e i risultati dei test di questo articolo.