Udtrykket deepfake dukkede først op på Reddit i 2017da en bruger med samme skærmnavn begyndte at dele ændrede videoer, der brugte AI til at bytte ansigter, i første omgang i voksenindhold.

Mens Reddit forbød den oprindelige subreddit, havde ideen allerede taget fart.

Men rødderne til denne teknologi går endnu længere tilbage.

Allerede i 1997 var forskere begyndt at eksperimentere med videoredigering ved hjælp af maskinlæring.

Deres tidlige læbesynkroniseringsværktøj, kaldet Omskrivning af video kan få nogen til at se ud, som om de har sagt noget, de ikke har.

Det var ikke teknisk set en deepfake efter nutidens standarder, men det lagde grunden til det, der skulle komme.

Dagens blog handler om, hvordan denne udviklende teknologi fungerer, hvor den dukker op i hverdagen, og hvilke risici og fordele den fører med sig.

Lad os begynde med at forstå, hvad en deepfake egentlig er.

Det vigtigste at tage med:

- Deepfakes er AI-genererede medier, der får folk til at se ud til at sige eller gøre ting, de faktisk aldrig har gjort.

- Med gratis værktøjer og grundlæggende færdigheder kan næsten alle nu skabe overbevisende deepfake-videoer, -billeder eller -lydklip.

- Selv om deepfakes kan være kreative eller underholdende, udgør de også alvorlige risici som svindel, ærekrænkelse og misinformation.

- Du kan spotte de fleste deepfakes ved at bruge detektionsværktøjer eller ved at holde øje med visuelle og adfærdsmæssige uoverensstemmelser.

Hvad er en deepfake?

En deepfake er et falsk medie, som regel en video, et lydklip eller et billede, der er blevet ændret ved hjælp af kunstig intelligens for at få nogen til at se ud eller lyde, som om de gør eller siger noget, de faktisk aldrig har gjort.

Nu må du ikke forveksle det med et dårligt Photoshop-job eller en skitseagtig voiceover.

Vi taler om manipulation på højt niveau ved hjælp af en teknologi, der kaldes deep learning, som er en delmængde af AI.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

Det er, hvad udtrykket "deepfake" indebærer: dyb læring og falsk indhold.

Målet med en deepfake er normalt at skabe noget, der ser ægte nok ud til at narre folk.

Måske har du set de virale videoer af berømtheder, der gør bizarre ting, eller politikere, der kommer med skandaløse udtalelser, som de aldrig ville sige.

Det er klassiske deepfake-brugssituationer. Det, du ser, er ikke ægte, men teknologien bag er blevet god nok til, at din hjerne ikke straks opdager falskheden, medmindre du virkelig kigger efter.

Det er her, værktøjer som TruthScan træde ind.

TruthScan er udviklet til organisationer, der har brug for at verificere medier i stor skala - virksomheder, nyhedsredaktioner, universiteter og offentlige instanser. Det hjælper teams med at spotte manipulation, før falsk indhold skader tilliden eller omdømmet.

Faktisk, ifølge Undetectable AI's forskerteam, 85 % af amerikanerne siger, at deepfakes har undermineret deres tillid til onlineinformation.

Du har lige lært, hvad en deepfake-video eller et deepfake-medie egentlig er, og nu skal vi se på, hvordan folk laver dem.

Hvordan deepfakes bliver lavet

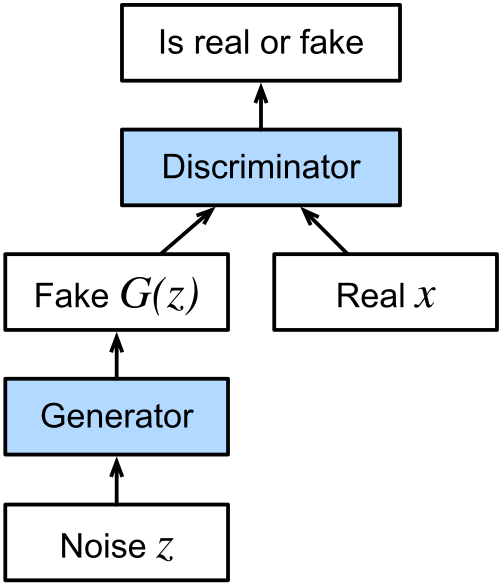

Teknologien bag de fleste deepfakes er en kategori af maskinlæringsalgoritmer, der kaldes generative adversarial networks eller GANs.

GAN'er består af to dele: en generator og en diskriminator.

Generatoren skaber falske medier baseret på, hvad den er blevet trænet i at kopiere, og diskriminatorens opgave er at afsløre, hvad der ser falsk ud.

De bliver ved med at gå frem og tilbage, indtil generatoren bliver bedre til at lave falsk indhold, der kan bestå diskriminatorens test.

Med tiden fører denne frem- og tilbagegang til medier, der ser chokerende realistiske ud.

Hvad er en Deepfake-videogenereringsproces?

Når systemet opbygger en deepfake-video, analyserer det videoer fra flere vinkler, studerer, hvordan personen taler, hvordan ansigtet bevæger sig, og hvordan kroppen bevæger sig.

Alle disse oplysninger bliver ført ind i generatoren, så den kan skabe indhold, der efterligner denne adfærd.

Derefter hjælper diskriminatoren med at finjustere den ved at påpege, hvad der er forkert, indtil slutresultatet ser helt rigtigt ud.

Det er derfor, illusionen holder så godt i bevægelse.

Der bruges et par forskellige teknikker afhængigt af formålet med deepfake-videoen.

Hvis ideen er at få nogen til at se ud til at sige eller gøre noget i en video, som de faktisk aldrig har sagt eller gjort, så er der tale om en såkaldt source video deepfake.

En deepfake autoencoder, der består af en encoder og en decoder, studerer de originale optagelser og anvender målets udtryk, gestus og subtile hovedbevægelser på dem.

Audio Deepfakes

En lyd-deepfake fungerer ved at klone en persons stemme, igen ved hjælp af GAN'er, baseret på optagelser af, hvordan de naturligt taler.

Når modellen er trænet, kan den generere ny tale med den pågældende stemme, selv om personen faktisk aldrig har sagt de pågældende ord.

Et andet lag, der ofte tilføjes, er læbesynkronisering.

Her mapper systemet genereret eller forudindspillet lyd på en video.

Målet er at få læberne i videoen til at matche ordene i lyden.

Eksempler på deepfakes fra den virkelige verden

Deepfakes dukker op overalt i disse dage.

Lad os præsentere dig for nogle populære deepfakes, der viser, hvor langt teknologien er kommet.

Deepfake af præsident Zelenskyy, der beder ukrainske tropper om at overgive sig

I marts 2022, i de tidlige faser af krigen mellem Rusland og Ukraine, dukkede en video op på nettet der viser den ukrainske præsident Volodymyr Zelenskyy og opfordrede sine soldater til at overgive sig.

Det lignede en national tale, komplet med Zelenskyys stemme og væremåde.

Videoen spredte sig på de sociale medier og blev endda lagt ud på en kompromitteret ukrainsk nyhedsside.

Præsidenten handlede hurtigt og udsendte en officiel erklæring gennem sine verificerede kanaler for at afkræfte optagelserne.

Det virale deepfake-billede af pave Frans i en designer-pufferjakke

Nogle gange behøver et deepfake-billede ikke at være ondsindet for at skabe forvirring.

I 2023 bliver et viralt foto af Pave Frans går rundt i en stilfuld hvid Balenciaga-pufferjakke tog internettet med storm.

Den fik titusindvis af visninger og blev delt på tværs af platforme.

Billedet blev skabt ved hjælp af et AI-værktøj kaldet Midjourney af en anonym bruger i Chicago.

Elon Musk Deepfakes brugt i online-svindel

I 2024, deepfakes med Elon Musk blev en central del af flere store online-svindelforsøg.

AI-genererede videoer af Musk begyndte at dukke op på Facebook, TikTok og andre platforme, hvor de promoverede falske kryptovaluta-gaver og investeringsordninger.

Disse klip så og lød bemærkelsesværdigt ægte.

Skaden var ikke kun teoretisk. En ældre pensionist mistede angiveligt næsten $700.000 efter at være blevet overbevist af en af disse videoer.

Joe Biden Deepfake Robocall, der var målrettet amerikanske vælgere

I begyndelsen af 2024, lige før primærvalget i New Hampshire, Vælgere modtog robocalls der lød præcis som USA's præsident Joe Biden.

I opkaldet opfordrede Joe Biden vælgerne til at blive hjemme og gemme deres stemme til parlamentsvalget i november. Hensigten var at forvirre og vildlede vælgerne til at springe primærvalget over.

Hændelsen udløste krav om regulering. Interessegrupper opfordrede USA's føderale valgkommission til at gribe ind, men FEC afviste i sidste ende med henvisning til begrænsninger i dens beføjelser.

I mellemtiden er teleselskabet, der er ansvarlig for at distribuere robotopkaldet indvilligede i at betale en bøde på $1 millioner.

Politisk brug af deepfake ved det indiske valg i 2020

Ikke alle anvendelser af deepfake-teknologi har skadelige eller vildledende hensigter (mere om dette senere i bloggen).

Under valget til Delhis lovgivende forsamling i 2020 blev Bharatiya Janata Party brugte AI til at skræddersy en kampagneannonce til forskellige sproglige målgrupper.

Partiet tog en video af sin leder Manoj Tiwari, der talte engelsk, og brugte deepfake lip-syncing til at producere en version på Haryanvi, en regional dialekt.

Mens voiceoveren kom fra en skuespiller, blev det visuelle ændret, så det matchede den nye lyd, ved hjælp af AI, der var trænet på rigtige optagelser af Tiwari.

Partimedlemmerne så det som en positiv anvendelse af teknologien, der gav dem mulighed for at komme i kontakt med vælgerne på et sprog, de forstod, selv om kandidaten ikke talte det flydende.

Sådan verificerer du deepfakes i den virkelige verden

Med deepfakes, der spreder sig inden for politik, underholdning og daglig kommunikation, har det aldrig været vigtigere at vide, hvordan man kan bekræfte, hvad der er ægte.

På trods af fremkomsten af sofistikerede eksempler findes der pålidelige værktøjer til at imødegå truslen fra deepfake-teknologi.

Uopdagede AI'er AI-videodetektor er et sådant værktøj, der viser, at der findes pålidelige værktøjer til at modvirke de sofistikerede eksempler på deepfake-teknologi.

Det er her, Undetectable AI's Detektion af deepfake kommer ind.

Den er designet til at verificere, om lyd- eller videoindhold er blevet kunstigt genereretved hjælp af avancerede kriminaltekniske modeller, der analyserer bevægelse billede for billede, konsistens på pixelniveau og vokale fingeraftryk.

På få sekunder kan brugerne se, om en video er blevet ændret digitalt - eller om en stemme er blevet klonet af AI.

Du skal bare uploade filen, så giver værktøjet en detaljeret autenticitetsrapport med en visuel opdeling og tillidsscore.

Uanset om det er et viralt klip, et mistænkeligt interview eller en delt optagelse, hjælper Deepfake Detection journalister, undervisere og almindelige brugere med at afdække sandheden bag det, de ser og hører.

Er deepfakes farlige? Risici og bekymringer

Indtil videre har vi set på, hvad en deepfake er, hvordan den bliver lavet, og hvor den allerede er dukket op i den virkelige verden.

Teknologien er unægtelig imponerende, men de risici, der er forbundet med den, er alvorlige og vokser hurtigt.

Deepfakes kan bruges som våben på flere måder. Her er nogle af de største bekymringer.

Ærekrænkelse

Når en persons udseende eller stemme bruges til at skabe falske kommentarer, udtalelser eller videoer, især dem, der er stødende eller kontroversielle, kan det ødelægge omdømmet næsten øjeblikkeligt.

Og i modsætning til ældre hoaxes eller falske citater efterlader en overbevisende deepfake ikke meget plads til tvivl i seerens sind.

I den forbindelse kan deepfakes skabe forargelse, ødelægge relationer eller simpelthen skubbe til en skadelig fortælling.

Det, der er særligt bekymrende, er, at deepfake ikke engang behøver at være perfekt.

Så længe personen er genkendelig, og indholdet er troværdigt nok, kan det efterlade en varig effekt på den offentlige mening.

Informationens troværdighed

En anden stor bekymring er, hvordan deepfakes underminerer selve ideen om sandhed.

Efterhånden som deepfakes bliver mere almindelige, bliver det sværere at vide, om det, vi ser eller hører, er ægte. Med tiden kan det føre til en bredere erosion af tilliden til enhver form for digital kommunikation.

Denne troværdighedskrise går ud over enkelte hændelser.

I demokratiske samfund er folk afhængige af fælles fakta for at træffe beslutninger, debattere emner og løse kollektive problemer.

Men hvis vælgere, seere eller borgere begynder at sætte spørgsmålstegn ved alt, bliver det meget lettere at manipulere med den offentlige mening eller afvise ubekvemme sandheder som "bare endnu en deepfake".

Afpresning

AI-genererede medier kan bruges til fejlagtigt at inkriminere personer ved at få det til at se ud, som om de har gjort noget ulovligt, uetisk eller pinligt.

Den slags fabrikerede beviser kan så bruges til at true eller kontrollere dem.

Og det går begge veje. Fordi deepfakes nu er så realistiske, kan en person, der udsættes for ægte afpresning, hævde, at beviserne er falske, selv om de ikke er det.

Det kaldes nogle gange for afpresningsinflation, hvor mængden af troværdige forfalskninger ender med at reducere værdien af det faktiske belastende materiale.

Troværdigheden af rigtige beviser forsvinder i tågen, og det gør det kun endnu mere kompliceret at afsløre forseelser.

Bedrageri og svindel

Ved hjælp af AI-genererede videoer eller stemmer fra betroede offentlige personer skaber svindlere utroligt overbevisende numre.

I nogle tilfælde bruges deepfakes af berømtheder som Elon Musk, Tom Hanks eller Oprah Winfrey til at reklamere for produkter eller tjenester, som de aldrig har hørt om.

Disse videoer bliver så sendt ud på de sociale platforme, hvor de når ud til millioner.

Selv privatpersoner er i fare, især i spearphishing-kampagner, der er rettet mod specifikke personer med personligt indhold, der er designet til at manipulere eller bedrage.

Ifølge en 2024-rapport fra Forbesdeepfake-drevet svindel har allerede skabt et anslået globalt tab på $12 milliarder, og det tal forventes at blive mere end tredoblet i løbet af de næste par år.

Derfor er detektion ikke kun for enkeltpersoner. Det er afgørende for virksomheder, der håndterer følsomme data, kommunikation eller offentligt indhold. TruthScan hjælper disse organisationer med at identificere ændrede videoer, før misinformation spredes.

Positiv og kreativ brug af deepfakes

Det er værd at bemærke, at ikke alle anvendelser af teknologien er negative.

Mens mange blogs, der forklarer, hvad en deepfake er, fokuserer på misbrug, er der en voksende liste over kreative og produktive måder, deepfakes bliver brugt på.

Men for virksomheder bør selv kunstnerisk eller markedsføringsmæssig brug af deepfakes kontrolleres for ægthed, før de frigives.

Værktøjer som TruthScan kan bekræfte, at der ikke er nogen utilsigtet manipulation tilbage i den endelige version.

Nedenfor er nogle bemærkelsesværdige eksempler.

Film og skuespilpræstationer

Studierne er begyndt at bruge deepfake-teknologi til ting som f.eks:

- Forbedring af visuelle effekter

- Reduktion af produktionsomkostninger

- At bringe karakterer tilbage, som ikke længere er her

Disneyhar for eksempel forfinet deepfake-modeller med høj opløsning, der gør det muligt at skifte ansigt og de-age skuespillere med imponerende realisme.

Deres teknologi arbejder med en opløsning på 1024 x 1024 og kan præcist spore ansigtsudtryk for at få figurer til at se yngre eller mere udtryksfulde ud.

Ud over Hollywood har deepfakes muliggjort globalt kampagnearbejde, som f.eks. da David Beckham blev klonet digitalt til at levere et sundhedsbudskab på flere sprog.

Kunst

I 2018 brugte multimediekunstneren Joseph Ayerle deepfake-teknologi til at skabe en AI-skuespiller, der blandede den italienske filmstjerne Ornella Mutis ansigt med Kendall Jenners krop.

Resultatet blev en surrealistisk udforskning af generationsidentitet og kunstnerisk provokation, en del af et videokunstværk med titlen Un'emozione per sempre 2.0.

Deepfakes er også dukket op i satire og parodier.

Webserien Sassy Justice fra 2020, skabt af South Park-skaberne Trey Parker og Matt Stone, er et godt eksempel.

Den brugte deepfaked offentlige personer til at gøre grin med aktuelle begivenheder og samtidig skabe opmærksomhed om selve teknologien.

Kundeservice

Uden for de kreative industrier finder virksomheder nytte i deepfakes til kundevendte tjenester.

Nogle callcentre bruger nu syntetiske stemmer drevet af deepfake-teknologi til at automatisere grundlæggende forespørgsler, såsom kontoforespørgsler eller klagelogning.

I disse tilfælde er hensigten ikke ondsindet, men blot at strømline.

Opkaldssystemer kan tilpasses ved hjælp af AI-genererede stemmer for at få automatiserede tjenester til at lyde mere naturlige og engagerende.

Da de opgaver, der håndteres, normalt er lavrisiko og gentagne, hjælper deepfakes i denne sammenhæng med at reducere omkostningerne og frigøre menneskelige agenter til mere komplekse problemer.

Uddannelse

Uddannelsesplatforme er også begyndt at indarbejde deepfake-drevne vejledere for at hjælpe eleverne på mere interaktive måder.

Disse AI-drevne vejledere kan levere lektioner ved hjælp af syntetiske stemmer og personlig vejledning.

Værktøjer og teknikker til detektering af deepfake

I takt med at deepfakes bliver mere avancerede og tilgængelige, bliver det også nødvendigt at identificere dem, før de gør skade.

Mennesker og organisationer har også brug for de rigtige værktøjer og teknikker for at være et skridt foran. Så her er et par værktøjer og teknikker.

Til billedfokuseret verifikation, TruthScans AI-billeddetektor analyserer belysning, pixelmønstre og sammensatte elementer for at markere AI-genererede eller redigerede billeder i realtid.

Det hjælper teams med hurtigt at bekræfte ægtheden på tværs af billeder og videoframes, før indholdet publiceres eller deles.

TruthScan: Deepfake-detektion på virksomhedsniveau

TruthScan er designet til virksomheder, universiteter og medieorganisationer, der har brug for verificering af visuelt og auditivt indhold i stor skala.

Den analyserer videoautenticitet på tværs af flere dimensioner:

- Registrering af ansigtsskift: Identificerer manipulerede ansigtstræk billede for billede.

- Adfærdsmæssige fingeraftryk: Registrerer subtile udtryksmønstre og mikrobevægelser, der ikke er i overensstemmelse med naturlig menneskelig adfærd.

- Video retsvidenskab: Undersøger billedkomprimering, pixelstøj og stemmeforvrængning.

- Detektion i realtid: Muliggør live-verifikation under videoopkald, pressemeddelelser eller broadcast-streams.

Med TruthScan kan teams autentificere videoer før offentliggørelse eller offentlig distribution, hvilket forhindrer skader på omdømme og økonomi.

For hverdagsbrugere tilbyder Undetectable AI's værktøjer en lignende beskyttelse på individuelt niveau.

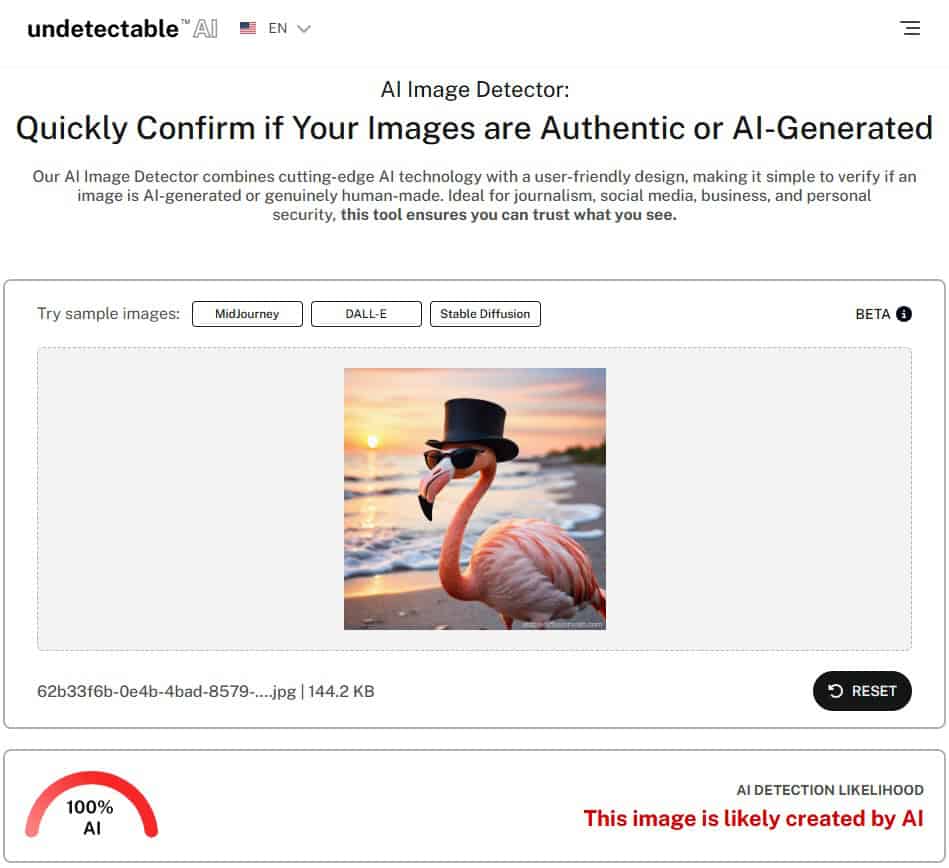

AI-billeddetektor af Undetectable AI

Undetectable AI's AI Image Detector gør det lettere at opdage deepfake, selv for dem uden teknisk baggrund.

Detektoren fungerer ved at analysere forskellige elementer i et uploadet billede, f.eks. farvemønstre, teksturer, ansigtstræk og strukturelle uoverensstemmelser.

Den understøtter detektering af medier, der er skabt med de mest velkendte AI-billedgeneratorer som

- Midt på rejsen

- DALL-E

- Stabil diffusion

- Ideogram

- GAN-baserede modeller

For at bruge det skal du blot uploade et billede, lade værktøjet analysere det og modtage en klar dom med en tillidsscore.

Hvis du er usikker på, om et billede, du er stødt på, er ægte, kan du prøve vores AI-billeddetektor for at se, om der er tegn på AI-manipulation.

Lad os nu sætte Undetectables AI-detektor til testen og se, om den præcist kan se, at billedet er AI-genereret.

Som du kan se, har billed-AI-detektoren fra Undetectable AI markeret dette billede som 100% AI-genereret.

Visuelle og adfærdsmæssige teknikker til manuel detektion

Der findes også praktiske teknikker, som enkeltpersoner kan bruge til at opdage deepfakes manuelt, især i situationer, hvor der er brug for øjeblikkelig analyse.

Nogle visuelle røde flag inkluderer:

- Akavet ansigtspositionering eller mærkelige udtryk.

- Inkonsekvent belysning eller farve på tværs af forskellige dele af billedet eller videoen.

- Flimren omkring ansigtet eller hårgrænsen, især under bevægelse.

- Mangel på naturlig blinken eller uregelmæssige øjenbevægelser.

- Uoverensstemmelser i læbesynkroniseringen, når lyden ikke stemmer overens med talen.

Fra en adfærdsmæssig vinkel kæmper deepfakes ofte med at efterligne subtile menneskelige træk. Vær opmærksom på kropssprog, følelsesmæssige udtryk og sædvanlige bevægelser.

Og i realtidssamtaler, især livevideoer, skal du bede om et sideprofilbillede.

Mange deepfake-modeller kæmper stadig med at gengive en 90-graders ansigtsvinkel eller komplekse bevægelser som at dreje hovedet og samtidig bevare et naturligt udtryk.

At spotte deepfakes i tekst og kontekst

Deepfakes er ikke begrænset til det visuelle. Nogle versioner involverer syntetisk tekst, stemme eller adfærd, der efterligner en persons kommunikationsstil.

Når du analyserer tekstindhold eller dialog, skal du holde øje med:

- Stavefejl og mærkelig grammatik.

- Sætninger, der føles forcerede eller ikke flyder naturligt.

- Usædvanlige e-mailadresser eller inkonsekvente formuleringer.

- Beskeder, der føles ude af kontekst eller ikke er relateret til situationen.

Konteksten er også vigtig. Hvis en video eller et budskab vises i en sammenhæng, der ikke giver mening, som f.eks. en politiker, der tilfældigt annoncerer en vigtig beslutning i et klip af lav kvalitet, er det værd at sætte spørgsmålstegn ved dets ægthed.

Er du nysgerrig på vores AI Detector og Humanizer? Prøv dem i widgetten nedenfor!

Ofte stillede spørgsmål om deepfakes

Er deepfakes ulovlige?

Deepfakes er ikke ulovlige som standard, men de kan blive det, hvis de bryder eksisterende love, f.eks. om ærekrænkelse, børnepornografi eller eksplicit indhold uden samtykke.

Nogle amerikanske stater har vedtaget love rettet mod deepfakes, der påvirker valg eller involverer hævnporno.

Føderale lovforslag som DEFIANCE-loven og NO FAKES Act er også i gang med at regulere ondsindet brug af deepfake-teknologi.

Er der nogen, der kan lave en deepfake?

Ja, næsten alle kan lave en deepfake ved hjælp af gratis eller billig software og AI-værktøjer.

Mange platforme har nu brugervenlige grænseflader, så det er ikke nødvendigt med avancerede tekniske færdigheder for at komme i gang.

Hvordan kan jeg beskytte mig mod deepfakes?

Begræns din eksponering ved at undgå at lægge billeder eller videoer i høj opløsning ud på nettet. Brug privatlivsindstillinger og opdagelsesværktøjer som Uopdagelig AI eller TruthScan for at dobbelttjekke alt mistænkeligt.

Findes der apps til at opdage deepfake?

Ja, TruthScan er designet til forretningsbrugere, der har brug for at analysere videoindhold i stor skala, mens Undetectable AI's detektorer henvender sig til enkeltpersoner og skabere, der ønsker at verificere mindre mængder indhold.

Afsluttende tanker

Deepfakes omformer den måde, vi ser sandheden på online. Uanset om du beskytter dit brand, administrerer offentlig kommunikation eller bare surfer sikkert, gør det en stor forskel at bruge de rigtige detektionsværktøjer.

For virksomheder og institutioner, TruthScan giver beskyttelse på virksomhedsniveau mod AI-drevet misinformation.

For enkeltpersoner, uopdagede AI'er AI-billeddetektor giver en enkel og hurtig måde at tjekke billeder på og holde sig informeret.

Sammen er de med til at sikre, at det, du ser og deler, forbliver ægte.