Sikkerhed og etik inden for AI er stadig en gråzone. På trods af alle de fremskridt, vi har gjort, er mange AI-værktøjer i dag berygtede for at indsamle tvivlsomme data, producere forudindtagede resultater og operere med ringe gennemsigtighed om, hvordan de rent faktisk fungerer.

Claude AI er et af de få systemer, der åbent markedsfører sig på løftet om etisk intelligens. Producenterne hævder, at de har bygget en AI, der kun er afhængig af fritflydende information og evidensbaseret ræsonnement.

Den slags dristige påstande giver naturligvis anledning til spørgsmål.

Hvem står egentlig bag Claude AI? Og hvordan understøtter virksomhedens struktur dens værdier i stedet for at gå på kompromis med dem for at tjene penge?

I denne artikel vil jeg diskutere, hvem der ejer Claude AI, og hvordan virksomhedens ejerskabsmodel understøtter dens moralske kompas.

Det vigtigste at tage med

- Claude AI er bygget og ejet af Anthropic, en AI-virksomhed, der blev grundlagt i 2021 af de tidligere OpenAI-forskere Dario og Daniela Amodei.

- Anthropic fungerer som et public-benefit-selskab (PBC), dvs. at det er juridisk forpligtet til at afbalancere profit med formål. Amazon og Google har investeret stort i virksomheden, men de har ikke noget at skulle have sagt i beslutningsprocessen.

- Claude bruger konstitutionel AI, hvilket betyder, at den selv kontrollerer sine svar i forhold til et nedskrevet sæt etiske regler, der er inspireret af principper om menneskerettigheder, ærlighed og privatlivets fred.

Hvem ejer Claude AI?

Claude AI ejes og udvikles af en San Francisco-baseret virksomhed Antropisken startup inden for kunstig intelligens, der blev grundlagt i 2021.

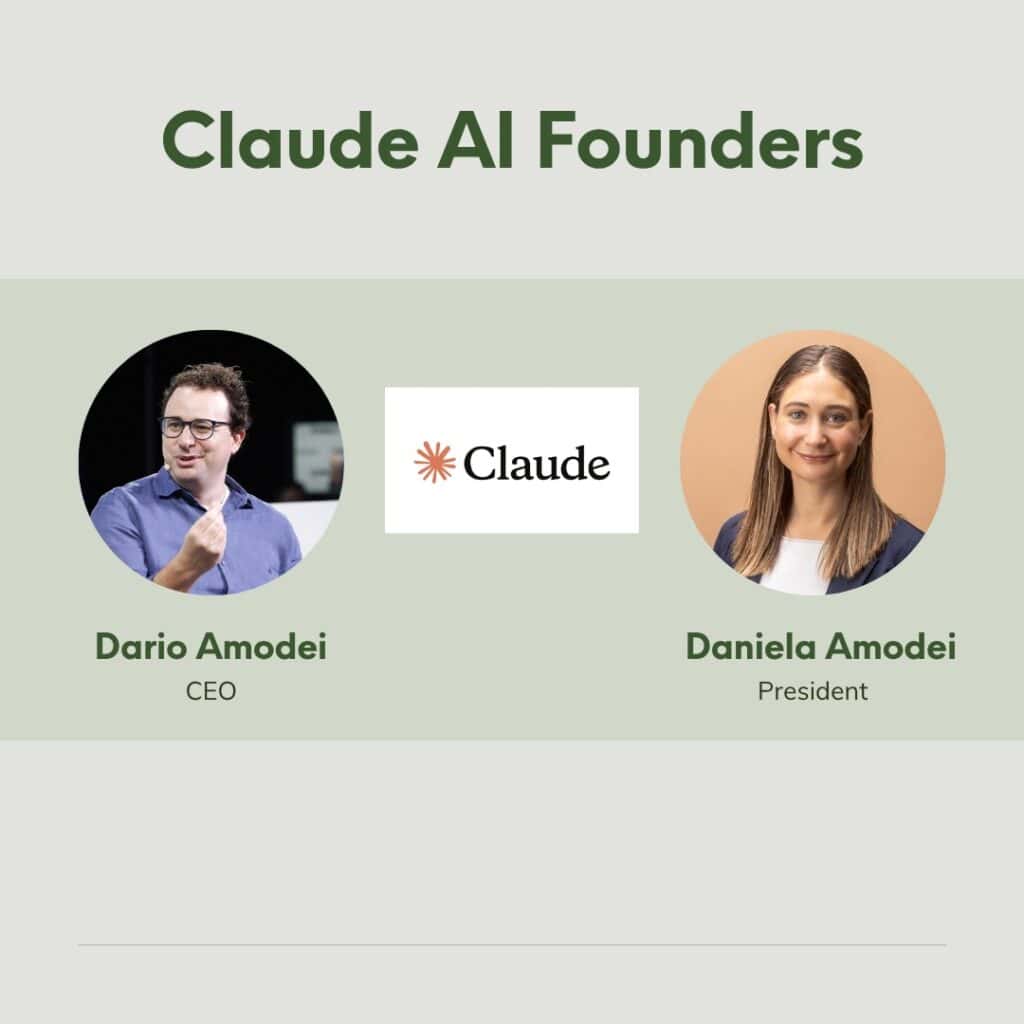

Anthropic blev grundlagt af tidligere OpenAI-forskere, herunder Dario Amodei og Daniela Amodei, som er bror og søster.

Dario, CEO, var tidligere OpenAI's vicepræsident for forskning og en af nøglepersonerne bag GPT-2 og GPT-3. Daniela, præsidenten, var ansvarlig for OpenAI's sikkerhedspolitik.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

Claude, deres AI-flagskibsmodel, er opkaldt efter Claude Shannon, matematikeren, der kaldes informationsteoriens fader.

Den første version af Claude blev lanceret i marts 2023, efterfulgt af forbedrede Claude 2, Claude 3 og de seneste udgaver, der konkurrerer med OpenAI's GPT-modeller.

Anthropics forskningsmetoder, især konstitutionel AI-træning, hvor Claude lærer gennem eksplicitte etiske retningslinjer, danner også grundlaget for mange andre AI-systemer, herunder Undetectable AI's AI-chat.

AI Chat er altså en sikker samtaleassistent, der er inspireret af Claudes strenge designprincipper.

Anthropics investorer og ejerstruktur

Anthropic er et privatejet public-benefit-selskab (PBC), der er stiftet i Delaware. "Public-benefit"-delen betyder, at det er lovligt chartret til at afbalancere profit med en mission.

I Claudes tilfælde handler det om at opbygge AI i overensstemmelse med menneskelige værdier i stedet for at jagte rent kortsigtet økonomisk udbytte.

Hvem ejer Claude AI Anthropic, den stiftende virksomhed?

Virksomhedens ejerskab er delt mellem flere personer.

Grundlæggerne, herunder søskendeparret Dario Amodei (CEO) og Daniela Amodei (President), har stor indflydelse på virksomhedens retning.

Tidlige medarbejdere har også aktieoptioner, som det er almindeligt i nystartede teknologivirksomheder.

De største investorer i virksomheden omfatter:

- Amazon har foretaget en investering på flere milliarder dollars i Anthropic til at blive en af sine største eksterne støtter. I 2023 annoncerede de op til $4 milliarder, og i de efterfølgende træk øgede de denne forpligtelse.

- Google ejer i øjeblikket omkring 14% Anthropic-aktier og vil tilføje yderligere $750 millioner i år, hvilket vil bringe den samlede investering i virksomheden op over $3 milliarder.

Derudover bidrager mange venturekapitalfirmaer (som Spark Capital, Lightspeed Venture Partners og Iconiq Capital) og institutionelle investorer til virksomheden.

Anthropic har også oprettet en "Long-Term Benefit Trust" (undertiden kaldet "purpose trust").

Fonden har visse ledelsesrettigheder for at sikre, at virksomhedens mission forbliver upåvirket af investorer. Det gør Amazon og Google til store mindretalsaktionærer i stedet for kontrollerende ejere.

I september 2025, Anthropic rejste også omkring $13 milliarder i en finansieringsrunde der vurderede virksomheden til omkring $183 milliarder.

Sådan fungerer Claude AI

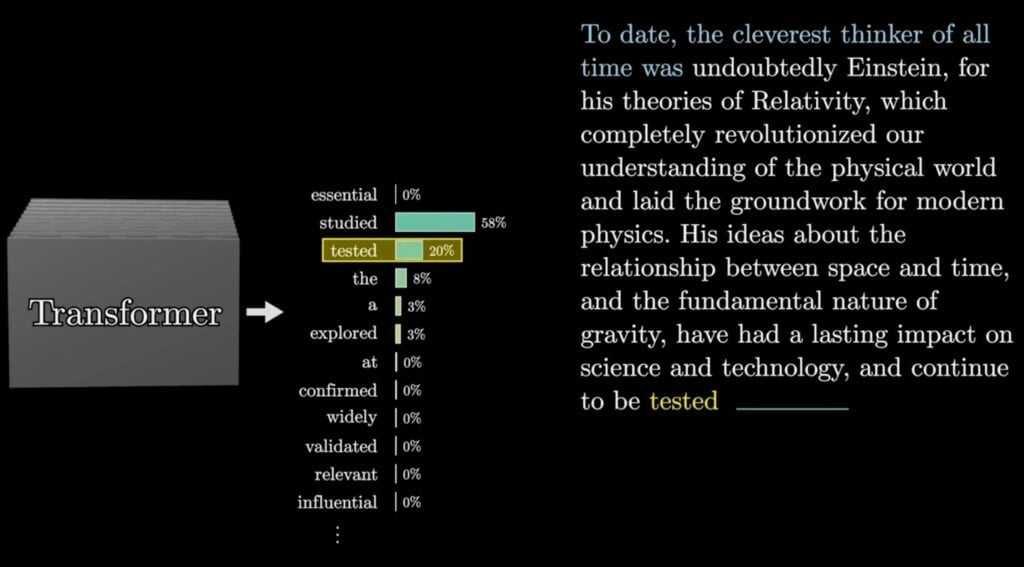

Claude AI fungerer stort set som ethvert generativt AI-værktøj, der har læst det meste af internettet og lært at forudsige et svar på dine anmodninger.

Det er en stor sprogmodel (LLM), der er trænet på massive tekstdatasæt. Men det, der adskiller Claude fra andre chatbots, er, hvordan den er blevet trænet til at tjekke sig selv og opføre sig sikkert.

Teknisk set er Claude bygget på en transformer-arkitektur (den samme generelle struktur, som bruges i GPT- og Gemini-modellerne), hvilket gør det muligt at håndtere lange kontekster.

Du kan Se denne video, hvis du vil forstå, hvordan transformatorarkitekturen fungerer når det gælder træning af AI-modeller.

Claude-model-serien

Claude-serien begyndte med udgivelsen af Claude 1 i marts 2023.

Det var Anthropics første offentlige model, som straks fik offentlig opmærksomhed for at være et mere gennemsigtigt alternativ til andre chatbots.

Claude 2, der blev lanceret i juli 2023, kom med forbedret ræsonnement, skrivning og kontekstuel forståelse.

Claude 3 blev udgivet i marts 2024, og den markerede et stort spring i værktøjets udvikling. Det introducerede en familie af flere andre modeller med forskellige styrker, herunder:

- Haikuden hurtigste og letteste version af Claude 3 til realtidsopgaver og kundeservice-bots

- Sonnet, som afbalancerer hastighed med intelligens, er ideel til forretnings- og forskningsbrug.

- OpusAnthropics hidtil dygtigste model bruges til dybe ræsonnementer, kreativ skrivning og datatung problemløsning.

De nyeste Claude-modeller (fra oktober 2025) er Claude Sonnet 4.5, Claude Haiku 4.5 og Claude Opus 4.1.

| Funktion | Claude Sonnet 4.5 | Claude Haiku 4.5 | Claude Opus 4.1 |

| Beskrivelse | Avanceret model bygget til kodning, automatisering og ræsonnementstunge opgaver. | Let og ekstremt hurtig model, der er ideel til daglige forespørgsler og produktivitet. | Premium-model optimeret til dyb ræsonnering og kompleks analyse. |

| Hastighed | Hurtig | Hurtigste | Moderat |

| Kontekstgrænse | 200.000 tokens (op til 1 million i beta) | 200K tokens | 200K tokens |

| Maksimalt output | 64K tokens | 64K tokens | 32K tokens |

| Udvidet tænketilstand | Tilgængelig | Tilgængelig | Tilgængelig |

| Prioriteret adgang | Inkluderet | Inkluderet | Inkluderet |

| Viden om pålidelighed | Frem til januar 2025 | Frem til februar 2025 | Frem til januar 2025 |

| Cutoff for træningsdata | Juli 2025 | Juli 2025 | Marts 2025 |

| Sammenlignende ventetid | Afbalanceret til de fleste arbejdsgange | Hurtigste i alt | Langsommere, fokuseret på dybde og præcision |

| Ideelle brugsscenarier | Kodningsagenter, automatisering i stor skala, dybdegående skrivning | Hurtige svar, generel produktivitet, chat-applikationer | Forskning, datafortolkning og beslutningstagning, der kræver nuanceret ræsonnement |

| API-priser | $3 / input M-token - $15 / output M-token | $1 / input M-token - $5 / output M-token | $15 / input M-token - $75 / output M-token |

Hvad er konstitutionel AI?

De fleste chatbots trænes gennem en metode, der kaldes "forstærkningsindlæring fra menneskelig feedback."

Det betyder i bund og grund, at folk sætter sig ned og læser tonsvis af AI-genererede svar og markerer dem, der lyder bedst.

Virker det? Ja, det gør det.

Men er det effektivt? Ikke så meget.

Anthropic fik den idé at give modellen en skriftlig forfatning, et sæt klare, gennemsigtige regler for, hvordan den skulle opføre sig, kaldet Konstitutionel AI.

Reglerne er hentet fra virkelige etiske rammer som Verdenserklæringen om Menneskerettigheder og generelle ideer om ærlighed og privatliv.

Claude får lov til at kritisere sine egne svar for at kontrollere, om de følger de forfatningsmæssige regler. Denne proces, som kaldes selvjustering, sikrer, at modellen forbedrer sin dømmekraft uden konstant menneskelig korrektion.

Claude AI vs. ChatGPT vs. Gemini

Claude, ChatGPT og Gemini er alle store sprogmodeller, der er lavet til at forstå menneskeligt input og reagere på det.

Kernekonceptet bag dem alle er også det samme, dvs. at forudsige det næste mest sandsynlige ord i en sætning ved hjælp af massive træningsdata.

Hvert system var dog designet på en anden måde.

Claude, som vi lige har diskuteret, bruger konstitutionel AI til at forfine sine svar baseret på et sæt forudbestemte regler.

Du vil se den holde pauser for at forklare sit ræsonnement eller skitsere sine begrænsninger. Så den er mindre tilbøjelig til at være overmodig.

Desuden har Claudes seneste serie, som omfatter Haiku, Sonnet og Opus, et massivt kontekstvindue på op til 200.000 tokens.

Den er så stor, at den kan analysere hele bøger uden at miste tråden. ChatGPT og Gemini kan ikke komme i nærheden af det endnu.

ChatGPT er den mest udbredte AI-model til dato med en live web-browsing-funktion. Dens modeller (GPT-3.5, GPT-4, GPT-4 Turbo og GPT-5, som er den nuværende avancerede version) trænes ved hjælp af forstærkningslæring fra menneskelig feedback (RLHF).

Den lærer grundlæggende af tusindvis af eksempler på, hvad folk kan lide eller ikke lide i svar. Naturligvis vil ChatGPT producere svar, som du er enig i.

Nogle gange kan de være unøjagtige (dvs. at det af og til "hallucinerer" detaljer), men det er den bedste samtalepartner.

De nuværende versioner af ChatGPT omfatter også DALL-E 3 (til billeder), Code Interpreter/Advanced Data Analysis og brugerdefinerede GPT'er.

Og Gemini, som tidligere hed Bard, kombinerer Google-søgning og AI-modellering på ét sted. Styrken er de verificerede oplysninger i realtid, der hentes fra Google Search.

Da det er et af Google LLC's produkter, er det også fuldt integreret i Google Workspace (Docs, Sheets, Gmail, Slides).

Med hensyn til arkitektur introducerede Gemini 1.5 ræsonnementer med lang kontekst på op til en million tokens i forskningsversionen. Gemini har en tendens til at lyde lidt mere faktabaseret end ChatGPT.

Her er nogle detaljerede benchmarks for at sammenligne ydeevnen for Claude AI vs. ChatGPT vs. Gemini.

| Benchmark/opgave | Claude Sonnet 4.5 | Claude Haiku 4.5 | Claude Sonnet 4 | GPT-5 | Gemini 2.5 Pro |

| Agentisk kodning (SWE-bench verificeret) | 77.2 % | 73.3 % | 72.7 % | 72,8 % (GPT-5 høj) / 74,5 % (Codex) | 67.2% |

| Terminal-kodning (terminal-bænk) | 50.0 % | 41.0 % | 36.4 % | 43.8 % | 25.3% |

| Ydeevne ved brug af værktøj (t2-bench) | Detailhandel 86.2% Flyselskab 70% Telecom 98% | Detailhandel 83,2% Flyselskab 63,6% Telekommunikation 83% | Detail 83,8% Flyselskab 63% Telekommunikation 49,6% | Detail 81.1% Flyselskab 62.6 % Telecom 96.7 % | - |

| Brug af computer (OSWorld) | 61.4% | 50.7% | 42.2% | - | - |

| Matematikkonkurrence (AIME 2025) | 100% (Python) / 87.0 % (uden værktøj) | 96.3% (Python) / 80.7% (uden værktøj) | 70.5% (uden værktøj) | 99.6% (Python) / 94.6% (uden værktøj) | 88% |

| Ræsonnement på kandidatniveau (GPQA Diamond) | 83.4% | 73% | 76.1% | 85.7% | 86.4% |

| Spørgsmål og svar på flere sprog (MMLU) | 89.1% | 83% | 86.5% | 89.4% | - |

| Visuel ræsonnering (MMMU-validering) | 77.8% | 73.2% | 74.4% | 84.2% | 82% |

Brug AI-tjekker for at vurdere, om Claudes svar indeholder AI-genererede mønstre.

Indsæt outputtet i værktøjet, og det analyserer øjeblikkeligt frasering, tone og struktur for at vise, hvor menneskelig eller maskinskrevet teksten lyder.

Det er en hurtig måde at verificere indholdets kvalitet på, før man deler eller publicerer Claudes svar.

Almindelige misforståelser om Claude AI

De fleste af os er ikke vokset op med kunstig intelligens som en del af vores hverdag, så det er kun naturligt, at nogle af begreberne stadig føles abstrakte.

Her er nogle almindelige misforståelser om Claude AI og sandheden bag dem.

- Claude AI kan overgå det menneskelige intellekt

Mange mennesker på nettet ynder at sige, at Claude eller en hvilken som helst anden stor AI-model kan overgå den menneskelige intelligens. Konceptet lyder rigtig sjovt som et plot i en sci-fi-film, men det er ikke sandt.

Alle AI-modeller producerer deres svar baseret på matematik. For hvert input ser de på mønstre i de data, de blev trænet på, for at forudsige, hvilken tekst der skal komme bagefter. Der er ingen selvbevidsthed, forståelse eller egentlig ræsonnering i menneskelig forstand involveret i processen.

Men mennesker bruger hele tiden deres mavefornemmelse til at træffe beslutninger, som psykologer kalder heuristik. Disse instinkter er bygget på levede erfaringer.

Claude kan helt sikkert overhale mennesker, men det er ikke det samme som at være klogere.

- Claude kan lære af sig selv

Ideen om, at Claude kan "lære af sig selv", lyder næsten troværdig, fordi den er bygget på konstitutionel AI.

Men at evaluere sine svar af etiske grunde er ikke ensbetydende med reel læring.

Claude lærer ikke sig selv nye oplysninger eller opgraderer sine evner over tid. Hver eneste forbedring, du nogensinde har set i en ny Claude-version, Claude 1, 2, 3, 4 Opus, Sonnet, skyldes menneskelige ingeniørers indsats.

Konstitutionel AI er simpelthen en kontrolleret træningsmekanisme, som ingeniører har skabt for at få Claude til at anvende konsekvent etisk ræsonnement. Når træningen er færdig, er modellen statisk. Den kan ikke selv tilegne sig ny viden.

- Claude er mere etisk, så den vil ikke lyve eller hallucinere

Mange mennesker antager også, at fordi Claude har ry for at være "etisk", så finder de ikke på noget.

Sagen er, at Claude stadig er en AI-model. Og Anthropic har aldrig påstået, at den var ufejlbarlig. Faktisk har de været forfriskende åbne omkring det.

Virksomheden har åbent sagt, at Claude stadig kan "hallucinere", simpelthen på grund af, hvad den forudsiger, der skal komme som det næste, ifølge statistikkerne.

Claude Docs giver brugerne et praktisk tip om eksplicit at fortælle systemet, at det er okay at sige "jeg ved det ikke". Instruktionen har vist sig at reducere risikoen for hallucinationer.

Kom i gang med vores AI Detector og Humanizer i widgetten nedenfor!

Konklusion

Claude AI er helt klart et benchmark for, hvordan AI bør udvikles på en ansvarlig måde. Værktøjet afspejler Anthropics engagement i at skabe AI, der respekterer og er i overensstemmelse med menneskelige værdier.

Når det er sagt, kommer den grundlæggende, gratis version af Claude med forbrugsgrænser, der nulstilles hver femte time, hvilket er lidt af et problem, hvis du har brug for kontinuerlig adgang.

Hvis du leder efter en tilsvarende troværdig, sikkerhedsbevidst AI-platform, som også er gratis at bruge, kan du tjekke Undetectable AI ud.

Ud over en simpel chatbot har Undetectable AI også virkelig seje specialværktøjer som AI Humanizer, AI Paraphraser, Grammar Checker, AI SEO Writer osv. Alle produkterne følger den samme høje standard for privatlivets fred som Claude!

Giv Uopdagelig AI et forsøg i dag!