Kan du huske, da DALL-E AI-billedgeneratoren for nylig blev tilgængelig for alle tilbage i 2021?

Allerede året efter anslog Forbes, at over 1,5 millioner brugere skabte to millioner billeder om dagen ved hjælp af DALL-E.

Hvis du har forsøgt dig med AI-genereret kunst, var DALL-E sandsynligvis også dit første stop.

Men de tidlige dage, hvor man kun brugte AI for sjov, er for længst forbi. I dag bruges AI-genererede billeder til forretningsformål.

A Undersøgelse i marts 2023 fandt ud af, at 36% af marketingfolk nu bruger AI til at skabe hjemmesidebilleder, mens 39% bruger det til indhold på sociale medier.

Men selv om mange omfavner AI's kreative potentiale, er det kun få, der virkelig forstår, hvordan AI-billedgenerering fungerer bag kulisserne.

Hvordan går en AI-model fra at analysere millioner af billeder til at producere et helt nyt, aldrig før set billede baseret på en simpel tekstbesked?

Det er præcis, hvad jeg vil gennemgå i denne guide. Vi gennemgår, hvad AI-billedgenerering er, hvordan det fungerer, hvilke AI-modeller der er bag kulisserne og meget mere.

Så lad os begynde.

Hvad er AI-billedgenerering?

AI-billedgenerering er processen med at bruge kunstig intelligens-modeller til at skabe billeder fra bunden.

Du giver bare et par linjer tekst til en AI-billedgenerator, og en algoritme, der er blevet trænet på et absurd stort datasæt af billeder, kommer med et billede på få sekunder. Hvis du nogensinde har undret dig over hvordan man genererer AI-billederer processen overraskende enkel for brugeren: Skriv en tekst, og modellen oversætter dine ord til et helt nyt billede.

Processen involverer ingen pensler eller kameraer.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

Algoritmen er blevet trænet på tonsvis af malerier, fotos og digitale kunstværker fra alle livets områder og kan nu producere noget helt nyt baseret på dine instruktioner.

Med helt nyt mener jeg alt, hvad en menneskelig hjerne kan komme i tanke om, hvad enten det er virkeligt eller uvirkeligt, eksisterende eller ikke-eksisterende.

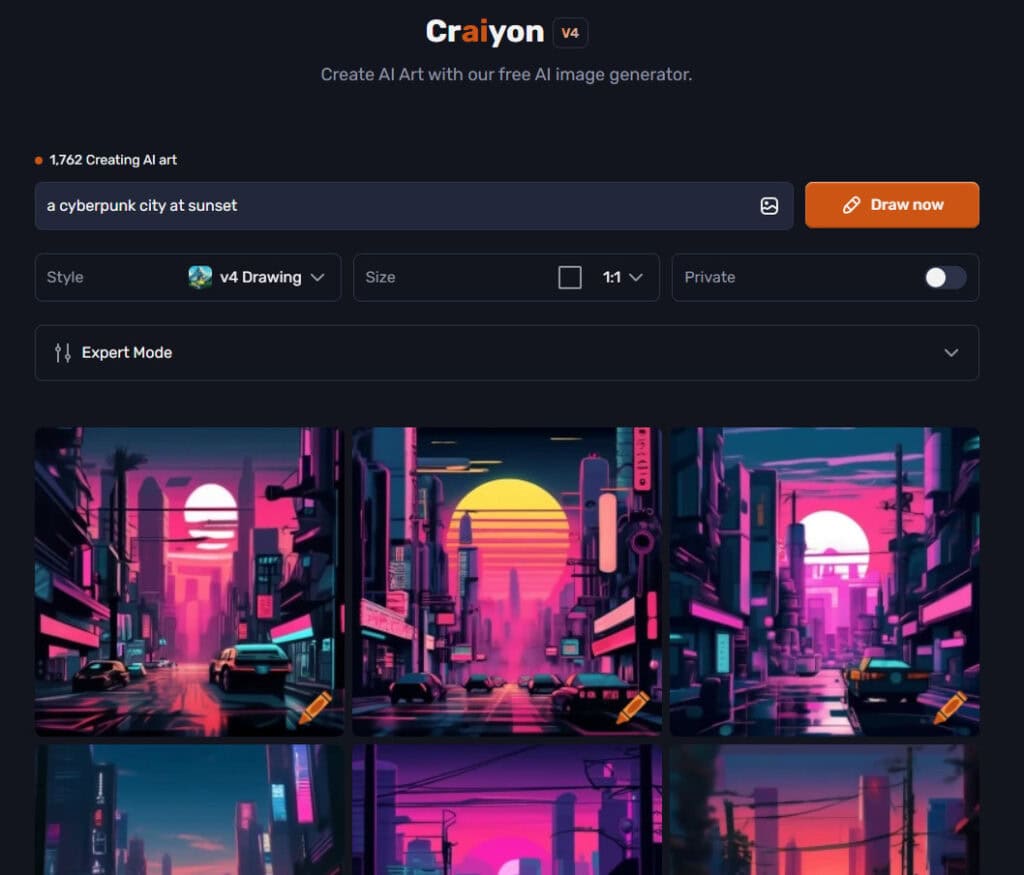

Bed f.eks. om "en cyberpunk-by ved solnedgang", og AI vil skabe et aldrig før set billede, der matcher din beskrivelse.

Og nej, AI'en trækker ikke fra et eksisterende fotografi eller kopierer et andet kunstværk. Den skaber noget helt unikt hver gang.

Men hvordan viser billederne sig at være?

Billederne er nogle gange fantastiske. Nogle gange er de helt hen i vejret. (Har du nogensinde bedt en AI om at skabe menneskehænder?? Held og lykke).

Komplekse scener med præcise interaktioner mellem objekter kan nogle gange forvirre AI'en og føre til visuelle fejl, der ser ud, som om de hører hjemme i en alternativ virkelighed.

Nyere modeller er dog blevet meget bedre til at tegne hænder, fødder og andre indviklede detaljer.

Nogle af de største AI-billedgeneratorer omfatter:

- DALL-E

- Stabil diffusion

- Midt på rejsen

- Craiyon

Hver af disse har sine egne styrker. Nogle er gode til fotorealisme, mens andre er bedre til stiliseret kunst.

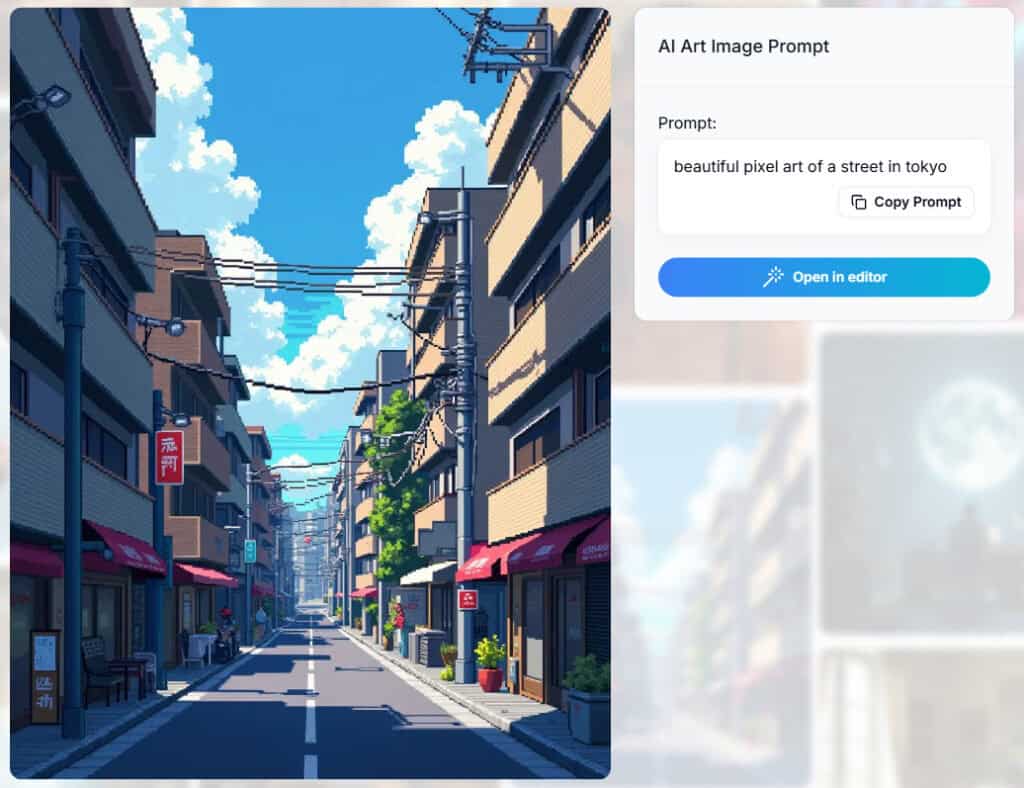

Se på dette pixel art-billede af Stable Diffusion:

Så hvordan gør AI egentlig dette på et teknisk niveau? Lad os se nærmere på, hvordan AI-billedgenerering fungerer.

Hvordan AI bruger maskinlæring til at skabe billeder

Hovedaktøren bag AI-billedgenerering er maskinlæring, eller kort sagt ML.

Maskinlæring er en kompleks computerramme, der gør det muligt for algoritmer at lære mønstre, genkende relationer og generere nye data uden megen indgriben fra mennesker.

Takket være deres træning på massive datasæt lærer ML-modeller helt af sig selv, hvordan objekter, farver og teksturer skal se ud.

Der er to hovedteknikker til at træne disse modeller:

- Overvåget læring: AI'en får vist billeder sammen med deres beskrivelser, hvilket hjælper den med at forbinde ord med visuelle elementer.

- Ikke-overvåget læring: AI'en lærer ved at analysere mønstre i massive datasæt uden instruktioner fra mennesker og giver selv mening til visuel information.

På et mere teknisk niveau er neurale netværk den underliggende teknologi her.

Det er computermodeller, der efterligner den menneskelige hjerne og behandler information i lag, lidt ligesom mennesker.

Det er selvfølgelig kun begyndelsen.

Dernæst lærer du trin for trin, hvordan billedgenerering med AI egentlig fungerer.

Sådan fungerer AI-billedgenerering (trin for trin)

Vi har dækket de store linjer, men hvordan fungerer AI-billedgenerering i praksis?

Selve processen er ikke så enkel som at trykke på en knap og se magien ske. Bag hvert AI-genereret billede ligger en omhyggeligt struktureret pipeline.

Her kan du se rørledningen i ørneperspektiv.

1. Træning på massive billeddatasæt

Før en AI-model kan generere billeder, skal den først se en masse. Og med en masse mener jeg millioner (eller endda milliarder) af billeder, ofte hentet fra internettet.

Disse billeder er parret med tekstbeskrivelser, der hjælper AI'en med at forstå, hvordan ord relaterer til visuelle elementer.

Når den ser "en fluffy golden retriever ligge i solen", lærer den, at "fluffy" refererer til tekstur, "golden" refererer til farve, og "ligge i solen" påvirker lys og skygger.

Denne fase er af afgørende betydning, fordi en AI-model kun er så god som dens træningsdata.

Hvis datasættet er ubalanceret, f.eks. mest kunst i vestlig stil eller forudindtagede skildringer af visse erhverv, kan AI's output vil afspejle disse fordomme.

Det er derfor, forskere konstant finjusterer datasæt manuelt for mangfoldighed og retfærdighed for at forhindre uheld som AI-genererede CEO'er, der har tendens til at være midaldrende hvide mænd som standard.

2. Brug af neurale netværk til at genkende funktioner

Når AI'en har indtaget et bjerg af billeder, begynder den at behandle mønstre ved hjælp af neurale netværk.

Da det ikke er praktisk at huske specifikke billeder, og det ville være smertefuldt begrænsende, nedbryder AI'en dem til numeriske værdier, spotter tendenser og tildeler sandsynligheder til relationer.

For eksempel lærer den, at guitarer normalt forbindes med hænder, at katte har tendens til at have knurhår, og at sollys kaster bløde skygger.

Hvis du beder AI'en om "en flamingo med høj hat og solbriller, der danser på en strand ved solnedgang, gengivet i akvarelstil", vil den ikke finde et eksisterende billede at kopiere.

I stedet genererer den et originalt billede ved at sammensætte begreber, den har lært (flamingo, høj hat, solbriller, strand, solnedgang og akvarelstil).

3. Generering af billeder ved hjælp af AI-modeller

På dette stadie er AI'en klar til at skabe billeder, men den maler dem ikke bare streg for streg som en menneskelig kunstner.

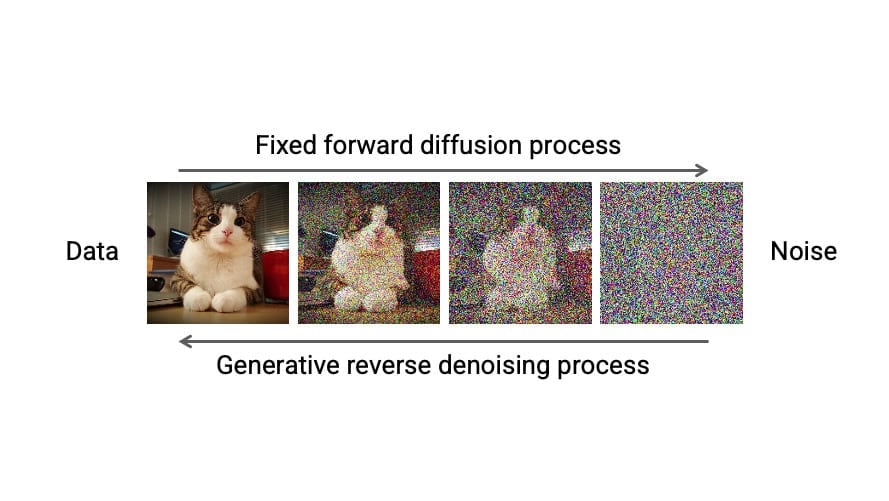

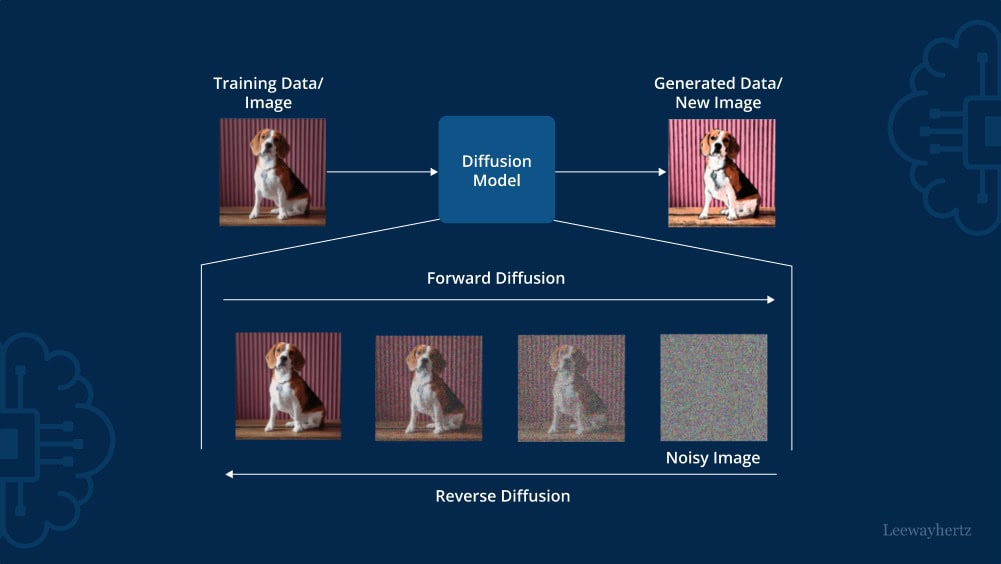

I stedet bruger mange modeller en proces, der kaldes diffusion, som er en teknik, hvor AI'en lærer at "gendanne" billeder fra visuel støj.

Sådan her fungerer det:

- Forskerne tilføjer lag af tilfældig støj (f.eks. støj på en gammel tv-skærm) til billederne under træningen.

- AI'en lærer at genkende de skjulte billeder under støjen.

- Derefter vender den processen om og fjerner gradvist støj, indtil den genskaber et klart, detaljeret billede.

Med tiden bliver AI'en så god til denne proces, at den slet ikke længere har brug for et originalbillede.

Når du i stedet indtaster en tekst, starter AI'en med ren støj og forfiner den pixel for pixel, indtil der opstår et helt nyt billede.

4. Forbedring af output gennem iterativ træning

Selv om AI-genererede billeder kan være utroligt realistiske, er processen ikke perfekt.

Nogle gange genererer en model et billede, der ser næsten rigtigt ud, men så bemærker man et bizart ekstra lem eller et ansigt, der ser smeltet ud. Det er her, AI-modeller har brug for iterativ træning.

AI-modeller forbedres gennem et feedback-loop, hvor de konstant sammenligner deres genererede billeder med virkelige billeder.

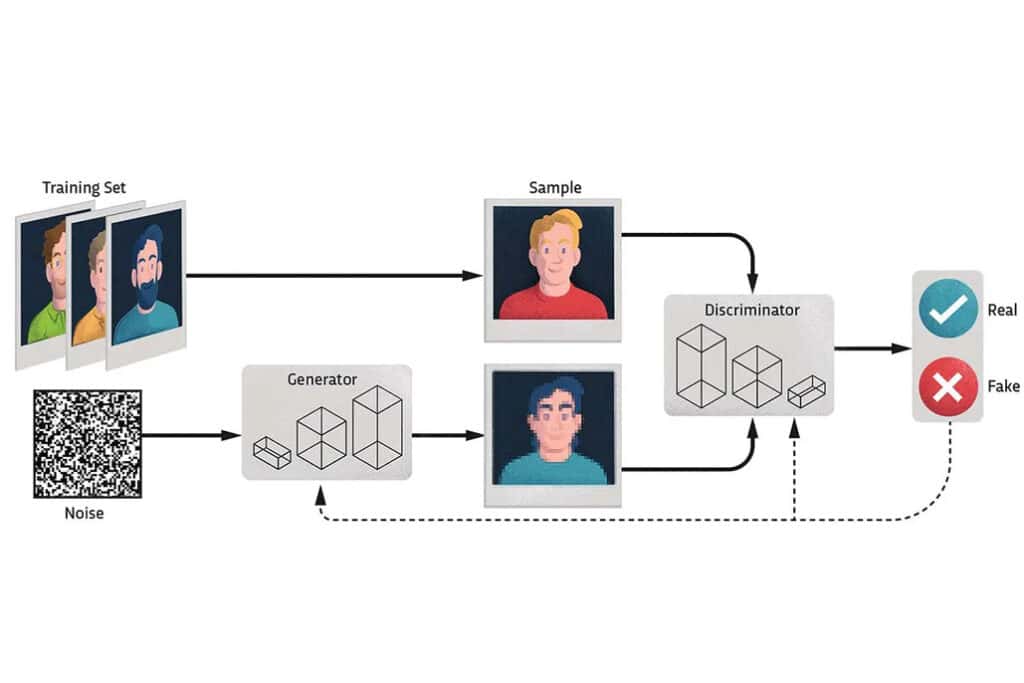

Dette gøres ofte ved hjælp af to konkurrerende netværk:

- En generator, som skaber nye billeder

- En diskriminator, som forsøger at afgøre, om billederne er ægte eller falske

Generatoren bliver bedre til at narre diskriminatoren, og diskriminatoren bliver bedre til at spotte forfalskninger.

Denne uendelige leg presser AI'en til at blive bedre, indtil de genererede billeder næsten ikke kan skelnes fra de rigtige.

For hver iteration bliver AI-modellerne smartere, hurtigere og bedre til at forstå subtile detaljer som f.eks. hvordan refleksioner fungerer på vand, hvordan forskellige materialer interagerer med lys og, ja, hvordan man endelig kan generere menneskehænder, der ikke ser ud som om, de tilhører en ældgammel rædsel.

Typer af AI-billedgenereringsmodeller

Under motorhjelmen bruger AI-billedgeneratorer forskellige typer modeller til at bringe pixels til live.

Her er et par hovedtyper af disse modeller.

1. Generative Adversarial Networks (GAN'er)

Som nævnt tidligere, GAN'er består af to neurale netværk - en generator og en diskriminator - som konkurrerer mod hinanden. Generatoren skaber billeder, mens diskriminatoren evaluerer deres ægthed.

Med tiden forbedrer generatoren sin evne til at producere realistiske billeder, der kan narre diskriminatoren. GAN'er bruges i vid udstrækning til at skabe fotorealistiske billeder i høj kvalitet.

2. Diffusionsmodeller

Diffusionsmodeller genererer billeder ved gradvist at tilføje støj til data og derefter lære at vende processen.

Modellen starter med tilfældig støj og forfiner billedet trin for trin, guidet af en tekstprompt.

Denne tilgang er kendt for at producere meget detaljerede og forskelligartede resultater.

3. Variationelle autokodere (VAE'er)

VAE'er kodning af billeder til en komprimeret latent rum og derefter afkode dem tilbage til billeder. Ved at tage prøver fra dette latente rum kan VAE'er generere nye billeder, der ligner træningsdataene.

De bruges ofte til opgaver, der kræver kontrolleret og struktureret billedgenerering.

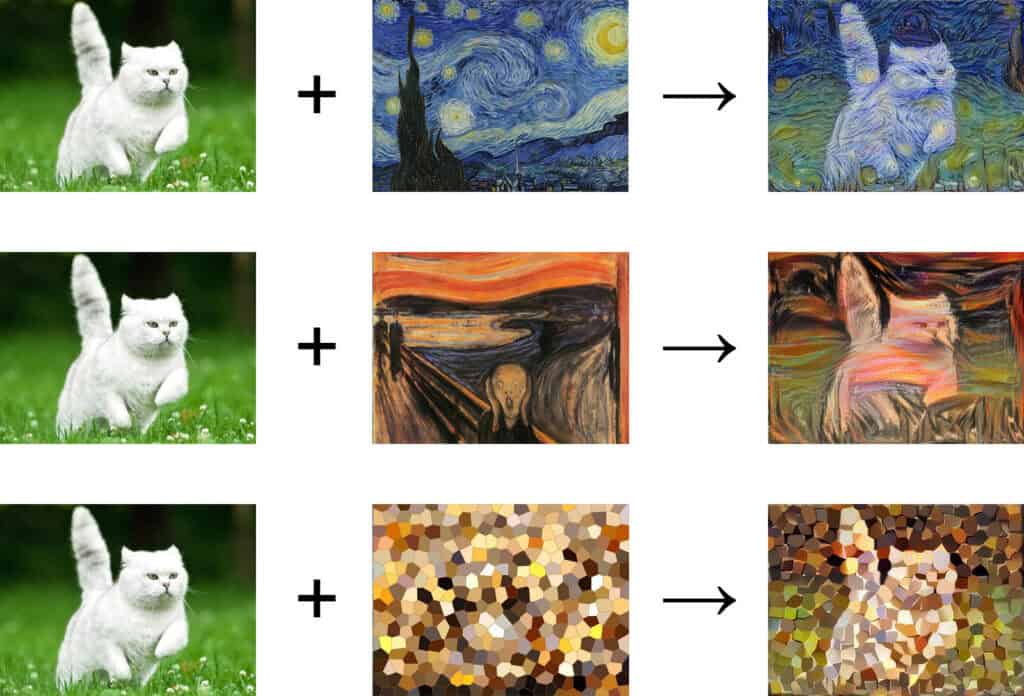

4. Overførsel af neural stil (NST)

Har du nogensinde ønsket at se dit kæledyrs portræt i Van Goghs Starry Night-stil? Det får du brug for NST's ekspertise.

NST tager to eksisterende billeder, et for indhold og et for stil, og blander dem.

Det bruger dybe neurale netværk til at isolere og blande funktioner som teksturer, farver og mønstre og skabe visuelt slående output, der efterligner stilen i berømte kunstværker eller unikke designs.

Anvendelser af AI-billedgenerering

Det, der engang krævede timevis af manuelt designarbejde, kan nu klares på få minutter med det rigtige Værktøjer til skabelse af AI-indhold.

Her er nogle af de mest effektive måder, AI-billedgenerering bruges på i dag:

- Reklamekreative: Brands bruger AI-billedgeneratorer til at skabe reklamegrafik, produktgengivelser og kampagnebilleder til en brøkdel af prisen og tiden i forhold til traditionelle designmetoder.

- Kunst: Kunstnere og designere bruger AI til at skabe nye stilarter, remixe eksisterende æstetik og udforske visuelle koncepter, som de måske ikke ville have forestillet sig på egen hånd.

- Miniaturer og billeder til blog og sociale medier: Med AI behøver bloggere ikke længere at gå på jagt efter stockfotos eller stole på generisk grafik. De kan simpelthen generere tilpassede billeder, der matcher deres indholds tema.

- Spiludvikling og virtuelle verdener: Udviklere af videospil bruger AI til at generere detaljerede teksturer, karakterdesigns og nogle gange hele landskaber.

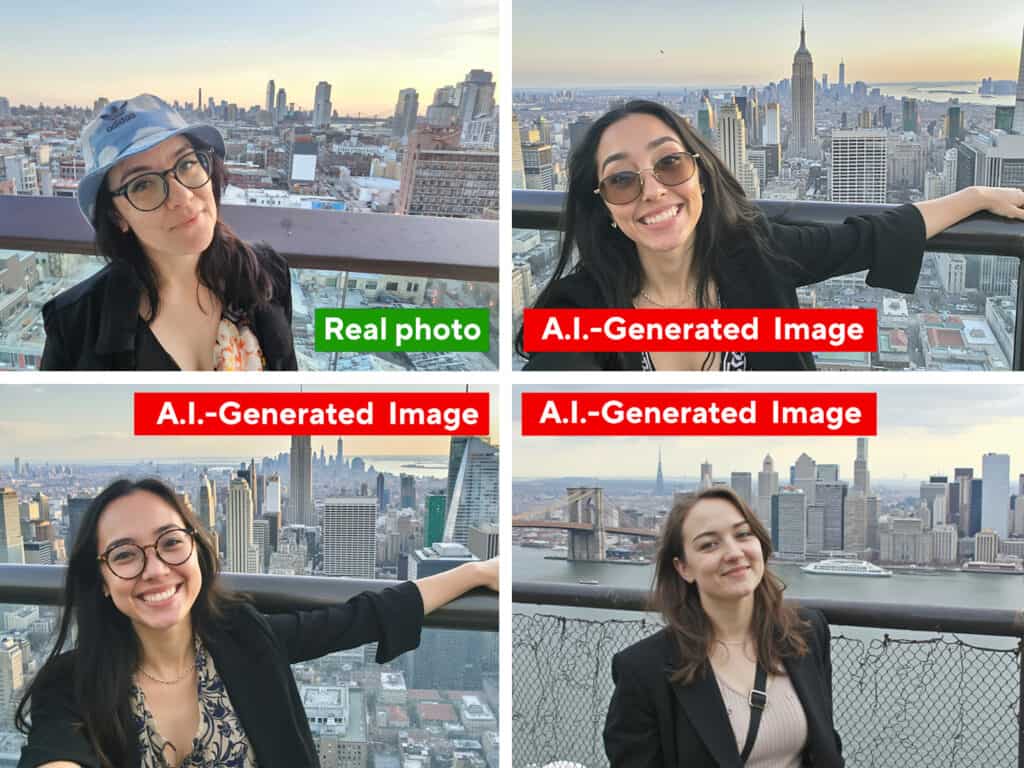

Sådan tjekker du, om et billede er AI-genereret

Det bliver sværere at se forskel på menneskeskabte og AI-skabte billeder, da AI genererer mere realistiske billeder for hver dag, der går.

Der findes dog et par manuelle teknikker til at kontrollere, om et billede er AI-genereret.

Se efter unaturlige detaljer

AI er ikke perfekt, og nogle gange afslører små, men markante fejl den.

Hold øje med mærkeligt formede fingre, unaturlige ansigtsudtryk, inkonsekvent belysning eller asymmetriske mønstre, der ikke stemmer overens med fysikken i den virkelige verden.

Selv avancerede AI-modeller kæmper nogle gange med at gengive realistiske hænder, øjne eller komplekse teksturer.

Se efter alt for glatte eller slørede områder

AI-genererede billeder har ofte en uhyggelig blødhed, især i områder med mange detaljer.

Hvis et billede ser for glat ud, mangler fin tekstur eller har slørede kanter, hvor der burde være skarphed, kan det være resultatet af AI-generering.

Analyser skygger og refleksioner

Et af AI's svage punkter er en nøjagtig gengivelse af den måde, lyset interagerer med objekter på.

Refleksioner i spejle eller vinduer stemmer måske ikke overens med den faktiske scene, og skygger kan virke inkonsekvente eller fysisk umulige.

Hvis noget ved belysningen virker "forkert", er det værd at undersøge nærmere.

AI Stealth Writer: Broen til autentisk indhold

Ligesom man leder efter “hacks” i belysningen for at verificere et billede, leder AI-tekstdetektorer efter “burstiness” og “perplexity” for at markere maskinskrevne tekster.

For at bygge bro mellem et råt udkast og et professionelt stykke arbejde, henvender mange skabere sig til vores Undetectable AI's AI Stealth Writer.

Brug omvendt billedsøgning

Hvis du har mistanke om, at et billede er AI-genereret, kan du prøve at køre en Omvendt billedsøgning.

Du kan bruge Googles billedsøgningsfunktion til dette formål.

AI-genererede billeder har ofte ikke en oprindelse på nettet, i modsætning til stockfotos eller brugergenereret indhold.

Hvis et billede ikke dukker op i søgeresultaterne, kan det være skabt af kunstig intelligens.

Zoom ind og undersøg de fine detaljer

Ved et hurtigt blik kan AI-billeder se fejlfri ud.

Men når man zoomer ind, kan man se mærkelige artefakter, gentagne teksturer eller forvrængninger i små detaljer (som mønsteret i hår eller stof).

På trods af alle disse manuelle metoder er der mange finere detaljer, som det menneskelige øje simpelthen ikke kan fange.

Men AI-billeddetektorer er tilgængelige for os nu, så vi behøver ikke at bekymre os om manuelt at detektere billeder til AI.

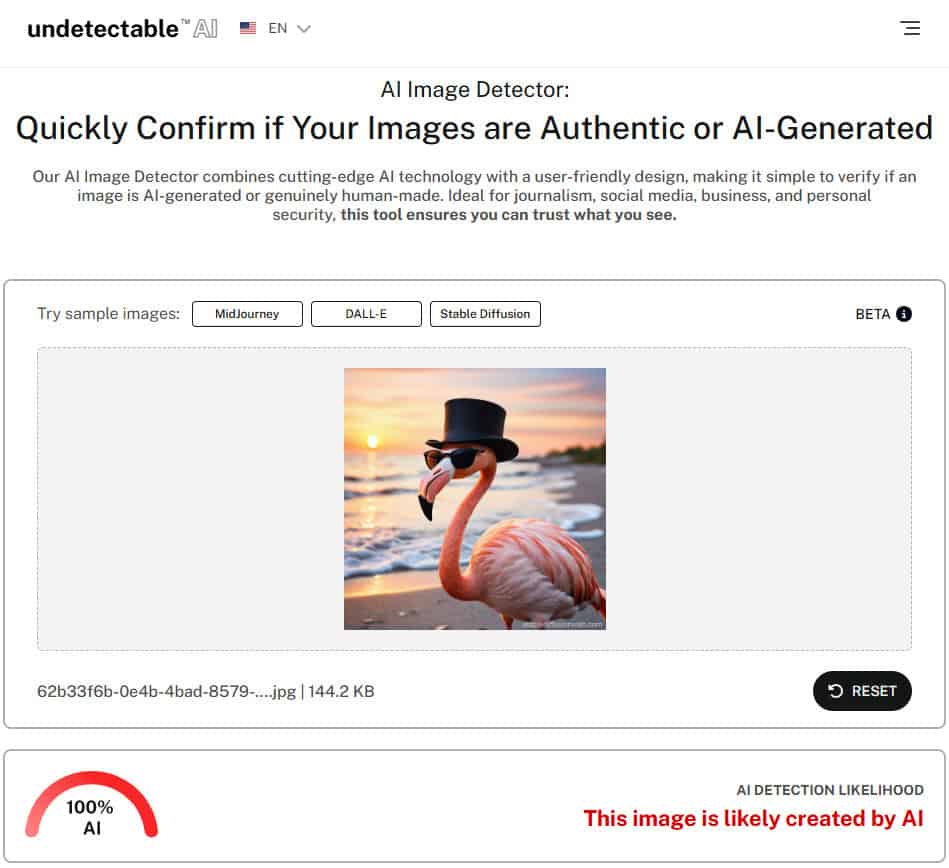

Tag uopdagelige AI'er AI-billeddetektorfor eksempel.

Du skal blot uploade billedet, og detektoren analyserer ved hjælp af maskinlæringsalgoritmer billedet på et dybere niveau for at opdage AI-fingeraftryk, der måske ikke er synlige med det blotte øje.

Kan du huske billedet af flamingohatten, der blev genereret af Stable Diffusion AI for et par år siden?

Den kunne ikke narre Undetectable AI. Se selv nedenfor.

Så hvis du er usikker på, om et billede er AI eller ej, kan du bruge Undetectable AI's AI-billeddetektor for at få svaret.

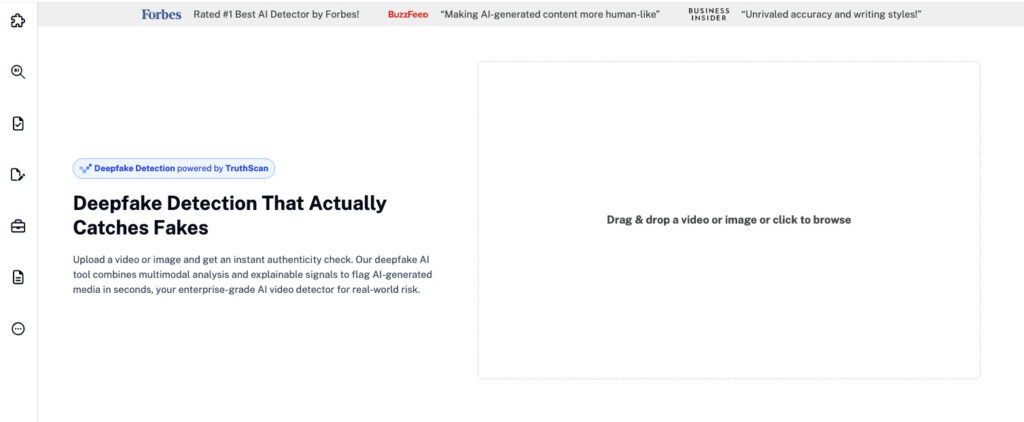

Prøv også at bruge TruthScans AI-billeddetektor.

Du skal blot uploade dit billede, så analyserer det automatisk hver eneste pixel, tekstur og metadatalag for at afsløre subtile tegn på AI-manipulation, som selv professionelle kan overse.

Det er en hurtig og pålidelig måde at kontrollere, om et billede virkelig er optaget eller skabt af AI, før du stoler på det eller deler det.

Opdagelse af subtile AI-markører med Deepfake Detection

For billeder, der næsten ser for virkelige ud, er Undetectable AI's Detektion af deepfake tager billedverifikation til det næste niveau.

Den identificerer subtile uoverensstemmelser der afslører syntetiske billeder som uregelmæssig belysning, unaturlige ansigtsblandinger eller forvrængninger på pixelniveau, der er usynlige for det blotte øje.

Du skal blot uploade dit billede eller din video til Deepfake Detection for at få en klar autenticitetsscore med visuelle heatmaps, der viser, hvor der kan være sket manipulation.

Ved at parre Deepfake Detection med AI Image Detector kan du verificere både overfladiske og dybe strukturelle signaler, hvilket sikrer fuld tillid til dine billeders ægthed.

Afsluttende tanker

AI-billedgenerering er ikke længere et futuristisk koncept.

Det er her, det udvikler sig, og det er ved at blive en grundlæggende del af skabelsen af digitalt indhold.

Så at forstå, hvordan AI-billedgenerering fungerer, giver dig en afgørende fordel i dagens atmosfære, uanset om det er på jobmarkedet eller i din personlige omgangskreds.

Samtidig er det lige så vigtigt at have evnen til at skelne mellem AI-genererede billeder på grund af dens voksende brug til at lave deepfakes.

Denne evne hjælper dig også med at få øje på AI-spor i dine billeder, så du kan fjerne dem for at omgå AI-indholdsregistrering.

Men med Undetectable AI's AI-billeddetektor er det helt vores hovedpine.

Ved hjælp af avancerede maskinlæringsalgoritmer kan vores detektor identificere AI-genererede billeder med præcision.

Tag ikke vores ord for det, når du kan Test det selv.

Mens du er her, så glem ikke at udforske vores AI Detector og Humanizer i widgetten nedenfor!