Den berømte Mona Lisa, loftet i Det Sixtinske Kapel, Vermeers Pige med perleørering og Van Goghs Stjernenatten er alle mesterværker.

Men der var en tid, hvor hver enkelt krævede måneder eller endda år af dedikeret arbejde.

Så kom den digitale æra, og vi gik fra måneder af arbejde til timer af arbejde med værktøjer som Photoshop, Illustrator og Corel Painter.

Nu befinder vi os i den mest avancerede æra af dem alle: æraen med AI-kunstgenerering.

I dag kan enhver med en prompt og lidt know-how generere billeder på få sekunder.

Men hvis AI på få sekunder kan skabe det, som tidligere tog mestre år at skabe, hvor lang tid tager det så at generere et AI-billede?

Og betyder den forskel overhovedet noget, når man sammenligner sekunder med århundreder?

I denne blog vil vi gennemgå, hvad AI-billedgenerering er, de gennemsnitlige genereringstider for populære værktøjer, hvorfor hastighederne varierer så meget, og de vigtigste faktorer, der påvirker, hvor hurtigt dit billede vises.

Du får også praktiske tips til at fremskynde AI-generering, hvordan professionelle optimerer arbejdsgange, og hvordan AI-detekteringsværktøjer kan verificere billeder endnu hurtigere, end de bliver oprettet.

Lad os dykke ned i det.

Det vigtigste at tage med

- AI-billeder tager normalt 1-60 sekunder at generere, hvor de fleste professionelle værktøjer i gennemsnit bruger 10-30 sekunder pr. billede.

- Realtidsværktøjer kan skabe billeder på under 1 sekund, mens kunstneriske platforme som Midjourney tager 30-60 sekunder for at opnå resultater af højere kvalitet.

- Højere opløsning forsinker genereringen og tilføjer 70–80% mere tid.

- Hardware er vigtigt: En RTX 4090 kan generere ca. 75 billeder i minuttet, mens en RTX 3060 bruger 10-15 sekunder pr. billede.

- Komplekse spørgsmål med flere emner eller detaljer kan tilføje 30–50% ekstra tid.

- Hastigheden er forbedret 120 gange siden 2022, fra 60-90 sekunder pr. billede til under 1 sekund med de hurtigste værktøjer.

Hvad er AI-billedgenerering?

AI-billedgenerering betyder at skabe nye billeder ud fra tekstprompter, tilfældig støj eller andre input. Generering er ikke det samme som redigering.

Ved redigering starter vi med et eksisterende billede og justerer visse elementer, mens vi bevarer originalen intakt.

- For eksempel: Du tager et foto og foretager justeringer, som f.eks. at ændre en bils farve fra rød til blå, samtidig med at du bevarer grundbilledet. AI-billedgeneratorer som Photoshops AI-værktøjer og Googles Gemini 2.5 Flash Image specialiserer sig i disse redigeringer.

I billedgenerering skaber vi visuelle elementer fra bunden.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

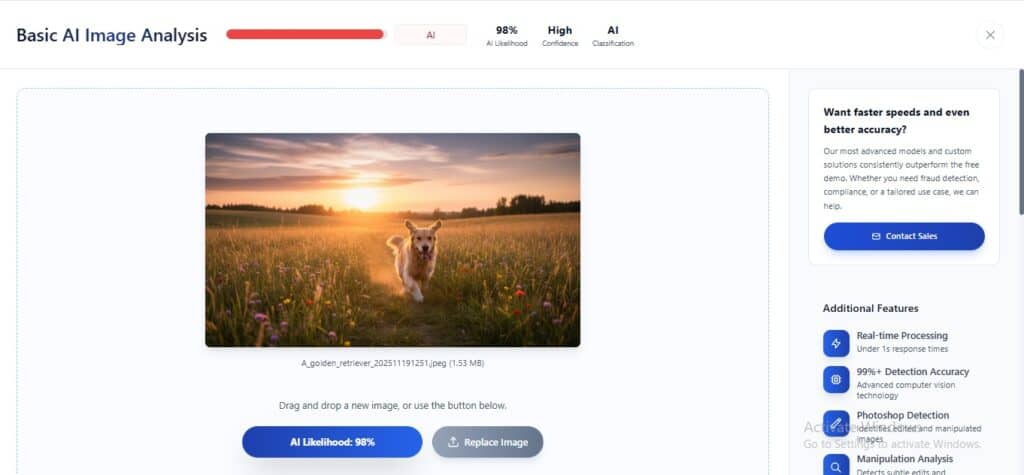

- For eksempel: Hvis du beder en AI om at generere “en golden retriever, der løber gennem en eng ved solnedgang”, konstruerer den hele scenen fra bunden. Værktøjer som DALL-E, Midjourney og Nano Banana fokuserer på denne type original indholdsproduktion.

Hvor lang tid tager det at generere et AI-billede?

AI-billedgenereringsværktøjer tager mellem 1 og 60 sekunder at skabe et enkelt billede, afhængigt af værktøjet, indstillingerne og opløsningen.

- Gennemsnitlige genereringstider

De nyeste AI-billedredskaber er meget hurtigere end for få år siden.

De fleste professionelle platforme producerer standardbilleder i 1024×1024 på 5–30 sekunder, hvilket er en enorm forbedring i forhold til 2022–2023, hvor selv simple billeder ofte krævede 60–90 sekunder.

Test i virkelige omgivelser fra 2024–2025 viser:

| Kategori | Værktøj/eksempel | Tid pr. billede | Noter |

| Generering i realtid | FLUX Schnell, SDXL-Lightning | 0,5–1 sek. | Interaktiv arbejdsgang; se resultater næsten øjeblikkeligt |

| Hurtige professionelle værktøjer | Stabile diffusionsvarianter, Google Imagen 4 Fast | 2–7 sek. | Balanceret hastighed og kvalitet |

| High-Fidelity-platforme | DALL-E 3, Leonardo.ai | 10–20 sek. | Fokus på hurtig overholdelse og polerede visuelle effekter |

| Kunstneriske ledere | Midt på rejsen | 30–60 sek. (4 variationer) | Genererer fire billeder samtidigt. ~7–15 sekunder pr. billede effektivt |

| Cloud-tjenester | Ethvert værktøj | +2–5 sekunders forsinkelse | Eliminerer hardwarekrav, mindre netværksforsinkelse |

- Hvorfor hastigheden varierer

Hastigheden for AI-billedgenerering varierer på grund af 3 hovedfaktorer.

- Modeltype / Arkitektur

Forskellige AI-modeller genererer billeder på forskellige måder, hvilket har direkte indflydelse på, hvor hurtigt de arbejder.

| Modeltype / Arkitektur | Sådan fungerer det | Hastighed / Trin |

| Diffusionsmodeller (Midjourney, DALL-E, Stable Diffusion) | “Rens” tilfældig støj trin for trin for at danne et komplet billede | 20–50 trin. 50 trin ≈ 2,5 gange længere end 20 trin |

| Enkelt-trins modeller (SDXL Turbo) | Brug destillation til at fremstille samme kvalitet i færre trin | 1–4 trin. 30–40 gange hurtigere end diffusionsmodeller |

| GAN'er (StyleGAN) | Generer billeder direkte ved hjælp af modstridende netværk | Ekstremt hurtig: 0,1–0,3 sekunder pr. billede. Begrænset til specifikke domæner som ansigter. |

| Hybride systemer (FLUX) | Kombiner transformerbaseret tekstforståelse med optimeret diffusion | Hurtigere og mere præcis end standarddiffusion |

- Modelstørrelse

Størrelsen på en AI-model påvirker, hvor hurtigt den kan skabe billeder. Større modeller, som SDXL, har mere “hjernekraft” (2,6 milliarder parametre) og kan skabe mere detaljerede og nøjagtige billeder, men de tager længere tid at behandle end mindre modeller med færre parametre (som 890 millioner).

- Tekstforståelse / Encodere

Nogle avancerede modeller, såsom SDXL, anvender ekstra sprogforståelsesværktøjer for bedre at kunne forstå komplekse kommandoer.

Det tager lidt ekstra tid, men det hjælper AI'en med at generere billeder, der passer bedre til din beskrivelse.

Faktorer, der påvirker hastigheden af AI-billedgenerering

AI-billedgenereringshastigheden afhænger af flere faktorer. Lad os se på, hvordan forskellige værktøjer fungerer i virkelige scenarier.

- 1. Den AI-model, du bruger

Forskellige AI-platforme varierer meget i hastighed og stil.

- Midt på rejsen har gennemgået syv versioner.

- Version 7 (juni 2025) genererer billeder på 21–42 sekunder, hvilket er ca. 20–40% hurtigere end version 6. Den producerer fire variationer pr. prompt.

- Version 7 (juni 2025) genererer billeder på 21–42 sekunder, hvilket er ca. 20–40% hurtigere end version 6. Den producerer fire variationer pr. prompt.

- DALL-E 2 og 3 fungerer udelukkende via skyen.

- DALL-E 2 genererede billeder på 12 sekunder, da det blev frigivet.

- DALL-E 3 tager i gennemsnit 10-20 sekunder, mens komplekse kommandoer undertiden kan tage op til 45 sekunder eller mere i spidsbelastningsperioder.

- Stabil diffusion bragte open source lokal generering.

- Leonardo.ai er baseret på Stable Diffusion til hurtig prototyping, spilaktiver og produktvisualisering med standardgenerering på 10–20 sekunder.

- Leonardo.ai er baseret på Stable Diffusion til hurtig prototyping, spilaktiver og produktvisualisering med standardgenerering på 10–20 sekunder.

- Adobe Firefly fokuserer på kommerciel sikkerhed.

- Image Model 5 (oktober 2025) genererer billeder på 10–25 sekunder afhængigt af tilstand og opløsning.

- Image Model 5 (oktober 2025) genererer billeder på 10–25 sekunder afhængigt af tilstand og opløsning.

- Nano Banana (Gemini 2.5) er specialiseret i redigering snarere end fuld generering.

- Enkle redigeringer sker på få millisekunder, mens komplekse redigeringer af flere billeder tager 2-5 sekunder.

- 2. Kompleksitet i forbindelse med prompt

Detaljegraden i din prompt har direkte indflydelse på, hvor lang tid det tager at generere et AI-kunstbillede.

Et eksempel:

- Længere prompter tager længere tid. Hver ekstra 10 ord tilføjer 5–8% mere behandlingstid. Komplekse scener med mange motiver eller stilarter kan tage 30–50% længere tid end enkle prompts.

- Klare, direkte anvisninger er hurtigere. Korte beskrivelser som “bjerglandskab ved solnedgang” genereres hurtigere end lange, samtaleagtige anmodninger.

- Abstrakte eller vage kommandoer gør modellen langsommere. En prompt som “følelsen af nostalgi udtrykt gennem byarkitektur” kræver mere fortolkning. Konkrete prompts giver hurtigere resultater.

- Negative prompter tilføjer ekstra behandling. Instruktioner som “ingen sløring, ingen forvrængning” tilføjer 5–10% ekstra tid, fordi AI'en skal filtrere uønskede elementer fra.

- 3. Opløsning og kvalitetsindstillinger

Højere opløsning = langsommere billedgenerering. Det skyldes, at større billeder har langt flere pixels, og AI'en skal arbejde hårdere for at udfylde alle detaljer.

Når folk spørger, hvor lang tid det tager at generere et AI-billede, er opløsningen en af de vigtigste faktorer.

- At gå fra 512×512 til 1024×1024 betyder 4 gange flere pixels, hvilket kan gøre tingene 70–80% langsommere.

- En model (som FLUX.1 Dev), der har brug for 5 sekunder ved 512×512, kan tage 20 sekunder ved 1024×1024.

- En model (som FLUX.1 Dev), der har brug for 5 sekunder ved 512×512, kan tage 20 sekunder ved 1024×1024.

- Større spring gør tingene endnu langsommere. 1024×1024 → 1920×1080 (Full HD) fordobler næsten tiden.

- 4K-billeder tager ofte 4 minutter eller mere og kan endda se dårligere ud, hvis din GPU har problemer.

Bedste praksis

| For det meste arbejde | Til sociale medier | Til udskrivning |

| 1024×1024 eller 1920×1080 er den ideelle balance. | 1024×1024 er mere end nok. | Generer i Full HD og opskaler senere (Topaz, Let’s Enhance). Det er hurtigere og ser bedre ud end at generere i native 4K. |

- 4. Hardware og regnekraft

AI-billedgenerering afhænger hovedsageligt af din GPU. En stærkere GPU = hurtigere billeder.

Oversigt over GPU-ydeevne

| Hardware | Hastighed | Noter |

| RTX 4090 (24 GB) | ~75 billeder/min | En af de hurtigste GPU'er til forbrugere |

| RTX 3060 (12 GB) | 10–15 sek./billede | God mulighed for begyndere |

Et eksempel:

- RTX 4090 kan færdigbehandle et 512×512-billede på under 1 sekund, mens en RTX 3060 kan tage 10 sekunder på samme opgave.

Andre hardwarefaktorer (hurtigt overblik)

| Komponent | Indvirkning | Hvad det betyder |

| CPU | Lav | Enhver moderne CPU fungerer; GPU'en klarer det tunge arbejde. |

| RAM | Medium | Brug dobbelt så meget som din GPU VRAM (f.eks. 24 GB GPU → 48 GB RAM er ideelt). |

| Opbevaring | Lav | NVMe SSD'er indlæser modeller hurtigere, men fremskynder ikke genereringen. |

Lokalt vs. cloud (enkelt)

| Mulighed | Styrke | Svaghed |

| Lokal GPU | Hurtig, privat, ingen månedlige omkostninger | Dyrt på forhånd |

| Sky | Ingen hardware nødvendig | Dyrere på lang sigt |

Et eksempel:

- Midjourney i skyen: 10–30 sekunder/billede

- Lokal RTX 4090: 1–5 sekunder/billede

Bonus: Hvis du vil kontrollere, om et billede er lavet af AI (uanset model, hastighed eller indstillinger), skal du bruge en pålidelig AI-billeddetektor.

Disse værktøjer analyserer mønstre, teksturer og uoverensstemmelser for at vurdere, om billedet er menneskeskabt eller genereret af kunstig intelligens.

TruthScan er specialiseret i at opdage disse skjulte AI-fingeraftryk.

Den analyserer:

- Strukturelle mønstre

- Støjfordeling

- Generative modelsignaturer for at give et klart, tillidsbaseret resultat.

Klik her for at bruge TruthScan.

Hvor længe professionelle brugere venter på billedgenerering

Igen afhænger det af AI'ens niveau inden for billedgenerering og hvilket værktøj den bruger, hvor lang tid det tager at generere et billede.

Lad os se på nogle scenarier her.

- Hvis en bruger laver udkast i lav opløsning (512×512) på en avanceret GPU (RTX 4090) med få inferensstrin, tager genereringen 5–10 sekunder.

- Hvis en bruger producerer billeder i produktionskvalitet på 1024×1024, skal man forvente 10–30 sekunder pr. billede.

- Hvis en bruger opretter billeder med høj detaljegrad med flere indgange, opskalering eller forfining, kan genereringen tage 2-5 minutter.

- Hvis du bruger cloud-prioriteret adgang (f.eks. ChatGPT Plus), reduceres ventetiden til 10-30 sekunder. Brugere af gratisversionen kan opleve ventetider på 30-60 sekunder i spidsbelastningsperioder.

- Hvis du laver lavtrinsudkast (20–30), er genereringen hurtig; højtrinsfinaler (50+) giver kvalitet.

- Hvis man starter med en lavere opløsning og opskalerer senere, bliver arbejdsgangen hurtigere og mere effektiv.

- Hvis der anvendes caching-teknikker (DeepCache / vektordatabaser), kan GPU-beregningen falde med 20–30%.

For virksomheder, der skaber mange billeder, TruthScan er et fantastisk værktøj. Det er nyttigt til at sikre, at dine brand-, marketing- eller produktbilleder er nøjagtige og troværdige.

Brug af TruthScan sparer tid, undgår fejl og gør det nemt at administrere mange billeder på én gang.

Hvis du ønsker alle eller nogle af disse fordele, skal du bruge TruthScan til øjeblikkelig, nøjagtig og massevis af AI-billeddetektering.

Sådan fremskyndes generering af AI-billeder

Spekulerer du på, hvor lang tid det tager at generere et AI-billede, og vil du gerne gøre det hurtigere?

Du kan fremskynde AI-billedgenerering på tre måder.

Du kan bruge alle tre sammen eller starte med den, der passer bedst til din arbejdsgang:

- Brug værktøjer til generering af billedserier

- Med værktøjer som ComfyUI, Automatic1111, RunPod eller Baseten kan du generere over 100 billeder på én gang.

- Med værktøjer som ComfyUI, Automatic1111, RunPod eller Baseten kan du generere over 100 billeder på én gang.

- Opgrader din hardware

- Hurtigere GPU'er reducerer genereringstiden drastisk.

- Hurtigere GPU'er reducerer genereringstiden drastisk.

- Optimer genereringsindstillinger

- Start med en lavere opløsning (512×512 eller 768×768) til de første udkast, og opskaler derefter med værktøjer som SwinIR eller Topaz Gigapixel i stedet for at generere høj opløsning direkte.

Ud over hardware og indstillinger er effektiviteten af din tekstindtastning den mest oversete faktor i billedgenereringshastigheden.

Du kan bruge vores usynlige AI'er Prompt-generator at udvikle præcise beskrivelser, der hjælper dig med at få AI-billeder af høj kvalitet hurtigere ved at fjerne den tvetydighed, der bremser AI-modeller.

Hvor lang tid tager det for AI-værktøjer at genkende billeder?

Typiske AI-detekteringsværktøjer tager 2-10 sekunder pr. billede, fordi de scanner teksturer, mønstre, metadata og AI-artefakter. Store filer, komplekse billeder eller videorammer forsinker dette yderligere.

TruthScan, er dog designet til hastighed og effektivitet:

- Hurtigere behandling: Den analyserer billeder på under 500 millisekunder pr. element, hvilket reducerer tiden med 70–80% sammenlignet med typiske værktøjer.

- Realtidsdetektering: Fungerer på tværs af billeder, videoer og tekst, hvilket gør det praktisk til live-workflows eller medieverifikation i stor skala.

- Høj nøjagtighed: Billeddetektoren opnår en detektionsrate på 99%+, og nogle opfølgende tests viser en nøjagtighed på 96%+ i skelnen mellem AI-genereret indhold.

- Automatisk integration: TruthScans API giver virksomheder mulighed for automatisk at scanne store batcher, hvilket muliggør øjeblikkelig verifikation under indholdspipelines.

Et eksempel:

- Et marketingteam, der uploader 500 produktbilleder, kan verificere dem alle på under 5 minutter med TruthScan, mens standardværktøjer kan tage 30-60 minutter.

- For videoindhold, TruthScan kan scanne billeder i realtid, hvilket gør det velegnet til live streams eller moderering af brugergenereret videoindhold.

Begynd at forfine din tekst med vores AI Detector og Humanizer nedenfor!

Konklusion

AI-billedgenerering har aldrig været så hurtig eller nem.

I dag tager det mellem under et sekund og cirka et minut at generere et billede med AI, når det drejer sig om en kunstnerisk kreation i høj kvalitet.

Hvor hurtigt det sker, afhænger af den opløsning, du vælger, din hardware og hvor detaljeret din prompt er, men selv komplekse scener kan vises på få sekunder med den rigtige opsætning.

For bare få år siden ville dette have taget flere minutter eller længere tid, men nu kan både professionelle og hobbyister realisere deres ideer næsten øjeblikkeligt.

Hvis du arbejder med digitale medier, indholdsproduktion eller marketing og vil vide, om et billede er genereret af AI, kan du brug TruthScan.

Det verificerer hurtigt, om et billede er AI-genereret... hurtigt, præcist og pålideligt til alle dine projekter.