Το 2018, ο Jordan Peele δημιούργησε ένα βίντεο με τον πρώην πρόεδρο των ΗΠΑ Μπαράκ Ομπάμα που ξεγέλασε εκατομμύρια Αμερικανούς.

Το βίντεο ήταν σε όλες τις ειδήσεις, απεικονίζοντας τον Ομπάμα να παραδίδει ένα προειδοποιητικό μήνυμα.

Αλλά μάντεψε τι ήταν αυτό; Ψεύτικες ειδήσεις.

Στη συνέχεια αποκαλύφθηκε ότι επρόκειτο για τεχνητή νοημοσύνη. Ο Peele το χρησιμοποίησε αυτό ως μια επίδειξη του πώς η τεχνολογία, ειδικά τα deepfakes, μπορούν να χειραγωγήσουν την πραγματικότητα.

Αλλά αυτό συνέβη το 2018, και από τότε, τα deepfakes και τα βίντεο που δημιουργούνται με τεχνητή νοημοσύνη έχουν γίνει τρομακτικά καλά.

Οι κακοποιοί τα χρησιμοποιούν για τα πάντα, από πορνό εκδίκησης μέχρι πολιτική παραπληροφόρηση.

Πρόσωπα διασημοτήτων ανταλλάσσονται με ρητό περιεχόμενο.

Οι πολιτικοί εμφανίζονται να κάνουν δηλώσεις που δεν έκαναν ποτέ. Ο γείτονάς σας θα μπορούσε θεωρητικά να σας κάνει να πείτε οτιδήποτε σε βίντεο.

Αυτό που παλαιότερα απαιτούσε ακριβό λογισμικό και τεχνική εμπειρογνωμοσύνη τώρα συμβαίνει με δωρεάν εφαρμογές για smartphone.

Ο καθένας μπορεί να δημιουργήσει πειστικό ψεύτικο περιεχόμενο μέσα σε λίγα λεπτά. Αλλά υπάρχουν καλά νέα: μπορείτε να μάθετε να τα εντοπίζετε.

Αυτός ο οδηγός θα σας διδάξει ακριβώς πώς να αναγνωρίζετε τα deepfakes πριν σας ξεγελάσουν.

Επειδή σε έναν κόσμο όπου το να βλέπεις δεν σημαίνει πλέον να πιστεύεις, οι δεξιότητες κριτικής σκέψης είναι η καλύτερη άμυνά σου.

Βασικά συμπεράσματα

- Τα Deepfakes έχουν συχνά λεπτές οπτικές δυσλειτουργίες στις κινήσεις του προσώπου, το φωτισμό και την οπτική επαφή.

- Ασυνέπειες στον ήχο, όπως αφύσικα μοτίβα αναπνοής και διακυμάνσεις της φωνής, είναι σημαντικές κόκκινες σημαίες.

- Οι τεχνικές χειροκίνητης ανίχνευσης επικεντρώνονται στην ανάλυση του συγχρονισμού των χειλιών, των μοτίβων ανοιγοκλεισίματος των ματιών και της συνοχής του φόντου.

- Τα επαγγελματικά εργαλεία ανίχνευσης μπορούν να εντοπίσουν συνθετικό περιεχόμενο με μεγαλύτερη ακρίβεια από την ανθρώπινη παρατήρηση

- Η κατανόηση της διαφοράς μεταξύ deepfakes και cheapfakes σας βοηθά να είστε σε εγρήγορση για τους διαφορετικούς τύπους χειραγώγησης

- Οι μέθοδοι γρήγορης επαλήθευσης περιλαμβάνουν αντίστροφες αναζητήσεις εικόνας και έλεγχο της αξιοπιστίας της πηγής

Συνήθη σημάδια ότι βλέπετε ένα Deepfake

Τα Deepfakes δεν είναι τέλεια. Όχι ακόμα, τουλάχιστον.

Ακόμη και το πιο εξελιγμένο περιεχόμενο που παράγεται με τεχνητή νοημοσύνη αφήνει σημάδια που μπορούν να εντοπίσουν τα εκπαιδευμένα μάτια. Σκεφτείτε τα ως το ψηφιακό ισοδύναμο μιας κακής πλαστής ταυτότητας.

Η τεχνολογία είναι εντυπωσιακή, αλλά δεν είναι άψογη.

Μην ανησυχείτε ποτέ ξανά για την τεχνητή νοημοσύνη που ανιχνεύει τα κείμενά σας. Undetectable AI Μπορεί να σας βοηθήσει:

- Κάντε το γραπτό σας με υποστήριξη AI να εμφανιστεί ανθρωποειδής.

- Παράκαμψη όλα τα κύρια εργαλεία ανίχνευσης AI με ένα μόνο κλικ.

- Χρήση AI με ασφάλεια και με αυτοπεποίθηση στο σχολείο και στην εργασία.

Το πιο προφανές σημάδι είναι συνήθως τα μάτια.

Τα ανθρώπινα μάτια έχουν μια φυσική λάμψη, μια ζωντάνια που είναι δύσκολο να αναπαραχθεί. Οι απομιμήσεις συχνά δημιουργούν μάτια που φαίνονται ελαφρώς γυάλινα ή μη εστιασμένα.

Το άτομο μπορεί να κοιτάζει ευθεία μπροστά χωρίς τις φυσικές μικροκινήσεις που κάνουν τα πραγματικά μάτια.

Είναι ανεπαίσθητο, αλλά όταν ξέρεις τι να κοιτάξεις, είναι δύσκολο να το χάσεις.

Οι εκφράσεις των προσώπων είναι ένα άλλο αδύναμο σημείο.

Τα πραγματικά ανθρώπινα πρόσωπα έχουν αμέτρητες μικροσκοπικές μυϊκές κινήσεις που συμβαίνουν ταυτόχρονα.

Όταν χαμογελάτε, δεν κινείται μόνο το στόμα σας. Τα μάγουλά σας ανασηκώνονται, τα μάτια σας τσαλακώνονται, ολόκληρο το πρόσωπό σας συμμετέχει.

Τα Deepfakes παλεύουν με αυτή την πολυπλοκότητα. Μπορεί να πετύχουν τις μεγάλες εκφράσεις, αλλά να χάσουν τις λεπτές υποστηρικτικές κινήσεις.

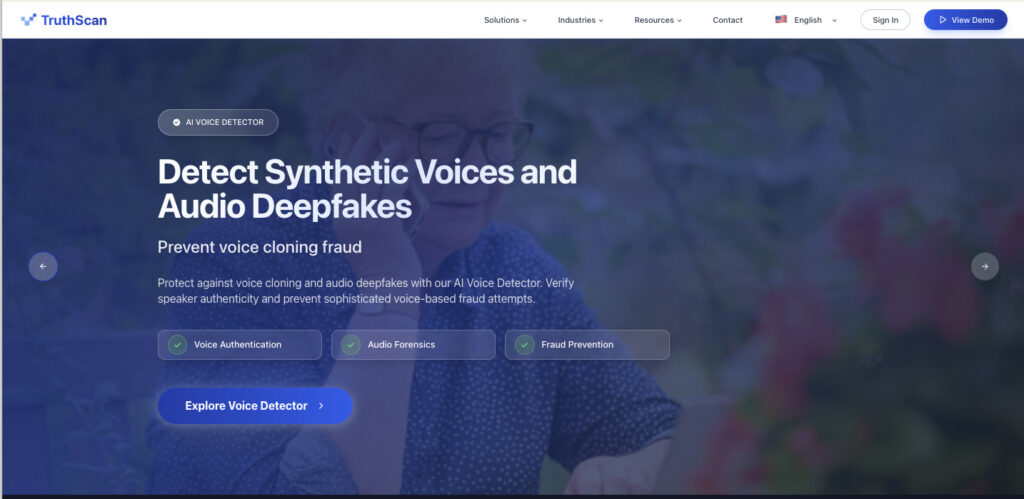

Ακόμα και με εξάσκηση, μπορεί να είναι δύσκολο να εμπιστευτείτε μόνο τα μάτια σας. Εδώ είναι που TruthScan μπαίνει μέσα.

Το TruthScan αναλύει αυτόματα τα βίντεο για ανεπαίσθητες ασυνέπειες, όπως αναντίστοιχο συγχρονισμό καρέ, δυσλειτουργίες στα όρια του προσώπου και αφύσικες δυναμικές κινήσεων, που είναι σχεδόν αδύνατο να εντοπιστούν με το χέρι.

Το μοντέλο ανίχνευσης εξετάζει χιλιάδες καρέ ανά δευτερόλεπτο, επισημαίνοντας την πιθανή παραποίηση με ένα εύχρηστο σκορ εμπιστοσύνης, ώστε να μπορείτε να διακρίνετε το πραγματικό από το συνθετικό σε δευτερόλεπτα.

Πώς να εντοπίσετε ένα βίντεο Deepfake

Τα video deepfakes είναι ο πιο συνηθισμένος και δυνητικά επικίνδυνος τύπος συνθετικών μέσων.

Χρησιμοποιούνται για τα πάντα, από οικονομικές απάτες μέχρι πολιτική χειραγώγηση.

Η εκμάθηση της ανάλυσης κινούμενων εικόνων απαιτεί διαφορετικό σύνολο δεξιοτήτων από τον εντοπισμό ψεύτικων φωτογραφιών.

- Ξεκινήστε παρατηρώντας τα μοτίβα ανοιγοκλεισίματος των ματιών του ατόμου. Οι άνθρωποι ανοιγοκλείνουν τα μάτια τακτικά και φυσικά, συνήθως κάθε 3-5 δευτερόλεπτα. Το πολύ ή το λίγο ανοιγοκλείσιμο των ματιών μπορεί να είναι κόκκινο πανί.\

- Δώστε προσοχή στις κινήσεις του κεφαλιού και τη γλώσσα του σώματος. Οι πραγματικοί άνθρωποι έχουν φυσικές, ρευστές κινήσεις που αντιστοιχούν στην ομιλία και τα συναισθήματά τους. Η γλώσσα του σώματος μπορεί να μην ταιριάζει με τον τόνο της φωνής ή το περιεχόμενο της ομιλίας.

- Εξετάστε προσεκτικά το ιστορικό. Οι Deepfakes συχνά εστιάζουν τόση επεξεργαστική ισχύ στο πρόσωπο που παραμελούν όλα τα υπόλοιπα. Αναζητήστε φόντα που φαίνονται τεχνητά θολά ή στατικά.

- Ελέγξτε για ψηφιακά τεχνουργήματα γύρω από τις άκρες του προσώπου.. Στα σημεία όπου το παραγόμενο πρόσωπο συναντά το αρχικό βίντεο, ενδέχεται να δείτε ανεπαίσθητα φωτοστέφανα, χρωματικές μετατοπίσεις ή εικονοστοιχεία. Αυτά τα ψηφιακά αντικείμενα είναι ιδιαίτερα ορατές όταν το άτομο γυρίζει το κεφάλι του ή κινείται γρήγορα. Η τεχνολογία δυσκολεύεται να διατηρήσει καθαρές άκρες κατά τη διάρκεια γρήγορης κίνησης.

- Οι ασυνέπειες στον ρυθμό καρέ μπορούν επίσης να αποκαλύψουν βαθιές απομιμήσεις. Αν το πρόσωπο φαίνεται να κινείται με διαφορετικό ρυθμό καρέ από το υπόλοιπο βίντεο, αυτό είναι ύποπτο.

- Η ποιότητα του ήχου είναι ζωτικής σημασίας. Ακόμα και αν τα οπτικά στοιχεία φαίνονται τέλεια, ο ήχος μπορεί να προδώσει την απάτη.

Πώς να αναλύσετε τον ήχο για ενδείξεις Deepfake

Οι ηχητικές απομιμήσεις γίνονται τρομακτικά εξελιγμένες.

Η τεχνολογία κλωνοποίησης φωνής μπορεί πλέον να αναπαράγει τα μοτίβα ομιλίας κάποιου με λίγα μόνο λεπτά δείγματος ήχου.

Αλλά όπως και οι οπτικές απομιμήσεις, έτσι και οι ηχητικές απομιμήσεις έχουν χαρακτηριστικά που οι προσεκτικοί ακροατές μπορούν να αναγνωρίσουν.

Ξεκινήστε δίνοντας προσοχή στην αναπνοή. Στις πραγματικές συζητήσεις, οι άνθρωποι κάνουν παύσεις για να εισπνεύσουν, να εκπνεύσουν ή να προσαρμόσουν τη φωνητική τους ενέργεια.

Οι βαθιές απομιμήσεις συχνά παραλείπουν αυτό το σημείο εντελώς ή εισάγουν αναπνευστικούς ήχους που μοιάζουν ρομποτικοί και ομοιόμορφα διατεταγμένοι.

Το αποτέλεσμα; Μια φωνή που μιλάει πολύ ομαλά, πολύ συνεχώς, σχεδόν σαν να γλιστράει πάνω σε ράγες.

Μπορείτε να εντοπίσετε αυτές τις ανωμαλίες πιο εύκολα ακούγοντας:

- Χωρίς παύσεις για αναπνοή, ακόμη και σε μεγάλες προτάσεις

- Αναπνοές που ακούγονται πανομοιότυπες, ομοιόμορφα χρονικά, ή περίεργα τοποθετημένα

- Ένας επίπεδος τόνος χωρίς κόπωση ή φωνητική καταπόνηση

- Λόγος που μοιάζει "πολύ τέλειος", σαν να έχει σχεδιαστεί

Οι άνθρωποι δεν είναι τόσο γυαλισμένοι. Οι φωνές μας ταλαντεύονται.

Βήχουμε, καταπίνουμε, σταματάμε στη μέση της σκέψης μας.

Έτσι, όταν ακούτε μια φωνή που ακούγεται σαν να έχει σιδερωθεί από την αρχή μέχρι το τέλος, αυτό είναι ένα στοιχείο.

Ο θόρυβος στο παρασκήνιο μπορεί επίσης να προδώσει ένα deepfake.

Αν κάποιος υποτίθεται ότι είναι σε ένα πολυσύχναστο καφέ, θα πρέπει να ακούτε ποτήρια να τσουγκρίζουν, χαμηλές κουβέντες, ίσως και συναγερμό αυτοκινήτου.

Αν είναι σιωπηλή ή γεμάτη με γενικό βουητό στο παρασκήνιο, κάτι δεν πάει καλά. Οι πραγματικές ηχογραφήσεις έχουν περιβαλλοντική υφή.

Τώρα σκεφτείτε τις προφορές. Μανιερισμοί. Μικρές παραξενιές στον τρόπο που μιλάει κάποιος.

Αυτός ο περίεργος τρόπος που ο φίλος σας λέει "κουμπί" ή το πώς ο συνάδελφός σας αφήνει την τελευταία συλλαβή σε κάθε πρόταση; Τα Deepfakes συχνά τα χάνουν αυτά. Αντιγράφουν τη φωνή, όχι το πρόσωπο.

Η ποιότητα του ήχου είναι ένα άλλο στοιχείο. Ορισμένα κλιπ έχουν υψηλή καθαρότητα, αλλά ισχυρίζονται ότι είναι τηλεφωνικές ηχογραφήσεις.

Άλλα ακούγονται συμπιεσμένα, αλλά όχι με τρόπο που να έχει νόημα για το πλαίσιο. Αν ο ήχος δεν ταιριάζει με το περιβάλλον, έχετε άλλη μια κόκκινη σημαία.

Το συναίσθημα είναι ίσως το πιο δύσκολο πράγμα που μπορείς να προσποιηθείς και το πιο εύκολο να το εντοπίσεις.

Αν κάποιος ακούγεται χαρούμενος ενώ μεταφέρει άσχημα νέα ή ρομποτικός ενώ διηγείται μια βαθιά προσωπική ιστορία, εμπιστευτείτε το ένστικτό σας. Η συνθετική ομιλία δεν έχει κατακτήσει ακόμα τον τόνο.

Τα Deepfakes είναι εντυπωσιακά. Αλλά δεν είναι μη ανιχνεύσιμα. Όχι ακόμα.

Και αν ακούτε προσεκτικά, η αλήθεια είναι συνήθως θαμμένη στις λεπτομέρειες.

Αν εξακολουθείτε να μην είστε σίγουροι μετά την ακρόαση, εργαλεία όπως το TruthScan μπορούν να επιβεβαιώσουν τις υποψίες σας.

Το Σάρωση αυθεντικότητας ήχου της TruthScan απομονώνει τις συχνότητες της φωνής, συγκρίνει τις παραλλαγές της αναπνοής και του τόνου και εντοπίζει κλωνοποιημένες φωνητικές υπογραφές που δεν ταιριάζουν με τον ανθρώπινο ρυθμό ή τα μοτίβα πίεσης.

Είτε επικυρώνετε ένα ύποπτο φωνητικό μήνυμα είτε μια δημόσια ηχογράφηση, το TruthScan μπορεί να αποκαλύψει αν αυτό που ακούτε προέρχεται από άνθρωπο ή από μηχάνημα.

Πώς να εντοπίσετε μια φωτογραφία Deepfake

Το θέμα με το deepfake φωτογραφίες? Συχνά είναι άψογες στο κέντρο και γίνονται περίεργες στις άκρες.

Ας ξεκινήσουμε με το φωτισμό.

Στην πραγματική ζωή, οι σκιές και τα φώτα ακολουθούν κανόνες.

Ένα πρόσωπο που φωτίζεται από αριστερά πρέπει να ταιριάζει με το υπόλοιπο περιβάλλον.

Όμως, τα deepfakes δεν παίρνουν πάντα το υπόμνημα.

Θα εντοπίσετε σκιές που πέφτουν προς αντίθετες κατευθύνσεις ή φωτισμό που μοιάζει δραματικός χωρίς λόγο.

Ένα πλαίσιο. Μια στιγμή. Καμία κίνηση για ανάλυση. Αυτός είναι ο λόγος που αυτές οι απομιμήσεις είναι πιο δύσκολο να πιαστούν.

Αλλά μπορείτε ακόμα να το κάνετε.

Κοιτάξτε τα μάτια και μετά κοιτάξτε τι αντανακλάται σε αυτά.

Αν κάποιος φοράει γυαλιά, θα πρέπει να βλέπετε τον κόσμο να αντανακλάται: παράθυρα, φώτα, ακόμη και άλλους ανθρώπους.

Αν είναι απλώς θόρυβος ή παράξενα κενό, η εικόνα μπορεί να είναι συνθετική.

Στη συνέχεια, υπάρχει το δέρμα.

Το αληθινό ανθρώπινο δέρμα είναι περίπλοκο: πόροι, υφή, αποχρωματισμός, ακόμη και το περιστασιακό σπυράκι.

Τα deepfakes τείνουν να τα εξομαλύνουν πάρα πολύ. Όχι σαν φίλτρο, αλλά περισσότερο σαν κάποιος να το λείανε στο Photoshop.

Μπορεί να φαίνεται τέλειο, μέχρι να μην είναι.

Αν κάτι σας φαίνεται αλλόκοτο, ζουμάρετε. Κοιτάξτε γύρω σας. Εμπιστευτείτε τη δυσφορία.

Όσο πιο ανεπαίσθητη είναι η δυσλειτουργία, τόσο πιο σίγουρη είναι η απομίμηση.

Συμβουλές για χειροκίνητη ανίχνευση χωρίς εργαλεία

Δεν χρειάζεστε φανταχτερά εργαλεία για να πιάσετε μια απάτη.

Τα μάτια και τα αυτιά σας, όταν χρησιμοποιούνται σκόπιμα, είναι συχνά αρκετά.

Εμπιστευτείτε το ένστικτό σας. Αν κάτι σας φαίνεται παράξενο, μάλλον είναι.

Συγκρίνετε το περιεχόμενο με επαληθευμένα πλάνα του ίδιου προσώπου, ιδίως τη φωνή, τους τρόπους και τις λεπτομέρειες του προσώπου.

Τα deepfakes συνήθως χάνουν τις αποχρώσεις.

Επιβραδύνετε τα βίντεο για να εντοπίσετε τα χαρακτηριστικά που τρεμοπαίζουν ή τις περίεργες αλλαγές φωτισμού καρέ-καρέ.

Ερωτήστε την πηγή: Ποιος το δημοσίευσε πρώτος; Γιατί; Τα υψηλής ποιότητας κλιπ που υποτίθεται ότι γυρίστηκαν με συσκευές χαμηλής ποιότητας ή βρέθηκαν μόνο σε ένα μέρος θα πρέπει να εγείρουν ερωτηματικά.

Ακόμα και χωρίς μεταδεδομένα ή προηγμένη ανάλυση, οι περισσότερες απομιμήσεις αφήνουν πίσω τους ενδείξεις, αν ξέρετε τι να ψάξετε.

Deepfake vs Cheapfake: Deepfake: Γνωρίστε τη διαφορά

Deepfakes

- Εικόνες ή ήχος που παράγονται από τεχνητή νοημοσύνη

- Ανταλλαγή προσώπων, κλωνοποίηση φωνής, συνθετικός συγχρονισμός χειλιών

- Απαιτούν δεδομένα κατάρτισης και εξειδικευμένα εργαλεία

- Συχνά πιο δύσκολο να παραχθεί, αλλά πιο ρεαλιστικό

Cheapfakes

- Δεν εμπλέκεται AI

- Βασική επεξεργασία: περικοπή, περικοπή, επιβράδυνση, αναπλαισίωση

- Πραγματικό περιεχόμενο, λάθος πλαίσιο

- Ευκολότερη ανίχνευση, αλλά συχνά παραβλέπεται

Τα deepfakes βασίζονται σε προηγμένη τεχνολογία, ενώ τα cheapfakes βασίζονται σε χειραγώγηση και παραπλάνηση.

Και τα δύο μπορούν να σας ξεγελάσουν, αλλά για διαφορετικούς λόγους.

Οι φτηνές απομιμήσεις συχνά περνούν απαρατήρητες, επειδή χρησιμοποιούν πραγματικό περιεχόμενο που έχει διαστρεβλωθεί αρκετά ώστε να παραπλανήσει.

Το να γνωρίζετε με ποια από αυτές έχετε να κάνετε, σας βοηθά να εντοπίζετε το πρόβλημα γρηγορότερα και να είστε πιο έξυπνοι στο διαδίκτυο.

Εργαλεία που μπορείτε να χρησιμοποιήσετε για να εντοπίσετε ένα Deepfake

Ενώ το η χειροκίνητη ανίχνευση είναι πολύτιμη, εξειδικευμένα εργαλεία μπορούν να εντοπίσουν συνθετικό περιεχόμενο που μπορεί να ξεγελάσει τους ανθρώπινους παρατηρητές.

Αυτά τα εργαλεία χρησιμοποιούν αλγορίθμους μηχανικής μάθησης που έχουν εκπαιδευτεί ειδικά για την αναγνώριση περιεχομένου που παράγεται με τεχνητή νοημοσύνη.

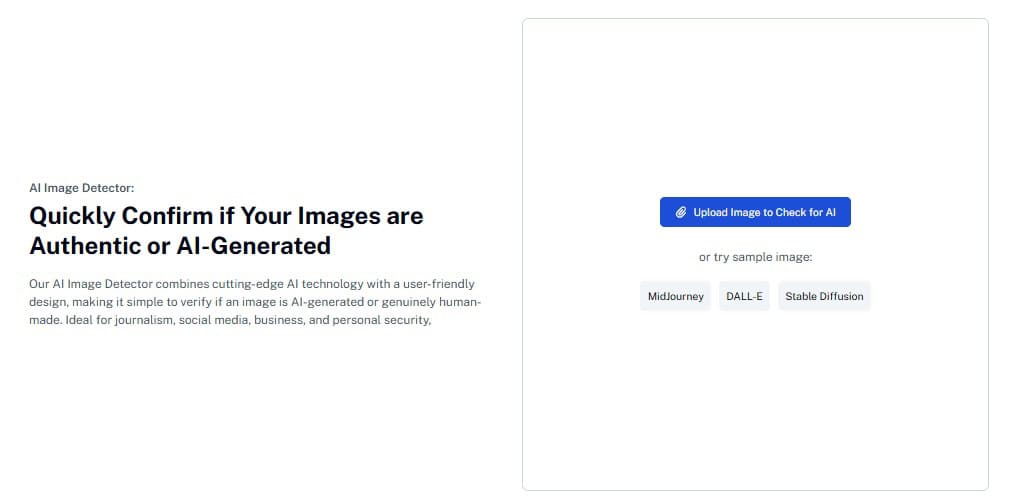

Για εικόνες, δοκιμάστε το Undetectable AI's Ανιχνευτής εικόνας AI για να αξιολογήσετε αν μια φωτογραφία περιέχει συνθετικά στοιχεία.

Αυτό το εργαλείο αναλύει πολλαπλές πτυχές της δημιουργίας εικόνας και μπορεί να εντοπίσει ανεπαίσθητα τεχνουργήματα που δεν βλέπουν τα ανθρώπινα μάτια.

Είναι ιδιαίτερα αποτελεσματική στην αναγνώριση προσώπων και αντικειμένων που δημιουργούνται από τεχνητή νοημοσύνη.

Για ολοκληρωμένη ανίχνευση deepfake σε πολλαπλούς τύπους μέσων, ελέγξτε το Ανιχνευτής Deepfake της TruthScan.

Το TruthScan συνδυάζει προηγμένη ανάλυση προσώπου, επαλήθευση ήχου και εντοπισμό μοτίβων συμπεριφοράς για να αξιολογήσει αν ένα βίντεο ή μια εγγραφή έχει τροποποιηθεί συνθετικά.

Δεν ελέγχει απλώς τα pixels, αλλά σαρώνει το ολόκληρη η παράσταση.

Οι διαστάσεις σάρωσης περιλαμβάνουν:

- Ανίχνευση εναλλαγής προσώπου: Σημαίνει αφύσικες μεταβάσεις και μορφοποιήσεις σε περιοχές του προσώπου.

- Αναγνώριση κλώνου φωνής: Ανιχνεύει φωνές που δημιουργούνται από τεχνητή νοημοσύνη και τις συγκρίνει με φυσικά φωνητικά μοτίβα.

- Χαρτογράφηση συνέπειας συμπεριφοράς: Παρακολουθεί τις μικροεκφράσεις και τη σταθερότητα του βλέμματος καρέ-καρέ για να εντοπίζει συνθετικές διακοπές απόδοσης.

- Στρώμα εγκληματολογίας βίντεο: Εξετάζει τεχνουργήματα συμπίεσης, χρονικές αναντιστοιχίες και παρατυπίες μεταδεδομένων.

Το αποτέλεσμα είναι μια πλήρης έκθεση γνησιότητας με ποσοστό εμπιστοσύνης και οπτική ανάλυση των σημείων όπου έγινε χειραγώγηση.

Το TruthScan είναι ιδιαίτερα ισχυρό για δημοσιογράφους, ερευνητές και ομάδες ασφαλείας που χρειάζονται γρήγορα αξιόπιστη επικύρωση βίντεο.

Τι να κάνετε αν υποπτεύεστε ένα Deepfake

Μην το μοιραστείτε ή ακόμα και μην το διαψεύσετε.

Αυτό μπορεί να αυξήσει ακούσια την εμβέλειά του. Αν πιστεύετε ότι το περιεχόμενο είναι ψεύτικο, αναφέρετέ το απευθείας στην πλατφόρμα. Οι περισσότεροι ιστότοποι διαθέτουν εργαλεία για την επισήμανση συνθετικών μέσων.

Έλεγχος γεγονότων μέσω αξιόπιστων πηγών όπως η Snopes ή η PolitiFact. Αν δεν έχει επαληθευτεί ακόμα, σκεφτείτε να το υποβάλετε.

Τραβήξτε στιγμιότυπα οθόνης ή αποθηκεύστε συνδέσμους πριν εξαφανιστεί το περιεχόμενο, καθώς μπορεί να βοηθήσουν τους δημοσιογράφους ή τους ερευνητές αργότερα.

Προειδοποιήστε το δίκτυό σας, αλλά αποφύγετε την αναδημοσίευση του ψεύτικου. Αντ' αυτού, επικεντρωθείτε στη διδασκαλία του τρόπου εντοπισμού της. Εάν κάποιος υποδύεται κάποιον, ενημερώστε τον.

Ίσως θελήσουν να απαντήσουν ή να αναλάβουν νομική δράση.

Για ψεύτικα μηνύματα που συνδέονται με απειλές ή εγκλήματα, αναφέρετε τα στις αστυνομικές αρχές. Οι νόμοι για τα συνθετικά μέσα ενημέρωσης πλησιάζουν και η πληροφορία σας μπορεί να κάνει τη διαφορά.

Ξεκινήστε την εξερεύνηση - ο ανιχνευτής AI Detector και ο Humanizer μας περιμένουν στο widget παρακάτω!

Συχνές ερωτήσεις σχετικά με την ανίχνευση Deepfake

Μπορούν να εντοπιστούν τα deepfakes 100% του χρόνου;

Όχι. Ακόμα και τα καλύτερα εργαλεία χάνουν πράγματα. Η ανίχνευση λειτουργεί καλύτερα όταν τα εργαλεία ΤΝ, η ανθρώπινη εξέταση και η κριτική σκέψη χρησιμοποιούνται μαζί.

Τι πρέπει να κάνω αν κάποιος με κάνει deepfakes;

Αποθηκεύστε τα αποδεικτικά στοιχεία. Αναφέρετε το στην πλατφόρμα. Εάν είναι επιβλαβές ή παράνομο, επικοινωνήστε με δικηγόρο. Πολλές περιοχές έχουν πλέον νόμους κατά των κακόβουλων deepfakes.

Πώς μπορώ να βοηθήσω τους άλλους να εντοπίζουν τα deepfakes;

Επικεντρωθείτε στην επίγνωση, όχι στον φόβο. Διδάξτε δεξιότητες παρατήρησης, μοιραστείτε σαφή παραδείγματα και υπενθυμίστε πάντα στους ανθρώπους να ελέγχουν τις πηγές πριν τις μοιραστούν.

Θολές γραμμές και ψέματα Pixel

Οι βαθιές απομιμήσεις αποτελούν μία από τις σημαντικότερες προκλήσεις για την ακεραιότητα των πληροφοριών στην ψηφιακή εποχή. Αλλά δεν είναι μαγικά.

Με τις κατάλληλες γνώσεις και τα κατάλληλα εργαλεία, μπορείτε να προστατεύσετε τον εαυτό σας και τους άλλους από τη συνθετική χειραγώγηση των μέσων ενημέρωσης.

Να θυμάστε τις βασικές αρχές: εμπιστευτείτε το ένστικτό σας, εξετάστε προσεκτικά τις λεπτομέρειες, επαληθεύστε τις πηγές και χρησιμοποιήστε τα διαθέσιμα εργαλεία.

Αναζητήστε ασυνέπειες στο φωτισμό, τις κινήσεις του προσώπου, την ποιότητα του ήχου και τα στοιχεία του φόντου. Δώστε προσοχή στο πλαίσιο και εξετάστε τα κίνητρα πίσω από το ύποπτο περιεχόμενο.

Η τεχνολογία θα συνεχίσει να εξελίσσεται. Τα deepfakes θα βελτιωθούν, αλλά και οι μέθοδοι ανίχνευσης θα βελτιωθούν.

Ενημερωθείτε για νέες τεχνικές και εργαλεία. Μοιραστείτε τις γνώσεις σας με άλλους. Δημιουργήστε ένα δίκτυο κριτικά σκεπτόμενων ατόμων που μπορούν να σας βοηθήσουν να εντοπίσετε και να καταπολεμήσετε τα συνθετικά μέσα ενημέρωσης.

Η επαγρύπνησή σας έχει σημασία. Κάθε ψεύτικο βίντεο που πιάνετε, κάθε παραπλανητική εικόνα που δεν μοιράζεστε, κάθε άτομο που διδάσκετε να σκέφτεται κριτικά, κάνει το διαδίκτυο λίγο πιο αξιόπιστο.

Σε έναν κόσμο όπου η τεχνολογία μπορεί να βάλει λόγια στο στόμα του καθενός, ο σκεπτικισμός και οι γνώσεις σας είναι ισχυρά όπλα κατά της εξαπάτησης.

Μη ανιχνεύσιμο AI προσφέρει εργαλεία που σας βοηθούν να αναλύετε, να αμφισβητείτε και να επαληθεύετε ταχύτερα το ψηφιακό περιεχόμενο. Χρησιμοποιήστε τα. Μοιραστείτε τα. Γίνετε ο λόγος που η παραπληροφόρηση θα σταματήσει μαζί σας.

Μαζί, το Undetectable AI και το TruthScan σας παρέχουν προστασία πλήρους φάσματος, από τον εντοπισμό περιεχομένου που έχει γραφτεί με τεχνητή νοημοσύνη έως την επαλήθευση βίντεο και κλώνων φωνής.

Δοκιμάστε τον AI Image Detector για φωτογραφίες ή TruthScan για βίντεο και πάρτε τον έλεγχο της ψηφιακής σας πραγματικότητας.