Hai visto che virale Foto del Papa con un elegante giubbotto bianco nel 2023?

Milioni di persone l'hanno condivisa, i siti di informazione ne hanno parlato e tutti hanno parlato di quanto il Papa fosse elegante.

C'è solo un problema: non è mai successo. L'immagine è stata completamente creata dall'intelligenza artificiale.

Oppure potreste ricordare l'immagine scioccante di un esplosione al Pentagono che ha brevemente scosso il mercato azionario. Falso!

Che dire delle immagini di Trump viene placcato e arrestato? Anche in questo caso, sono stati completamente inventati dall'IA.

Le immagini AI false hanno causato danni reali.

Le persone hanno perso denaro investendo sulla base di foto di notizie false.

Celebrità e persone comuni hanno fatto apparire i loro volti su altri corpi in situazioni imbarazzanti o inappropriate.

I politici sono stati mostrati mentre dicevano e facevano cose che in realtà non hanno mai fatto.

Quando non possiamo fidarci dei nostri occhi, abbiamo bisogno di nuovi modi per capire cosa è reale e cosa no.

In questo blog, vi mostrerò come la tecnologia AI e DeepFake si è evoluta nel corso degli anni, l'importanza di identificare le immagini AI rispetto a quelle reali, come capire se un'immagine è generata dall'AI o lo strumento migliore per rilevare le immagini generate dall'AI.

Come si sono evolute l'arte dell'intelligenza artificiale e la tecnologia Deepfake

Parliamo di AI prima...

Non molto tempo fa, le immagini generate dall'intelligenza artificiale sembravano un brutto sogno: volti sfocati, dita in più e un sacco di stranezze. Ma oggi l'arte dell'IA è sorprendentemente realistica.

Tutto è iniziato intorno al 2014 con GAN (Generative Adversarial Networks), in cui due modelli di intelligenza artificiale - uno che crea falsi, l'altro che li individua - continuavano a migliorarsi a vicenda.

Non preoccupatevi più che l'intelligenza artificiale rilevi i vostri messaggi. Undetectable AI Può aiutarvi:

- Fate apparire la vostra scrittura assistita dall'intelligenza artificiale simile all'uomo.

- Bypass tutti i principali strumenti di rilevamento dell'intelligenza artificiale con un solo clic.

- Utilizzo AI in modo sicuro e con fiducia a scuola e al lavoro.

Le prime immagini GAN erano piuttosto brutte: volti sfocati con occhi strani e orecchie mancanti.

Nel 2020, le cose sono migliorate notevolmente con "modelli di diffusione".

Iniziano con un'immagine disordinata e piena di puntini e la ripuliscono lentamente fino a farla sembrare reale.

Si trattava di un enorme balzo in avanti. Improvvisamente, l'intelligenza artificiale poteva creare immagini molto più chiare e realistiche.

Tecnologia Deepfake funziona allo stesso modo, ma in modo più complicato.

Comporta l'uso della tecnologia AI e Deepfake.

L'intelligenza artificiale apprende l'aspetto del volto di una persona da diverse angolazioni ed espressioni studiando molti video e immagini.

Poi può mettere il volto di quella persona sul corpo di un'altra in un altro video.

Il computer impara ad adattare l'illuminazione, il tono della pelle e persino le piccole espressioni per farle sembrare reali.

I primi deepfake del 2017 apparivano ovvi e difettosi. I deepfake di oggi possono essere quasi perfetti.

Per vedere il confronto, guardate i video qui sotto:

Deepfake nel 2017 - Falso video di Obama

Deepfake nel 2023 - Emma Watson in "Scappa (2017)"

Nel 2022, le persone hanno creato circa 6 milioni di immagini utilizzando l'IA. All'inizio del 2023, la cifra è salita a oltre 20 milioni di immagini al giorno.

Oggi esistono online miliardi di immagini create dall'intelligenza artificiale e la maggior parte di noi le vede quotidianamente senza nemmeno saperlo.

I rischi delle immagini generate dall'intelligenza artificiale nella disinformazione

Le notizie false si diffondono 6 volte più velocemente di quelle vere sui social media.

Di solito il danno è fatto quando qualcuno fa notare che un'immagine è falsa.

I rischi associati alle immagini false sono:

1) Manipolazione - Le false immagini creano false narrazioni sugli altri, comprese le elezioni, i leader e gli eventi mondiali. Ad esempio, Le immagini generate dall'intelligenza artificiale raffiguravano falsamente l'arresto del presidente degli Stati Uniti Donald Trump.

2) Diffamazione - Le immagini false possono rovinare la reputazione. Ad esempio, nel gennaio 2024, sono circolate online immagini di Taylor Swift generate dall'intelligenza artificiale che la ritraggono falsamente.

3) Disordini sociali - Una sola immagine falsa può creare indignazione, sommosse o addirittura violenza. Ad esempio, nel maggio 2023, un'immagine generata dall'intelligenza artificiale che mostrava un'esplosione vicino al Pentagono è circolata ampiamente sui social media.

4) Frode - I truffatori utilizzano immagini deepfake per indurre le persone a inviare denaro. Ad esempio; Michael Hewson (analista finanziario) è stato spacciato per promuovere programmi di investimento fraudolenti.

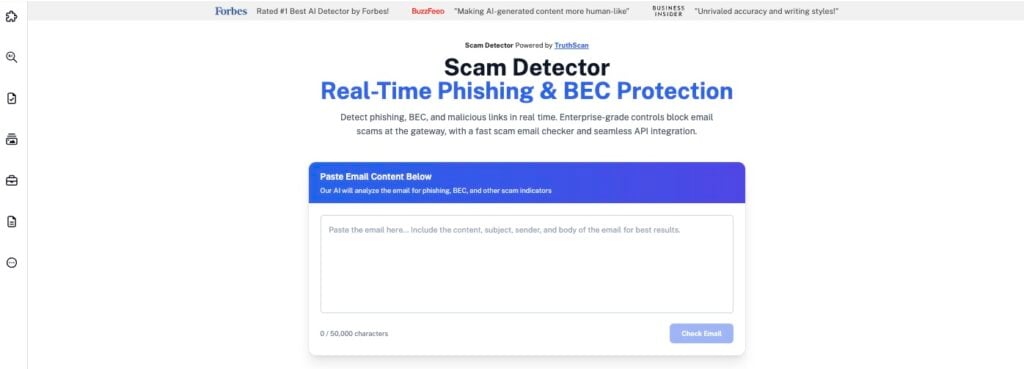

Poiché queste truffe spesso iniziano con l'immagine di una celebrità “verificata”, la normale prudenza non è sufficiente. Eseguite il link o il messaggio di accompagnamento attraverso il nostro Undetectable AI Rilevatore di truffe.

Fornisce un livello vitale di sicurezza segnalando i domini fraudolenti e il linguaggio ad alto rischio “get-rich-quick” che spesso accompagna i deepfake generati dall'AI di analisti finanziari o personaggi pubblici.

C'è un altro problema che si sta verificando, chiamato "dividendo del bugiardo".

Con il diffondersi dei falsi di AI, le persone coinvolte in scandali reali si limitano a liquidare le prove come "deepfake" - anche quando è autentico. I politici hanno già iniziato a usare questa tattica.

L'importanza di identificare l'IA rispetto alle immagini reali

La necessità di comprendere l'immagine reale e quella falsa è più che mai sentita per un paio di motivi:

1 - Erosione della fiducia pubblica

La nostra società si basa sulla fiducia. Il nostro cervello accetta ciò che vede nei telegiornali, nei tribunali o dai nostri leader.

Ma ora, con l'intelligenza artificiale che crea immagini false così convincenti, questa fiducia sta venendo meno.

Se continuiamo a essere così sospettosi, cambierà completamente il nostro modo di relazionarci con il mondo.

2 - Implicazioni legali e normative emergenti

I governi stanno cercando di capire cosa fare con le immagini false dell'AI.

Ad esempio,

- La California ha appena approvato una legge che rende illegale la creazione di annunci politici falsi utilizzando l'intelligenza artificiale durante le elezioni.

- Il La legge sull'intelligence dell'UE impone degli obblighi sull'etichettatura dei requisiti dei materiali AI e deepfake.

3 - Impatto sulle competenze digitali

Mentre l'intelligenza artificiale diventa sempre più brava a creare immagini false, tutti noi dobbiamo diventare più bravi a individuarle.

Le scuole devono insegnare agli studenti l'IA e la tecnologia in continua evoluzione di Deepfake.

Dobbiamo sviluppare una comprensione completa per non limitarci a credere a tutto ciò che vediamo online.

4 - Mantenimento delle catene di autenticità

Una soluzione può essere "Catene di autenticità."

Ciò significa tracciare la provenienza di un'immagine, a partire dal momento in cui viene creata fino al momento in cui la vediamo.

Una speciale tecnologia può aggiungere alle foto reali segni invisibili che mostrano chi le ha scattate e quando.

Utilizzandolo, potremmo verificare la storia di un'immagine e la sua autenticità.

Come capire se un'immagine è generata dall'intelligenza artificiale (segnali chiave)

Le immagini generate dall'intelligenza artificiale hanno un aspetto così reale che un principiante farebbe fatica a trovare la differenza.

Se state cercando di capire come identificare se un'immagine è stata generata dall'intelligenza artificiale, cercate questi dettagli chiave:

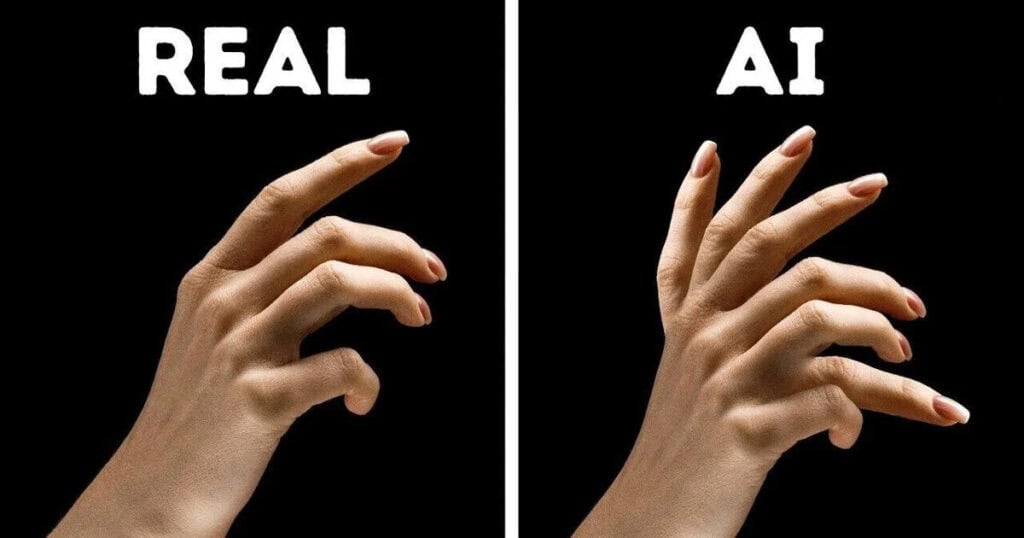

- 1. Dettagli innaturali o surreali

L'intelligenza artificiale non è in grado di capire alcune parti del corpo, in particolare mani.

Abbiamo 5 dita per mano, ma l'intelligenza artificiale spesso assegna alle persone 6-8 dita, dita fuse o pollici dall'aspetto strano. Guardate le mani.

Fonte = Orari

Anche l'intelligenza artificiale fa confusione denti molto.

Cercate denti che sembrano troppo perfetti, troppi denti in una bocca o denti che non sono allineati correttamente.

A volte, tutti i denti si fondono in un'unica chiazza bianca.

Immagine generata da ChatGPT

Altri errori del corpo includono:

- Occhi che non coincidono o che guardano in direzioni leggermente diverse

- Orecchie che non combaciano o che si trovano ad altezze differenti

- Occhiali che si deformano in modo strano o che fluttuano fuori dal viso

- Gioielli che si fondono con la pelle o che non seguono i movimenti del corpo.

- 2. Texture eccessivamente liscia o simile alla plastica

Pelle vera ha una consistenza (pori, linee, piccole imperfezioni). Tuttavia, l'AI spesso fa sembrare la pelle una bambola di plastica, troppo perfetta!

I capelli sono un altro indizio. I capelli veri hanno singole ciocche che vanno in direzioni diverse.

I capelli AI spesso sembrano un pezzo unico, soprattutto nel punto in cui si incontrano con la fronte.

L'attaccatura dei capelli potrebbe sembrare dipinta piuttosto che mostrare i singoli capelli.

Fonte = Mikestuzzi

Vestiti nelle immagini AI sono molto lisce o presentano strane rughe che non hanno senso fisico.

Osservate come si piegano i tessuti: si piegano come farebbero i materiali veri?

Spesso l'AI fa sembrare il tessuto sciolto o congelato in modi impossibili.

Perché succede? L'intelligenza artificiale non comprende la fisica e i materiali: si limita a copiare modelli già visti.

Ad esempio,

Potrebbe conoscere l'aspetto del denimma non come il denim si comporta quando qualcuno vi si siede sopra. Cercate questi indizi.

- 3. Testo sfocato o farfugliato nell'immagine

Il testo è la principale debolezza dell'intelligenza artificiale.

Quando si vedono parole o lettere in un'immagine AI, spesso sono sfocate, senza senso o semplicemente sbagliate.

Immagine generata da ChatGPT

Cercare:

- Parole che iniziano normalmente ma si trasformano in parole senza senso

- Lettere che si mescolano o cambiano forma

- Combinazioni impossibili di simboli

- Testi senza senso su cartelli o magliette

Questo accade perché l'intelligenza artificiale non comprende il linguaggio nello stesso modo in cui comprende le immagini. I testi sembrano essere un altro modello visivo.

- 4. Luci e ombre incoerenti

Le immagini generate dall'intelligenza artificiale non seguono o comprendono le regole di luce e ombra.

Ad esempio, A volte sembra che ci siano più soli nel cielo.

Oppure ci sono ombre sugli oggetti (pelle, metallo, vetro) che non hanno senso.

L'intelligenza artificiale non comprende la fisica della luce. Sta solo cercando di far corrispondere gli schemi che ha già visto, non sta calcolando come la luce rimbalza e si riflette.

Fonte = Creatore.nightcafe.club

Questi problemi di luce stanno migliorando, ma sono ancora comuni anche nelle immagini AI di alta qualità.

- 5. Sfondi strani o percezione della profondità non realistica

Lo sfondo delle immagini di IA spesso contiene indizi che indicano che qualcosa non va. Cercare:

- Edifici dall'architettura impossibile (finestre non allineate, porte che non portano da nessuna parte)

- Oggetti che sembrano confondersi l'uno con l'altro o con lo sfondo

- Cose che dovrebbero essere lontane ma che sembrano della stessa dimensione di quelle vicine

Fonte = Wallpaperaccess.com

A volte il bordo in cui una persona incontra lo sfondo ha un aspetto strano, o troppo nitido o troppo sfocato. Questo accade perché l'IA crea la persona e lo sfondo separatamente e poi cerca di unirli.

- 6. Controllare i metadati e le informazioni sulla fonte

Ogni foto scattata da una vera macchina fotografica ha "Metadati" - informazioni su quando e come è stata scattata la foto.

Le immagini AI non hanno metadati o metadati che dimostrino che sono state realizzate da programmi come DALL-E o Midjourney.

È possibile controllare i metadati utilizzando:

- Cliccare con il tasto destro del mouse su un'immagine e guardare "Proprietà" o "Info".

- Utilizzando siti web come metadata2go.com

- Sul telefono, utilizzare applicazioni come Photo Investigator

Se non siete sicuri, provate a fare un ricerca inversa di immagini.

- Vai a Google Immagini

- Caricate l'immagine per vedere se appare altrove online o in versioni diverse.

Ricordate che il fatto che qualcuno dichiari di aver scattato una foto non la rende vera.

Chi l'ha pubblicato e perché? Vogliono farmi arrabbiare o spaventare?

Questi sono spesso segni di immagini false.

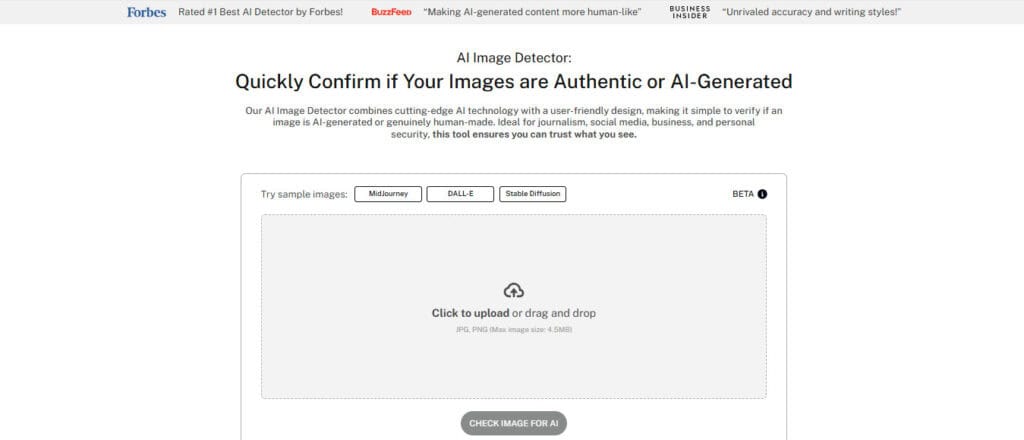

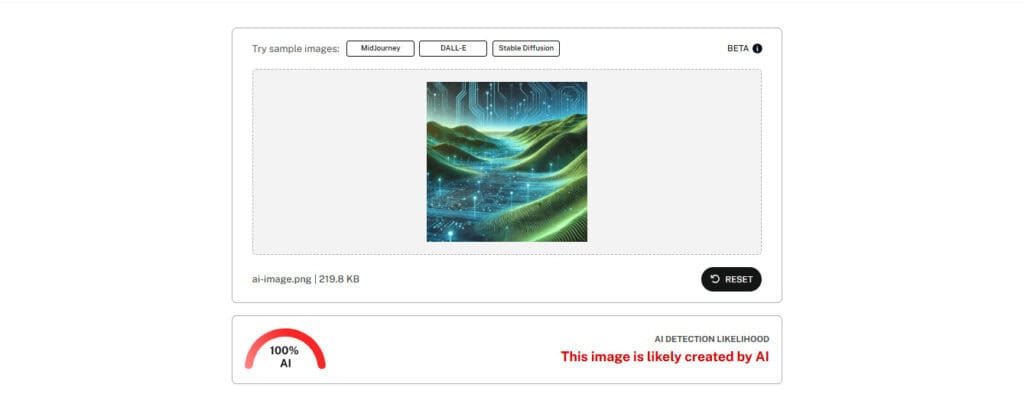

Il miglior strumento per rilevare le immagini generate dall'intelligenza artificiale

Sorprendentemente, esistono altri strumenti addestrati all'IA che aiutano a rilevare l'IA. In questo caso, lo strumento è Rilevatore di immagini AI.

Vediamo quali sono le caratteristiche di un buon rilevatore AI.

1 - Precisione: Alcuni strumenti di rilevazione sono per lo più corretti, mentre altri commettono errori.

I migliori rilevatori di oggi ci azzeccano circa l'80-85% delle volte, il che non è perfetto ma è molto meglio che tirare a indovinare.

2 - Quali generatori di IA può rilevare: Alcuni strumenti sono ottimi per individuare una fonte (ad esempio, le immagini di DALL-E) ma non ne individuano altre (ad esempio, i falsi di Midjourney).

Questo strumento è addestrato su tutti i principali strumenti artistici di IA: DALL-E, Midjourney, Stable Diffusion e altri ancora.

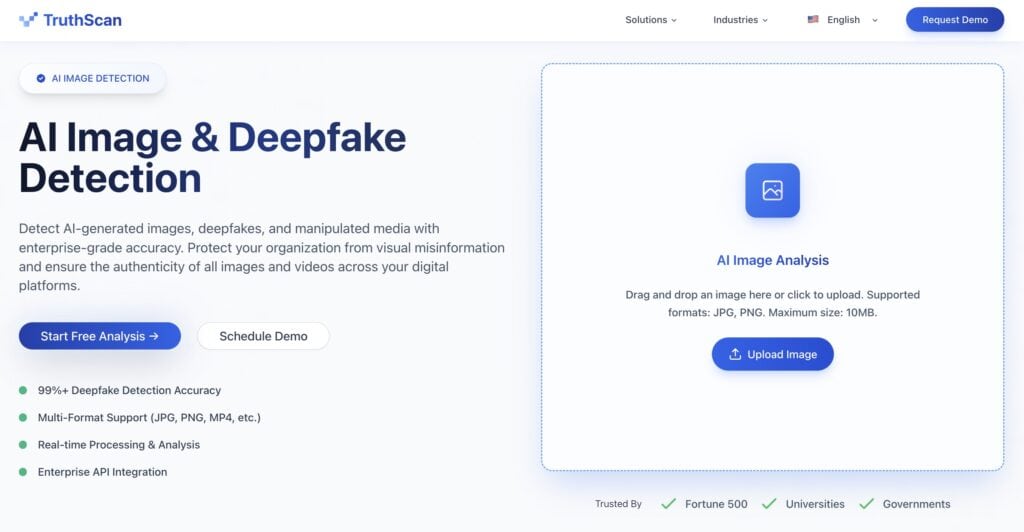

Per analisi più avanzate e di livello forense, Rilevatore di immagini AI di TruthScan è un altro potente strumento che vale la pena di aggiungere al vostro kit di strumenti per la verifica delle immagini.

Va oltre l'analisi dei pattern a livello di pixel per rilevare i segni di contenuti manipolati o generati dall'IA, compresi i deepfake e i media sintetici.

Sia che si tratti di potenziale disinformazione, di problemi di sicurezza del marchio o di prove digitali, TruthScan aiuta a garantire che le immagini utilizzate o incontrate siano autentiche, tracciabili e legalmente sicure da condividere.

Rilevamento di deepfake per confermare l'autenticità delle immagini

Per le situazioni in cui l'accuratezza visiva è veramente importante, Undetectable AI Rilevamento di deepfake fornisce un modo preciso per verificare se un'immagine o un video sono stati generati o manipolati artificialmente.

Esamina coerenza dell'illuminazione, modelli di pixel e allineamento del viso per rilevare anche i segni più sottili di deepfake o di editing sintetico.

Caricando il vostro file, riceverete un punteggio di autenticità e indicatori visivi che evidenziano le aree di potenziale manipolazione.

In combinazione con l'AI Image Detector, Deepfake Detection garantisce che ogni immagine condivisa o pubblicata sia verificata, autentica e affidabile.

Per i team o le istituzioni che esaminano anche i contributi audio, come le dichiarazioni personali registrate o le risposte alle domande di ammissione registrate, è utile verificare che la voce che si sta ascoltando sia autentica.

IA non rilevabili Rilevatore vocale AI è in grado di analizzare l'audio caricato e verificare la presenza di segni di sintesi vocale o clonazione.

Ti fornisce un chiaro segnale che indica se il discorso è stato prodotto da un vero oratore o generato da un modello di intelligenza artificiale, aggiungendo un ulteriore livello di affidabilità e autenticità a qualsiasi contributo vocale.

3 - Facilità d'uso: Non dovrebbe essere necessaria una laurea in informatica per verificare se un'immagine è falsa.

È sufficiente caricare l'immagine per ottenere il risultato in pochi secondi.

4 - Privacy: Alcuni rilevatori conservano tutte le immagini caricate, il che potrebbe essere un problema se si stanno controllando foto sensibili. Questo strumento elimina le immagini dopo averle controllate.

Ecco come utilizzare il nostro Rilevatore di immagini AI:

- Fare clic su questo link per visitare il sito web.

- Selezionare l'immagine desiderata dal computer o dal telefono. Lo strumento accetta i formati JPEG e PNG fino a 4,5 MB di dimensione.

- Fare clic sul pulsante e attendere qualche secondo.

- Un punteggio complessivo da 1 a 100 indica la probabilità che l'immagine sia generata dall'intelligenza artificiale.

Per ottenere risultati ottimali, utilizzare immagini che non siano state pesantemente compresse o ridimensionate.

Le schermate e le immagini provenienti dai social media sono spesso compresse, il che può rendere più difficile il rilevamento.

A volte i rilevatori sbagliano in due modi principali:

- Falsi positivi Quando il rilevatore dice che un'immagine è generata dall'intelligenza artificiale, ma è reale. Questo può accadere con foto altamente modificate, illustrazioni o immagini con un'illuminazione insolita.

Falsi negativi Quando il rilevatore dice che un'immagine è reale, ma in realtà è generata dall'intelligenza artificiale.

Questo accade più spesso con immagini AI pesantemente modificate o realizzate da modelli AI più recenti che il rilevatore non ha ancora imparato a conoscere.

Se state cercando un modo semplice per analizzare i contenuti generati dall'intelligenza artificiale, date un'occhiata al nostro AI Detector e Humanizer nel widget qui sotto!

Domande frequenti sul rilevamento di immagini generate dall'intelligenza artificiale

Come capire se un'immagine o un video sono generati dall'intelligenza artificiale?

Le immagini generate dall'intelligenza artificiale spesso hanno difficoltà con il testo, gli oggetti simmetrici e la resa di sfondi coerenti.

Nei video, le persone potrebbero muoversi in modo innaturale, la voce potrebbe non corrispondere alle labbra o alcune parti del video potrebbero sfarfallare da un fotogramma all'altro.

Esistono filigrane sulle immagini generate dall'intelligenza artificiale?

Sì, alcuni strumenti di intelligenza artificiale come Midjourney e DALL-E di OpenAI nascondono filigrane segrete nelle loro immagini.

Le immagini generate dall'intelligenza artificiale possono essere completamente impercettibili?

La risposta è "no" a partire dal 2025. I modelli avanzati di intelligenza artificiale stanno creando immagini molto convincenti, ma gli artefatti tecnici sono ancora allo stesso livello.

Attualmente la tecnologia è in grado di eliminare circa 85% delle cose che possono essere notate, ma non può ancora rendere qualcosa completamente invisibile.

Perché alcune immagini AI sembrano iperrealistiche?

I modelli AI più recenti realizzano immagini super realistiche grazie a una tecnologia intelligente.

Sono stati addestrati su miliardi di immagini di alta qualità e continuano a migliorare con aggiornamenti speciali.

Questi modelli sono particolarmente adatti a catturare gli stili fotografici, l'illuminazione realistica e le texture dettagliate.

Qual è il miglior rilevatore AI per le immagini?

Il Rilevatore di immagini AI di Undetectable AI rileva le immagini generate dall'AI con una precisione fino a 85%.

Utilizza un processo intelligente in più fasi per controllare i minimi dettagli delle immagini.

Esamina gli schemi nei pixel, i dati nascosti e i piccoli errori che altri strumenti potrebbero non notare.

Riflessioni finali: Come riconoscere le immagini generate dall'intelligenza artificiale

Questo è il punto di partenza e, prima di concludere questo blog, ho una domanda per voi.

Perché il nostro cervello è così facilmente ingannato dalle immagini dell'intelligenza artificiale?

La risposta sta nella psicologia umana.

Il nostro cervello segue il "effetto di superiorità dell'immagine".

Secondo questo principio, le immagini si fissano nella nostra mente meglio delle parole.

Quando qualcosa sembra reale e si adatta a ciò che già crediamo, non lo mettiamo in discussione. Inoltre, spesso siamo troppo occupati per controllare due volte se una foto è vera o falsa.

In questo caso, è possibile cercare gli indizi di cui abbiamo parlato sopra. Mani strane, testi strani e pelle perfetta possono aiutare a individuare i falsi AI.

La cosa più importante da ricordare è che gli occhi possono essere ingannati. Solo perché un'immagine sembra vera, non significa che lo sia.

Quando vedete qualcosa di sorprendente o scioccante online, prendetevi un minuto per pensarci prima di condividerlo o esprimere un giudizio.

Dato che l'intelligenza artificiale sta diventando ogni giorno più importante, tutti noi dobbiamo diventare più bravi a individuarla. La prossima volta che vedrete una foto fantastica, sarete il super detective delle immagini e cercherete gli indizi?