Så du den virale Bildet av paven i en stilig hvit pufferjakke i 2023?

Millioner av mennesker delte det, nyhetssider rapporterte om det, og alle snakket om hvor stilig paven så ut.

Det var bare ett problem - det skjedde aldri. Bildet var fullstendig skapt av kunstig intelligens.

Eller du husker kanskje det sjokkerende bildet av en eksplosjonen i Pentagon som rystet aksjemarkedet en kort stund. Falsk!

Hva med bildene av Trump blir taklet og arrestert? Igjen, de var også fullstendig oppdiktet av AI.

Falske AI-bilder har forårsaket reell skade.

Folk har tapt penger på å investere basert på falske nyhetsbilder.

Både kjendiser og vanlige folk har fått ansiktene sine plassert på andre kropper i pinlige eller upassende situasjoner.

Politikere har blitt vist når de sier og gjør ting de aldri har gjort i virkeligheten.

Når vi ikke kan stole på våre egne øyne, trenger vi nye måter å finne ut hva som er ekte og hva som ikke er det.

I denne bloggen vil jeg vise deg hvordan AI- og DeepFake-teknologien har utviklet seg gjennom årene, hvor viktig det er å identifisere AI kontra ekte bilder, hvordan du kan se om et bilde er AI-generert, eller det beste verktøyet for å oppdage AI-genererte bilder.

Hvordan AI-kunst og Deepfake-teknologi har utviklet seg

La oss snakke om AI ...først...

For ikke så lenge siden så AI-genererte bilder ut som en vond drøm - uklare ansikter, ekstra fingre og mye rart. Men i dag er AI-kunst sjokkerende realistisk.

Det hele startet rundt 2014 med GANs (Generative Adversarial Networks), der to AI-modeller - en som lager forfalskninger, den andre som oppdager dem - stadig forbedrer hverandre.

Aldri bekymre deg for at AI oppdager tekstene dine igjen. Undetectable AI Kan hjelpe deg:

- Få AI-assistert skriving til å vises ...menneskelignende.

- Bypass alle de viktigste AI-deteksjonsverktøyene med bare ett klikk.

- Bruk AI trygt og selvsikkert i skole og arbeid.

De første GAN-bildene var ganske dårlige - uskarpe ansikter med rare øyne og manglende ører.

I 2020 ble ting mye bedre med "Diffusjonsmodeller."

De starter med et rotete bilde fullt av prikker, og rydder sakte opp til det ser ekte ut.

Dette var et stort fremskritt. Plutselig kunne kunstig intelligens lage mye klarere og mer realistiske bilder.

Deepfake-teknologi fungerer på samme måte, men på en vanskeligere måte.

Det innebærer bruk av både AI- og Deepfake-teknologi.

AI lærer seg hvordan en persons ansikt ser ut fra mange vinkler og uttrykk ved å studere mange videoer og bilder av dem.

Deretter kan den sette den personens ansikt på en annen persons kropp i en annen video.

Datamaskinen lærer seg å matche lys, hudfarge og til og med små ansiktsuttrykk for å få det til å se ekte ut.

Tidlige deepfakes fra 2017 så åpenbare og glitchy ut. Dagens deepfakes kan være nesten perfekte.

For å se sammenligningen, se videoene nedenfor:

Deepfake i 2017 Falsk Obama-video

Deepfake i 2023 - Emma Watson i "Get Out (2017)"

I 2022 skapte folk rundt 6 millioner bilder ved hjelp av AI. Tidlig i 2023 var tallet steget til over 20 millioner bilder hver dag.

I dag finnes det milliarder av AI-skapte bilder på nettet, og de fleste av oss ser dem daglig uten å være klar over det.

Risikoen ved AI-genererte bilder i feilinformasjon

Falske nyheter spres seks ganger raskere enn sanne nyheter på sosiale medier.

Skaden er som regel allerede skjedd når noen påpeker at et bilde er falskt.

Risikoen forbundet med falske bilder er:

1) Manipulering - Falske bilder skaper falske fortellinger om andre, inkludert valg, ledere og verdensbegivenheter. For eksempel, AI-genererte bilder viste feilaktig arrestasjonen av USAs president Donald Trump.

2) ærekrenkelse - Falske bilder kan ødelegge omdømmet. For eksempel, i januar 2024 sirkulerte AI-genererte bilder av Taylor Swift på nettet, som feilaktig fremstilte henne.

3) Sosial uro - Et enkelt falskt bilde kan skape raseri, opptøyer eller til og med vold. For eksempel, i mai 2023, sirkulerte et AI-generert bilde som viste en eksplosjon i nærheten av Pentagon, på sosiale medier.

4) Bedrageri Svindlere bruker falske bilder for å lure folk til å sende penger. For eksempel; Michael Hewson (finansanalytiker) ble utgitt for å promotere falske investeringsopplegg.

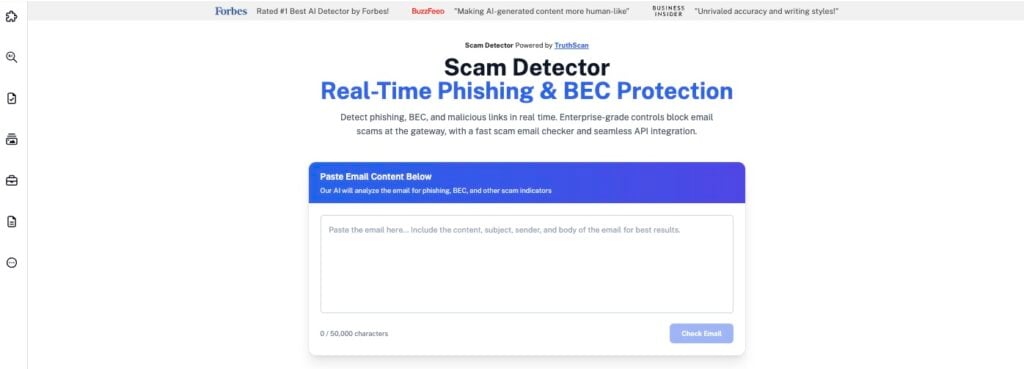

Fordi disse svindelforsøkene ofte starter med et “verifisert” kjendisbilde, er det ikke nok med vanlig forsiktighet. Kjør den medfølgende lenken eller meldingen gjennom vår Undetectable AIs Svindeldetektor.

Det gir et viktig sikkerhetslag ved å flagge falske domener og høyrisiko “bli rik fort”-språk som ofte følger med AI-genererte deepfakes av finansanalytikere eller offentlige personer.

Det er et annet problem som skjer nå, kalt "Løgnerens utbytte."

Etter hvert som AI-forfalskninger blir vanlige, avfeier folk som blir tatt i ekte skandaler, bevisene som "deepfake" - selv når det er ekte. Politikere har allerede begynt å bruke denne taktikken.

Viktigheten av å identifisere AI vs. ekte bilder

Behovet for å forstå hva som er ekte og hva som er falskt, er større enn noen gang av flere grunner:

1 - Undergraving av offentlig tillit

Samfunnet vårt er basert på tillit. Hjernen vår aksepterer det den ser i nyhetene, i retten eller fra våre ledere.

Men nå, med AI som lager så overbevisende falske bilder, er denne tilliten i ferd med å brytes ned.

Hvis vi alle fortsetter å være så mistenksomme, vil det fullstendig endre hvordan vi forholder oss til verden.

2 - Juridiske implikasjoner og nye forskrifter

Myndighetene prøver å finne ut hva de skal gjøre med falske AI-bilder.

For eksempel,

- California har nettopp vedtatt en lov som gjør det ulovlig å lage falske politiske annonser ved hjelp av kunstig intelligens i valgperioden.

- Den EUs etterretningslov pålegger forpliktelser om merking av kravene til AI- og deepfake-materialer.

3 - Innvirkning på digitale ferdigheter

Etter hvert som kunstig intelligens blir flinkere til å lage falske bilder, må vi alle bli flinkere til å oppdage dem.

Skolene må lære elevene om AI og Deepfake-teknologien, som er i stadig utvikling.

Vi må utvikle en fullstendig forståelse, slik at vi ikke bare tror på det vi ser på nettet.

4 - Opprettholde autentisitetskjeder

En løsning kan være "Autentisitetskjeder."

Det betyr å spore hvor et bilde kommer fra - fra det øyeblikket det blir skapt til vi ser det.

Spesiell teknologi kan legge til usynlige merker på ekte bilder som viser hvem som har tatt dem og når.

Hvis vi bruker dette, kan vi verifisere et bildes historie og autentisitet.

Hvordan se om et bilde er AI-generert (viktige tegn)

Bildene som genereres av AI, ser så ekte ut at en nybegynner vil slite med å finne forskjellen.

Hvis du prøver å finne ut om et bilde er AI-generert, bør du se etter disse nøkkeldetaljene:

- 1. Unaturlige eller surrealistiske detaljer

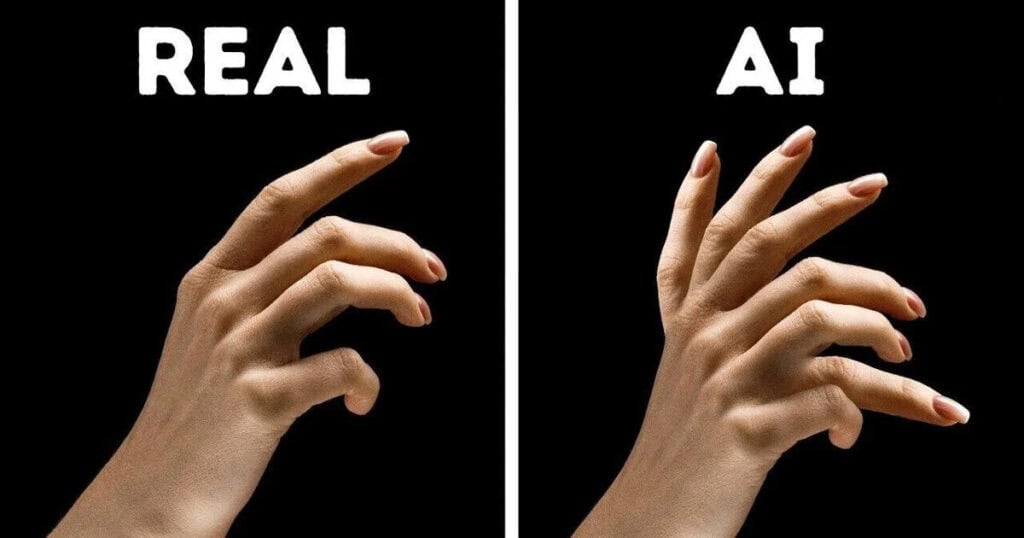

AI kan ikke finne ut av visse kroppsdeler, spesielt hender.

Vi har fem fingre på hver hånd, men AI gir ofte folk 6-8 fingre, sammenvokste fingre eller tommeltotter som ser merkelige ut. Se på hendene.

Kilde = Fltimes

AI gjør også feil tenner mye.

Se etter tenner som virker for perfekte, for mange tenner i munnen eller tenner som ikke står på rett linje.

Noen ganger smelter alle tennene sammen til en hvit klatt.

Bilde generert av ChatGPT

Andre kroppsfeil inkluderer:

- Øyne som ikke passer sammen eller ser i litt forskjellige retninger

- Ører som ikke passer sammen eller har ulik høyde

- Briller som forvrenger seg på en merkelig måte eller flyter av ansiktet

- Smykker som smelter inn i huden eller ikke følger kroppens bevegelser.

- 2. Overdrevent glatte eller plastlignende teksturer

Ekte hud har tekstur (porer, linjer, små ujevnheter). AI får imidlertid ofte huden til å se ut som en plastdukke - for perfekt!

Håret er en annen ledetråd. Ekte hår har individuelle hårstrå som går i forskjellige retninger.

AI-hår ser ofte ut som ett stykke, spesielt der det møter pannen.

Hårfestet kan se påmalt ut i stedet for å vise de enkelte hårstråene.

Kilde = Mikestuzzi

Klær i AI-bilder er enten veldig glatte eller har rare rynker som ikke gir fysisk mening.

Se på hvordan tekstiler brettes - bøyer de seg som ekte materialer ville gjort?

Ofte får AI stoffet til å se ut som om det har smeltet eller frosset på umulige måter.

Hvorfor skjer dette? AI forstår ikke fysikk og materialer - den kopierer bare mønstre den har sett før.

For eksempel,

Den vet kanskje hvordan denim ser utmen ikke hvordan denim oppfører seg når noen setter seg på den. Se etter disse ledetrådene.

- 3. Uskarp eller utydelig tekst i bildet

Tekst er AIs største svakhet.

Når du ser ord eller bokstaver i et AI-bilde, er de ofte uskarpe, tullete eller rett og slett feil.

Bilde generert av ChatGPT

Se etter:

- Ord som begynner normalt, men som blir til volapyk

- Bokstaver som blandes eller endrer form

- Umulige kombinasjoner av symboler

- Tekst på skilt eller t-skjorter som ikke gir mening

Dette skjer fordi AI ikke forstår språk på samme måte som den forstår bilder. Tekstene ser ut til å være et annet visuelt mønster.

- 4. Inkonsekvent belysning og skygger

AI-genererte bilder følger ikke eller forstår ikke reglene for lys og skygge.

For eksempel, Noen ganger ser det ut som om det er flere soler på himmelen.

Eller det kan være skygger på objekter (hud, metall, glass) som ikke gir mening.

AI forstår ikke lysfysikk. Den prøver bare å matche mønstre den har sett før, ikke å beregne hvordan lyset spretter og reflekteres.

Kilde = Creator.nightcafe.club

Disse lysproblemene er i ferd med å bli bedre, men de er fortsatt vanlige selv i AI-bilder av høy kvalitet.

- 5. Merkelige bakgrunner eller urealistisk dybdeoppfatning

Bakgrunnen i AI-bilder har ofte ledetråder om at noe ikke stemmer. Se etter:

- Bygninger med umulig arkitektur (vinduer som ikke står på linje, dører som ikke fører noen steder)

- Objekter som ser ut til å gli inn i hverandre eller i bakgrunnen

- Ting som burde være langt unna, men som ser like store ut som ting på nært hold

Kilde = Wallpaperaccess.com

Noen ganger ser kanten der en person møter bakgrunnen merkelig ut - enten for skarp eller for uskarp. Dette skjer fordi AI lager personen og bakgrunnen hver for seg og deretter prøver å sette dem sammen.

- 6. Sjekk metadata og kildeinformasjon

Alle bilder tatt med et ekte kamera har "Metadata" - informasjon om når og hvordan bildet ble tatt.

AI-bilder har ingen metadata eller metadata som viser at de er laget av programmer som DALL-E eller Midjourney.

Du kan sjekke metadata ved hjelp av:

- Høyreklikk på et bilde og se på "Egenskaper" eller "Info"

- Ved hjelp av nettsteder som metadata2go.com

- På telefonen kan du bruke apper som Photo Investigator

Hvis du er usikker, kan du prøve en omvendt bildesøk.

- Gå til Google Bilder

- Last opp bildet for å se om det finnes andre steder på nettet eller i ulike versjoner.

Husk at bare fordi noen påstår at de har tatt et bilde, betyr ikke det at det er sant.

Hvem har lagt ut dette og hvorfor? Vil de gjøre meg sint eller redd?

Dette er ofte tegn på falske bilder.

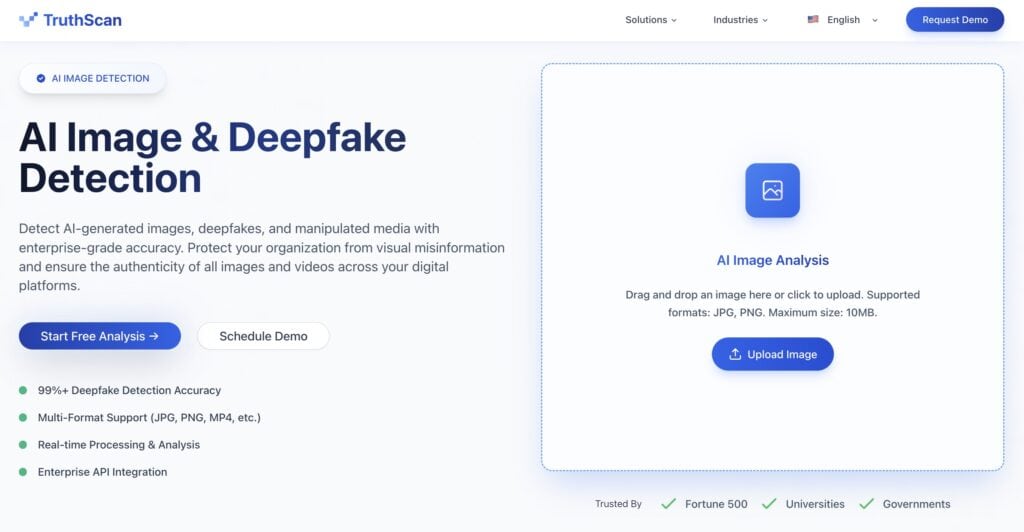

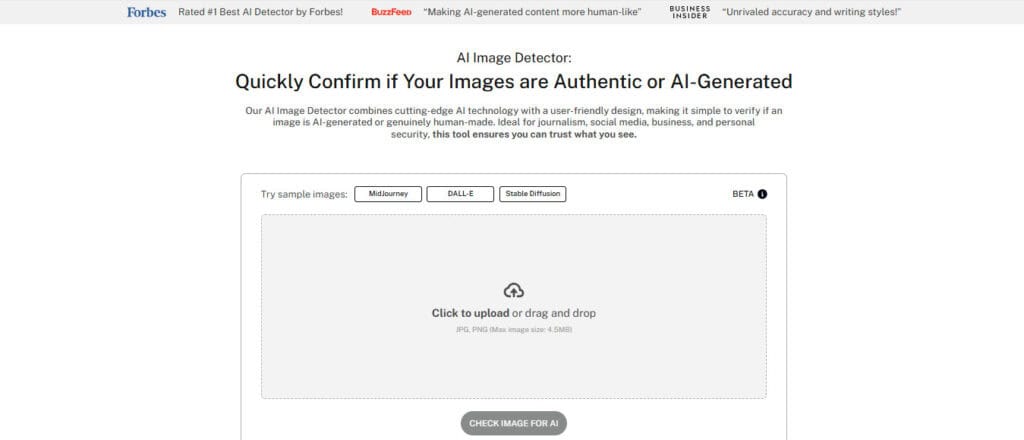

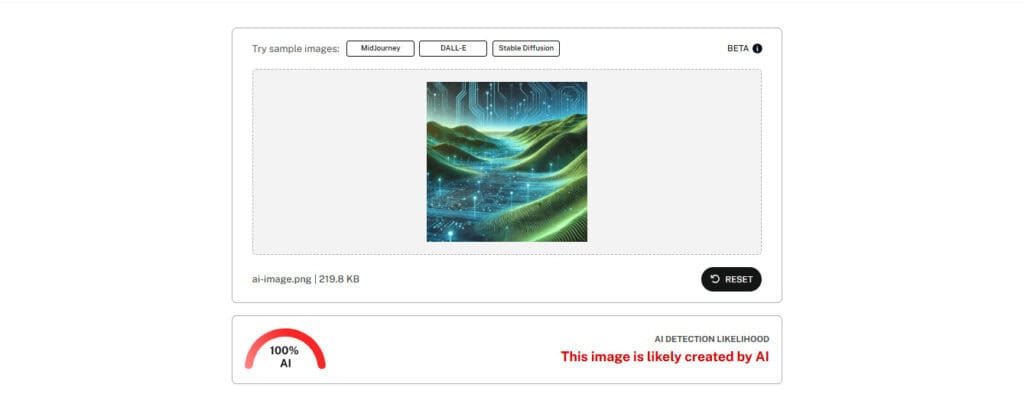

Det beste verktøyet for å oppdage AI-genererte bilder

Overraskende nok har vi andre AI-trente verktøy som hjelper til med å oppdage AI. I dette tilfellet er verktøyet AI-bildedetektor.

La oss ta en titt på hva som kjennetegner en god AI-detektor.

1 - Nøyaktighet: Noen detektorverktøy er stort sett riktige, mens andre gjør feil.

Den beste detektoren i dag treffer riktig i omtrent 80-85% av tilfellene, noe som ikke er perfekt, men mye bedre enn å gjette.

2 - Hvilke AI-generatorer den kan oppdage: Noen verktøy er gode til å oppdage én kilde (f.eks. DALL-E-bilder), men overser andre (f.eks. forfalskninger av Midjourney).

Dette verktøyet er opplært på alle de viktigste AI-verktøyene - DALL-E, Midjourney, Stable Diffusion med flere.

For mer avanserte og rettsmedisinske analyser, TruthScans AI-bildedetektor er et annet kraftig verktøy som er verdt å legge til i verktøykassen din for bildeverifisering.

Den går lenger enn mønsteranalyse på pikselnivå for å oppdage tegn på manipulert eller AI-generert innhold - inkludert deepfakes og syntetiske medier.

Enten du har å gjøre med potensiell feilinformasjon, problemer med varemerkesikkerhet eller digitale bevis, kan TruthScan bidra til å sikre at bildene du bruker eller støter på, er autentiske, sporbare og juridisk trygge å dele.

Deepfake-deteksjon for å bekrefte bildeautentisitet

I situasjoner der visuell nøyaktighet virkelig betyr noe, er Undetectable AIs Deteksjon av deepfake gir en presis måte å kontrollere om et bilde eller en video er kunstig generert eller manipulert.

Den undersøker konsistens i belysning, pikselmønstre og ansiktsjustering for å oppdage selv de mest subtile tegn på deepfake eller syntetisk redigering.

Når du laster opp filen din, får du en autentisitetspoengsum og visuelle indikatorer som fremhever potensielle manipulasjonsområder.

I kombinasjon med AI Image Detector sørger Deepfake Detection for at alle bildene du deler eller publiserer, er verifiserte, autentiske og pålitelige.

For team eller institusjoner som også vurderer lydinnsendelser, for eksempel muntlige personlige uttalelser eller innspilte svar på søknader, er det nyttig å kunne verifisere at stemmen du hører er ekte.

Uoppdagelige AI-er AI Voice Detector kan analysere opplastet lyd og sjekke for tegn på stemmesyntese eller kloning.

Det gir deg et klart signal om talen ble produsert av en ekte taler eller generert av en AI-modell, noe som gir ekstra tillit og autentisitet til alle stemmebaserte innleveringer.

3 - Brukervennlighet: Du burde ikke trenge en grad i informatikk for å sjekke om et bilde er falskt.

Du laster bare opp bildet, så får du resultatet i løpet av få sekunder.

4 - Personvern: Noen detektorer beholder alle bildene du laster opp, noe som kan være et problem hvis du sjekker sensitive bilder. Dette verktøyet sletter bilder etter at de er sjekket.

Slik bruker du vår AI-bildedetektor:

- Klikk på denne lenken for å besøke nettstedet.

- Velg ønsket bilde fra datamaskinen eller telefonen. Verktøyet godtar JPEG- og PNG-formater på opptil 4,5 MB.

- Klikk på knappen og vent noen sekunder.

- En samlet poengsum fra 1-100 viser hvor sannsynlig det er at bildet er AI-generert

Det beste resultatet får du ved å bruke bilder som ikke er kraftig komprimert eller har endret størrelse.

Skjermbilder og bilder fra sosiale medier er ofte komprimerte, noe som kan gjøre det vanskeligere å oppdage dem.

Noen ganger tar detektorer feil på to måter:

- Falske positiver skjer når detektoren sier at et bilde er AI-generert, men det er ekte. Dette kan skje med svært redigerte bilder, illustrasjoner eller bilder med uvanlig belysning.

Falske negativer skjer når detektoren sier at et bilde er ekte, men det i virkeligheten er AI-generert.

Dette skjer oftest med kraftig redigerte AI-bilder eller bilder laget av nyere AI-modeller som detektoren ikke har fått vite om ennå.

Hvis du er på utkikk etter en enkel måte å analysere AI-generert innhold på, kan du ta en titt på AI Detector og Humanizer i widgeten nedenfor!

Vanlige spørsmål om deteksjon av AI-genererte bilder

Hvordan kan man se om et bilde eller en video er generert av kunstig intelligens?

AI-genererte bilder sliter ofte med tekst, symmetriske objekter og gjengivelse av konsistente bakgrunner.

I videoer kan folk bevege seg unaturlig, stemmene deres stemmer kanskje ikke med leppene, eller deler av videoen kan flimre fra bilde til bilde.

Finnes det vannmerker på AI-genererte bilder?

Ja, noen AI-verktøy som Midjourney og OpenAIs DALL-E skjuler hemmelige vannmerker i bildene sine.

Kan AI-genererte bilder være helt usynlige?

Svaret er "nei" fra og med 2025. Avanserte AI-modeller skaper svært overbevisende bilder, men de tekniske artefaktene er fortsatt på samme nivå.

I dag kan teknologien fjerne omtrent 85% av det som kan merkes, men den kan ikke gjøre noe helt usynlig ennå.

Hvorfor ser noen AI-bilder hyperrealistiske ut?

De nyeste AI-modellene lager superrealistiske bilder ved hjelp av smart teknologi.

De har blitt trent opp på milliarder av bilder av høy kvalitet, og blir stadig bedre med spesielle oppgraderinger.

Disse modellene er spesielt gode til å fange opp fotograferingsstiler, realistisk belysning og detaljerte teksturer.

Hva er den beste AI-detektoren for bilder?

Den AI-bildedetektor fra Undetectable AI oppdager AI-genererte bilder med en nøyaktighet på opptil 85%.

Den bruker en smart flertrinnsprosess for å kontrollere bittesmå detaljer i bilder.

Den ser på mønstre i pikslene, skjulte data og små feil som andre verktøy kanskje ikke legger merke til.

Avsluttende tanker: Hvordan oppdage AI-genererte bilder

Det var en oppsummering, og før vi avslutter denne bloggen, har jeg et spørsmål til deg.

Hvorfor lar hjernen vår seg så lett lure av AI-bilder?

Svaret ligger i den menneskelige psykologien.

Hjernen vår følger "picture superiority effect".

Bilder fester seg bedre i minnet enn ord.

Når noe ser ekte ut og passer inn i det vi allerede tror på, stiller vi ikke spørsmål ved det. I tillegg er vi ofte for opptatt til å dobbeltsjekke om et bilde er ekte eller falskt.

I dette tilfellet kan du se etter ledetrådene vi har diskutert ovenfor. Merkelige hender, merkelig tekst og perfekt hud kan hjelpe deg med å oppdage AI-fakes.

Det viktigste å huske på er at øynene dine kan bli lurt. Bare fordi et bilde ser ekte ut, betyr ikke det at det er det.

Når du ser noe fantastisk eller sjokkerende på nettet, bør du ta deg tid til å tenke over det før du deler det eller feller en dom.

AI blir stadig bedre, og vi må alle bli flinkere til å oppdage dem. Neste gang du ser et fantastisk bilde, vil du være en superbildedetektiv og lete etter ledetrådene?