Ви бачили цей вірусний Фото Папи Римського у стильній білій куртці-пуховику у 2023 році?

Мільйони людей поширили його, новинні сайти повідомили про нього, і всі говорили про те, як стильно виглядав Папа.

Була лише одна проблема - цього ніколи не відбувалося. Зображення було повністю створене штучним інтелектом.

Або ви можете пригадати шокуюче зображення вибух у Пентагоні яка ненадовго потрясла фондовий ринок. Фальшивка!

А як щодо фотографій Трампа схопили і заарештували? Знову ж таки, вони також були повністю вигадані штучним інтелектом.

Підроблені зображення зі штучним інтелектом завдали реальної шкоди.

Люди втратили гроші, інвестуючи на основі фотографій з фейкових новин.

Як знаменитості, так і звичайні люди у незручних чи недоречних ситуаціях перевдягали обличчя на інші тіла.

Політики були показані як такі, що говорять і роблять те, чого насправді ніколи не робили.

Коли ми не можемо довіряти власним очам, нам потрібні нові способи з'ясувати, що є реальним, а що ні.

У цьому блозі я покажу вам, як AI та технологія DeepFake розвивалися протягом багатьох років, як важливо розрізняти штучний інтелект та реальні зображення, як визначити, чи є зображення штучно створеним, а також про найкращий інструмент для виявлення штучно створених зображень.

Як еволюціонували мистецтво штучного інтелекту та технологія глибокого підроблення

Поговоримо про ШІ спершу...

Не так давно зображення, створені штучним інтелектом, виглядали як страшний сон - розмите обличчя, зайві пальці та багато інших дивацтв. Але сьогодні АІ-арт шокує своєю реалістичністю.

Все почалося приблизно в 2014 році з GANs (Generative Adversarial Networks), де дві моделі штучного інтелекту - одна створює фейки, а інша їх виявляє - постійно вдосконалювали одна одну.

Більше ніколи не турбуйтеся про те, що ШІ виявить ваші тексти. Undetectable AI Може допомогти тобі:

- Зробіть так, щоб ваше письмо з допомогою штучного інтелекту з'являлося на екрані схожий на людину.

- Обхід всі основні інструменти виявлення ШІ лише одним кліком.

- Використання ШІ безпечно і впевнено у школі та на роботі.

Ранні зображення GAN були досить поганими - розмиті обличчя з дивними очима і відсутніми вухами.

До 2020 року справи пішли набагато краще з "дифузійні моделі".

Вони починають з безладного зображення, повного крапок, і повільно очищають його, поки воно не стане схожим на справжнє.

Це був величезний стрибок уперед. Раптом ШІ став створювати набагато чіткіші, реалістичніші зображення.

Технологія глибокого підроблення працює так само, але трохи хитріше.

Він передбачає використання як AI, так і технології Deepfake.

ШІ вивчає, як виглядає обличчя людини з різних ракурсів і виразів, вивчаючи безліч відео та фотографій з її обличчям.

Потім вона може помістити обличчя цієї людини на чиєсь інше тіло в іншому відео.

Комп'ютер вчиться підлаштовуватися під освітлення, тон шкіри і навіть крихітні вирази обличчя, щоб все виглядало реалістично.

Перші дельфейки 2017 року виглядали очевидними і глючними. Сьогоднішні ділфейки можуть бути майже ідеальними.

Щоб побачити порівняння, подивіться відео нижче:

Deepfake у 2017 році - Фальшиве відео про Обаму

Deepfake у 2023 році - Емма Вотсон у фільмі "Забирайся геть" (2017)

У 2022 році люди створили близько 6 мільйонів зображень за допомогою ШІ. На початку 2023 року ця цифра підскочила до понад 20 мільйонів зображень щодня.

Сьогодні мільярди зображень, створених штучним інтелектом, існують в Інтернеті, і більшість з нас бачать їх щодня, навіть не підозрюючи про це.

Ризики зображень, згенерованих штучним інтелектом, у дезінформації

Неправдиві новини в соціальних мережах поширюються в 6 разів швидше, ніж правдиві.

Шкода зазвичай завдається до того моменту, коли хтось вказує на те, що зображення є фальшивим.

Ризики, пов'язані з підробленими зображеннями, такі:

1) Маніпуляція - Фальшиві образи створюють неправдиві наративи про інших, включаючи вибори, лідерів та світові події. Наприклад, Згенеровані штучним інтелектом зображення неправдиво зобразили арешт президента США Дональда Трампа.

2) Наклеп - Фейкові зображення можуть зіпсувати репутацію. Наприклад, у січні 2024 року в мережі поширилися згенеровані штучним інтелектом зображення Тейлор Свіфт, які неправдиво зображували її.

3) Соціальні заворушення - Одне фейкове зображення може викликати обурення, заворушення або навіть насильство. Наприклад, У травні 2023 року в соціальних мережах широко поширилося згенероване штучним інтелектом зображення вибуху біля Пентагону.

4) Шахрайство - Шахраї використовують підроблені зображення, щоб обманом змусити людей надсилати гроші. Наприклад; Майкл Хьюсон (фінансовий аналітик) видавав себе за Майкла Хьюсона з метою просування шахрайських інвестиційних схем.

Зараз існує ще одна проблема, яка називається "Дивіденди брехуна".

У міру того, як підробки ШІ стають все більш поширеними, люди, які потрапляють в реальні скандали, просто відкидають докази, вважаючи, що "глибокий фейк" - навіть якщо вона щира. Політики вже почали використовувати цю тактику.

Важливість ідентифікації ШІ та реальних зображень

Потреба зрозуміти, де справжній образ, а де фейковий, є більш ніж актуальною з кількох причин:

1 - Ерозія суспільної довіри

Наше суспільство базується на довірі. Наш мозок приймає те, що бачить в новинах, в суді чи від наших лідерів.

Але тепер, коли штучний інтелект створює такі переконливі фейкові зображення, ця довіра руйнується.

Якщо ми всі продовжуватимемо бути такими підозрілими, це повністю змінить наш зв'язок зі світом.

2 - Правові наслідки та нові правила, що з'являються

Уряди намагаються з'ясувати, що робити з підробленими фотографіями ШІ.

Наприклад,

- Каліфорнія щойно прийняла закон який забороняє створювати фальшиву політичну рекламу з використанням ШІ під час виборів.

- У "The Закон ЄС про розвідку накладає зобов'язання про вимоги до маркування матеріалів зі штучним інтелектом та глибоко підроблених матеріалів.

3 - Вплив на навички цифрової грамотності

Поки ШІ вдосконалюється у створенні фальшивих зображень, нам усім потрібно навчитися краще їх розпізнавати.

Школи повинні розповідати учням про технології AI та Deepfake, що постійно розвиваються.

Нам потрібно розвинути повне розуміння, щоб ми не просто вірили всьому, що бачимо в Інтернеті.

4 - Підтримка ланцюжків автентичності

Одним з рішень може бути "Ланцюги автентичності."

Це означає відстежувати, звідки походить зображення - від моменту його створення до моменту, коли ми його бачимо.

Спеціальна технологія може додавати невидимі позначки до реальних фотографій, які показують, хто і коли їх зробив.

Якщо ми скористаємося цим, то зможемо перевірити історію зображення та його автентичність.

Як визначити, що зображення згенероване штучним інтелектом (ключові ознаки)

Зображення, згенеровані штучним інтелектом, виглядають настільки реалістично, що новачкові буде важко знайти різницю.

Якщо ви намагаєтеся навчитися визначати, чи є зображення згенерованим штучним інтелектом, зверніть увагу на ці ключові деталі:

- 1. Неприродні або сюрреалістичні деталі

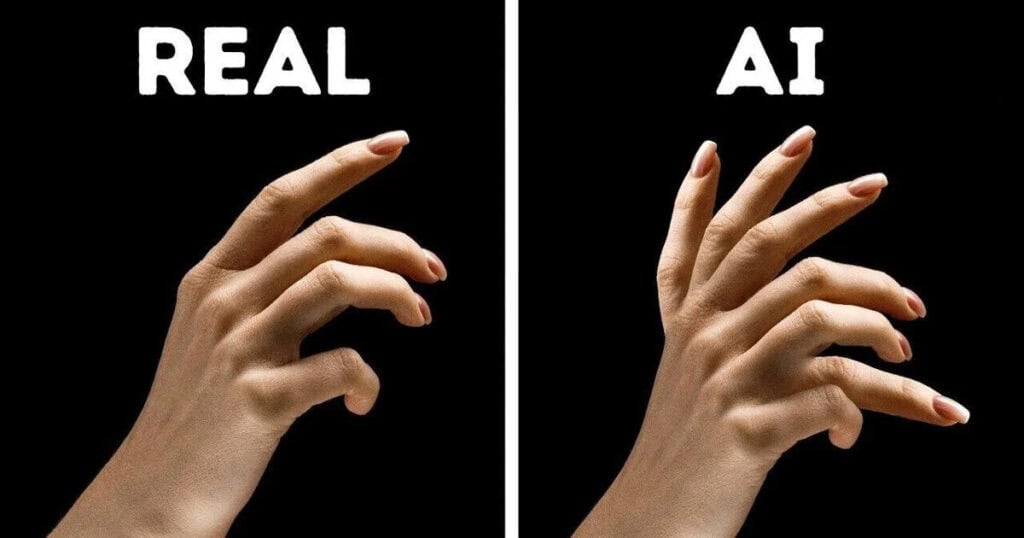

ШІ не може розпізнати певні частини тіла, особливо руки.

У нас по 5 пальців на кожній руці, але ШІ часто дає людям 6-8 пальців, зрощені пальці або великі пальці, що мають дивний вигляд. Подивіться на руки.

Джерело = Джерело Fltimes

ШІ також помиляється зуби дуже багато.

Зверніть увагу на зуби, які здаються занадто ідеальними, занадто багато зубів у роті або зуби, які не вирівняні.

Іноді всі зуби зливаються в одну білу пляму.

Зображення згенероване за допомогою ChatGPT

Інші помилки тіла включають:

- Очі, які не збігаються або дивляться в різні боки

- Вуха, які не збігаються або знаходяться на різній висоті

- Окуляри, які дивно деформуються або злітають з обличчя

- Прикраси, які тануть у шкірі або не повторюють рухів тіла.

- 2. Надмірно гладкі або пластикові текстури

Справжня шкіра має текстуру (пори, зморшки, дрібні недоліки). Однак ШІ часто робить шкіру схожою на пластикову ляльку - занадто ідеальною!

Волосся - ще одна підказка. Справжнє волосся має окремі пасма, які йдуть у різних напрямках.

Волосся зі штучним інтелектом часто виглядає як суцільний шматок, особливо там, де воно з'єднується з чолом.

Лінія росту волосся може виглядати намальованою, а не показувати окремі волосинки.

Джерело = Джерело Mikestuzzi

Одяг в ШІ зображення або дуже гладкі, або мають дивні зморшки, які не мають фізичного сенсу.

Подивіться, як складаються тканини - чи згинаються вони, як справжні матеріали?

Часто АІ робить так, що тканина виглядає так, ніби вона розплавилася або заморозилася неможливими способами.

Чому так відбувається? ШІ не розуміє фізики та матеріалів - він просто копіює шаблони, які бачив раніше.

Наприклад,

Він може знати. як виглядає денімале не про те, як поводиться джинсова тканина, коли на неї сідають. Подивіться на ці підказки.

- 3. Розмитий або нерозбірливий текст на зображенні

Текст - найбільша слабкість ШІ.

Коли ви бачите слова або літери на зображенні зі штучним інтелектом, вони часто розмиті, безглузді або просто неправильні.

Зображення згенероване за допомогою ChatGPT

Шукай:

- Слова, які починаються нормально, але перетворюються на абракадабру

- Літери, які змішуються або змінюють форму

- Неможливі комбінації символів

- Текст на вивісках чи футболках, який не має сенсу

Це відбувається тому, що ШІ не розуміє мову так само, як він розуміє зображення. Тексти здаються ще одним візуальним шаблоном.

- 4. Неузгодженість світла і тіней

Зображення, створені штучним інтелектом, не дотримуються і не розуміють законів світла і тіні.

Наприклад, Іноді здається, що в небі кілька сонць.

Або на предметах (шкіра, метал, скло) будуть тіні, які просто не мають сенсу.

ШІ не розуміє фізики світла. Він просто намагається зіставити патерни, які бачив раніше, а не обчислює, як світло відбивається і відбивається.

Джерело = Джерело Creator.nightcafe.club

Ці проблеми зі світлом покращуються, але вони все ще поширені навіть на високоякісних зображеннях зі штучним інтелектом.

- 5. Дивний фон або нереальне сприйняття глибини

Тло на зображеннях зі штучним інтелектом часто містить підказки про те, що щось не так. Шукай:

- Будівлі з неможливою архітектурою (вікна, що не стоять на одній лінії, двері, що ведуть в нікуди)

- Об'єкти, які ніби зливаються один з одним або з фоном

- Речі, які мають бути далеко, але виглядають такими ж за розміром, як і зблизька

Джерело = Джерело Wallpaperaccess.com

Іноді межа, де людина стикається з фоном, виглядає дивно - або занадто різкою, або занадто розмитою. Це відбувається через те, що ШІ робить людину і фон окремо, а потім намагається склеїти їх разом.

- 6. Перевірте метадані та інформацію про джерело

Кожна фотографія, зроблена справжньою камерою, має "Метадані" - інформацію про те, коли і як було зроблено фотографію.

Зображення зі штучним інтелектом не мають метаданих або метаданих, які вказують на те, що вони були зроблені такими програмами, як DALL-E або Midjourney.

Ви можете перевірити метадані за допомогою:

- Клацніть правою кнопкою миші на зображенні та подивіться "Властивості" або "Інформація"

- Використовуючи такі веб-сайти, як metadata2go.com

- На телефоні використовуйте такі програми, як Photo Investigator

Якщо ви не впевнені, спробуйте зворотний пошук зображень.

- Перейдіть до Google Images

- Завантажте зображення, щоб перевірити, чи з'являється воно деінде в Інтернеті або в інших версіях.

Пам'ятайте, якщо хтось стверджує, що зробив фотографію, це ще не означає, що вона правдива.

Хто і навіщо це розмістив? Вони хочуть мене розлютити чи налякати?

Часто це ознаки підроблених зображень.

Найкращий інструмент для виявлення зображень, згенерованих штучним інтелектом

Дивно, але у нас є й інші інструменти, навчені ШІ, які допомагають у виявленні ШІ. В даному випадку це ШІ-детектор зображень.

Давайте подивимося, що робить АІ-детектор хорошим.

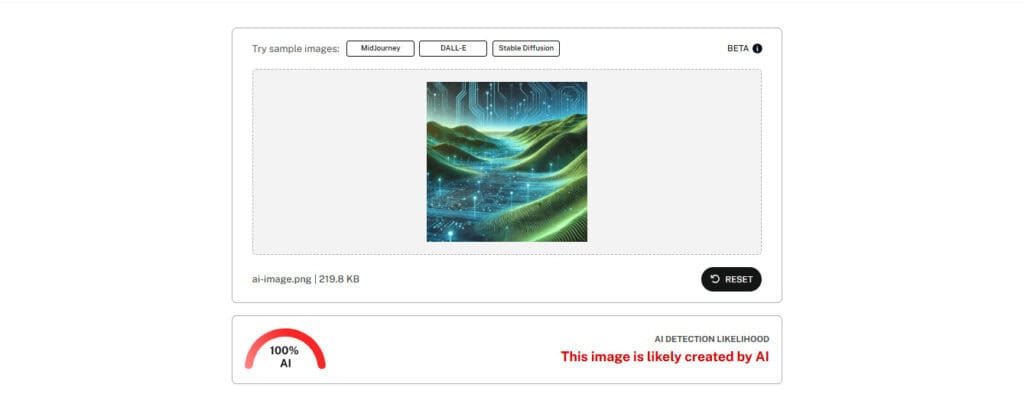

1 - Точність: Деякі інструменти-детектори здебільшого мають рацію, тоді як інші роблять помилки.

Найкращий детектор на сьогодні вгадує приблизно у 80-85% випадків, що не ідеально, але набагато краще, ніж вгадувати.

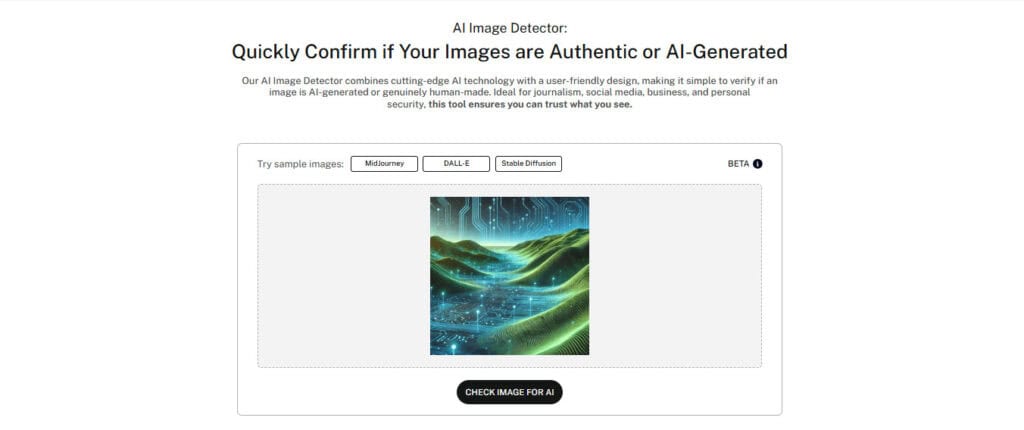

2 - Які АІ-генератори він може розпізнавати: Деякі інструменти чудово виявляють одні джерела (наприклад, зображення DALL-E), але пропускають інші (наприклад, підробки Midjourney).

Цей інструмент навчений усім основним інструментам штучного інтелекту - DALL-E, Midjourney, Stable Diffusion та іншим.

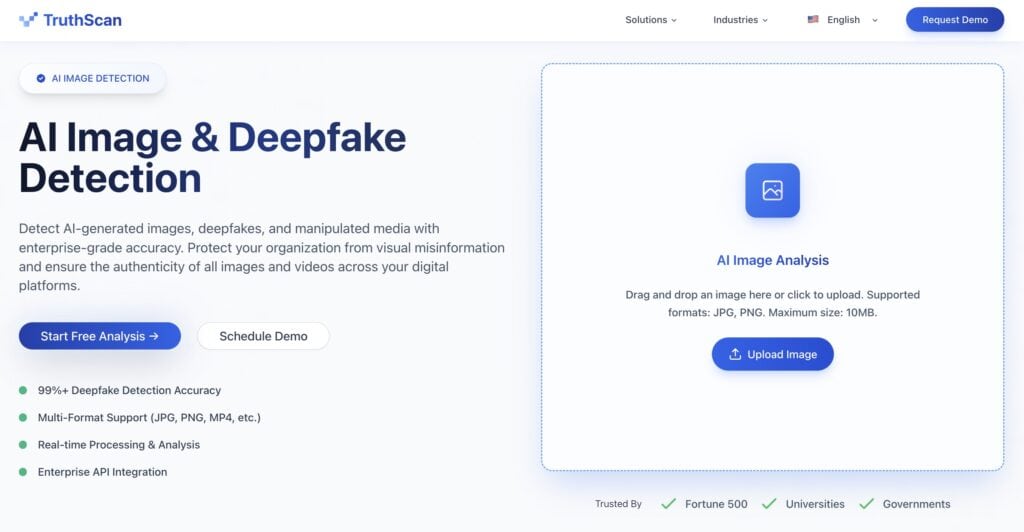

Для більш просунутого та криміналістичного аналізу, Детектор зображень зі штучним інтелектом TruthScan ще один потужний інструмент, який варто додати до вашого набору інструментів для перевірки зображень.

Він виходить за рамки піксельного аналізу шаблонів, щоб виявити ознаки маніпуляцій або контенту, згенерованого штучним інтелектом, включно з глибокими підробками та синтетичними медіа.

Незалежно від того, чи маєте ви справу з потенційною дезінформацією, проблемами безпеки бренду або цифровими доказами, TruthScan допоможе забезпечити автентичність зображень, які ви використовуєте або з якими стикаєтесь, можливість їх відстеження та юридичну безпеку для поширення.

Глибоке виявлення підробок для підтвердження автентичності зображень

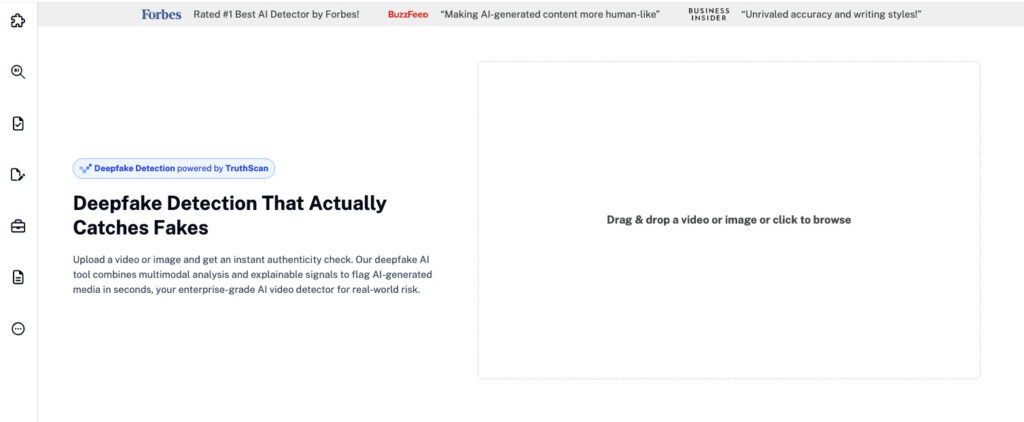

Для ситуацій, коли візуальна точність дійсно має значення, ШІ, що не виявляється Виявлення глибоких підробок надає точний спосіб перевірити, чи не було зображення або відео штучно створено або підроблено.

Він досліджує узгодженість освітлення, піксельні шаблони та вирівнювання обличчя виявляти навіть найтонші ознаки глибокого фейку або синтетичного монтажу.

Завантаживши свій файл, ви отримаєте оцінку автентичності та візуальні індикатори, які вказують на потенційні маніпуляції.

У поєднанні з ШІ-детектором зображень Deepfake Detection гарантує, що кожне зображення, яким ви ділитеся або публікуєте, є перевіреним, автентичним і заслуговує на довіру.

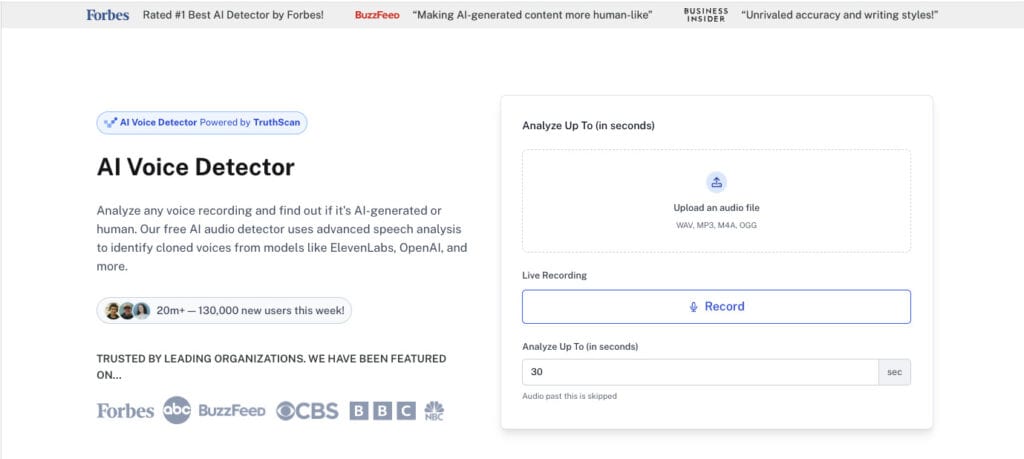

Для команд або установ, які також перевіряють аудіоматеріали, такі як усні особисті заяви або записані відповіді на заявки, це допомагає перевірити, чи голос, який ви чуєте, є справжнім.

Невиявлені ШІ Детектор голосу зі штучним інтелектом може аналізувати завантажене аудіо та перевіряти його на наявність ознак синтезу голосу або клонування.

Це дає вам чіткий сигнал про те, чи була мова вимовлена реальним мовцем, чи згенерована моделлю штучного інтелекту, що додає додатковий рівень довіри та автентичності до будь-якого голосового повідомлення.

3 - Простота використання: Щоб перевірити, чи не підроблене зображення, вам не потрібна вища освіта в галузі комп'ютерних наук.

Ви просто завантажуєте фотографію і отримуєте результат за кілька секунд.

4 - Конфіденційність: Деякі детектори зберігають усі завантажені зображення, що може бути проблемою, якщо ви перевіряєте чутливі фотографії. Цей інструмент видаляє зображення після перевірки.

Ось як користуватися нашим ШІ-детектор зображень:

- Перейдіть за цим посиланням, щоб відвідати веб-сайт.

- Виберіть потрібне зображення з комп'ютера або телефону. Інструмент підтримує формати JPEG і PNG розміром до 4,5 МБ.

- Натисніть кнопку і зачекайте кілька секунд.

- Загальна оцінка від 1 до 100 показує, наскільки ймовірно, що зображення згенероване штучним інтелектом

Для досягнення найкращих результатів використовуйте зображення, які не були сильно стиснуті або змінені.

Скріншоти та зображення з соціальних мереж часто стискаються, що може ускладнити їх виявлення.

Іноді датчики помиляються двома основними способами:

- Хибні спрацьовування трапляються, коли детектор каже, що зображення згенероване штучним інтелектом, але воно справжнє. Це може статися з сильно відредагованими фотографіями, ілюстраціями або зображеннями з незвичним освітленням.

Хибнонегативні результати трапляються, коли детектор каже, що зображення реальне, але насправді воно згенероване штучним інтелектом.

Найчастіше це трапляється з сильно відредагованими АІ-зображеннями або зображеннями, зробленими новими моделями АІ, про які детектор ще не знає.

Якщо ви шукаєте простий спосіб аналізу контенту, створеного штучним інтелектом, скористайтеся нашими AI Detector і Humanizer у віджеті нижче!

Поширені запитання про виявлення зображень, згенерованих штучним інтелектом

Як визначити, що зображення або відео створені штучним інтелектом?

Зображення, створені штучним інтелектом, часто мають проблеми з текстом, симетричними об'єктами та відтворенням послідовного фону.

У відео люди можуть рухатися неприродно, їхні голоси можуть не збігатися з губами, або частини відео можуть мерехтіти від кадру до кадру.

Чи є водяні знаки на зображеннях, згенерованих штучним інтелектом?

Так, деякі інструменти ШІ, такі як Midjourney і DALL-E від OpenAI, приховують секретні водяні знаки на своїх зображеннях.

Чи можуть зображення, створені штучним інтелектом, бути повністю невидимими?

Станом на 2025 рік відповідь - ні. Просунуті моделі ШІ створюють дуже переконливі зображення, але технічні артефакти все ще залишаються на тому ж рівні.

Наразі технологія може видалити близько 85% речей, які можна помітити, але вона ще не може зробити щось повністю невидимим.

Чому деякі зображення ШІ виглядають гіперреалістично?

Новітні моделі штучного інтелекту роблять суперреалістичні знімки, використовуючи розумні технології.

Вони були навчені на мільярдах високоякісних зображень і продовжують вдосконалюватися за допомогою спеціальних оновлень.

Ці моделі особливо добре передають стилі фотографій, реалістичне освітлення та деталізовані текстури.

Який найкращий ШІ-детектор для зображень?

У "The ШІ-детектор зображень від Undetectable AI виявляє зображення, згенеровані ШІ, з точністю до 85%.

Він використовує розумний багатокроковий процес для перевірки найдрібніших деталей на зображеннях.

Він шукає закономірності в пікселях, приховані дані та дрібні помилки, які інші інструменти можуть не помітити.

Останні думки: Як розпізнати зображення, створені штучним інтелектом

На цьому ми завершуємо, і перед тим, як закінчити цей блог, я хочу поставити вам запитання.

Чому наш мозок так легко обманюють зображення зі штучним інтелектом?

Відповідь криється в людській психології.

Наш мозок слідує за "Ефект переваги зображення".

Згідно з цим, картинки закарбовуються в нашій пам'яті краще, ніж слова.

Коли щось виглядає реальним і відповідає тому, у що ми вже віримо, ми не ставимо це під сумнів. Крім того, ми часто надто зайняті, щоб перевірити, чи справжня картина, чи підроблена.

У цьому випадку ви можете шукати підказки, про які ми говорили вище. Дивні руки, дивний текст і ідеальна шкіра можуть допомогти вам виявити підробки ШІ.

Найважливіше пам'ятати, що очі можна обдурити. Те, що картинка виглядає реальною, не означає, що вона такою є.

Коли ви бачите щось дивовижне або шокуюче в Інтернеті, поміркуйте над цим, перш ніж ділитися або виносити будь-яке судження.

Оскільки штучний інтелект стає все більш досконалим з кожним днем, нам усім потрібно навчитися краще його розпізнавати. Наступного разу, коли ви побачите дивовижну картинку, чи станете ви супер-детективом і шукатимете підказки?