Er AI-indholdsdetektering altid præcis? Hvordan fungerer det helt præcist? Det er spørgsmål, som alle fra studerende til virksomhedsejere bør have svar på i 2026.

De seneste fremskridt inden for kunstig intelligens har ført til skabelsen af utroligt realistisk AI-genereret indhold, der udvisker grænsen mellem maskine og menneske.

Det har åbnet nye muligheder i forskellige brancher, men det er også en stor udfordring at skelne mellem menneskeskabt og AI-genereret indhold.

Som et brancheførende produkt har Undetectable AI bevist, at maskinskrevet tekst faktisk kan være næsten umulig at skelne fra menneskelig prosa.

I denne guide vil vi undersøge identifikationsprocessen, udforske teknikkerne, detektorværktøjerne og fremtiden for indholdsautenticitet.

Lad os dykke ned i det.

Det vigtigste at tage med

- AI-detektion er probabilistisk snarere end definitiv, hvilket betyder, at værktøjer beregner sandsynligheden for en maskins oprindelse baseret på matematiske mønstre.

- Nøjagtighed er stadig en væsentlig hindring for branchen, fordi falske positiver ofte udpeger personer, der ikke har engelsk som modersmål, eller meget formelle menneskelige skribenter.

- Hybridstrategier er de mest effektive til at identificere syntetisk tekst, idet de kombinerer automatiseret software med menneskeligt redaktionelt tilsyn og faktatjek.

- Våbenkapløbet mellem AI og detektion er konstant, da generative modeller udvikler sig til at efterligne menneskelige “ufuldkommenheder” mere effektivt hver dag.

- Gennemsigtighed bliver mere værdifuld end kontrol, da mange organisationer nu fokuserer på indholdets kvalitet og anvendelighed snarere end dets tekniske oprindelse.

Hvad er AI-indholdsregistrering, og hvorfor er det vigtigt?

AI-indholdsregistrering er processen med at bruge specialiseret software til at analysere tekst og afgøre, om den er produceret af en stor sprogmodel (LLM) som ChatGPT eller Claude.

Det er vigtigt, fordi det berører kernen i digital tillid.

Inden for uddannelse hjælper det med at opretholde akademisk integritet; inden for journalistik sikrer det, at rapportering er baseret på menneskelig observation; og inden for søgemaskineoptimering hjælper det platforme med at identificere spam med lav indsats, der kan skabe rod på nettet.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

Når vi bevæger os længere ind i 2026, er evnen til at identificere syntetisk indhold blevet et spørgsmål om sikkerhed.

Fra deepfake-artikler til automatiserede misinformationskampagner: At kende kilden til information er afgørende for et velfungerende samfund.

Registreringsværktøjer fungerer som en første forsvarslinje og hjælper brugerne med at kontrollere, at den “stemme”, de lytter til, er understøttet af menneskelig erfaring og ansvarlighed.

Sådan fungerer AI-værktøjer til indholdsregistrering faktisk

For at forstå, hvordan en detektor markerer en sætning, må man indse, at disse værktøjer ikke “læser” efter mening, som en person gør. I stedet udfører de en dyb statistisk analyse af tekstens struktur.

Mønstergenkendelse og forudsigelighed

AI-modeller er designet til at forudsige det mest sandsynlige næste ord i en sekvens. Dette fører til en høj grad af matematisk “glathed” i teksten.

Detektorer ser efter denne mangel på friktion; hvis hvert ord er det mest statistisk sandsynlige valg, identificerer værktøjet det som et maskingenereret mønster.

Forvirring og ustabilitet forklaret enkelt

Perplexitet måler, hvor “overraskende” teksten er for en model. Menneskelig skrivning er ofte meget forvirrende, fordi vi træffer uventede ordvalg.

Burstiness henviser til variationen i sætningslængde og -struktur. Mennesker skriver i ryk - en lang, blomstrende sætning efterfulgt af en kort, slagkraftig sætning. AI har en tendens til at være meget ensartet og skabe en flad, rytmisk “brummen”, som detektorer hurtigt identificerer.

Signaler til sprogmodellering

Detektorer bruger ofte en “spejlvendt” version af den AI, de forsøger at fange.

Ved at køre en passage gennem en detektionsmodel kan softwaren se, om teksten passer perfekt til sandsynlighedskortene for en generator. Hvis teksten følger den nøjagtige vej, som en maskine ville tage, udløser det en høj detektionsscore.

Maskinlæringsklassifikatorer bag detektion

De fleste moderne værktøjer bruger “klassifikatorer”, der er blevet trænet på millioner af eksempler på både menneske- og AI-tekst. Disse klassifikatorer lærer at spotte de små, usynlige forskelle i, hvordan mennesker og maskiner bruger funktionsord som “den”, “det” eller “er”.”

Med tiden bliver disse modeller meget følsomme over for den syntetiske prosas subtile “stivhed”.

Hvorfor detektionsresultater er sandsynligheder, ikke sikkerhed

Det er vigtigt at forstå, at en AI-detektor ikke giver et “ja” eller “nej”-svar. I stedet giver den en sandsynlighedsscore, som f.eks. “85% er sandsynligvis AI.”

Fordi menneskelig skrivning nogle gange kan være forudsigelig og formel, og AI-skrivning kan justeres til at være kaotisk, kan disse værktøjer kun tilbyde et kvalificeret gæt baseret på aktuelle data.

Almindelige tegn på AI-genereret indhold

Selv om software er nyttigt, kan det menneskelige øje ofte spotte “afslørende” tegn på maskinens oprindelse, hvis du ved, hvad du skal kigge efter.

- Overdrevent poleret, men generisk sprog: AI skriver ofte på en måde, der er grammatisk perfekt, men fuldstændig blottet for personlighed eller unik “smag”.”

- Gentagne sætningsstrukturer: Maskiner starter ofte flere sætninger i træk med det samme ord eller bruger nøjagtig samme længde til hver sætning i et afsnit.

- Mangel på personlig erfaring eller specifikke detaljer: En AI kan beskrive et koncept, men den kan ikke dele en specifik anekdote om en fejl, den har begået, eller en unik sanselig detalje fra en begivenhed i det virkelige liv.

- Forudsigeligt afsnitsflow: AI-genereret indhold følger normalt et meget strengt “Introduktion, punkt A, punkt B, punkt C, konklusion”-format uden den organiske vandring i den menneskelige tanke.

- Vage overgange og sikre konklusioner: Se efter sætninger som “Afslutningsvis”, “Det er vigtigt at bemærke” eller “Desuden”, der bruges på en mekanisk måde, som ikke tilføjer reel værdi til fortællingen.

De mest populære AI-værktøjer til indholdsregistrering i dag

Flere værktøjer har vist sig at være førende på området, og de tilbyder hver især forskellige styrker til forskellige typer brugere.

Uopdagelig AI

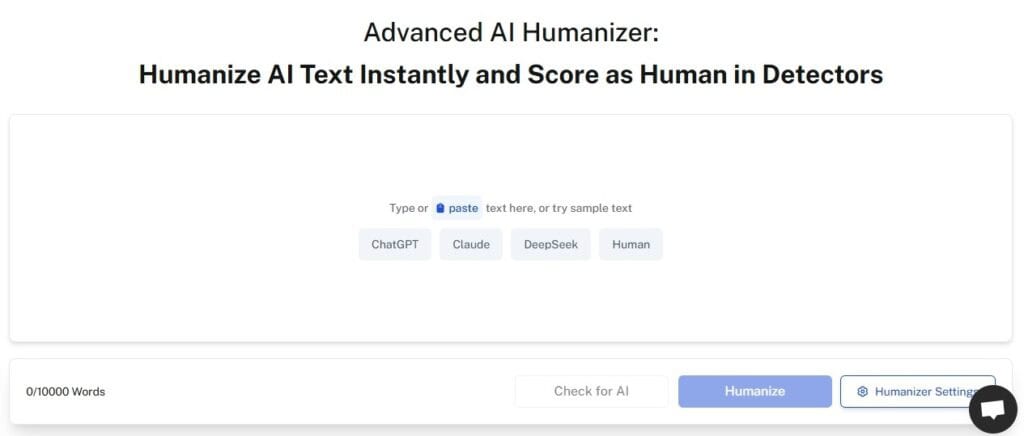

Uopdagelig AI er unik, fordi den tilbyder en tilgang med flere modeller. I stedet for at stole på en enkelt algoritme kombinerer den gratis detektor logikken fra over syv forskellige detektionsmodeller i en enkelt grænseflade.

Det giver brugerne et mere “bredt” overblik over, hvordan deres tekst kan blive opfattet af forskellige systemer på nettet.

Turnitin AI-opdagelse

Drejitin er den dominerende kraft i den akademiske verden. Værktøjet er specielt indstillet til at finde AI i studerendes essays og forskningsartikler.

Det bruges i vid udstrækning af universiteter verden over, selvom det er blevet kritiseret for lejlighedsvis at markere originalt menneskeligt arbejde som maskingenereret.

GPTZero

GPTZero blev oprindeligt skabt som et specialeprojekt på Princeton og var et af de første værktøjer, der blev populære. Den er kendt for sine scores “Perplexity” og “Burstiness”, som hjælper brugerne med at se de nøjagtige matematiske årsager til, at et stykke tekst føles “robotagtigt”.”

Copyleaks

Copyleaks er foretrukket af virksomheder på grund af sin høje nøjagtighed og sin evne til at opdage “parafraseret” plagiat. Det er især effektivt til at identificere, når nogen har taget AI-tekst og lavet mindre manuelle ændringer for at forsøge at skjule den.

Originalitet.ai

Dette værktøj markedsføres primært til webudgivere og SEO-professionelle. Det er designet til at være meget følsomt og markerer ofte selv små mængder AI-assistance. Det er en favorit for dem, der har brug for at sikre, at det indhold, de køber fra freelancere, er 100% menneskeforfattet.

Nøjagtighedsproblemet: Kan man stole på AI-indholdsdetektering?

Det mest kontroversielle aspekt af branchen er spørgsmålet om pålidelighed. Selv om detektionsværktøjerne bliver bedre og bedre, er de langt fra perfekte, og deres fejl kan få konsekvenser i den virkelige verden.

Falske positiver på menneskelig skrift

En “falsk positiv” opstår, når et værktøj fejlagtigt identificerer menneskelig skrift som AI. Det sker ofte med meget strukturerede tekster, såsom juridiske dokumenter, videnskabelige rapporter eller endda Bibelen. Det har ført til mange tilfælde, hvor studerende uretmæssigt er blevet beskyldt for at snyde.

Falske negativer på AI-indhold

En “falsk negativ” sker, når AI-genereret tekst går for at være menneskelig.

Med værktøjer som Undetectable AI's AI Humanizer, er det nu muligt at omskrive maskintekst, så den efterligner kompleksiteten og tilfældigheden i menneskelig prosa, hvilket effektivt omgår næsten alle nuværende detektorer.

Fordomme mod forfattere, der ikke har engelsk som modersmål

Forskning har vist, at AI-detektorer er mere tilbøjelige til at markere tekster skrevet af personer, der ikke har engelsk som modersmål.

Fordi disse skribenter ofte bruger et mere formelt og mindre varieret ordforråd, afspejler deres arbejde naturligvis de statistiske mønstre, som detektorerne leder efter, hvilket fører til uretfærdige fordomme i akademiske og professionelle sammenhænge.

Hvem bruger AI-indholdsdetektering (og hvorfor)?

Anvendelsen af disse værktøjer er udbredt, men motiverne varierer afhængigt af branchen.

| Brugergruppe | Primært mål | Hvorfor resultaterne ofte varierer |

| Uddannelsesinstitutioner | Forhindre akademisk uærlighed og snyd. | Akademisk skrivning er naturligt formel, hvilket forvirrer mange grundlæggende detektorer. |

| Teams til indholdsmarkedsføring | Sørg for, at indholdet er “nyttigt” og ranker godt i søgninger. | Forskellige værktøjer prioriterer forskellige SEO-signaler og søgeordstætheder. |

| Udgivere og medier | Bevar brandets autoritet og menneskelige stemme. | Journalistik bruger ofte korte, slagkraftige sætninger, der kan se ud som “low burstiness” for AI. |

| Rekrutterere | Filtrer masseproducerede, AI-skrevne følgebreve fra. | Professionelle CV'er bruger standardiserede skabeloner, som maskiner efterligner perfekt. |

Hvordan usynlig AI hjælper med at forbedre menneskelignende skrivning

Mens afsløring er den ene side af mønten, er den anden “menneskeliggørelse”. Undetectable AI leverer en række værktøjer, der hjælper forfattere med at bruge AI på en ansvarlig måde og samtidig sikre, at deres endelige output føles autentisk.

Reduktion af forudsigelige AI-mønstre

Softwaren analyserer dit udkast og identificerer de “maskinlignende” sekvenser, der normalt ville udløse et flag. Derefter omorganiserer og omformulerer den disse afsnit på en intelligent måde for at skabe et mere naturligt flow.

Forbedring af naturligt flow og stemme

Ved at bruge AI Humanizer, kan forfattere tilføre den “sprælskhed” og sproglige variation, som maskiner normalt mangler. Det resulterer i en tekst, der ikke bare er “umulig at opdage”, men som virkelig er mere engagerende for den menneskelige læser.

Finpudsning af tone og sætningsvariation

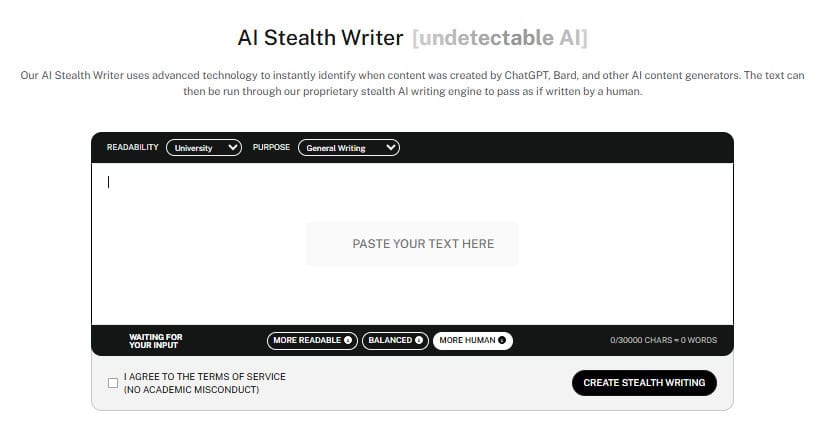

Vores AI Stealth Writer giver brugerne mulighed for at vælge mellem forskellige “menneskelige” niveauer, fra gymnasieniveau til universitet eller professionel.

Det sikrer, at tonen forbliver i overensstemmelse med målgruppen, og forhindrer det “tonale piskesmæld”, der opstår, når rå AI forsøger at lyde for smart.

Støtte til ansvarlig brug af AI

Målet er ikke at bedrage, men at forbedre. Ved at give en AI-indholdsdetektor Sammen med humaniseringsværktøjer opfordrer Undetectable AI forfattere til at tjekke deres arbejde, angive deres kilder og sikre, at deres endelige indsendelse er en sand afspejling af deres egne ideer og redigering.

Fremtiden for AI-indholdsdetektering

Når vi ser frem mod 2027 og derefter, vil kampen mellem generation og detektion fortsætte med at omforme, hvordan vi interagerer med information online.

- Det igangværende våbenkapløb mellem AI og detektion: Hver gang en detektor bliver smartere, bliver generatorerne bedre til at efterligne menneskelig “støj”. Denne cyklus vil sandsynligvis fortsætte, indtil vi når et punkt med “perfekt paritet”.”

- Smartere detektionsalgoritmer: Fremtidige værktøjer vil sandsynligvis se på “metadata” og “fingeraftryksteknikker”, såsom skjulte vandmærker, der er indlejret af de virksomheder, der skaber AI-modellerne.

- Skiftet mod gennemsigtighed i stedet for politiarbejde: Mange eksperter mener, at vi i sidste ende vil Hold op med at forsøge at “fange” AI og i stedet fokusere på verificerbare “human-in-the-loop”-arbejdsgange.

- Hvorfor skrivefærdigheder stadig betyder noget: Selv i en verden fuld af kunstig intelligens er evnen til at redigere, faktatjekke og give et unikt menneskeligt perspektiv stadig den mest værdifulde færdighed, en forfatter kan besidde.

Prøv vores AI Detector og Humanizer i widgetten nedenfor!

Ofte stillede spørgsmål

Er AI-indholdsregistrering altid præcis?

Nej, det er sandsynlighedsbaseret. Falske positiver er almindeligt forekommende, især med formelle tekster eller tekster, der ikke er skrevet på modersmål. Du bør altid bruge detektionsresultater som udgangspunkt for en undersøgelse snarere end en endelig dom.

Kan Google straffe mig for AI-genereret indhold?

Ifølge Google Search Central, Google fokuserer på indholdets kvalitet og anvendelighed. Hvis dit AI-indhold ikke er nyttigt eller udelukkende er skabt for at manipulere placeringer, vil det blive straffet, uanset om det er skrevet af en maskine.

Hvordan gør jeg mit AI-indhold usynligt?

Den mest effektive måde er at bruge et humaniseringsværktøj som Undetectable AI, der omstrukturerer teksten, så den matcher menneskelige sprogmønstre. De bedste resultater kommer dog altid ved at tilføje dine egne personlige historier og unikke indsigter manuelt.

Fanger Turnitin alt AI-indhold?

Turnitin er meget avanceret, men kan stadig omgås ved hjælp af sofistikeret omskrivning og menneskeliggørelse. Det bruges bedst af lærere til at lede efter generelle mønstre af inkonsekvens i en elevs arbejde over tid.

Konklusion

I takt med at kunstig intelligens bliver en fast bestanddel af vores kreative og professionelle liv, er det vigtigt at forstå detektion af ai-indhold for at bevare integritet og tillid.

Selv om detektionsværktøjer giver et værdifuldt indblik i en teksts matematiske oprindelse, er de ikke ufejlbarlige dommere.

De mest succesfulde skabere i 2026 er dem, der bruger disse værktøjer ansvarligt og kombinerer AI's effektivitet med den uerstattelige varme og nuance i en menneskelig stemme.

Ved at holde dig informeret og bruge en flerstrenget tilgang til verifikation kan du navigere trygt på det moderne web.

Autenticitet er den mest værdifulde valuta i automatiseringens tidsalder. Sørg for, at din stemme bliver hørt, ikke kun dine beskeder.

Er du klar til at sikre, at det, du skriver, både er af høj kvalitet og autentisk dig? Gå på opdagelse Uopdagelig AI for at menneskeliggøre dine udkast og bevare din professionelle kant.