Så du den virale Billede af paven i en stilfuld hvid pufferjakke tilbage i 2023?

Millioner af mennesker delte det, nyhedssider rapporterede om det, og alle talte om, hvor stilfuld paven så ud.

Der var bare ét problem - det skete aldrig. Billedet var fuldstændig skabt af kunstig intelligens.

Eller du husker måske det chokerende billede af en eksplosion i Pentagon der kortvarigt rystede aktiemarkedet. Falsk!

Hvad med billederne af Trump bliver tacklet og arresteret? Igen var de også fuldstændig opfundet af AI.

Falske AI-billeder har forårsaget reel skade.

Folk har tabt penge på at investere på baggrund af falske nyhedsbilleder.

Både berømtheder og almindelige mennesker har fået deres ansigter sat på andre kroppe i pinlige eller upassende situationer.

Man har set politikere sige og gøre ting, som de i virkeligheden aldrig har gjort.

Når vi ikke kan stole på vores egne øjne, har vi brug for nye måder at finde ud af, hvad der er ægte, og hvad der ikke er.

I denne blog vil jeg vise dig, hvordan AI- og DeepFake-teknologien har udviklet sig gennem årene, hvor vigtigt det er at identificere AI vs. rigtige billeder, hvordan man kan se, om et billede er AI-genereret, og hvilket værktøj der er bedst til at opdage AI-genererede billeder.

Hvordan AI-kunst og deepfake-teknologi har udviklet sig

Lad os tale om AI Først...

For ikke så længe siden lignede AI-genererede billeder en dårlig drøm - slørede ansigter, ekstra fingre og en hel masse underligt. Men i dag er AI-kunst chokerende realistisk.

Det hele startede omkring 2014 med GAN'er (Generative Adversarial Networks), hvor to AI-modeller - den ene skabte forfalskninger, den anden opdagede dem - blev ved med at forbedre hinanden.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

De første GAN-billeder var ret dårlige - slørede ansigter med mærkelige øjne og manglende ører.

I 2020 blev tingene meget bedre med "Diffusionsmodeller."

De starter med et rodet billede fuld af prikker og rydder langsomt op, indtil det ser rigtigt ud.

Det var et stort spring fremad. Pludselig kunne AI lave meget klarere og mere realistiske billeder.

Deepfake-teknologi fungerer på samme, men vanskeligere måde.

Det indebærer brug af både AI- og Deepfake-teknologi.

AI lærer, hvordan en persons ansigt ser ud fra mange vinkler og udtryk ved at studere masser af videoer og billeder af dem.

Så kan den sætte den persons ansigt på en anden persons krop i en anden video.

Computeren lærer at matche lyset, hudtonen og selv små udtryk, så det ser ægte ud.

Tidlige deepfakes fra 2017 så åbenlyse og fejlbehæftede ud. Nutidens deepfakes kan være næsten perfekte.

Se videoerne nedenfor for at se sammenligningen:

Deepfake i 2017 Falsk Obama-video

Deepfake i 2023 - Emma Watson i "Get Out (2017)"

I 2022 skabte folk omkring 6 millioner billeder ved hjælp af AI. I begyndelsen af 2023 var det steget til over 20 millioner billeder hver dag.

I dag findes der milliarder af AI-skabte billeder på nettet, og de fleste af os ser dem dagligt uden at vide det.

Risici ved AI-genererede billeder i misinformation

Falske nyheder spredes 6 gange hurtigere end sande nyheder på de sociale medier.

Skaden er som regel sket, når nogen påpeger, at et billede er falsk.

De risici, der er forbundet med falske billeder, er:

1) Manipulation - Falske billeder skaber falske fortællinger om andre, herunder valg, ledere og verdensbegivenheder. For eksempel, AI-genererede billeder afbildede fejlagtigt anholdelsen af USA's præsident Donald Trump.

2) Ærekrænkelse - Falske billeder kan ødelægge omdømmet. For eksempel, I januar 2024 cirkulerede AI-genererede billeder af Taylor Swift på nettet, som gav et falsk billede af hende.

3) Social uro - Et enkelt falsk billede kan skabe forargelse, optøjer eller endda vold. For eksempel, I maj 2023 cirkulerede et AI-genereret billede, der viste en eksplosion i nærheden af Pentagon, på de sociale medier.

4) Bedrageri. Svindlere bruger deepfake-billeder til at narre folk til at sende penge. For eksempel; Michael Hewson (finansanalytiker) blev udgivet for at promovere falske investeringsordninger.

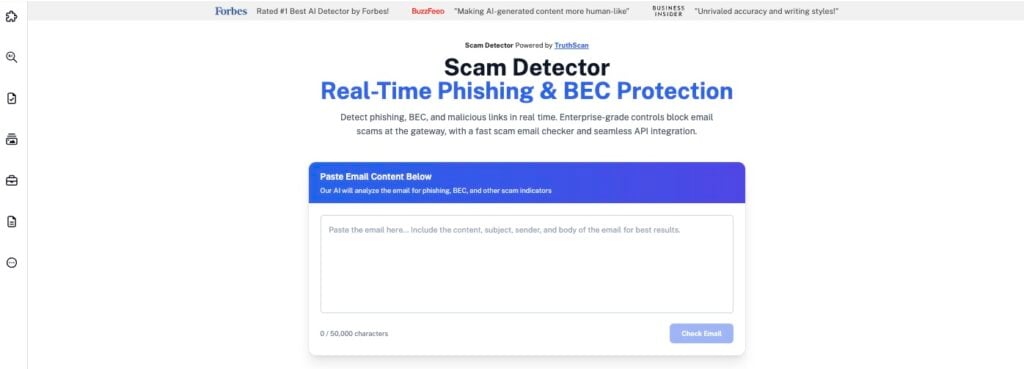

Fordi disse svindelnumre ofte starter med et “verificeret” billede af en berømthed, er almindelig forsigtighed ikke nok. Kør det medfølgende link eller den medfølgende besked gennem vores Undetectable AI's Svindeldetektor.

Det giver et vigtigt lag af sikkerhed ved at markere falske domæner og højrisiko “bliv hurtig rig”-sprog, der ofte følger med AI-genererede deepfakes af finansanalytikere eller offentlige personer.

Der er et andet problem, der sker nu, kaldet "Løgnerens udbytte."

Efterhånden som AI-forfalskninger bliver almindelige, afviser folk, der er fanget i rigtige skandaler, simpelthen beviserne som "deepfake" - selv når det er ægte. Politikere er allerede begyndt at bruge denne taktik.

Vigtigheden af at identificere AI vs. ægte billeder

Behovet for at forstå det ægte vs. det falske billede er større end nogensinde af et par grunde:

1 - Erosion af offentlighedens tillid

Vores samfund kører på tillid. Vores hjerne accepterer, hvad den ser i nyhederne, i retten eller fra vores ledere.

Men nu, hvor AI laver så overbevisende falske billeder, er den tillid ved at bryde sammen.

Hvis vi alle fortsætter med at være så mistænksomme, vil det fuldstændig ændre den måde, vi forbinder os med verden på.

2 - Juridiske konsekvenser og nye regler

Regeringer forsøger at finde ud af, hvad de skal gøre ved falske AI-billeder.

For eksempel,

- Californien har lige vedtaget en lov der gør det ulovligt at lave falske politiske annoncer ved hjælp af AI i valgperioden.

- Den EU's efterretningslov pålægger forpligtelser om mærkning af kravene til AI- og deepfake-materialer.

3 - Indvirkning på digitale færdigheder

I takt med at AI bliver bedre til at lave falske billeder, skal vi alle blive bedre til at spotte dem.

Skolerne skal lære eleverne om AI og Deepfakes teknologi, der hele tiden udvikler sig.

Vi er nødt til at udvikle en fuld forståelse, så vi ikke bare tror på det, vi ser på nettet.

4 - Opretholdelse af autenticitetskæder

En løsning kan være "Autenticitetskæder."

Det betyder, at man skal spore, hvor et billede kommer fra - fra det øjeblik, det bliver skabt, til vi ser det.

En særlig teknologi kan tilføje usynlige mærker til rigtige fotos, som viser, hvem der har taget dem og hvornår.

Hvis vi bruger det, kan vi verificere et billedes historie og dets ægthed.

Sådan ved du, om et billede er AI-genereret (vigtige tegn)

De billeder, der genereres af AI, ser så ægte ud, at en nybegynder vil have svært ved at se forskel.

Hvis du prøver at lære, hvordan du identificerer, om et billede er AI-genereret, skal du kigge efter disse vigtige detaljer:

- 1. Unaturlige eller surrealistiske detaljer

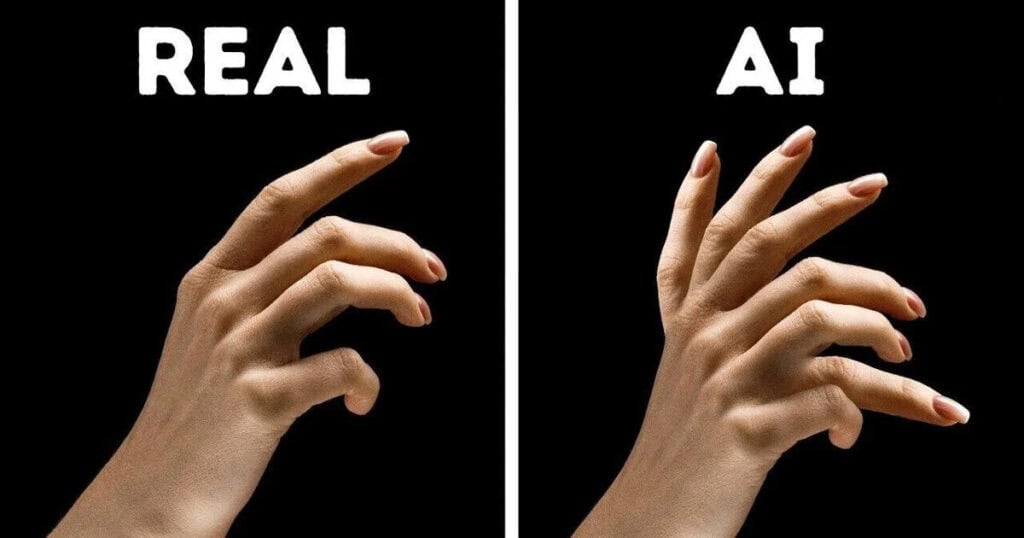

AI kan ikke finde ud af visse kropsdele, især ikke hænder.

Vi har 5 fingre på hver hånd, men AI giver ofte folk 6-8 fingre, sammenvoksede fingre eller tommelfingre, der ser mærkelige ud. Se på hænderne.

Kilde = Fltimes

AI kvajer sig også tænder meget.

Se efter tænder, der virker for perfekte, for mange tænder i munden eller tænder, der ikke står rigtigt.

Nogle gange smelter alle tænderne sammen til en hvid klat.

Billede genereret af ChatGPT

Andre kropsfejl omfatter:

- Øjne, der ikke passer sammen eller kigger i lidt forskellige retninger

- Ører, der ikke passer sammen eller er i forskellige højder

- Briller, der krummer mærkeligt eller flyder ud af ansigtet

- Smykker, der smelter ind i huden eller ikke følger kroppens bevægelser.

- 2. Alt for glatte eller plastikagtige teksturer

Ægte hud har tekstur (porer, linjer, små ufuldkommenheder). Men AI får ofte huden til at ligne en plastikdukke - for perfekt!

Håret er en anden ledetråd. Ægte hår har individuelle tråde, der går i forskellige retninger.

AI-hår ser ofte ud som et fast stykke, især hvor det møder panden.

Hårgrænsen kan se påmalet ud i stedet for at vise individuelle hår.

Kilde = Mikestuzzi

Tøj i AI-billeder er enten meget glatte eller har underlige rynker, der ikke giver fysisk mening.

Se på, hvordan tekstiler foldes - bøjer de, som rigtige materialer ville gøre?

Ofte får AI stof til at se ud, som om det er smeltet eller frosset på umulige måder.

Hvorfor sker dette? AI forstår ikke fysik og materialer - den kopierer bare mønstre, den har set før.

For eksempel,

Det ved måske hvordan denim ser udmen ikke hvordan denim opfører sig, når nogen sætter sig på det. Kig efter disse spor.

- 3. Sløret eller kaudervælskende tekst i billedet

Tekst er AI's største svaghed.

Når du ser ord eller bogstaver i et AI-billede, er de ofte slørede, nonsens eller bare helt forkerte.

Billede genereret af ChatGPT

Kig efter:

- Ord, der begynder normalt, men bliver til volapyk

- Bogstaver, der blandes eller ændrer form

- Umulige kombinationer af symboler

- Tekst på skilte eller t-shirts, der ikke giver mening

Det sker, fordi AI ikke forstår sprog på samme måde, som den forstår billeder. Teksterne ser ud til at være et andet visuelt mønster.

- 4. Inkonsekvent belysning og skygger

AI-genererede billeder følger eller forstår ikke reglerne for lys og skygge.

For eksempel, Nogle gange ser det ud, som om der er flere sole på himlen.

Eller der ville være skygger på objekter (hud, metal, glas), som bare ikke giver mening.

AI forstår ikke lysets fysik. Den prøver bare at matche mønstre, den har set før, ikke at beregne, hvordan lyset reflekteres.

Kilde = Skaber.natcafe.klub

Disse lysproblemer er blevet bedre, men de er stadig almindelige, selv i AI-billeder af høj kvalitet.

- 5. Mærkelige baggrunde eller urealistisk dybdeopfattelse

Baggrunden i AI-billeder er ofte tegn på, at der er noget galt. Kig efter:

- Bygninger med umulig arkitektur (vinduer, der ikke står på linje, døre, der ikke fører nogen steder hen)

- Objekter, der ser ud til at smelte sammen med hinanden eller baggrunden

- Ting, der burde være langt væk, men som ser ud til at have samme størrelse som ting tæt på

Kilde = Wallpaperaccess.com

Nogle gange ser kanten, hvor en person møder baggrunden, underlig ud - enten for skarp eller for sløret. Det sker, fordi AI laver personen og baggrunden hver for sig og derefter forsøger at sætte dem sammen.

- 6. Tjek metadata og kildeinformation

Alle billeder taget med et rigtigt kamera har "Metadata" - oplysninger om, hvornår og hvordan billedet blev taget.

AI-billeder har ingen metadata eller metadata, der viser, at de er lavet af programmer som DALL-E eller Midjourney.

Du kan tjekke metadata ved hjælp af:

- Højreklik på et billede og se på "Egenskaber" eller "Info"

- Brug af hjemmesider som metadata2go.com

- På telefonen kan du bruge apps som Photo Investigator

Hvis du ikke er sikker, så prøv en Omvendt billedsøgning.

- Gå til Google Billeder

- Upload billedet for at se, om det vises andre steder på nettet eller i forskellige versioner.

Husk, at bare fordi nogen påstår, at de har taget et billede, er det ikke sandt.

Hvem har skrevet det, og hvorfor? Vil de gøre mig vred eller bange?

Det er ofte tegn på falske billeder.

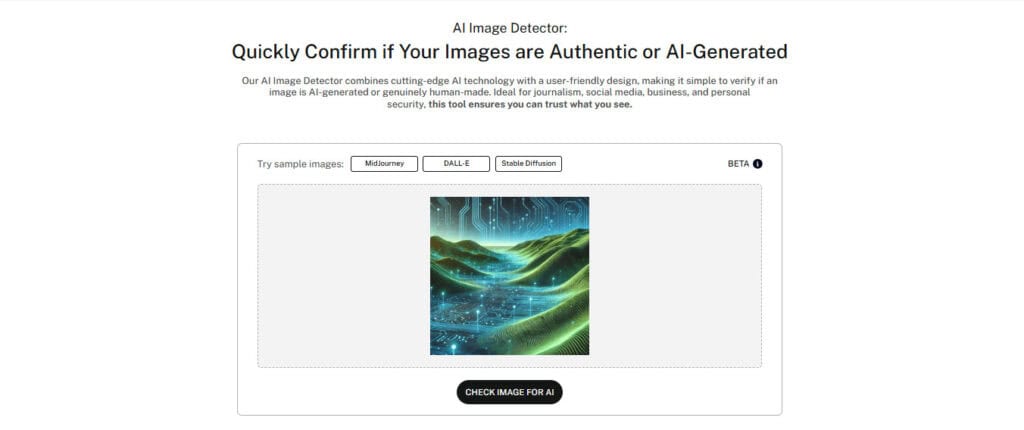

Bedste værktøj til at opdage AI-genererede billeder

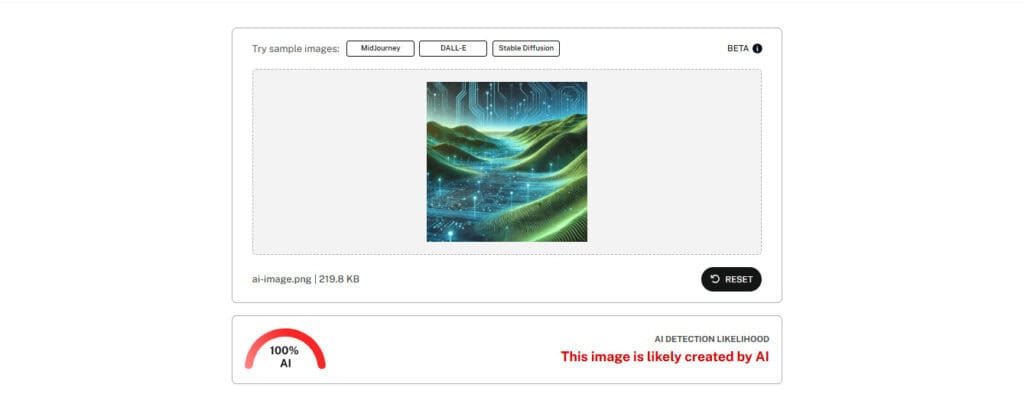

Overraskende nok har vi andre AI-trænede værktøjer, der hjælper med at opdage AI. I dette tilfælde er værktøjet AI-billeddetektor.

Lad os se på, hvad der kendetegner en god AI-detektor.

1 - Nøjagtighed: Nogle detektorværktøjer er for det meste rigtige, mens andre begår fejl.

Den bedste detektor i dag rammer rigtigt i ca. 80-85% af tilfældene, hvilket ikke er perfekt, men meget bedre end at gætte.

2 - Hvilke AI-generatorer den kan registrere: Nogle værktøjer er gode til at spotte én kilde (f.eks. DALL-E-billeder), men overser andre (f.eks. Midjourney-forfalskninger).

Dette værktøj er trænet på alle de store AI-kunstværktøjer - DALL-E, Midjourney, Stable Diffusion og mange flere.

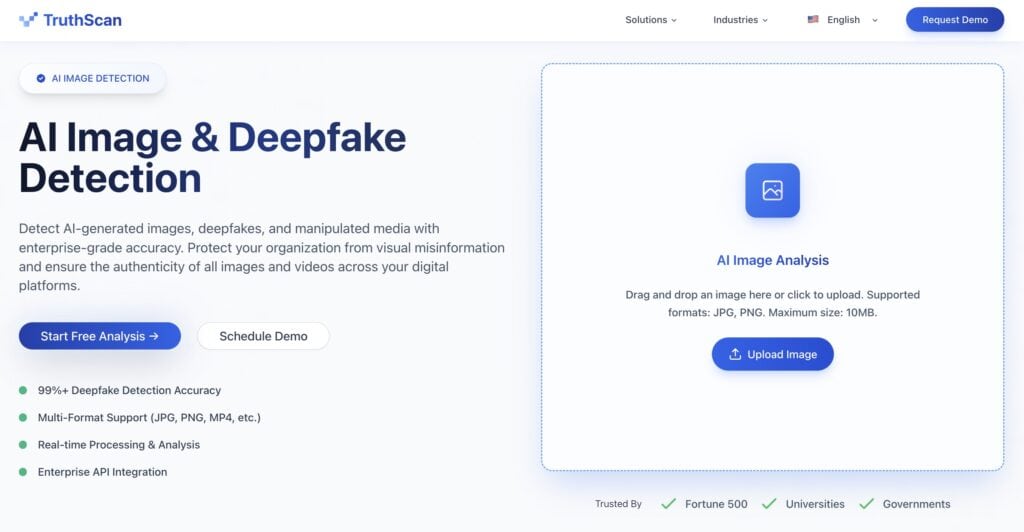

Til mere avancerede og retsmedicinske analyser, TruthScans AI-billeddetektor er et andet stærkt værktøj, der er værd at tilføje til din værktøjskasse til billedverifikation.

Den går ud over mønsteranalyse på pixelniveau for at opdage tegn på manipuleret eller AI-genereret indhold - herunder deepfakes og syntetiske medier.

Uanset om du har at gøre med potentiel misinformation, brandsikkerhedsproblemer eller digitale beviser, hjælper TruthScan med at sikre, at de billeder, du bruger eller støder på, er autentiske, sporbare og juridisk sikre at dele.

Deepfake-detektion til bekræftelse af billedautenticitet

I situationer, hvor visuel nøjagtighed virkelig betyder noget, er Undetectable AI's Detektion af deepfake giver en præcis måde at kontrollere, om et billede eller en video er blevet kunstigt genereret eller manipuleret.

Den undersøger Belysningskonsistens, pixelmønstre og ansigtstilpasning til at opdage selv de mest subtile tegn på deepfake eller syntetisk redigering.

Når du uploader din fil, får du en autenticitetsscore og visuelle indikatorer, der fremhæver potentielle manipulationsområder.

I kombination med AI Image Detector sikrer Deepfake Detection, at hvert eneste billede, du deler eller udgiver, er verificeret, autentisk og troværdigt.

For teams eller institutioner, der også gennemgår lydindlæg, såsom personlige udtalelser eller indspillede ansøgningssvar, er det en hjælp at kunne verificere, at den stemme, man hører, er ægte.

Uopdagede AI'er AI stemme-detektor kan analysere uploadet lyd og kontrollere for tegn på stemmesyntese eller kloning.

Det giver dig et klart signal om, hvorvidt talen er produceret af en rigtig taler eller genereret af en AI-model, hvilket tilføjer et ekstra lag af tillid og autenticitet til enhver stemmebaseret indsendelse.

3 - Brugervenlighed: Man burde ikke have brug for en uddannelse i datalogi for at tjekke, om et billede er falsk.

Du skal blot uploade billedet, og så får du resultatet på få sekunder.

4 - Privatlivets fred: Nogle detektorer beholder alle de billeder, du uploader, hvilket kan være et problem, hvis du tjekker følsomme billeder. Dette værktøj sletter billeder efter at have tjekket dem.

Sådan bruger du vores AI-billeddetektor:

- Klik på dette link for at besøge hjemmesiden.

- Vælg det ønskede billede fra din computer eller telefon. Værktøjet accepterer JPEG- og PNG-formater på op til 4,5 MB.

- Klik på knappen, og vent et par sekunder.

- En samlet score fra 1-100 viser, hvor sandsynligt det er, at billedet er AI-genereret

Du får det bedste resultat, hvis du bruger billeder, der ikke er blevet kraftigt komprimeret eller ændret i størrelse.

Skærmbilleder og billeder fra sociale medier er ofte komprimerede, hvilket kan gøre det sværere at opdage dem.

Nogle gange tager detektorerne fejl på to måder:

- Falske positiver sker, når detektoren siger, at et billede er AI-genereret, men det er ægte. Dette kan ske med stærkt redigerede fotos, illustrationer eller billeder med usædvanlig belysning.

Falske negativer sker, når detektoren siger, at et billede er ægte, men det er faktisk AI-genereret.

Det sker oftest med stærkt redigerede AI-billeder eller dem, der er lavet af nyere AI-modeller, som detektoren endnu ikke har lært at kende.

Hvis du leder efter en nem måde at analysere AI-genereret indhold på, kan du tjekke vores AI Detector og Humanizer i widgetten nedenfor!

Ofte stillede spørgsmål om at opdage AI-genererede billeder

Hvordan ved man, om et billede eller en video er AI-genereret?

AI-genererede billeder kæmper ofte med tekst, symmetriske objekter og gengivelse af ensartede baggrunde.

I videoer kan folk bevæge sig unaturligt, deres stemmer passer måske ikke til deres læber, eller dele af videoen kan flimre fra billede til billede.

Er der vandmærker på AI-genererede billeder?

Ja, nogle AI-værktøjer som Midjourney og OpenAI's DALL-E skjuler hemmelige vandmærker i deres billeder.

Kan AI-genererede billeder være helt umulige at opdage?

Svaret er "nej" fra 2025. Avancerede AI-modeller skaber meget overbevisende billeder, men de tekniske artefakter er stadig på samme niveau.

I øjeblikket kan teknologien fjerne omkring 85% af de ting, der kan ses, men den kan endnu ikke gøre noget helt usynligt.

Hvorfor ser nogle AI-billeder hyperrealistiske ud?

De nyeste AI-modeller laver superrealistiske billeder ved hjælp af smart teknologi.

De er blevet trænet på milliarder af billeder i høj kvalitet og bliver stadig bedre med særlige opgraderinger.

Disse modeller er især gode til at indfange fotografiske stilarter, realistisk belysning og detaljerede teksturer.

Hvad er den bedste AI-detektor til billeder?

Den AI-billeddetektor fra Undetectable AI registrerer AI-genererede billeder med op til 85% nøjagtighed.

Den bruger en smart flertrinsproces til at kontrollere små detaljer i billeder.

Den ser på mønstre i pixels, skjulte data og små fejl, som andre værktøjer måske ikke opdager.

De sidste tanker: Sådan spotter du AI-genererede billeder

Det var alt, og før vi afslutter denne blog, har jeg et spørgsmål til dig.

Hvorfor bliver vores hjerne så let narret af AI-billeder?

Svaret ligger i den menneskelige psykologi.

Vores hjerner følger "Billedoverlegenhedseffekt."

Ifølge dette hænger billeder bedre fast i vores bevidsthed end ord.

Når noget ser ægte ud og passer ind i det, vi allerede tror på, sætter vi ikke spørgsmålstegn ved det. Desuden har vi ofte for travlt til at dobbelttjekke, om et billede er ægte eller falsk.

I dette tilfælde kan du kigge efter de spor, vi har diskuteret ovenfor. Sære hænder, mærkelig tekst og perfekt hud kan hjælpe dig med at spotte AI-fakes.

Det vigtigste at huske er, at dine øjne kan blive narret. Bare fordi et billede ser ægte ud, betyder det ikke, at det er det.

Når du ser noget fantastisk eller chokerende på nettet, så brug et øjeblik på at tænke over det, før du deler eller dømmer det.

AI bliver mere og mere avanceret, og vi skal alle blive bedre til at spotte dem. Næste gang du ser et fantastisk billede, vil du så være en super billeddetektiv og lede efter sporene?