Efterhånden som AI-værktøjer som ChatGPT bliver mere sofistikerede og tilgængelige, er der opstået en presserende bekymring inden for uddannelsessektoren:

Kan gymnasier og universiteter med sikkerhed opdage ChatGPT-genereret indhold?

I denne artikel undersøger vi, hvordan institutioner reagerer på fremkomsten af generativ AI, og hvilke detektionsmetoder der anvendes i 2025.

De udfordringer, de står over for, og hvordan studerende kan bruge AI ansvarligt uden at gå på kompromis med den akademiske integritet.

Det vigtigste at tage med

- Gymnasier kan opdage ChatGPT - men ikke med perfekt nøjagtighed. Værktøjer som Turnitin og Copyleaks bruges ofte, men giver stadig falske positive og negative resultater.

- Menneskelig gennemgang og stilometrisk analyse er nøglen til at vurdere uoverensstemmelser mellem en studerendes tidligere arbejde og nye indsendelser.

- Opdagelse er afhængig af sproglige, statistiske og kontekstuelle mønstre, men avancerede AI-output kan ofte omgå overfladisk analyse.

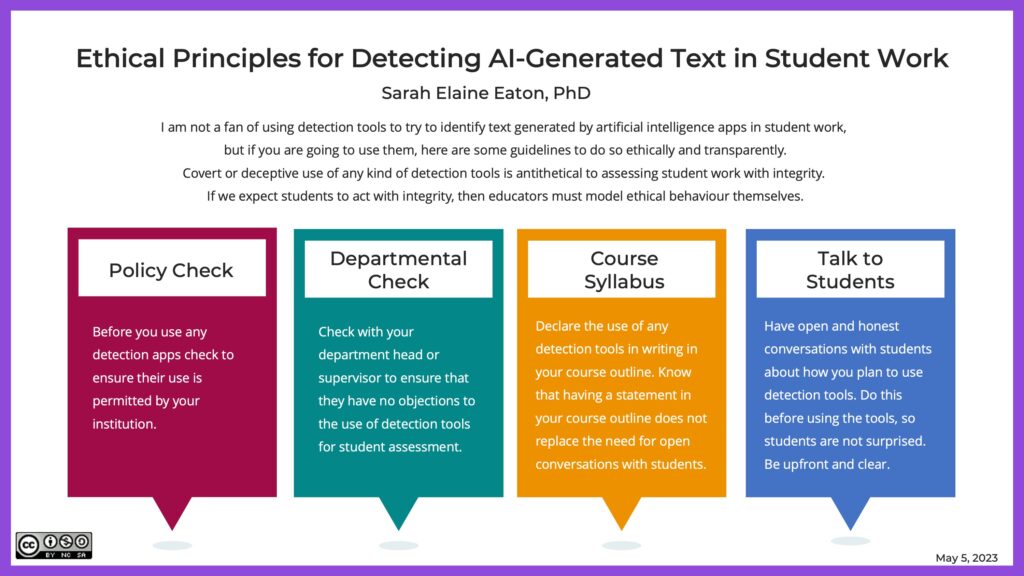

- Undervisere opdaterer politikker og indfører mundtlige eksamener, skriftlige opgaver i realtid og AI-bevidste vurderinger for at mindske afhængigheden af detektionsværktøjer alene.

- Etisk brug af AI er mulig, især når den styres af gennemsigtighed, akademisk ærlighed og værktøjer som Undetectable AI.

Kan ChatGPT opdages i 2025?

ChatGPT og andre store sprogmodeller har forbedret deres evne til at generere naturlig, sammenhængende og menneskelignende tekst dramatisk.

Selv om dette fremskridt åbner op for et stort uddannelsesmæssigt potentiale, giver det også nye udfordringer for akademiske institutioner, der ønsker at bevare integriteten af de studerendes arbejde.

De fleste AI-detektorer brugerd af universiteterherunder Turnitins AI-detekteringsfunktion - er afhængig af sproglige mønstre, forvirringog Sprængthed for at markere AI-genereret skrift.

Du skal aldrig bekymre dig om, at AI opdager dine tekster igen. Undetectable AI Kan hjælpe dig:

- Få din AI-assisterede skrivning til at fremstå Menneskelignende.

- Bypass alle større AI-detektionsværktøjer med bare ét klik.

- Brug AI sikkert og selvsikkert i skolen og på arbejdet.

Men disse systemer er ikke ufejlbarlige. Mange studerende redigerer AI-output eller menneskeliggør dem ved hjælp af avancerede værktøjer for at undgå at blive opdaget.

Dette våbenkapløb mellem generativ AI og AI-detektorer har efterladt universiteterne i en svær balancegang mellem retfærdighed, akademisk integritet og de studerendes skiftende behov.

Almindelige detektionsmetoder på videregående uddannelser

1. Stilometri

Stylometri undersøger en elevs unikke skrivestil på tværs af tidligere afleveringer - og analyserer grammatik, tegnsætning, sætningsstruktur og ordforråd.

En skarp afvigelse i tone eller kompleksitet signalerer ofte brug af AI. Denne metode er særlig effektiv, når undervisere har en portefølje med elevens tidligere arbejde til sammenligning.

2. Statistisk mønsteranalyse

AI-genereret indhold udviser ofte unaturlig konsistens i sætningslængde, formalitet eller struktur.

Detektorer som Turnitin scanner for afvigelser baseret på kendte mønstre i menneskelig skrivning. Men stærkt redigeret AI-indhold kan omgå en sådan analyse.

3. Kontekstuel og semantisk analyse

I stedet for bare grammatik på overfladen evaluerer kontekstuel analyse dybde, relevans og sammenhæng.

AI-værktøjer kan producere indhold, der "lyder rigtigt", men som mangler indsigtsfuld analyse eller forbindelse til kursusmaterialet.

4. Detektion ved hjælp af maskinlæring

Nogle institutioner bruger AI til at bekæmpe AI ved at træne maskinlæringsmodeller til at skelne mellem menneskelig og maskingenereret tekst baseret på tusindvis af eksempler på essays.

5. Menneskelig gennemgang

På trods af automatisering, Erfarne undervisere er fortsat de mest præcise AI-detektorerIsær når de kender deres elevers stemmer.

Faktisk er en 2025 arXiv-undersøgelse fandt, at erfarne instruktører klarede sig bedre end AI-detektorer til at spotte subtile AI-genererede opgaver.

Begrænsninger af AI-detektion i den akademiske verden

Selv om detektionssystemerne er blevet bedre, er der flere kritiske begrænsninger forbliver:

- Falske positiver kan uretmæssigt anklage elever, især dem, hvis skrivning afviger fra normen (f.eks. ESL-elever eller neurodiverse elever).

- Omkostninger og tilgængelighed begrænser universiteter med mindre budgetter i at anskaffe de mest avancerede AI-detektionsværktøjer.

- Etiske bekymringer opstår, når invasive opsporingsmetoder krænker elevernes privatliv eller skaber mistillid.

- Ulighed i brugen af AI kan yderligere øge præstationsforskellene mellem elever med forskellige adgangsniveauer til AI-kundskaber og -værktøjer.

Disse bekymringer har fået mange institutioner til at revurdere ikke bare, hvordan de opdager AI - men også, hvordan de... Gentænk vurderingen i det hele taget.

Konsekvenser af at bruge ChatGPT for studerende og universiteter

Akademisk integritet: AI-genererede afleveringer kan skjule en studerendes sande forståelse.

Når ChatGPT bruges uetisk, udfordrer det nøjagtigheden af den akademiske evaluering og kompromitterer værdien af karakterer og eksamensbeviser.

Etiske dilemmaer: Fra retfærdighed til databeskyttelse kæmper universiteterne med at finde ud af, hvor de skal sætte grænsen for brugen af AI. Skal AI forbydes direkte - eller integreres med omtanke?

Langsigtede virkninger: Overdreven afhængighed af AI kan svække vigtige færdigheder som kritisk tænkning, argumentation og kreativitet.

Hvis akademiske resultater opfattes som AI-assisterede, kan gradenes troværdighed falde i arbejdsgivernes og uddannelsernes øjne.

Måder at bruge AI-værktøjer sikkert på (med uopdagelig AI)

AI behøver ikke at være en fjende af akademisk ærlighed - når det bruges korrekt, kan det øge forståelsen uden at erstatte den originale tanke.

Se her, hvordan studerende kan bruge AI på en sikker og gennemsigtig måde:

- Brug AI til brainstorming, ikke til at skrive hele essays.

- Angiv dine kilder, hvis AI hjalp med at skabe indsigt.

- Rediger kraftigt for at gøre værket til dit eget.

- Brug menneskeliggørende værktøjer for at sikre, at dine tekster afspejler din personlige stemme.

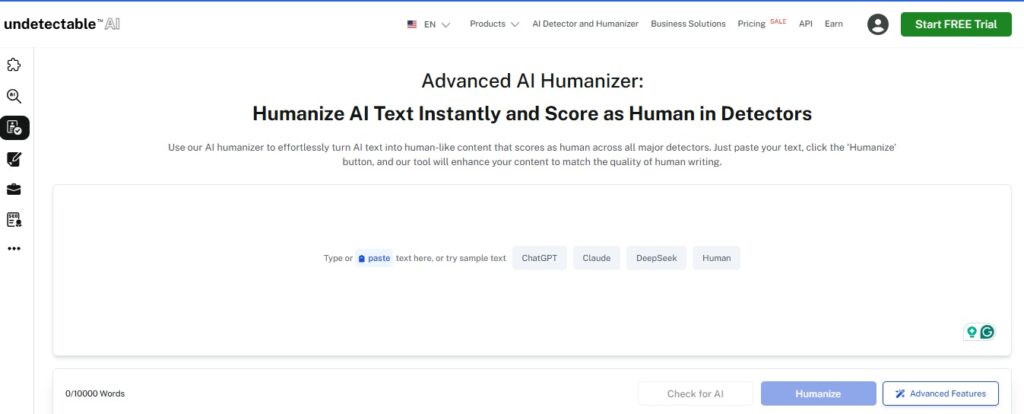

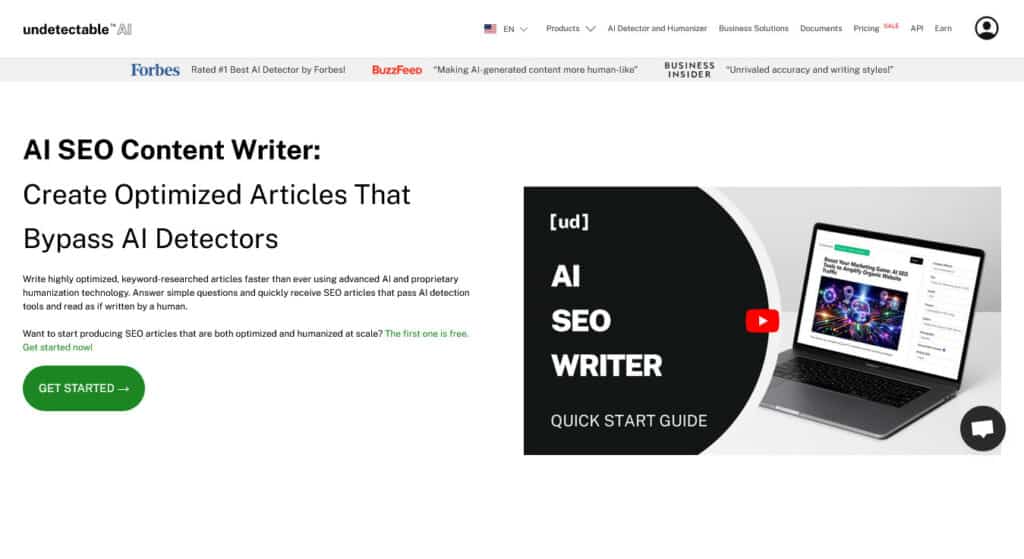

Anbefalede værktøjer fra Undetectable AI

- AI Humanizer - Konverterer robot-AI-output til menneskelignende skrift, der passer til din unikke stemme.

- AI SEO-indholdsforfatter - Ideel til studerende, der administrerer blogs eller personlige portfolier, og som har brug for etisk optimeret indhold.

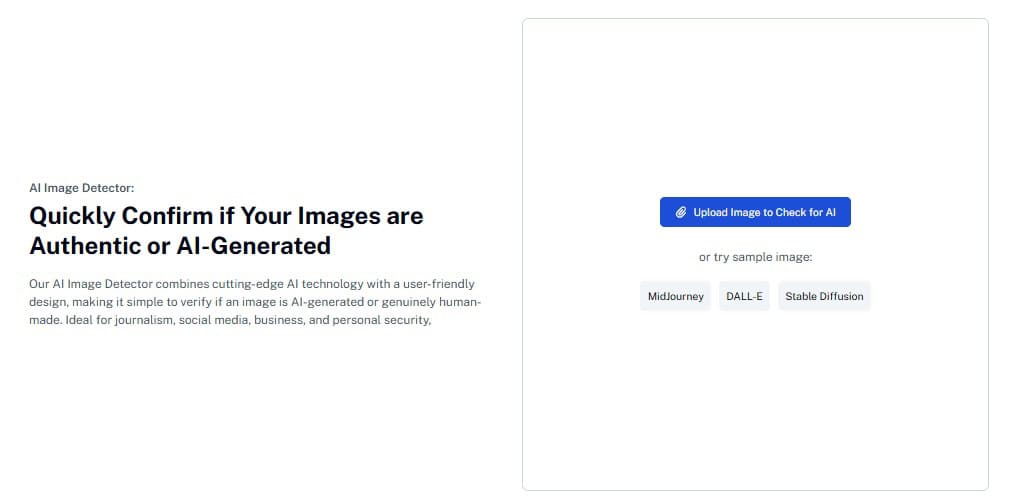

- AI-billeddetekteringr - Designet til visuelle projekter og multimedieindsendelser, der hjælper med at sikre originalitet og overensstemmelse.

Ved at bruge Undetectable AI-værktøjer på en ansvarlig måde kan eleverne tage AI til sig uden at bryde med de akademiske forventninger - og underviserne kan opbygge tillid gennem gennemsigtighed.

Sørg for, at du skriver i overensstemmelse med platformens standarder - start med widgetten nedenfor.

Ofte stillede spørgsmål (FAQ)

Kan gymnasier opdage ChatGPT-genereret indhold?

Ja - men ikke altid. Registreringsværktøjer kan markere sandsynlig AI-brug, men de overser ofte indhold eller identificerer det fejlagtigt. Menneskelig gennemgang er fortsat afgørende.

Er det snyd at bruge ChatGPT til at få hjælp?

Det kommer an på. At bruge ChatGPT til at brainstorme eller afklare et emne kan være fint, hvis det er godkendt af din underviser. At udgive AI-genereret arbejde for at være dit eget betragtes i vid udstrækning som akademisk uredelighed.

Hvad sker der, hvis en Studerende anklages fejlagtigt for at bruge AI?

Falske positiver sker. Derfor opfordres institutioner til at kombinere AI-værktøjer med pædagogisk dømmekraft, før de træffer disciplinære foranstaltninger.

Kan uopdagelige AI-værktøjer omgå opdagelse?

Uopdagelig AI hjælper med at menneskeliggøre indhold og genoprette det naturlige flow, men dens primære formål er at sikre klarhed og originalitet - ikke at snyde detektionssystemer.

Vil universiteterne fortsætte med at udvikle deres AI-politikker?

Helt sikkert. De fleste institutioner er aktivt i gang med at revidere politikker, udvikle nye evalueringer og udforske, hvordan man kan indarbejde AI på en ansvarlig måde i undervisningen.

Konklusion

Uddannelsens fremtid ligger ikke i at undgå kunstig intelligens - men i at lære at bruge den med omtanke.

Højskoler i 2025 anvender i stigende grad detektionsmetoder, men ægte akademisk integritet kommer fra de studerendes forståelse, gennemsigtighed og tillid.

Uanset om du er studerende og søger Etiske måder at bruge AI påeller en underviser, der tilpasser sig et nyt læringslandskab - Uopdagelig AI giver værktøjerne til at støtte din rejse med integritet.

Udforsk ikke-detekterbar AI og finde frem til etiske, effektive måder at arbejde med AI på i dagens klasseværelser.