C'è una cosa che è stata sulla bocca di tutti negli ultimi due anni: ChatGPT.

Insegnanti preoccuparsi che stia scrivendo i compiti degli studenti.

Scrittori temono che l'intelligenza artificiale possa scrivere libri e storie al posto loro.

Codificatori hanno paura che possa costruire siti web e applicazioni meglio di quanto possano fare gli esseri umani.

Alcuni prevedono addirittura che milioni di posti di lavoro potrebbero scomparire a causa dell'intelligenza artificiale.

Tutti ne abbiamo sentito parlare. Ma vi siete mai chiesti come ChatGPT funziona?

Come fa ChatGPT a scrivere i compiti di un bambino? Cosa succede dietro le quinte quando si digita una domanda e si risponde come una persona reale?

Come può una macchina scrivere poesie, storie e codici, anche se non capisce le parole come noi?

In questo blog, guarderemo all'interno ChatGPT e spiegare cos'è e come funziona ChatGPT, passo dopo passo.

Imparerete come ricorda le cose, quali sono i suoi limiti e come vengono costruiti strumenti come questo.

Iniziamo!

La Fondazione: Modelli linguistici GPT

ChatGPT è un'intelligenza artificiale in grado di comprendere e scrivere come un essere umano.

Si chiama modello linguistico perché lavora con il linguaggio, leggendolo, prevedendolo e generandolo.

Ma non capisce come le persone. Non pensa. Non conosce i fatti. Osserva solo gli schemi.

Non preoccupatevi più che l'intelligenza artificiale rilevi i vostri messaggi. Undetectable AI Può aiutarvi:

- Fate apparire la vostra scrittura assistita dall'intelligenza artificiale simile all'uomo.

- Bypass tutti i principali strumenti di rilevamento dell'intelligenza artificiale con un solo clic.

- Utilizzo AI in modo sicuro e con fiducia a scuola e al lavoro.

Ad esempio,

- Se si digita, "Il cielo è..."

- Potrebbe dire "blu".

Non perché sappia che il cielo è blu, ma perché ha visto quella frase milioni di volte durante l'addestramento. Ha imparato che "blu" viene spesso dopo "il cielo è".

Questo tipo di intelligenza artificiale è chiamato LLM, che sta per Modello di lingua grande.

Si basa su tonnellate di libri di testo, siti web e altro per capire come gli esseri umani usano le parole. Ma non sta leggendo il significato. Sta imparando come le parole si presentano di solito l'una accanto all'altra.

GPT è un tipo specifico di LLM.

GPT sta per "Trasformatore generativo preaddestrato".

- Generativo - può creare nuovo testo.

- Pre-addestrato - impara prima di parlare con voi.

- Trasformatore - la tecnologia chiave che sta alla base del funzionamento di ChatGPT e che gli permette di capire come le parole si relazionano tra loro in una frase, in un paragrafo o addirittura in una conversazione.

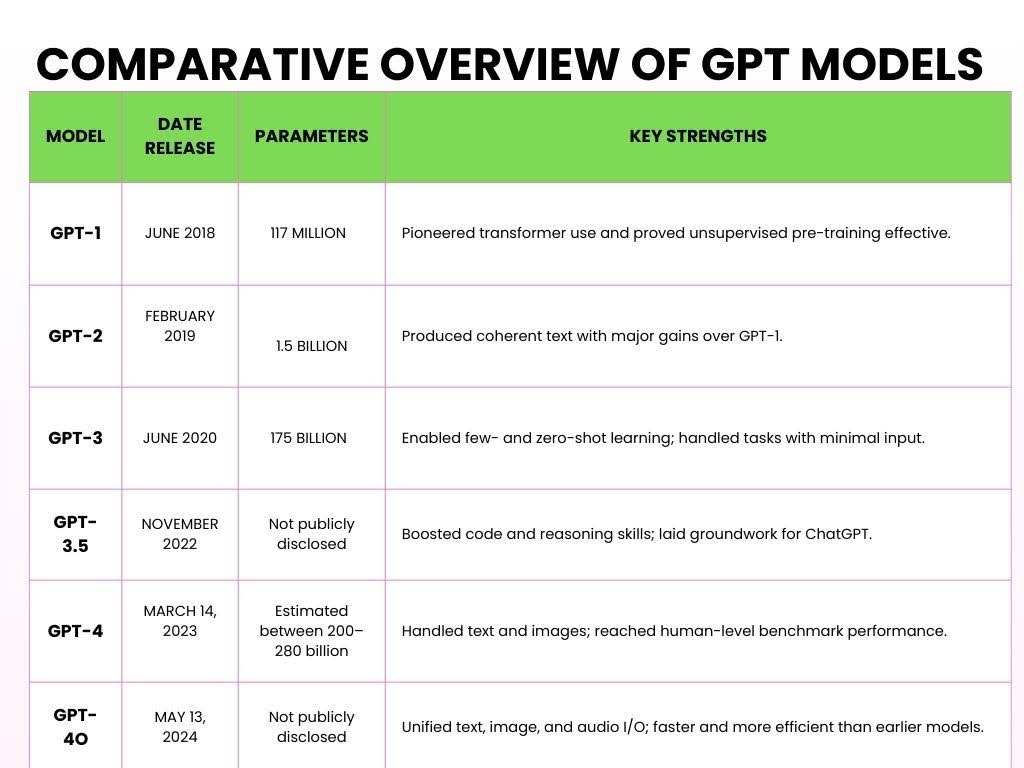

Ecco le diverse versioni di GPT che sono state lanciate nel corso degli anni.

Come funziona ChatGPT

Ecco una descrizione semplificata di come ChatGPT funziona ed elabora i vostri input in cinque fasi chiave.

- Fase 1: pre-addestramento su dati massivi

Modelli linguistici di grandi dimensioni (LLM) come ChatGPT sono pre-addestrati elaborando grandi quantità di testo da Internet per imparare i modelli linguistici.

Durante il pre-addestramento, il modello elabora trilioni di gettoni (piccoli pezzi di testo).

A gettone può essere una parola, una parte di parola o persino la punteggiatura, a seconda di come il modello tokenizza l'input.

Ad esempio,

Si pone a ChatGPT una domanda di matematica, come ad esempio:

Problema:

- 2 + 3 = ?

Durante il suo addestramento, ChatGPT legge centinaia di miliardi di parole da libri, notizie, articoli, Wikipedia, storie, articoli scientifici e persino discussioni su Reddit.

Questo addestramento e la lettura lo aiutano a capire come funziona l'addizione.

Ad esempio,

Potrebbe imparare il proprietà commutativa (ad esempio, 2 + 3 = 3 + 2) attraverso tali contesti.

ChatGPT vede molti esempi come

- "2 + 3 = 5,"

- "7 + 8 = 15,"

- "9 + 4 = 13."

Non impara solo questi esempi specifici, ma lo schema dell'addizione.

Capisce come i numeri interagiscono con il simbolo "+" e come il risultato segue tipicamente il simbolo "=".

- Passo 2: L'architettura del trasformatore

Una volta che ChatGPT aveva visto una quantità enorme di parole, aveva bisogno di un cervello che potesse dare un senso a tutte quelle informazioni. Questo cervello di intelligenza artificiale si chiama "Transformer".

Ciò che contraddistingue il Transformer è la sua capacità di focalizzare l'attenzione sulle parti più importanti dell'input, in modo simile a come elaboriamo il linguaggio.

Ad esempio,

Applichiamo questo principio a un problema matematico:

- "Qual è la somma di 5 e 7?".

Durante l'elaborazione, il Transformer non si limita ad analizzare parola per parola.

Invece, esamina l'intero contesto: "somma", "5" e "7", tutti insieme.

Riconosce che "somma" si riferisce a "aggiunta" e che "5" e "7" sono i numeri coinvolti.

Il trasformatore fornisce quindi più "attenzione" alle parole che hanno un impatto diretto sulla risposta, quindi si concentra sull'operazione ("somma") e sui numeri ("5" e "7").

Questa è una parte fondamentale del funzionamento di ChatGPT, che non elabora linearmente il problema, ma in un modo che lo aiuti a comprendere la relazione tra gli elementi.

Questa capacità di guardare tutto nel contesto è ciò che rende il Transformer così potente.

Invece di limitarsi a capire cosa viene dopo, capisce il significato collegando insieme i pezzi rilevanti della frase.

Inoltre, entrare in una nuova comunità online spesso significa imparare un vocabolario completamente nuovo, ma non è necessario aspettare mesi per iniziare a parlare la lingua.

Inoltre, se desideri che i tuoi messaggi si integrino perfettamente, Undetectable AI offre Generatore di acronimi consente di creare abbreviazioni personalizzate che imitano i complessi modelli utilizzati dai modelli di intelligenza artificiale per elaborare e generare forme abbreviate linguistiche strutturate.

- Fase 3: Tokenizzazione ed elaborazione del linguaggio

Quando si digita un testo in ChatGPT, il messaggio viene suddiviso in piccole parti. gettoni.

Alcuni token sono parole intere, mentre altri sono solo parti di parole.

Ad esempio,

Quando si immette "ChatGPT è intelligente". ChatGPT lo divide nei seguenti token:

["Chat", "G", "PT", "è", "intelligente"].

Anche il nome "ChatGPT" viene suddiviso in diversi token.

Questo processo è chiamato tokenizzazione. Poiché i modelli sono stati addestrati su token invece che su parole intere, la gestione è molto più flessibile:

Più lingue (poiché lingue diverse hanno strutture di parole diverse),

Slang e abbreviazioni (come "u" per "tu" o "idk" per "non so").

Anche parole inventate o variazioni (come la suddivisione di "unbelievable" in "un", "believ", "able").

- Fase 4: messa a punto e livelli di sicurezza

Una volta che ChatGPT è stato addestrato su una vasta quantità di dati, non è ancora pronto per la prima serata.

Ha ancora bisogno di aiuto per assicurarsi che risponda nel modo più utile, educato e sicuro.

Attraverso messa a punto supervisionata, i recensori umani forniscono a ChatGPT esempi di ciò che rende una buona risposta. Ad esempio,

- "Che cos'è 5 + 7?"

- Risposta negativa: È una domanda facile. Perché non lo sai?

- Buona risposta: La somma di 5 e 7 è 12.

Nel corso del tempo, ChatGPT viene addestrato con esempi migliori per diventare più educato, chiaro e concentrato.

Una volta ottenuta una solida base, riceve un aiuto più avanzato attraverso Apprendimento per rinforzo dal feedback umano (RLHF).

Il processo si svolge in questo modo:

- ChatGPT risponde.

- Tasso di umanizzazione La risposta si basa sulla sua qualità, sulla sua utilità, sulla sua precisione e sulla sua sicurezza.

- ChatGPT impara da questo feedback e cerca di dare risposte migliori in futuro.

Ad esempio, Immaginate che ChatGPT risponda a un problema matematico, come ad esempio "Quanto fa 12 diviso 4?":

- ChatGPT risponde: "3."

- Feedback umano: Questa risposta è ottima.

- ChatGPT impara: Continua a dare questo tipo di risposta quando si presentano domande simili.

L'obiettivo è che ChatGPT continui a migliorare, proprio come uno studente che impara dagli errori del passato.

Infine, uno scopo importante della messa a punto da parte dell'uomo è il allinearsi ai valori umani.

Vogliamo che non sia solo intelligente, ma anche utile, innocuo e onesto.

Ad esempio, se un utente pone una domanda complessa come, "Qual è la radice quadrata di -1?".

Invece di dare una risposta errata come "i è la risposta" senza alcun contesto, fornirebbe:

Risposta sicura e allineata: La radice quadrata di -1 è un numero immaginario, comunemente rappresentato come "i". Questo concetto è utilizzato nella matematica avanzata.

- Fase 5: Prompt in, risposta out

Questa è la fase finale in cui ChatGPT è pronto a rispondere alle vostre richieste.

Un prompt è il testo (cioè una domanda, un comando o un'affermazione) che si digita in ChatGPT per avviare la conversazione e ottenere una risposta.

Ad esempio,

Si accede al prompt "Che tempo fa oggi?"

Ecco come funziona ChatGPT dietro le quinte:

L'utente digita una richiesta → ChatGPT la suddivide in token → Cerca modelli nei token → Prevede la parola successiva → Forma una risposta → Regola il tono in base al testo → Ottiene la risposta finale

Per il prompt "Che tempo fa oggi?", ChatGPT probabilmente risponderebbe con qualcosa del tipo:

"Non posso fornire aggiornamenti meteo in tempo reale, ma potete consultare un sito o un'app meteo come Weather.com o i notiziari locali per avere informazioni più precise".

Questo perché ChatGPT non ha accesso ai dati in tempo reale, a meno che non sia collegato a uno strumento che raccoglie informazioni in tempo reale.

Come "ricorda" le conversazioni

Quando si parla con ChatGPT, sembra che ricordi le cose dette in precedenza.

E lo fa, ma solo quando la chat è aperta. Immaginate un grande blocco note dove tutto ciò che digitate viene scritto:

Lei dice:

- Il mio cane si chiama Max.

Poche righe dopo, lei dice:

- Quali trucchi può imparare Max?

ChatGPT collega i punti. Ricorda che Max è il vostro cane, perché è ancora sul blocco note.

Questo blocco note è chiamato finestra di contesto, e contiene un numero limitato di parole (chiamate token).

Alcune versioni possono contenere circa 8.000 gettoni, mentre le più recenti possono arrivare a 32.000 gettoni.

Ma una volta raggiunto il limite, deve iniziare a cancellare le parti più vecchie per fare spazio al nuovo testo.

Quindi se si dice "Il mio cane si chiama Max" all'inizio di una lunga chiacchierata - e poi 50 paragrafi dopo chiedere, "Qual è un buon guinzaglio per lui?". - potrebbe dimenticare chi è "lui".

Perché quelle informazioni sono già state cancellate dal blocco note.

Parliamo ora della memoria tra le chat.

Normalmente, quando si chiude la chat, il blocco note viene ripulito.

In questo modo, la prossima volta che si apre ChatGPT, inizia da zero.

Ma se si attiva la memoria personalizzata, ChatGPT può ricordare le cose tra le varie sessioni. Ad esempio,

- Dillo tu: Gestisco una piccola pasticceria online chiamata Sweet Crumbs.

- Una settimana dopo, lei dice: Scrivimi una descrizione del prodotto.

- Potrebbe rispondere: Certo! Ecco una descrizione per i biscotti Sweet Crumbs...

Non ricorda tutto. Ricorda solo ciò che l'utente autorizza e viene avvisato quando viene aggiunto qualcosa. È possibile vedere, modificare o eliminare i ricordi in qualsiasi momento.

Quindi la situazione è...

ChatGPT in realtà non "ricordare" come una persona. Si limita a guardare ciò che ha davanti, ovvero la conversazione in corso.

Se sembra che richiami qualcosa di precedente, è perché quelle informazioni sono ancora all'interno della finestra contestuale.

Limitazioni del funzionamento di ChatGPT

ChatGPT è incredibilmente utile, ma è importante comprenderne i limiti, soprattutto se lo si utilizza per qualsiasi attività rivolta al cliente o orientata alla conversione.

1 - Nessuna reale comprensione o consapevolezza

ChatGPT non comprende i contenuti come gli esseri umani. Non "conosce" i fatti: si limita a prevedere la prossima parola probabile sulla base dei dati di addestramento.

Ad esempio,

Se lo chiedete, "Cosa significa successo?" può generare una risposta fluente, ma non ha credenze, valori o consapevolezza. Imita gli schemi, non forma intuizioni.

2 - Bias dei dati di addestramento

Poiché ChatGPT viene addestrato su fonti miste di grandi dimensioni provenienti da Internet, libri, forum e articoli, può ereditare le distorsioni presenti in quei dati.

Se Internet si schiera da una parte o dall'altra su un argomento, ChatGPT potrebbe rispecchiare questa prospettiva - a volte in modo sottile, a volte no - anche quando è richiesta la neutralità.

3 - Non naviga in Internet

ChatGPT non è in grado di ottenere dati in tempo reale. Se gli chiedete di un prodotto lanciato la settimana scorsa o del prezzo di un'azione oggi, non ne saprà nulla.

I suoi dati di addestramento hanno un limite, e tutto ciò che si trova dopo quel punto è fuori portata.

4 - Può "allucinare" i fatti o citare fonti false.

Una delle stranezze più pericolose: ChatGPT può inventare le cose. Chiedetegli una statistica o una citazione e potrebbe rispondere,

"Secondo l'Organizzazione Mondiale della Sanità, 80% degli adulti preferiscono la marca X alla marca Y".

Sembra ufficiale, ma probabilmente questa statistica non esiste.

Non è stato recuperato, è stato inventato. Questo problema è noto come allucinazioneed è particolarmente rischioso nella ricerca, nel giornalismo o nei contenuti tecnici.

Se chiedete a ChatGPT come funziona, vedrete che non è sempre accurata.

Se si usa ChatGPT per scrivere, l'output sembrerebbe rigido, robotico o privo di quel tocco umano.

Per tali sfumature, è possibile utilizzare AI Humanizer.

Il Umanizzatore AI riscrive gli output di ChatGPT per ottenere tono, sfumature ed emozioni, dando ai vostri contenuti un battito cardiaco.

Esso ammorbidisce il fraseggio goffo, aggiunge calore, e fa sì che un testo tecnico o arido risuoni con il pubblico.

Quando i contenuti suonano umani, hanno un rendimento migliore.

Che stiate scrivendo landing page, e-mail o post su LinkedIn, la relazionalità guida la risposta. E l'emozione guida la conversione.

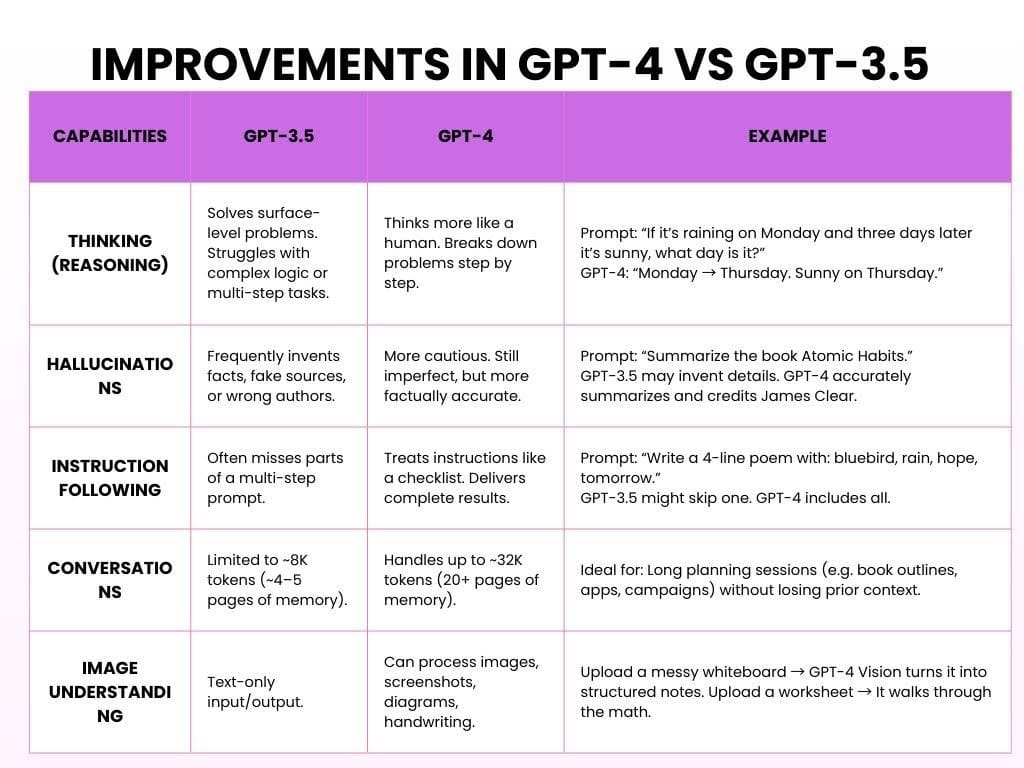

Miglioramenti in GPT-4 rispetto a GPT-3.5

GPT-3.5 è la versione gratuita, veloce, solida e ottima per compiti semplici. GPT-4 è la versione a pagamento di OpenAI, più intelligente, più potente e molto più utile.

Ecco come funziona ChatGPT con entrambi i modelli:

In conclusione, la GPT-3.5 è stata utile. GPT-4 è affidabile, attento e sembra che stia ascoltando.

Iniziate a esplorare: il nostro AI Detector e Humanizer vi aspettano nel widget qui sotto!

Come vengono costruiti gli strumenti di intelligenza artificiale come ChatGPT

La creazione di un'intelligenza artificiale come ChatGPT o di altri modelli linguistici di grandi dimensioni è un progetto pluriennale che prevede l'impiego di enormi serie di dati, team di esperti e un'iterazione incessante.

Ecco come avviene di solito:

- Prima fase: raccolta dei dati (6-12 mesi)

Obiettivo: Insegnare gli schemi linguistici modello.

Prima di poter rispondere alle domande, l'IA deve imparare come gli esseri umani scrivono e parlano.

Si inizia con la raccolta di centinaia di miliardi di parole da libri, siti web, notizie, articoli, documenti accademici e altro ancora.

Non "legge" come gli esseri umani. Invece, identifica gli schemi, proprio come abbiamo spiegato nelle sezioni precedenti.

Tempo richiesto: 6-12 mesi, a seconda della scala e delle dimensioni del team.

- Fase due: pre-addestramento del modello (6-9 mesi)

Obiettivo: Costruire il cervello.

Il preaddestramento consiste nell'alimentare il modello con grandi volumi di testo e lasciare che preveda le parole mancanti più e più volte, finché non inizia a capirle.

Questa fase richiede spesso potenti Cluster di GPU e centinaia di milioni di dollari in risorse di calcolo.

Tempo richiesto: 6-9 mesi di formazione non-stop su GPU.

3. Terza fase: Messa a punto e feedback umano (3-6 mesi)

Obiettivo: Rendere utile l'IA.

Ora può parlare, ma ha senso? Forse o forse no. A questo punto, i revisori umani valutano i risultati, correggono gli errori e guidano il modello utilizzando il Reinforcement Learning from Human Feedback (RLHF).

Tempo richiesto: 3-6 mesi, spesso in concomitanza con i primi test.

4. Quarta fase: Implementazione e infrastruttura (in corso)

Obiettivo: Rendetelo scalabile.

Una volta addestrato, il modello viene distribuito su siti web, app, API e piattaforme aziendali. Ciò richiede una seria infrastruttura di backend: data center, API a scalabilità automatica e sistemi di bilanciamento del carico per gestire milioni di utenti simultanei.

Tempistica: Inizia dopo la formazione, ma continua a tempo indeterminato.

5. Quinta fase: Sicurezza, pregiudizi ed etica (in corso, in parallelo)

Obiettivo: Mantenete un comportamento sicuro, onesto e non dannoso.

L'intelligenza artificiale non è solo intelligenza, ma anche responsabilità. I team che si occupano di etica lavorano in parallelo per segnalare potenziali abusi, ridurre i pregiudizi, bloccare i contenuti dannosi e rispettare gli standard di privacy. Valutano costantemente il comportamento del modello nel mondo reale.

Tempistica: Processo che dura tutta la vita, incorporato in tutte le fasi precedenti.

Domande frequenti su come funziona ChatGPT

ChatGPT cerca le risposte su Internet?

A partire da ottobre 2024, ChatGPT ha acquisito la capacità di navigare in Internet in tempo reale.

Questa funzione era inizialmente esclusiva degli utenti a pagamento, ma dal dicembre 2024 è diventata disponibile per tutti.

Si tratta di un chatbot o di qualcosa di più?

ChatGPT è un modello di intelligenza artificiale generativa. L'IA generativa genera risposte dinamiche e consapevoli del contesto utilizzando il deep learning.

Oltre a chattare, l'intelligenza artificiale generativa è in grado di scrivere saggi, generare immagini, comporre musica e persino creare video, dimostrando la sua versatilità in vari ambiti.

ChatGPT pensa?

No, il ChatGPT non pensa come gli esseri umani. Non ha consapevolezza, credenze, intenzioni o emozioni.

Ciò che fa è prevedere statisticamente la parola successiva in una frase in base ai modelli dei suoi dati di addestramento. Questo può sembrare un ragionamento, ma non è così.

Pensieri finali

I modelli linguistici di grandi dimensioni (LLM) hanno cambiato il modo in cui interagiamo con la tecnologia.

Possono creare testi che sembrano scritti da un essere umano, aiutando in compiti come la risposta alle domande e la creazione di contenuti creativi.

Ma gli LLM non "capire" cose o pensare come le persone. Funzionano prevedendo schemi nei dati, non attraverso il pensiero umano reale.

Mentre i LLM migliorano, dobbiamo pensare ai problemi che possono causare, come pregiudizi, problemi di privacy e uso improprio.

È importante utilizzare l'IA con attenzione, assicurandosi che sia equa, trasparente e che non diffonda informazioni false o danneggi la privacy.

Ecco i linee guida per l'utilizzo:

- Siate consapevoli che l'IA può avere dei pregiudizi nei suoi contenuti.

- Utilizzare gli strumenti di IA in modo da rispettare le norme sulla privacy.

- Ricontrollate le informazioni importanti da fonti attendibili.

- Non fate troppo affidamento sull'intelligenza artificiale. È uno strumento, non un sostituto del pensiero umano.

Poiché la tecnologia AI continua a diventare sempre più potente, si pone la domanda: Come possiamo fare in modo che i suoi progressi migliorino la creatività umana e il processo decisionale, anziché sostituire le cose che ci rendono unici?