Hvis du har vært med i AI-spillet en kort stund, er du sannsynligvis kjent med noen av frontløperne innen generativ AI.

Verktøy som Jaspers prompt-baserte innholdsforfatter, DALL-E 3 AI-kunstgeneratoren og til og med Suno og dens magiske evner til å generere musikk - bare for å nevne noen.

Men det var ChatGPT som tok AI-bransjen til et helt nytt nivå.

Den ble svært populær og skapte veier for ulike plattformer for å skape flere slike AI-verktøy.

De fleste av oss vet kanskje hvordan man bruker det på et grunnleggende nivå, men har du noen gang lurt på: "Hva står GPT for i ChatGPT?"

Er det et slags teknisk akronym eller en kul Silicon Valley-klingende etikett?

Hva står GPT for?

GPT står for generativ forhåndstrenet transformator. Disse tre ordene avslører kjernen i hvordan ChatGPT og lignende AI-systemer fungerer.

Se for deg GPT som V8-motoren under panseret på ChatGPT.

Når du samhandler med ChatGPT, snakker du i hovedsak med en GPT-modell som er optimalisert for samtale.

Aldri bekymre deg for at AI oppdager tekstene dine igjen. Undetectable AI Kan hjelpe deg:

- Få AI-assistert skriving til å vises ...menneskelignende.

- Bypass alle de viktigste AI-deteksjonsverktøyene med bare ett klikk.

- Bruk AI trygt og selvsikkert i skole og arbeid.

Navnet forteller oss nøyaktig hvordan teknologien fungerer, der den genererer nytt innhold, baserer seg på forhåndstrening på massive datasett og bruker en transformatorarkitektur for å forstå kontekst.

Begrepet høres kanskje teknisk ut, men ved å forstå hver enkelt del får du innsikt i hvorfor disse AI-modellene kan skrive essays, svare på spørsmål og til og med etterligne menneskelige samtaler med overraskende nøyaktighet.

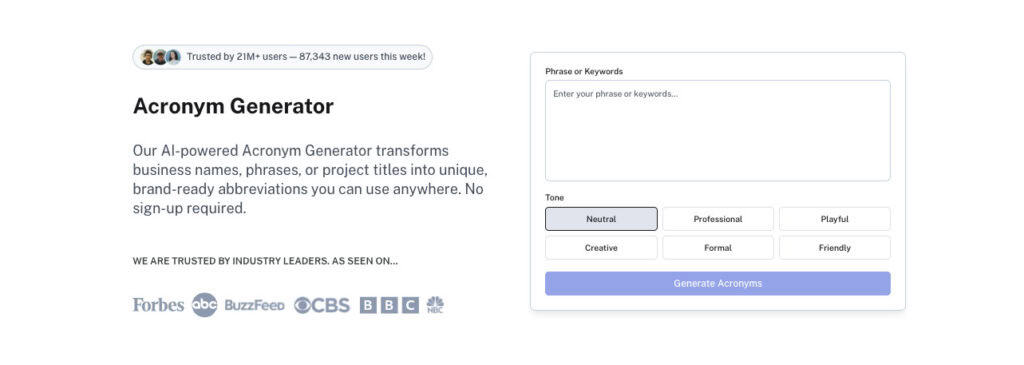

Hvis ‘alfabetsuppen’ av moderne teknologi føles overveldende, kan du bruke vår Uoppdagelige AI Akronymgenerator for å utforske hvordan kjente tekniske termer som ‘GPT’ er strukturert, og hvordan du kan lage din egen.

Det er en flott måte å avmystifisere navnekonvensjonene i Silicon Valley på, eller å skape din egen profesjonelle forkortelse for et nytt prosjekt, slik at merkevaren din blir like fengende og funksjonell som selve ‘Generative Pre-trained Transformer’.

Å bryte ned GPT: Hva hvert ord betyr

La oss se nærmere på hver enkelt komponent i GPT.

Disse tre ordene er ikke tilfeldig valgt - de beskriver den grunnleggende tilnærmingen som gjør denne AI-teknologien så kraftfull.

1. Generativ

G-en i GPT viser til modellens primære formål: å generere nytt innhold.

I motsetning til AI-systemer som kun er utviklet for å klassifisere eller identifisere eksisterende informasjon, er GPT oppretter ny tekst.

Den henter ikke bare ferdigskrevne svar fra en database. I stedet formulerer den originale svar basert på mønstre den har lært under opplæringen.

Denne generative evnen betyr at GPT kan:

- Lag helt nye historier

- Produsere unike svar på spørsmål

- Skap innhold som ikke har eksistert før

- Tilpasse skrivestilen til ulike kontekster

Når du ber ChatGPT om å skrive et dikt eller forklare et konsept, genererer den nytt innhold på stedet. Det er den sanne kraften til "G" i GPT.

2. Forutdannet

"P" avslører et kritisk aspekt ved hvordan GPT-modeller utvikler sine evner.

Med pretrening menes den innledende læringsfasen der modellen absorberer mønstre fra enorme datasett før den i det hele tatt samhandler med brukerne.

Under forhåndstreningen behandler GPT milliarder av teksteksempler fra bøker, artikler, nettsteder og andre kilder.

Denne prosessen lærer modellen:

- Språkmønstre og grammatikk

- Fakta og generell kunnskap

- Vanlige resonneringsmønstre

- Kulturelle kontekster og referanser

Tenk på pre-trening som modellens opplæringsfase.

På samme måte som mennesker lærer av å lese bøker før de skriver sitt eget innhold, lærer GPT av eksisterende tekst før de genererer nytt materiale.

Det er denne opplæringen som gir GPT sin brede kunnskapsbase.

Når du spør om alt fra Shakespeare til kvantefysikk, trekker modellen på dette grunnlaget for å danne sitt svar.

3. Transformator

T-en representerer det arkitektoniske gjennombruddet som gjorde det mulig å generere moderne AI-tekst.

Den transformatorarkitektursom ble introdusert i en artikkel fra 2017 med tittelen "Oppmerksomhet er alt du trenger", revolusjonerte hvordan kunstig intelligens behandler språk.

I motsetning til tidligere modeller som behandlet tekst sekvensielt (ett ord om gangen), kan transformatorer analysere forholdet mellom alle ordene i en tekst samtidig.

Denne tilnærmingen gjør det mulig for modellen å:

- Forstå konteksten mer effektivt

- Oppretthold sammenheng over lange passasjer

- Forstå subtile sammenhenger mellom begreper

- Behandle informasjon mer effektivt

Transformatorens oppmerksomhetsmekanisme lar GPT veie betydningen av ulike ord i forhold til hverandre.

Dette hjelper modellen til å forstå at ords betydning endres avhengig av konteksten.

Når du for eksempel bruker uttrykket "bank" i visse sammenhenger, vil GPT forstå at du snakker om finans, ikke om bredden av en elv.

Denne kontekstuelle forståelsen kommer fra transformatorarkitekturen.

Hvordan GPT fungerer i ChatGPT

ChatGPT er ikke bare GPT - det er GPT optimalisert spesielt for interaktive samtaler. Hvis du er nysgjerrig på hvordan lignende modeller fungerer i praksis, kan du prøve en GPT OSS gratis demo for å oppleve hvordan GPT-systemer med åpen kildekode genererer sanntidssvar.

Dette skillet er viktig fordi det forklarer hvorfor ChatGPT føles så naturlig å snakke med sammenlignet med andre AI-verktøy.

Hvordan ChatGPT bruker GPT til å generere tekst

ChatGPT bygger på kjernen i GPT-teknologien, men legger til viktige elementer som gjør at den fungerer godt for dialog frem og tilbake.

Prosessen fungerer omtrent slik:

- Du skriver inn en melding eller et spørsmål (ledeteksten)

- ChatGPT behandler inndataene dine gjennom sin GPT-modell

- Den tar hensyn til hele samtalehistorikken for kontekst

- Modellen genererer flere mulige svar

- Ytterligere systemer evaluerer disse svarene med tanke på kvalitet og sikkerhet

- Det beste svaret velges og vises for deg

Det som gjør ChatGPT spesielt, er at det er finjustert spesielt for dialog. Dette inkluderer ekstra opplæring for å gjøre svarene nyttige, ufarlige og ærlige.

Modellen lærer seg også å innrømme når den ikke vet noe, i stedet for å finne på svar.

Hvorfor GPT-modeller er så effektive i samtaler

GPT-modeller utmerker seg i samtaler av flere viktige grunner som har direkte sammenheng med utformingen.

For det første forstår de konteksten bemerkelsesverdig godt.

Når du stiller oppfølgingsspørsmål, husker modellen tidligere utvekslinger og bygger videre på dem, noe som gir en følelse av å snakke med noen som faktisk lytter.

For det andre har GPT-modeller blitt eksponert for utallige eksempler på menneskelig dialog under opplæringen.

De har lært seg den naturlige flyten i en samtale, for eksempel hvordan folk stiller spørsmål, kommer med oppklaringer og bygger videre på tidligere uttalelser.

For det tredje har moderne GPT-modeller blitt finjustert ved hjelp av en teknikk som kalles Forsterkningslæring fra menneskelige tilbakemeldinger (RLHF).

Denne prosessen bidrar til å tilpasse modellens responser til menneskelige preferanser og forventninger.

Resultatet er et AI-system som kan føre sammenhengende, relevante samtaler om et enormt spekter av emner, fra uformell småprat til tekniske forklaringer.

Utviklingen av GPT: Fra GPT-1 til GPT-4.5

GPT-modellen har utviklet seg dramatisk siden den ble introdusert. Hver versjon har ført med seg betydelige forbedringer.

- GPT-1 (2018) var banebrytende, men begrenset. Med 117 millioner parametere (de justerbare verdiene som bestemmer hvordan modellen behandler informasjon), viste den at transformatortilnærmingen kunne fungere for generative tekstoppgaver.

- GPT-2 (2019) representerte et stort sprang fremover med 1,5 milliarder parametere. Men de forbedrede mulighetene skapte bekymring for potensielt misbruk, noe som førte til en trinnvis lansering.

- GPT-3 (2020) var revolusjonerende. Med 175 milliarder parametere demonstrerte den en bemerkelsesverdig allsidighet og ble den første GPT-modellen som drev utbredte kommersielle applikasjoner.

- GPT-3.5 (2022) drev den første versjonen av ChatGPT. Denne videreutviklede versjonen viste betydelig forbedrede dialogfunksjoner og bedre samsvar med menneskelige verdier.

- GPT-4 (2023) markerte et nytt sprang. Med multimodale funksjoner (behandling av både tekst og bilder) og forbedret resonnering demonstrerte den ytelse på ekspertnivå på tvers av mange domener.

- GPT-4.5 (2024) har fortsatt denne utviklingen med raffinerte funksjoner og enda større pålitelighet. Hver iterasjon har brakt oss nærmere AI-systemer som kan forstå og svare på behovene våre med større nyanser og nøyaktighet.

Gjennom hele denne utviklingen har den grunnleggende GPT-tilnærmingen forblitt den samme, samtidig som omfanget og raffinementet har økt dramatisk.

Hvordan AI-verktøy bruker GPT til ulike bruksområder

GPT-teknologien driver langt mer enn bare ChatGPT.

Allsidigheten gjør den ideell for en rekke spesialiserte bruksområder, som alle utnytter GPTs kjernefunksjoner på unike måter.

Hos Undetectable AI har vi utviklet flere verktøy som utnytter GPTs språkbehandlingsevner til spesifikke formål:

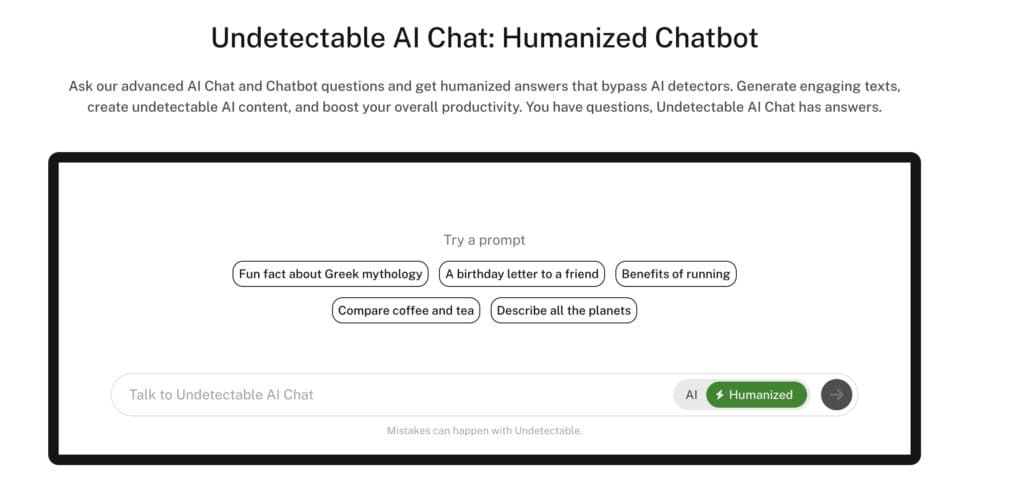

- AI-chat - Vår AI-chat tilbyr smarte, kontekstbevisste svar på alle spørsmål, fra kreative skriveoppgaver til historiefakta og hjelp med koding. Den bruker GPT til å generere nøyaktige, nyanserte svar, og menneskeliggjør deretter svaret slik at det høres naturlig ut og omgår AI-detektorer. Enten du brainstormer, skriver skript eller bare er nysgjerrig, gjør denne chatten mer enn å svare - den engasjerer deg som en ekte person.

- AI SEO-skribent - AI SEO Writer bruker GPT til å produsere fullt optimaliserte artikler som ikke bare rangeres i søkemotorer, men som også leses som om de er skrevet av et menneske. Den kombinerer søkeordmålretting, konkurrentanalyse og avansert språkmodellering for å skrive SEO-innhold med høy ytelse. Med en innebygd humanizer kan artiklene dine omgå AI-deteksjonsverktøy uten at det går på bekostning av kvalitet eller klarhet.

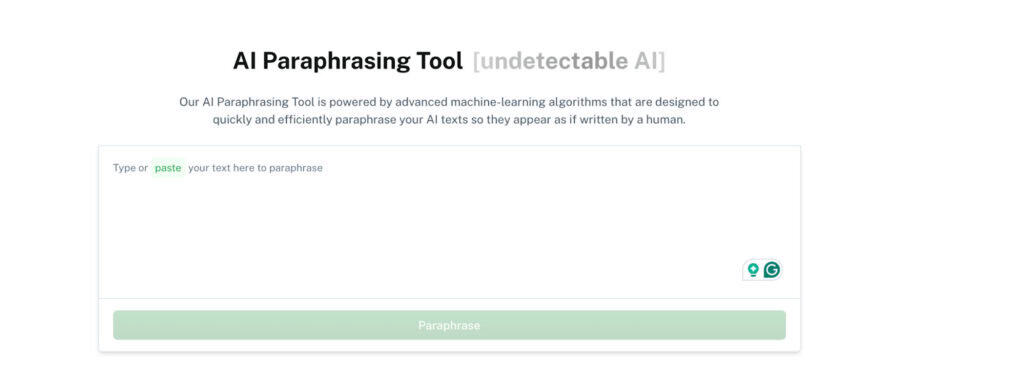

- Verktøy for parafrasering - Vårt AI-parafraseringsverktøy tenker om setningene dine. Ved hjelp av GPTs avanserte språkegenskaper omskriver det tekst med ulike toner, stiler eller kompleksitetsnivåer. Verktøyet er perfekt for studenter, markedsførere og forskere, og hjelper deg med å forvandle ethvert utkast til originalt, engasjerende og usynlig menneskelig innhold.

- AI CV Builder - CV-byggeren utnytter GPT til å lage skreddersydde, ATS-optimaliserte CV-er. Du velger en mal, legger inn opplysningene dine, og GPT tar seg av resten - å lage overbevisende, jobbspesifikke CV-er med profesjonelt språk og nøkkelord fra bransjen.

Kombiner det med vår AI Humanizerog du får en polert CV som skiller seg ut, leser seg naturlig og unngår å høres robotaktig ut.

Disse bruksområdene viser GPTs allsidighet. Den samme kjerneteknologien - Generative Pre-trained Transformer - kan optimaliseres for svært forskjellige oppgaver, samtidig som kvaliteten og den kontekstuelle forståelsen som gjør GPT så kraftfull, opprettholdes.

Oppdag våre AI-detektor og Humanizer gjennom widgeten nedenfor!

Vanlige spørsmål om GPT i ChatGPT

Er GPT det samme som AI?

GPT er en spesifikk type AI-modell som fokuserer på å generere tekst, mens AI er et bredere felt som omfatter ulike teknologier som datasyn og robotteknologi.

GPT er et verktøy i AI-verktøykassen. Det som gjør GPT unikt, er evnen til å generere menneskelignende språk, ikke bare analysere eller klassifisere data.

Hvem utviklet GPT?

GPT ble utviklet av OpenAI, som ble grunnlagt i 2015 av blant andre Elon Musk og Sam Altman.

Den første versjonen ble lansert i 2018, og hver nye versjon bygger på forskning innen maskinlæring og språkmodellering. Microsoft er nå en stor investor og partner i OpenAIs fortsatte utvikling av GPT.

Hvordan forbedrer GPT seg over tid?

Hver versjon av GPT forbedres gjennom større datasett, flere treningsparametere og smartere arkitektur.

Teknikker som Reinforcement Learning from Human Feedback (RLHF) bidrar til å tilpasse resultatene til menneskelige preferanser. Oppdateringene omfatter også sterkere sikkerhetstiltak for å redusere skjevheter og forhindre misbruk.

Nå kjenner du GPT-ene dine!

GPT - Generative Pre-trained Transformer - driver noen av de mest imponerende AI-verktøyene som er tilgjengelige i dag.

Hvis du forstår hva dette akronymet betyr, kan du få en dypere innsikt i hvordan teknologi som ChatGPT fungerer, og hvorfor den er i stand til å generere et så bemerkelsesverdig språk.

Etter hvert som GPT-teknologien utvikler seg, blir den stadig mer allsidig, kraftig og tilgjengelig.

Enten du chatter uformelt eller bruker avanserte verktøy som Undetectable AIs GPT-drevne chat, SEO Writer, Paraphraser eller CV Builder, benytter du deg av et banebrytende AI-system som er bygget for å produsere menneskelignende resultater.

Prøv Ikke påvisbar AI for å oppleve GPT-teknologi som er skreddersydd for smartere skriving som ikke kan oppdages.