Etter hvert som AI-verktøy som ChatGPT blir mer sofistikerte og tilgjengelige, har det oppstått et presserende problem i utdanningssektoren:

Kan høyskoler og universiteter oppdage ChatGPT-generert innhold på en pålitelig måte?

I denne artikkelen undersøker vi hvordan institusjonene reagerer på fremveksten av generativ AI, og hvilke deteksjonsmetoder som brukes i 2025.

Utfordringene de står overfor, og hvordan studenter kan bruke AI på en ansvarlig måte uten at det går på bekostning av den akademiske integriteten.

Det viktigste å ta med seg

- Høyskoler kan oppdage ChatGPT - men ikke med perfekt nøyaktighet. Verktøy som Turnitin og Copyleaks brukes ofte, men gir likevel falske positive og negative resultater.

- Menneskelig vurdering og stilometrisk analyse er avgjørende for å vurdere uoverensstemmelser mellom en students tidligere arbeid og nye innleveringer.

- Oppdagelse er avhengig av lingvistiske, statistiske og kontekstuelle mønstre, men avanserte AI-resultater kan ofte omgå overfladisk analyse.

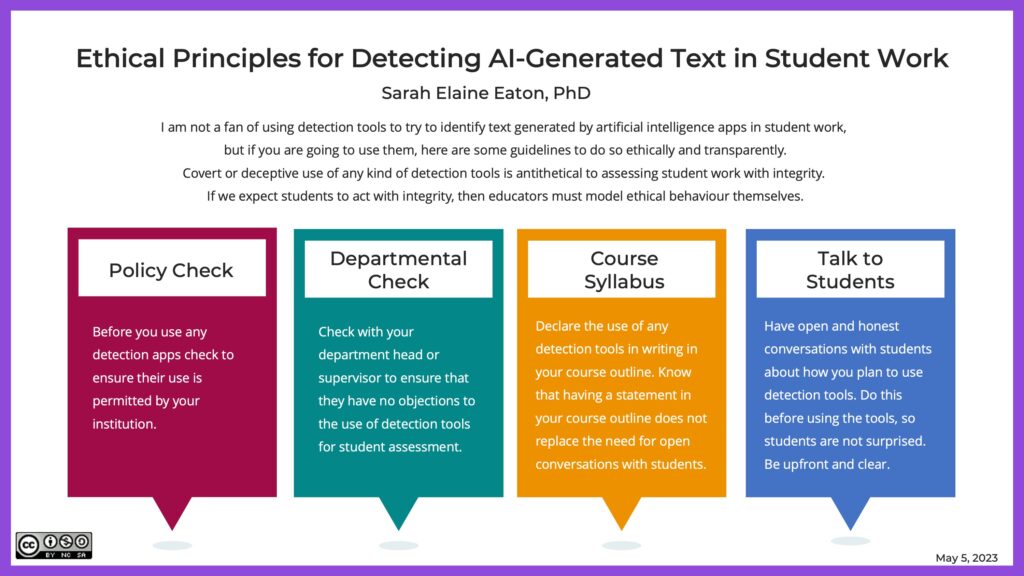

- Lærere oppdaterer retningslinjene og tar i bruk muntlige eksamener, skriveoppgaver i sanntid og AI-bevisste vurderinger for å redusere avhengigheten av deteksjonsverktøy alene.

- Etisk bruk av kunstig intelligens er mulig, særlig når den styres av åpenhet, akademisk redelighet og verktøy som Undetectable AI.

Kan ChatGPT oppdages i 2025?

ChatGPT og andre store språkmodeller har forbedret sin evne til å generere naturlig, sammenhengende og menneskelignende tekst dramatisk.

Samtidig som denne utviklingen åpner opp for et stort pedagogisk potensial, byr den også på nye utfordringer for akademiske institusjoner som ønsker å bevare integriteten til studentenes arbeid.

De fleste AI-detektorer brukerd av høyskolerinkludert Turnitins AI-deteksjonsfunksjon - baserer seg på språklige mønstre, forvirring, og sprøhet for å flagge AI-genererte tekster.

Aldri bekymre deg for at AI oppdager tekstene dine igjen. Undetectable AI Kan hjelpe deg:

- Få AI-assistert skriving til å vises ...menneskelignende.

- Bypass alle de viktigste AI-deteksjonsverktøyene med bare ett klikk.

- Bruk AI trygt og selvsikkert i skole og arbeid.

Disse systemene er imidlertid ikke ufeilbarlige. Mange studenter redigerer AI-resultater eller menneskeliggjør dem ved hjelp av avanserte verktøy for å unngå å bli oppdaget.

Dette våpenkappløpet mellom generativ AI og AI-detektorer har ført til at universitetene må balansere mellom rettferdighet, akademisk integritet og studentenes skiftende behov.

Vanlige deteksjonsmetoder i høyere utdanning

1. Stylometri

Stylometri undersøker studentens unike skrivestil på tvers av tidligere innleveringer - og analyserer grammatikk, tegnsetting, setningsstruktur og ordforråd.

Et kraftig avvik i tonefall eller kompleksitet signaliserer ofte bruk av AI. Denne metoden er spesielt effektiv når læreren har en mappe med elevens tidligere arbeider å sammenligne med.

2. Statistisk mønsteranalyse

AI-generert innhold har ofte unaturlig konsistens i setningslengde, formalitet eller struktur.

Detektorer som Turnitin skanner etter avvik basert på kjente mønstre i menneskelig skriving. Svært redigert AI-innhold kan imidlertid omgå slike analyser.

3. Kontekstuell og semantisk analyse

I stedet for bare å se på grammatikk på overflaten, evaluerer kontekstuell analyse dybde, relevans og sammenheng.

AI-verktøy kan produsere innhold som "høres riktig ut", men som mangler innsiktsfull analyse eller tilknytning til fagstoffet.

4. Deteksjon ved hjelp av maskinlæring

Noen institusjoner bruker AI for å bekjempe AI - de trener opp maskinlæringsmodeller for å skille mellom menneskelig og maskingenerert tekst basert på tusenvis av eksempler på essays.

5. Menneskelig gjennomgang

Til tross for automatisering, Erfarne lærere er fortsatt de mest nøyaktige AI-detektorenespesielt når de kjenner elevenes stemmer.

Faktisk ble en 2025 arXiv-studie fant at erfarne instruktører var bedre enn AI-detektorer til å oppdage subtile AI-genererte oppgaver.

Begrensninger ved AI-deteksjon i akademia

Selv om deteksjonssystemene har blitt bedre, har flere kritiske begrensninger forbli:

- Falske positiver kan urettmessig anklage elever, spesielt de som skriver på en måte som avviker fra normen (f.eks. elever som ikke kan lese og skrive på norsk eller elever med nevrodiversitet).

- Kostnad og tilgjengelighet begrenser universiteter med mindre budsjetter fra å anskaffe de mest avanserte verktøyene for AI-deteksjon.

- Etiske bekymringer oppstår når invasive oppdagelsesmetoder krenker elevenes personvern eller skaper mistillit.

- Ulikhet i bruk av AI kan øke prestasjonsforskjellene ytterligere blant elever med ulik tilgang til AI-kunnskaper og -verktøy.

Disse bekymringene har fått mange institusjoner til å revurdere ikke bare hvordan de oppdager AI - men også hvordan de revurdere vurderingen helt og holdent.

Konsekvenser av å bruke ChatGPT for studenter og høyskoler

Akademisk integritet: AI-genererte innleveringer kan tilsløre studentens sanne forståelse.

Når ChatGPT brukes på uetisk vis, utfordrer det nøyaktigheten i akademiske evalueringer og svekker verdien av karakterer og vitnemål.

Etiske dilemmaer: Fra rettferdighet til personvern - universitetene strever med hvor de skal sette grensen for bruk av kunstig intelligens. Bør kunstig intelligens forbys helt - eller integreres med omtanke?

Langsiktig innvirkning: Overdreven bruk av kunstig intelligens kan svekke viktige ferdigheter som kritisk tenkning, argumentasjon og kreativitet.

Hvis akademiske resultater oppfattes som AI-assisterte, kan troverdigheten til gradene synke i arbeidsgivernes og studieprogrammenes øyne.

Måter å bruke AI-verktøy på en trygg måte (med uoppdagelig AI)

AI trenger ikke å være en fiende av akademisk redelighet - når det brukes riktig, kan det bidra til økt forståelse uten å erstatte originale tanker.

Slik kan studenter bruke AI på en trygg og åpen måte:

- Bruk AI til idémyldring, ikke til å skrive hele essays.

- Oppgi kilder hvis AI bidro til å generere innsikt.

- Rediger kraftig for å gjøre verket til ditt eget.

- Bruk menneskeliggjørende verktøy for å sikre at det du skriver, gjenspeiler din personlige stemme.

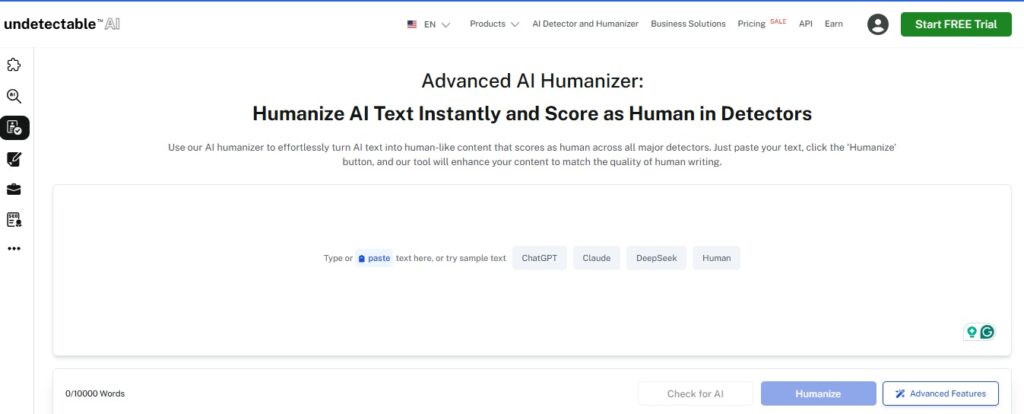

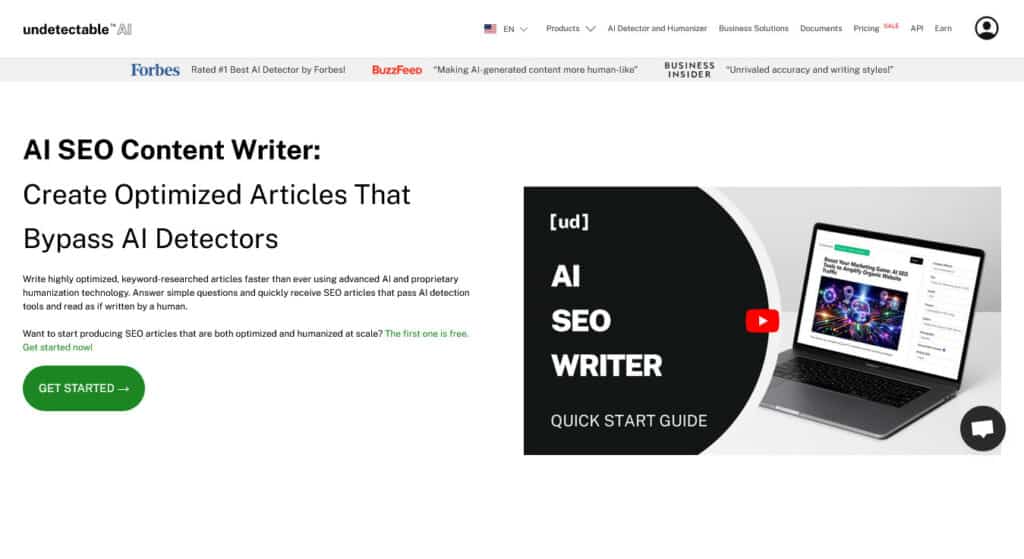

Anbefalte verktøy fra Undetectable AI

- AI Humanizer - Konverterer robot-AI til menneskelignende skrift som samsvarer med din unike stemme.

- AI SEO-innholdsforfatter - Ideell for studenter som driver blogger eller personlige portfolier, og som trenger etisk optimalisert innhold.

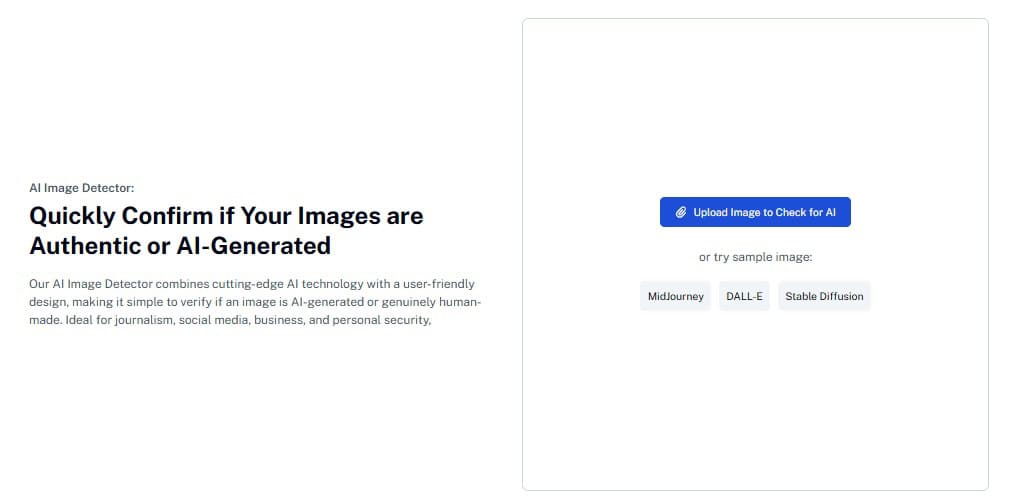

- AI Image Detector - Designet for visuelle prosjekter og multimedieinnsendinger, noe som bidrar til å sikre originalitet og samsvar.

Ved å bruke Undetectable AI-verktøy på en ansvarlig måte kan elevene ta i bruk AI uten å bryte med de akademiske forventningene - og lærere kan bygge tillit gjennom åpenhet.

Sørg for at det du skriver, er i tråd med plattformstandardene - begynn med widgeten nedenfor.

Ofte stilte spørsmål (FAQ)

Kan høyskoler oppdage ChatGPT-generert innhold?

Ja - men ikke alltid. Deteksjonsverktøy kan flagge sannsynlig AI-bruk, men de overser ofte innhold eller identifiserer feilaktig innhold. Menneskelig gjennomgang er fortsatt avgjørende.

Er det juks å bruke ChatGPT for å få hjelp?

Det kommer an på hva. Det kan være greit å bruke ChatGPT til å brainstorme eller avklare et emne hvis læreren godkjenner det. Å utgi AI-generert arbeid som ditt eget regnes som akademisk uredelighet.

Hva skjer hvis en student blir feilaktig beskyldt for å bruke AI?

Falske positive resultater forekommer. Derfor oppfordres institusjonene til å kombinere AI-verktøy med lærernes skjønn før de iverksetter disiplinærtiltak.

Kan uoppdagelige AI-verktøy omgå deteksjon?

Udetekterbar AI bidrar til å menneskeliggjøre innholdet og gjenopprette den naturlige flyten, men det primære formålet er å sikre klarhet og originalitet - ikke å lure deteksjonssystemer.

Vil høyskolene fortsette å utvikle sine retningslinjer for kunstig intelligens?

Absolutt. De fleste institusjoner jobber aktivt med å revidere retningslinjer, utvikle nye evalueringer og utforske hvordan kunstig intelligens kan integreres i utdanningen på en ansvarlig måte.

Konklusjon

Fremtidens utdanning ligger ikke i å unngå kunstig intelligens - men i å lære å bruke den på en klok måte.

Høyskoler i 2025 tar i økende grad i bruk deteksjonsmetoder, men ekte akademisk integritet kommer fra studentenes forståelse, åpenhet og tillit.

Enten du er en student som søker etiske måter å bruke kunstig intelligens påeller en lærer som tilpasser seg et nytt læringslandskap - Udetectable AI gir deg verktøyene du trenger for å gjennomføre reisen med integritet.

Utforsk Uoppdagelig AI og finne etiske, effektive måter å jobbe med AI på i dagens klasserom.