ロボットが世界を支配している! この発言は、数年前までは悪いことだと考えられていたが、今ではそれほど悪いことではないかもしれない。

いくつかのことがあった。 言説 ロボット、特に人工知能が私たちの日常生活やさまざまな産業をどのように変えたかをめぐる。

家事の簡素化であれ、オフィスでのルーチンワークの自動化であれ、AIは間違いなくイノベーションのフロントランナーとしての地位を確立している。

AIの最大の貢献のひとつは、次のようなものだ。 コンテンツ制作.

チャットボットは自然言語処理(NLP)モデルで構築され、クエリに答えて人間のような応答をシミュレートする。

チャットボットは平凡な問い合わせを手助けしてくれるが、学術研究やジャーナリズムのような意図された目的のために、チャットボットが書いたコンテンツが信頼でき、本物であることを確認したいかもしれない。

私たちがカバーします。

チャットボットによって書かれたかどうかを確認する最良の方法をご紹介します。

迅速な解決策:AIディテクターを使ってチャットボットが書いたコンテンツを識別する

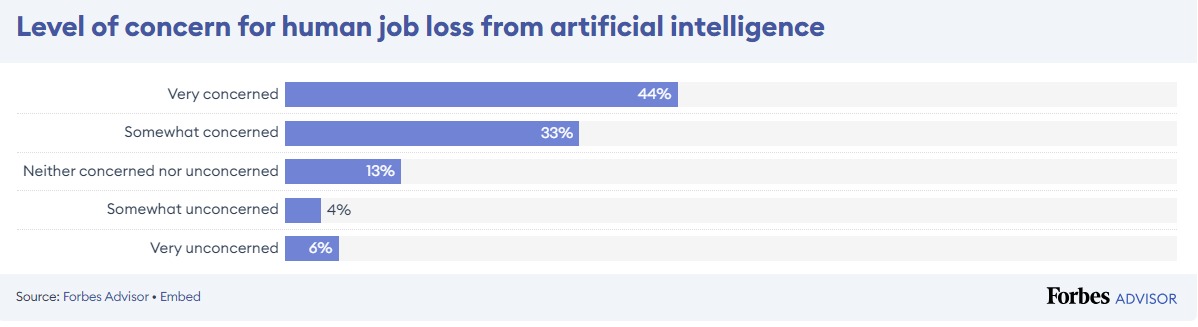

AIは、ほぼすべてを生み出すと予想されている。 1億人の雇用そのため、意欲的な労働者が新しい分野を開拓できるようになると同時に、作業も容易になる。

例えば、AIを搭載したコンテンツ作成ツールは、AIが生成したテキストを作成し、プロセスをより速くすることができる。

しかし、これには真正性についての懸念が伴う。これはどこに当てはまるのだろうか?

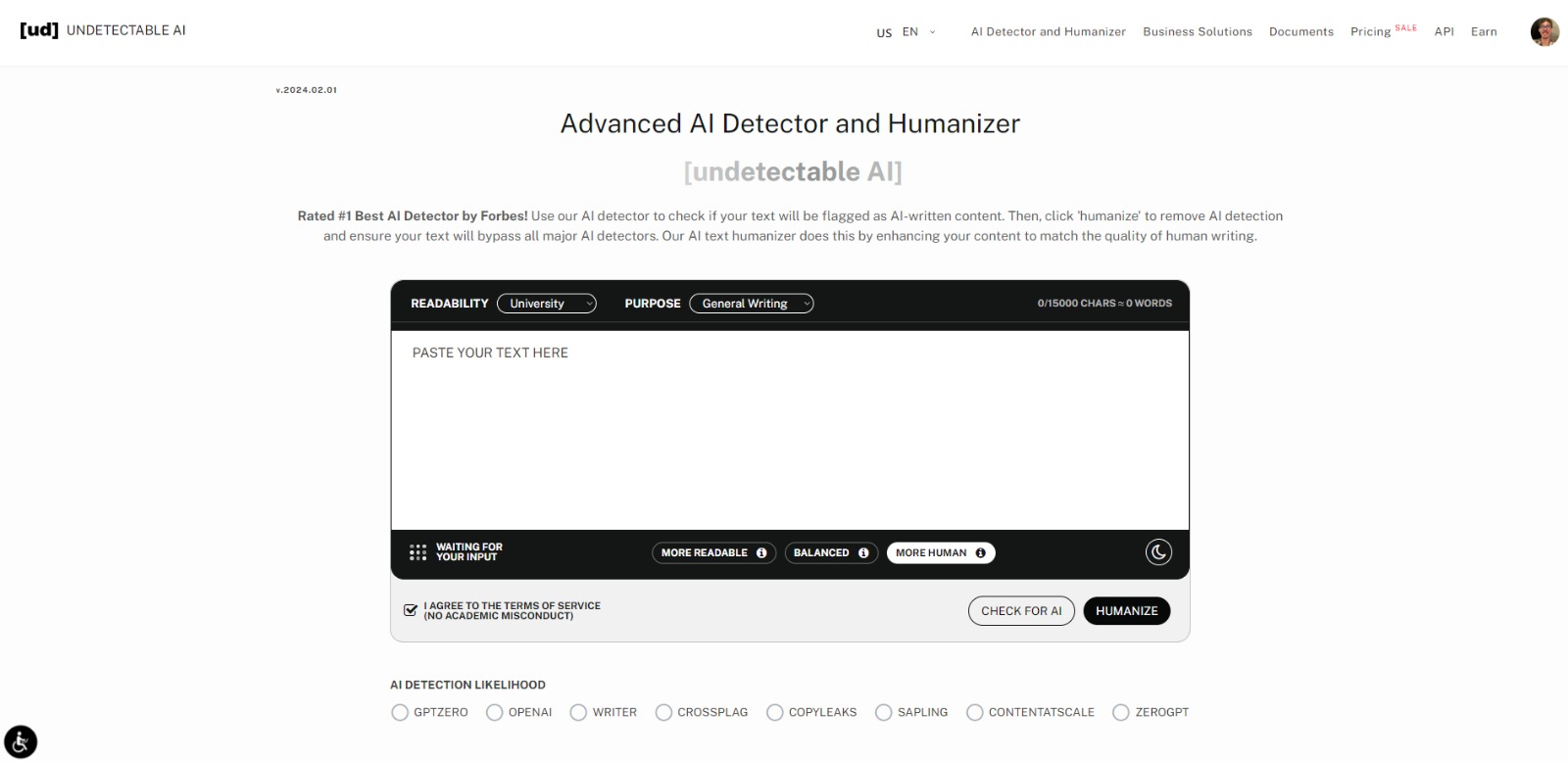

もうAIがあなたのテキストを検出する心配はありません。 Undetectable AI あなたを助けることができる:

- AIがアシストする文章を出現させる 人間らしい。

- バイパス ワンクリックですべての主要なAI検出ツール。

- 用途 AI 無事に そして 堂々 学校でも仕事でも。

研究論文を授業に提出することを考えてみよう。生徒が提出し、教師がその文章がいかにおかしいかに気づく。

を確認する。 先生 のような信頼できるAI検出器を使うことができる。 検出不可能なAI 生徒の作品を素早く効果的に分析する。

AI検出器のおかげで、教師は生徒が提出した論文の真偽について十分な情報を得た上で判断し、必要に応じて適切な措置を取ることができる。

AIディテクターは、AIによってのみ生成されうる言語パターンや構造パターンを分析する。

チャットボットが書いたコンテンツは、肉眼で見るよりも詳細にコンテンツの正確性をレビューする検出器にとって、際立つような特定の特徴を持っている。

コンテンツ制作者は、AIディテクターを使用して作品のオリジナリティを検証し、以下のような可能性のあるインスタンスを追跡することもできる。 意図しない盗作.

したがって、AIが執筆のためのアイデアやインスピレーションを生み出す上で価値があることは間違いないが、AIの利用が倫理的で透明性のあるものであることを確認することが重要だ。

現在では、より多くの機関がこのようなことを認めている。 AIの導入また、Undetectable AIを使って、得られたアイデアを人間的なものにすることもできる。

AIを活用してコンテンツ作成プロセスを容易にすると同時に、コンテンツがオリジナルであり続け、あなた独自のものであることを確認するという、健全なミックスである。

違いを見る準備はできているか?以下のUndetectable AIウィジェットを試して、それがあなたの文章をどのように向上させるかを直接体験してみよう(英語のみ)。

テキストを入力するだけで、より人間的で洗練されたバージョンに変身するのを見ることができる。今すぐ試してみよう!

チャットボットが書いたコンテンツを識別するのに役立つその他の指標

AIは非常に優秀になったため、時として人間とAIが生成したコンテンツの境界線が曖昧になることがある。

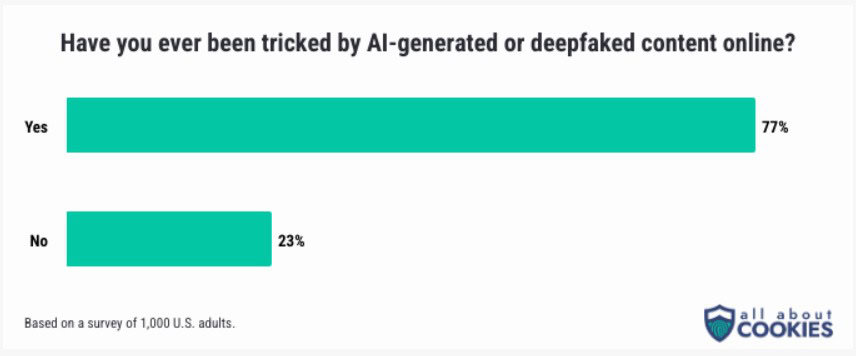

以上 10人中7人 は、何らかの形でAIコンテンツに騙されたことを認めている。AIが進化し、より高度になるにつれて、その適切な使用についてより明確な方針と倫理的ガイドラインが定められるべきである。

AIディテクターはチャットボットが書いたコンテンツを識別するのに有効だが、いくつかの特定の特徴は、それがAIかどうかを手動で識別するのに役立つ。

1.不自然な言語

不自然な言語は、何かがAIによって書かれたかどうかを見分ける最大の兆候のひとつである。

これはどういうことかというと、文章が非常にロボット的で、たいていは過度に形式的だということだ。自然な流れもない。

不自然な言葉の主な兆候には、以下のようなものがある:

- 不必要なのに複雑な言葉や専門用語を多用する。

- カジュアルな表現や創造的な文章が欠けている。

- 文章は一貫したトーンを保つことができず、つぎはぎだらけの感がある。

例えば、生徒がChatGPTに完全に依存することを決めた場合である。 大学入学小論文.

彼らはプロンプトを入力し、コピーし、ペーストし、送信を押す。言語が過度に洗練されているため、彼らの仕事をAIと見抜くのは簡単だ。

その理解度は一般的な生徒のレベルをはるかに超えており、AIが作成したコンテンツではないかと疑われるのも無理はない。

AIが不自然な表現をする傾向があるのは、AIモデルの限界によるものだ。これらのモデルは、単に人間のスピーチパターンを複製し、促されたことに基づいて独自のテキストを作成しようとする。

2.文脈の理解

ここで、イライラするほど親近感の湧く話をしよう:カスタマーサービス・チャットボットに、自社製品の特定の問題について尋ねてみよう。

チャットボットは、あなたの問い合わせに直接答える代わりに、会社のポリシーや製品の使用手順など、一般的な情報を返答する。

チャットボットはこのようにしかプログラムされていないため、あなたはチャットボットからそれ以上のことを引き出すことはできない。残念なことに、あなたは人間のサポートに連絡を取ることにした。

文脈理解の欠如とはこういうものだ。文脈理解とは、その名の通り、関連する状況の中で情報を解釈する能力を必要とする。

私たちは何かを書くときに、そのトピックについてリサーチを行い、具体的で関連性のある情報を提供するからだ。

AIのコンテンツはしばしば支離滅裂で、時には無意味にさえ感じられることがある。さまざまなリソースを表面的に利用するだけなので、AIは言語のニュアンスを正確に解釈できるコンテンツを作るのに苦労する。

3.知識の限界

AIは強力ではあるが、全知全能の存在ではない。特に複雑な知識に関しては、AIは制約を免れない。

しかし、AIは促されたことを遂行することを目的としているため、事実と異なる情報や存在しない情報まで記入してしまう。また、AIが正しいデータを提供できたとしても、それはたいてい古いものだ。

以下は、AIに知識の限界がある一般的な理由である:

- データには偏りがあり、AIがより詳細な情報を提供できるのは、よく表現された視点に限られるということだ。

- AIモデルは膨大なデータセットから構成されるが、その知識の範囲は無限ではなく、どこかで止まらなければならない。

- AIは通常、トレンドについていくのに苦労し、最新の情報が不足している。

AIコンテンツだけに頼っていると、次のような憂慮すべき事態に陥る可能性がある。 誤った情報を広める.

例えば、AIが作成した高度な医療処置に関する記事は、不正確である可能性が高く、研究目的には有害である。

4.文体の不一致

ネットで記事を読んだとき、序章はとても魅力的に見えたが、その後の部分が空回りして、まったく別のライターが書いたように感じたことはないだろうか?

あなたが読んだその記事は、AIが作成したものかもしれない。AIのコンテンツは、その文体に一貫性がないことで悪名高い。

AIモデルが人間の言葉を模倣することに長けているのは事実だ。しかし、明確な文体で一貫性を保つ能力に著しく欠けている。

AIの場合、文体の矛盾は通常どのように見えるかを説明しよう:

- 同じコンテンツの中で、フォーマルからインフォーマルへ、プロフェッショナルからカジュアルへと、トーンはすぐに変化する。

- AIが書いた作品は、文章に一貫した流れがなく、かなり千鳥足に見える。

- 読みにくいのは、視点が多すぎる(あるいは不足している)からだ。

矛盾に気づくことは、読んでいる内容が信用できるかどうかを確かめるために重要である。

5.エラーパターン

過ちを犯すのは人間(そして機械)である。 現在ある最も賢いロボットでさえ間違いを犯す。

エラーのパターンは、AIが生成したコンテンツの一般的な赤信号である。なぜなら、AIモデル自体が常に正しく、あるいは意図したとおりに動作するとは限らず、組織はツールが提供するテキストや情報を検証する品質チェックを行っていないからである。

要するに、AIはコンテンツ生成プロセスを自動化するために使われたのであり、悪いことではないが、放っておくとうまくいかなくなる可能性がある。

文法的な間違いからスペルミス、矛盾した記述、論理的な意味をなさないアイデアまで、さまざまな間違いがある。

なぜこのようなことが起こるのか?AIは複雑なアルゴリズムを持つソフトウェアに過ぎず、バグや不具合が発生する可能性がある。

AIモデルの訓練に使われるデータの質も、ツールの性能に影響を与える可能性がある。

6.事実または個人情報の確認

AIが苦手とするもう一つのことは、AIが提供する情報を検証することだ。AIからの誤報は、以下のように懸念されている。 消費者の75%.

AIが事実や個人の詳細を確認できないことは危険である。一般的に誤った情報は誤解を招き、個人や組織にまで影響を及ぼす可能性がある。

これらは、AIに誤った情報を流されないためのいくつかの方法である:

- 私たち人間は優れたクロスチェッカーなので、読んだコンテンツに記載されている情報源を常にチェックすること。

- 批判的思考力を働かせ、一見しただけですべてを鵜呑みにしないことだ。

- 特に重要度の高いコンテンツに関しては、コンテンツが正確であることを確認するために人間の監視があることを確認すること。

- 時間をかけてAIの複雑さを学び、その能力と限界を理解する。

AIは与えられた情報だけに頼るため、正確なデータを知ることが難しい。つまり、新しい情報はまったく入手できないのだ。

また、AIは複数の情報源にまたがるクロスチェックを行わないし、人間ほど情報の真偽を検証する能力もない。

AIが生成したコンテンツを検出し、簡単に人間らしくする。

結論

このような指標を使えば、あなたが読むコンテンツにもっと自信を持つことができる。

AIはより良くなる一方なので、チャットボットによって書かれたものかどうかをチェックする方法について、鋭い目を持ち続けることが重要だ。

私たちはオンラインで多くのコンテンツを消費しているため、見るものすべてに気を配るのは疲れる。このプロセスを簡素化するために、Undetectable AIがあなたのそばにいる。

検出不可能なAI また、AIヒューマナイザーにより、生成されたコンテンツの読みやすさを向上させることもできる。

だから、あなた自身が制作したコンテンツを安心して利用できる。1つのプラットフォームに2つのツール。

AI技術の利点を受け入れながら、その倫理的な使用を優先し、コミュニケーションの完全性を維持するために誤った情報と闘おう。